Kurzzusammenfassung: Künstliche Intelligenz wird Therapeuten nicht vollständig ersetzen, sondern als ergänzendes Instrument in der psychischen Gesundheitsversorgung dienen. Studien zeigen, dass KI-Chatbots unangemessen reagieren und die für sinnvolle psychologische Veränderung unerlässliche menschliche Verbindung und therapeutische Beziehung nicht nachbilden können.

Die psychische Gesundheitsversorgung steht an einem Wendepunkt. KI-gestützte Therapie-Chatbots verbreiten sich rasant und versprechen rund um die Uhr Zugang zu psychologischer Unterstützung ohne Wartelisten oder hohe Kosten. Für Therapeuten, die diese Entwicklung beobachten, ist die Frage nicht nur akademischer Natur – sie betrifft sie persönlich.

Werden Maschinen die Arbeit ersetzen, deren Beherrschung jahrelange Ausbildung und emotionale Intelligenz erfordert?

Die Sache hat jedoch einen Haken: Die Antwort ist nicht so einfach wie Ja oder Nein. Jüngste Forschungsergebnisse führender Institutionen zeichnen ein differenzierteres Bild, in dem KI sowohl überraschendes Potenzial als auch kritische Grenzen aufweist, die nicht ignoriert werden dürfen.

Was die Forschung tatsächlich über KI-Therapietools aussagt

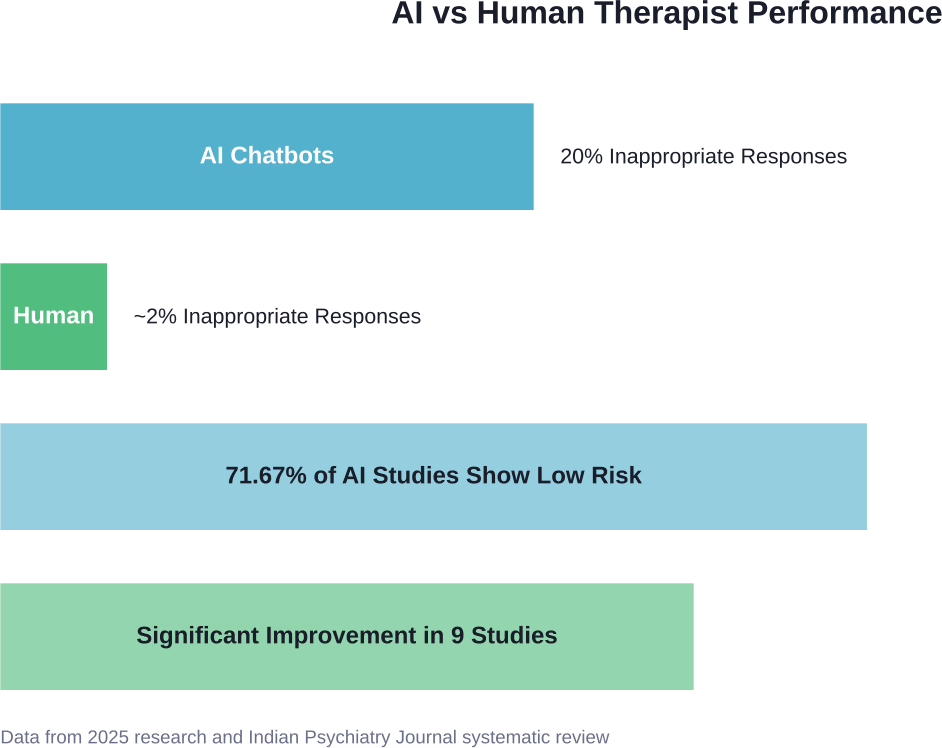

Untersuchungen ergaben, dass KI-Chatbots, die für die Unterstützung im Bereich psychische Gesundheit entwickelt wurden, in 201 von 5 Fällen unangemessen reagierten – also in jeder fünften Antwort. Menschliche Therapeuten hingegen gaben in denselben Situationen selten unangemessene Antworten.

Aber Moment mal. Das ist noch nicht die ganze Geschichte.

Eine 2025 im Indian Psychiatry Journal veröffentlichte systematische Übersichtsarbeit untersuchte KI-gestützte psychologische Interventionen bei Depressionen und Angstzuständen. Die Ergebnisse: Die meisten Studien wiesen ein geringes Risiko (71,671 TP3T) auf, was auf eine hohe Zuverlässigkeit bei spezifischen, klar definierten Aufgaben hindeutet. Neun Studien mit 1.082 Studierenden zeigten statistisch signifikante Verbesserungen der Angst- und Depressionswerte durch den Einsatz von KI-Chatbots.

Also, was ist es – hilfreich oder schädlich?

Die Antwort hängt ganz davon ab, wie diese Tools eingesetzt werden. KI-gestützte Therapie-Tools eignen sich gut für bestimmte Anwendungsbereiche: Symptomverfolgung, Übungen der kognitiven Verhaltenstherapie, Unterstützung bei Krisen-SMS und Psychoedukation. Sie stoßen jedoch – mitunter auf gefährliche Weise – an ihre Grenzen bei komplexen Situationen, die klinische Beurteilung, Sicherheitseinschätzungen und die Arbeit mit Traumata erfordern.

Die Zahlen lügen nicht.

Einer in BMC Psychiatry veröffentlichten Studie (verfügbar über PubMed) zufolge erreichte die Fehldiagnoserate bei schweren psychischen Erkrankungen in Äthiopien 39,161 TP3T, wobei die Rate bei Nicht-Spezialisten höher lag. Dies unterstreicht einen entscheidenden Punkt: Selbst Ärzte haben ohne entsprechende Ausbildung Schwierigkeiten mit der diagnostischen Genauigkeit.

KI-Systeme stehen vor ähnlichen Herausforderungen, verfügen aber nicht über die Fähigkeit, durch Empathie und klinische Intuition Kurskorrekturen vorzunehmen.

Wo KI tatsächlich die psychische Gesundheitsversorgung unterstützt

Trotz ihrer Einschränkungen sind KI-Werkzeuge nicht nutzlos. Ganz im Gegenteil.

Eine 2025 in JMIR Mental Health veröffentlichte Studie untersuchte Chatbots auf Basis kognitiver Verhaltenstherapie zur Behandlung von Depressionen und Angstzuständen. Die Ergebnisse hoben mehrere Bereiche hervor, in denen KI-Tools einen echten Mehrwert bieten:

- Zugänglichkeit und Skalierbarkeit: KI-Chatbots ermöglichen den sofortigen Zugang zu psychologischer Unterstützung ohne Terminvereinbarung, geografische Einschränkungen oder Versicherungsbarrieren. Für unterversorgte Bevölkerungsgruppen, die mit Stigmatisierung oder begrenzter Verfügbarkeit von Therapeuten konfrontiert sind, ist dies von enormer Bedeutung.

- Konstante Verfügbarkeit: Psychische Krisen kennen keine Geschäftszeiten. KI-Tools bieten rund um die Uhr Unterstützung, wenn menschliche Therapeuten nicht verfügbar sind.

- Niedrigere Kostenbarrieren: Obwohl die Preise je nach Plattform variieren, sind KI-Therapie-Tools in der Regel deutlich günstiger als herkömmliche Therapiesitzungen, wodurch psychische Gesundheitsunterstützung auch für Menschen zugänglich wird, die sich die üblichen Preise nicht leisten können.

- Reduzierter Verwaltungsaufwand: Generative KI erweist sich als vielversprechend bei der Bearbeitung von Papierkram, der Protokollierung von Notizen und der Dokumentation von Behandlungsplänen, wodurch Kliniker entlastet werden und sich auf die direkte Patientenversorgung konzentrieren können.

Praxistaugliche Anwendungen

Kognitive Verhaltenstherapie-basierte Chatbots scheinen besonders effektiv für strukturierte Interventionen zu sein. Diese Systeme leiten die Nutzer durch evidenzbasierte Übungen: Gedankenprotokolle, Verhaltensaktivierung, Expositionshierarchien und Entspannungstechniken.

Für Studierende – eine Bevölkerungsgruppe, die zunehmend mit psychischen Problemen konfrontiert ist – zeigten KI-Chatbots, die auf die im DSM-5 definierten Störungen abzielten, messbare Verbesserungen. Studien dokumentierten eine Reduzierung der Angstwerte im GAD-7-Fragebogen und der Depressionssymptome.

Allerdings stellen die unterschiedlichen Studiendesigns und die heterogene Ergebnisdarstellung Herausforderungen für eine breite Generalisierbarkeit dar. Die Evidenzbasis ist zwar vielversprechend, aber noch unvollständig.

Finden Sie heraus, wo KI in der Therapie ihren Platz hat, bevor Sie große Veränderungen erwarten.

Künstliche Intelligenz wird mitunter als Ersatz für Therapeuten diskutiert, spielt aber in Wirklichkeit eine unterstützende Rolle. Sie kann helfen, Informationen zu strukturieren, Muster in Daten aufzudecken oder bei Routineaufgaben zu unterstützen, während der Kern der Therapie – Vertrauen, Kontext und menschliche Verbindung – unverändert bleibt.

AI Superior Der Fokus liegt darauf, KI in realen Arbeitsabläufen nutzbar zu machen. Sie arbeiten mit Organisationen zusammen, um klare Anwendungsfälle zu definieren und anschließend maßgeschneiderte Lösungen zu entwickeln und zu integrieren, die sich an die bestehenden Servicebereitstellungsprozesse anpassen, anstatt ein völlig neues System zu erzwingen.

Wenn Sie den Einsatz von KI in der Therapie oder im Bereich der psychischen Gesundheit erwägen, ist es sinnvoller, klein anzufangen und die Technologie in der Praxis zu testen. Kontaktieren Sie uns. AI Superior um zu erkunden, was verbessert werden kann, ohne die heutige Arbeitsweise Ihres Teams zu stören.

Die unersetzlichen menschlichen Elemente

Und jetzt wird es interessant.

Therapie besteht nicht nur darin, korrekte Informationen zu vermitteln oder Behandlungsprotokolle zu befolgen. Die therapeutische Beziehung selbst – die Verbindung zwischen Therapeut und Klient – trägt maßgeblich zum Heilungsprozess bei.

Die Forschung belegt durchweg, dass die therapeutische Beziehung den Behandlungserfolg zuverlässiger vorhersagt als spezifische Interventionstechniken. Klienten, die sich wirklich verstanden, wertgeschätzt und unterstützt fühlen, zeigen unabhängig von der angewandten Therapieform bessere Fortschritte.

Kann KI das nachbilden?

Noch nicht. Wahrscheinlich nie im umfassendsten Sinne.

Laut einer in Frontiers in Psychology veröffentlichten Studie ist die menschliche Interaktion in der psychischen Gesundheitsversorgung weiterhin von größter Bedeutung. KI-Systemen fehlen mehrere entscheidende Fähigkeiten:

| Fähigkeit des menschlichen Therapeuten | Aktueller Status der KI | Warum es wichtig ist |

|---|---|---|

| Echte Empathie und emotionale Einfühlung | Nur simulierte Antworten | Kunden erkennen Authentizität; Vertrauen hängt davon ab. |

| Komplexe Sicherheitsbewertungen | Begrenzt durch Trainingsdaten | Die Beurteilung des Suizidrisikos erfordert ein differenziertes Urteilsvermögen. |

| Kulturelle Kompetenz und Kontext | Oftmals mangelt es an kultureller Spezifik | Eine wirksame Therapie muss kulturelle Hintergründe berücksichtigen. |

| Ethische Entscheidungsfindung in Grauzonen | Schwierigkeiten mit mehrdeutigen Situationen | Psychische Erkrankungen bieten selten eindeutige Szenarien. |

| Adaptive Flexibilität | Durch die Programmierung eingeschränkt | Menschen passen ihre Strategie an das Feedback von Moment zu Moment an. |

Mal ehrlich: Therapie ist anstrengend. Und das soll sie auch sein. Wachstum findet im Unbehagen statt, und erfahrene Therapeuten wissen, wie sie Klienten produktiv fördern und gleichzeitig deren Sicherheit gewährleisten können.

KI-Chatbots können nicht erkennen, wenn die Körpersprache eines Menschen dessen Worten widerspricht. Sie können die bedeutungsvolle Pause vor der Beantwortung einer Frage nicht wahrnehmen. Sie spüren nicht den Schmerz eines Menschen und freuen sich nicht über den Moment des Durchbruchs, wenn die Erkenntnis greifbar wird.

Was Experten für psychische Gesundheit tatsächlich sagen

Die American Psychological Association hat ethische Leitlinien für KI in der beruflichen Praxis veröffentlicht. Ihre Position erkennt sowohl potenzielle Vorteile als auch ernsthafte Bedenken hinsichtlich unregulierter KI-gestützter Tools für die psychische Gesundheit an.

Experten auf diesem Gebiet betonen immer wieder einen entscheidenden Unterschied: KI als Erweiterung versus KI als Ersatz.

Augmentation bedeutet den Einsatz von KI zur Unterstützung der klinischen Arbeit – beispielsweise durch automatisierte Screening-Tools, die Transkription von Sitzungsnotizen, die Symptomverfolgung zwischen den Terminen und die Bereitstellung psychoedukativer Inhalte. Dieser Ansatz nutzt die Stärken der Technologie und wahrt gleichzeitig die menschliche Aufsicht.

Der Begriff „Ersatz“ bedeutet, menschliche Therapeuten vollständig durch KI zu ersetzen. Die meisten Experten halten dies für ungeeignet für eine umfassende psychische Gesundheitsversorgung, insbesondere für Menschen mit schweren psychischen Erkrankungen, komplexen Traumata oder akuten Sicherheitsbedenken.

Praktiker äußern unterschiedliche Ansichten zu KI-Tools, von vorsichtigem Optimismus bis hin zu tiefer Besorgnis. Viele sehen in KI-Tools potenzielle Verbündete für einen besseren Zugang zur Gesundheitsversorgung, befürchten aber Qualitätssicherung, Haftungsfragen und die Abwertung klinischer Expertise.

Das Stigma-Problem

Die Stanford-Studie hob Folgendes hervor: Unregulierte KI-Chatbots können tatsächlich zur Stigmatisierung psychischer Erkrankungen beitragen und gefährliche Ratschläge geben.

Ohne angemessene Aufsicht können KI-Systeme schädliche Stereotypen verstärken, zu simple Lösungen für komplexe Probleme anbieten oder nicht erkennen, wann ein professionelles Eingreifen dringend erforderlich ist.

Eine in der Studie analysierte Chatbot-Antwort teilte einer Person, die unter erheblichem Kummer litt, im Wesentlichen mit, dass es jedem manchmal so gehe – eine Antwort, die echtes Leid verharmlost und die Betroffenen davon abhalten könnte, Hilfe zu suchen.

Die Krise der sozialen Kontakte

Schauen Sie, es gibt einen umfassenderen Kontext, der es wert ist, untersucht zu werden.

Die soziale Isolation in den Vereinigten Staaten hat ein alarmierendes Ausmaß erreicht. Laut Brookings haben nur noch 131 % der Erwachsenen zehn oder mehr enge Freunde – im Vergleich zu 331 % im Jahr 1990. Junge Menschen sind besonders stark von Isolation betroffen, obwohl sie in der technologisch vernetztesten Zeit der Geschichte leben.

Was geschieht, wenn KI-Chatbots die echte menschliche Interaktion in therapeutischen Kontexten ersetzen?

Manche Forscher befürchten, dies könnte die soziale Isolation eher verstärken als ihr entgegenwirken. Wenn Menschen sich zunehmend KI zuwenden, um emotionale Unterstützung zu erhalten, anstatt menschliche Beziehungen aufzubauen – ob therapeutisch oder anderweitig –, könnten die langfristigen Folgen für die psychische Gesundheit erheblich sein.

Der Mensch ist auf Verbindung angewiesen. Therapie wirkt unter anderem deshalb, weil sie eine heilsame emotionale Erfahrung ermöglicht: von einem anderen Menschen wirklich gesehen und akzeptiert zu werden. Ein KI-System, egal wie hochentwickelt, kann dieses grundlegende menschliche Bedürfnis nicht erfüllen.

Regulierungs- und Aufsichtsbedenken

Hier wird die Sache kompliziert.

Der Bereich der KI im Bereich der psychischen Gesundheit ist nach wie vor weitgehend unreguliert. Unternehmen können Therapie-Chatbots ohne klinische Aufsicht, evidenzbasierte Protokolle oder Sicherheitsprüfungen auf den Markt bringen, die mit den Anforderungen von Pharma- oder Medizinprodukteunternehmen vergleichbar sind.

Dies birgt erhebliche Risiken. KI-Systeme, die mit verzerrten Daten trainiert wurden, könnten verschiedenen Bevölkerungsgruppen eine ungleichmäßige Versorgungsqualität bieten. Chatbots ohne angemessene Sicherheitsvorkehrungen könnten Warnsignale schwerwiegender Erkrankungen übersehen oder Ratschläge geben, die die Symptome verschlimmern.

Die American Psychological Association und andere Berufsverbände fordern ethische Richtlinien und regulatorische Rahmenbedingungen, doch die Umsetzung hinkt der technologischen Entwicklung weit hinterher.

Sowohl Therapeuten als auch Patienten benötigen Schutz: klare Standards dafür, was KI-gestützte Tools für die psychische Gesundheit leisten dürfen und was nicht, Transparenz über deren Grenzen und Verantwortlichkeit, wenn Systeme Schaden verursachen.

Die wirtschaftliche Realität

Eine Studie der Brookings Institution zum Thema Arbeitsplatzverlust durch KI zeigt besorgniserregende Trends. Mehr als 301.030 aller Arbeitnehmer könnten erleben, dass mindestens 501.030 ihrer beruflichen Tätigkeiten durch generative KI-Technologien beeinträchtigt werden. Besonders gefährdet sind Büroangestellte sowie Personen mit mittlerem bis hohem Lohnniveau.

Gilt das aber auch für Therapeuten?

Teilweise. Einstiegspositionen im therapeutischen Bereich – etwa ehrenamtliche Mitarbeiter an Krisentelefonen, Peer-Berater oder Ansprechpartner für Erstgespräche – könnten durch KI-Tools ersetzt werden. Hochspezialisierte klinische Tätigkeiten, die eine fortgeschrittene Ausbildung erfordern, scheinen zumindest vorerst sicherer zu sein.

Die allgemeine Arbeitsmarktlage zeigt, dass Umschulungsprogramme oft Schwierigkeiten haben, entlassenen Mitarbeitern einen erfolgreichen Übergang ins Berufsleben zu ermöglichen. Die Teilnahmequoten an solchen Programmen variieren stark zwischen den Bundesstaaten und reichen von 141 bis 961 Teilnehmern an Präsenzschulungen.

Für Fachkräfte im Bereich der psychischen Gesundheit bedeutet Relevanz wahrscheinlich, KI als Werkzeug zu nutzen und gleichzeitig einzigartige menschliche Kompetenzen zu vertiefen: die Konzeptualisierung komplexer Fälle, kulturelle Sensibilität, ethisches Urteilsvermögen und Beziehungsaufbau.

Wie die Zukunft tatsächlich aussieht

Und wo stehen wir nun?

Das realistischste Szenario ist nicht der vollständige Ersatz, sondern die Transformation. KI-Tools werden zunehmend Routineaufgaben übernehmen: Symptom-Screening, Terminplanung, Sitzungsnotizen, Hausaufgaben, psychoedukative Module und Unterstützung zwischen den Sitzungen.

Menschliche Therapeuten werden sich auf das konzentrieren, was Maschinen nicht können: den Aufbau therapeutischer Allianzen, die Bewältigung komplexer klinischer Präsentationen, die Behandlung von Traumata und Bindungswunden, das Treffen differenzierter Sicherheitsentscheidungen und die Bereitstellung einer authentischen menschlichen Präsenz, die die Heilung ermöglicht.

Dieses Hybridmodell könnte den Zugang zur psychischen Gesundheitsversorgung sogar verbessern. KI-gestützte Systeme dienen als erste Anlaufstelle und leiten Fälle an menschliche Fachkräfte weiter, wenn Komplexität oder Risiko zunehmen. So erhalten mehr Menschen Unterstützung; diejenigen, die menschliche Hilfe benötigen, bekommen diese weiterhin.

Die Forschung zu KI-gestützten Therapieunterstützungstools zeigt vielversprechende Ergebnisse, wenn KI die von Menschen geleitete Gruppentherapie ergänzt. Die Kombination verbessert sowohl die Wirksamkeit als auch die Therapietreue in der psychischen Gesundheitsversorgung.

Das ist der ideale Punkt: Die KI erledigt ihre Aufgaben, die sie gut kann, und der Mensch liefert das, was nur der Mensch bieten kann.

Häufig gestellte Fragen

Können KI-gestützte Therapie-Chatbots wirklich bei Depressionen und Angstzuständen helfen?

Studien belegen, dass KI-Chatbots messbare Verbesserungen bei leichten bis mittelschweren Depressionen und Angstzuständen bewirken können, insbesondere bei der Durchführung strukturierter kognitiver Verhaltenstherapieübungen. Neun Studien mit 1.082 Studierenden zeigten statistisch signifikante Verbesserungen der Angst- und Depressionswerte. Diese Tools eignen sich jedoch am besten als Ergänzung und nicht als Ersatz für professionelle Hilfe, insbesondere bei schweren Erkrankungen.

Sind KI-Therapie-Apps sicher?

Die Sicherheit variiert stark. Studien haben gezeigt, dass KI-Chatbots häufig unangemessen reagierten, und unregulierte Systeme können zur Stigmatisierung beitragen oder gefährliche Ratschläge geben. Für grundlegende Psychoedukation und Symptomverfolgung sind viele KI-Tools relativ sicher. Bei Kriseninterventionen, komplexen psychischen Erkrankungen oder Traumatherapie bleibt die Unterstützung durch Fachkräfte unerlässlich. Prüfen Sie daher immer, ob eine App klinisch geprüft wird.

Werden Therapeuten aufgrund von KI ihre Arbeitsplätze verlieren?

Ein vollständiger Ersatz ist unwahrscheinlich. KI wird die therapeutische Arbeit voraussichtlich eher verändern als sie zu eliminieren. Einstiegspositionen im Supportbereich sind stärker von Verdrängung bedroht, während spezialisierte klinische Positionen, die komplexes Urteilsvermögen, interkulturelle Kompetenz und Beziehungsfähigkeiten erfordern, für KI weiterhin schwer zu replizieren sind. Therapeuten, die KI-Tools integrieren und gleichzeitig ihre einzigartigen menschlichen Kompetenzen weiterentwickeln, werden voraussichtlich erfolgreich sein.

Was kann KI besser als menschliche Therapeuten?

KI zeichnet sich durch ihre ständige Verfügbarkeit, den sofortigen Zugang ohne Wartezeiten, geringere Kosten, die kontinuierliche Durchführung strukturierter Interventionen, die Verlaufsbeobachtung von Symptomen, die Automatisierung administrativer Aufgaben und die Skalierbarkeit für unterversorgte Bevölkerungsgruppen aus. Diese Stärken machen KI wertvoll für die Erweiterung des Zugangs zur psychischen Gesundheitsversorgung, insbesondere für die Erstunterstützung und das kontinuierliche Üben von Fertigkeiten zwischen den Therapiesitzungen.

Was kann KI in der Therapie nicht ersetzen?

Künstliche Intelligenz kann weder echte Empathie noch authentische menschliche Beziehungen, komplexe Sicherheitsbewertungen hinsichtlich Suizid- oder Selbstgefährdungsrisiko, differenzierte kulturelle Kompetenz, ethische Entscheidungsfindung in unklaren Situationen, die Verarbeitung von Traumata, die Feingefühl erfordert, noch die therapeutische Beziehung selbst – die laut Forschungsergebnissen den Behandlungserfolg besser vorhersagt als spezifische Techniken – bieten. Die menschliche Fähigkeit, unausgesprochene Emotionen zu erfassen und sich flexibel anzupassen, liegt jenseits der aktuellen KI-Kapazitäten.

Wie genau sind KI-gestützte Diagnosen im Bereich psychische Gesundheit?

Die diagnostische Genauigkeit von KI variiert stark in Abhängigkeit von der Erkrankung und der Qualität der Trainingsdaten. Studien zeigen, dass selbst menschliche Kliniker häufig Fehldiagnosen stellen (39,161 TP3T bei schweren psychiatrischen Störungen in einer Studie), insbesondere Nicht-Spezialisten. KI-Systeme stehen vor ähnlichen Herausforderungen, da ihnen die Möglichkeit fehlt, durch klinische Intuition Korrekturen vorzunehmen. KI-Diagnostiktools sollten die umfassende professionelle Beurteilung unterstützen, nicht ersetzen.

Sollte ich einen KI-Chatbot nutzen, anstatt einen Therapeuten aufzusuchen?

Für unmittelbare Unterstützung, Psychoedukation oder das Üben von Bewältigungsstrategien, wenn professionelle Hilfe nicht verfügbar ist, können KI-Chatbots hilfreich sein. Sie sollten jedoch keine professionelle Therapie bei mittelschweren bis schweren psychischen Erkrankungen, Traumata, akuten Sicherheitsrisiken oder Situationen, die eine diagnostische Abklärung erfordern, ersetzen. KI-Tools sollten eher als ergänzende Unterstützung denn als Ersatz für eine umfassende Betreuung betrachtet werden.

Fazit

Wird KI Therapeuten ersetzen? Nein – aber sie wird die Arbeitsweise der Therapie verändern.

Die Erkenntnisse deuten auf eine Zukunft der Zusammenarbeit hin, in der Technologie den Zugang erweitert, menschliche Expertise aber weiterhin zentral für eine wirksame psychische Gesundheitsversorgung bleibt. Künstliche Intelligenz übernimmt Routineaufgaben und bietet unmittelbare Unterstützung; Menschen bewältigen komplexe Zusammenhänge und bauen heilsame Beziehungen auf.

Hier geht es nicht darum, sich zwischen menschlichen Therapeuten und KI-Tools zu entscheiden. Es geht darum, beides sinnvoll zu integrieren, um mehr Menschen effektiver zu helfen.

Für Therapeuten, die um ihre berufliche Zukunft bangen: Vertiefen Sie Ihre Beziehungsfähigkeiten, Ihre interkulturelle Kompetenz und Ihre Fähigkeit, komplexe Fälle zu bearbeiten. Diese einzigartigen menschlichen Fähigkeiten gewinnen zunehmend an Wert, wenn KI Routinearbeiten übernimmt.

Für Menschen, die psychologische Unterstützung suchen: Nutzen Sie KI-Tools als Hilfsmittel oder Ergänzung, aber meiden Sie in schwierigen Situationen nicht den menschlichen Kontakt. Die therapeutische Beziehung selbst besitzt eine heilende Kraft, die Algorithmen nicht nachahmen können.

Die psychische Gesundheitsversorgung steht an einem Scheideweg – doch der Weg in die Zukunft führt wohl eher über Zusammenarbeit als über Ersatz. Technologie und Menschlichkeit im Zusammenspiel könnten endlich dazu beitragen, dass qualitativ hochwertige psychische Gesundheitsversorgung für alle Bedürftigen zugänglich wird.