Resumen rápido: Las herramientas de análisis predictivo combinan modelos estadísticos, aprendizaje automático y minería de datos para pronosticar resultados futuros a partir de datos históricos. El conjunto de tecnologías abarca entornos de programación (Python, R), plataformas estadísticas (IBM SPSS, SAS), herramientas de inteligencia empresarial (Tableau, Power BI), plataformas de AutoML (DataRobot, H2O.ai) y soluciones basadas en la nube (AWS SageMaker, Azure ML) adaptadas a diferentes niveles de conocimientos técnicos y casos de uso.

El análisis predictivo determina la probabilidad de resultados futuros mediante técnicas como la minería de datos, la estadística, el modelado de datos, la inteligencia artificial y el aprendizaje automático. Organizaciones de diversos sectores utilizan estas herramientas para interpretar patrones de datos históricos y tomar decisiones informadas sobre riesgos, oportunidades y comportamientos de los clientes.

El mercado de análisis predictivo en 2026 ofrece desde soluciones sin código para analistas de negocio hasta ecosistemas de aprendizaje automático empresariales diseñados para equipos de ciencia de datos. La elección de la herramienta adecuada depende de la madurez de su organización, sus casos de uso y su infraestructura tecnológica actual.

Pero aquí está la clave: no todas las herramientas de análisis predictivo ofrecen los mismos resultados. La plataforma adecuada cambia la forma en que los equipos distribuyen su tiempo, pasando de la preparación de datos a las predicciones reales que generan ingresos. Los analistas de marketing, por ejemplo, suelen dedicar entre 40 y 30 minutos de su tiempo a preparar datos para el análisis, dejando poco margen para las previsiones que realmente importan.

¿Qué se considera una herramienta de análisis predictivo?

Las herramientas de análisis predictivo utilizan modelos estadísticos, técnicas de minería de datos y aprendizaje automático para analizar datos empresariales actuales e históricos y generar pronósticos precisos. Estas plataformas ayudan a las empresas a definir la probabilidad de eventos futuros o desconocidos.

La distinción es importante porque no todas las plataformas de análisis son predictivas. El análisis descriptivo indica qué sucedió. El análisis diagnóstico explica por qué sucedió. El análisis predictivo, en cambio, pronostica qué sucederá a continuación basándose en patrones en los datos.

Las plataformas de análisis predictivo reales combinan varias capacidades básicas:

- Integración de datos procedentes de múltiples fuentes (bases de datos, hojas de cálculo, servicios en la nube).

- Bibliotecas de algoritmos y modelos estadísticos (regresión, clasificación, series temporales)

- Entrenamiento y validación de modelos de aprendizaje automático

- Ingeniería de características automatizada y selección de variables

- Infraestructura de implementación y monitoreo del modelo

- Herramientas de visualización para interpretar predicciones

Las herramientas genéricas de inteligencia empresarial suelen incluir funciones básicas de previsión. Sin embargo, carecen de la profundidad necesaria para un modelado predictivo sofisticado. Las plataformas predictivas avanzadas ofrecen técnicas como métodos de conjunto, redes neuronales y potenciación de gradiente, que proporcionan una precisión notablemente superior.

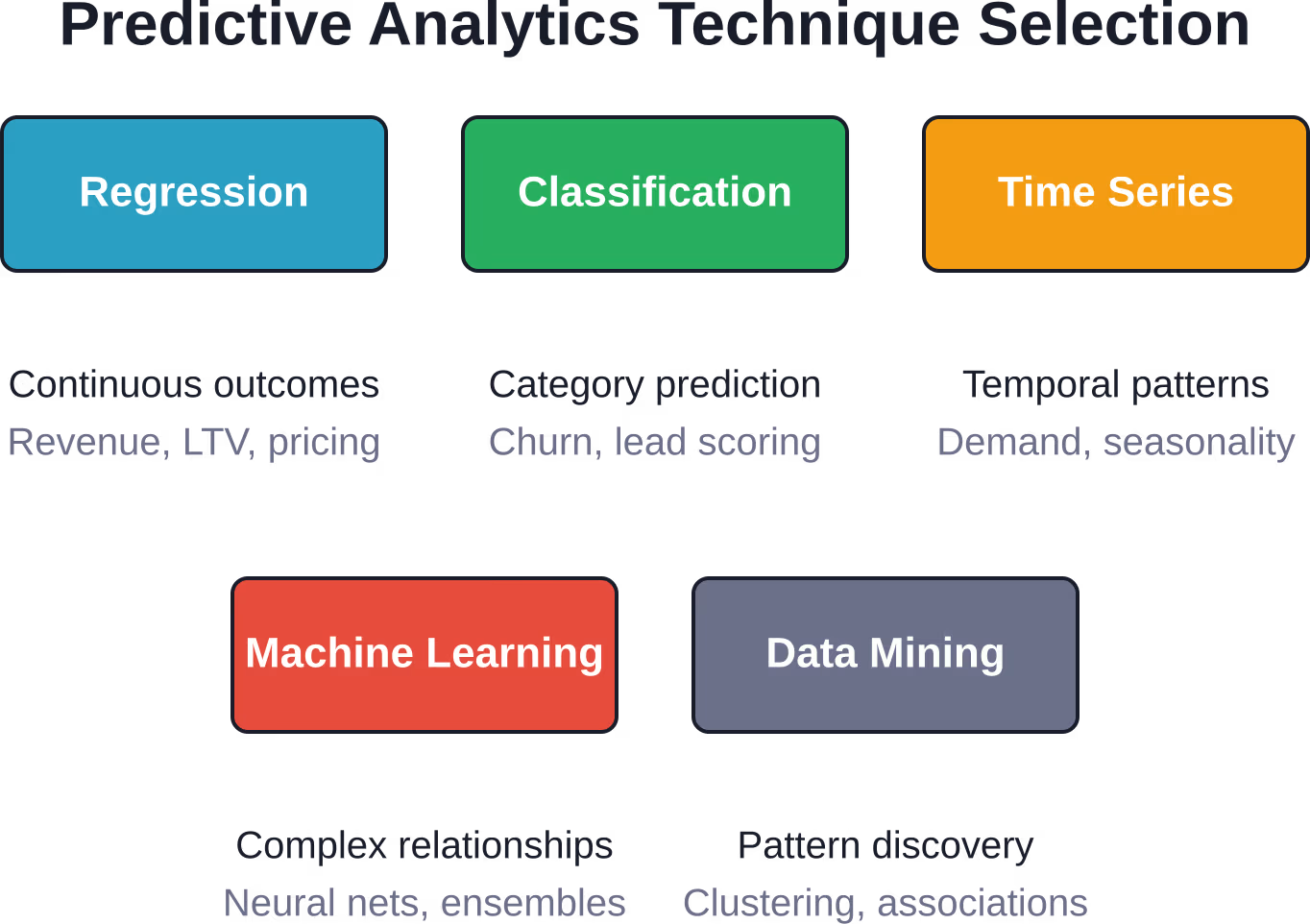

Técnicas básicas de análisis predictivo

Comprender las técnicas que sustentan el análisis predictivo ayuda a determinar qué herramientas se necesitan realmente. Los distintos métodos se adaptan a diferentes tipos de predicción, y no todas las plataformas son compatibles con todas las técnicas.

Análisis de regresión

Los modelos de regresión predicen resultados numéricos continuos. La regresión lineal funciona para relaciones sencillas, como predecir los ingresos por ventas en función del gasto en publicidad. Variantes más complejas, como la regresión polinómica y la regresión de cresta, manejan patrones no lineales y evitan el sobreajuste.

Esta técnica requiere datos históricos limpios con relaciones identificadas entre las variables. Los equipos de marketing utilizan la regresión para pronosticar el valor de vida del cliente, mientras que los departamentos financieros predicen los ingresos trimestrales basándose en las tendencias estacionales y las señales del mercado.

Modelos de clasificación

La clasificación predice resultados categóricos: decisiones de sí/no, categorías de riesgo, segmentos de clientes. La regresión logística, los árboles de decisión y las máquinas de vectores de soporte se incluyen en esta categoría.

Los sistemas de puntuación de clientes potenciales se basan en gran medida en la clasificación. El modelo analiza cientos de atributos (puesto de trabajo, tamaño de la empresa, comportamiento en el sitio web) para clasificar a los prospectos como de alta o baja probabilidad de conversión. Las organizaciones sanitarias utilizan la clasificación para predecir el riesgo de reingreso hospitalario o la probabilidad de diagnóstico de una enfermedad.

Pronóstico de series temporales

Las técnicas de series temporales analizan datos recopilados a intervalos regulares para predecir valores futuros. Los modelos ARIMA, el suavizado exponencial y Prophet (la herramienta de pronóstico de código abierto de Meta) destacan por su capacidad para capturar patrones estacionales, tendencias y comportamientos cíclicos.

Las empresas minoristas utilizan la previsión de series temporales para la planificación de inventarios. Las plataformas de comercio electrónico predicen los picos de demanda durante las festividades. Las instituciones financieras pronostican los precios de las acciones y las fluctuaciones monetarias mediante sofisticados modelos de series temporales que incorporan múltiples variables.

Algoritmos de aprendizaje automático

El aprendizaje automático mejora el análisis predictivo al optimizar automáticamente las predicciones a medida que se dispone de más datos. Los bosques aleatorios, las máquinas de potenciación de gradiente (GBM), las redes neuronales y las arquitecturas de aprendizaje profundo manejan relaciones complejas y no lineales que los métodos estadísticos tradicionales no detectan.

Según una investigación del programa de análisis de negocios en línea de William & Mary, las técnicas de aprendizaje automático han mejorado el análisis predictivo para empresas de diversos sectores. El uso del aprendizaje automático permite que los sistemas procesen millones de datos simultáneamente, algo que sería inviable con el modelado estadístico manual.

Por ejemplo, un algoritmo de aprendizaje automático que gestiona una campaña publicitaria de pago por clic podría establecer un límite superior de $0.25 para la puja por palabras clave. Al incorporar miles de puntos de datos, el algoritmo podría determinar que $0.14 representa la puja óptima para obtener el máximo retorno de la inversión (ROI), un nivel de precisión difícil de alcanzar mediante análisis manual.

Minería de datos y reconocimiento de patrones

La minería de datos extrae patrones previamente desconocidos de grandes conjuntos de datos. Los algoritmos de agrupamiento agrupan a clientes similares sin categorías predefinidas. El aprendizaje de reglas de asociación descubre qué productos compran con frecuencia los clientes juntos. La detección de anomalías identifica patrones inusuales que podrían indicar fraude o fallos del sistema.

El aprendizaje automático y el análisis predictivo son herramientas esenciales para descubrir y comprender grandes conjuntos de datos. Estas técnicas se complementan: la minería de datos descubre patrones, mientras que el modelado predictivo utiliza esos patrones para pronosticar resultados futuros.

Categorías de herramientas de análisis predictivo

Las plataformas de análisis predictivo abarcan desde soluciones sin código para analistas de negocio hasta ecosistemas de aprendizaje automático empresariales diseñados para equipos de ciencia de datos. El mercado se segmenta en distintas categorías según los requisitos técnicos, la especificidad de los casos de uso y la complejidad de la implementación.

Plataformas de software estadístico

Las herramientas estadísticas tradicionales como IBM SPSS, SAS y Stata dominaron el análisis predictivo durante décadas. Estas plataformas ofrecen capacidades integrales de modelado estadístico, amplia documentación y una fiabilidad comprobada para la investigación académica y empresarial.

IBM SPSS ofrece interfaces intuitivas para análisis de regresión, análisis factorial y otras técnicas clásicas. SAS proporciona análisis robustos, con especial dominio en sectores regulados como el farmacéutico y el financiero. Estas herramientas requieren conocimientos estadísticos, pero no exigen experiencia en programación para análisis básicos.

¿La limitación? No fueron diseñados para los flujos de trabajo modernos de aprendizaje automático ni para la infraestructura de big data. Los científicos de datos prefieren cada vez más alternativas más flexibles.

Lenguajes y bibliotecas de programación

Python y R son los entornos más populares para el análisis predictivo entre los equipos de ciencia de datos. Ambos lenguajes ofrecen amplias bibliotecas de aprendizaje automático, comunidades activas y flexibilidad para el desarrollo de modelos personalizados.

La biblioteca scikit-learn de Python proporciona implementaciones de docenas de algoritmos. TensorFlow y PyTorch impulsan los modelos de aprendizaje profundo. Pandas se encarga de la manipulación de datos. El ecosistema abarca todo el flujo de trabajo de análisis predictivo, desde la limpieza de datos hasta la implementación del modelo.

R se especializa en computación estadística con paquetes como caret, randomForest y glmnet. El lenguaje destaca en el análisis exploratorio de datos y la visualización estadística mediante ggplot2. Los estadísticos investigadores prefieren R por su amplia cobertura de técnicas estadísticas avanzadas.

Estas herramientas requieren conocimientos de programación. Sin embargo, ofrecen la máxima flexibilidad y personalización para equipos con experiencia técnica.

Herramientas de inteligencia empresarial con funciones predictivas.

Plataformas como Tableau, Microsoft Power BI y Qlik han integrado capacidades predictivas en sus soluciones de inteligencia empresarial. Estas herramientas se centran en la accesibilidad: los usuarios empresariales pueden generar pronósticos sin necesidad de escribir código ni comprender algoritmos.

Tableau se integra con R y Python para la creación de modelos personalizados, a la vez que ofrece funciones de previsión integradas para datos de series temporales. Power BI incluye funciones de AutoML mediante la integración con Azure. Estas plataformas se conectan a más de 100 fuentes de datos, incluyendo bases de datos, hojas de cálculo y servicios en la nube.

La disyuntiva radica en la sofisticación. La previsión integrada funciona bien para escenarios estándar, pero carece de la profundidad necesaria para modelos complejos. Los equipos financieros que utilizan estas herramientas para la previsión de ingresos, junto con señales de mercado y tendencias estacionales, obtienen resultados fiables. Sin embargo, los casos de uso especializados aún requieren plataformas predictivas específicas.

AutoML y plataformas sin código

Las plataformas automatizadas de aprendizaje automático democratizan el análisis predictivo al gestionar automáticamente la selección de algoritmos, el ajuste de hiperparámetros y la ingeniería de características. DataRobot, H2O.ai y Google AutoML representan esta categoría.

Estas herramientas procesan datos de entrenamiento y prueban automáticamente cientos de configuraciones de modelos para identificar el enfoque con mejor rendimiento. Analistas de negocio sin experiencia en ciencia de datos pueden crear modelos de nivel profesional. Las plataformas gestionan los flujos de trabajo de implementación, monitorización y reentrenamiento.

DataRobot destaca especialmente en implementaciones empresariales con requisitos de gobernanza. H2O.ai ofrece versiones tanto de código abierto como comerciales. Driverless AI automatiza todo el proceso de aprendizaje automático, manteniendo la interpretabilidad del modelo, algo fundamental para las industrias reguladas.

Servicios de aprendizaje automático basados en la nube

Amazon Web Services, Google Cloud Platform y Microsoft Azure proporcionan entornos de aprendizaje automático gestionados. AWS SageMaker, Google Vertex AI y Azure Machine Learning combinan infraestructura, bibliotecas de algoritmos y herramientas de implementación en plataformas nativas de la nube.

Estos servicios se integran de forma natural con otros recursos en la nube. Los datos almacenados en S3 o BigQuery se utilizan directamente para el entrenamiento de modelos. Los modelos implementados se escalan automáticamente según el volumen de predicciones. El sistema de monitorización integrado realiza un seguimiento del rendimiento del modelo y de la desviación de los datos.

Las plataformas en la nube son ideales para organizaciones que ya han invertido en infraestructura en la nube. Eliminan los costos generales de administración de la infraestructura, a la vez que brindan funciones de seguridad y cumplimiento de nivel empresarial. Las organizaciones que utilizan servicios de aprendizaje automático en la nube han logrado aumentar el valor de vida del cliente mediante la segmentación predictiva de clientes.

Soluciones específicas de la industria

Las herramientas de análisis predictivo especializadas se dirigen a sectores o casos de uso específicos. Las plataformas de marketing en la nube (Salesforce Einstein, Adobe Sensei) se centran en la predicción y personalización del recorrido del cliente. Las plataformas sanitarias abordan la estratificación del riesgo del paciente y la predicción de reingresos. Las herramientas para servicios financieros se especializan en la detección de fraudes y la calificación crediticia.

Estas soluciones vienen preconfiguradas con modelos y esquemas de datos relevantes para el sector. El tiempo de implementación se reduce significativamente en comparación con la creación de modelos personalizados desde cero. Las organizaciones sanitarias que utilizan análisis predictivos han reportado reducciones significativas en las hospitalizaciones y las visitas a urgencias mediante enfoques de estratificación de riesgos.

La especificidad tiene dos caras. Las herramientas de la industria cumplen a la perfección con el propósito para el que fueron diseñadas, pero carecen de flexibilidad para nuevos casos de uso que se salgan de su ámbito.

Características esenciales de las plataformas de análisis predictivo

No todas las plataformas incluyen todas las funcionalidades. Comprender qué características son importantes para cada caso de uso específico evita costosos desajustes entre las capacidades de las herramientas y las necesidades de la organización.

Conectividad e integración de datos

Los modelos predictivos solo funcionan cuando pueden acceder a datos relevantes. Las mejores plataformas ofrecen amplias bibliotecas de conectores para bases de datos (PostgreSQL, MySQL, Oracle), almacenes de datos en la nube (Snowflake, Redshift, BigQuery), sistemas CRM (Salesforce, HubSpot) y plataformas de marketing.

La integración de datos va más allá de las simples importaciones. Los sistemas predictivos de producción necesitan flujos de datos automatizados que actualicen los datos de entrenamiento, reentrenen los modelos según un cronograma establecido y envíen las predicciones a los sistemas operativos. Las API de predicción en tiempo real requieren conexiones de baja latencia a bases de datos transaccionales.

¿La herramienta se puede implementar tanto en la nube como en las instalaciones de la empresa? ¿Cumple con los requisitos de residencia de datos para operaciones internacionales? Estas cuestiones de integración determinan si una plataforma se ajusta a las limitaciones de la arquitectura empresarial.

Bibliotecas de algoritmos y tipos de modelos

Las plataformas integrales admiten múltiples enfoques de modelado. Modelos de regresión para resultados continuos. Algoritmos de clasificación para predicciones categóricas. Métodos de series temporales para pronósticos temporales. Agrupamiento para segmentación. Métodos de conjunto que combinan múltiples modelos para una mayor precisión.

La profundidad también importa. ¿La plataforma ofrece solo regresión lineal o incluye técnicas de regularización como LASSO y regresión de cresta? ¿Puede manejar máquinas de potenciación de gradiente, bosques aleatorios y redes neuronales? ¿Es compatible con el aprendizaje profundo para datos no estructurados como imágenes y texto?

Las plataformas líderes ofrecen entre 10 y 50 implementaciones de algoritmos diferentes. Además, explican cuándo utilizar cada enfoque y guían a los usuarios hacia las técnicas más adecuadas según las características de sus datos.

AutoML e ingeniería de características automatizada

La ingeniería de características —la creación de variables predictivas a partir de datos brutos— tradicionalmente consumía una enorme cantidad de tiempo en ciencia de datos. Las plataformas modernas automatizan este proceso, probando miles de combinaciones de características para identificar las variables más predictivas.

AutoML extiende la automatización a la selección de algoritmos y al ajuste de hiperparámetros. El sistema entrena decenas de modelos candidatos, compara su rendimiento mediante validación cruzada y recomienda la mejor configuración. Esta capacidad acelera el desarrollo de modelos, reduciendo el tiempo de semanas a horas.

Pero la automatización tiene sus límites. Los sistemas totalmente automatizados a veces pasan por alto información específica del dominio que los analistas expertos incorporarían. Las mejores plataformas logran un equilibrio entre la automatización y la capacidad de intervención de expertos.

Explicabilidad e interpretabilidad del modelo

Los modelos complejos de aprendizaje automático suelen funcionar como cajas negras: generan predicciones precisas, pero no explican el razonamiento. Las industrias reguladas requieren que los modelos sean interpretables para cumplir con los requisitos normativos. Los responsables empresariales necesitan explicaciones para confiar en las recomendaciones.

Las plataformas modernas incluyen herramientas de explicabilidad. Los valores SHAP (SHapley Additive exPlanations) cuantifican la contribución de cada variable a las predicciones individuales. Los gráficos de dependencia parcial muestran cómo el cambio de una variable afecta a los resultados. Las clasificaciones de importancia de las características identifican qué puntos de datos son más relevantes.

Estas funciones de interpretabilidad reducen la brecha entre la precisión estadística y la adopción empresarial. Cuando los equipos de marketing comprenden por qué un modelo marca ciertos clientes potenciales como de alta prioridad, confían lo suficiente en el sistema como para actuar en función de las recomendaciones.

Infraestructura de despliegue y monitorización

Crear modelos precisos representa la mitad del desafío. Implementarlos en sistemas de producción donde generan valor para el negocio completa el panorama. Las plataformas empresariales incluyen infraestructura de implementación: API REST, motores de puntuación por lotes y servicios de modelos integrados.

El monitoreo posterior a la implementación realiza un seguimiento del rendimiento del modelo a lo largo del tiempo. La precisión de las predicciones suele disminuir a medida que cambian las condiciones del mundo real. Los paneles de monitoreo alertan a los equipos cuando el rendimiento del modelo cae por debajo de ciertos umbrales, lo que activa los flujos de trabajo de reentrenamiento.

El control de versiones para los modelos también es importante. Los sistemas de producción necesitan la capacidad de revertir versiones cuando las nuevas versiones de los modelos no rinden lo esperado. Las mejores plataformas tratan los modelos como artefactos versionados con un seguimiento completo de su linaje.

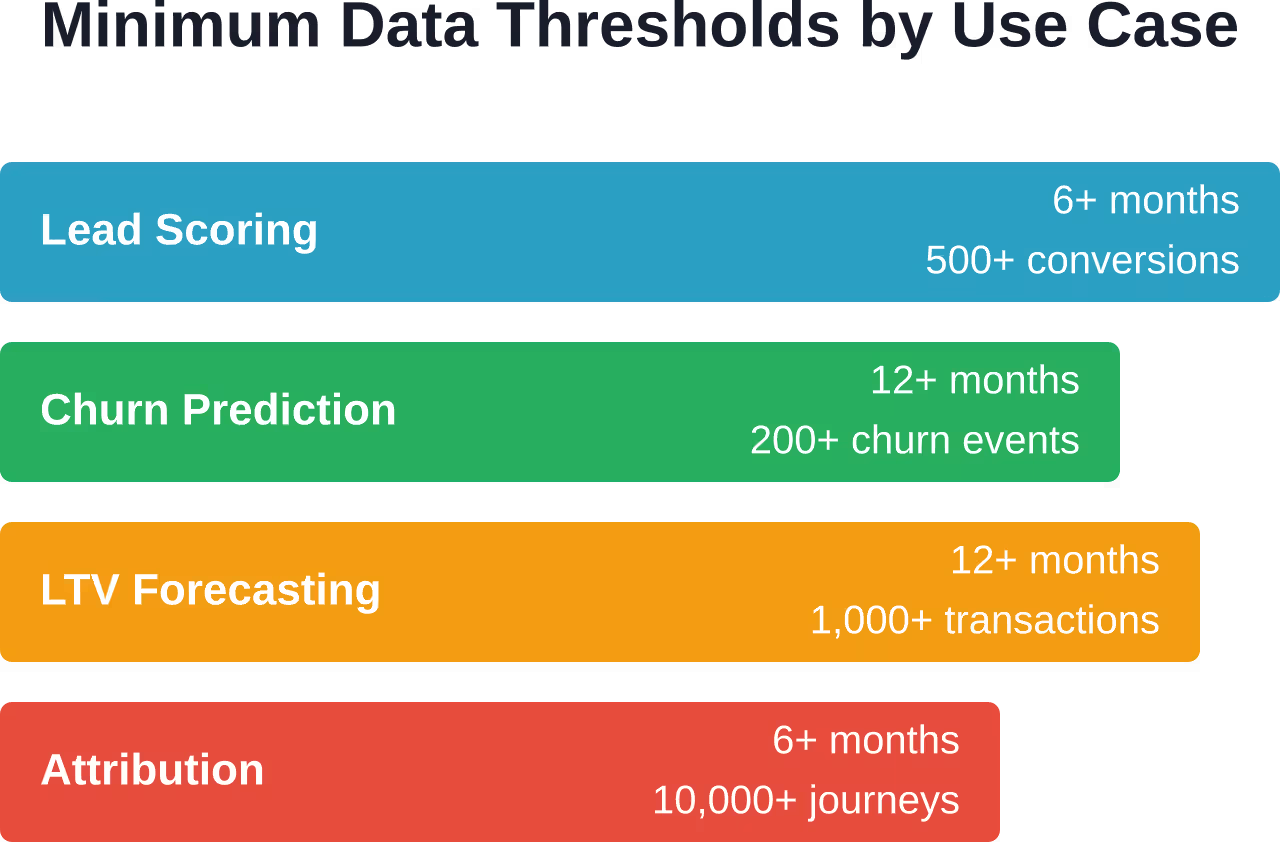

Requisitos mínimos de datos para el análisis predictivo

Aquí es donde suelen fallar las implementaciones: un volumen o calidad de datos insuficientes impiden que los modelos aprendan patrones significativos. Los diferentes tipos de predicción requieren diferentes umbrales de datos.

Si las predicciones implican probabilidad de conversión, el modelo necesita ver cientos —idealmente miles— de conversiones pasadas en diferentes contextos. Umbrales mínimos por tipo de predicción:

- Puntuación principal: Más de 6 meses de historial de clientes potenciales, más de 500 conversiones.

- Predicción de abandono: Más de 12 meses de datos del ciclo de vida del cliente, más de 200 eventos de abandono.

- Previsión del LTV: Más de 12 meses de datos de ingresos, más de 1000 transacciones.

- Modelado de atribución: Más de 6 meses de datos multicanal, más de 10.000 recorridos de usuario.

Estos valores representan mínimos de referencia. Generalmente, una mayor cantidad de datos mejora la precisión del modelo, aunque a partir de ciertos volúmenes, los beneficios disminuyen. La calidad de los datos es tan importante como la cantidad: los valores faltantes, los formatos inconsistentes y las etiquetas incorrectas perjudican el rendimiento del modelo independientemente del volumen.

Las organizaciones que se encuentren por debajo de estos umbrales deberían comenzar con enfoques analíticos más sencillos (análisis descriptivo, segmentación básica) mientras desarrollan la infraestructura de datos para futuras capacidades predictivas.

Las mejores plataformas de análisis predictivo para diferentes casos de uso.

La elección de la herramienta adecuada depende de las capacidades técnicas, los requisitos del caso de uso y la madurez de la organización. Estas plataformas representan a los líderes actuales en diferentes categorías.

Para equipos de marketing: Improvado

Improvado combina la integración unificada de datos de marketing con análisis predictivos basados en inteligencia artificial. La plataforma se conecta a las principales plataformas publicitarias, sistemas CRM y herramientas de análisis, centralizando datos que normalmente se encuentran dispersos en decenas de fuentes.

El agente de IA permite realizar predicciones en lenguaje natural: los analistas de marketing pueden consultar qué campañas generarán más conversiones el próximo trimestre sin necesidad de escribir SQL ni Python. La configuración suele tardar dos semanas, lo que lo convierte en una solución integral para departamentos de marketing que no cuentan con equipos de ciencia de datos especializados.

Improvado es ideal para organizaciones que priorizan predicciones específicas de marketing: pronóstico del rendimiento de campañas, modelado del valor de vida del cliente y optimización de la atribución. No reemplazará las plataformas de ciencia de datos de propósito general, pero destaca dentro de su ámbito de análisis de marketing.

Para análisis visual: Tableau

La principal fortaleza de Tableau reside en la combinación de capacidades predictivas con una visualización de datos de primer nivel. Los usuarios empresariales pueden generar pronósticos mediante interfaces intuitivas de arrastrar y soltar, mientras que los científicos de datos integran modelos personalizados de R y Python.

La plataforma admite cálculos complejos y análisis detallados de series temporales para explorar la estacionalidad y las tendencias. Los datos, las visualizaciones y los paneles de control se pueden integrar en herramientas de terceros, lo que permite ampliar la capacidad de análisis predictivo a toda la organización.

Tableau es ideal para equipos que necesitan comunicar predicciones a personas sin conocimientos técnicos. La capa de visualización hace que las previsiones sean accesibles y útiles para los ejecutivos que no interpretarán los resultados brutos del modelo.

Para AutoML empresarial: DataRobot

DataRobot automatiza todo el proceso de aprendizaje automático, desde la ingeniería de características hasta la implementación y el monitoreo del modelo. La plataforma prueba cientos de configuraciones de algoritmos, las clasifica según su rendimiento y explica el comportamiento del modelo mediante herramientas de interpretación integradas.

Las funciones de gobernanza empresarial incluyen registros de auditoría, controles de acceso basados en roles y detección de sesgos. Los modelos se implementan mediante API REST o motores de puntuación por lotes. La monitorización automatizada rastrea la degradación del rendimiento y activa flujos de trabajo de reentrenamiento.

DataRobot es ideal para grandes empresas con diversos casos de uso predictivos, pero con personal limitado en ciencia de datos. Organizaciones de servicios financieros, atención médica y manufactura lo utilizan para modelado de riesgos, detección de fraude y mantenimiento predictivo.

Para flujos de trabajo nativos de la nube: AWS SageMaker

Amazon SageMaker proporciona infraestructura administrada para crear, entrenar e implementar modelos de aprendizaje automático a gran escala. El servicio se integra con los lagos de datos de AWS, gestiona el entrenamiento distribuido en clústeres de GPU e implementa modelos con escalado automático.

Los algoritmos integrados cubren los casos de uso más comunes, mientras que la compatibilidad con modelos personalizados permite satisfacer requisitos especializados. Los cuadernos de SageMaker Studio facilitan el desarrollo colaborativo. Model Monitor realiza un seguimiento de la desviación de datos y la calidad de las predicciones en producción.

Las organizaciones que ya invierten en infraestructura de AWS obtienen una integración perfecta. Los datos almacenados en S3 fluyen directamente a los flujos de entrenamiento. Los modelos implementados acceden a otros servicios de AWS sin necesidad de configuraciones de red complejas.

Para mayor flexibilidad de código abierto: H2O.ai

H2O.ai ofrece plataformas de análisis predictivo tanto de código abierto como comerciales. El marco de trabajo de código abierto H2O se ejecuta en ordenadores portátiles o clústeres distribuidos, y admite algoritmos populares a través de interfaces de R y Python.

Driverless AI, el producto comercial, automatiza la ingeniería de características, la selección de modelos y el ajuste de hiperparámetros, manteniendo la interpretabilidad mediante documentación automática. La plataforma genera explicaciones adecuadas para la revisión regulatoria en los sectores bancario y sanitario.

H2O.ai es ideal para organizaciones que valoran la flexibilidad del código abierto y, al mismo tiempo, necesitan soporte empresarial para implementaciones en producción. Su enfoque híbrido permite experimentar con herramientas gratuitas antes de adquirir licencias comerciales.

Para análisis estadístico: IBM SPSS

IBM SPSS sigue siendo la plataforma dominante en la investigación académica, la atención médica y el sector público, donde las técnicas estadísticas clásicas y el cumplimiento normativo son fundamentales. Su interfaz intuitiva permite a los investigadores sin conocimientos de programación realizar análisis complejos.

La plataforma abarca modelado de regresión, análisis de supervivencia, análisis factorial y diseño experimental. La documentación y la validación cumplen con los requisitos de la FDA para ensayos farmacéuticos. La integración con el conjunto de herramientas analíticas de IBM permite implementaciones empresariales.

SPSS es adecuado para organizaciones donde el rigor estadístico y la documentación priman sobre las capacidades de aprendizaje automático de vanguardia. Es menos flexible que Python o R, pero más accesible para personas sin conocimientos de programación.

| Plataforma | Mejor para | Punto fuerte clave | Usuarios típicos |

|---|---|---|---|

| Improvisado | Análisis de marketing | Datos unificados + agente de IA | analistas de marketing |

| Cuadro | Comunicación visual | Predicción + visualización | analistas de negocios |

| DataRobot | AutoML empresarial | Automatización completa + gobernanza | Analistas y científicos de datos |

| AWS SageMaker | Aprendizaje automático nativo de la nube | Integración y escalabilidad con AWS | Ingenieros y científicos de datos |

| H2O.ai | Código abierto + comercial | Flexibilidad + explicabilidad | Equipos de ciencia de datos |

| IBM SPSS | Rigor estadístico | Cumplimiento normativo | Investigadores y analistas |

Aplicaciones de análisis predictivo en el mundo real

Comprender cómo las organizaciones aplican estas herramientas aclara su valor práctico más allá de sus capacidades teóricas.

Atención sanitaria: Estratificación del riesgo del paciente

Las organizaciones sanitarias utilizan análisis predictivos para identificar a los pacientes con alto riesgo de reingreso hospitalario o visitas a urgencias. Estas organizaciones han reportado reducciones significativas en las hospitalizaciones y las visitas a urgencias mediante enfoques de estratificación de riesgos.

Los modelos incorporan registros electrónicos de salud, datos sobre la adherencia a la medicación, determinantes sociales de la salud y patrones históricos de utilización. Los médicos reciben puntuaciones de riesgo que les permiten tomar decisiones sobre la planificación de la atención, como la asignación de visitas domiciliarias, la coordinación de seguimientos con especialistas o el ajuste de los regímenes de medicación antes de que se produzcan episodios agudos.

Comercio electrónico: Predicción del valor de vida del cliente

Las plataformas de logística de comercio electrónico que utilizan las herramientas de análisis de AWS han logrado aumentar el valor de vida del cliente mediante la segmentación predictiva. Los equipos de marketing utilizan estas predicciones para optimizar la inversión en adquisición de clientes. Los clientes con un alto valor de vida del cliente previsto reciben ofertas de retención más atractivas y experiencias personalizadas. Este enfoque permite redirigir el presupuesto de campañas generales a intervenciones específicas donde el retorno de la inversión es mayor.

Medios de comunicación: Recomendación de contenido y crecimiento de la audiencia.

Las empresas de medios han reportado mejoras significativas en la captación de clientes mediante modelos predictivos de audiencia. Los sistemas de recomendación de contenido utilizan técnicas similares: Netflix y Spotify predicen qué películas o canciones disfrutarán los usuarios individuales basándose en el filtrado colaborativo y los atributos del contenido. Estas predicciones impactan directamente en las métricas de retención y participación de los usuarios.

Servicios financieros: Detección de fraude

Las compañías de tarjetas de crédito implementan modelos predictivos en tiempo real que evalúan la probabilidad de fraude en cada transacción. Estos sistemas analizan el monto de la transacción, la categoría del comercio, la ubicación geográfica, la hora del día y los patrones históricos para detectar actividades sospechosas en cuestión de milisegundos.

Estos modelos equilibran la precisión con la tasa de falsos positivos. Bloquear transacciones legítimas frustra a los clientes, mientras que no detectar intentos de fraude genera pérdidas económicas. Los métodos de conjunto, que combinan múltiples algoritmos, logran la precisión necesaria para su implementación en producción.

Las filtraciones de datos conllevan costes sustanciales para las organizaciones, lo que convierte a los sistemas de detección predictiva de fraude en inversiones valiosas.

Fabricación: Mantenimiento predictivo

Las operaciones industriales utilizan datos de sensores y aprendizaje automático para predecir fallos en los equipos antes de que ocurran. Una investigación del IEEE demuestra marcos de IA explicables para la monitorización predictiva del estado de las herramientas en el mecanizado de alta velocidad, combinando la precisión predictiva con la interpretabilidad para los técnicos de mantenimiento.

Estos sistemas analizan patrones de vibración, lecturas de temperatura, firmas acústicas y registros de uso para predecir cuándo fallarán los componentes. Los programas de mantenimiento pasan de intervalos fijos a cronogramas basados en el estado del equipo, lo que reduce el tiempo de inactividad y prolonga su vida útil.

Cómo seleccionar la herramienta de análisis predictivo adecuada

El mercado de análisis predictivo ofrece soluciones genéricas aplicables a diversos sectores, así como herramientas específicas para cada industria, adaptadas a casos de uso concretos. Elegir incorrectamente supone una pérdida de tiempo y presupuesto, además de retrasar la obtención de valor.

Evalúe la madurez de sus datos.

Las organizaciones se clasifican en distintas etapas de madurez de datos. Las empresas en etapa inicial carecen de datos históricos suficientes para realizar modelos sofisticados. Las operaciones en etapa intermedia cuentan con datos, pero necesitan mejorar su accesibilidad. Las organizaciones avanzadas optimizan el rendimiento de los modelos y la infraestructura de implementación.

Adapta la sofisticación de las herramientas a tu nivel de madurez. Los equipos sin experiencia en ciencia de datos no deberían empezar con AWS SageMaker, ya que la curva de aprendizaje retrasa los resultados. Los analistas de negocio que trabajan con conjuntos de datos ya establecidos obtienen resultados más rápidos utilizando plataformas de AutoML o herramientas de BI con funciones predictivas.

Definir casos de uso específicos

Las iniciativas genéricas de "necesitamos análisis predictivos" fracasan con más frecuencia que los proyectos específicos. Defina casos de uso concretos: reducir la pérdida de clientes en 151 TP3T, mejorar la precisión de la calificación de clientes potenciales en 201 TP3T u optimizar los niveles de inventario para reducir los costos de almacenamiento en $500K anuales.

Los objetivos específicos aclaran los requisitos de la herramienta. La predicción de la deserción de clientes requiere algoritmos de clasificación e integración de datos del ciclo de vida del cliente. La optimización del inventario requiere pronósticos de series temporales y conectividad con el sistema de la cadena de suministro. Los distintos casos de uso favorecen el uso de diferentes plataformas.

Evaluar los requisitos técnicos

¿La plataforma es compatible con sus fuentes de datos? ¿Puede implementarse en su entorno preferido (nube, local, híbrido)? ¿Se integra con los paneles de BI y los sistemas operativos existentes?

La compatibilidad técnica determina la complejidad de la implementación. Una plataforma potente que requiere un extenso trabajo de integración personalizada podría ofrecer menos valor que una herramienta ligeramente menos sofisticada con conectores listos para usar para su conjunto de tecnologías específico.

Considera las capacidades del equipo.

Las plataformas AutoML permiten a los analistas de negocio crear modelos sin necesidad de programar. Las herramientas estadísticas como SPSS son adecuadas para investigadores familiarizados con las técnicas tradicionales. Python y R requieren conocimientos de ciencia de datos, pero ofrecen la máxima flexibilidad.

Una evaluación honesta de las habilidades del equipo evita desajustes entre las capacidades de las herramientas. Como alternativa, utilice la selección de herramientas para guiar las decisiones de contratación: si la estrategia empresarial exige modelado avanzado, invierta en talento en ciencia de datos junto con la infraestructura.

Calcular el costo total de propiedad

El precio de la suscripción representa solo una parte del costo total. Los servicios de implementación, la capacitación, la ingeniería de datos y el mantenimiento continuo añaden gastos sustanciales que se suman a las tarifas de software indicadas.

Los costos ocultos surgen durante la expansión. Algunas plataformas cobran por predicción, lo que genera gastos basados en el uso que aumentan considerablemente con la adopción. Otras requieren una infraestructura costosa para la implementación local. Los servicios en la nube acumulan cargos por computación y almacenamiento. Calcule los costos totales de propiedad realistas a tres años antes de comprometerse.

Mejores prácticas de implementación

La compra de una plataforma de análisis predictivo representa el comienzo, no el final, del proceso. Las implementaciones exitosas siguen patrones consistentes.

Comience con un proyecto piloto.

Los despliegues a nivel empresarial suelen estancarse cuando la complejidad abruma a los equipos. En su lugar, identifique un único caso de uso de alto valor con métricas de éxito claras y un alcance manejable.

Un programa piloto de tres meses valida la tecnología, genera confianza en la organización y detecta posibles problemas de integración antes de su implementación completa. Elija casos de uso donde la precisión de la predicción tenga un impacto directo en resultados comerciales medibles: la pérdida de clientes, las tasas de conversión de clientes potenciales o la rotación de inventario.

Establecer la gobernanza de datos

Los modelos predictivos heredan los problemas de calidad de sus datos de entrenamiento. Establezca políticas de gobernanza de datos antes de comenzar el desarrollo del modelo. Defina la propiedad de los datos, los estándares de calidad, las políticas de retención y los controles de acceso.

Los catálogos de datos documentan los conjuntos de datos disponibles, sus esquemas, frecuencias de actualización y problemas de calidad conocidos. Esta documentación acelera el desarrollo de modelos al ayudar a los científicos de datos a localizar rápidamente los datos de entrenamiento relevantes.

Crear equipos multifuncionales

Para lograr un análisis predictivo eficaz, es fundamental la colaboración entre expertos en la materia, científicos de datos y el equipo de operaciones de TI. Los expertos comprenden el contexto empresarial e interpretan los resultados de los modelos. Los científicos de datos crean y validan los modelos. Los equipos de TI se encargan de la implementación y la monitorización de la infraestructura.

Las implementaciones aisladas fracasan porque los modelos no reflejan la realidad del negocio o no pueden integrarse con los sistemas operativos. Los equipos multifuncionales evitan estas desconexiones.

Plan para la gestión del ciclo de vida del modelo

Los modelos se degradan con el tiempo a medida que cambian las condiciones del mundo real. Los comportamientos de los clientes varían. La oferta de productos evoluciona. Los competidores ajustan sus estrategias. El modelo de predicción de abandono de clientes que funcionó bien el año pasado podría tener un rendimiento inferior hoy en día.

Establezca procesos para monitorear el rendimiento del modelo, reentrenarlo con datos nuevos e implementar versiones actualizadas. Las herramientas de automatización se encargan del reentrenamiento rutinario, pero la revisión humana evita que los sistemas automatizados aprendan y amplifiquen patrones anómalos.

Priorizar la explicabilidad del modelo

Las partes interesadas no actuarán en función de predicciones que no comprendan. Incluso si un modelo opaco alcanza una precisión del 951%, los equipos de ventas ignoran las puntuaciones de los clientes potenciales sin explicaciones. Los ejecutivos rechazan las recomendaciones que carecen de un razonamiento claro.

Invierta en herramientas de explicabilidad que traduzcan la información interna del modelo a un lenguaje empresarial. La frase “Este cliente potencial obtuvo una puntuación alta porque visitó las páginas de precios tres veces, trabaja en una empresa del tamaño objetivo y coincide con nuestro mejor segmento de clientes” genera una acción más efectiva que “el modelo predice una probabilidad de conversión de 0,87”.”

Obtenga modelos predictivos creados a partir de sus datos y casos de uso.

Las herramientas de análisis predictivo suelen requerir que adaptes tus datos a su estructura. Cuando los datos provienen de múltiples fuentes o no siguen un formato estándar, los modelos integrados dejan de ser útiles. IA superior Desarrollamos software de IA personalizado con análisis predictivo, creando modelos que reflejan cómo se recopilan y utilizan realmente sus datos. Esto le permite trabajar con pronósticos, detección de fraude y predicción de fallas sin las limitaciones de la lógica de herramientas predefinidas.

Convierte tus datos en modelos predictivos funcionales.

AI Superior ofrece:

- Modelos predictivos creados a partir de tus propios datos, no de plantillas genéricas.

- Software de IA diseñado para sus tareas de predicción específicas.

- Un sistema que combina datos de múltiples fuentes.

Contacta con IA Superior para analizar cómo se pueden implementar los análisis predictivos en su entorno.

Errores comunes y cómo evitarlos

Las organizaciones malgastan recursos en iniciativas de análisis predictivo que aportan un valor mínimo. Estos patrones se repiten en las implementaciones fallidas.

Datos de entrenamiento insuficientes

Ni siquiera los algoritmos más sofisticados pueden extraer patrones de datos insuficientes. En ocasiones, los equipos fuerzan proyectos predictivos antes de acumular suficientes registros históricos.

Sea honesto sobre la disponibilidad de datos. Si la predicción de abandono requiere más de 200 eventos históricos de abandono, pero solo existen 50, posponga el proyecto mientras desarrolla la infraestructura de datos. Aproveche este período para realizar análisis descriptivos que documenten los patrones actuales.

Énfasis excesivo en la precisión

Buscar una precisión del modelo ligeramente mejor suele aportar menos valor comercial que implementar rápidamente un modelo suficientemente bueno. La diferencia entre la precisión de 82% y 85% rara vez justifica seis meses adicionales de desarrollo.

Defina umbrales de precisión aceptables en función del impacto en el negocio. Implemente modelos que cumplan con dichos umbrales y, a continuación, realice iteraciones basadas en el rendimiento en producción. El uso en entornos reales suele revelar mejoras que pasan desapercibidas durante las pruebas fuera de línea.

Descuidar la última milla

La creación de modelos precisos representa la mitad del desafío. Integrar las predicciones en los flujos de trabajo operativos, donde influyen en las decisiones, completa la cadena de valor.

Si las puntuaciones de los clientes potenciales no se integran en el CRM donde trabajan los vendedores, no influirán en su comportamiento. Si las predicciones de abandono no activan campañas de retención, no reducen la deserción. Planifique la implementación y la integración desde el inicio del proyecto, no como algo secundario.

Ignorar la gestión del cambio

La implementación técnica suele tener más éxito que la adopción organizacional. Los equipos de ventas acostumbrados a tomar decisiones basadas en la intuición se resisten a la puntuación algorítmica de clientes potenciales. Los gerentes de marketing cuestionan los modelos de atribución que contradicen su intuición.

Involucre a las partes interesadas desde el principio. Demuestre logros rápidos que generen confianza. Proporcione explicaciones que ayuden a los usuarios a comprender y confiar en las predicciones. La gestión del cambio determina si el análisis predictivo genera valor teórico o un impacto real en el negocio.

El futuro de las herramientas de análisis predictivo

El panorama de la analítica predictiva sigue evolucionando. Varias tendencias marcan la dirección que están tomando las herramientas.

Mayor automatización y accesibilidad

Las capacidades de AutoML se expanden cada año, reduciendo las barreras técnicas para el modelado predictivo. Las interfaces de lenguaje natural permiten a los analistas de negocio formular preguntas en lenguaje sencillo, en lugar de escribir código o SQL.

Esta democratización extiende las capacidades predictivas más allá de los equipos especializados en ciencia de datos. Los expertos en la materia crean sus propios modelos, acelerando la generación de conocimiento y liberando a los científicos de datos para abordar desafíos complejos que requieren enfoques personalizados.

Predicciones en tiempo real y en streaming

Las predicciones por lotes dan paso a la puntuación en tiempo real a medida que mejora la infraestructura. Los sistemas de detección de fraude ya puntúan las transacciones en milisegundos. Los motores de personalización ofrecen recomendaciones de contenido individualizadas en tiempo real mientras los usuarios navegan por los sitios web.

Las plataformas de transmisión de datos y la infraestructura de modelos de baja latencia permiten actualizaciones continuas de las predicciones. Las puntuaciones de riesgo de los clientes se actualizan a medida que llegan nuevas señales de comportamiento, en lugar de recalcularse diariamente.

Énfasis en la IA explicable

La presión regulatoria y las exigencias empresariales impulsan la demanda de modelos interpretables. El Reglamento General de Protección de Datos (RGPD) europeo establece el derecho a la explicación de las decisiones automatizadas. La gestión del riesgo de los modelos en el sector bancario requiere la documentación de la lógica de dichos modelos.

Las técnicas de explicabilidad avanzan a la par que la sofisticación de los modelos. Los investigadores desarrollan métodos que mantienen la precisión de las predicciones a la vez que permiten la transparencia sobre la lógica de las decisiones. Este equilibrio se convierte en un factor diferenciador clave a medida que las organizaciones se enfrentan al escrutinio de sus decisiones algorítmicas.

Integración de múltiples tipos de datos

Los primeros modelos predictivos utilizaban datos estructurados: información demográfica de los clientes, registros de transacciones y registros de comportamiento. Las plataformas modernas incorporan cada vez más datos no estructurados, como texto, imágenes y vídeo.

El procesamiento del lenguaje natural extrae información de las transcripciones de atención al cliente y las publicaciones en redes sociales. La visión artificial analiza imágenes de productos y defectos de fabricación. Los modelos multimodales combinan datos estructurados y no estructurados para obtener predicciones más precisas.

Preguntas frecuentes

¿Cuál es la diferencia entre las herramientas de análisis predictivo y las plataformas de inteligencia empresarial?

Las plataformas de inteligencia empresarial se centran en el análisis descriptivo: informan sobre qué sucedió y por qué mediante paneles de control, visualizaciones y análisis históricos. Las herramientas de análisis predictivo pronostican lo que sucederá a continuación utilizando modelos estadísticos y algoritmos de aprendizaje automático. Muchas plataformas de BI modernas incluyen ahora funciones predictivas básicas, pero las plataformas predictivas especializadas ofrecen técnicas de modelado más sofisticadas y flujos de trabajo automatizados.

¿Necesito científicos de datos para usar herramientas de análisis predictivo?

Depende de la plataforma y del caso de uso. Las herramientas de AutoML, como DataRobot y las plataformas específicas del sector, permiten a los analistas de negocio crear modelos sin necesidad de conocimientos de programación. Estas plataformas automatizan la selección de algoritmos y la ingeniería de características. Para modelos personalizados, técnicas avanzadas o casos de uso novedosos, las habilidades en ciencia de datos siguen siendo valiosas. Las organizaciones suelen empezar con herramientas accesibles y añadir conocimientos técnicos a medida que los requisitos se vuelven más complejos.

¿Cuántos datos necesito antes de empezar con el análisis predictivo?

Los requisitos mínimos varían según el caso de uso. La puntuación de clientes potenciales suele requerir más de 6 meses de historial y más de 500 conversiones. La predicción de abandono requiere más de 12 meses de datos del ciclo de vida del cliente y más de 200 eventos de abandono. Los pronósticos más sencillos pueden funcionar con menos datos, mientras que los modelos complejos necesitan más. La calidad es tan importante como la cantidad: los datos limpios y consistentes con variables relevantes ofrecen mejores resultados que grandes volúmenes de registros de baja calidad.

¿Qué sectores se benefician más del análisis predictivo?

Prácticamente todos los sectores aplican el análisis predictivo, aunque sus casos de uso varían. Los servicios financieros lo utilizan para la detección de fraudes, la calificación crediticia y la gestión de riesgos. Las organizaciones sanitarias predicen los resultados de los pacientes y el riesgo de reingreso. Los minoristas pronostican la demanda y optimizan los precios. La industria manufacturera lo aplica al mantenimiento predictivo. Los equipos de marketing de todos los sectores lo utilizan para predecir el valor de vida del cliente y optimizar las campañas. El denominador común reside en las decisiones en las que la previsión de resultados futuros genera una ventaja competitiva.

¿Qué tan precisos son los modelos de análisis predictivo?

La precisión varía considerablemente según la calidad de los datos, la complejidad del problema y el enfoque de modelado. Un pronóstico simple puede alcanzar una precisión de entre 70 y 80%, mientras que los métodos de conjunto sofisticados, aplicados a datos limpios, alcanzan más de 90%. Sin embargo, la precisión perfecta no es ni alcanzable ni necesaria; los modelos que mejoran la toma de decisiones en comparación con la intuición por sí sola aportan valor. El rendimiento en el mundo real suele diferir de la precisión de las pruebas, por lo que el monitoreo continuo garantiza que los modelos mantengan su eficacia a medida que cambian las condiciones.

¿Pueden funcionar los análisis predictivos con conjuntos de datos pequeños?

Los conjuntos de datos pequeños limitan las opciones y la precisión del modelado. Técnicas como la regularización evitan el sobreajuste cuando los datos de entrenamiento son escasos. El aprendizaje por transferencia aplica patrones aprendidos de grandes conjuntos de datos a problemas más pequeños y específicos de un dominio. Dicho esto, la significación estadística requiere tamaños de muestra mínimos: predecir eventos raros a partir de 20 ejemplos históricos no generará pronósticos fiables. Las organizaciones con datos limitados deberían comenzar con enfoques analíticos más sencillos mientras desarrollan la infraestructura de datos para futuras capacidades predictivas.

¿Cuál es el plazo típico para recuperar la inversión en implementaciones de análisis predictivo?

Los proyectos piloto suelen demostrar su valor en un plazo de 3 a 6 meses cuando los casos de uso cuentan con métricas claras y datos suficientes. Las implementaciones a nivel empresarial tardan entre 12 y 18 meses, ya que las organizaciones desarrollan la infraestructura, establecen la gobernanza e integran las predicciones en los flujos de trabajo operativos. El retorno de la inversión (ROI) depende del caso de uso: la reducción de la rotación de clientes y la prevención del fraude generan un impacto financiero cuantificable rápidamente, mientras que la previsión estratégica proporciona beneficios a largo plazo. Las organizaciones que comienzan con proyectos piloto específicos y se expanden gradualmente obtienen un retorno más rápido que aquellas que intentan transformaciones integrales de inmediato.

Conclusión

Las herramientas de análisis predictivo transforman la forma en que las organizaciones toman decisiones, sustituyendo la intuición por pronósticos basados en datos. El conjunto de tecnologías abarca desde plataformas AutoML accesibles que democratizan el modelado hasta entornos de programación sofisticados que brindan a los científicos de datos la máxima flexibilidad.

Las implementaciones exitosas adaptan las capacidades de las herramientas a la madurez de la organización, las habilidades del equipo y los casos de uso específicos. Las empresas en fase inicial se benefician de soluciones llave en mano con requisitos técnicos mínimos. Los equipos de datos avanzados aprovechan entornos de modelado personalizados para aplicaciones especializadas.

La clave reside en comenzar con un enfoque claro: identificar un caso de uso único y de alto valor, garantizar la disponibilidad de los datos, seleccionar las herramientas adecuadas y demostrar su valor antes de expandirse. Las organizaciones que siguen este enfoque logran resultados comerciales medibles: menor rotación de clientes, mejores tasas de conversión, niveles de inventario optimizados y prevención de pérdidas por fraude.

Los resultados reales validan la inversión. Los proveedores de atención médica redujeron significativamente las hospitalizaciones mediante análisis predictivos. Las plataformas de comercio electrónico aumentaron el valor del cliente a lo largo del tiempo mediante enfoques predictivos. Las empresas de medios incrementaron sustancialmente la captación de clientes utilizando modelos predictivos de audiencia. Estos resultados son alcanzables cuando se combinan las herramientas adecuadas con datos suficientes y objetivos comerciales claros.

El panorama de la analítica predictiva seguirá evolucionando. La automatización amplía el acceso. Las capacidades en tiempo real permiten tomar decisiones instantáneas. Las técnicas de explicabilidad generan confianza en las recomendaciones algorítmicas. Las organizaciones que invierten ahora en capacidades predictivas obtienen ventajas competitivas que se multiplican a medida que se acumulan datos y mejoran los modelos.

¿Listo para implementar análisis predictivos? Comience por auditar los datos existentes, definir objetivos medibles y seleccionar un caso piloto donde la previsión genere un valor empresarial claro. Las herramientas existen; el éxito depende de una implementación bien planificada y alineada con la realidad de la organización.