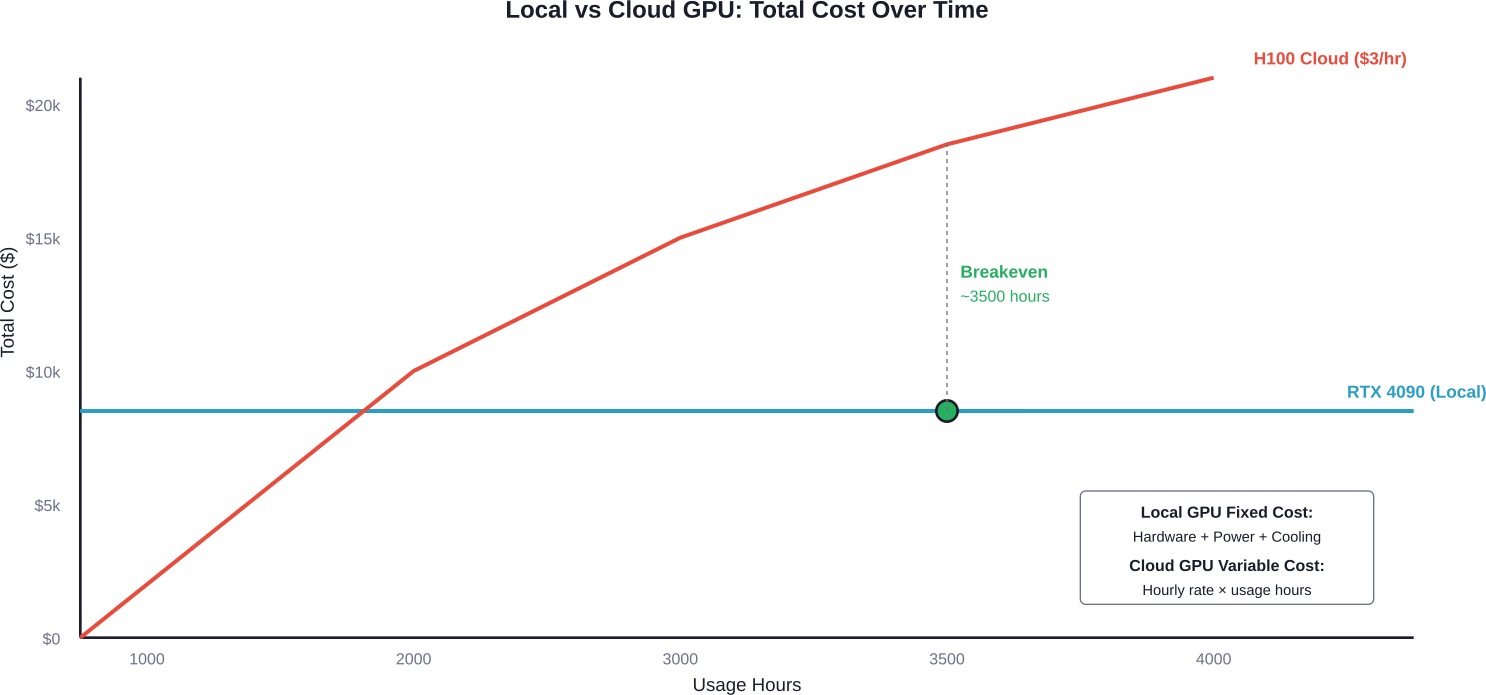

Résumé rapide : En 2026, les GPU les plus économiques pour la formation LLM incluent les NVIDIA RTX 4090 et L4 pour les configurations locales, tandis que les solutions cloud comme le H100 et l'allocation fractionnée de GPU, récemment mises en place, offrent une tarification flexible. Le choix optimal dépend de la taille du modèle, du budget et du mode d'acquisition (achat ou location) ; le seuil de rentabilité se situe autour de 3 500 heures pour l'achat par rapport à la location cloud.

Le choix du matériel pour la formation LLM détermine désormais si les projets seront menés à terme dans les délais impartis ou si les budgets seront épuisés avant même leur déploiement. Avec des modèles dépassant les 70 milliards de paramètres, les équipes sont confrontées à un marché où un seul mauvais choix de GPU peut entraîner des semaines de calcul perdues ou des milliers de dollars de surdimensionnement.

Le point essentiel est le suivant : la rentabilité ne se résume pas au prix d’achat. Il s’agit d’adapter les exigences de la charge de travail aux capacités du matériel, tout en évitant les goulots d’étranglement liés à une puissance insuffisante et le surdimensionnement coûteux.

Comprendre les exigences GPU pour la formation LLM

L'entraînement de grands modèles de langage exige des caractéristiques matérielles spécifiques qui vont au-delà des jeux vidéo ou des charges de travail d'apprentissage automatique traditionnelles. La capacité de mémoire détermine le minimum requis pour l'exécution des modèles.

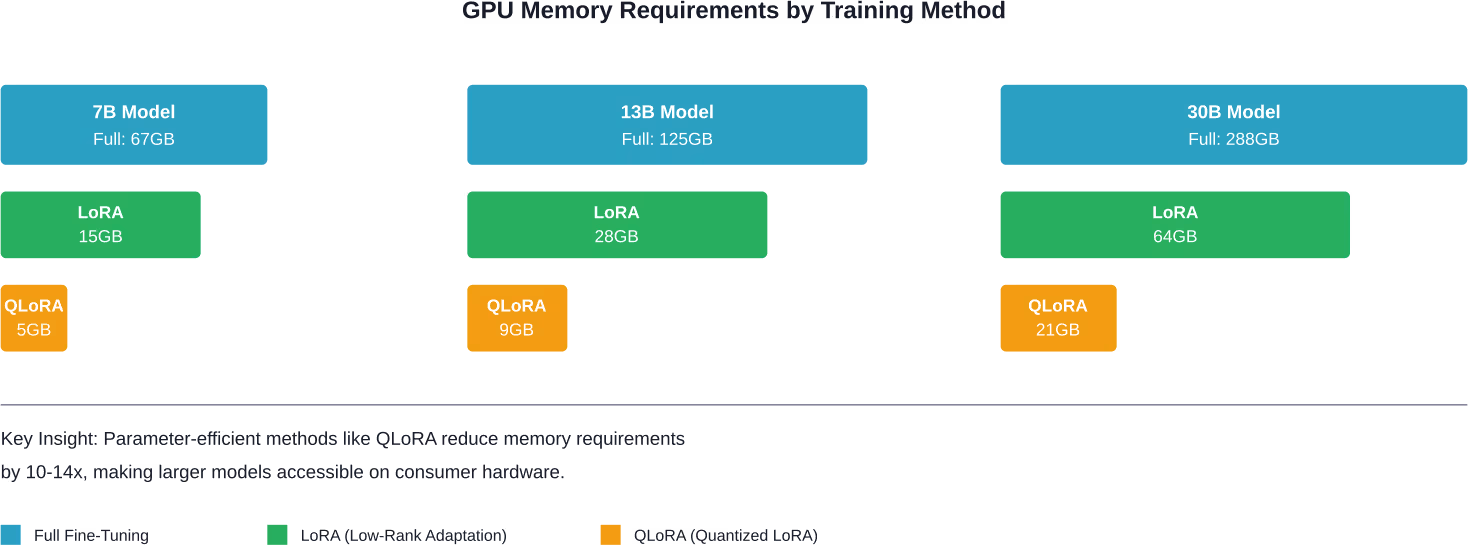

Un réglage fin complet nécessite généralement environ 16 Go de VRAM par milliard de paramètres. Un modèle à 7 milliards de paramètres requiert environ 67 Go pour un entraînement complet, tandis qu'un modèle à 13 milliards passe à 125 Go et les modèles à 30 milliards nécessitent 288 Go.

Mais attendez. Ces chiffres supposent un réglage fin complet. Les méthodes optimisées en termes de paramètres modifient complètement le calcul.

| Taille du modèle | Réglage fin complet | LoRA | QLoRA (4 bits) | Inférence uniquement |

|---|---|---|---|---|

| Paramètres 7B | 67 Go | 15 Go | 5 Go | 14 Go |

| Paramètres 13B | 125 Go | 28 Go | 9 Go | 26 Go |

| Paramètres 30B | 288 Go | 64 Go | 21 Go | 60 Go |

La bande passante mémoire détermine la vitesse d'entraînement. Malgré une consommation énergétique maximale, les GPU fonctionnent souvent à des taux d'utilisation sous-optimaux (entre 30% et 50%) lors du pré-entraînement standard des modèles linéaires linéaires, selon une étude de Mindbeam AI. Le goulot d'étranglement réside généralement dans la vitesse d'accès du GPU aux poids et aux gradients du modèle, et non dans sa puissance de calcul brute.

Les cœurs Tensor constituent un autre facteur multiplicateur de performance essentiel. Les architectures NVIDIA modernes intègrent du matériel spécialisé pour les opérations matricielles dont les modèles de transformateurs ont largement besoin.

Options GPU locales : quand la propriété est judicieuse

L'achat de matériel est financièrement avantageux lorsque les charges de travail d'entraînement sont continues. Les données de seuil de rentabilité montrent que l'achat d'une RTX 4090 n'atteint le coût de location d'un A100 qu'après environ 3 500 heures d'utilisation active.

Cela représente environ 146 jours de fonctionnement continu. Pour les équipes menant des recherches ininterrompues ou assurant régulièrement des formations de production, la propriété est rentable. Pour les projets intermittents, ce n'est pas le cas.

NVIDIA RTX 4090 : La carte graphique économique par excellence

La RTX 4090 offre 24 Go de VRAM avec une fréquence d'environ $1 600 à $1 800 MHz par carte. D'après les retours de la communauté, le temps d'entraînement sur YOLOv8 est passé de 38 heures à 9 heures grâce à la RTX 4090, en remplacement d'une configuration matérielle insuffisante.

Vingt-quatre gigaoctets suffisent pour gérer la plupart des modèles 7B avec un réglage fin LoRa. QLoRA peut atteindre 13B sur une seule carte. Pour les modèles de plus de 30B, une configuration multi-GPU est nécessaire.

La 4090 ne prend pas en charge NVLink, ce qui limite l'efficacité de la mise à l'échelle multi-GPU par rapport aux cartes destinées aux centres de données. La bande passante entre les GPU repose sur PCIe, ce qui crée des goulots d'étranglement pour les modèles dont la mémoire ne tient pas dans une seule carte graphique.

NVIDIA L4 : Le jeu de l’efficacité

Le GPU L4 est principalement conçu pour l'inférence, mais ses performances en matière d'efficacité énergétique le rendent pertinent pour certains scénarios d'entraînement. Avec une consommation d'énergie inférieure à celle des GPU d'entraînement haut de gamme, le L4 réduit les coûts d'exploitation dans les déploiements cloud.

Les fournisseurs de cloud proposent des instances L4 à des prix nettement inférieurs à ceux des options A100 ou H100. Pour les modèles de petite taille ou les méthodes d'entraînement à faible consommation de paramètres, l'instance L4 offre des performances adéquates à un coût plus avantageux.

Configurations multi-GPU pour les grands modèles

L'entraînement local de modèles à 70 milliards de paramètres nécessite d'importantes ressources GPU. D'après une discussion sur les forums Hugging Face d'avril 2025, un modèle à 70 milliards de paramètres requiert environ 280 Go de VRAM pour les seuls poids du modèle, auxquels s'ajoute la mémoire nécessaire pour les gradients et les fonctions d'activation.

La RTX 4070 Ti SUPER dispose de 16 Go de VRAM, tandis que la RTX 5070 Ti (architecture Blackwell) possède également 16 Go de GDDR7, mais son prix public conseillé est de $749 (son prix réel en 2026 est souvent plus élevé, à partir de $900). De plus, l'intégration de 18 cartes graphiques grand public (série RTX) dans un seul système est techniquement irréalisable en raison des limitations liées aux lignes PCIe, à l'alimentation, au refroidissement et à la carte mère. Le nombre maximal réaliste de cartes graphiques dans un système grand public, sans carte d'extension dédiée de type serveur, est généralement de 4 à 8.

Soyons francs : la plupart des équipes qui ciblent des modèles de plus de 70 milliards de dollars devraient sérieusement évaluer les options cloud avant de s’engager dans des déploiements locaux massifs.

Location de GPU dans le cloud : accès flexible au matériel de centre de données

Les fournisseurs de services cloud permettent d'accéder à la gamme de GPU NVIDIA pour centres de données sans investissement initial. Les GPU H100 et H200 intègrent 80 Go de mémoire HBM3 offrant une bande passante nettement supérieure à celle des cartes grand public.

Les tarifs varient considérablement d'un fournisseur à l'autre. Selon l'étude ‘ Beyond Benchmarks: The Economics of AI Inference ’, le coût horaire de base d'une connexion A800 80G est d'environ $0,79 €/heure, se situant généralement entre $0,51 € et $0,99 €/heure en fonction du fournisseur et de l'engagement.

Clouds hyperscalers vs clouds GPU spécialisés

Les principales plateformes cloud proposent des instances GPU à haute disponibilité, mais à un prix élevé. Les fournisseurs de cloud GPU spécialisés proposent souvent des tarifs nettement inférieurs à ceux des hyperscalers, tout en offrant le même matériel.

Le compromis réside dans l'intégration de l'écosystème. Les hyperscalers proposent des offres combinant GPU et services connexes étendus : bases de données gérées, stockage d'objets, réseau et gestion des identités. Les fournisseurs spécialisés, quant à eux, se concentrent exclusivement sur l'accès au calcul.

Pour les équipes déjà intégrées aux écosystèmes AWS, Azure ou GCP, rester sur la même plateforme est souvent judicieux malgré le coût plus élevé des GPU. Pour les charges de travail privilégiant les GPU et présentant un minimum de dépendances, les fournisseurs spécialisés offrent une meilleure rentabilité.

| Type de fournisseur | Contrôle | Disponibilité à la demande | Prix | Idéal pour |

|---|---|---|---|---|

| Hyperscaler | Haut | Moyen | Prime | Intégration d'entreprise |

| Nuage spécialisé | Moyen | Haut | Compétitif | Charges de travail GPU pures |

| Spot/Préemptible | Faible | Variable | Le plus bas | Emplois tolérants aux pannes |

H100 et H200 : fleurons actuels des centres de données

Les GPU NVIDIA H100 constituent la référence actuelle pour l'entraînement de modèles linéaires à grande échelle. Dotées de 80 Go de mémoire HBM3 et de cœurs Tensor spécialisés, ces cartes gèrent efficacement même les modèles les plus volumineux.

Le H200 étend la mémoire à 141 Go HBM3e, permettant ainsi de gérer des modèles encore plus volumineux ou des lots de calcul plus importants. Pour les architectures complexes comme le modèle Mistral Large 3, qui compte 675 milliards de paramètres (comme détaillé dans l'annonce de NVIDIA de décembre 2025), cette mémoire supplémentaire est cruciale.

Les coûts varient généralement de $2 à $4 par heure selon le fournisseur, l'engagement et la région. À partir de 3 500 heures (seuil de rentabilité pour l'achat d'une RTX 4090), le coût de location d'un H100 s'élèverait à $7 000 à $14 000.

Ce type de tarification n'est justifié que lorsque les besoins en matériel dépassent ce qui est économiquement accessible, lorsque les charges de travail sont intermittentes ou lorsque des performances de pointe justifient le surcoût.

Allocation fractionnée du GPU

Les récentes innovations en matière d'ordonnancement des GPU permettent à plusieurs charges de travail de partager efficacement un seul GPU. NVIDIA Run:ai répond à ce besoin grâce à une allocation fractionnée dynamique qui améliore le débit des jetons tout en réduisant la capacité inactive.

D'après un test de performance conjoint réalisé par NVIDIA et Nebius et publié le 18 février 2026, le fractionnement des GPU peut améliorer considérablement l'utilisation des ressources pour les charges de travail LLM, avec un débit GPU maximal de 771 TP3T atteignable grâce à l'utilisation de 0,5 fraction de GPU. Selon le test de performance NVIDIA Run:ai réalisé avec Nebius (février 2026), les petits modèles comme Phi-4-Mini, doté de 3,8 milliards de paramètres et nécessitant environ 8 Go de mémoire, peuvent partager efficacement les GPU avec d'autres charges de travail.

Cette approche est optimale pour l'exécution de plusieurs petits modèles ou pour des charges de travail mixtes d'inférence et d'entraînement. Pour des entraînements uniques de grande envergure, l'accès à un GPU dédié offre toujours des performances optimales.

Matériel émergent : ce qui nous attend

NVIDIA a annoncé la plateforme Rubin le 5 janvier 2026, promettant une réduction jusqu'à 10 fois du coût des jetons d'inférence et une réduction de 4 fois du nombre de GPU nécessaires à l'entraînement. La plateforme intègre NVLink de sixième génération offrant une bande passante de 3,6 To/s par GPU.

Les GPU Blackwell, positionnés entre les actuels H200 et les futurs Rubin, offrent des gains de performances considérables en matière de débit d'inférence. D'après l'annonce de NVIDIA du 2 avril 2025, Blackwell est optimisé pour répondre aux besoins croissants en calcul des charges de travail de raisonnement IA.

NVIDIA Dynamo 1.0 est entré en production le 16 mars 2026, offrant un logiciel libre pour l'inférence générative et agentique à grande échelle. Selon l'annonce de NVIDIA, Dynamo multiplie par sept les performances d'inférence des GPU Blackwell.

Mais attention : tout ce matériel de nouvelle génération sera vendu à prix d'or dès sa sortie. Les premiers utilisateurs paieront le prix fort pour des performances de pointe. Les équipes soucieuses de leur budget devraient vérifier si les GPU de la génération actuelle répondent à leurs besoins avant d'opter pour les puces les plus récentes.

Stratégies d'optimisation réduisant les besoins en GPU

Le choix du matériel ne représente que la moitié du problème. La méthodologie de formation détermine la consommation réelle de ressources.

Réglage fin efficace des paramètres

Les techniques LoRA et QLoRA réduisent les besoins en mémoire de 4 à 14 fois par rapport à un réglage fin complet. Au lieu de mettre à jour tous les poids du modèle, ces méthodes entraînent de petites couches d'adaptation tout en conservant le modèle de base figé.

Un modèle 13B nécessitant 125 Go pour un réglage optimal n'en requiert que 9 Go avec QLoRA 4 bits. C'est la différence entre avoir besoin de huit GPU au lieu d'un seul.

Il existe des compromis en matière de performances : les méthodes économes en paramètres n’atteignent pas toujours la qualité d’un réglage fin optimal. Cependant, pour de nombreuses applications, la différence est négligeable au regard des économies réalisées.

Point de contrôle du gradient et précision mixte

La technique de pointage de gradient privilégie la mémoire au détriment du calcul en recalculant les activations intermédiaires lors de la rétropropagation au lieu de les stocker. Cela réduit de moitié les besoins en mémoire, au prix d'un temps d'entraînement 20 à 30% plus long.

L'entraînement en précision mixte utilise des nombres à virgule flottante 16 bits pour la plupart des opérations, tout en conservant les calculs critiques en 32 bits. Les cœurs Tensor modernes accélèrent les opérations 16 bits, ce qui rend souvent la précision mixte à la fois plus rapide et plus économe en mémoire que l'entraînement en 32 bits pur.

Déchargement de tenseurs et stockage GPUDirect

Une étude publiée le 6 juin 2025 sur arXiv présente TERAIO, une méthode d'entraînement LLM économique utilisant le déchargement de tenseurs prenant en compte leur durée de vie via GPUDirect Storage. Selon cette étude, les tenseurs actifs n'occupent qu'une petite fraction (1,71 TP3T en moyenne) de la mémoire GPU allouée à chaque itération d'entraînement LLM. Le système permet la migration directe des tenseurs entre les GPU et les SSD, réduisant ainsi les goulots d'étranglement du CPU et optimisant l'utilisation de la bande passante des SSD.

Cette architecture permet d'entraîner des modèles plus volumineux sur un nombre réduit de GPU en répartissant intelligemment les tenseurs entre la mémoire GPU et le stockage NVMe rapide. La perte de performance liée à l'accès au stockage est minimisée grâce à la prélecture prédictive.

Cadre de calcul des coûts

Pour déterminer le rapport coût-efficacité réel, il faut calculer le coût total de possession, et non pas seulement le prix affiché.

Composants TCO du GPU local

Le prix d'achat du matériel représente le coût évident, mais les frais d'exploitation s'accumulent :

- Consommation électrique : La RTX 4090 consomme environ 450 W à pleine charge. Avec un tarif d'électricité américain typique d'environ 1 TP4T0,12 $/kWh, son fonctionnement continu coûterait environ 1 TP4T0,05 $ par heure, soit 1 TP4T438 $ par an.

- Besoins en refroidissement : Les GPU hautes performances génèrent une chaleur importante nécessitant une circulation d'air adéquate ou un refroidissement liquide.

- Infrastructure de soutien : Carte mère, processeur, RAM, stockage, alimentation, boîtier.

- Maintenance et remplacement éventuel : Les cartes graphiques grand public ne bénéficient pas des garanties professionnelles et finissent par tomber en panne.

Un système complet basé sur une RTX 4090 coûte généralement entre $3 000 et $4 000, tout compris. Amorti sur trois ans, en tenant compte des coûts d'électricité, cela représente environ $1 500 par an, plus la consommation électrique.

Composants TCO GPU Cloud

La facturation du cloud semble simple : un tarif horaire multiplié par les heures d’utilisation. Des coûts cachés apparaissent :

- Transfert de données : Déplacement des ensembles de données d'entraînement et des points de contrôle des modèles vers/depuis le stockage cloud.

- Frais de stockage : Disques persistants pour les ensembles de données et les résultats intermédiaires.

- Temps d'inactivité : Oublier de fermer les instances après la fin de la formation.

- Sortie du réseau : Téléchargement des modèles entraînés pour un déploiement ailleurs.

Prévoyez un budget supplémentaire de 10-20% au-delà des coûts horaires de base du GPU pour ces dépenses annexes.

Cadre de décision : local, cloud ou hybride

La stratégie optimale dépend des habitudes d'utilisation et des exigences en matière d'échelle.

Choisissez les GPU locaux lorsque :

- La formation se déroule en continu (plus de 3 500 heures par an).

- Les dimensions des modèles s'inscrivent parfaitement dans les limites de la mémoire GPU grand public.

- Les exigences de résidence des données ou de sécurité empêchent l'utilisation du cloud

- Un budget est prévu pour les dépenses d'investissement initiales.

Choisissez les GPU cloud lorsque :

- L'entraînement est intermittent ou expérimental

- Les dimensions des modèles dépassent les configurations locales pratiques.

- La demande de pointe varie considérablement au fil du temps.

- L'accès au matériel le plus récent compte plus que les considérations économiques à long terme.

Les approches hybrides sont pertinentes pour de nombreuses équipes. Elles permettent de développer et de tester sur du matériel local, puis de migrer vers le cloud pour les entraînements complets. Cela optimise l'utilisation du matériel en interne tout en n'accédant aux GPU du centre de données qu'en cas de besoin.

Partage de GPU et déploiements multi-locataires

Une étude publiée le 6 mai 2025 sur arXiv présente Prism, un système de partage de GPU pour la gestion de serveurs multi-LLM. Selon l'article arXiv 2505.04021 (mai 2025), Prism permet de réduire les coûts de plus de moitié et d'atteindre les objectifs de niveau de service (SLO) 3,3 fois mieux que les systèmes de gestion de serveurs multi-LLM de pointe.

Bien que centrées sur l'inférence plutôt que sur l'entraînement, les principes restent valables. Plusieurs petites tâches d'entraînement peuvent partager les ressources du GPU plus efficacement que de dédier un GPU entier à chaque charge de travail.

La planification des GPU basée sur Kubernetes, combinée à des outils comme le plugin NVIDIA, permet une allocation fractionnée des GPU dans les environnements auto-hébergés. Ceci optimise l'utilisation lors de l'exécution de charges de travail diverses sur un pool de GPU partagé.

Formation régionale et décentralisée

Les frameworks d'entraînement décentralisés permettent le pré-entraînement des modèles linéaires à longue portée (LLM) sur des GPU répartis géographiquement. Selon une étude de SPES présentée à ICLR 2026, les chercheurs ont réussi à entraîner des LLM du ministère de l'Éducation (MoE) à l'aide de configurations GPU décentralisées, avec une empreinte mémoire réduite par nœud.

Ce modèle permet d'étendre l'accès à la formation LLM aux organisations disposant de ressources informatiques distribuées plutôt que de clusters centralisés. La rentabilité découle de l'utilisation du matériel existant sur plusieurs sites, évitant ainsi l'achat d'une infrastructure de formation dédiée.

Recommandations pratiques par niveau de budget

C’est là que les choses deviennent concrètes. Que doivent acheter ou louer les équipes ?

Budget d'entrée ($0-$3 000)

Privilégiez les instances cloud spot ou les GPU grand public dotés de 16 à 24 Go de VRAM. La RTX 4060 Ti (16 Go) constitue l'option minimale viable pour l'expérimentation sur le modèle 7B avec QLoRA.

Les instances spot cloud pour GPU NVIDIA T4 à faible configuration sont facturées $0,40/heure selon la tarification de Hugging Face GPU Spaces. Cela permet 7 500 heures d'entraînement avant d'atteindre la capacité d'une instance locale de $3 000 heures, largement suffisante pour la recherche initiale.

Budget moyen ($3 000-$10 000)

Les systèmes RTX 4090 offrent le meilleur compromis entre performances et prix. Un système bi-RTX 4090 correctement configuré gère la plupart des scénarios d'entraînement 13B et les modèles 30B plus petits grâce à des méthodes économes en paramètres.

Vous pouvez aussi allouer ce budget à des crédits cloud H100. À $3/heure, 10 000 crédits H100 offrent environ 3 333 heures, ce qui est suffisant pour des projets de recherche importants sans obligation de propriété.

Budget de production ($10 000+)

Les charges de travail de production importantes justifient l'utilisation de matériel de centre de données. Les déploiements cloud avec plusieurs GPU A100 ou H100 et une tarification par instance réservée garantissent des coûts et des performances prévisibles.

Pour les organisations ayant des besoins de formation continus, les clusters A100 ou L40S sur site deviennent rentables malgré un investissement initial plus important. Le support aux entreprises et les avantages économiques à long terme favorisent une acquisition à grande échelle.

Pièges courants à éviter

Plusieurs erreurs entraînent systématiquement des pertes de budget et de temps :

- Surdimensionnement de la mémoire : L'achat de cartes graphiques de 80 Go pour l'entraînement de 7 milliards de modèles est un gaspillage d'argent. Il faut adapter le matériel aux besoins réels, et non aux limites théoriques.

- Ignorer la bande passante : Les lignes PCIe et la connectivité NVLink sont essentielles pour l'entraînement multi-GPU. Les cartes mères grand public manquent souvent de bande passante suffisante pour prendre en charge efficacement plus de 2 ou 3 GPU haut de gamme.

- Oublier le refroidissement : L'intégration de plusieurs cartes graphiques hautes performances dans un même châssis exige une ventilation importante. La limitation thermique nuit aux performances et engendre des problèmes de fiabilité.

- Mélanger du matériel incompatible : Tous les GPU ne prennent pas en charge NVLink, les versions PCIe ont une incidence sur la bande passante et les alimentations doivent fournir une alimentation propre et adéquate sur les rails appropriés.

- Négliger l'optimisation logicielle : L'amélioration des performances la plus économique provient d'un meilleur code, et non d'un meilleur matériel. Analysez les charges de travail avant d'investir dans des GPU.

N'investissez pas trop dans les GPU, optimisez d'abord la configuration d'entraînement.

Les coûts des GPU reflètent généralement des choix plus profonds : ce que vous entraînez, comment vous l’entraînez et si la charge de travail est réellement justifiée. IA supérieure Ce projet vise à concevoir et à entraîner des modèles linéaires à grande échelle (LLM) en privilégiant l'efficacité à chaque étape. Il s'agit notamment de déterminer quand un entraînement complet est nécessaire par rapport à un simple ajustement, de structurer les jeux de données pour qu'ils soient utilisables sans être trop volumineux, et de configurer des sessions d'entraînement qui n'entraînent aucun gaspillage de ressources. L'objectif est d'éviter le recours systématique à des calculs à grande échelle lorsqu'une configuration plus petite et mieux adaptée permettrait d'obtenir le même résultat.

Une grande partie des dépenses liées aux GPU provient de l'exécution de processus mal conçus : expériences répétées, modèles surdimensionnés ou pipelines d'entraînement non optimisés. Pour réduire ces dépenses, il est nécessaire de revoir la conception du système, et pas seulement le matériel utilisé. Si vous souhaitez maîtriser vos coûts GPU avant qu'ils ne s'aggravent, contactez-nous. IA supérieure et examinez comment votre flux de travail de formation est défini.

Considérations pour pérenniser l'avenir

Les architectures GPU évoluent rapidement. Le matériel acheté aujourd'hui sera dépassé par la prochaine génération d'ici 12 à 18 mois.

Mais est-ce vraiment important ? Pour les charges de travail en production, les plateformes stables bénéficiant d’un support logiciel éprouvé offrent souvent un meilleur retour sur investissement que le matériel de pointe doté d’outils encore immatures.

La location de cloud offre une protection naturelle contre l'obsolescence. Mettez à niveau votre matériel en changeant de type d'instance plutôt qu'en remplaçant votre propre équipement.

Pour les configurations locales, privilégiez les plateformes ayant une bonne valeur de revente. Les GPU grand public NVIDIA conservent une demande sur le marché secondaire. Les cartes pour centres de données conservent leur valeur plus longtemps, mais leurs marchés sont moins liquides.

FAQ

De quel GPU ai-je besoin pour entraîner un LLM à 7 milliards de paramètres ?

Pour un réglage optimal, il faut environ 67 Go de VRAM répartis sur une ou plusieurs cartes graphiques. Avec LoRa, une seule carte graphique de 24 Go comme la RTX 4090 suffit. QLoRA réduit les exigences à seulement 5 Go, rendant ainsi compatibles même les cartes graphiques d'entrée de gamme.

Est-il moins cher d'acheter une carte graphique ou d'en louer une dans le cloud ?

L'acquisition d'un GPU local devient plus économique après environ 3 500 heures d'utilisation que sa location dans le cloud. Pour des formations ponctuelles ou des projets nécessitant moins de 150 jours de calcul continu, la location dans le cloud est plus avantageuse. En revanche, pour des charges de travail soutenues, l'acquisition d'un GPU local est la solution la plus rentable.

Combien coûte la location d'un GPU cloud H100 ?

Les tarifs varient de $2 à 4 par heure selon le fournisseur, la région et le niveau d'engagement. Les instances ponctuelles et les réservations permettent de réduire les coûts, tandis que l'accès à la demande est facturé à un tarif plus élevé.

Est-il possible d'entraîner des modèles LLM sur des GPU grand public comme la RTX 4090 ?

Absolument. La RTX 4090 avec 24 Go de VRAM gère sans problème les modèles de 7 milliards de données et ceux de 13 milliards grâce à des techniques d'optimisation des paramètres. Plusieurs RTX 4090 en parallèle permettent d'entraîner des modèles encore plus volumineux, même si les GPU de centres de données offrent une meilleure évolutivité multi-GPU.

Quelle est la différence entre les GPU A100 et H100 ?

Le H100 offre 80 Go de mémoire HBM3 contre 80 Go de HBM2e pour le A100, ce qui lui confère une bande passante supérieure. Le H100 intègre des cœurs Tensor de quatrième génération, offrant des performances améliorées pour les opérations de transformation. Pour l'entraînement LLM, le H100 affiche généralement des performances supérieures au A100.

Ai-je besoin de NVLink pour l'entraînement multi-GPU ?

NVLink améliore considérablement l'efficacité multi-GPU pour les grands modèles qui ne tiennent pas dans la mémoire d'un seul GPU. Pour les modèles qui tiennent entièrement dans un seul GPU grâce au parallélisme des données, la bande passante PCIe est suffisante. L'entraînement de modèles de plus de 30 milliards de bits bénéficie grandement de la connectivité NVLink.

Quelle est l'architecture GPU la plus rentable pour les LLM en 2026 ?

Pour les configurations locales, la RTX 4090 offre le meilleur rapport performances/prix. Pour les charges de travail dans le cloud, le processeur graphique NVIDIA L4 assure une bonne efficacité pour les petits modèles, tandis que le H100 offre des performances optimales pour l'entraînement à grande échelle. L'option la plus rentable dépend de la taille de la charge de travail et des habitudes d'utilisation, et non d'une architecture en particulier.

Conclusion

Le choix d'un GPU rentable pour l'entraînement LLM doit trouver un équilibre entre l'achat et la location, les besoins en mémoire par rapport à la taille du modèle et les besoins en performances par rapport aux contraintes budgétaires.

Pour les équipes qui débutent dans le développement de modèles linéaires, la location de GPU dans le cloud offre une grande flexibilité sans investissement initial. Expérimentez différentes tailles de modèles et approches d'entraînement avant d'investir dans du matériel.

Les organisations ayant des charges de travail de formation soutenues devraient sérieusement envisager l'acquisition de GPU locaux. Après 3 500 heures, l'achat s'avère nettement plus avantageux que la location.

L'enseignement le plus important ? L'optimisation du matériel et l'amélioration des méthodes d'entraînement permettent souvent d'obtenir des gains de performance supérieurs à l'achat de GPU plus onéreux. Commencez par un code efficace et des techniques appropriées, puis adaptez le matériel aux goulots d'étranglement réels.

Vérifiez les prix actuels des fournisseurs de services cloud GPU et des fabricants de matériel avant de prendre une décision définitive ; ce marché évolue rapidement et les coûts fluctuent chaque mois.