Kurzzusammenfassung: Kostengünstige GPUs für das LLM-Training im Jahr 2026 sind beispielsweise die NVIDIA RTX 4090 und L4 für lokale Setups. Cloud-Optionen wie H100 und die aufkommende fraktionale GPU-Zuteilung bieten flexible Preisgestaltung. Die optimale Wahl hängt von der Modellgröße, dem Budget und der Frage ab, ob man kauft oder mietet – der Break-Even-Punkt liegt bei etwa 3.500 Stunden für den Kauf im Vergleich zur Cloud-Miete.

Die Hardwareauswahl für LLM-Schulungen entscheidet heute darüber, ob Projekte termingerecht abgeschlossen werden oder das Budget vor der Implementierung aufgebraucht ist. Da Modelle mittlerweile über 70 Milliarden Parameter umfassen, stehen Teams vor einem Markt, auf dem eine einzige falsche GPU-Wahl wochenlange Rechenzeitverschwendung oder Tausende von Dollar für überdimensionierte Kapazität kosten kann.

Aber das Entscheidende ist: Kosteneffizienz hängt nicht nur vom Preis ab. Es geht darum, die Anforderungen der Arbeitslast an die Hardwarekapazität anzupassen und dabei sowohl Leistungsengpässe als auch teure Überdimensionierung zu vermeiden.

GPU-Anforderungen für das LLM-Training verstehen

Das Training großer Sprachmodelle erfordert spezifische Hardwareeigenschaften, die über Spiele oder traditionelle ML-Anwendungen hinausgehen. Die Speicherkapazität bildet die Mindestanforderung dafür, welche Modelle überhaupt ausgeführt werden können.

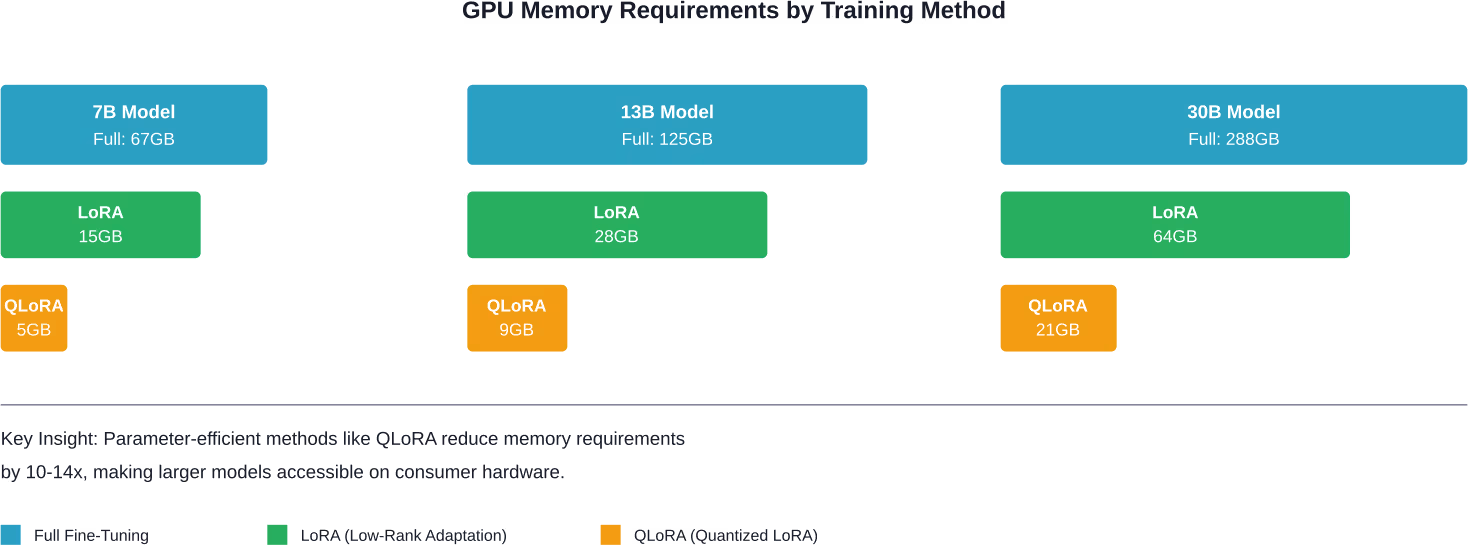

Für eine vollständige Feinabstimmung werden typischerweise etwa 16 GB VRAM pro Milliarde Parameter benötigt. Ein Modell mit 7 Milliarden Parametern benötigt für das vollständige Training ungefähr 67 GB, während ein Modell mit 13 Milliarden Parametern 125 GB und Modelle mit 30 Milliarden Parametern 288 GB benötigen.

Aber Moment mal. Diese Zahlen setzen eine vollständige Feinabstimmung voraus. Parametereffiziente Methoden verändern die Berechnung grundlegend.

| Modellgröße | Vollständige Feinabstimmung | LoRA | QLoRA (4-Bit) | Schlussfolgerung |

|---|---|---|---|---|

| 7B-Parameter | 67 GB | 15 GB | 5 GB | 14 GB |

| 13B-Parameter | 125 GB | 28 GB | 9 GB | 26 GB |

| 30B-Parameter | 288 GB | 64 GB | 21 GB | 60 GB |

Die Speicherbandbreite steuert die Trainingsgeschwindigkeit. Trotz voller Leistungsaufnahme arbeiten GPUs während des standardmäßigen LLM-Vortrainings laut einer Studie von Mindbeam AI häufig mit suboptimalen Auslastungsraten von 30% bis 50%. Der Flaschenhals liegt oft nicht in der reinen Rechenleistung, sondern in der Geschwindigkeit des Zugriffs der GPU auf Modellgewichte und Gradienten.

Tensor-Kerne stellen einen weiteren entscheidenden Leistungsfaktor dar. Moderne NVIDIA-Architekturen beinhalten spezialisierte Hardware für Matrixoperationen, auf die Transformer-Modelle stark angewiesen sind.

Lokale GPU-Optionen: Wann Besitz sinnvoll ist

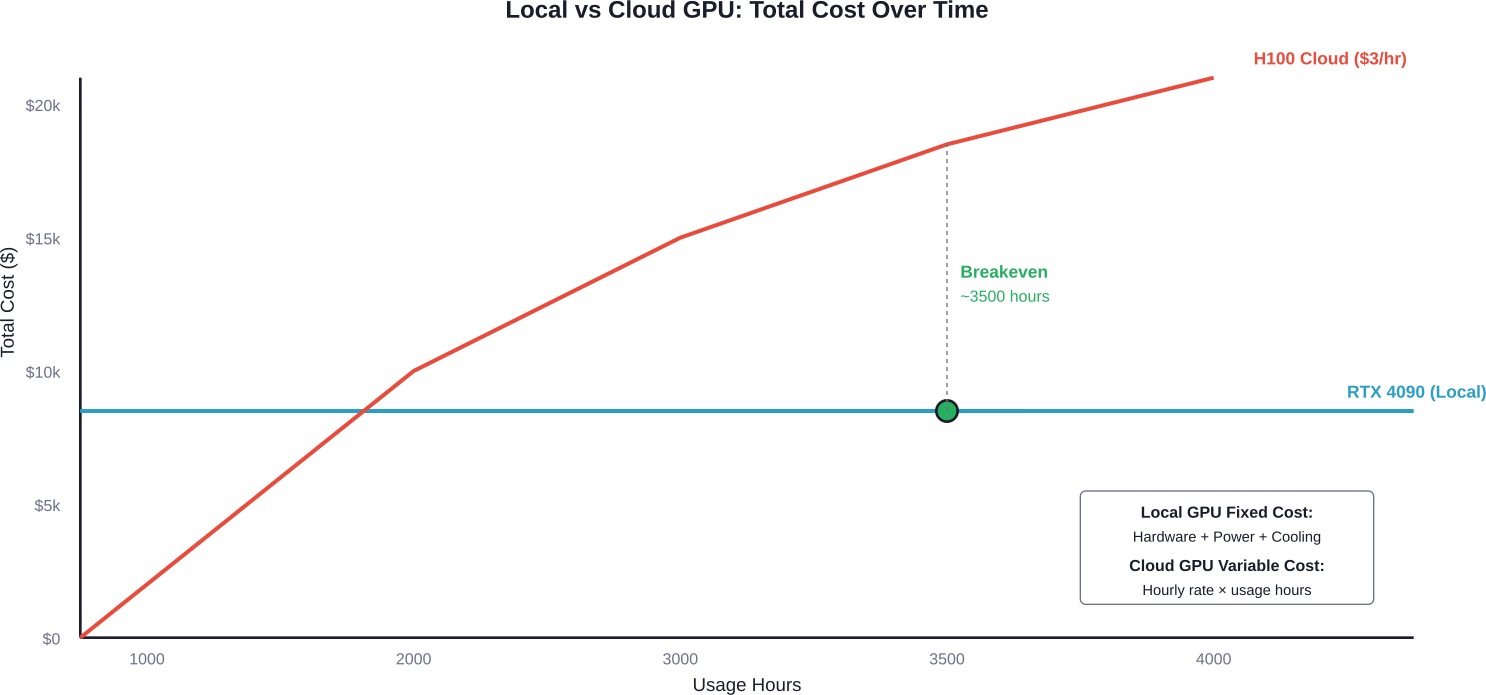

Der Kauf von Hardware ist finanziell sinnvoll, wenn Trainingsworkloads kontinuierlich ausgeführt werden. Die Break-Even-Daten zeigen, dass sich der Kauf einer RTX 4090 erst nach etwa 3.500 Stunden aktiver Nutzung mit den Mietkosten eines A100 deckt.

Das entspricht etwa 146 Tagen Dauerbetrieb. Für Teams, die ununterbrochen forschen oder regelmäßig Produktionsschulungen durchführen, lohnt sich der Besitz. Bei Projekten mit nur gelegentlicher Laufzeit hingegen nicht.

NVIDIA RTX 4090: Das preisgünstige Arbeitstier

Die RTX 4090 bietet 24 GB VRAM zu Preisen zwischen 1.600 und 1.800 TKP pro Karte. Laut Berichten aus der Community verkürzten sich die Trainingszeiten für YOLOv8 von 38 auf 9 Stunden beim Wechsel von unzureichender Hardware zur RTX 4090.

24 Gigabyte reichen für die meisten 7B-Modelle mit LoRA-Feinabstimmung problemlos aus. QLoRA kann auf einer einzelnen Karte bis zu 13B erreichen. Für Modelle mit 30B und mehr sind Multi-GPU-Systeme erforderlich.

Die 4090 unterstützt kein NVLink, was die Effizienz der Multi-GPU-Skalierung im Vergleich zu Rechenzentrumskarten einschränkt. Die Bandbreite zwischen den GPUs basiert stattdessen auf PCIe, was bei Modellen, die nicht in den Single-GPU-Speicher passen, zu Engpässen führt.

NVIDIA L4: Das Effizienzspiel

Die L4-GPU ist primär für Inferenzanwendungen konzipiert, ihre Effizienz macht sie aber auch für bestimmte Trainingsszenarien relevant. Dank ihres geringeren Stromverbrauchs im Vergleich zu führenden Trainings-GPUs senkt die L4 die Betriebskosten in Cloud-Umgebungen.

Cloud-Anbieter bieten L4-Instanzen deutlich günstiger an als A100- oder H100-Optionen. Für kleinere Modelle oder parametereffiziente Trainingsmethoden bietet die L4-Instanz eine ausreichende Leistung zu besseren Kosten.

Multi-GPU-Konfigurationen für große Modelle

Das lokale Training von Modellen mit 70 Milliarden Parametern erfordert erhebliche GPU-Leistung. Laut einer Diskussion im Hugging Face Forum vom April 2025 benötigt ein solches Modell allein für die Modellgewichte etwa 280 GB VRAM, zuzüglich weiteren Speichers für Gradienten und Aktivierungen.

Die RTX 4070 Ti SUPER verfügt über 16 GB VRAM, während die RTX 5070 Ti (Blackwell-Architektur) ebenfalls 16 GB GDDR7 besitzt, deren UVP jedoch bei $749 liegt (der tatsächliche Preis im Jahr 2026 dürfte oft höher bei über $900 liegen). Darüber hinaus ist der Aufbau eines Clusters aus 18 Consumer-GPUs (RTX-Serie) in einem einzigen System aufgrund von PCIe-Lanes, Stromversorgung, Kühlung und Mainboard-Beschränkungen technisch nicht praktikabel. Die maximal realistische Anzahl in einem Consumer-System ohne dedizierte Server-Erweiterungskarten liegt typischerweise bei 4–8 Karten.

Mal ehrlich: Die meisten Teams, die auf Modelle mit über 70 Milliarden Einheiten abzielen, sollten Cloud-Optionen ernsthaft in Betracht ziehen, bevor sie sich für massive lokale Builds entscheiden.

Cloud-GPU-Vermietung: Flexibler Zugriff auf Rechenzentrumshardware

Cloud-Anbieter ermöglichen den Zugriff auf NVIDIAs Rechenzentrums-GPUs ohne Investitionskosten. Die GPUs H100 und H200 verfügen über 80 GB HBM3-Speicher mit deutlich höherer Bandbreite als Consumer-Grafikkarten.

Die Preise variieren je nach Anbieter erheblich. Laut der Studie ‘Beyond Benchmarks: The Economics of AI Inference’ belaufen sich die Basiskosten für A800 80G auf etwa $0,79/Stunde, wobei sie je nach Anbieter und Vertragslaufzeit in der Regel zwischen $0,51 und $0,99/Stunde liegen.

Hyperscaler vs. Spezialisierte GPU-Clouds

Große Cloud-Plattformen bieten GPU-Instanzen mit hoher Verfügbarkeit, aber zu Premiumpreisen. Spezialisierte GPU-Cloud-Anbieter unterbieten Hyperscaler oft deutlich und bieten dabei dieselbe Hardware.

Der Kompromiss liegt in der Integration des Ökosystems. Hyperscaler bündeln GPUs mit umfangreichen angrenzenden Diensten – verwalteten Datenbanken, Objektspeicherung, Netzwerkdiensten und Identitätsmanagement. Spezialisierte Anbieter konzentrieren sich hingegen ausschließlich auf den Zugriff auf Rechenleistung.

Für Teams, die bereits in AWS-, Azure- oder GCP-Ökosystemen integriert sind, ist die Nutzung der jeweiligen Plattform trotz höherer GPU-Kosten oft sinnvoll. Für GPU-intensive Workloads mit minimalen Abhängigkeiten bieten spezialisierte Anbieter eine bessere Wirtschaftlichkeit.

| Anbietertyp | Kontrolle | Verfügbarkeit auf Abruf | Preis | Am besten geeignet für |

|---|---|---|---|---|

| Hyperscaler | Hoch | Medium | Prämie | Unternehmensintegration |

| Spezialisierte Cloud | Medium | Hoch | Wettbewerbsfähig | Reine GPU-Workloads |

| Spot/Preemptible | Niedrig | Variable | Niedrigster | Fehlertolerante Jobs |

H100 und H200: Aktuelle Flaggschiffe für Rechenzentren

NVIDIA H100 GPUs stellen den aktuellen Standard für das Training umfangreicher LLM-Modelle dar. Mit 80 GB HBM3-Speicher und spezialisierten Tensor-Kernen bewältigen diese Karten selbst massive Modelle effizient.

Die H200 erweitert den Speicher auf 141 GB HBM3e und ermöglicht so noch größere Modelle oder größere Chargengrößen. Für Architekturen mit gemischten Komponenten wie das Mistral Large 3-Modell mit insgesamt 675 Milliarden Parametern, wie in NVIDIAs Ankündigung vom Dezember 2025 detailliert beschrieben, ist dieser zusätzliche Speicher von erheblicher Bedeutung.

Die Kosten liegen üblicherweise zwischen $2 und 4 pro Stunde, abhängig vom Anbieter, der Vertragslaufzeit und der Region. Bei 3.500 Stunden – dem Break-Even-Punkt für den Besitz einer RTX 4090 – würden die Mietkosten für einen H100 insgesamt $7.000 bis $14.000 betragen.

Diese Preisgestaltung ist nur dann sinnvoll, wenn der Hardwarebedarf das wirtschaftlich Machbare übersteigt, wenn die Arbeitslasten nur zeitweise auftreten oder wenn eine Spitzenleistung den Aufpreis rechtfertigt.

Teilweise GPU-Zuweisung

Jüngste Innovationen im GPU-Scheduling ermöglichen es mehreren Workloads, einzelne GPUs effizient gemeinsam zu nutzen. NVIDIA Run:ai löst dieses Problem durch dynamische fraktionierte Zuweisung, die den Token-Durchsatz verbessert und gleichzeitig die Leerlaufkapazität reduziert.

Laut gemeinsamen Benchmark-Ergebnissen von NVIDIA und Nebius vom 18. Februar 2026 kann GPU-Fraktionierung die Ressourcennutzung für LLM-Workloads deutlich verbessern. Mit einer GPU-Fraktionierung von 0,5 lässt sich ein voller GPU-Durchsatz von 771 TP3T erreichen. Die Benchmark-Ergebnisse von NVIDIA Run:ai mit Nebius (Februar 2026) zeigen, dass kleine Modelle wie der Phi-4-Mini mit 3,8 Milliarden Parametern und einem Speicherbedarf von ca. 8 GB GPUs effektiv mit anderen Workloads teilen können.

Dieser Ansatz eignet sich am besten für die Ausführung mehrerer kleinerer Modelle oder gemischter Inferenz- und Trainingslasten. Für einzelne große Trainingsläufe bietet der dedizierte GPU-Zugriff weiterhin die optimale Leistung.

Neue Hardware: Was kommt als Nächstes?

NVIDIA kündigte am 5. Januar 2026 die Rubin-Plattform an, die eine bis zu zehnfache Reduzierung der Kosten für Inferenztoken und eine vierfache Reduzierung der für das Training benötigten GPU-Anzahl verspricht. Die Plattform nutzt NVLink der sechsten Generation mit einer Bandbreite von 3,6 TB/s pro GPU.

Die Blackwell-GPUs, die zwischen der aktuellen H200- und der zukünftigen Rubin-Architektur positioniert sind, bieten massive Leistungssprünge beim Inferenzdurchsatz. Laut NVIDIAs Ankündigung vom 2. April 2025 optimiert Blackwell für den wachsenden Rechenbedarf von KI-Workloads.

NVIDIA Dynamo 1.0 wurde am 16. März 2026 veröffentlicht und bietet Open-Source-Software für generative und agentenbasierte Inferenz im großen Maßstab. Laut NVIDIA steigert Dynamo die Inferenzleistung von Blackwell-GPUs um bis zu das Siebenfache.

Doch hier liegt der Haken: Die gesamte Hardware der nächsten Generation wird bei Markteinführung zu Premiumpreisen angeboten. Wer frühzeitig einsteigt, zahlt für Spitzenleistung. Kostenbewusste Teams sollten daher prüfen, ob die GPUs der aktuellen Generation ihre Anforderungen erfüllen, bevor sie auf die neueste Technologie setzen.

Optimierungsstrategien zur Reduzierung der GPU-Anforderungen

Die Auswahl der Hardware ist nur die halbe Miete. Die Trainingsmethodik bestimmt den tatsächlichen Ressourcenverbrauch.

Parametereffiziente Feinabstimmung

LoRA- und QLoRA-Verfahren reduzieren den Speicherbedarf im Vergleich zum vollständigen Feinabstimmen um das 4- bis 14-Fache. Anstatt alle Modellgewichte zu aktualisieren, trainieren diese Methoden kleine Adapterschichten, während das Basismodell unverändert bleibt.

Ein 13B-Modell, das für die vollständige Feinabstimmung 125 GB benötigt, kommt mit 4-Bit-QLoRA mit nur 9 GB aus. Das entspricht dem Unterschied zwischen acht und nur einer GPU.

Es gibt Kompromisse bei der Leistungsfähigkeit – parametereffiziente Methoden erreichen nicht immer die Qualität einer vollständigen Feinabstimmung. Für viele Anwendungen ist der Unterschied jedoch im Vergleich zu den Kosteneinsparungen vernachlässigbar.

Gradienten-Checkpointing und gemischte Präzision

Gradienten-Checkpointing reduziert den Speicherbedarf, indem Zwischenergebnisse der Aktivierungen während der Backpropagation neu berechnet statt gespeichert werden. Dadurch halbiert sich der Speicherbedarf annähernd, allerdings verlängert sich die Trainingszeit um 20–301 Tsd.

Beim Training mit gemischter Präzision werden für die meisten Operationen 16-Bit-Gleitkommazahlen verwendet, während kritische Berechnungen in 32 Bit durchgeführt werden. Moderne Tensor-Kerne beschleunigen 16-Bit-Operationen, wodurch das Training mit gemischter Präzision oft sowohl schneller als auch speichereffizienter als reines 32-Bit-Training ist.

Tensor-Offloading und GPUDirect-Speicher

Eine am 6. Juni 2025 auf arXiv veröffentlichte Studie stellte TERAIO vor, einen kosteneffizienten Ansatz für das Training von LLM-Systemen, der lebensdauerbewusstes Tensor-Offloading über GPUDirect Storage nutzt. Laut TERAIO belegen die aktiven Tensoren in jeder LLM-Trainingsiteration nur einen geringen Anteil (durchschnittlich 1,7%) des zugewiesenen GPU-Speichers. Das System ermöglicht die direkte Migration von Tensoren zwischen GPUs und SSDs, wodurch CPU-Engpässe vermieden und die SSD-Bandbreite optimal genutzt wird.

Diese Architektur ermöglicht das Training größerer Modelle auf weniger GPUs durch intelligentes Auslagern von Tensoren zwischen GPU-Speicher und schnellem NVMe-Speicher. Der Leistungsverlust durch Speicherzugriffe wird durch prädiktives Vorladen minimiert.

Kostenberechnungsrahmen

Um die tatsächliche Kosteneffizienz zu ermitteln, müssen die Gesamtbetriebskosten berechnet werden, nicht nur die Listenpreise.

Lokale GPU-TCO-Komponenten

Der Hardware-Kaufpreis stellt den offensichtlichen Kostenfaktor dar, aber die Betriebskosten summieren sich:

- Stromverbrauch: Die RTX 4090 hat unter Volllast eine Leistungsaufnahme von ca. 450 W. Bei den üblichen US-Strompreisen von ca. 10,12 £/kWh würden die Kosten im Dauerbetrieb etwa 10,05 £ pro Stunde bzw. 438 £ pro Jahr betragen.

- Kühlbedarf: Hochleistungs-GPUs erzeugen erhebliche Wärme, die eine ausreichende Luftzirkulation oder Flüssigkeitskühlung erfordert.

- Unterstützungsinfrastruktur: Motherboard, CPU, RAM, Speicher, Netzteil, Gehäuse.

- Wartung und potenzieller Austausch: Consumer-GPUs verfügen nicht über die Garantien von Unternehmen und fallen irgendwann aus.

Ein komplettes System mit einer RTX 4090 kostet in der Regel 1.400 bis 1.400 Euro. Umgerechnet auf drei Jahre inklusive Stromkosten ergibt das jährlich etwa 1.500 Euro zuzüglich Stromkosten.

Cloud-GPU-TCO-Komponenten

Die Abrechnung von Cloud-Diensten erscheint einfach – Stundensatz mal Nutzungsstunden. Versteckte Kosten entstehen jedoch bei:

- Datenübertragung: Verschieben von Trainingsdatensätzen und Modell-Checkpoints in/aus dem Cloud-Speicher.

- Lagerkosten: Permanente Datenträger für Datensätze und Zwischenergebnisse.

- Leerlaufzeit: Vergessen, die Instanzen nach Abschluss des Trainings herunterzufahren.

- Netzwerkausgang: Herunterladen trainierter Modelle zur Bereitstellung an anderer Stelle.

Planen Sie zusätzlich zu den stündlichen GPU-Basiskosten weitere 10-20% für diese Nebenkosten ein.

Entscheidungsrahmen: Lokal, Cloud oder Hybrid

Die optimale Strategie hängt von den Nutzungsmustern und den Skalierungsanforderungen ab.

Lokale GPUs auswählen, wenn:

- Die Schulungen finden kontinuierlich statt (über 3.500 Stunden jährlich).

- Die Modellgrößen passen problemlos in den GPU-Speicherbereich von Endverbrauchern.

- Anforderungen an den Datenstandort oder die Sicherheit verhindern die Cloud-Nutzung

- Für die anfänglichen Investitionsausgaben ist ein Budget vorhanden.

Wählen Sie Cloud-GPUs, wenn:

- Das Training ist sporadisch oder experimentell.

- Die Modellgrößen überschreiten die praktischen örtlichen Gegebenheiten.

- Die Spitzennachfrage schwankt im Laufe der Zeit erheblich.

- Der Zugang zu neuester Hardware ist wichtiger als langfristige wirtschaftliche Aspekte.

Hybride Ansätze sind für viele Teams sinnvoll. Entwicklung und Tests erfolgen auf lokaler Hardware, anschließend wird für vollständige Trainingsläufe auf Cloud-Ressourcen skaliert. Dies maximiert die Auslastung der eigenen Hardware und nutzt die GPUs des Rechenzentrums nur bei Bedarf.

GPU-Sharing und Multi-Tenant-Bereitstellungen

Eine am 6. Mai 2025 auf arXiv veröffentlichte Studie stellte Prism vor, ein System für die gemeinsame Nutzung von GPUs beim Multi-LLM-Serving. Laut arXiv-Paper 2505.04021 (Mai 2025) erzielt Prism im Vergleich zu aktuellen Multi-LLM-Serving-Systemen mehr als doppelt so hohe Kosteneinsparungen und eine 3,3-fach höhere Erfüllung der Service Level Objectives (SLOs).

Obwohl der Fokus auf Inferenz und nicht auf Training liegt, gelten die Prinzipien dennoch. Mehrere kleine Trainingsprozesse können GPU-Ressourcen effizienter gemeinsam nutzen, als jedem einzelnen Prozess eine eigene GPU zuzuweisen.

Die GPU-Planung auf Kubernetes-Basis ermöglicht in Kombination mit Tools wie dem NVIDIA-Geräte-Plugin die fraktionierte GPU-Zuweisung in selbstgehosteten Umgebungen. Dadurch wird die Auslastung bei der Ausführung unterschiedlicher Workloads auf einem gemeinsam genutzten GPU-Pool maximiert.

Regionale und dezentrale Ausbildung

Dezentrale Trainingsframeworks ermöglichen das Vortraining von LLMs auf geografisch verteilten GPUs. Laut einer auf der ICLR 2026 vorgestellten Studie von SPES konnten Forscher MoE-LLMs erfolgreich mithilfe dezentraler GPU-Konfigurationen mit reduziertem Speicherbedarf pro Knoten trainieren.

Dieses Paradigma erweitert den Zugang zu LLM-Schulungen auf Organisationen mit verteilten Rechenressourcen anstelle zentralisierter Cluster. Kosteneffizienz ergibt sich aus der Nutzung vorhandener Hardware an mehreren Standorten anstatt aus dem Kauf dedizierter Schulungsinfrastruktur.

Praktische Empfehlungen nach Budgetstufe

Nun wird es praktisch. Was sollten Teams tatsächlich kaufen oder mieten?

Einstiegsbudget ($0-$3.000)

Konzentrieren Sie sich auf Cloud-Spot-Instanzen oder Consumer-GPUs mit 16–24 GB VRAM. Die RTX 4060 Ti (16 GB) bietet die minimale praktikable Option für Experimente mit dem 7B-Modell und QLoRA.

Cloud-Spot-Instanzen für NVIDIA T4-GPUs mit kleinen Konfigurationen kosten laut Hugging Face GPU Spaces $0,40/Stunde. Dies ermöglicht 7.500 Stunden Trainingszeit vor dem Abgleich mit einem lokalen Build für $3.000 – mehr als ausreichend für erste Forschungsarbeiten.

Mittleres Budget ($3.000-$10.000)

RTX 4090-Systeme bieten das beste Verhältnis von Leistung und Preis. Ein korrekt konfiguriertes Dual-4090-System bewältigt die meisten 13B-Trainingsszenarien und kleinere 30B-Modelle mit parametereffizienten Methoden.

Alternativ kann dieses Budget für H100-Cloud-Guthaben verwendet werden. Bei $3/Stunde bietet $10.000 etwa 3.333 Stunden – ausreichend für umfangreiche Forschungsprojekte ohne Eigentumsverpflichtungen.

Produktionsbudget ($10.000+)

Anspruchsvolle Produktionsworkloads rechtfertigen Rechenzentrumshardware. Mehrere A100- oder H100-GPUs in Cloud-Bereitstellungen mit reservierter Instanzpreisgestaltung bieten planbare Kosten und Leistung.

Für Organisationen mit einem dauerhaften Schulungsbedarf sind A100- oder L40S-Cluster vor Ort trotz höherer Anfangsinvestitionen kosteneffektiv. Unternehmensweite Unterstützung und langfristige Wirtschaftlichkeit sprechen für eine großflächige Anschaffung.

Häufige Fallstricke, die es zu vermeiden gilt

Mehrere Fehler führen regelmäßig zu unnötigem Budget- und Zeitverlust:

- Überdimensionierter Speicher: Die Anschaffung von 80-GB-GPUs für das Training von 7-Mbit/s-Modellen ist Geldverschwendung. Die Hardware sollte den tatsächlichen Anforderungen und nicht den theoretischen Maximalwerten entsprechen.

- Bandbreite ignorieren: PCIe-Lanes und NVLink-Konnektivität sind für Multi-GPU-Training wichtig. Mainboards für Endverbraucher bieten oft nicht genügend Bandbreite, um mehr als zwei bis drei High-End-GPUs effektiv zu unterstützen.

- Kühlung vergessen: Mehrere Hochleistungs-GPUs in einem einzigen Gehäuse erfordern einen erheblichen Luftstrom. Thermische Drosselung beeinträchtigt die Leistung und führt zu Zuverlässigkeitsproblemen.

- Inkompatible Hardware mischen: Nicht alle GPUs unterstützen NVLink, die PCIe-Versionen sind für die Bandbreite wichtig, und die Netzteile müssen ausreichend sauberen Strom auf den entsprechenden Schienen liefern.

- Vernachlässigung der Softwareoptimierung: Die kostengünstigste Leistungssteigerung erzielt man durch besseren Code, nicht durch bessere Hardware. Analysieren Sie die Arbeitslasten, bevor Sie Geld für GPUs ausgeben.

Zahlen Sie nicht zu viel für GPUs, optimieren Sie zuerst das Trainings-Setup.

Die Kosten einer GPU spiegeln in der Regel tiefer liegende Entscheidungen wider – was trainiert wird, wie trainiert wird und ob der Arbeitsaufwand tatsächlich gerechtfertigt ist. AI Superior Wir arbeiten an der Entwicklung und dem Training von LLMs mit Fokus auf Effizienz in jeder Phase. Dazu gehört die Entscheidung, wann ein vollständiges Training und wann eine Feinabstimmung erforderlich ist, die Strukturierung von Datensätzen für eine optimale Nutzung ohne unnötigen Umfang sowie die Einrichtung von Trainingsläufen, die keine Rechenzyklen verschwenden. Ziel ist es, den Einsatz umfangreicher Rechenressourcen zu vermeiden, wenn ein kleineres, besser abgestimmtes Setup dasselbe Ergebnis liefern würde.

Ein Großteil der GPU-Ausgaben entsteht durch Prozesse, deren Dimensionierung nie ausreichend berücksichtigt wurde – wiederholte Experimente, überdimensionierte Modelle oder Trainingspipelines, die nicht kontinuierlich angepasst werden. Um dies zu reduzieren, sind Änderungen in der Systemplanung erforderlich, nicht nur in der verwendeten Hardware. Wenn Sie die GPU-Kosten in den Griff bekommen möchten, bevor sie sich unkontrolliert summieren, kontaktieren Sie uns. AI Superior und schauen Sie sich an, wie Ihr Trainingsablauf definiert ist.

Überlegungen zur Zukunftssicherung

GPU-Architekturen entwickeln sich rasant. Hardware, die heute gekauft wird, wird innerhalb von 12 bis 18 Monaten von der nächsten Generation übertroffen werden.

Aber spielt das tatsächlich eine Rolle? Bei Produktionsworkloads bieten stabile Plattformen mit bewährter Softwareunterstützung oft einen besseren ROI als hochmoderne Hardware mit unausgereiften Tools.

Cloud-Miete bietet einen natürlichen Schutz vor Veralterung. Aktualisieren Sie auf neue Hardware, indem Sie die Instanztypen ändern, anstatt Ihre eigene Hardware zu ersetzen.

Bei lokalen Konfigurationen sollten Sie sich auf Plattformen mit hohem Wiederverkaufswert konzentrieren. NVIDIA-Grafikkarten für Endverbraucher weisen eine anhaltende Nachfrage auf dem Gebrauchtmarkt auf. Rechenzentrumskarten behalten ihren Wert länger, weisen aber einen weniger liquiden Markt auf.

Häufig gestellte Fragen

Welche GPU benötige ich, um ein LLM mit 7 Milliarden Parametern zu trainieren?

Für eine optimale Feinabstimmung werden ca. 67 GB VRAM auf einer oder mehreren GPUs benötigt. Mit LoRa funktioniert eine einzelne 24-GB-GPU wie die RTX 4090. QLoRA reduziert die Anforderungen auf nur 5 GB, wodurch selbst Einsteiger-GPUs nutzbar werden.

Ist es günstiger, eine Grafikkarte zu kaufen oder sie aus der Cloud zu mieten?

Der Besitz einer eigenen GPU wird nach etwa 3.500 Betriebsstunden im Vergleich zur Cloud-Miete günstiger. Für gelegentliches Training oder Projekte mit weniger als 150 Tagen kontinuierlicher Rechenzeit ist die Cloud-Miete kostengünstiger. Bei anhaltender Auslastung ist der Besitz die bessere Wahl.

Wie viel kostet die Anmietung einer H100 Cloud-GPU?

Die Preise variieren je nach Anbieter, Region und Vertragslaufzeit zwischen $2 und 4 pro Stunde. Spot-Instanzen und reservierte Preise können die Kosten senken, während On-Demand-Zugriff mit höheren Preisen verbunden ist.

Kann ich LLMs auf Consumer-GPUs wie der RTX 4090 trainieren?

Absolut. Die RTX 4090 mit 24 GB VRAM bewältigt 7-Billionen-Modelle problemlos und 13-Billionen-Modelle mit parametereffizienten Verfahren. Mehrere 4090er-Karten können parallel sogar noch größere Modelle trainieren, wobei Rechenzentrums-GPUs eine bessere Multi-GPU-Skalierung bieten.

Worin besteht der Unterschied zwischen den GPUs A100 und H100?

Der H100 bietet 80 GB HBM3-Speicher im Vergleich zu den 80 GB HBM2e des A100 und ermöglicht dadurch eine höhere Bandbreite. Der H100 verfügt über Tensor-Kerne der vierten Generation mit verbesserter Leistung für Transformer-Operationen. Beim LLM-Training liefert der H100 in der Regel eine höhere Leistung als der A100.

Benötige ich NVLink für das Training mit mehreren GPUs?

NVLink verbessert die Multi-GPU-Effizienz für große Modelle, die nicht in den Speicher einer einzelnen GPU passen, deutlich. Für Modelle, die vollständig auf einer einzelnen GPU mithilfe von Datenparallelität verarbeitet werden können, ist die PCIe-Bandbreite ausreichend. Das Training von Modellen mit über 30 Milliarden Datenpunkten profitiert erheblich von der NVLink-Konnektivität.

Welche GPU-Architektur ist im Jahr 2026 für LLMs am kosteneffektivsten?

Für lokale Installationen bietet die RTX 4090 das beste Preis-Leistungs-Verhältnis. Bei Cloud-Workloads sorgt die NVIDIA L4 für Effizienz bei kleineren Modellen, während die H100 optimale Leistung für umfangreiche Trainingsdaten liefert. Die kostengünstigste Option hängt von der Workload-Größe und den Nutzungsmustern ab und nicht von einer bestimmten Architektur.

Schlussfolgerung

Bei der kosteneffizienten GPU-Auswahl für das LLM-Training werden Kauf- versus Mietkosten, Speicherbedarf und Modellgröße sowie Leistungsanforderungen und Budgetbeschränkungen gegeneinander abgewogen.

Für Teams, die gerade erst mit der LLM-Entwicklung beginnen, bietet die Anmietung von Cloud-GPUs Flexibilität ohne Kapitalbindung. Experimentieren Sie mit verschiedenen Modellgrößen und Trainingsansätzen, bevor Sie in Hardware investieren.

Organisationen mit einem hohen Trainingsaufkommen sollten den Kauf eigener GPUs ernsthaft in Erwägung ziehen. Nach 3.500 Betriebsstunden ist der Kauf wirtschaftlich deutlich rentabler als die Mietkosten.

Die wichtigste Erkenntnis? Hardwareoptimierung und verbesserte Trainingsmethoden führen oft zu größeren Leistungssteigerungen als der bloße Kauf teurerer GPUs. Beginnen Sie mit effizientem Code und geeigneten Techniken und skalieren Sie die Hardware anschließend passend zu den tatsächlichen Engpässen.

Bevor Sie eine endgültige Entscheidung treffen, sollten Sie die aktuellen Preise von GPU-Cloud-Anbietern und Hardwareherstellern prüfen – dieser Markt ist schnelllebig und die Kosten schwanken monatlich.