Korte samenvatting: De kosten voor de Google LLM API variëren aanzienlijk tussen de verschillende Vertex AI-modellen. Vanaf maart 2026 begint Gemini 3.1 Flash-Lite bij $0,25 per 1 miljoen invoertokens (voor ≤200.000 tokens) en $0,25 per 1 miljoen voor >200.000 tokens, terwijl Gemini 3.1 Pro varieert van $2 tot $12 per miljoen tokens, afhankelijk van de contextgrootte. De prijs is afhankelijk van het modeltype, het tokenvolume, caching en grounding-functies, waarbij batchverwerking 50% korting biedt.

De prijsstelling voor de LLM API's van Google is een cruciale factor geworden voor ontwikkelaars en bedrijven die AI-toepassingen bouwen. Met de uitbreiding van de Gemini-modelfamilie van Vertex AI tot begin 2026 is inzicht in de kostenstructuur niet langer optioneel.

De uitdaging? Het prijsmodel van Google is gebaseerd op meerdere variabelen: het aantal tokens, de grootte van het contextvenster, de cachestatus en of verzoeken in batch of realtime worden verwerkt. Een enkele API-aanroep kan, afhankelijk van de configuratie, variëren van een fractie van een cent tot enkele dollars.

Dit zijn de werkelijke kosten op dit moment.

Inzicht in de prijsstructuur van de Google LLM API

Google brengt via Vertex AI kosten in rekening voor het gebruik van de LLM API per token. Maar daar houdt de eenvoud dan ook op.

Volgens de officiële prijslijst van Vertex AI worden de kosten opgesplitst in inputtokens (wat ontwikkelaars naar het model sturen) en outputtokens (wat het model genereert). Deze dubbele prijsberekening betekent dat een prompt van 1000 woorden met een antwoord van 500 woorden twee keer in rekening wordt gebracht: één keer voor het lezen en één keer voor het schrijven.

Een token is een tekstfragment, meestal 3-4 tekens in het Engels. De zin "kunstmatige intelligentie" bestaat uit ongeveer 4 tokens. Een typisch zakelijk document van 500 woorden wordt dus omgezet in ongeveer 650-750 tokens.

Eerlijk gezegd: de meeste ontwikkelaars onderschatten het tokenverbruik met 30-401 TP3T bij het plannen van hun budget. Dat verschil wordt nog groter bij multimodale input zoals afbeeldingen of video.

Wat wordt beschouwd als een factureerbaar verzoek?

Google brengt kosten in rekening voor alle verwerkte tokens in succesvolle verzoeken (200 OK). Sommige 4xx-fouten (zoals 429 Too Many Requests) brengen echter geen kosten met zich mee, terwijl andere fouten, gerelateerd aan contentfiltering tijdens het genereren, wel kosten voor invoertokens met zich mee kunnen brengen.

Dit is belangrijker dan het lijkt. Tijdens testfasen, wanneer de foutpercentages kunnen oplopen tot 15-20%, levert die bescherming aanzienlijke besparingen op.

Prijsopgave van het Gemini 3.1-model

De Gemini 3.1-familie omvat meerdere modellen met zeer uiteenlopende prijspunten. Dit is de huidige structuur zoals die er in maart 2026 uitzag.

| Model | Invoer ≤200K tokens | Uitvoer ≤200K tokens | Invoer >200K tokens | Uitvoer >200K tokens |

|---|---|---|---|---|

| Voorbeeldweergave van Gemini 3.1 Pro | $2 per 1M | $12 per 1M | $4 per 1M | $18 per 1M |

| Gemini 3.1 Flash-afbeeldingvoorbeeld | $0.50 ingang, $3 uitgang per 1M | Afbeelding: $60 per 1M | Niet van toepassing | Niet van toepassing |

| Gemini 3 Standaard | $3 per 1M | $15 per 1M | Hogere tarieven zijn van toepassing. | Hogere tarieven zijn van toepassing. |

De prijsverhoging vindt plaats wanneer de inputcontext meer dan 200.000 tokens bedraagt. Bij die drempel rekent Google alle tokens – zowel input als output – aan tegen het tarief voor lange contexten. Voor Gemini 3.1 Pro betekent dit een verhoging van de inputkosten met 1001 TP3T (van 1 TP4T2 naar 1 TP4T4) en een verhoging van de outputkosten met 501 TP3T (van 1 TP4T12 naar 1 TP4T18).

Flash-modellen zijn gericht op prijsbewuste toepassingen. Voor de helft van de prijs van Pro-modellen leveren ze wat diepgang in de redenering in voor snelheid en kostenbesparing. Voor eenvoudige classificatie-, samenvattings- of extractietaken levert Flash 90% aan Pro-kwaliteit voor 25% aan kosten.

Prijsvoordeel van opgeslagen input

Caching is waar slimme ontwikkelaars de kosten drastisch kunnen verlagen. Wanneer dezelfde inhoud meerdere keren wordt opgevraagd – denk aan een productcatalogus, documentatie of kennisbank – verlaagt het cachen van die inhoud de kosten voor herhaalde invoer met maar liefst 90%.

Voor Gemini 3.1 Pro kosten gecachede invoertokens $0.20 per miljoen in plaats van $2 (voor ≤200K tokens) of $0.40 per miljoen (voor >200K tokens).

De berekening is snel gemaakt. Als een kennisbank met 50.000 tokens 100 keer per dag wordt geraadpleegd, bespaart caching ongeveer 1 TP4T9 per dag in vergelijking met het telkens verzenden van de volledige context. Dat is 1 TP4T270 per maand dankzij één enkele optimalisatie.

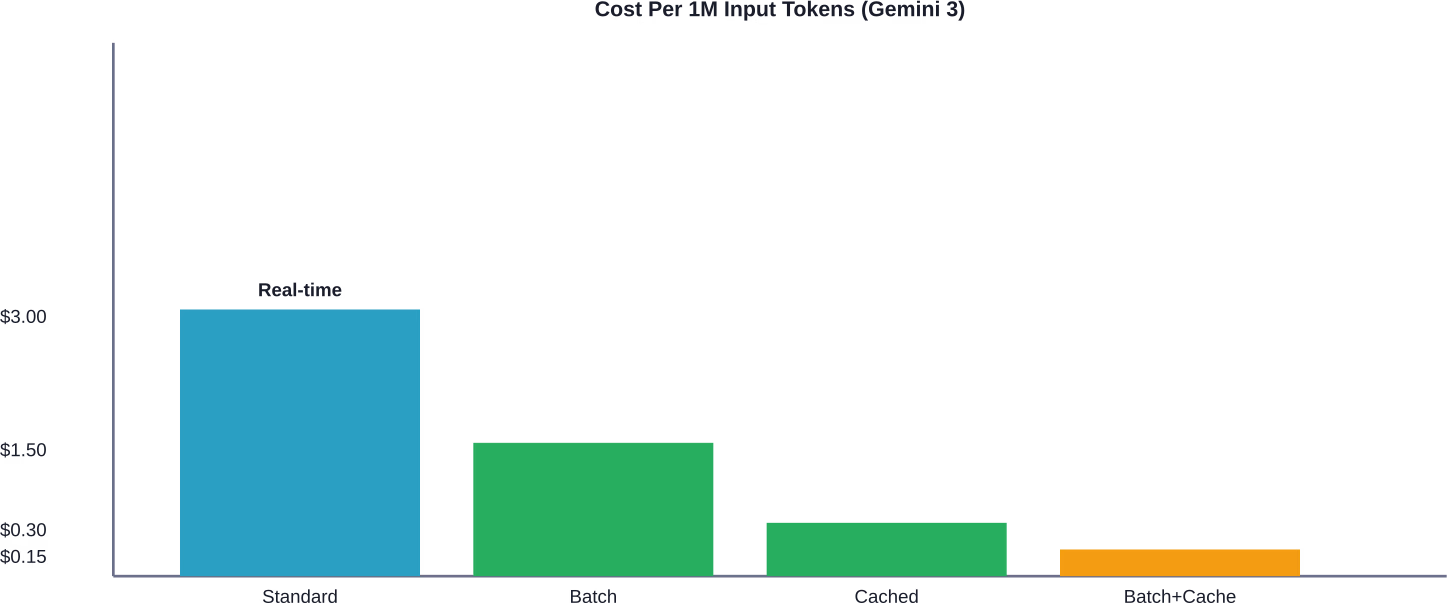

Batchverwerking versus realtime kosten

Batchverwerking verlaagt de kosten met de helft. Volgens de officiële documentatie van Vertex AI kost batchverwerking voor Gemini 3 Standard $1,50 per miljoen tokens, tegenover $3 voor realtime (niet-batch) verwerking. Batchverwerking kost $7,50 per miljoen tokens, tegenover $15 voor realtime verwerking.

Het nadeel? Latentie. Batchtaken worden asynchroon verwerkt, met voltooiingstijden variërend van minuten tot uren. Voor nachtelijke gegevensverwerking, documentanalyse of het genereren van grote hoeveelheden content is die vertraging irrelevant. Voor chatbots of interactieve tools is het echter een doorslaggevend nadeel.

Batchcachebewerkingen bieden vergelijkbare kortingen. Cacheschrijfbewerkingen dalen tot $1,875 per miljoen tokens en cachehits tot $0,15. Voor workloads met een hoog volume waarbij geen onmiddellijke reacties vereist zijn, is batchverwerking met caching de absoluut voordeligste optie.

Aarding en gereedschapsprijzen

Gemini 2.5 Pro bevat 10.000 gegronde meldingen per dag zonder extra kosten. Boven die limiet brengt Google $35 per 1.000 gegronde meldingen in rekening.

Een gefundeerde prompt betekent dat het model tijdens het genereren Google Search raadpleegt. Voor feitelijke nauwkeurigheid in nieuwssamenvattingen, onderzoeksondersteuning of realtime data-opvraging is een gefundeerde prompt van onschatbare waarde. Maar de kosten lopen wel op.

Met $35 per 1.000 geblokkeerde verzoeken lopen de kosten bij intensief gebruik snel op. Een applicatie die maandelijks 50.000 geblokkeerde verzoeken indient, betaalt $1.750 alleen al voor de blokkering – nog vóór de tokenkosten. De gratis dagelijkse toewijzing dekt 300.000 maandelijkse verzoeken voor gekwalificeerde accounts, wat voldoende is voor de meeste kleine tot middelgrote implementaties.

Web Grounding voor bedrijven heeft een hoger tarief: $45 per 1.000 zoekopdrachten. Deze premiumlaag biedt verbeterde zoekmogelijkheden en toegang tot bedrijfsgegevensbronnen. Organisaties die deze functie nodig hebben, kunnen contact opnemen met het accountteam van Google Cloud voor mogelijke volumekortingen.

De kosten van de LLM-opleiding bij Google vergelijken met die van concurrenten.

Hoe verhouden de tarieven van Google zich tot die van OpenAI en Anthropic?

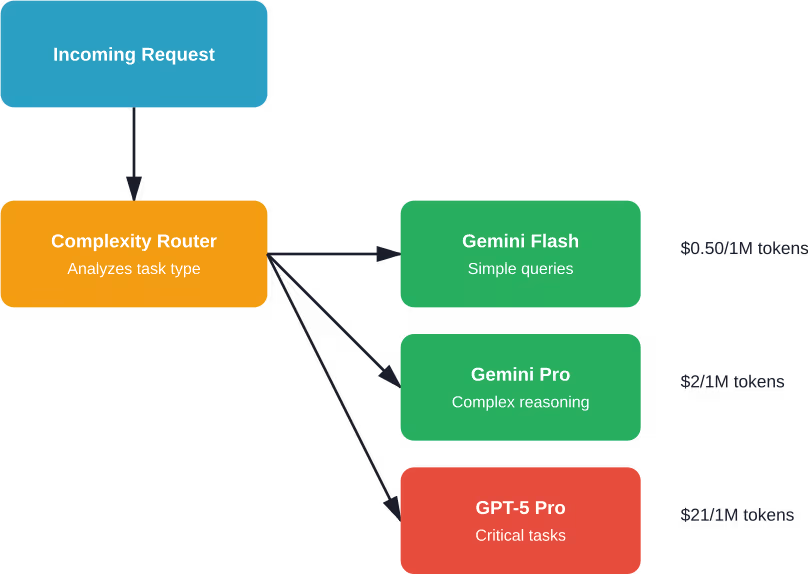

Vanaf maart 2026 kost OpenAI's GPT-5.2 Pro $21 per miljoen inputtokens en $168 per miljoen outputtokens – ongeveer 10 keer zoveel als Google's Gemini 3.1 Pro. Anthropic's Claude Sonnet 4.5 kost $3 per miljoen input en $15 per miljoen output, bijna identiek aan Gemini 3 Standard.

Maar hier wordt het interessant. DeepSeek's V3.2 is met $0,28 per miljoen inputtokens aanzienlijk goedkoper dan alle andere aanbieders. Voor budgetbewuste applicaties hebben Chinese aanbieders een nieuwe kostenbodem gecreëerd die westerse aanbieders moeilijk kunnen evenaren.

| Aanbieder | Model | Invoer (per 1 miljoen tokens) | Uitvoer (per 1 miljoen tokens) |

|---|---|---|---|

| Gemini 3.1 Pro | $2.00 | $12.00 | |

| Gemini 3.1 zaklamp | $0.25 | Standaardtarieven | |

| Open AI | GPT-5.2 Pro | $21.00 | $168.00 |

| Antropisch | Claude Sonnet 4.5 | $3.00 | $15.00 |

| Diepzoeken | V3.2-Exp | $0.28 | $0.40 |

Prestaties zijn net zo belangrijk als de prijs. Uit discussies in de community blijkt dat de extreem lage prijs van DeepSeek mogelijk ten koste gaat van de kwaliteit bij bepaalde complexe redeneertaken. Google's Gemini 3.1 Pro en Anthropic's Claude-modellen leveren betere prestaties op benchmarks zoals MMLU en HellaSwag.

De prijs-kwaliteitverhouding hangt volledig af van het gebruik. Voor de analyse van belangrijke juridische documenten is het zinvol om tien keer zoveel te betalen voor de nauwkeurigheid van GPT-5.2 Pro. Voor de classificatie van supporttickets bieden Gemini Flash of DeepSeek voldoende kwaliteit tegen een fractie van de kosten.

Verborgen kosten en infrastructuurkosten

De prijs van de tokens vertelt slechts een deel van het verhaal. De infrastructuur van Vertex AI brengt extra kosten met zich mee die veel ontwikkelaars over het hoofd zien tijdens de initiële planning.

Gegevensopslag voor RAG-toepassingen die gebruikmaken van de Vertex AI RAG Engine brengt aparte kosten met zich mee. De prijsstelling van Vertex AI Search is gebaseerd op een configureerbaar model met maandelijkse abonnementen voor zoekcapaciteit (QPM) en opslag. Voor websites wordt de opslag berekend als 500 kilobyte vermenigvuldigd met het aantal pagina's – een website met 1.000 pagina's kost maandelijks $2,38 alleen al voor data-indexering.

Vectordatabases, of u nu gebruikmaakt van de beheerde oplossingen van Vertex AI of van oplossingen van derden zoals Pinecot of Weaviate, brengen extra kosten met zich mee per GB voor opslag en zoekopdrachten. Een typische RAG-implementatie binnen een bedrijf met 50 GB aan embeddings kan maandelijks tussen de $50 en 150 aan kosten voor vectoropslag met zich meebrengen, onafhankelijk van de LLM-kosten.

Kosten voor gegevensoverdracht en -uitvoer

Cloudopslag, Google Drive en andere gegevensbronnen die via Vertex AI worden benaderd, brengen geen kosten in rekening voor toegang, maar er zijn wel kosten verbonden aan het uitsturen van gegevens. Het verplaatsen van gegevens buiten Google Cloud-regio's brengt bandbreedtekosten met zich mee die variëren van $0.08 tot $0.23 per GB, afhankelijk van de bestemming.

Voor applicaties die grote multimediabestanden of uitgebreide documentcollecties verwerken, kunnen de uitgaande datakosten met 10-201 TP3T aan de totale kosten worden toegevoegd. Een videoverwerkingspipeline die maandelijks 1 TB verwerkt, betaalt alleen al voor bandbreedte 1 TP4T80-230.

Effectieve kostenoptimalisatiestrategieën

Het verschil tussen een naïeve implementatie en een geoptimaliseerde uitrol kan oplopen tot 701 TP3T aan totale kosten. Dit is wat er daadwerkelijk toe doet.

Implementeer agressieve contextcaching.

Naast basiscaching zorgt de implementatie van een meerlaagse cachestrategie voor verdere kostenbesparing. Sla veelgebruikte contexten op in de eigen cache van Vertex AI. Voor minder vaak voorkomende, maar wel terugkerende contexten, kunt u een Redis- of Memcached-laag gebruiken die prompts reconstrueert op basis van sjablonen.

Een voorbeeld van kostenbesparing laat zien dat de implementatie van een tweelaags caching-systeem voor een klantenservicebot die een productcatalogus met 30.000 items raadpleegt, de kosten kan verlagen van ongeveer $2.400 naar $720 per maand.

Comprimeer prompts zonder kwaliteitsverlies.

Bij prompt-engineering draait het niet alleen om kwaliteit, maar ook om efficiëntie. Door stopwoorden te verwijderen, afkortingen te gebruiken waar de context dat toelaat en prompts te herstructureren, kan het aantal tokens met 15-25% worden verminderd zonder kwaliteitsverlies.

In plaats van "Analyseer de volgende feedback van klanten en geef een gedetailleerde samenvatting van de belangrijkste thema's, het sentiment en de bruikbare inzichten", gebruik je "Analyseer deze feedback. Lijst: belangrijkste thema's, sentiment, bruikbare inzichten." Dezelfde instructie, 40% minder tokens.

Verzoeken doorsturen naar de juiste modellen

Niet elke aanvraag vereist Gemini Pro. Door een routeringslaag te implementeren die eenvoudige vragen naar Flash stuurt en complexere redeneringen naar Pro, wordt de verhouding tussen kosten en kwaliteit geoptimaliseerd.

Classificatietaken, eenvoudige vraag- en antwoordsessies en het invullen van sjablonen werken prima in Flash. Meerstapsredeneringen, genuanceerde analyses en het genereren van creatieve ideeën profiteren van de extra mogelijkheden van Pro. Slimme routering kan de gemiddelde kosten per aanvraag met 40-50% verlagen bij gemengde workloads.

Alles wat mogelijk is, in batches produceren

De eisen aan realtime prestaties worden vaak overdreven. Contentmoderatie, documentsamenvatting, dataverrijking en vele andere workflows tolereren vertragingen van 5 tot 30 minuten zonder dat dit de gebruiker beïnvloedt.

Door deze workloads direct naar batchverwerking te migreren, worden de kosten met 50% verlaagd. Voor organisaties die maandelijks miljoenen aanvragen verwerken, betekent dit een besparing van vijf cijfers met minimale technische inspanning.

Budgetwaarschuwingen instellen en bewaken

Onverwachte kosten kunnen voorkomen. Een verkeerd geconfigureerde herhaalpogingslus, een onverwachte piek in het verkeer of een prompt-injectieaanval kunnen budgetten binnen enkele uren uitputten.

De factureringswaarschuwingen van Google Cloud activeren meldingen wanneer de uitgaven drempelwaarden overschrijden. Door waarschuwingen in te stellen bij 50%, 75% en 90% van het maandelijkse budget, wordt u vroegtijdig gewaarschuwd. In combinatie met automatische quotumlimieten worden catastrofale overschrijdingen voorkomen.

Voorkom dat u te veel betaalt voor LLM API's; valideer eerst uw configuratie.

Het gebruik van de Google LLM API's lijkt in eerste instantie eenvoudig, maar de kosten lopen snel op naarmate het gebruik toeneemt – vooral wanneer prompts, gegevensstromen en modelgedrag niet geoptimaliseerd zijn. AI Superieur Het systeem werkt gedurende de volledige levenscyclus, van gegevensvoorbereiding en modelselectie tot finetuning en implementatie, waardoor onnodig API-gebruik wordt verminderd en inefficiënte configuraties worden vermeden.

In plaats van uitsluitend te vertrouwen op externe API's, omvat de aanpak vaak een evaluatie van de financiële haalbaarheid van aangepaste modellen, finetuning of hybride configuraties. Dit is met name relevant voor bedrijven die de overstap maken van testen naar productie, waar de API-kosten in de loop der tijd kunnen oplopen. Als u van plan bent om LLM API's te gebruiken of de kosten al ziet stijgen, is het raadzaam om uw architectuur vroegtijdig te herzien. Neem contact op met AI Superieur om uw situatie te beoordelen voordat de kosten verder oplopen.

Praktische kostenvoorbeelden

De theorie is minder belangrijk dan de praktijk. Wat kosten daadwerkelijke implementaties?

Klantenservice chatbot

Een middelgroot e-commercebedrijf gebruikt een supportbot die maandelijks 50.000 gesprekken afhandelt. Elk gesprek bestaat gemiddeld uit 8 berichten met 200 input-tokens en 150 output-tokens per bericht.

Totaal maandelijks volume: 50.000 gesprekken × 8 berichten × (200 inkomende + 150 uitgaande) = 140 miljoen tokens (80 miljoen inkomende, 60 miljoen uitgaande).

Met de Gemini 3.1 Flash ($0.50 ingang voor tekst/afbeelding, $3 uitgang voor tekst): ongeveer $40 ingang + $30 uitgang = $70 per maand.

Met Gemini 3.1 Pro ($2 ingang, $12 uitgang): $160 ingang + $720 uitgang = $880 per maand.

Flash kan dit gebruiksscenario effectief afhandelen, wat een maandelijkse besparing oplevert van $810, oftewel een kostenbesparing van 97%.

Documentverwerkingspipeline

Een legal tech-startup verwerkt maandelijks 10.000 contracten, elk met gemiddeld 5.000 tokens. Extractie en analyse genereren 1.000 outputtokens per document.

Totaal volume: 10.000 documenten × (5.000 invoer + 1.000 uitvoer) = 60 miljoen tokens (50 miljoen invoer, 10 miljoen uitvoer).

Voor batchverwerking met Gemini 3 Standard: 50M × $1.50/1M (batchinvoer) + 10M × $7.50/1M (batchuitvoer) = $75 + $75 = $150 per maand.

Verwerking in realtime: 50M × $3/1M + 10M × $15/1M = $150 + $150 = $300 per maand.

Batchverwerking halveert de kosten zonder kwaliteitsverlies bij nachtelijke verwerkingsprocessen.

Wanneer kies je voor Google in plaats van de concurrentie?

De LLM API's van Google blinken uit in specifieke scenario's, maar zijn niet universeel optimaal.

Kies Google Vertex AI wanneer:

- Werkt al binnen de Google Cloud-infrastructuur: De kosten voor gegevensoverdracht en -integratie dalen aanzienlijk.

- Multimodale mogelijkheden zijn vereist: Gemini verwerkt tekst, afbeeldingen, audio en video in uniforme prompts.

- RAG-toepassingen bouwen: De geïntegreerde vectorzoek- en grondingstools van Vertex AI verminderen de architectonische complexiteit.

- Zeer lange contextvensters nodig hebben: Gemini 1.5 Pro ondersteunt tot 2 miljoen tokens, wat de meeste concurrenten ruimschoots overtreft.

- Prioriteit geven aan kostenefficiëntie voor taken met een gemiddelde complexiteit: Flash-modellen bieden een uitstekende prijs-kwaliteitverhouding.

Zoek elders wanneer:

Maximale redeneercapaciteit is belangrijker dan kosten: GPT-5.2 Pro presteert beter dan Gemini bij complexe logische taken. Gespecialiseerde domeinen zoals geavanceerde wiskunde of competitief programmeren: de modellen van OpenAI lopen momenteel voorop in deze benchmarks. Nultolerantie voor nalevingseisen: sommige sectoren vereisen specifieke certificeringen die gevestigde aanbieders bevoordelen.

Veelgestelde vragen

Wat kost de goedkoopste LLM API van Google?

Gemini 3.1 Flash-Lite kost $0,25 per miljoen invoertokens (voor ≤200K context) vanaf maart 2026, waardoor het een van Google's meest economische opties is. Met batchverwerking en caching kunnen de effectieve kosten dalen tot $0,15 per miljoen tokens voor batchcache-hits, hoewel de eerste batchcache-schrijfbewerkingen $1,875 per miljoen kosten.

Wat is het prijsverschil tussen Gemini Pro en Flash?

Gemini 3.1 Pro kost $2 per miljoen inputtokens, vergeleken met $0,50 voor Flash – een verschil van factor 4. Ook voor outputtokens is het verschil vergelijkbaar: Pro rekent $12 per miljoen, terwijl Flash aanzienlijk lagere standaardtarieven hanteert. Pro biedt superieure redenering en nuance; Flash optimaliseert voor snelheid en kosten bij eenvoudigere taken.

Rekent Google kosten aan voor mislukte API-verzoeken?

Google brengt kosten in rekening voor alle verwerkte tokens in succesvolle verzoeken (200 OK). Sommige 4xx-fouten (zoals 429 Too Many Requests) brengen echter geen kosten met zich mee, terwijl andere fouten, gerelateerd aan contentfiltering tijdens het genereren, wel kosten voor invoertokens met zich mee kunnen brengen.

Hoe verlaagt contextcaching de kosten van Google LLM?

Het cachen van herhaalde context verlaagt de tokenkosten met ongeveer 90%. Voor Gemini 3.1 Pro kosten gecachede invoertokens $0,20 per miljoen, tegenover $2 voor niet-gecachede tokens.

Wat zijn de aardingskosten voor Gemini-modellen?

Gemini 2.5 Pro bevat 10.000 gratis beveiligde prompts per dag. Boven deze limiet bedragen de kosten voor standaard beveiliging $35 per 1.000 beveiligde prompts. Enterprise webbeveiliging kost $45 per 1.000 beveiligde prompts. Deze kosten komen bovenop de standaard kosten voor in- en uitgaande tokens.

Kan ik de Google LLM API's gratis gebruiken?

Google biedt, in tegenstelling tot sommige concurrenten, geen permanente gratis versie van Vertex AI LLM aan. Nieuwe Google Cloud-accounts ontvangen echter credits (meestal $300) voor de eerste tests. De prijs is gebaseerd op gebruik zonder minimale afnamevereisten, waardoor kleinschalige tests tegen minimale kosten mogelijk zijn.

Hoe werkt de prijsbepaling voor batchverwerking?

Batchverwerking verlaagt de tokenkosten met 50% voor alle Gemini-modellen van Google. Zo daalt de kosten voor Gemini 3 Standard van $3 naar $1,50 per miljoen inkomende tokens en van $15 naar $7,50 per miljoen uitgaande tokens. Batchverzoeken worden asynchroon verwerkt, met voltooiingstijden die variëren van minuten tot uren, afhankelijk van de diepte van de wachtrij.

De kostenbeslissing nemen

De prijsstelling van de LLM API van Google positioneert Vertex AI concurrerend op de markt in 2026, met name voor applicaties die al binnen het ecosysteem van Google Cloud draaien.

De kostenstructuur beloont optimalisatie. Ontwikkelaars die caching, batchverwerking en intelligente modelroutering implementeren, kunnen effectieve kosten realiseren die 70-80% lager liggen dan de catalogusprijzen. Degenen die modellen op een naïeve manier implementeren, zullen aanzienlijk te veel betalen.

Prijsstelling op basis van tokens blijft het dominante model bij alle grote aanbieders, maar de effectieve kosten per door AI gegenereerde respons variëren sterk afhankelijk van de gekozen implementatie. Een goed ontworpen implementatie op Gemini Flash kan AI-functionaliteit leveren tegen een tiende van de kosten van een niet-geoptimaliseerde GPT-5 Pro-implementatie.

De kernvraag is niet welke aanbieder de laagste catalogusprijs heeft, maar welke combinatie van modelmogelijkheden, prijsstructuur en infrastructuurintegratie de beste prijs-kwaliteitverhouding biedt voor specifieke workloadkenmerken.

Begin met een duidelijke benchmark. Test representatieve workloads met behulp van Google-, OpenAI- en Anthropic-modellen. Meet niet alleen de kwaliteit, maar ook het daadwerkelijke tokenverbruik, de latentie en de foutpercentages. Bereken de totale eigendomskosten, inclusief infrastructuur, gegevensoverdracht en ontwikkeltijd.

Optimaliseer vervolgens meedogenloos. Elke reductie van 10% in het gemiddelde aantal tokens per verzoek, elke procentuele verbetering in de cache-hitrate, elke workload die naar batchverwerking wordt gemigreerd, vertaalt zich direct in kostenbesparingen.

Het kostenlandschap voor LLM (Learning Learning Models) blijft zich snel ontwikkelen. Prijzen die vandaag concurrerend zijn, kunnen binnen enkele maanden achterhaald zijn, omdat aanbieders strijden om marktaandeel. Budgetflexibiliteit en architectonische aanpasbaarheid zijn net zo belangrijk als de huidige prijzen bij het bouwen van een AI-infrastructuur voor de lange termijn.