Die KI-Landschaft hat sich dramatisch verändert. Drei große Akteure konkurrieren nun um die Aufmerksamkeit der Entwickler: Anthropics Claude, OpenAIs GPT-Serie und der innovative Newcomer DeepSeek.

Doch welches Modell hält, was es verspricht? Die Antwort ist nicht einfach. Jedes Modell hat seine Stärken, und die beste Wahl hängt ganz davon ab, was Sie bauen möchten.

Schauen wir uns genauer an, wie diese Modelle im Vergleich zu den wirklich wichtigen Kennzahlen abschneiden.

Modellpaletten: Worauf Sie tatsächlich die Wahl haben

Der erste Schritt besteht darin, das aktuelle Modellangebot zu verstehen. Diese Unternehmen haben nicht nur “ein Modell” im Angebot – sie haben ganze Produktfamilien mit unterschiedlichen Leistungsstufen entwickelt.

Claudes aktueller Kader

Anthropic bietet ab Anfang 2026 drei Hauptmodelle an. Claude Opus 4.6 ist das intelligenteste Modell und wurde speziell für die Entwicklung von Agenten und komplexe Programmieraufgaben entwickelt. Claude Sonnet 4.6 vereint Geschwindigkeit und Intelligenz und ist daher die empfohlene Lösung für den täglichen Gebrauch. Claude Haiku 4.5 ist die schnellste Option mit nahezu Spitzenleistung im Bereich der intelligenten Technologien.

Claude Opus 4.6 und Claude Sonnet 4.6 (sowie einige Sonnet 4.x-Varianten) unterstützen in der Beta-Phase ein Kontextfenster mit 1 Million Token über die Claude API, Amazon Bedrock, Google Cloud Vertex AI und Microsoft Foundry.

Erweiterte Produktpalette von OpenAI

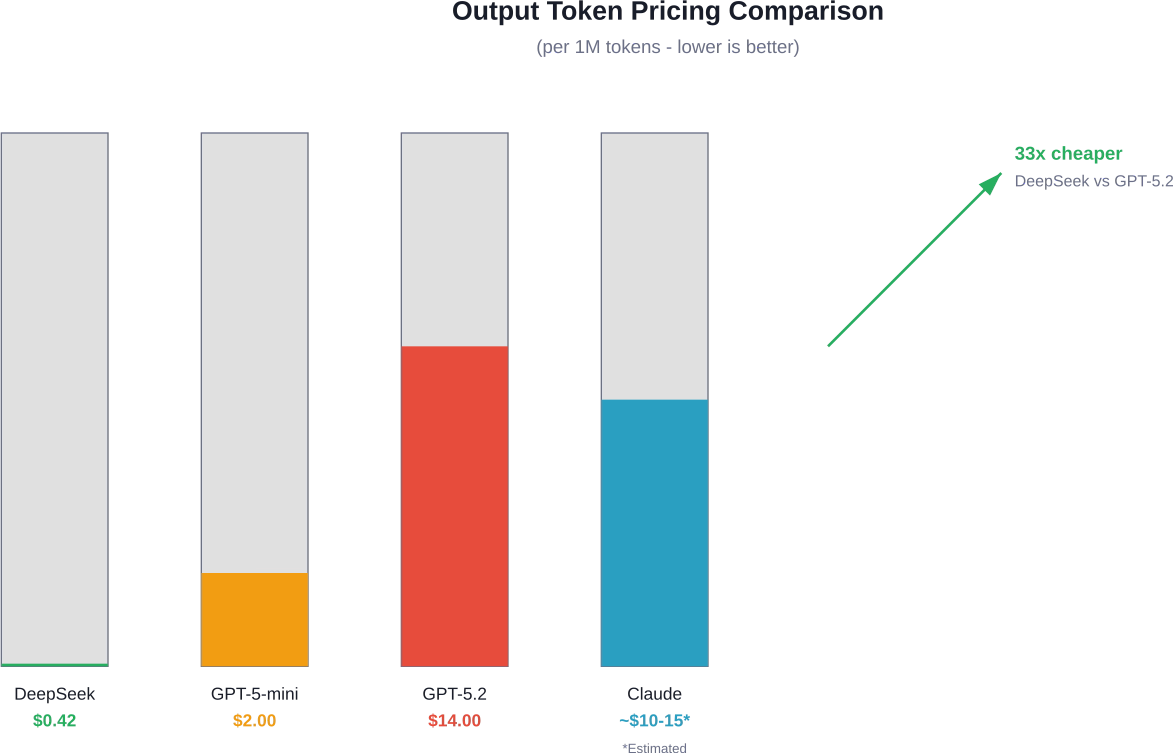

Das Portfolio von OpenAI ist deutlich gewachsen. Ihr Flaggschiff, GPT-5.2, zielt auf Programmier- und Agentenaufgaben in verschiedenen Branchen ab und verfügt über ein Kontextfenster von 400.000 Token sowie einen Wissensstand, der am 31. August 2025 endet. Die Eingabekosten betragen 1,75 TP4T pro Million Token, die Ausgabekosten 14,00 TP4T pro Million Token. Bei zwischengespeicherter Eingabe sinken die Kosten auf lediglich 0,18 TP4T pro Million Token.

GPT-4.1 dient als ihr intelligentestes Modell ohne logisches Denken, mit einem beeindruckenden Kontextfenster von 1.047.576 Token und einem Wissensstand, der am 1. Juni 2024 endet. Die Standardpreise liegen bei $2,00 pro Million Input-Token und $8,00 pro Million Output-Token.

Das Angebot erstreckt sich nach unten mit GPT-5-mini ($0,25 Input, $2,00 Output pro Million Token) und GPT-5-nano ($0,05 Input, $0,40 Output pro Million Token) für budgetbewusste Anwendungen.

DeepSeeks schlanker Ansatz

DeepSeek macht es einfacher. DeepSeek-V3.2 bietet zwei Modi: deepseek-chat (nicht-konstruktiver Modus) und deepseek-reasoner (konstruktiver Modus). Beide basieren auf demselben Modell mit einem Kontextfenster von 128.000 Byte.

Laut der offiziellen DeepSeek-API-Dokumentation ist die Standardausgabe von deepseek-chat auf 4K (maximal 8K) begrenzt, während deepseek-reasoner standardmäßig 32K (maximal 64K) ausgibt. Die Preisstruktur ist bemerkenswert aggressiv: $0,028 pro Million Eingabe-Token mit Cache-Treffern, $0,28 pro Million Standard-Eingabe-Token und $0,42 pro Million Ausgabe-Token.

DeepSeek-V3.2-Speciale erweitert die Möglichkeiten des logischen Denkens nochmals deutlich und erzielt in Wettbewerben wie IMO, CMO, ICPC World Finals und IOI 2025 eine Leistung auf Gold-Niveau. Derzeit ist es nur über die API ohne Unterstützung für die Tool-Nutzung verfügbar.

Positionierung der wichtigsten KI-Modelle hinsichtlich ihres Preis-Leistungs-Verhältnisses ab Anfang 2026, die den Wettbewerbsvorteil von DeepSeek aufzeigt.

Programmierleistung: Wo die Realität auf die Straße trifft

Für die Entwickler ist vor allem eines wichtig: Kann dieses Modell tatsächlich guten Code schreiben?

Laut einer Studie von arXiv, die diese Modelle anhand von Programmieraufgaben vergleicht, erzielte DeepSeek eine konkurrenzfähige Leistung zu deutlich geringeren Kosten, während Claude im Allgemeinen pro Token wesentlich teurer ist. Das ist ein überzeugendes Wertversprechen für kostenbewusste Teams.

Mal ehrlich: Die Leistungsunterschiede dieser Modelle bei Programmieraufgaben haben sich deutlich verringert. GPT-4.1 bietet ausgewogene Programmierfähigkeiten mit starker Azure-Integration, falls Sie bereits im Microsoft-Ökosystem arbeiten. Claude Opus zeichnet sich durch sein Verständnis komplexer Codebasen und seine durchdachten Refactoring-Vorschläge aus.

Doch jetzt wird es interessant. Laut Benchmark-Daten erreichte DeepSeek R1 65,9 Punkte auf LiveCodeBench (Pass@1-COT), OpenAI o1-1217 63,4 Punkte und Claude-3.5-Sonnet 33,8 Punkte, während GPT-4o-0513 34,2 Punkte erzielte.

| Modell | HumanEval-Score | LiveCodeBench | Bester Anwendungsfall

|

|---|---|---|---|

| DeepSeek R1 | 85%+ | 65.9 | Budgetbewusste Programmieraufgaben |

| GPT-5.2 | Hoch | ~63-65 | Agentische Codierungs-Workflows |

| Claude Opus 4.6 | Wettbewerbsfähig | N / A | Komplexe Refaktorisierung |

| OpenAI o1-1217 | Hoch | 63.4 | Aufgaben mit hohem Denkvermögen |

Und wie sieht es mit Programmierung in der Praxis aus?

Benchmarks erzählen die eine Geschichte. Die tatsächliche Entwicklungsarbeit erzählt eine andere.

Diskussionen in der Community zeigen, dass Claude sich durch einen konsistenten Codestil in großen Projekten auszeichnet. GPT-5 bewältigt komplexe Architekturentscheidungen gut, insbesondere wenn verschiedene Implementierungsansätze geprüft werden müssen. DeepSeek überrascht Entwickler trotz seines niedrigeren Preises mit seiner Fähigkeit, den Kontext zu verstehen.

Die Wahrheit ist: Für einfache CRUD-Anwendungen und gängige Webentwicklungsmuster funktionieren alle drei hervorragend. Die Unterschiede zeigen sich erst bei der Fehlersuche in komplexen Parallelitätsproblemen oder bei der Refaktorisierung bestehender Systeme.

Logisches Denkvermögen: Wie tiefgründig denken sie?

Die o-Series-Modelle von OpenAI wurden gezielt darauf trainiert, “länger zu denken” und logische Gedankengänge zu entwickeln, bevor sie antworten. Dies führt zu einer starken logischen Argumentation bei komplexen Problemen.

DeepSeek V3.2 im Reasoning-Modus (deepseek-reasoner) tritt direkt in diesem Bereich an. Das Modell erzielte Gold-Ergebnisse bei Mathematik-Olympiaden und Programmierwettbewerben. DeepSeek-V3.2-Speciale maximiert die Reasoning-Fähigkeiten und kann mit fortgeschrittenen Modellen wie Gemini-3.0-Pro konkurrieren, benötigt jedoch mehr Token.

Claudes Ansatz unterscheidet sich etwas. Anstatt einer für die Nutzer sichtbaren, ausgedehnten Gedankenkette verwendet Claude adaptives Denken – er entscheidet dynamisch, wann und wie viel er denkt, basierend auf der Komplexität der Aufgabe.

Laut einer wissenschaftlichen Studie auf arXiv zeigten diese Modelle bei der Bearbeitung wissenschaftlicher Rechenaufgaben jeweils unterschiedliche Denkmuster. Die Studie bewertete die Leistung in verschiedenen Bereichen und stellte fest, dass die Modellwahl die Ergebnisse je nach Art des erforderlichen Denkens signifikant beeinflusste.

Realitätscheck bei der Preisgestaltung

Die Kosten spielen eine Rolle. Vor allem, wenn man monatlich Millionen von Token verarbeitet.

Schauen wir uns die konkreten Zahlen von den offiziellen Preisseiten an.

OpenAI-Preisstruktur

Die Standardverarbeitung mit GPT-5.2 kostet $1,75 pro Million Eingabe-Token und $14,00 pro Million Ausgabe-Token. Bei Verwendung eines Caches sinken die Kosten auf $0,175 pro Million Token. Die Batch-API bietet Einsparungen von 50%, wodurch die Kosten für Eingabe auf $0,875 und für Ausgabe auf $7,00 pro Million Token sinken.

GPT-5-mini bietet mit $0,25 Input und $2,00 Output pro Million Token (Standardkurse) eine kostengünstigere Option. GPT-5-nano ist mit $0,025 Input und $0,20 Output pro Million Token deutlich günstiger.

Die Pro-Modelle sind deutlich teurer. GPT-5.2-pro benötigt $21,00 Input und $168,00 Output pro Million Token.

Claudes Preisgestaltung (basierend auf historischen Mustern)

Obwohl in der bereitgestellten Dokumentation keine offiziellen aktuellen Preise für Claude Opus 4.6 angegeben wurden, ergaben Recherchen von arXiv, dass Claude im Allgemeinen mehr kostet als andere KI-Ansätze für ähnliche Aufgaben.

Aktuelle Preisinformationen zur Claude API finden Sie in der offiziellen Dokumentation von Anthropic.

Die aggressive Preisstrategie von DeepSeek

DeepSeek unterbietet die Konkurrenz deutlich. Laut offizieller API-Dokumentation beträgt der Standardpreis $0,28 pro Million Eingabe-Token und $0,42 pro Million Ausgabe-Token. Bei Cache-Treffern sinkt der Preis für Eingabe-Token auf nur noch $0,028 pro Million Token.

Das ist je nach Konfiguration etwa 5- bis 50-mal günstiger als vergleichbare Modelle.

Preisvergleich der Output-Token zeigt den deutlichen Kostenvorteil von DeepSeek gegenüber Konkurrenzmodellen.

Kontextfenster und Speicher

Wie viele Informationen können diese Modelle während eines Gesprächs in ihrem “Arbeitsspeicher” speichern?

- Claude bietet in der Betaversion ein Kontextfenster für 1 Million Token. Das reicht für mehrere Romane oder eine umfangreiche Codebasis. Dadurch eignet sich Claude besonders gut für Aufgaben, die die Analyse großer Dokumente oder langwieriger Konversationen erfordern.

- GPT-5.2 bietet 400.000 Token, während GPT-4.1 ein Kontextfenster mit 1.047.576 Token bietet. Beides ist beachtlich – mehr als ausreichend für die meisten praktischen Anwendungen.

- DeepSeek V3.2 stellt 128.000 Tokens bereit, was zwar weniger ist, aber für die meisten Aufgaben immer noch ausreicht. Die meisten Entwickler werden dieses Limit im Normalbetrieb nicht erreichen.

Die praktischen Auswirkungen? Wenn Sie Tools entwickeln, die ganze Repositories analysieren, lange juristische Dokumente verarbeiten oder sehr lange Konversationen führen, sind Claude oder GPT-4.1 im Vorteil. Für Standard-Chatbot-Anwendungen oder fokussierte Programmieraufgaben ist DeepSeeks 128K-Architektur völlig ausreichend.

Ökosystem und Integration

Modelle existieren nicht isoliert. Integration ist wichtig.

OpenAIs Ökosystemvorteil

Die Modelle von OpenAI lassen sich nahtlos in Microsoft Azure, GitHub Copilot und unzählige Drittanbieter-Tools integrieren. Das GPT-Ökosystem ist ausgereift und bietet umfassende Dokumentation, Community-Ressourcen und vorkonfigurierte Integrationen.

Funktionsaufrufe, strukturierte Ausgaben, Feinabstimmung, Destillation und vorhergesagte Ausgaben werden unterstützt. Der Endpunkt v1/chat/completions hat sich zu einem De-facto-Standard entwickelt, der von vielen Tools unterstützt wird.

Claudes wachsende Präsenz

Claude ist über verschiedene Kanäle verfügbar: Claude API direkt von Anthropic, Amazon Bedrock, Google Cloud Vertex AI und Microsoft Foundry. Dieser Multi-Cloud-Ansatz bietet Flexibilität.

Anthropic hat Agentenfähigkeiten eingeführt – modulare Funktionen, die Claudes Funktionalität erweitern. Jede Fähigkeit enthält Anweisungen, Metadaten und optionale Ressourcen, die Claude bei Bedarf automatisch verwendet.

DeepSeeks Kompatibilitätsstrategie

Die API von DeepSeek orientiert sich bewusst am Format von OpenAI. Laut offizieller Dokumentation können Sie das OpenAI SDK oder jede OpenAI-kompatible Software mit DeepSeek verwenden, indem Sie einfach die `base_url` auf `https://api.deepseek.com` ändern und einen DeepSeek-API-Schlüssel angeben.

Diese Kompatibilität bedeutet, dass viele bestehende Tools sofort mit DeepSeek funktionieren, wodurch die Umstellungskosten sinken.

Sicherheit, Ausrichtung und Transparenz

Nicht alle Modelle gehen beim Thema Sicherheit auf die gleiche Weise vor.

- Claude hat sich einen Ruf für sorgfältige Sicherheitsausrichtung erworben. Anthropics Ansatz der konstitutionellen KI zielt darauf ab, Modelle hilfreich, harmlos und ehrlich zu gestalten. In der Praxis bedeutet dies manchmal, dass Claude Anfragen ablehnt, die andere Modelle bearbeiten würden, was manche Nutzer als übertrieben vorsichtig empfinden.

- OpenAI nutzt umfangreiches Reinforcement Learning durch menschliches Feedback (RLHF) und Sicherheitstests. Sie sind eher bereit, Grenzen auszuloten, ohne dabei die bestehenden Schutzmechanismen zu vernachlässigen.

- DeepSeek veröffentlichte technische Dokumentationen, in denen die Modellmechanismen und Trainingsmethoden erläutert werden, um Transparenz zu fördern. Da DeepSeek jedoch ein relativ neuer Marktteilnehmer ist, muss die langfristige Sicherheitsbilanz des Unternehmens erst noch aufgebaut werden.

Für Unternehmensanwendungen in regulierten Branchen kann Claudes konservativer Ansatz von Vorteil sein. Für Forschung und Experimente eignet sich GPTs ausgewogenes Verhältnis von Leistungsfähigkeit und Sicherheit gut. DeepSeeks offener Ansatz spricht Entwickler an, die die zugrundeliegenden Prozesse verstehen möchten.

Unternehmensüberlegungen: Welches Geschäftsmodell ist das richtige?

Die Auswahl eines KI-Modells für den Unternehmenseinsatz erfordert andere Kriterien als für private Projekte.

Gesamtbetriebskosten

Betrachten Sie nicht nur den Preis pro Token. Berücksichtigen Sie Mengenrabatte, Vorteile des Caching und den Entwicklungsaufwand. Ein Modell, das dreimal so viel kostet, aber die Debugging-Zeit um 40% reduziert, könnte die bessere Investition sein.

DeepSeeks Preisgestaltung macht es attraktiv für Anwendungen mit hohem Datenaufkommen, bei denen die Kosten pro Interaktion im Vordergrund stehen. Die Genauigkeit von Claude kann höhere Kosten für kundenorientierte Anwendungen rechtfertigen, bei denen Fehler teuer sind. Die Ökosystemintegration von GPT kann die Entwicklungszeit verkürzen und so höhere API-Kosten ausgleichen.

Zuverlässigkeit und Verfügbarkeit

OpenAI hatte in Spitzenzeiten gelegentlich mit Ausfällen zu kämpfen. Die Multi-Cloud-Verfügbarkeit von Claude über AWS, GCP und Azure bietet Redundanzoptionen. DeepSeek ist ein neuerer Dienst und verfügt daher über begrenzte Erfahrungswerte.

Für unternehmenskritische Anwendungen werden Multi-Modell-Strategien immer üblicher. Man kann Claude als primäres Modell mit GPT als Fallback verwenden oder einfache Anfragen an DeepSeek und komplexe Anfragen an ressourcenintensivere Modelle weiterleiten.

Datenschutz und Compliance

Prüfen Sie die Datenschutzrichtlinien der einzelnen Anbieter sorgfältig. Claude über Amazon Bedrock oder Google Vertex AI bietet möglicherweise andere Compliance-Zertifizierungen als die direkte API. Die Azure-Bereitstellung von OpenAI bietet Sicherheitsfunktionen auf Unternehmensebene. Die Datenschutzrichtlinien von DeepSeek sollten anhand Ihrer spezifischen regulatorischen Anforderungen geprüft werden.

| Faktor | Am besten geeignet für Claude | Am besten geeignet für GPT | Am besten geeignet für DeepSeek

|

|---|---|---|---|

| Budgetpriorität | Niedrig | Medium | Hoch |

| Ökosystemintegration | Medium | Hoch | Medium |

| Sicherheitsanforderungen | Hoch | Medium | Medium |

| Kontextfenster-Anforderungen | Sehr hoch (1M) | Hoch (400.000–1 Mio.) | Mittel (128K) |

| Logisches Denken | Hoch | Sehr hoch | Hoch |

| Dokumentationsqualität | Hoch | Sehr hoch | Gut |

Bekannte Einschränkungen und Schwächen

Jedes Modell hat seine Schwächen. Wenn man sie kennt, kann man sie umgehen.

Claudes Eigenheiten

Claude kann übervorsichtig sein und harmlose Anfragen aufgrund von Sicherheitsfiltern ablehnen. Manchmal liefert er ausführlichere Erklärungen als nötig. Die höheren Preislimits sind für Anwendungsfälle gedacht, in denen die Kosten pro Token entscheidend sind.

Herausforderungen der GPT

GPT-Modelle “halluzinieren” gelegentlich Informationen mit hoher Sicherheit. Die Modelle können aufgrund der längeren Denkzeit langsamer sein. Die Preise für Pro-Versionen sind für viele Anwendungen zu hoch.

DeepSeeks Wachstumsschmerzen

Als neuere Plattform verfügt DeepSeek über weniger Community-Wissen und weniger Integrationen von Drittanbietern. Das kleinere Kontextfenster schränkt einige Anwendungen ein. Langzeitstabilität und Support bleiben mit zunehmender Reife des Dienstes fraglich.

Leistungsbenchmarks: Die Zahlen

Benchmarks bieten standardisierte Vergleichspunkte, die tatsächliche Leistung variiert jedoch.

Eine Studie des Center for Security and Emerging Technology der Georgetown University betont, dass sich Evaluierungen “noch in einem sehr frühen Stadium” befinden und daher mit Vorsicht zu interpretieren seien. Gängige Benchmarks sind MMLU (Measuring Massive Multitask Language Understanding) mit Multiple-Choice-Fragen aus professionellen Prüfungen und GPQA (Graduate-Level Google-Proof Q&A) mit von Experten verfassten Fragen.

Laut verschiedenen Quellen schneidet DeepSeek V3 bei Programmier-Benchmarks gut ab und ist dabei deutlich kostengünstiger. Modelle der GPT-5-Serie sind führend bei komplexen, logikintensiven Aufgaben. Claude erzielt starke Ergebnisse bei anspruchsvollen Sprachaufgaben und dem Verständnis langer Dokumente.

Die wichtigste Erkenntnis? Benchmark-Ergebnisse sind wichtig, aber sie sagen nicht alles aus. Testen Sie Modelle anhand Ihrer konkreten Anwendungsfälle, bevor Sie sie endgültig festlegen.

Benutzererfahrung und Schnittstelle

Die Entwicklererfahrung ist genauso wichtig wie die reinen Fähigkeiten.

Die Testumgebung und die Dokumentation von OpenAI sind ausgereift und umfassend. Die API ist gut dokumentiert und enthält zahlreiche Beispiele. Für GPT-5.2 wird die kostenlose Version nicht unterstützt; die Nutzungsstufen haben definierte TPM-Limits (z. B. sind in Stufe 5 bis zu 40.000.000 TPM möglich).

Die Dokumentation von Claude ist ebenso umfassend und enthält übersichtliche Modellvergleichstabellen sowie Funktionsbeschreibungen. Dank des Multi-Cloud-Ansatzes können Sie je nach Bereitstellungsmodell über verschiedene Schnittstellen mit Claude interagieren.

Die Dokumentation von DeepSeek ist funktional, aber weniger umfangreich. Die OpenAI-Kompatibilität ist hilfreich, da viele Tutorials und Beispiele mit minimalen Anpassungen funktionieren.

Welches Modell sollten Sie wählen?

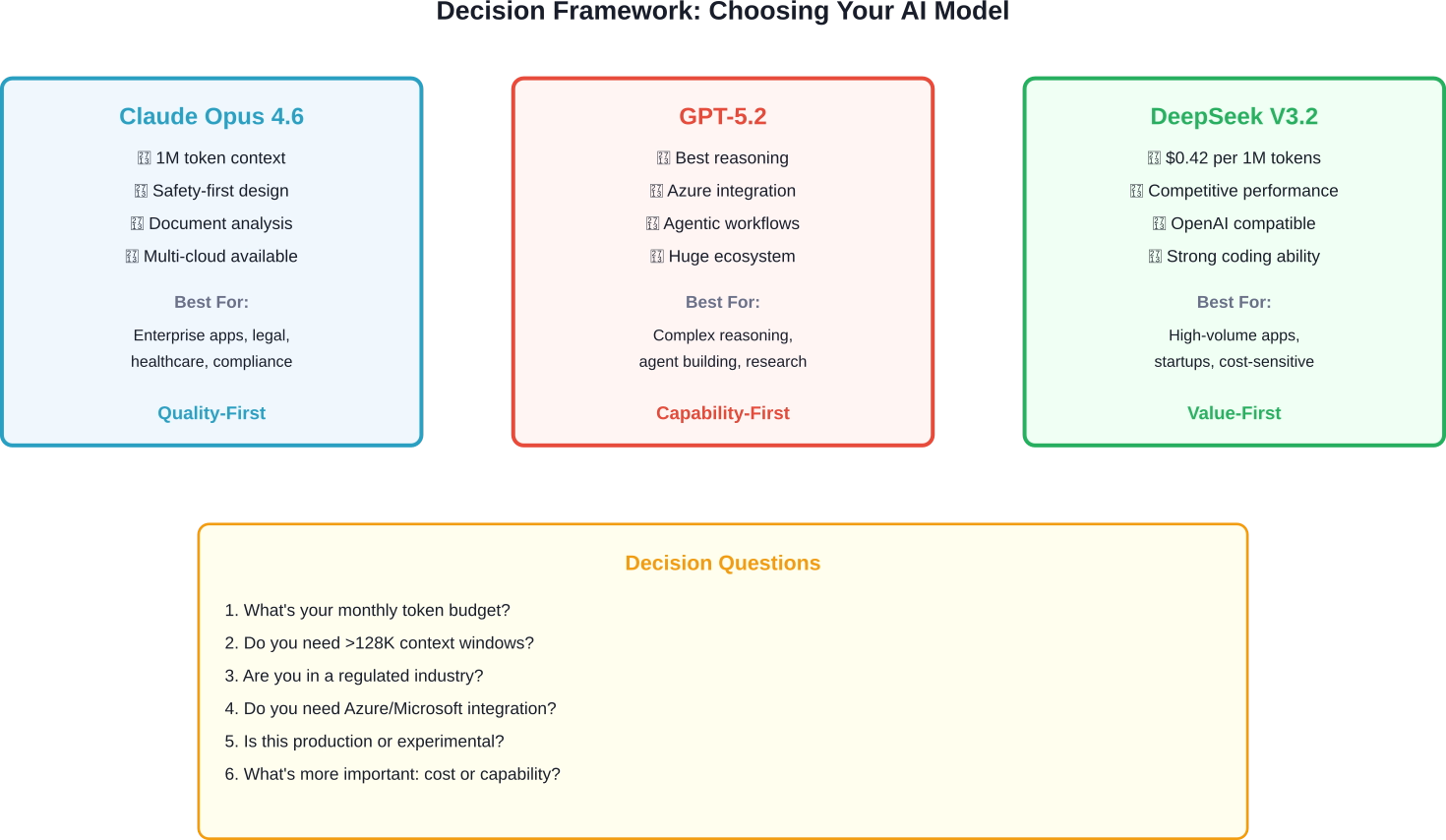

Folgendes ist wichtig: Es gibt kein universell “bestes” Modell. Ihre Wahl hängt von Ihren individuellen Bedürfnissen ab.

Wähle Claude, wenn…

Für die Verarbeitung großer Dokumente benötigen Sie ein maximales Kontextfenster. Sicherheit und sorgfältige Ausgabe sind von höchster Priorität. Sie entwickeln Anwendungen in sensiblen Bereichen, in denen ein konservatives Vorgehen von Vorteil ist. Das Budget ist weniger restriktiv als die Qualitätsanforderungen.

Wählen Sie GPT, wenn…

Sie benötigen eine tiefe Ökosystemintegration mit Microsoft-, Azure- oder GitHub-Tools. Analytische Fähigkeiten sind für Ihren Anwendungsfall zentral. Sie wünschen sich umfassende Dokumentation und Community-Support. Sie entwickeln agentenbasierte Systeme, die eine ausgefeilte Planung erfordern.

Wählen Sie DeepSeek, wenn…

Kosteneffizienz ist von zentraler Bedeutung. Sie verarbeiten große Datenmengen, wodurch sich die Kosten pro Token schnell summieren. Sie benötigen wettbewerbsfähige Leistung ohne Premiumpreise. Sie sind mit einer modernen Plattform vertraut und wünschen sich OpenAI-Kompatibilität.

Rahmenwerk zur Auswahl des richtigen KI-Modells basierend auf Ihren spezifischen Anforderungen und Einschränkungen

Multi-Modell-Strategien

Viele anspruchsvolle Anwendungen beschränken sich nicht auf ein einziges Modell.

Ein Routing-Ansatz kann Kosten und Qualität optimieren. Verwenden Sie DeepSeek für einfache Abfragen, Claude für komplexe Analysen mit langem Kontext und GPT für Aufgaben, die tiefgreifendes logisches Denken erfordern. Dies erfordert zwar die Entwicklung einer Routing-Logik, kann aber die Kosten um 601 Tsd. 3 Tsd. oder mehr senken und gleichzeitig die Qualität erhalten.

Eine weitere Strategie: Verwenden Sie kostengünstigere Modelle für die Erstellung erster Entwürfe und anschließend Premium-Modelle für die Verfeinerung und Qualitätsprüfung. Alternativ können Sie dieselbe Anfrage mit mehreren Modellen bearbeiten und für kritische Entscheidungen Abstimmungs- oder Ensemble-Verfahren einsetzen.

Der Aufwand für die Verwaltung mehrerer Modelle nimmt ab, da Tools wie Crazyrouter und ähnliche Dienste es einfach machen, verschiedene Modelle mit demselben Code zu testen.

Die KI-Grenze mit AI Superior meistern

Da sich die Kluft zwischen analytischem Denken und Kosteneffizienz verringert, verlagert sich die Herausforderung für die meisten Unternehmen von der Auswahl eines Modells hin zu dessen erfolgreicher Implementierung. AI Superior, Unser Team aus promovierten Datenwissenschaftlern und Softwareentwicklern schließt diese Lücke durch umfassende KI-Anwendungsentwicklung und strategische Beratung. Wir unterstützen Unternehmen dabei, über einfache API-Aufrufe hinauszugehen, indem wir maßgeschneiderte, leistungsstarke Systeme entwickeln, die diese zukunftsweisenden Modelle in bestehende Arbeitsabläufe integrieren. So stellen wir sicher, dass Ihre Architekturwahl – ob Claudes umfangreiche Kontextfenster oder DeepSeeks kosteneffiziente Schlussfolgerungen – einen konkreten Mehrwert für Ihr Unternehmen generiert.

Unser systematischer Ansatz konzentriert sich darauf, die spezifischen Bereiche zu identifizieren, in denen maschinelles Lernen langfristig die Effizienz steigern kann – von Computer Vision bis hin zu prädiktiver Analytik. Wir wissen, dass in einem so dynamischen Umfeld wie dem von 2026 eine standardisierte Modellstrategie selten zielführend ist. Stattdessen arbeitet unser Team eng mit Ihnen zusammen und entwickelt in einem sorgfältigen Analyse- und MVP-Prozess robuste, zuverlässige und auf die spezifischen regulatorischen und Datenanforderungen Ihrer Branche zugeschnittene Lösungen.

Zukunftsausblick: Was kommt auf uns zu?

Die Landschaft der KI-Modelle entwickelt sich weiterhin rasant.

- OpenAI veröffentlicht kontinuierlich schrittweise Verbesserungen seiner Modellfamilie. Die Kluft zwischen Inferenzmodellen und Standardmodellen scheint sich zu verringern. Preisdruck von Wettbewerbern wie DeepSeek könnte Anpassungen erzwingen.

- Anthropic erweitert die Verfügbarkeit von Claude bei verschiedenen Cloud-Anbietern und fügt Funktionen wie Agent Skills hinzu. Das Kontextfenster mit 1 Million Token in der Beta-Version deutet darauf hin, dass sie die Grenzen der Eingabeverarbeitung neu definieren.

- DeepSeek positioniert sich als innovativer Anbieter und beweist, dass wettbewerbsfähige Leistung nicht zwangsläufig hohe Preise erfordert. Dass ihr Modell V3.2-Speciale in Programmierwettbewerben Gold-Ergebnisse erzielt, zeigt, dass es ihnen nicht nur um den Preis geht – sie setzen auch auf Leistungsfähigkeit.

Es ist mit kontinuierlichen Modellverbesserungen, Preiswettbewerb und einer Konsolidierung der Kompetenzen der Anbieter zu rechnen. Die Unterschiede zwischen diesen Modellen werden sich bei Vergleichswerten voraussichtlich verringern, während sie sich bei speziellen Anwendungsfällen weiter auseinanderentwickeln.

Fazit: Ihre Wahl treffen

Der Wettbewerb zwischen Claude, GPT und DeepSeek kommt allen zugute. Die Preise sinken, die Leistungsfähigkeit steigt, und die Kluft zwischen Premium- und Budget-Optionen verringert sich.

Letztendlich hängt Ihre Entscheidung von Ihren Prioritäten ab. Wenn Sie etwas entwickeln, bei dem Intelligenz wichtiger ist als die Kosten – beispielsweise Forschungsanwendungen, komplexe Denkaufgaben oder hochentwickelte Agenten –, dann rechtfertigen GPT-5.2 oder Claude Opus 4.6 ihren höheren Preis.

Wenn Sie große Datenmengen verarbeiten und Kosteneffizienz benötigen, ohne dabei zu viel Leistung einzubüßen, bietet DeepSeek ein hervorragendes Preis-Leistungs-Verhältnis. Die Preisgestaltung von $0,42 pro Million Output-Token verändert die Wirtschaftlichkeit von KI-Anwendungen.

Und immer häufiger liegt die kluge Vorgehensweise nicht darin, sich für ein bestimmtes Modell zu entscheiden, sondern darin, die Anwendung so zu gestalten, dass für jede Aufgabe das richtige Modell verwendet wird.

Der beste Weg? Testen Sie alle drei anhand Ihrer konkreten Anwendungsfälle. Die meisten bieten kostenlose Testversionen oder Guthaben für erste Tests an. Führen Sie Ihre eigentlichen Abfragen durch, messen Sie die Ergebnisse, berechnen Sie die Kosten und treffen Sie Ihre Entscheidung auf Basis von Daten statt auf Basis von Marketingversprechen.

Bereit zum Testen? In der offiziellen Dokumentation zur Claude API, OpenAI Platform und DeepSeek API finden Sie Ihre Schlüssel, um noch heute mit dem Experimentieren zu beginnen.

Häufig gestellte Fragen

Ist DeepSeek so gut wie GPT-4 oder Claude?

Für viele Aufgaben ja. DeepSeek V3.2 erzielt bei Programmier-Benchmarks wie HumanEval wettbewerbsfähige Ergebnisse und ist dabei deutlich kostengünstiger. Forschungsdaten belegen, dass es bei HumanEval starke Leistungswerte zu wesentlich niedrigeren Kosten als Claude erreicht. GPT und Claude können jedoch weiterhin Vorteile bei Aufgaben bieten, die maximale Schlussfolgerungsfähigkeit oder sehr lange Kontextfenster von mehr als 128.000 Token erfordern.

Welches KI-Modell eignet sich am besten für die Programmierung im Jahr 2026?

Es kommt auf Ihre spezifischen Bedürfnisse an. DeepSeek R1 erzielte im LiveCodeBench-Test mit 65,9 Punkten die höchste Punktzahl und eignet sich daher hervorragend für kostengünstige Programmieraufgaben. GPT-5.2 glänzt bei agentenbasierten Arbeitsabläufen und komplexen Architekturentscheidungen. Claude Opus 4.6 ist besonders gut geeignet, um große Codebasen zu verstehen und zu refaktorisieren. Für die meisten Entwickler bietet DeepSeek das beste Preis-Leistungs-Verhältnis, während GPT die beste Integration in das jeweilige Ökosystem bietet.

Wie viel kostet die Nutzung dieser KI-Modelle?

Die Preise variieren erheblich. Laut offiziellen Preisseiten kostet DeepSeek $0,28 Input und $0,42 Output pro Million Token (Standardpreise). GPT-5.2 kostet $1,75 Input und $14,00 Output pro Million Token. GPT-5-mini kostet $0,25 Input und $2,00 Output pro Million Token. Die Preise für Claude variieren je nach Bereitstellungsmethode – aktuelle Preise finden Sie in der offiziellen Dokumentation von Anthropic. DeepSeek ist etwa 5- bis 50-mal günstiger als vergleichbare Modelle.

Kann ich DeepSeek mit meinem bestehenden OpenAI-Code verwenden?

Ja. Laut der offiziellen API-Dokumentation von DeepSeek verwendet deren API ein OpenAI-kompatibles Format. Sie können das OpenAI SDK oder jede andere OpenAI-kompatible Software mit DeepSeek verwenden, indem Sie die `base_url` auf `https://api.deepseek.com` ändern und Ihren DeepSeek-API-Schlüssel angeben. Die meisten bestehenden Codeabschnitte sollten mit minimalen Anpassungen funktionieren.

Welches Modell hat das längste Kontextfenster?

Claude bietet derzeit in der Beta-Phase ein Kontextfenster von 1 Million Token. GPT-4.1 bietet 1.047.576 Token und übertrifft Claude damit geringfügig. GPT-5.2 bietet 400.000 Token. DeepSeek V3.2 verfügt über 128.000 Token, was zwar weniger ist, aber für die meisten Anwendungen ausreicht. Bei Aufgaben, die die Analyse extrem großer Dokumente oder sehr langer Konversationen erfordern, sind Claude oder GPT-4.1 im Vorteil.

Sind diese Modelle für den Unternehmenseinsatz sicher?

Alle drei Lösungen wurden bereits in Unternehmensumgebungen eingesetzt, jedoch mit unterschiedlichen Schwerpunkten. Claude legt Wert auf die Einhaltung von Sicherheitsstandards und ist in regulierten Branchen beliebt. OpenAI bietet Unternehmensimplementierungen über Azure mit zusätzlichen Sicherheitsfunktionen. DeepSeek ist ein neuerer Anbieter mit weniger Erfahrung. Für den Unternehmenseinsatz sollten Sie die Datenschutzrichtlinien, Compliance-Zertifizierungen und Service-Level-Agreements (SLAs) der einzelnen Anbieter anhand Ihrer spezifischen Anforderungen bewerten. Multi-Cloud-Implementierungen von Claude über AWS, GCP oder Azure können zusätzliche Compliance-Optionen bieten.