Kurzzusammenfassung: Prädiktive Analysen im Bergbau nutzen maschinelles Lernen, Echtzeit-Sensordaten und statistische Modelle, um Geräteausfälle vorherzusagen, die Rohstoffgewinnung zu optimieren und die Sicherheit zu erhöhen. Durch die Analyse historischer Muster und Betriebsdaten können Bergbauunternehmen ungeplante Ausfallzeiten um bis zu 30–501 Tonnen pro 100 Tonnen reduzieren, die Wartungskosten um 18–401 Tonnen pro 100 Tonnen senken und datengestützte Entscheidungen treffen, die Produktivität und Nachhaltigkeit in den Bereichen Exploration, Gewinnung und Verarbeitung verbessern.

Die Bergbauindustrie steht unter enormem Druck. Die Maschinen arbeiten unter extremen Bedingungen, die Mineralienpreise schwanken unvorhersehbar, und die Sicherheitsvorschriften werden Jahr für Jahr verschärft. Traditionelle, reaktive Instandhaltung und Entscheidungen nach Bauchgefühl reichen nicht mehr aus.

Hier setzt die prädiktive Analytik an. Indem sie Rohdaten aus dem Betrieb in umsetzbare Prognosen wandelt, können Bergbauunternehmen Geräteausfälle vorhersehen, Abbauprozesse in Echtzeit optimieren und intelligentere Entscheidungen zur Ressourcenverteilung treffen. Die Technologie kombiniert Algorithmen des maschinellen Lernens, Sensornetzwerke und statistische Modelle, um aus historischen Mustern Erkenntnisse für die Zukunft zu gewinnen.

Aber das Entscheidende ist: Predictive Analytics dient nicht nur der Vermeidung von Ausfällen. Es verändert die Herangehensweise von Bergbaubetrieben an alles – von der Exploration bis zur Einhaltung von Umweltauflagen.

Was unterscheidet prädiktive Analysen von traditionellem Data Mining?

Data Mining und Predictive Analytics werden oft verwechselt, dienen aber im Bergbau unterschiedlichen Zwecken. Das Verständnis dieser Unterschiede ist bei der Implementierung dieser Technologien wichtig.

Data-Mining konzentriert sich auf das Aufdecken verborgener Muster in historischen Daten. Es ist vergangenheitsorientiert und blickt zurück, um Beziehungen zwischen Variablen zu identifizieren – beispielsweise die Korrelation von Erzgehaltsverteilungen mit geologischen Formationen oder das Auffinden unerwarteter Nutzungsmuster von Geräten.

Die prädiktive Analytik nutzt diese erkannten Muster und projiziert sie in die Zukunft. Sie verwendet bestätigte Zusammenhänge, um zukünftige Ergebnisse vorherzusagen: wann ein Muldenkipper einen Lagerwechsel benötigt, wie hoch der morgige Durchsatz einer Aufbereitungsanlage sein wird oder welche Explorationsgebiete das höchste Mineralpotenzial aufweisen.

| Aspekt | Datengewinnung | Prädiktive Analytik |

|---|---|---|

| Hauptfokus | Aufdeckung verborgener Muster in historischen Daten | Muster nutzen, um zukünftige Ergebnisse vorherzusagen |

| Zeitorientierung | Vergangenheitsorientierte Analyse | Zukunftsorientierte Prognosen |

| Ausgabetyp | Mustererkennung, Korrelationserkennung | Wahrscheinlichkeitswerte, Prognosen, Risikobewertungen |

| Bergbauanwendung | Geologische Zusammenhänge identifizieren, Geräteprotokolle analysieren | Ausfälle vorhersagen, Produktionspläne optimieren |

Beide Techniken ergänzen sich. Data Mining liefert die Grundlage – die Muster und Zusammenhänge –, während Predictive Analytics auf dieser Grundlage umsetzbare Prognosen erstellt.

Nutzen Sie prädiktive Analysen im Bergbau mit überlegener KI.

AI Superior Erstellt Vorhersagemodelle auf Basis von Betriebs- und Sensordaten, um die Planung, Wartung und Risikokontrolle im Bergbau zu unterstützen.

Sie konzentrieren sich auf Modelle, die an bestehende Systeme anknüpfen, beginnend mit der Datenauswertung und einem funktionierenden Prototyp vor der Skalierung.

Sie möchten prädiktive Analysen im Bergbau einsetzen?

AI Superior kann Ihnen helfen bei:

- Auswertung von Betriebs- und Sensordaten

- Erstellung von Vorhersagemodellen

- Integration von Modellen in bestehende Systeme

- Verfeinerung der Ergebnisse

👉 Kontaktieren Sie AI Superior um Ihr Projekt, Ihre Daten und Ihren Implementierungsansatz zu besprechen

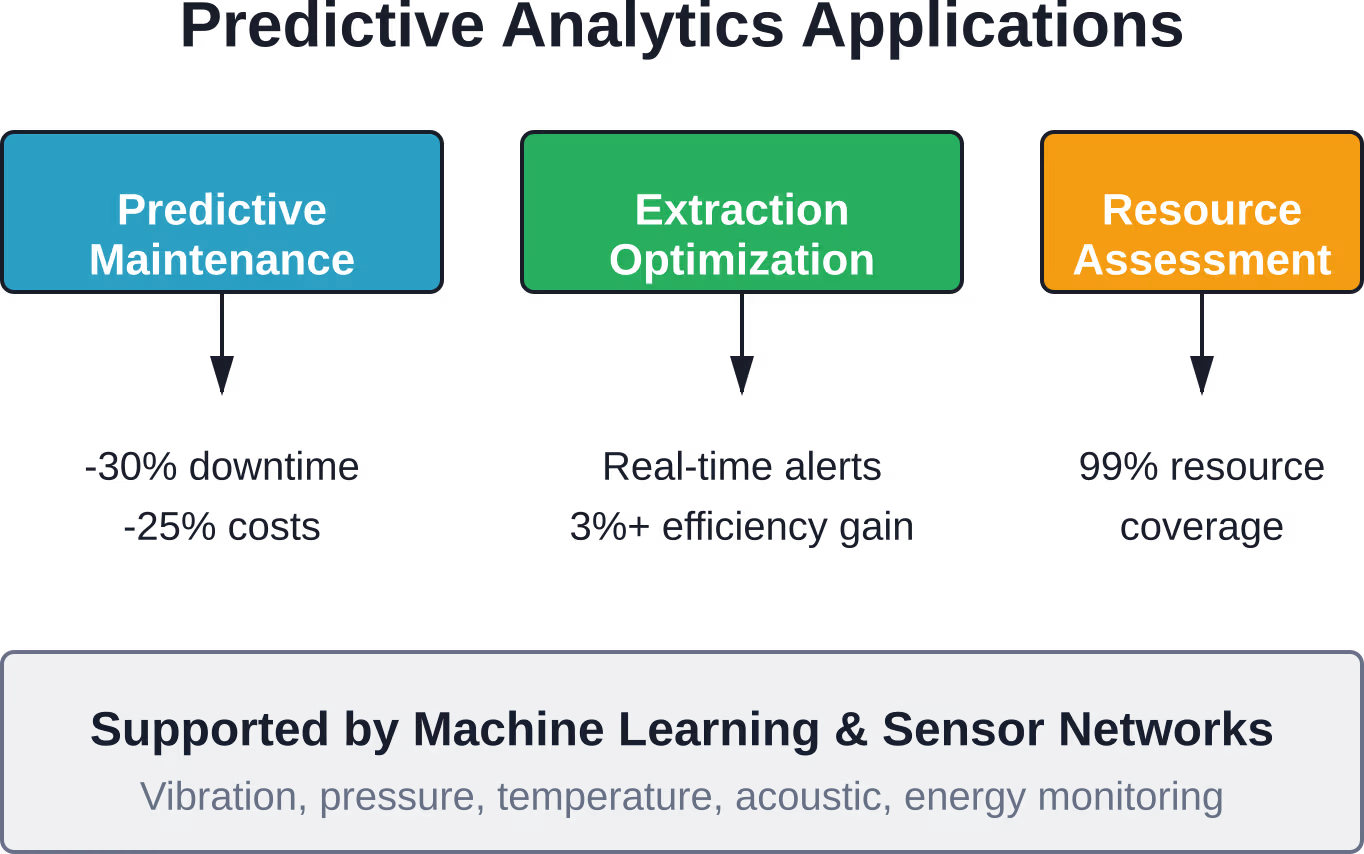

Kernanwendungen, die den Bergbaubetrieb transformieren

Predictive Analytics schafft Mehrwert entlang der gesamten Wertschöpfungskette im Bergbau. Verschiedene Anwendungen führen zu messbaren betrieblichen Verbesserungen.

Vorausschauende Instandhaltung und Anlagenmanagement

Kritische Anlagen wie Brecher, Förderbänder, Mühlen und Belüftungssysteme arbeiten unter extremen Bedingungen. Beschleunigter Verschleiß führt zu unerwarteten Ausfällen, die die Produktion unterbrechen und Sicherheitsrisiken bergen.

Vorausschauende Wartungsmodelle analysieren Vibrationssensoren, Hydraulikdrucksensoren, Motortemperatursensoren, akustische Sensoren und Energieverbrauchszähler, um Komponentenausfälle vorherzusagen, bevor sie auftreten. Algorithmen des maschinellen Lernens erkennen subtile Musteränderungen, die auf sich anbahnende Probleme hinweisen.

Die Auswirkungen sind erheblich. Betriebe, die vorausschauende Instandhaltung einsetzen, berichten von 30–501 TP3T weniger ungeplanten Ausfallzeiten und 18–401 TP3T geringeren Instandhaltungskosten. Anstatt Lager unabhängig von ihrem Zustand nach einem festen Zeitplan zu wechseln, erfolgt die Instandhaltung genau dann, wenn die Daten dies anzeigen.

Gut implementierte Modelle des maschinellen Lernens können hohe Genauigkeitsraten bei der Zustandsvorhersage von Anlagen erzielen. Typischerweise verarbeiten diese Modelle große Trainingsdatensätze und verwenden Standardvalidierungsmethoden.

Optimierung der Ressourcengewinnung

Kognitive Computersysteme überwachen den Betrieb von Baggern in Echtzeit und vergleichen die tatsächliche Leistung mit optimalen Kennzahlen. Wenn der Baggerarm wiederholt über die effizienten Parameter hinaus schwenkt, alarmiert das System den Bediener umgehend.

Branchenanwendungen zufolge können Überwachungssysteme Produktivitätsverluste in Echtzeit quantifizieren und Bediener über ineffiziente Betriebsmuster informieren, die sich zu erheblichen Effizienzverlusten summieren. Dieser unmittelbare Feedback-Mechanismus ermöglicht Verhaltensanpassungen, die zu spürbaren Effizienzsteigerungen beitragen.

Exploration und Ressourcenbewertung

Das USGS-Projekt DATAP II (Development of Assessment Techniques and Analysis Project II) modernisierte die Methoden zur Bewertung von Mineralressourcen. Das Projekt umfasst eine Datenbank bedeutender Gold-, Silber-, Kupfer-, Blei- und Zinkvorkommen in Alaska.

Die in dieser Studie ermittelten Schwellenwerte decken 991.000 Tonnen der bisherigen US-Produktion sowie die verbleibenden identifizierten Ressourcen ab. Lagerstätten, die die Mindestkriterien erfüllen – 2 Tonnen Gold, 85 Tonnen Silber, 50.000 Tonnen Kupfer, 30.000 Tonnen Blei oder 50.000 Tonnen Zink – stellen nahezu alle wirtschaftlich nutzbaren Ressourcen dar.

Mithilfe dieser geologischen Daten trainierte Vorhersagemodelle helfen Explorationsteams, vielversprechende Standorte zu identifizieren, bevor teure Bohrprogramme beginnen.

Technologie-Stack für Mining-Vorhersagen

Für eine effektive prädiktive Analytik ist die Integration mehrerer Technologieebenen erforderlich. Der Technologie-Stack umfasst typischerweise Sensornetzwerke, Dateninfrastruktur, Analysemodelle und Visualisierungsschnittstellen.

Sensornetzwerke und IoT-Integration

Das Internet der Dinge liefert die Grundlage für die Rohdaten. Vibrationssensoren an rotierenden Maschinen, Druckaufnehmer in Hydrauliksystemen, Wärmebildkameras zur Überwachung der Lagertemperaturen – diese Geräte erzeugen kontinuierliche Datenströme zur Messung der Betriebsbedingungen.

Drahtlose Sensornetzwerke, die auf weitläufigen Minengeländen eingesetzt werden, übermitteln Messwerte an zentrale Datenplattformen. Das Datenvolumen kann enorm sein: Ein einzelner großer Betrieb kann monatlich Terabytes an Sensordaten erzeugen.

Algorithmen für maschinelles Lernen

Im Bereich der prädiktiven Analytik finden verschiedene Algorithmenfamilien Anwendung. Ensemble-Methoden, die mehrere Modelltypen kombinieren, können die Genauigkeit verbessern, indem sie Vorhersagen aktualisieren, sobald neue Sensordaten eintreffen.

Deep-Learning-Netzwerke zeichnen sich durch ihre Fähigkeit zur Mustererkennung in komplexen, hochdimensionalen Sensordaten aus. Reinforcement Learning optimiert sequentielle Entscheidungen wie Sprengpläne oder die Routenplanung für Ausrüstung. Bayes'sche Aktualisierungsverfahren quantifizieren die Unsicherheit von Vorhersagen, was entscheidend ist, wenn Sicherheitsentscheidungen von Modellausgaben abhängen.

SHAP-Werte und Szenarioanalysen helfen Anwendern, Empfehlungen zu vertrauen und sie zu interpretieren. Transparenz ist wichtig, wenn Modelle kostspielige Eingriffe vorschlagen oder Sicherheitsrisiken aufzeigen.

Digital Twin-Technologie

Digitale Zwillinge erstellen virtuelle Nachbildungen physischer Anlagen oder Prozesse. Diese Modelle erfassen Sensordaten in Echtzeit und simulieren das Verhalten von Anlagen unter verschiedenen Bedingungen.

In Kombination mit prädiktiver Analytik ermöglichen digitale Zwillinge den Bedienern, “Was-wäre-wenn”-Szenarien zu testen, ohne reale Anlagen zu gefährden. Was passiert, wenn wir den Durchsatz der Walzanlage um 51 Tonnen erhöhen? Wie verhält sich das Lager unter höherer Belastung? Digitale Zwillinge liefern Antworten, bevor Änderungen umgesetzt werden.

Herausforderungen und Lösungen bei der Implementierung

Mal ehrlich: Die Implementierung von Predictive Analytics im Bergbau ist nicht so einfach wie Plug-and-Play. Immer wieder tauchen dabei verschiedene Herausforderungen auf.

Datenstandardisierung und -qualität

Die bestehenden Systeme an verschiedenen Minenstandorten verwenden oft inkompatible Datenformate. Ein Standort erfasst die Betriebsstunden der Anlagen im Dezimalformat, ein anderer im Stunden-Minuten-Format. Die Sensorkalibrierung variiert. Historische Aufzeichnungen weisen Lücken auf.

Um diese Probleme anzugehen, müssen Datengovernance-Standards festgelegt werden, bevor mit der Modellentwicklung begonnen wird. Saubere, standardisierte Daten zu erstellen ist zwar keine glamouröse Aufgabe, aber sie ist grundlegend.

IT- und OT-Integration

Betriebstechnische Systeme, die physikalische Prozesse steuerten, arbeiteten traditionell getrennt von Informationstechnologienetzwerken. Sicherheitsbedenken, unterschiedliche Protokolle und organisatorische Silos führten zu dieser Trennung.

Industrie 4.0 erfordert die Zusammenführung dieser Bereiche. Wie ein Experte feststellte, sträuben sich IT-Abteilungen zunächst gegen die Vernetzung operativer Systeme aufgrund von Sicherheitsbedenken – selbst wenn die Geschäftsleitung Integrationsprogramme befürwortet. Diese Zurückhaltung beruht auf der berechtigten Sorge, Schwachstellen in Produktionssteuerungssysteme einzuführen.

Die Lösungen umfassen die Einrichtung sicherer Datenübertragungsprotokolle, die Schaffung entmilitarisierter Zonen zwischen Netzwerken und den Aufbau funktionsübergreifender Teams, die IT- und OT-Expertise verbinden.

Modellskalierbarkeit und -wartung

Ein für einen bestimmten Brechertyp an einem bestimmten Standort trainiertes Vorhersagemodell lässt sich nicht unbedingt auf andere Anlagen oder geologische Bedingungen übertragen. Für eine Skalierung müssen entweder standortspezifische Modelle entwickelt oder komplexere Modelle erstellt werden, die die betriebliche Variabilität berücksichtigen.

Modelle verschlechtern sich im Laufe der Zeit, da sich die Anlagenkonfigurationen ändern, neue Erzkörper andere Materialeigenschaften aufweisen oder sich die Betriebspraktiken weiterentwickeln. Kontinuierliche Modellüberwachung und -anpassung sind daher unerlässlich.

Anwendungen für Nachhaltigkeit und Umweltkonformität

Predictive Analytics reicht über die betriebliche Effizienz hinaus und umfasst auch den Umweltschutz. Der Regulierungsdruck nimmt weltweit zu, und Umweltkennzahlen haben direkten Einfluss auf Betriebsgenehmigungen.

Anwendungen prädiktiver Analysen für das Energie-, Wasser- und Abfallmanagement bergen das Potenzial, den Ressourcenverbrauch zu optimieren und die Umweltbelastung zu reduzieren. Diese Verbesserungen ergeben sich aus der Optimierung von Prozessparametern in Echtzeit anstatt aus dem Betrieb mit statischen Sollwerten.

Die Überwachung von Absetzbecken ist eine sicherheitsrelevante Anwendung. Sensornetzwerke erfassen Porenwasserdruck, Sickerwasserraten und strukturelle Bewegungen und speisen Vorhersagemodelle, die aufkommende Instabilitätsrisiken erkennen. Frühwarnungen ermöglichen präventive Maßnahmen, bevor es zu katastrophalen Schäden kommt.

Ausblick: 2026 und darüber hinaus

Branchenprognosen deuten auf eine deutliche Verbreitung von Predictive Analytics zur operativen Optimierung in Bergbau- und Öl- und Gasunternehmen in den kommenden Jahren hin. Die Technologie wandelt sich von einem Wettbewerbsvorteil zu einer operativen Notwendigkeit.

Mehrere Trends beschleunigen sich. Echtzeit-KI-Anwendungen ersetzen Batch-Verarbeitungsverfahren – Modelle werden kontinuierlich aktualisiert, sobald Sensordaten eingehen, anstatt geplante Analysen durchzuführen. Erklärbare KI-Methoden lösen das “Black-Box”-Problem und machen die Modelllogik für Betreiber und Aufsichtsbehörden transparent.

Modelle für gemischte Daten, die sowohl strukturierte numerische Daten als auch unstrukturierte Texte und Bilder analysieren, werden zum Standard. Ein umfassendes Vorhersagesystem könnte Sensormesswerte, Wartungsprotokolle, Bedieneraufzeichnungen und Fotos von Anlagen gleichzeitig auswerten.

Die Kombination von prädiktiver Analytik und autonomem Betrieb erzeugt Rückkopplungsschleifen, in denen Erkenntnisse automatisch und ohne menschliches Eingreifen Aktionen auslösen. Prognostiziert ein Modell beispielsweise einen Lagerausfall in 72 Stunden, plant das System den Austausch selbstständig im nächsten geplanten Wartungsfenster ein.

Häufig gestellte Fragen

Worin besteht der Unterschied zwischen prädiktiver und deskriptiver Analytik im Bergbau?

Deskriptive Analysen untersuchen historische Daten, um zu verstehen, was geschehen ist – Produktionsmengen des letzten Quartals, Ausfallraten von Anlagen oder Erzgehaltsverteilungen. Prädiktive Analysen nutzen diese historischen Muster, um vorherzusagen, was geschehen wird – welche Anlagen im nächsten Monat ausfallen werden, die zu erwartenden Produktionsraten oder die Standorte von Rohstofflagerstätten. Deskriptive Analysen blicken zurück, prädiktive Analysen nach vorn.

Wie genau sind vorausschauende Wartungsmodelle?

Die Genauigkeit variiert je nach Datenqualität, Modellkomplexität und Anwendungsspezifika. Gut implementierte Modelle des maschinellen Lernens können hohe Genauigkeitsraten bei der Zustandsvorhersage von Anlagen erzielen. Ensemble-Methoden, die mehrere Algorithmen kombinieren, liefern in der Regel eine höhere Genauigkeit als Ansätze mit nur einem Algorithmus. Die Leistungsfähigkeit in der Praxis hängt stark von der Sensorabdeckung und der Verfügbarkeit historischer Daten ab.

Welchen ROI können Bergbauunternehmen von prädiktiven Analysen erwarten?

Zu den dokumentierten Auswirkungen zählen eine Reduzierung ungeplanter Ausfallzeiten um 30–501 TP3T und eine Senkung der Wartungskosten um 18–401 TP3T. Produktionsoptimierung kann zu Effizienzsteigerungen führen. Anwendungen zur Einhaltung von Umweltauflagen optimieren den Ressourcenverbrauch und die Umweltbelastung. Der Gesamt-ROI hängt von der Betriebsgröße ab, Amortisationszeiten von 12–24 Monaten sind jedoch bei umfassenden Implementierungen üblich.

Profitieren auch kleine Bergbaubetriebe von prädiktiver Analytik?

Absolut. Große Unternehmen verfügen zwar über mehr Daten und Ressourcen für komplexe Systeme, doch auch kleine Betriebe profitieren von gezielten Anwendungen. Vorausschauende Wartung kritischer Anlagen liefert messbare Vorteile, ohne dass eine Infrastruktur im Unternehmensmaßstab erforderlich ist. Cloudbasierte Analyseplattformen reduzieren die Vorabinvestitionen und machen die Technologie so für Unternehmen jeder Größe zugänglich.

Welche Dateninfrastruktur ist für die Implementierung von Predictive Analytics erforderlich?

Zu den Mindestanforderungen gehören Sensornetzwerke an kritischen Anlagen, eine Datenspeicherinfrastruktur (Cloud oder On-Premise) sowie analytische Rechenkapazität. Viele Projekte beginnen mit bestehenden SCADA- und Historian-Systemen und ergänzen diese schrittweise um IoT-Sensoren. Konnektivitätsprobleme an entfernten Standorten lassen sich durch Edge Computing lösen, das Daten lokal verarbeitet, bevor die gewonnenen Erkenntnisse übertragen werden.

Wie gehen prädiktive Analysesysteme mit geologischer Variabilität um?

Fortschrittliche Modelle integrieren geologische Parameter als Eingangsgrößen und lernen, wie die Eigenschaften des Erzes die Anlagenleistung und das Prozessverhalten beeinflussen. Transferlernverfahren ermöglichen es Modellen, die für einen Erztyp trainiert wurden, sich mit reduziertem Trainingsaufwand an unterschiedliche Mineralogie anzupassen. Standortspezifische Anpassungen bleiben wichtig, aber moderne Ansätze verringern den Aufwand für den Umgang mit Variabilität.

Welche Fähigkeiten benötigen Teams, um diese Systeme zu implementieren und zu warten?

Interdisziplinäres Fachwissen ist unerlässlich: Datenwissenschaftler mit Kenntnissen im Bereich maschinelles Lernen, Verfahrenstechniker mit Erfahrung im Bergbau, IT-Experten für die Infrastrukturverwaltung und OT-Spezialisten für die Wartung von Sensornetzwerken. Viele Betriebe arbeiten zunächst mit spezialisierten Anbietern zusammen und bauen ihre internen Kompetenzen schrittweise durch Wissenstransfer und Schulungsprogramme auf.

Den nächsten Schritt gehen

Predictive Analytics hat sich in modernen Bergbaubetrieben von einem experimentellen zu einem unverzichtbaren Bestandteil entwickelt. Die Frage ist nicht, ob diese Technologien implementiert werden sollen, sondern wie schnell und strategisch sie eingesetzt werden sollen.

Konzentrieren Sie sich zunächst auf wirkungsvolle, klar definierte Anwendungen, anstatt sofort eine umfassende Transformation anzustreben. Vorausschauende Wartung kritischer Anlagen bietet einen eindeutigen ROI und schafft Akzeptanz im Unternehmen für weitergehende Initiativen.

Die Datenqualität ist wichtiger als die Komplexität der Algorithmen. Investitionen in Datenstandardisierung, Sensorkalibrierung und Governance-Prozesse zahlen sich im gesamten Analysezyklus aus.

Und denken Sie daran: Predictive Analytics ergänzt menschliches Fachwissen, ersetzt es aber nicht. Die effektivsten Implementierungen kombinieren algorithmische Erkenntnisse mit dem Wissen der Anwender und schaffen so eine Partnerschaft zwischen menschlichem Urteilsvermögen und maschineller Präzision, die beides allein übertrifft.