Kurzzusammenfassung: Die Preise für LLM-Chatbots im Jahr 2026 reichen von kostenlosen Tarifen mit eingeschränktem Zugriff bis hin zu Enterprise-Plänen mit monatlichen Kosten von über 1.400 Tsd. 3.000 Tsd. Die Kosten tokenbasierter APIs variieren stark: OpenAI GPT-5.2 Pro berechnet 1.400 Tsd. 21 Tsd./1.68 Tsd. 1 Million Tokens, GPT-5.2 Standard 1.75 Tsd./1.400 Tsd. 14 Tsd. 1 Million Tokens. DeepSeek V3.2-Exp kostet 1.28 Tsd. 0,28 Tsd. 0,42 Tsd. 0,42 Tsd. 0,42 pro Million Eingabe-Tokens (Cache-Fehler). Die richtige Wahl hängt vom Nutzungsvolumen, den benötigten Funktionen und davon ab, ob Sie einen Chatbot-Zugang per Abonnement oder eine direkte API-Integration benötigen.

Der Markt für LLM-Chatbots ist rasant gewachsen, und damit einhergehend hat sich eine Preislandschaft entwickelt, die selbst erfahrene Entwickler verwirren kann. Fragt man nach den Kosten eines KI-Chatbots im Jahr 2026, lautet die ehrliche Antwort: von null Dollar bis zu einem sechsstelligen Betrag pro Jahr.

Diese enorme Preisspanne ergibt sich daraus, dass die Preisgestaltung für LLM-Chatbots zwei grundlegend verschiedene Ansätze umfasst. Zum einen gibt es abonnementbasierte Chatbot-Plattformen, bei denen Teams monatliche Gebühren für sofort einsatzbereite Konversations-KI zahlen. Zum anderen gibt es tokenbasierte API-Dienste, mit denen Entwickler individuelle Lösungen erstellen und nutzungsabhängig bezahlen.

Um zu verstehen, welches Modell den jeweiligen Bedürfnissen entspricht – und wie hoch die tatsächlichen Kosten sind –, muss man Marketingversprechen durchschauen und sich die realen Zahlen ansehen. Die Preisstrukturen haben sich seit 2025 deutlich verändert: Neue Modelle sind auf den Markt gekommen und etablierte Anbieter haben ihre Preise angepasst.

Wie die Preisgestaltung für LLM-Chatbots tatsächlich funktioniert

Bevor wir uns mit konkreten Kosten befassen, ist es hilfreich, die beiden dominanten Preisgestaltungsmodelle zu verstehen, die diesen Markt prägen.

Abonnementbasierte Chatbot-Plattformen

Diese Dienste bieten komplette Chatbot-Lösungen mit integrierten Schnittstellen, Integrationen und Support. Teams zahlen eine wiederkehrende Gebühr – in der Regel monatlich – und erhalten Zugang zu einer Plattform, die die technische Komplexität übernimmt.

Laut aktuellen Marktanalysen folgt die Preisgestaltung für Abonnement-Chatbots typischerweise dieser Struktur:

| Preismodell | So funktioniert es | Typischer Kostenbereich |

|---|---|---|

| Abonnement (SaaS) | Feste monatliche Tarife mit Nutzungsbegrenzungen | $30–$1.500/Monat |

| Nutzungsbasiert | Bezahlung pro Gespräch, Lösung oder Token | $0,50–$5 pro Gespräch |

| Kundenspezifisches Unternehmen | Verhandelte Preise mit dedizierten Ressourcen | $3.000–$50.000+/Monat |

| Pro Benutzer/Sitzplatz | Kosten pro Teammitglied, das auf die Plattform zugreift | $15–$200/Benutzer/Monat |

Das Abonnementmodell eignet sich gut für Unternehmen, die planbare Kosten und minimalen technischen Aufwand wünschen. Der Haken dabei: Diese Plattformen setzen oft strenge Beschränkungen für monatliche Konversationen, aktive Chatbots oder das Trainingsdatenvolumen.

Tokenbasierte API-Preisgestaltung

Für Entwickler, die individuelle Lösungen erstellen, bietet der API-Zugriff mehr Flexibilität, verursacht aber variable Kosten. Jede Interaktion mit einem LLM wird in Tokens gemessen – was in etwa Wortfragmenten entspricht.

Die Token-Preisgestaltung gliedert sich in zwei Komponenten: Eingabe-Token (die an das Modell gesendete Eingabeaufforderung) und Ausgabe-Token (die generierte Antwort). Ausgabe-Token sind fast immer teurer, da die Textgenerierung mehr Rechenressourcen benötigt als die Textverarbeitung.

Die Mathematik dahinter wird schnell interessant. Ein typisches Kundenservicegespräch verbraucht etwa 500 Eingabe-Token und generiert 300 Ausgabe-Token. Je nach Anbieter können die Kosten für diese einzelne Interaktion zwischen Bruchteilen eines Cents und mehreren Cent liegen.

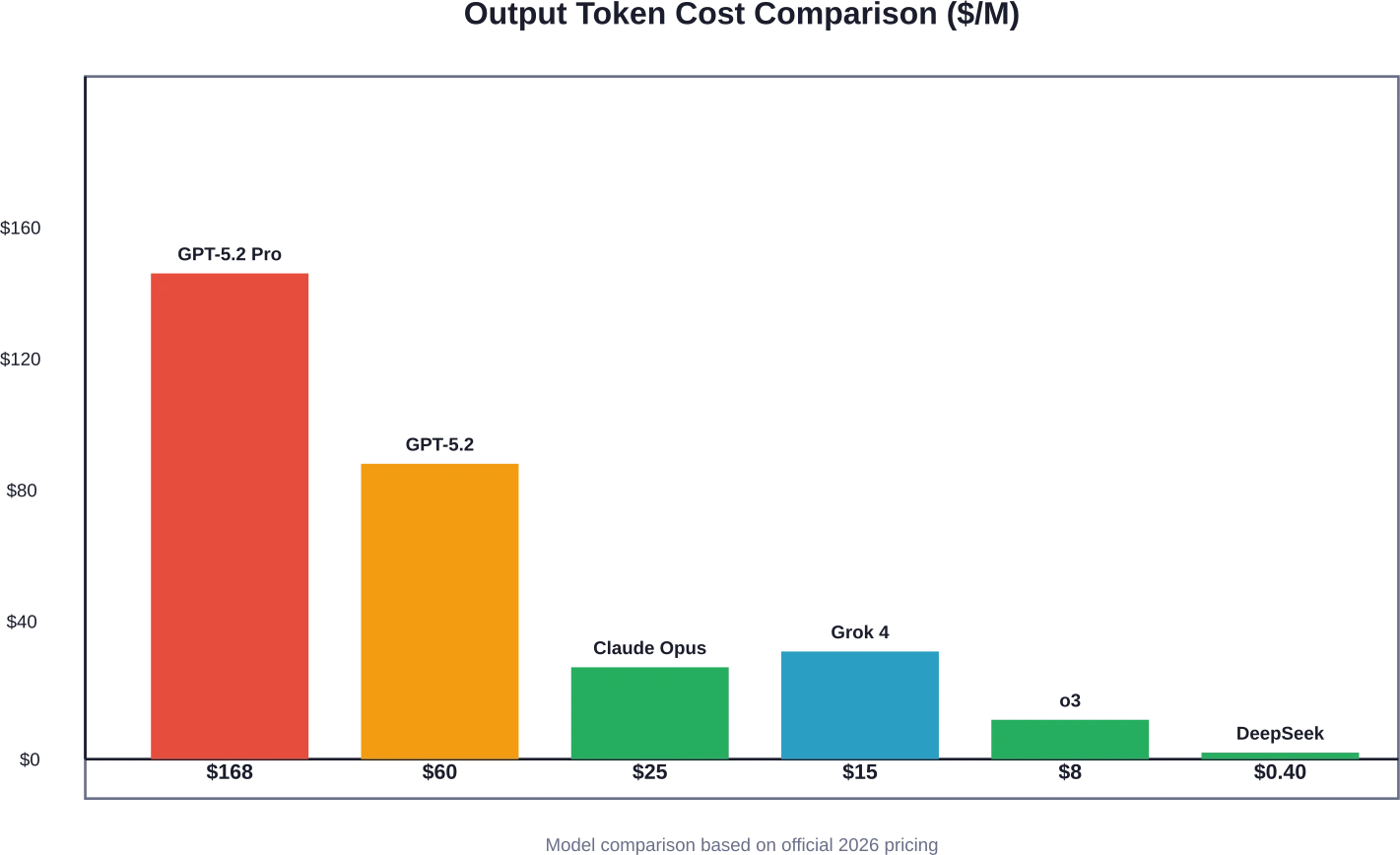

Vergleich der API-Preise von Major LLM

Die Landschaft der tokenbasierten Preisgestaltung veränderte sich Anfang 2026 dramatisch. Neue Modelle wurden eingeführt, Wettbewerber unterboten sich gegenseitig, und Leistungsverbesserungen veränderten die Kosten-pro-Wert-Berechnungen.

OpenAI-Preisstruktur

OpenAI bietet sowohl Abonnementpläne für den ChatGPT-Zugang als auch eine API-Abrechnung pro Token für Entwickler an. Laut der offiziellen Preisseite von OpenAI umfassen die Abonnementstufen für ChatGPT Folgendes:

- Frei: Eingeschränkter Zugriff auf GPT-5.2 mit Nachrichtenbegrenzungen und langsameren Antwortzeiten

- Gehen: Erweiterter Zugriff mit mehr Nachrichten und Uploads

- Plus, Pro, Team, Enterprise: Progressive Stufen mit höheren Limits und zusätzlichen Funktionen

Die Preisgestaltung von OpenAI für den API-Zugang im Februar 2026 weist erhebliche Unterschiede zwischen den verschiedenen Modellstufen auf:

| Modell | Eingabe ($/M-Token) | Ausgabe ($/M-Token) | Anwendungsfall |

|---|---|---|---|

| GPT-5.2 Pro | $21.00 | $168.00 | Aufgaben mit maximaler Leistungsfähigkeit |

| GPT-5.2 | $1.75 | $14.00 | Neuestes Flaggschiffmodell |

| GPT-4.1 Mini | $0.40 | $1.60 | Kosteneffiziente Aufgaben |

| o1 (Argumentieren) | $15.00 | $60.00 | Komplexe Problemlösung |

| o3 (Argumentation) | $2.00 | $8.00 | Schlussfolgerungen der nächsten Generation |

In Diskussionen innerhalb der Community wurde festgestellt, dass o1 deutlich mehr kostet als o3, wobei das Preisverhältnis jedoch eher auf unterschiedliche Rechenarchitekturen als auf eine Hierarchie der Leistungsfähigkeit zurückzuführen ist.

OpenAI bietet außerdem spezialisierte Modelle wie chatgpt-image-latest mit $5 Eingabe und $10 Ausgabe pro Million Token an, die für multimodale Interaktionen konzipiert sind.

Anthropic Claude Preisgestaltung

Die Claude-Modelle von Anthropic haben sich aufgrund ihrer starken Leistung bei Codierungs- und Analyseaufgaben bewährt. Laut Anthropics Ankündigung vom 5. Februar 2026 bleibt der Preis für Claude Opus 4.6 unverändert bei $5 pro Million Input-Token und $25 pro Million Output-Token.

Damit ist Claude Opus deutlich günstiger als einige Modelle von OpenAI. Für einen Entwickler, der monatlich 10 Millionen Eingabe-Token und 5 Millionen Ausgabe-Token mit vergleichbaren Modellen verarbeitet, ist der Kostenunterschied erheblich:

- GPT-5.2 Pro: (10 × $21) + (5 × $168) = $1,050

- Claude Opus 4.6: (10 × $5) + (5 × $25) = $175

Claude führte in der Beta-Version außerdem ein Kontextfenster mit 1 Million Token ein, das längere Konversationen ohne Kontextkürzung ermöglicht – eine Funktion, die die Tokenverschwendung durch wiederholten Kontext reduziert.

Anthropic bietet über die Claude Console Tools zur Kostenüberwachung, mit denen Entwickler Nutzungsmuster verfolgen und Ausgabenlimits festlegen können. Für Anthropic Claude Code können Entwickler den Befehl `/cost` verwenden, um detaillierte Statistiken zur Token-Nutzung aktueller Sitzungen anzuzeigen und so Optimierungspotenziale zu identifizieren.

Google Gemini Preise

Googles Gemini-Modelle bieten wettbewerbsfähige Preise, wobei die konkreten Preise im Jahr 2026 je nach Modellkategorie und Region variieren. Laut Wettbewerbsanalysen positionieren sich die Gemini-Modelle typischerweise zwischen den Premium-Modellen von OpenAI und den günstigeren Alternativen.

Der Vorteil von Gemini liegt in der Integration mit der Google Cloud-Infrastruktur und den Diensten, was es für Organisationen attraktiv macht, die bereits in dieses Ökosystem investiert haben.

xAI Grok Preisgestaltung

Laut Wettbewerbsanalyse hat xAI Grok 4-Modelle mit Preisen von $3 pro Million Input-Token und $15 pro Million Output-Token auf den Markt gebracht. Damit ist Grok 4 teurer als Claude Opus, aber günstiger als GPT-5.2.

xAI bietet außerdem Grok 4 Fast und Grok 4.1 Fast zu deutlich niedrigeren Gebühren an: $0,20 Input und $0,50 Output pro Million Token. Diese schnelleren Varianten bieten im Gegenzug höhere Geschwindigkeit und Kosteneffizienz und bieten daher weniger Funktionen.

DeepSeek-Preisdisruption

Das chinesische Unternehmen DeepSeek hat mit seiner Modellvariante V3.2-Exp nahezu alle Konkurrenten preislich unterboten. DeepSeek V3.2-Exp kostet $0,28 pro Million eingegebener Token (Cache-Fehler) und $0,42 pro Million ausgegebener Token.

Diese Preisgestaltung bedeutet eine drastische Reduzierung im Vergleich zu Premium-Modellen westlicher Hersteller. Bei Anwendungen mit hohem Datenvolumen können die Preise von DeepSeek monatliche Einsparungen in Höhe von Tausenden von Dollar ermöglichen.

Zu den Abwägungen gehören mögliche Latenzzeiten durch chinesische Server, Bedenken hinsichtlich des Datenstandorts für regulierte Branchen und Fragen zur langfristigen Preisstabilität.

Kosten einer Abonnement-Chatbot-Plattform

Für Unternehmen, die schlüsselfertige Lösungen der API-Entwicklung vorziehen, bündeln Abonnementplattformen den LLM-Zugang mit Schnittstellen, Analysen und Integrationen.

Preise für Kleinunternehmen

Einstiegspakete richten sich typischerweise an Einzelunternehmer oder kleine Teams, die Chatbot-Funktionen testen. Diese Starterpakete kosten oft $30–$150 pro Monat und beinhalten:

- 1–3 aktive Chatbots

- Begrenzte Anzahl monatlicher Gespräche (oft 500–5000)

- Grundlegende Integrationen (Website, Facebook Messenger)

- Standard-Antwortvorlagen

- E-Mail-Support

Die hier geltenden Beschränkungen sind entscheidend. Ein kleiner Online-Shop, der täglich 100 Kundenanfragen bearbeitet, stößt innerhalb der ersten Woche an die monatliche Obergrenze von 3.000 Konversationen. Sobald diese Grenzen überschritten sind, erheben die Plattformen entweder zusätzliche Gebühren oder sperren den Chatbot – beides ist für die Kundenzufriedenheit nicht optimal.

Lösungen für den Mittelstand

Wachsende Unternehmen benötigen typischerweise Tarife im Bereich von $300 bis $1.000 pro Monat. In dieser Stufe erweitern sich die Funktionen erheblich:

- 5–10 Chatbots mit ausgefeilterer Logik

- 15.000–50.000 Gespräche pro Monat

- CRM- und Helpdesk-Integrationen

- Maßgeschneiderte Schulungen zu firmenspezifischen Daten

- Analyse- und Gesprächseinblicke

- Priorisierter Support mit schnelleren Reaktionszeiten

Diese Stufe eignet sich für Unternehmen mit einem etablierten Kundenstamm, die aber noch nicht im Enterprise-Bereich tätig sind. Die Preisgestaltung spiegelt den Wert der Automatisierung wider: Ein einzelner Supportmitarbeiter kostet monatlich 1.400 bis 1.400 Euro an Gehalt und Sozialleistungen, sodass sich die Investition selbst für einen Chatbot lohnt, der 301.300 Anfragen bearbeitet.

Preise für Enterprise-Chatbots

Große Organisationen zahlen oft monatlich zwischen 3.000 und über 50.000 Tsd. für Chatbot-Plattformen der Enterprise-Klasse. Auf diesem Niveau werden die Preise in der Regel individuell auf Basis folgender Faktoren erstellt:

- Unbegrenzte oder sehr hohe Gesprächslautstärke

- White-Label-Branding-Optionen

- Erweiterte Sicherheits- und Compliance-Funktionen

- Persönliche Kundenbetreuung

- Benutzerdefiniertes Modelltraining und Feinabstimmung

- SLA-Garantien für Verfügbarkeit und Reaktionsgeschwindigkeit

- Mehrsprachige Unterstützung

Enterprise-Verträge umfassen häufig professionelle Dienstleistungen – Implementierungsunterstützung, kundenspezifische Integrationsentwicklung und laufende Optimierungsberatung. Diese Dienstleistungen können einmalige oder wiederkehrende Kosten in Höhe von Zehntausenden von Euro verursachen.

Versteckte Kosten, die die Preise für LLM-Chatbots in die Höhe treiben

Der angegebene Preis ist selten die ganze Wahrheit. Zahlreiche versteckte oder halbversteckte Kosten können die tatsächlichen Betriebskosten von LLM-Chatbots verdoppeln.

Kontextfenster und Tokenverschwendung

Jede Konversation mit einem LLM umfasst nicht nur die neueste Nachricht des Nutzers, sondern auch den Konversationsverlauf zur Kontextualisierung. Eine Konversation mit zehn Beiträgen kann mit jeder neuen Nachricht Tausende von Kontextinformationen übertragen.

Modelle mit größeren Kontextfenstern reduzieren diese Verschwendung, indem sie mehr Gesprächsstatus speichern, ohne diesen erneut zu senden. Das 1-Millionen-Token-Kontextfenster von Claude Opus 4.6 stellt hier einen großen Vorteil dar – längere Gespräche erfordern keine aufwändige erneute Kontextübertragung.

Kosten für schnelles Caching

Einige Anbieter bieten schnelles Caching an, um die Kosten beim wiederholten Senden desselben Kontextes zu senken. OpenAI und Anthropic unterstützen beide verschiedene Formen des Caching, unterscheiden sich jedoch in ihren Preismodellen.

Zwischengespeicherte Tokens sind günstiger als neue, aber nicht alle Inhalte eignen sich für die Zwischenspeicherung. Um zu verstehen, wann die Zwischenspeicherung sinnvoll ist – und um Eingabeaufforderungen so zu optimieren, dass die Cache-Treffer maximiert werden –, ist technisches Know-how erforderlich, das kleineren Teams möglicherweise fehlt.

Integrations- und Entwicklungszeit

API-basierte Ansätze sparen zwar Abonnementgebühren, verursachen aber Entwicklungskosten. Für die Entwicklung eines produktionsreifen Chatbots ist Folgendes erforderlich:

- Backend-Infrastruktur für API-Aufrufe

- Entwicklung von Benutzeroberflächen

- Dialogablauflogik und Fehlerbehandlung

- Sicherheitsmaßnahmen für Benutzerdaten

- Überwachungs- und Protokollierungssysteme

- Kontinuierliche Wartung im Zuge der Weiterentwicklung von APIs

Für ein mittelgroßes Entwicklerteam entspricht dies anfänglich etwa 200–500 Arbeitsstunden, zuzüglich 10–20 Stunden monatlich für die Wartung. Bei üblichen Entwicklerhonoraren belaufen sich die anfänglichen Kosten auf 20.000–50.000 Tsd. und die laufenden monatlichen Kosten auf 1.500–3.000 Tsd.

Datenaufbereitung und Schulung

Allgemeine LLMs funktionieren ohne weitere Anpassungen gut, aber für domänenspezifische Ergebnisse ist oft eine Feinabstimmung oder der Einsatz von Retrieval-Augmented Generation (RAG)-Systemen erforderlich.

Der Aufbau eines RAG-Systems bedeutet:

- Sammlung und Reinigung von Firmendokumenten

- Inhalte angemessen aufteilen

- Generieren und Speichern von Einbettungen

- Implementierung der Abruflogik

- Testen und iteratives Verbessern der Abrufqualität

Diese Arbeit ist nicht kostenlos. Organisationen verbringen oft Wochen oder Monate damit, Wissensdatenbanken produktionsreif zu machen.

Überwachung und Qualitätssicherung

LLMs generieren gelegentlich falsche, unpassende oder markenfremde Antworten. Für den Einsatz in Unternehmen ist Folgendes erforderlich:

- Konversationsüberwachungssysteme

- Menschliche Überprüfungsprozesse für markierte Interaktionen

- A/B-Tests verschiedener Eingabeaufforderungen und Modelle

- Regelmäßige Audits zur Qualitäts- und Konformitätsprüfung

Diese Betriebskosten summieren sich. Je nach Gesprächsvolumen und Risikotoleranz benötigt ein Unternehmen möglicherweise 0,5 bis 2 Vollzeitäquivalente (FTE) für das Qualitätsmanagement von Chatbots.

Das richtige Preismodell auswählen

Wie sollen Organisationen angesichts dieser vielfältigen Optionen zwischen Abonnementplattformen und API-Entwicklung oder zwischen Premiummodellen und kostengünstigeren Alternativen entscheiden?

Berechnung des Nutzungsvolumens

Beginnen Sie mit der Schätzung des Gesprächsvolumens und des Tokenverbrauchs. Für einen Kundenservice-Chatbot:

- Schätzung der täglichen Gesprächsfrequenz (das bestehende Ticketvolumen dient als Grundlage)

- Berechnen Sie die durchschnittliche Anzahl an Tokens pro Konversation (500–2000 sind je nach Komplexität typisch).

- Für Wachstum und unerwartete Spitzenwerte 30–50%-Puffer hinzufügen

Berechnen Sie anschließend die Kosten bei verschiedenen Anbietern. Ein Unternehmen, das monatlich 10.000 Konversationen zu je 1.000 Token (500 Input, 500 Output) abwickelt, würde Folgendes verbrauchen:

- 5 Millionen Input-Tokens monatlich

- 5 Millionen Output-Token monatlich

Zu unterschiedlichen Anbietertarifen:

| Anbieter/Modell | Monatliche Kosten | Jährliche Kosten |

|---|---|---|

| GPT-5.2 Pro | $945 | $11,340 |

| Claude Opus 4.6 | $150 | $1,800 |

| Grok 4 | $90 | $1,080 |

| o3 | $50 | $600 |

| DeepSeek V3.2 | $3.50 | $42 |

Diese Berechnung offenbart enorme Unterschiede. Aber Moment mal – der Preis ist nicht alles.

Abwägung zwischen Qualität und Kosten

Günstigere Modelle liefern oft Ergebnisse geringerer Qualität. In Anwendungsfällen, in denen Genauigkeit entscheidend ist – etwa bei medizinischer Beratung, Rechtsinformationen oder Finanzberatung – reduziert die Investition in bessere Modelle das Risiko.

Einige Entwickler berichten, dass die Speicherkosten beim Erstellen von Chatbots mit langen Konversationsverläufen unerwartet stark ansteigen können, insbesondere bei Modellen, die kein effizientes Kontextmanagement unterstützen.

Die eindeutigste Antwort liefert das Testen verschiedener Modelle anhand konkreter Anwendungsfälle. Führen Sie Pilotprojekte mit 100–500 realen Gesprächen über mehrere Modelle hinweg durch und messen Sie Folgendes:

- Genauigkeit und Relevanz der Antworten

- Nutzerzufriedenheitswerte

- Gesprächslösungsquoten

- Eskalation auf menschliche Agenten

Das Modell, das akzeptable Qualität zum niedrigsten Preis bietet, setzt sich durch. Manchmal ist das ein Premiummodell, manchmal reicht ein Modell der Mittelklasse völlig aus.

Eigenbau oder Kauf – Entscheidung

Sollten Unternehmen mithilfe von APIs eigene Chatbots entwickeln oder Abonnementplattformen erwerben?

Abonnementplattformen sind sinnvoll, wenn:

- Die technischen Ressourcen sind begrenzt.

- Die Markteinführungsgeschwindigkeit ist wichtiger als die individuelle Anpassung.

- Das Gesprächsvolumen liegt innerhalb der Plattformgrenzen.

- Standardintegrationen decken alle erforderlichen Anwendungsfälle ab.

API-Entwicklung ist sinnvoll, wenn:

- Einzigartige Arbeitsabläufe erfordern benutzerdefinierte Logik

- Das hohe Volumen macht die Abonnementkosten unerschwinglich.

- Eine tiefe Integration in bestehende Systeme ist unerlässlich.

- Das technische Team hat Kapazitäten für die Entwicklung.

Der Wendepunkt liegt häufig bei etwa 25.000–50.000 monatlichen Konversationen. Unterhalb dieser Schwelle sind Abonnementplattformen wirtschaftlich vorteilhafter. Oberhalb dieser Schwelle sind individuelle API-Implementierungen trotz des Entwicklungsaufwands in der Regel kostengünstiger.

Verwaltung und Optimierung der LLM-Kosten

Nach der Implementierung helfen verschiedene Strategien, die laufenden Kosten zu kontrollieren.

Schnelles Engineering für mehr Effizienz

Gut formulierte Prompts reduzieren Token-Verschwendung und verbessern die Ausgabequalität. Zu den Techniken gehören:

- Verwendung prägnanter Systemmeldungen, die den Kontext ohne überflüssige Wörter herstellen.

- Implementierung von Few-Shot-Learning mit 2–3 Beispielen anstatt 10+

- Strukturierung der Ausgaben mit JSON oder anderen Formaten, um ausführliche Erklärungen zu minimieren

- Komplexe Aufgaben nach Möglichkeit in kleinere Schritte unterteilen

Eine Reduzierung der durchschnittlich benötigten Token pro Konversation um 20% entspricht direkt einer Kostenersparnis von 20%.

Modellauswahl nach Aufgabe

Nicht jede Aufgabe erfordert das leistungsstärkste Modell. Intelligente Routenplanung kann erhebliche Kosten einsparen:

- Verwenden Sie günstigere Modelle für einfache FAQs und Routing-Entscheidungen.

- Teure Modelle sollten für komplexe Schlussfolgerungen oder Generierung reserviert werden.

- Implementieren Sie ein Konfidenzbewertungssystem, um zu bestimmen, wann auf Premium-Modelle umgestiegen werden soll.

Ein gestaffelter Ansatz könnte GPT-4.1 Mini für 70% Konversationen und GPT-5.2 für die verbleibenden 30%, die fortgeschrittene Fähigkeiten erfordern, verwenden, wodurch die durchschnittlichen Kosten um 50–60% gesenkt werden.

Caching und Kontextoptimierung

Durch die Nutzung von Prompt-Caching, sofern verfügbar, lassen sich die Kosten für wiederholte Kontextinformationen reduzieren. Der strategische Einsatz von zwischengespeicherten Inhalten kann die Token-Ausgaben deutlich senken.

Für Anthropic Claude Code können Entwickler den Befehl /cost verwenden, um detaillierte Statistiken zur Token-Nutzung für aktuelle Sitzungen anzuzeigen und so Optimierungsmöglichkeiten zu identifizieren.

Nutzungsüberwachung und Benachrichtigungen

Sowohl OpenAI als auch Anthropic bieten Tools zur Nutzungsüberwachung an. Durch das Einrichten von Benachrichtigungen lassen sich unerwartete Rechnungen bei plötzlichen Nutzungsspitzen vermeiden.

Wichtige Kennzahlen zur Überwachung:

- Trends beim täglichen Tokenverbrauch

- Kosten pro Gespräch im Laufe der Zeit

- Modellauswahlverteilung

- Fehlerraten, die Wiederholungsversuche auslösen und Token verschwenden

Die Claude Console von Anthropic bietet detaillierte Kosten- und Nutzungsberichte, die für Entwickler, Abrechnungsmanager und Administratoren sichtbar sind und ein proaktives Kostenmanagement ermöglichen.

Unternehmensbezogene Überlegungen und Mengenrabatte

Große Organisationen verhandeln oft bessere Konditionen, als die veröffentlichten API-Preise vermuten lassen.

Kundenspezifische Unternehmensvereinbarungen

Unternehmen, die sich zu einem signifikanten Volumen verpflichten – oft $50.000+ jährlich – können verhandeln:

- Mengenrabatte von 10–30%

- Individuelle Tarifstufen basierend auf dem zugesagten Budget

- SLA-Garantien für Verfügbarkeit und Latenz

- Dedizierter Support und technisches Account-Management

- Private Bereitstellungsoptionen für Datensensibilität

OpenAI, Anthropic und andere große Anbieter bieten alle Enterprise-Pläne an, allerdings werden die Preisdetails nicht öffentlich bekannt gegeben.

Datenresidenz und Compliance

Regulierte Branchen stehen vor zusätzlichen Herausforderungen. Organisationen im Gesundheitswesen müssen die HIPAA-Bestimmungen einhalten; Finanzdienstleister benötigen SOC 2; europäische Unternehmen müssen die Datenschutzbestimmungen der DSGVO berücksichtigen.

Unternehmensvereinbarungen beinhalten häufig Folgendes:

- Geschäftspartnervereinbarungen (BAAs) für das Gesundheitswesen

- Datenverarbeitungsvereinbarungen zur Festlegung der Datenverarbeitung

- Regionale Bereitstellungsoptionen zur Speicherung von Daten in bestimmten Rechtsordnungen

- Null-Datenaufbewahrungsrichtlinien

Claude Code unterstützt die Option, Daten nicht aufzubewahren, für Teams, denen der Datenschutz wichtig ist.

Diese Compliance-Funktionen sind manchmal mit höheren Preisen oder Mindestausgaben verbunden.

Neue Modelle und zukünftige Preistrends

Der LLM-Markt entwickelt sich rasant. Mehrere Trends prägen die Preisgestaltung ab 2026.

Open-Source-Wettbewerb

Modelle wie GLM-5 und Qwen3.5 stellen zunehmend leistungsfähige Open-Source-Alternativen dar. Organisationen mit den entsprechenden technischen Ressourcen können diese Modelle selbst hosten und so die Kosten pro Token vollständig eliminieren.

Der Nachteil sind die Infrastrukturkosten. Die Ausführung eines Modells mit 40 Milliarden Parametern erfordert erhebliche GPU-Ressourcen – oft 1.400.500 bis 1.400.000 PKR monatlich an Cloud-GPU-Kosten oder beträchtliche Investitionen in lokale Hardware.

Bei sehr hohem Datenaufkommen (Millionen von täglichen Konversationen) kann Self-Hosting trotz des Infrastrukturaufwands eine bessere Wirtschaftlichkeit als API-Dienste erzielen.

Spezialmodelle

Aufgabenspezifische Modelle, die für eng definierte Anwendungsfälle optimiert sind, bieten oft ein besseres Preis-Leistungs-Verhältnis als universelle Flaggschiffmodelle. Das o3-Reasoning-Modell von OpenAI ist kostengünstiger als o1 und liefert gleichzeitig eine verbesserte Leistung bei bestimmten analytischen Aufgaben.

Da die Anbieter immer spezialisiertere Modelle auf den Markt bringen, können Unternehmen die Kosten optimieren, indem sie die Modelle an die spezifischen Anforderungen der Anwendungsfälle anpassen, anstatt für alles teure Flaggschiffmodelle zu verwenden.

Multimodale Preisentwicklung

Modelle, die Bilder, Audio und andere Modalitäten verarbeiten, führen zu zusätzlicher Komplexität bei der Preisgestaltung. Die Realtime API von OpenAI berechnet Text-, Audio- und Bild-Tokens unterschiedlich: Audio-Tokens in Nutzernachrichten kosten 1 Token pro 100 ms, Audio-Tokens von Assistenten 1 Token pro 50 ms.

Bei sprachbasierten Chatbots summieren sich diese Kosten schnell. Ein fünfminütiges Gespräch umfasst 300.000 ms Audio. Gemäß den Tarifen der OpenAI Realtime API (1 Token pro 100 ms für Benutzer-Audio, 1 Token pro 50 ms für Assistenten-Audio) könnten sich die Kosten – je nach Gesprächsaufteilung – auf 3.000 bis 6.000 Tokens belaufen, noch vor der Textverarbeitung.

Berechnung der Kapitalrendite

Die Kosten zu verstehen, ist nur die halbe Miete. Die andere Hälfte besteht darin, den Nutzen von Chatbots zu quantifizieren.

Reduzierung der Unterstützungskosten

Die einfachste ROI-Berechnung bezieht sich auf die Anzahl der wegfallenden Support-Tickets. Wenn ein Chatbot 401.300 eingehende Anfragen bearbeitet und jedes von einem Mitarbeiter bearbeitete Ticket 1.400 bis 1.400 Arbeitskosten verursacht, summieren sich die Einsparungen schnell.

Für ein Unternehmen, das monatlich 5.000 Support-Tickets zu durchschnittlichen Kosten von $8 bearbeitet:

- Monatliche Gesamtkosten für den Support: $40,000

- Chatbot-Verarbeitung 40%: 2.000 Tickets automatisiert

- Ersparnisse: 2.000 × $8 = $16.000 monatlich

Wenn der Chatbot monatlich $2.000 kostet (einschließlich Entwicklungs- und API-Kosten), beträgt die Nettoersparnis $14.000 monatlich bzw. $168.000 jährlich.

Auswirkungen auf den Umsatz

Bei Chatbots für Vertrieb und Leadgenerierung verlagern sich die ROI-Berechnungen auf Konversionsverbesserungen:

- Erhöhtes Engagement durch 24/7-Verfügbarkeit

- Schnellere Reaktionszeiten verringern die Abbruchrate

- Bessere Qualifizierung von Leads vor der Übergabe an einen Mitarbeiter

- Upselling- und Cross-Selling-Empfehlungen

Selbst geringfügige Verbesserungen der Konversionsraten können die Investition in einen Chatbot rechtfertigen. Eine Steigerung der Konversionsrate um 21 £, 3 £ bei einem monatlichen Umsatz von 1 Mio. £ entspricht 1 £, 4 £, 20.000 £ – und übersteigt damit die üblichen Chatbot-Kosten deutlich.

Immaterielle Vorteile

Manche Vorteile von Chatbots lassen sich schwerer quantifizieren:

- Verbesserte Kundenzufriedenheit durch sofortige Reaktionen

- Einheitliche Markenstimme in allen Interaktionen

- Dadurch wurden menschliche Agenten für komplexe, hochkarätige Fälle freigesetzt

- Datenerhebung und Erkenntnisse aus Gesprächsmustern

Diese Faktoren sind für die langfristige Wettbewerbsfähigkeit von Bedeutung, auch wenn sie nicht direkt in den Finanzkalkulationen auftauchen.

Hören Sie auf, zu viel für LLM-Chatbots zu bezahlen und entwickeln Sie sie richtig.

Die Kosten für einen LLM-Chatbot hängen stark von der Systemarchitektur ab. Modellwahl, Trainingsstrategie, Token-Nutzung und Infrastruktur beeinflussen den Endpreis. Viele Unternehmen stellen fest, dass die Verwendung generischer Modelle ohne Optimierung die Betriebskosten schnell in die Höhe treibt.

AI Superior Das Unternehmen arbeitet mit Firmen zusammen, die maßgeschneiderte LLM-Systeme für den produktiven Einsatz benötigen. Es entwickelt und optimiert umfangreiche Sprachmodelle, erstellt Trainingsdaten und optimiert die Bereitstellung, sodass Chatbots auch bei steigender Nutzung präzise und kosteneffizient bleiben. Das Team aus promovierten Datenwissenschaftlern und Ingenieuren konzentriert sich auf die Entwicklung von KI-Systemen, die auf spezifische Arbeitsabläufe zugeschnitten sind, anstatt auf Standardlösungen zu setzen.

Planen Sie einen LLM-Chatbot? Sprechen Sie mit AI Superior Bevor Sie sich für eine teure Architektur entscheiden, sollten Sie sich einen klaren Überblick darüber verschaffen, was die Entwicklung und der Betrieb Ihres Chatbots tatsächlich kosten sollten.

Kostenbeispiele aus der Praxis

Um die Preisgestaltung zu verdeutlichen, betrachten wir einige realistische Szenarien:

Szenario 1: FAQ-Bot für kleine E-Commerce-Unternehmen

- Volumen: 2.000 Gespräche pro Monat

- Ansatz: Abonnementplattform

- Kosten: $79/Monat Plattformgebühr

- Ergebnis: Beantwortet 601.003.000 Produktfragen und halbiert so das E-Mail-Supportvolumen.

Szenario 2: Unterstützung für mittelständische SaaS-Unternehmen

- Volumen: 15.000 Gespräche pro Monat

- Ansatz: Benutzerdefinierte API-Integration mit Claude Opus

- Token-Nutzung: 12 Mio. Eingang, 8 Mio. Ausgang monatlich

- API-Kosten: (12 × $5) + (8 × $25) = $260/Monat

- Entwicklung: $30.000 Erstinstallation, $2.000 monatliche Wartung

- Kosten im ersten Jahr: $30.000 + ($260 + $2.000 × 12) = $57.120

- Laufende jährliche Kosten: $27,120

- Ergebnis: Bewältigt 45% Tier-1-Support, spart 2 Vollzeitäquivalente ein

Szenario 3: Multi-Channel-Assistent für Unternehmen

- Volumen: 200.000 Gespräche monatlich über Web, Mobilgeräte und Sprache

- Ansatz: Hybridmodell mit DeepSeek für einfache Anfragen, GPT-5.2 für komplexe Anfragen.

- Token-Nutzung: 120M Eingang (80M DeepSeek, 40M GPT), 80M Ausgang (50M DeepSeek, 30M GPT)

- API-Kosten: DeepSeek: (80 × $0,28) + (50 × $0,42) = $43,40; GPT: (40 × $21) + (30 × $168) = $5,880

- Monatliche Gesamtkosten der API: $2,442

- Infrastruktur: $5.000 monatlich (Lastverteilung, Überwachung, Datenbanken)

- Team: 2 Vollzeitäquivalente für Wartung und Optimierung = 1 TP4T 20.000 monatlich

- Monatliche Gesamtkosten: $27,442

- Ergebnis: Bearbeitet 70% Kundeninteraktionen und ersetzt damit 8 Vollzeitkräfte im Support.

Diese Beispiele veranschaulichen, wie die Kosten mit dem Volumen und der Komplexität steigen.

Häufig gestellte Fragen zur Preisgestaltung

Gibt es kostenlose LLM-Studiengänge?

Ja, mehrere Anbieter bieten kostenlose Tarife an. Laut der Preisseite von OpenAI bietet deren kostenloser Tarif eingeschränkten Zugriff auf GPT-5.2 mit begrenzter Nachrichtenanzahl und langsameren Antwortzeiten. Dies eignet sich für Experimente, jedoch nicht für den Produktiveinsatz.

Open-Source-Modelle können ohne Softwarelizenzkosten selbst gehostet werden, es fallen jedoch weiterhin Infrastrukturkosten an.

Wie funktionieren Unternehmensrabatte?

Unternehmenskunden, die sich zu einem hohen Bestellvolumen verpflichten, können individuelle Konditionen aushandeln, die oft 10–301 TP3T unter den veröffentlichten API-Preisen liegen. Diese Vereinbarungen setzen in der Regel jährliche Mindestausgaben von 1 TP4T50.000–1 TP4T100.000+ voraus.

Was passiert, wenn die Nutzung die im Tarif festgelegten Grenzen überschreitet?

Abonnementplattformen erheben üblicherweise entweder Gebühren für die Überschreitung des vereinbarten Datenvolumens (oft zu höheren Stückpreisen) oder pausieren den Dienst bis zum nächsten Abrechnungszeitraum. API-Dienste funktionieren zwar weiterhin, es fallen jedoch Gebühren an, die über das vereinbarte Budget hinausgehen.

Lassen sich die Kosten genau vorhersagen?

Die Nutzungsprognose verbessert sich mit der Zeit, bleibt aber volatil. Unerwartete virale Inhalte, saisonale Spitzen oder verändertes Nutzerverhalten können zu Nutzungsschwankungen um das 2- bis 5-Fache führen. Ein Puffer von 30–501 TP3T hilft, Überraschungen zu vermeiden.

Gibt es regionale Preisunterschiede?

Einige Anbieter passen ihre Preise regional an, große API-Dienste wie OpenAI und Anthropic verwenden jedoch einheitliche globale Tarife. Anforderungen an den Datenstandort erfordern mitunter regionale Implementierungen, die mit höheren Preisen verbunden sind.

Häufig gestellte Fragen

Wie hoch sind die durchschnittlichen Kosten eines KI-Chatbots im Jahr 2026?

Die durchschnittlichen Kosten variieren je nach Ansatz erheblich. Abonnementplattformen für kleine Unternehmen kosten zwischen 1.400 und 1.300 PKR monatlich. Lösungen für mittelständische Unternehmen kosten zwischen 1.000 und 1.400 PKR monatlich. Implementierungen in Großunternehmen übersteigen oft 3.000 PKR monatlich. Bei API-basierten Implementierungen hängen die Kosten vom Volumen ab – typischerweise liegen sie für die meisten Organisationen zwischen 100 und 5.000 PKR monatlich, wobei Implementierungen in Großunternehmen allein an Token-Kosten mitunter über 20.000 PKR monatlich erreichen können.

Wie viel kostet die ChatGPT-API im Vergleich zu Claude?

Stand Februar 2026 kostet OpenAIs GPT-5.2 Pro $21 pro Million Input-Token und $168 pro Million Output-Token, während Anthropics Claude Opus 4.6 $5 Input- und $25 Output-Token pro Million Token kostet. Claude ist deutlich günstiger – etwa 67% weniger als GPT-5.2 Pro. Bei monatlich 10 Millionen Input- und 5 Millionen Output-Token kostet GPT-5.2 $1.050, im Vergleich zu $175 bei Claude.

Welche Faktoren beeinflussen die Preisgestaltung von LLM-Chatbots am stärksten?

Die Hauptkostentreiber sind das Gesprächsvolumen, die Anzahl der Token pro Gespräch, die Modellauswahl und der Implementierungsansatz. Ein Unternehmen, das Premium-Modelle wie GPT-5.2 Pro bei hohem Gesprächsvolumen einsetzt, zahlt unter Umständen 100- bis 400-mal mehr als ein Unternehmen, das Budgetmodelle wie DeepSeek für eine vergleichbare Anzahl an Gesprächen verwendet. Auch die Größe des Kontextfensters, die Effizienz des Caching und die Notwendigkeit einer individuellen Entwicklung beeinflussen die Gesamtbetriebskosten erheblich.

Ist es günstiger, einen eigenen Chatbot zu entwickeln oder eine Plattform zu nutzen?

Bei einem monatlichen Konversationsvolumen unter 25.000 sind Abonnementplattformen unter Berücksichtigung der Entwicklungszeit in der Regel kostengünstiger. Oberhalb dieser Schwelle sind individuelle API-Implementierungen trotz anfänglicher Entwicklungskosten von 20.000 bis 50.000 PKR wirtschaftlicher. Der optimale Zeitpunkt hängt von der Verfügbarkeit des technischen Teams und den spezifischen Funktionsanforderungen ab. Individuelle Lösungen bieten mehr Flexibilität, erfordern jedoch laufende Wartung.

Bieten LLM-Anbieter kostenlose Einstiegskurse an?

Ja, die meisten großen Anbieter bieten eingeschränkten kostenlosen Zugang. OpenAI bietet einen kostenlosen Tarif mit eingeschränktem Zugriff auf GPT-5.2, begrenzter Nachrichtenanzahl und langsameren Antwortzeiten. Diese kostenlosen Tarife eignen sich für Tests und Experimente, sind aber aufgrund ihrer Beschränkungen für den Produktiveinsatz unpraktisch. Sobald das monatliche Konversationsvolumen Hunderte oder Tausende erreicht, sind kostenpflichtige Tarife erforderlich.

Wie kann ich die Kosten der LLM-API senken, ohne die Qualität zu beeinträchtigen?

Mehrere Strategien senken die Kosten bei gleichbleibender Qualität: Verwendung von gestaffeltem Modellrouting (kostengünstigere Modelle für einfache, Premium-Modelle für komplexe Anfragen), Optimierung von Eingabeaufforderungen zur Reduzierung von Token-Verschwendung, Nutzung von Eingabeaufforderungs-Caching (sofern verfügbar), Implementierung größerer Kontextfenster zur Vermeidung wiederholter Kontextübertragungen und Test mehrerer Modelle, um das beste Preis-Leistungs-Verhältnis für spezifische Anwendungsfälle zu ermitteln. Viele Organisationen erzielen durch diese Optimierungen Kosteneinsparungen von 30–501 TP3T.

Welche versteckten Kosten sollte ich neben den API-Preisen einplanen?

Neben den direkten API- oder Abonnementkosten sollten Sie folgende Budgets einplanen: Entwicklungszeit (20.000–50.000 Tsd. für individuelle Lösungen), laufende Wartung (1.500–5.000 Tsd. monatlich), Infrastruktur für Hosting und Monitoring (500–5.000 Tsd. monatlich, abhängig vom Umfang), Datenaufbereitung und Erstellung der Wissensdatenbank (Aufwand von Wochen bis Monaten) sowie Qualitätssicherung inklusive manueller Überprüfung. Versteckte Kosten können den tatsächlichen Preis von LLM-Dienstleistungen oft verdoppeln oder verdreifachen.

Entscheidungsfindung zur Preisgestaltung Ihres LLM-Chatbots

Die Preislandschaft für LLM-Chatbots im Jahr 2026 bietet mehr Optionen denn je – und ist gleichzeitig komplexer. Die Kluft zwischen günstigen und Premium-Angeboten hat sich vergrößert. Die Auswahl reicht nun von DeepSeeks $0,28/$0,42 pro Million Token bis hin zu OpenAIs GPT-5.2 Pro mit $21/$168.

Es gibt keine Universallösung für jeden Anwendungsfall. Kleine Unternehmen, die dialogbasierte KI testen, profitieren von Abonnementplattformen, die Technologie und Support zu festen monatlichen Gebühren bündeln. Wachsende Unternehmen mit moderatem Volumen finden oft in mittelständischen Plattformen oder API-Implementierungen mit kosteneffizienten Modellen wie Claude Opus oder o3 das beste Preis-Leistungs-Verhältnis. Große Unternehmen mit entsprechenden technischen Ressourcen können ihre Kosten durch individuelle Entwicklung, Modellrouting und Volumenverhandlungen optimieren.

Entscheidend ist, mit klaren Nutzungsschätzungen zu beginnen, verschiedene Ansätze mit realen Arbeitslasten zu testen und nicht nur die Kosten, sondern auch die Ergebnisse zu messen – gelöste Support-Tickets, verbesserte Konversionsraten, gesteigerte Kundenzufriedenheit. Diese Kennzahlen bestimmen den tatsächlichen ROI.

Eines ist sicher: Die Preisgestaltung wird sich weiterentwickeln. Monatlich kommen neue Modelle auf den Markt, etablierte Anbieter passen ihre Preise an, und Open-Source-Alternativen werden immer besser. Unternehmen, die flexible Architekturen entwickeln, die einen einfachen Modellwechsel ermöglichen, können sich so positionieren, dass sie ihre Kosten im Zuge der Marktveränderungen optimieren können.

Sind Sie bereit, die Chatbot-Optionen von LLM für Ihre individuellen Bedürfnisse zu erkunden? Berechnen Sie zunächst Ihr erwartetes monatliches Konversationsvolumen und Ihren Token-Verbrauch. Testen Sie kostenlose Angebote verschiedener Anbieter anhand repräsentativer Anwendungsfälle. Wählen Sie anschließend die Lösung, die akzeptable Qualität zu überschaubaren Kosten bietet – nicht unbedingt die günstigste oder teuerste, sondern diejenige, die Ihren Anforderungen das beste Preis-Leistungs-Verhältnis bietet.