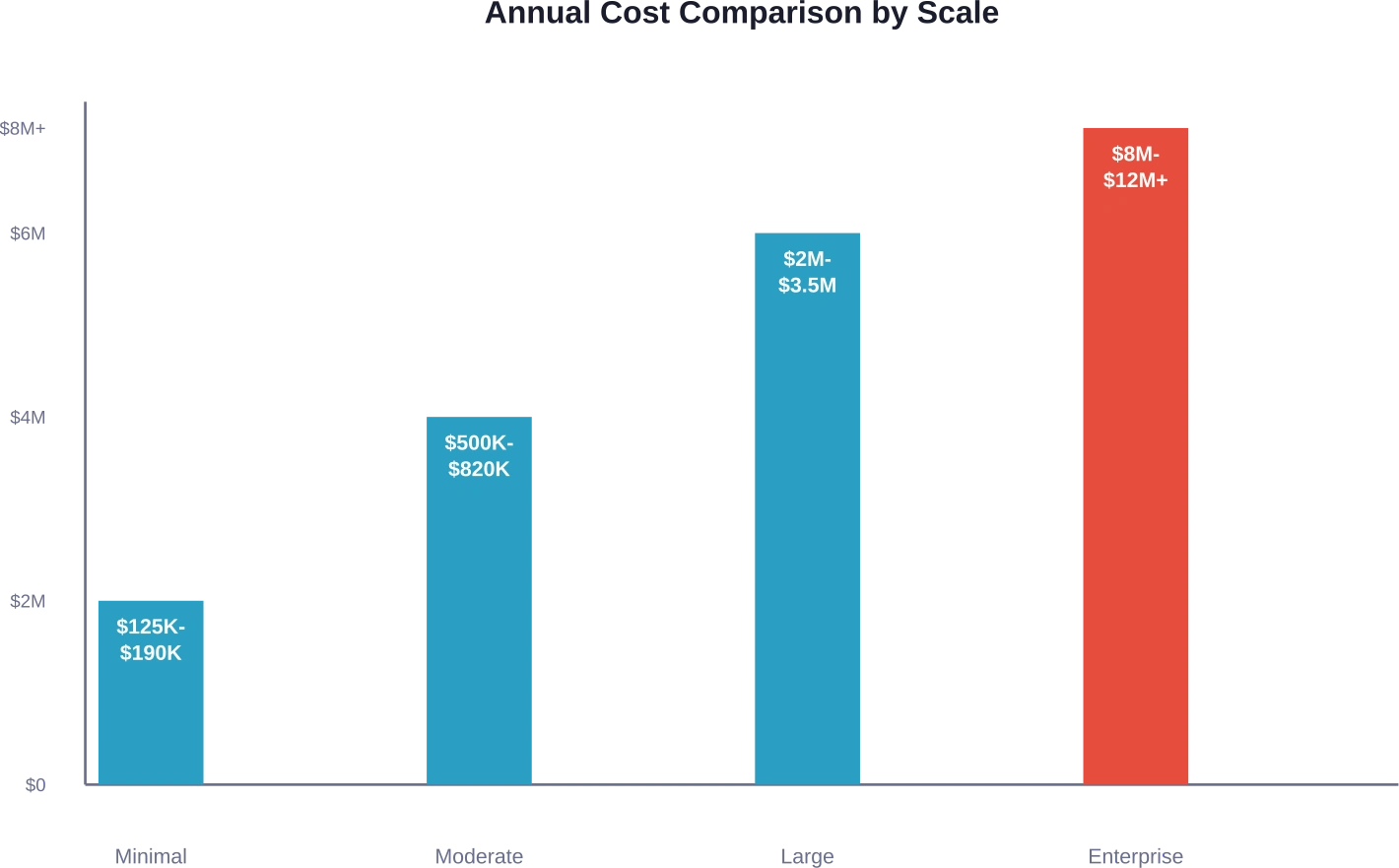

Kurzzusammenfassung: Open-Source-LLMs eliminieren Lizenzgebühren, verlagern die Kosten jedoch auf Infrastruktur, Personal und Wartung. Minimale interne Implementierungen kosten jährlich zwischen 125.000 und 190.000 US-Dollar, während Implementierungen im Unternehmensmaßstab über 12 Millionen US-Dollar kosten können. Die Kosteneffizienz hängt vom Nutzungsvolumen, dem technischen Know-how und den Anpassungsanforderungen ab – proprietäre APIs sind für geringe bis mittlere Arbeitslasten oft günstiger.

Das Versprechen klingt verlockend: Ein umfangreiches Open-Source-Sprachmodell herunterladen, in der eigenen Infrastruktur implementieren und so die laufenden API-Kosten proprietärer Dienste vermeiden. Keine Abrechnung pro Token mehr. Keine Abhängigkeit von einem einzelnen Anbieter.

Aber hier ist der Haken: Dieses “kostenlose” Modell hat einen Preis, der die meisten Organisationen überrascht.

Open-Source-LLMs verlagern die Kosten von offensichtlichen Posten wie Lizenzgebühren auf weniger sichtbare, aber ebenso beträchtliche Kosten: spezialisierte Entwickler, GPU-Infrastruktur, laufende Wartung und Betriebskosten. Diese versteckten Kosten können die Kosten kommerzieller API-Dienste, insbesondere bei kleineren Projekten, um ein Vielfaches übersteigen.

Bei der Entscheidung zwischen Open-Source- und proprietären LLMs geht es nicht um kostenlos versus kostenpflichtig. Es geht darum, welche Kostenstruktur Ihren Nutzungsmustern, technischen Möglichkeiten und Geschäftsanforderungen entspricht.

Warum Open-Source-LLMs eigentlich nicht kostenlos sind

Der Begriff “Open Source” birgt ein gefährliches Missverständnis. Zwar lassen sich Modellgewichte lizenzgebührenfrei herunterladen, doch der Einsatz dieser Gewichte in Produktionsumgebungen erfordert erhebliche Ressourcen.

Proprietäre LLM-Dienste wie OpenAIs GPT-5.2, Googles Gemini oder Anthropics Claude berechnen ihre Gebühren pro Token. Anfang 2026 kostete OpenAIs GPT-5.2 Pro $21,00 pro Million Input-Token ($168 pro Million Output-Token), während günstigere Varianten wie GPT-5.2 Mini ab $0,25 pro Million Input-Token erhältlich waren. Laut verifizierten Preisdaten spiegeln diese Preise verschiedene Leistungsstufen wider, die ein ausgewogenes Verhältnis zwischen Leistung und Kosten bieten. DeepSeeks V3.2-Exp “Denkmodelle” werden mit $0,28 pro Million Input-Token (Cache-Fehler) und $0,42 pro Million Output-Token angeboten und sind damit deutlich günstiger als westliche Wettbewerber.

Open-Source-Modelle kehren diese Gleichung um. Anstatt nutzungsbasierter Gebühren zahlen Sie für:

- Hardwarebeschaffung oder Cloud-GPU-Anmietung

- Ingenieurgehälter für Bereitstellung und Integration

- Infrastrukturmanagement und -überwachung

- Sicherheitshärtung und Compliance-Arbeit

- Modelloptimierung und Feinabstimmung

- Laufende Wartung und Support

Diese Kosten bleiben unabhängig vom Nutzungsvolumen relativ konstant, wodurch ein grundlegend anderes Wirtschaftsmodell als bei nutzungsbasierten APIs entsteht.

Die Realität der Infrastrukturkosten

Die Ausführung von LLMs erfordert erhebliche Rechenleistung. Modelle mit Milliarden von Parametern benötigen GPUs mit großem VRAM, schnellen Verbindungen und robusten Kühlsystemen.

Hardware-Investitionsanforderungen

Für eine minimale Produktionsumgebung wird typischerweise mindestens eine High-End-GPU benötigt. NVIDIAs A100-GPUs, die häufig für LLM-Inferenz eingesetzt werden, kosten zwischen 10.000 und 15.000 £ pro Stück. Größere Modelle oder höhere Durchsatzanforderungen vervielfachen diese Kosten schnell.

Die Hardwarebeschaffung ist jedoch nur der Anfang. Zur physischen Infrastruktur gehören Rackplatz, Stromverteilung, Kühlsysteme und Netzwerkverbindungen. Unternehmen ohne bestehende Rechenzentrumskapazität müssen zusätzliche Investitionen in diese Systeme tätigen.

Cloud-GPU-Ökonomie

Cloud-GPU-Instanzen bieten eine Alternative zum Hardwarebesitz, sind aber nach wie vor teuer. Laut einer Analyse von Hugging Face zur Wirtschaftlichkeit von GPU-Cloud-Diensten dominieren die Kapitalkosten die Preisstruktur. Beispielsweise kostet eine NVIDIA Tesla V100 in der Regel rund 10.000 US-Dollar, während die durchschnittlichen Mietkosten pro Stunde zwischen 2 und 3 US-Dollar liegen – die stündlichen Cloud-Gebühren summieren sich also bei kontinuierlichem Betrieb schnell.

Und genau hier liegt das Problem, das die anfänglichen Kostenprognosen durcheinanderbringt: Inferenz-Workloads erfordern eine permanente Verfügbarkeit. Im Gegensatz zu Trainingsprozessen, die nur einmal ausgeführt werden, laufen Produktionsumgebungen kontinuierlich. Dieser 24/7-Betrieb lässt die stündlichen Cloud-Kosten in hohe monatliche Rechnungen umschlagen.

Investitionen in Humankapital

Die Infrastruktur stellt nur einen Kostenfaktor dar. Der Bedarf an spezialisierten Fachkräften für die Bereitstellung und Wartung von Open-Source-LLMs übersteigt oft die Hardwarekosten.

Erforderliche Ingenieurrollen

Für den produktiven Einsatz von LLM-Systemen sind mehrere spezialisierte Rollen erforderlich. MLOps-Ingenieure kümmern sich um Bereitstellungspipelines, Inferenzoptimierung und die Skalierung der Infrastruktur. Softwareintegrationsingenieure entwickeln die Schnittstellen zwischen Modellen und bestehenden Systemen – eine Aufgabe, die laut verfügbaren Daten in KI-Projekten typischerweise etwa 601 TP3 T an Entwicklungsaufwand in Anspruch nimmt.

DevOps-Spezialisten verwalten Kubernetes-Cluster, Container-Orchestrierung und Infrastrukturüberwachung. Sicherheitsingenieure implementieren Zugriffskontrollen, Audit-Protokollierung und Compliance-Frameworks. Dateningenieure erstellen Pipelines zur Feinabstimmung und Evaluierung von Modellen.

In dem heutigen wettbewerbsintensiven Markt für KI-Fachkräfte sind diese Positionen mit hohen Gehältern verbunden. Erfahrene ML-Ingenieure verdienen oft zwischen 150.000 und 250.000 US-Dollar jährlich, wobei die Gesamtvergütungspakete für Spitzenkräfte noch höher ausfallen.

Anforderungen an die laufende Unterstützung

Doch hier liegt die Schwierigkeit für viele Organisationen: Die Implementierung ist kein einmaliges Projekt. Produktive LLM-Systeme erfordern kontinuierliche Betreuung.

Modelle müssen regelmäßig aktualisiert werden, um ihre Leistungsfähigkeit zu verbessern. Inferenz-Stacks wie vLLM oder NVIDIA Triton erfordern Wartung und Optimierung. Integrationspunkte funktionieren nicht mehr, wenn sich vorgelagerte Systeme ändern. Ohne kontinuierliche Optimierung verschlechtert sich die Leistung.

Dies führt zu einem ständigen Personalbedarf. Unternehmen können nicht einfach ein Open-Source-LLM implementieren und sich dann nicht mehr darum kümmern – sie verpflichten sich zu kontinuierlichen Investitionen in die Softwareentwicklung.

Reale Kostenszenarien

Abstrakte Kostenkategorien sind weniger wichtig als konkrete Szenarien. Was kostet der Betrieb von Open-Source-LLMs in unterschiedlichen Größenordnungen tatsächlich?

Minimaler interner Einsatz

Ein einfacher interner Chatbot oder ein Dokumentenanalysetool für ein kleines Team stellt das einfachste Einsatzszenario dar. Laut Kostenaufschlüsselungen aus Branchenanalysen belaufen sich selbst minimale interne Implementierungen auf 125.000 bis 190.000 US-Dollar jährlich.

Dieses Szenario setzt Folgendes voraus:

- Cloud-GPU-Instanzen statt Hardwarekauf

- Single-GPU-Inferenz-Setup

- Teilzeit-Technikunterstützung (kein festangestelltes Personal)

- Minimale Anpassungsmöglichkeiten über grundlegende Feineinstellungen hinaus

- Geringes Anfragevolumen (Hunderte bis wenige Tausend täglich)

Die Kosten verteilen sich grob auf Cloud-Infrastruktur (40%), Entwicklungszeit (45%) und Überwachungs-/Sicherheitstools (15%).

Moderate kundenorientierte Merkmale

Kundenorientierte Anwendungen erhöhen die Anforderungen deutlich. Höhere Verfügbarkeitsanforderungen, ein gesteigertes Abfragevolumen und der Bedarf an Produktionssupport treiben die Kosten für Implementierungen mittleren Umfangs auf 1.500.000 bis 1.820.000 US-Dollar jährlich.

Dieses Szenario beinhaltet typischerweise Folgendes:

- Multi-GPU-Setup für Redundanz und Durchsatz

- Eigenes Ingenieurteam (2-3 Vollzeitstellen)

- Individuelle Feinabstimmung für Domänenspezifik

- Umfassende Überwachung und Alarmierung

- Sicherheitshärtung und Compliance-Arbeit

Die Infrastrukturkosten steigen, aber die Entwicklungskosten dominieren. Der Aufbau zuverlässiger, produktionsreifer Systeme erfordert einen nachhaltigen Entwicklungsaufwand, der weit über die anfängliche Inbetriebnahme hinausgeht.

Kernprodukte für Unternehmen

Wenn LLM-Funktionen zu einem zentralen Bestandteil des Produktangebots werden, steigen die Kosten drastisch an. Implementierungen im Unternehmensmaßstab, die Tausende von gleichzeitigen Nutzern bedienen, können jährlich 1,4 Billionen bis 1,4 Billionen US-Dollar übersteigen.

Diese Einsätze erfordern:

- GPU-Cluster mit mehreren Regionen für Leistung und Redundanz

- Feste Ingenieurteams (8-15+ Ingenieure)

- Umfangreiche Modelloptimierung und kundenspezifische Architekturen

- Rahmenwerke für Unternehmenssicherheit und Compliance

- 24/7-Betriebsunterstützung

Bei dieser Größenordnung wird der Personalaufwand im Ingenieurwesen zum dominierenden Kostentreiber und übertrifft die Infrastrukturkosten deutlich.

| Einsatzskala | Jährliche Kostenspanne | Hauptkostentreiber | Typische Anwendungsfälle

|

|---|---|---|---|

| Minimale interne | $125K–$190K | Cloud-GPUs, Teilzeit-Engineering | Interne Chatbots, Dokumentenanalyse |

| Mäßiger Kundenkontakt | $500K–$820K | Eigenes Ingenieurteam, Multi-GPU | Automatisierung des Kundensupports, Content-Generierung |

| Großproduktion | $2M–$3.5M | Große Ingenieurteams, optimierte Infrastruktur | Kernproduktmerkmale, APIs mit hohem Datenvolumen |

| Enterprise Core Product | $8M–$12M+ | Umfangreiche Teams, regionsübergreifende Cluster | Geschäftskritische KI-Produkte, Plattformangebote |

Preisgestaltung der proprietären LLM-API im Jahr 2026

Um die Kosten von Open-Source-Software zu vergleichen, ist es notwendig, proprietäre Alternativen zu verstehen. Die API-Preisgestaltung hat sich deutlich weiterentwickelt, wobei große Anbieter ihre Preise angepasst und neue Tarifstufen eingeführt haben.

Aktuelle Preislandschaft

Anfang 2026 variierte die Preisgestaltung für das firmeneigene LLM-Programm stark. Laut verifizierten Preisdaten (Stand: Februar 2026):

- OpenAIs GPT-5.2 Pro kostet $21,00 pro Million Input-Token und $168,00 pro Million Output-Token und repräsentiert damit die Premium-Flaggschiff-Version. Die Standardversion von GPT-5.2 kostet $1,75 bzw. $14,00, während GPT-5.2 Mini mit $0,25 bzw. $2,00 budgetfreundlichere Preise bietet.

- Die Preise für Googles Gemini-Geräte variieren je nach Modellvariante. Die neuesten Modelle bieten ein ausgewogenes Verhältnis von Leistung und Kosten für verschiedene Anwendungsfälle.

- Die Claude-Modelle von Anthropic behaupten ihre wettbewerbsfähige Positionierung im mittleren bis gehobenen Preissegment und legen Wert auf lange Akkulaufzeit und Sicherheitsmerkmale.

- xAI hat Grok 4 zu $3/$15 pro Million Token, Grok 4 Fast zu $0,20/$0,50 und Grok 4.1 Fast zu $0,20/$0,50 pro Million Token auf den Markt gebracht.

- Die “Denkmodelle” der Version V3.2-Exp von DeepSeek werden mit $0,28 pro Million Input-Token (Cache-Miss) und $0,42 pro Million Output-Token gehandelt und sind damit deutlich günstiger als die westlichen Wettbewerber.

Nutzungsbasierte Kostenberechnungen

Die API-Kosten steigen linear mit der Nutzung. Eine Anwendung, die monatlich 100 Millionen Token mit GPT-5.2 Pro verarbeitet (zu $21,00 pro Million Eingabe-Token), würde jährlich etwa $25K an Eingabe-Token verursachen. Dieselbe Arbeitslast auf DeepSeek V3.2-Exp kostet jährlich etwa $336 – ein Unterschied um das 74-Fache.

Diese lineare Skalierung führt zu klaren Gewinnschwellen. Anwendungen mit hohem Datenvolumen rechtfertigen schließlich Investitionen in Open-Source-Infrastruktur. Bei geringen bis mittleren Arbeitslasten sind APIs fast immer die bessere Wahl.

Der Wendepunkt hängt von den jeweiligen Preisstufen und Infrastrukturkosten ab, liegt aber im Allgemeinen für die meisten Organisationen irgendwo zwischen 50 Millionen und 200 Millionen Token pro Monat.

Versteckte Betriebskosten

Neben den offensichtlichen Infrastruktur- und Gehaltskosten fallen bei der Implementierung von Open-Source-LLM weniger sichtbare Betriebskosten an, die sich im Laufe der Zeit summieren.

Überwachung und Beobachtbarkeit

Produktionsfähige LLM-Systeme erfordern eine umfassende Überwachung. Latenzverfolgung, Durchsatzmetriken, Fehlerraten und Ressourcennutzung müssen in Echtzeit sichtbar sein.

Kommerzielle Observability-Plattformen berechnen ihre Gebühren anhand des Datenvolumens und der Aufbewahrungsfristen. Diese Kosten steigen mit der Systemkomplexität und dem Datenverkehr.

Bei kundenspezifischen Überwachungslösungen werden die Kosten auf den Entwicklungsaufwand verlagert – die Erstellung von Dashboards, Alarmsystemen und Diagnosetools beansprucht erhebliche Entwicklungsressourcen.

Modellaktualisierungen und Versionierung

Open-Source-LLM-Ökosysteme entwickeln sich schnell. Regelmäßig werden neue Modellversionen veröffentlicht, die verbesserte Funktionen, höhere Effizienz oder Fehlerbehebungen bieten.

Jedes Update erfordert Tests, Validierung und eine sorgfältige Bereitstellungsplanung. Regressionstests stellen sicher, dass neue Versionen bestehende Funktionen nicht beeinträchtigen. Leistungsvergleiche bestätigen die Verbesserungen. Rollback-Verfahren bereiten auf Fehler vor.

Unternehmen können Updates nicht einfach ignorieren – das Versäumnis, kritische Sicherheitspatches oder Leistungsverbesserungen einzuspielen, führt zu technischen Schulden und Wettbewerbsnachteilen.

Sicherheit und Compliance

LLM-Implementierungen, die sensible Daten verarbeiten, unterliegen strengen Sicherheitsanforderungen. Zugriffskontrollen, Audit-Protokollierung, Datenverschlüsselung und Netzwerkisolation müssen implementiert und gewartet werden.

Compliance-Rahmenwerke wie SOC 2, HIPAA oder DSGVO bringen zusätzliche Anforderungen mit sich. Regelmäßige Sicherheitsaudits, Penetrationstests und Schwachstellenmanagement verursachen laufende Kosten.

Proprietäre API-Anbieter kümmern sich in der Regel um Compliance-Zertifizierungen und die Sicherheitsinfrastruktur und entlasten so die Kunden. Open-Source-Implementierungen übernehmen die volle Verantwortung.

Wann Open Source finanziell sinnvoll ist

Trotz erheblicher Kosten bieten Open-Source-LLMs in bestimmten Szenarien überzeugende wirtschaftliche Vorteile.

Hohe Produktionslasten

Der Punkt, an dem Open-Source-Lösungen günstiger sind als APIs, hängt vom Nutzungsvolumen ab. Die Verarbeitung von Hunderten Millionen oder Milliarden Tokens pro Monat verursacht enorme API-Kosten, die Investitionen in die Infrastruktur rechtfertigen.

Eine Anwendung, die monatlich 500 Millionen Token über proprietäre APIs der mittleren Preisklasse verarbeitet, könnte jährlich 1,4 Billionen US-Dollar ($200K–$400K) kosten. Dieselbe Arbeitslast auf selbstgehosteter Infrastruktur könnte insgesamt 1,4 Billionen US-Dollar ($300K–$500K) kosten – allerdings mit relativ geringer Skalierung darüber hinaus.

Bei Milliarden von Token verschiebt sich die Wirtschaftlichkeit entscheidend in Richtung Selbsthosting.

Spezielle Domänenanforderungen

Manche Anwendungen erfordern eine umfangreiche Feinabstimmung anhand proprietärer Domänendaten. Medizinische Diagnostik, die Analyse juristischer Dokumente oder spezialisierte technische Bereiche profitieren von Modellen, die mit domänenspezifischen Korpora trainiert wurden.

Proprietäre API-Anbieter bieten zwar Feinabstimmungsdienste an, doch die Kosten steigen bei umfangreichen Anpassungen schnell an. Open-Source-Modelle ermöglichen hingegen unbegrenzte Feinabstimmung ohne Gebühren pro Trainingstoken.

Organisationen mit seltenen Sprachen, spezialisierten Vokabularen oder besonderen Formatierungsanforderungen finden Open-Source-Modelle möglicherweise anpassungsfähiger, wobei das Kosten-Nutzen-Verhältnis je nach Anwendungsfall variiert.

Datenschutz und Datensouveränität

Regulatorische Bestimmungen verbieten mitunter die Übermittlung sensibler Daten an externe APIs. Gesundheitsdaten, Finanzinformationen oder vertrauliche Daten erfordern unter Umständen eine Verarbeitung vor Ort.

Open-Source-LLMs ermöglichen die vollständige Datenkontrolle. Informationen verlassen niemals die Unternehmensinfrastruktur, was die Einhaltung von Vorschriften vereinfacht und Risiken reduziert.

Der Wert dieser Kontrollmaßnahme hängt von der Sensibilität der Daten und dem regulatorischen Kontext ab, aber für einige Organisationen ist sie unabhängig von den Kosten unverzichtbar.

Langfristige strategische Unabhängigkeit

Die Abhängigkeit von externen API-Anbietern birgt strategische Risiken. Anbieter können Preise erhöhen, Modelle einstellen oder Nutzungsbedingungen ändern. Serviceausfälle beeinträchtigen abhängige Anwendungen unmittelbar.

Open-Source-Implementierungen beseitigen die Abhängigkeit von einzelnen Anbietern. Unternehmen haben die Kontrolle über Verfügbarkeit, Preisgestaltung und Roadmap.

Ein auf arXiv veröffentlichter Forschungsartikel zur Kosten-Nutzen-Analyse der On-Premise-Implementierung von LLM definiert Leistungsparität als Benchmark-Werte innerhalb von 20% der führenden kommerziellen Modelle. Dies spiegelt die Unternehmensnormen wider, bei denen kleine Genauigkeitslücken durch Kosten-, Sicherheits- und Integrationsvorteile ausgeglichen werden.

Leistungsüberlegungen

Bei Kostenvergleichen wird eine entscheidende Dimension außer Acht gelassen: die Leistungsunterschiede zwischen Open-Source- und proprietären Modellen.

Fähigkeitslücken

Erstklassige proprietäre Modelle übertreffen vergleichbare Open-Source-Alternativen in der Regel bei anspruchsvollen Denkaufgaben, komplexen Anweisungen und spezialisierten Anwendungsbereichen.

Die Unterschiede variieren je nach Aufgabentyp erheblich. Einfache Klassifizierung, strukturierte Datenextraktion oder vorlagenbasierte Generierung weisen nur minimale Unterschiede auf. Komplexe Schlussfolgerungen, differenziertes Sprachverständnis oder kreative Aufgaben sprechen hingegen für hochmoderne, proprietäre Modelle.

Organisationen müssen bewerten, ob Leistungsunterschiede für ihre spezifischen Anwendungsfälle relevant sind. Viele Anwendungen erzielen mit mittlerer Leistungsfähigkeit zu geringeren Kosten gute Ergebnisse.

Optimierungsmöglichkeiten

Open-Source-Implementierungen ermöglichen umfassende Optimierungen, die mit API-Diensten nicht möglich sind. Quantisierung reduziert die Modellgröße und den Speicherbedarf bei gleichbleibender Genauigkeit. Wissensdestillation überträgt Funktionen auf kleinere, schnellere Modelle.

Eine auf Hugging Face veröffentlichte Studie zur Effizienz von Denkprozessen ergab, dass kürzere Denkketten bei geringerem Rechenaufwand eine vergleichbare oder sogar bessere Leistung erzielen können. Insbesondere benötigten einfache Short-1@k-Ansätze bis zu 40% weniger Denk-Token als Standardansätze, ohne die Ausgabequalität zu beeinträchtigen.

Benutzerdefinierte Inferenz-Stacks wie vLLM oder NVIDIA Triton bieten Leistungsoptimierungen, die über standardisierte APIs nicht möglich sind. Batching-Strategien, Caching-Mechanismen und hardwarespezifische Optimierungen können Durchsatz und Latenz deutlich verbessern.

Latenz und Durchsatz

Selbstgehostete Infrastruktur ermöglicht eine geografische Verteilung näher an den Nutzern und reduziert so die Netzwerklatenz. Dedizierte Hardware eliminiert Warteschlangenverzögerungen, die bei gemeinsam genutzter API-Infrastruktur auftreten können.

Die Entwicklung leistungsstarker Inferenzsysteme erfordert jedoch umfassendes Fachwissen. Schlecht optimierte Implementierungen weisen oft eine höhere Latenz auf als gut entwickelte API-Dienste.

Die Kostenentscheidung treffen

Die Wahl zwischen Open-Source- und proprietären LLMs erfordert die Bewertung mehrerer Dimensionen, die über einen einfachen Kostenvergleich hinausgehen.

Gesamtbetriebskosten berechnen

Genaue Kostenprognosen müssen alle Ausgabenkategorien umfassen:

- Infrastruktur: GPU-Hardware oder Cloud-Miete, Netzwerk, Speicher

- Personal: Gehälter von Ingenieuren, Rekrutierungskosten, Ausbildung

- Operationen: Überwachungstools, Sicherheitssoftware, Compliance-Audits

- Opportunitätskosten: Entwicklungszeit wurde von der Produktentwicklung abgezogen

- Risikoprämie: Ausfallkosten, Leistungsprobleme, Sicherheitsvorfälle

Organisationen unterschätzen systematisch die Personal- und Betriebskosten, während sie die Einsparungen bei der Infrastruktur überschätzen.

Technische Fähigkeiten bewerten

Erfolgreiche Open-Source-Implementierungen erfordern umfassende technische Expertise. Teams benötigen Kenntnisse in verteilten Systemen, GPU-Programmierung, ML-Optimierung und Produktionsbetrieb.

Organisationen, denen dieses Fachwissen fehlt, stehen vor zwei Möglichkeiten: Entweder sie bauen die entsprechenden Fähigkeiten durch Einstellung und Schulung von Mitarbeitern auf (teuer und langsam) oder sie engagieren externe Berater (teuer und abhängigkeitsbildend).

API-Dienste eliminieren die meisten technischen Anforderungen und ermöglichen es den Teams, sich auf die Anwendungslogik anstatt auf die Infrastruktur zu konzentrieren.

Erwägen Sie hybride Ansätze

Die Entscheidung ist nicht binär. Viele Organisationen kombinieren erfolgreich verschiedene Ansätze.

LLM-Routingstrategien wählen Modelle dynamisch anhand der Anfragecharakteristika aus. Einfache Anfragen werden an schnelle und kostengünstige Modelle weitergeleitet, während komplexe Aufgaben leistungsstarke Alternativen nutzen. Laut einer Studie von Hugging Face zum Batch-Routing von Anweisungen sorgt diese Optimierung für ein ausgewogenes Verhältnis von Leistung und Kosten bei gemischten Arbeitslasten.

Entwicklungs- und Testumgebungen können APIs nutzen, während die Produktionsumgebung auf einer selbstgehosteten Infrastruktur basiert. Dies reduziert die Infrastrukturkosten in Phasen mit geringem Datenaufkommen und ermöglicht gleichzeitig einen API-freien Produktionsbetrieb.

Aufgabenspezifische Spezialisierung setzt Open-Source-Modelle für standardisierte Aufgaben mit hohem Volumen ein, während für komplexe, variable Anfragen proprietäre APIs verwendet werden.

| Rücksichtnahme | Bevorzugt Open Source | Bevorzugt proprietäre APIs

|

|---|---|---|

| Nutzungsvolumen | Sehr hoch (über 500 Millionen Token/Monat) | Niedrig bis mittel (<100 Mio. Token/Monat) |

| Technisches Fachwissen | Starke ML- und Infrastrukturteams | Begrenzte ML-Expertise, kleine Teams |

| Anpassungsbedarf | Umfangreiche Feinabstimmung erforderlich | Standardmodelle ausreichend |

| Datenschutz | Strenge regulatorische Anforderungen | Übliche Geschäftsbedingungen akzeptabel |

| Markteinführungszeit | Langfristige strategische Investition | Schnelle Bereitstellung entscheidend |

| Kostenvorhersagbarkeit | Fixe Infrastrukturkosten bevorzugen | Variable Kosten akzeptabel |

Strategien zur Kostenoptimierung

Organisationen, die sich für Open-Source-LLMs engagieren, können verschiedene Strategien zur Kostenkontrolle einsetzen.

Infrastruktur richtig dimensionieren

Viele Implementierungen dimensionieren Hardware überdimensioniert, basierend auf Spitzenlasten anstatt auf dem typischen Verbrauch. Eine automatisch skalierende Infrastruktur passt die Kapazität dynamisch an den Bedarf an und reduziert so die Kosten ungenutzter Ressourcen.

Spot-Instanzen und unterbrechbare VMs bieten erhebliche Cloud-Rabatte – teilweise 60 bis 801.000 US-Dollar unter dem Standardpreis – im Gegenzug für potenzielle Unterbrechungen. Batch-Workloads und Entwicklungsumgebungen tolerieren Unterbrechungen gut.

Modellauswahl und Optimierung

Kleinere Modelle erzielen nach Feinabstimmung überraschend gute Ergebnisse bei spezialisierten Aufgaben. Untersuchungen zur Optimierung kleiner Sprachmodelle für E-Commerce-Anwendungen ergaben, dass ein korrekt feinabgestimmtes Llama-3.2-Modell mit einer Milliarde Parametern eine Genauigkeit von 99% erreichte und damit die Leistung von GPT-5.1 bei der Erkennung spezialisierter Absichten erzielte.

Durch die Quantisierung wird die Modellgenauigkeit von 16-Bit auf 8-Bit oder sogar 4-Bit-Darstellungen reduziert, wodurch der Speicherbedarf und die Inferenzkosten um 50-75% gesenkt werden, bei minimalen Auswirkungen auf die Qualität.

Die Modelldestillation trainiert kleinere Schülermodelle, um größere Lehrermodelle nachzuahmen, wodurch ein besseres Verhältnis von Effizienz zu Leistung erzielt wird als beim Training von Grund auf.

Effiziente Inferenztechniken

Durch die Verarbeitung mehrerer Eingaben in Batches wird die GPU-Auslastung deutlich verbessert. Kontinuierliche Batching-Verfahren ermöglichen die dynamische Zusammenstellung von Batches für Echtzeitanwendungen.

Die KV-Cache-Optimierung reduziert redundante Berechnungen während der autoregressiven Generierung, insbesondere bei langen Kontexten oder mehrstufigen Gesprächen.

Das Request-Routing leitet einfache Anfragen an kleine, schnelle Modelle und komplexe Anfragen an größere Modelle weiter und optimiert so das Kosten-Nutzen-Verhältnis über verschiedene Workload-Verteilungen hinweg.

Überprüfen Sie Ihre Open-Source-LLM-Kosten mit Technical Insight

Open-Source-LLMs wirken auf den ersten Blick günstig, da das Basismodell kostenlos ist. Die tatsächlichen Kosten entstehen jedoch häufig durch Training, Feinabstimmung, Datenaufbereitung und Bereitstellung. Entscheidungen über Modellgröße, Architektur und Integration haben einen erheblichen Einfluss auf den Rechenaufwand und die laufenden Betriebskosten. AI Superior Der Fokus liegt auf der technischen Entwicklung von Open-Source-LLMs – der Erstellung von Modellen, der Optimierung von Trainingsabläufen und der Einrichtung effizienter Bereitstellungspipelines, damit Sie Ihre Budgetverwendung nachvollziehen und kontrollieren können. (aisuperior.com/services/llm-model-creation-services)

Wenn Sie im Jahr 2026 versteckte Ausgaben erfassen und einen besseren Überblick über deren Herkunft erhalten möchten, beginnen Sie mit der technischen Einrichtung. Sprechen Sie mit AI Superior um Ihre aktuelle Open-Source-LLM-Implementierung zu prüfen und praktische Wege zur Senkung der Gesamtbetriebskosten zu finden.

Zukünftige Kostentrends

Die Kostendynamik des LLM-Studiums entwickelt sich weiterhin rasant, wobei mehrere Trends die wirtschaftliche Landschaft neu gestalten.

Abwärtsdruck auf die API-Preise

Der Wettbewerb unter den proprietären Anbietern verschärft sich. DeepSeeks aggressive Preisgestaltung von $0,28 pro Million Input-Token zwang die Konkurrenten, ihre eigenen Preise zu überprüfen.

Eine verbesserte Inferenzeffizienz senkt die Kosten für Anbieter und ermöglicht so niedrigere Preise bei gleichbleibenden Margen. Kontinuierliche Hardwareverbesserungen und algorithmische Optimierungen dürften diesen Trend weiter verstärken.

Leistungsfähigere Open-Source-Modelle

Die Leistungslücke zwischen Open-Source- und proprietären Modellen verringert sich kontinuierlich. Heute als Open-Source-Software veröffentlichte Modelle erreichen bereits die Leistung proprietärer Alternativen von vor 12 bis 18 Monaten.

Diese Entwicklung verringert den Leistungsverlust bei der Wahl von Open-Source-Optionen und macht sie somit für mehr Anwendungen praktikabel.

Spezialisierte Kleinmodelle

Aufgabenspezifische kleine Modelle, die für bestimmte Domänen trainiert werden, konkurrieren zunehmend mit universell einsetzbaren großen Modellen bei fokussierten Anwendungen.

Diese spezialisierten Modelle laufen auf kostengünstigerer Hardware mit geringerem Betriebsaufwand und verbessern so die Wirtschaftlichkeit von Open-Source-Software für bestimmte Anwendungsfälle.

Häufige Fehler bei der Kostenschätzung

Organisationen begehen bei der Bewertung der Kosten eines LLM-Studiums regelmäßig vorhersehbare Fehler.

Personalkosten außer Acht lassen

Der häufigste Fehler: die vorhandenen Ingenieurressourcen als “kostenlos” zu betrachten, weil Gehälter bereits budgetiert sind.

Die Implementierung und Wartung von LLM beansprucht einen erheblichen Teil der Entwicklungszeit. Diese Zeit verursacht Opportunitätskosten – die Entwickler, die an der Infrastruktur arbeiten, können nicht gleichzeitig Produktfunktionen entwickeln.

Eine ordnungsgemäße Kostenrechnung umfasst die gesamten Personalkosten, nicht nur die Kosten für zusätzliche Neueinstellungen.

Unterschätzung der Betriebskosten

Die Erstimplementierung erfordert über einen mehrjährigen Lebenszyklus einen Gesamtaufwand von schätzungsweise 20 bis 301 Tsd. Tonnen. Laufende Wartung, Aktualisierungen, Überwachung und Optimierung beanspruchen den größten Teil davon.

Organisationen budgetieren zwar für die Implementierung, unterschätzen aber den dauerhaften Betriebsbedarf, was nach der Markteinführung zu Ressourcenengpässen führt.

Vergleich von Spitzenwert und Durchschnitt

Die anhand der Spitzenlast berechneten API-Kosten erscheinen im Vergleich zu den fixen Infrastrukturkosten überhöht. Die meisten Workloads erreichen jedoch nicht dauerhaft Spitzenlast – die durchschnittliche Auslastung bestimmt die tatsächlichen Kosten.

Die Infrastruktur muss für Spitzenlastzeiten ausgelegt sein und im Normalbetrieb ungenutzte Ressourcen bereitstellen. APIs hingegen berechnen nur die tatsächliche Nutzung und skalieren somit automatisch mit der Nachfrage.

Vernachlässigung von Compliance und Sicherheit

Sicherheitsverbesserungen, Compliance-Audits und regulatorische Anforderungen verursachen erhebliche Mehrkosten bei selbstgehosteten Bereitstellungen.

Organisationen, die keine Erfahrung mit produktiven ML-Systemen haben, unterschätzen diese Kosten regelmäßig um 50-100%.

Häufig gestellte Fragen

Sind Open-Source-LLMs wirklich kostenlos?

Nein. Zwar sind die Modellgewichte lizenzgebührenfrei verfügbar, die Implementierung erfordert jedoch eine umfangreiche Infrastruktur, spezialisierte Ingenieure und laufende Wartung. Die Gesamtbetriebskosten für minimale Implementierungen beginnen bei etwa 125.000 £ jährlich, während Implementierungen in Unternehmen 12 Millionen £ übersteigen.

Ab wann ist Open-Source günstiger als proprietäre APIs?

Die Gewinnschwelle liegt typischerweise zwischen 50 und 200 Millionen Token pro Monat, abhängig von den jeweiligen API-Preisen und Infrastrukturkosten. Anwendungen mit sehr hohem Volumen (über 500 Millionen Token pro Monat) bevorzugen fast immer Self-Hosting, während Anwendungen mit geringerem Volumen in der Regel von nutzungsbasierten APIs profitieren.

Was sind die größten versteckten Kosten von Open-Source-LLM-Programmen?

Die Gehälter der Ingenieure stellen den größten, oft übersehenen Kostenfaktor dar und machen in der Regel 45.000 bis 55.000 Billionen US-Dollar der Gesamtkosten aus. Unternehmen unterschätzen regelmäßig den für Implementierung, Optimierung und laufende Wartung erforderlichen Fachaufwand. Auch die Härtung der Sicherheitsmaßnahmen und die Einhaltung von Compliance-Vorgaben stellen einen häufig unterschätzten Kostenfaktor dar.

Wie viel günstiger sind Open-Source-LLMs im Vergleich zu proprietären Alternativen?

Es hängt vollständig vom Nutzungsvolumen ab. Bei geringen Volumina sind proprietäre APIs deutlich günstiger – potenziell 5- bis 10-mal günstiger, wenn man die gesamten Gesamtbetriebskosten berücksichtigt. Bei sehr hohen Volumina kann selbstgehostete Infrastruktur die Kosten pro Token um 50 bis 801 Tsd. senken. Der Vorteil variiert je nach Umfang, Anpassungsbedarf und verfügbarem Know-how.

Welche technischen Kenntnisse sind für den Betrieb von Open-Source-LLMs erforderlich?

Für den Produktiveinsatz werden ML-Ingenieure zur Modelloptimierung, MLOps-Spezialisten für die Bereitstellungsinfrastruktur, DevOps-Ingenieure für das Systemmanagement und Softwareingenieure für die Integration benötigt. Sicherheitsexpertise ist für Produktionssysteme, die sensible Daten verarbeiten, unerlässlich. Bei kleineren Implementierungen können diese Aufgaben von ein bis zwei Personen übernommen werden, während für Unternehmenslösungen dedizierte Teams erforderlich sind.

Können sich kleine Unternehmen den Einsatz von Open-Source-LLM leisten?

Für die meisten kleinen Unternehmen sind proprietäre APIs wirtschaftlicher, es sei denn, sie haben spezielle Anforderungen wie strengen Datenschutz, umfangreiche Anpassungswünsche oder ein außergewöhnlich hohes Nutzungsvolumen. Die jährlichen Mindestkosten von über 125.000 US-Dollar für das Selbsthosting übersteigen in der Regel die API-Kosten kleiner Unternehmen, bis die Nutzung ein erhebliches Ausmaß erreicht.

Was ist die beste Vorgehensweise für kostenbewusste Organisationen?

Beginnen Sie mit proprietären APIs, um die Produkt-Markt-Passung zu validieren und Nutzungsmuster zu verstehen. Dies minimiert Vorabinvestitionen und technische Komplexität. Ziehen Sie den Einsatz von Open-Source-Software erst in Betracht, wenn ein bestimmtes Volumen erreicht ist und die API-Kosten prohibitiv werden (typischerweise über 1.400.000 USD jährlich). Stellen Sie außerdem sicher, dass die technische Expertise für den effektiven Betrieb einer selbstgehosteten Infrastruktur vorhanden ist.

Fazit: Die richtige wirtschaftliche Entscheidung treffen

Open-Source-LLM-Programme sind nicht kostenlos – sie haben eine grundlegend andere Kostenstruktur, die bestimmte organisatorische Kontexte begünstigt.

Die Gewichtung des “kostenlosen” Modells bedeutet erhebliche Investitionen in Infrastruktur, Personal und Betrieb. Bei geringer bis mittlerer Nutzung bieten proprietäre APIs eine bessere Wirtschaftlichkeit bei deutlich reduzierter Komplexität. Unternehmen zahlen nur für die tatsächliche Nutzung und lagern Bereitstellung, Skalierung und Wartung an Anbieter aus.

Open-Source-Implementierungen sind wirtschaftlich sinnvoll bei hohen Datenmengen, wenn die API-Kosten pro Token unerschwinglich werden, umfangreiche Anpassungen einen tiefen Modellzugriff erfordern oder der Datenschutz eine lokale Verarbeitung notwendig macht. Diese Szenarien rechtfertigen die beträchtlichen Fixkosten und die technische Komplexität.

Die Entscheidung erfordert eine ehrliche Bewertung der tatsächlichen Kosten – einschließlich der oft übersehenen Personalkosten – im Vergleich zu realistischen Nutzungsprognosen. Organisationen mit ausgeprägten Kompetenzen im Bereich Machine Learning und klaren Plänen für eine großflächige Nutzung profitieren von Open-Source-Ansätzen. Für Organisationen mit begrenzter Expertise, moderater Nutzung oder engen Zeitplänen sind APIs in der Regel praktischer.

Am wichtigsten ist, dass Sie verstehen, dass die Frage nicht “Open Source oder proprietär” lautet, sondern “welches Kostenmodell zu unseren Nutzungsbedingungen, Fähigkeiten und Anforderungen passt”. Beantworten Sie diese Frage ehrlich, und die wirtschaftlich optimale Wahl wird deutlich.

Sind Sie bereit, die LLM-Optionen für Ihren konkreten Anwendungsfall zu evaluieren? Berechnen Sie das erwartete Tokenvolumen, bewerten Sie die technischen Möglichkeiten und modellieren Sie beide Kostenstrukturen mit realistischen Annahmen. Die Zahlen werden Ihnen bei Ihrer Entscheidung besser helfen als jede allgemeine Empfehlung.