Resumen rápido: Datadog LLM Observability ofrece monitorización integral para aplicaciones de IA con métricas sobre el uso de tokens, la latencia y las tasas de error, pero su modelo de precios es complejo y se basa en la ingesta de datos. Los equipos pueden esperar que los costes aumenten según el volumen de solicitudes y las necesidades de retención de datos, por lo que es fundamental monitorizar el uso mediante las funciones de gestión de costes de Datadog y configurar alertas para evitar cargos excesivos.

En los últimos dos años, el despliegue de modelos de lenguaje a gran escala se ha disparado. Este auge plantea un nuevo desafío operativo: ¿cómo pueden los equipos supervisar estas cargas de trabajo de IA sin incurrir en gastos excesivos?

Datadog irrumpió en el ámbito de la observabilidad de LLM para abordar precisamente este problema. Su plataforma promete una visibilidad integral del rendimiento del modelo, el uso de tokens y la calidad de la aplicación. Pero aquí está el detalle: comprender el coste real de esta funcionalidad requiere familiarizarse con el complejo modelo de precios de Datadog.

Esta guía desglosa la estructura de costes de Datadog LLM Observability, explica los principales factores que influyen en su precio y proporciona estrategias prácticas para controlar el gasto manteniendo la visibilidad que exigen las aplicaciones de IA modernas.

Comprensión de la estructura de precios de observabilidad de Datadog LLM

Datadog no publica un precio independiente para LLM Observability en su página de precios pública. En cambio, el modelo de costos está directamente vinculado a su infraestructura APM (Application Performance Monitoring), que cobra en función de los intervalos de datos procesados.

Según la documentación oficial de Datadog, LLM Observability genera métricas calculadas a partir de 100% de tráfico de la aplicación. Estas métricas registran el número de spans, el número de errores, el uso de tokens y las medidas de latencia. La métrica ml_obs.span registra el número total de spans con etiquetas para el entorno, el nombre del modelo, el proveedor del modelo, el servicio y el tipo de span.

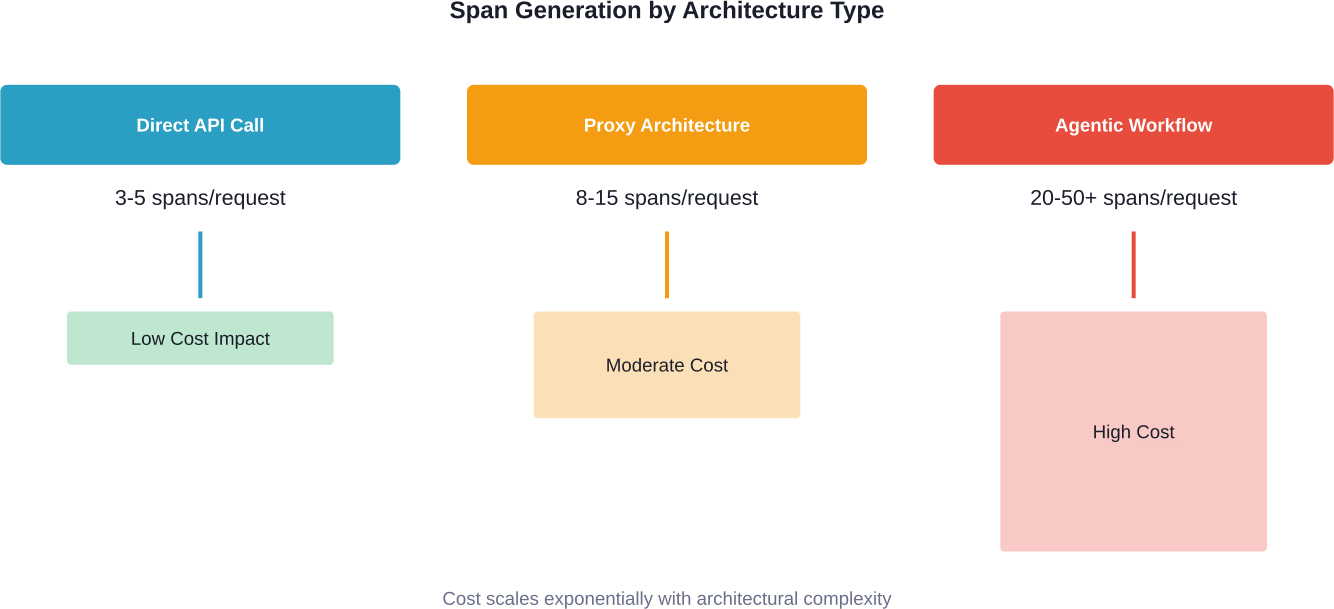

Cada solicitud LLM suele generar múltiples segmentos: uno para la solicitud general y segmentos adicionales para el preprocesamiento, la invocación del modelo, el posprocesamiento y cualquier llamada a herramientas. El volumen de segmentos influye directamente en los costos, ya que el precio de APM de Datadog se ajusta según la cantidad de datos de segmentos ingeridos e indexados.

Componentes básicos de precios

Los equipos que implementan LLM Observability se enfrentan a varios factores que influyen en los costos:

- Volumen de ingesta de tramos basado en el rendimiento de las solicitudes

- Periodos de retención de datos (retención estándar frente a retención extendida)

- Métricas personalizadas derivadas de datos de rastreo

- Supervisión de la infraestructura para los recursos informáticos subyacentes

- Registro de ingesta si se capturan cargas útiles de solicitud/respuesta de LLM.

¿El desafío? En entornos de contenedores o microservicios, los costos pueden aumentar más rápido de lo esperado. Como señaló un análisis, el modelo de precios basado en el host de Datadog "puede parecer obsoleto y abusivo" en entornos de nube dinámicos donde la cantidad de contenedores fluctúa.

¿Qué factores influyen en los costes de observabilidad de LLM?

Comprender los factores que influyen en los costos ayuda a los equipos a presupuestar con precisión e identificar oportunidades de optimización. A continuación, se detallan los elementos clave para el control del gasto en gestión de proyectos legales.

Generación de volumen y tramo de solicitud

Cada llamada a la API de LLM genera trazas. Una simple solicitud de finalización puede generar entre 3 y 5 tramos. ¿Flujos de trabajo complejos con agentes, que incluyen llamadas a herramientas, pasos de recuperación y cadenas de razonamiento? Estos pueden generar fácilmente entre 20 y 50 tramos por solicitud.

Consideremos un equipo que procesa 1 millón de solicitudes LLM al día. Con un promedio conservador de 5 spans por solicitud, esto equivale a 5 millones de spans diarios o 150 millones mensuales. Los costos de ingesta de spans se acumulan rápidamente a esta escala.

Las arquitecturas basadas en proxies añaden una capa adicional. Cuando los equipos enrutan el tráfico LLM a través de pasarelas como LiteLLM o soluciones de proxy personalizadas, cada decisión de enrutamiento, reintento y mecanismo de reserva crea tramos adicionales. Según las directrices de Datadog para la monitorización de proxies de IA, los equipos deben instrumentar las solicitudes de proxy para realizar un seguimiento de la selección del modelo, la latencia, las tasas de error y el uso de tokens.“

Costos generales de seguimiento del uso de tokens

Datadog registra el número de tokens como metadatos de span. Para los equipos que procesan miles de millones de tokens al mes, almacenar estos datos de telemetría supone un coste considerable. La plataforma realiza un seguimiento tanto de los tokens de entrada como de los de salida, además de metadatos sobre el modelo, el proveedor y los parámetros de la solicitud.

Los datos de tokens resultan especialmente valiosos a la hora de optimizar los costes. Los equipos pueden identificar consultas costosas, detectar solicitudes ineficientes o identificar patrones de uso inesperados. Sin embargo, esta visibilidad conlleva el coste de almacenar datos de alta cardinalidad que pueden abarcar millones de solicitudes.

Métricas y paneles personalizados

Además de las métricas estándar, los equipos suelen crear paneles personalizados que agregan datos de rendimiento de LLM. Cada consulta de métrica personalizada, especialmente aquellas con etiquetas de alta cardinalidad, incrementa los costos mensuales.

Las métricas personalizadas más comunes incluyen el costo por sesión de usuario, el promedio de tokens por tipo de consulta, las tasas de error por versión del modelo y los percentiles de latencia por región geográfica. Estas métricas proporcionan información crucial para el negocio, pero requieren una gestión cuidadosa para evitar costos excesivos.

Gestión de costes de Datadog para cargas de trabajo de LLM

Datadog ofrece herramientas diseñadas específicamente para ayudar a los equipos a supervisar y controlar sus gastos en observabilidad. Para las cargas de trabajo LLM, estas funciones resultan esenciales.

La función Datadog Costs, dentro de Cloud Cost Management, ofrece visibilidad sobre el gasto en observabilidad. Según la documentación oficial, los equipos necesitan los permisos billing_read y usage_read para acceder a los desgloses de costos. Solo Cloud Cost Management muestra los costos reales basados en el uso, mientras que la página Plan & Usage muestra estimaciones mensuales prorrateadas.

Configuración de alertas de uso de tokens

Una estrategia práctica para el control de costos consiste en configurar alertas de uso de tokens. Como explica la guía de monitoreo de proxies de Datadog, los equipos pueden establecer una cuota "flexible" que active una notificación al 80% sobre el límite, y una cuota "rígida" para evitar cualquier exceso.“

Este sistema de alerta de dos niveles evita facturas inesperadas. La alerta leve da tiempo a los equipos para investigar los picos de consumo, mientras que el límite estricto detiene el proceso antes de que los costos se disparen.

Estrategias de muestreo de trazas

No es necesario conservar todos los datos. Los equipos pueden implementar un muestreo inteligente para reducir costos y, al mismo tiempo, mantener la significancia estadística para el análisis del rendimiento.

El muestreo basado en la cabeza toma decisiones al inicio del rastreo; por ejemplo, muestrea 10% de todas las solicitudes. El muestreo basado en la cola es más inteligente: conserva todos los rastreos de errores y las solicitudes lentas, pero muestrea solo un porcentaje de las solicitudes rápidas exitosas. Este enfoque preserva los datos de depuración más valiosos a la vez que reduce los costos de almacenamiento.

Datadog admite ambos enfoques mediante controles de ingesta y filtros de retención. La clave está en configurar reglas que se ajusten a las necesidades de depuración del equipo sin tener que pagar por la retención exhaustiva de las solicitudes rutinarias y exitosas.

| Estrategia de muestreo | Datos retenidos | Impacto en los costos | Mejor para |

|---|---|---|---|

| Retención 100% | Todos los rastros | Costo más alto | Aplicaciones de producción críticas, requisitos de cumplimiento |

| Muestreo de cabeza (10%) | Subconjunto aleatorio | reducción 90% | Aplicaciones estables de alto volumen |

| Muestreo de cola | Errores + solicitudes lentas + muestra de normalidad | Reducción de 60-80% | La mayoría de las aplicaciones de LLM de producción |

| Solo errores | Solo solicitudes fallidas | Reducción de 95% | Entornos de desarrollo/preproducción sensibles al costo |

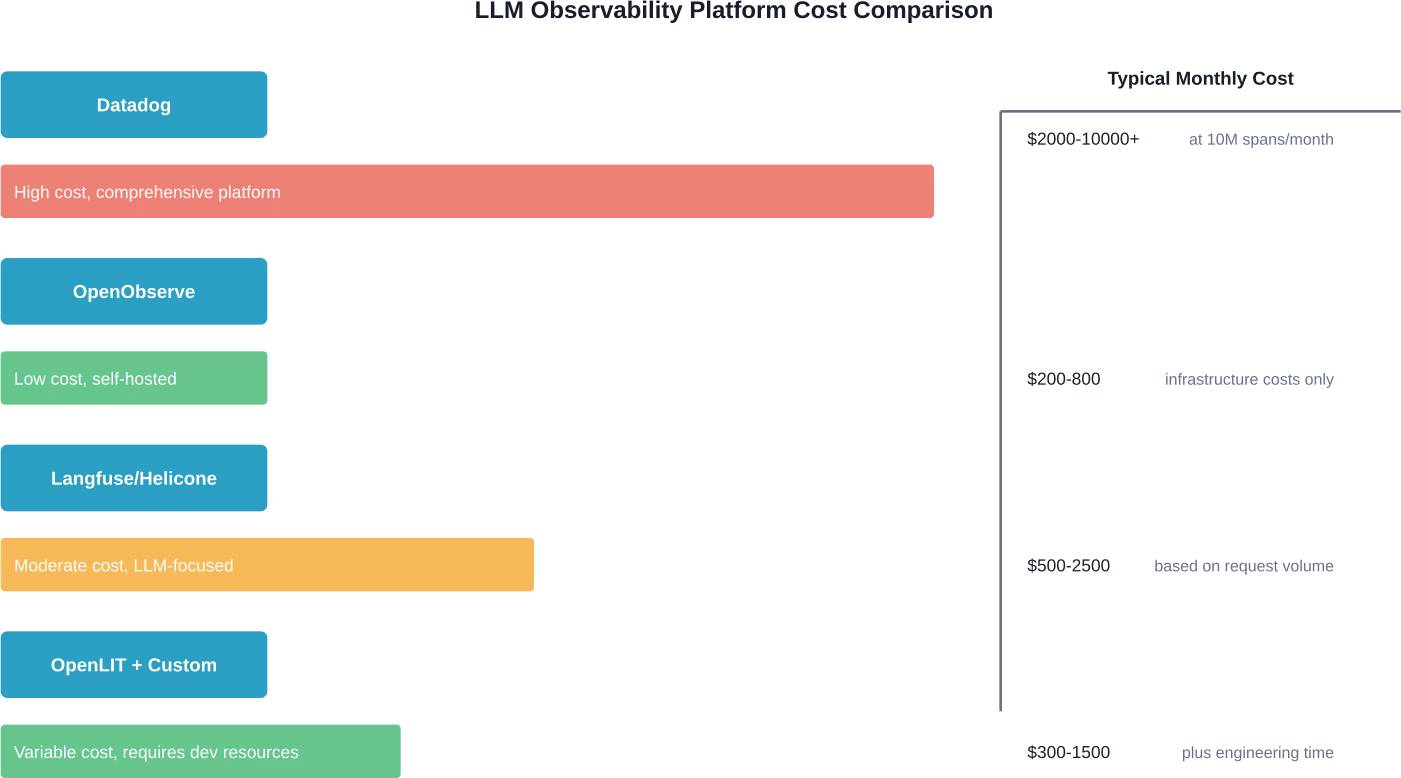

Comparación de los costes de observabilidad de Datadog LLM con otras alternativas

Datadog no es el único proveedor de observabilidad LLM. Comprender el panorama competitivo ayuda a los equipos a evaluar si el precio de Datadog se ajusta a sus necesidades específicas.

Alternativas de código abierto

OpenObserve se describe como "una alternativa rentable a Datadog, Splunk y Elasticsearch, con un coste de almacenamiento 140 veces menor". La plataforma utiliza almacenamiento basado en S3 con una arquitectura sin estado, lo que reduce drásticamente los costes de infraestructura en comparación con el modelo de servicio gestionado de Datadog.

Otras opciones de código abierto incluyen OpenLIT, que proporciona monitorización basada en OpenTelemetry diseñada específicamente para cargas de trabajo LLM. Para los equipos con recursos de ingeniería para gestionar la infraestructura, estas alternativas pueden generar ahorros sustanciales, pero a costa de un mayor gasto operativo.

Plataformas especializadas de LLM

Plataformas como Langfuse, Helicone y Arize ofrecen observabilidad específica para LLM con modelos de precios más sencillos. Muchas cobran en función de las solicitudes rastreadas, en lugar de las métricas de la infraestructura subyacente.

¿La contrapartida? Estas plataformas destacan en la monitorización de LLM, pero carecen de la observabilidad integral de la infraestructura que ofrece Datadog. Los equipos que ya utilizan Datadog para la gestión del rendimiento de aplicaciones (APM) tradicional suelen encontrar valor en consolidar la monitorización de LLM dentro de la misma plataforma, a pesar de los costes potencialmente más elevados.

Soluciones de middleware y proxy

Proyectos como claude_telemetry demuestran un enfoque híbrido: adaptadores ligeros de OpenTelemetry que registran las llamadas a herramientas, el uso de tokens y los costos a diversos sistemas backend, incluido Datadog. La documentación del proyecto claude_telemetry indica que la telemetría se puede enviar a varios sistemas backend, incluido Datadog.

Esta arquitectura desacopla la instrumentación del backend, lo que brinda a los equipos la flexibilidad de cambiar de proveedor si los costos de Datadog se vuelven prohibitivos. El costo de la instrumentación es mínimo (solo la sobrecarga del envoltorio), mientras que los costos del backend aumentan según el modelo de precios del proveedor elegido.

Estrategias prácticas de optimización de costes

Gestionar los costes de observabilidad de Datadog LLM requiere atención constante y decisiones de configuración inteligentes. A continuación, se presentan estrategias que funcionan en entornos de producción.

Optimizar las reglas de enrutamiento del proxy

Al utilizar proxies LLM, las decisiones de enrutamiento impactan directamente en los costos. Una consulta enrutada a GPT-4 cuesta significativamente más que una procesada por GPT-3.5 o un modelo abierto más pequeño.

La guía de monitorización de proxies de Datadog recomienda realizar un seguimiento del rendimiento de la selección de modelos. Si una regla de enrutamiento envía tráfico a un modelo costoso, pero las métricas de calidad no mejoran, “revierta la regla de enrutamiento a un modelo más rápido y económico”. Esta visibilidad a nivel de traza se amortiza sola al evitar el uso innecesario de modelos premium.

Implementar limitación de solicitudes

Los bucles de solicitudes descontroladas o la lógica de reintento ineficiente pueden disparar tanto los costes del proveedor de LLM como los de observabilidad. Los rastreos de Datadog revelan estos patrones mediante el análisis de intervalos.

Los equipos deben configurar la limitación de solicitudes a nivel de proxy, estableciendo límites generosos para el tráfico legítimo, pero también límites estrictos para evitar que el abuso o los errores generen millones de solicitudes innecesarias. Los datos de observabilidad ayudan a calibrar estos límites en función de los patrones de uso reales.

Disciplina de gestión de etiquetas

Las etiquetas de alta cardinalidad aumentan drásticamente los costos de almacenamiento de métricas. Etiquetas como user_id, session_id o request_id en cada segmento crean volúmenes de datos masivos.

Buenas prácticas: utilice identificadores de alta cardinalidad para los rastros (que se pueden buscar en los datos de los intervalos), pero no como etiquetas de métricas. Reserve las etiquetas de métricas para atributos delimitados como model_name, environment, service y error_type. Esto mantiene la capacidad de depuración a la vez que controla la proliferación de métricas.

Captura selectiva de carga útil

La captura de las cargas útiles completas de las solicitudes y respuestas de LLM proporciona un valor de depuración increíble, pero consume una cantidad considerable de almacenamiento de registros. Un solo hilo de conversación puede generar cientos de kilobytes de datos registrados.

Enfoque estratégico: capturar automáticamente las cargas útiles de errores y solicitudes de alta latencia, pero muestrear las solicitudes exitosas a una frecuencia de 1-5%. Los equipos siempre pueden aumentar temporalmente el muestreo al investigar problemas específicos.

Reduzca los costos de observabilidad antes de que se salgan de control.

Las herramientas de observabilidad de LLM, como Datadog, son útiles, pero no solucionan las ineficiencias subyacentes. La mayoría de los costos provienen de cómo se construye, ajusta y despliega el modelo, no solo de cómo se monitorea. IA superior Trabajan en la capa inicial: selección de modelos, preparación de datos, ajuste fino y diseño de la implementación, para evitar sobrecargar posteriormente los flujos de observabilidad. Su trabajo suele abarcar todo el ciclo de vida, desde el manejo de datos hasta la optimización y la configuración de producción.

Si ya estás pensando en los costos de observabilidad, es el momento adecuado para dar un paso atrás y arreglar la arquitectura que la sustenta. Habla con IA superior, Definir qué es lo que realmente se necesita rastrear y construir un sistema que se mantenga predecible en lugar de volverse más costoso con cada consulta.

Escenarios de costos reales

¿Cuánto invierten realmente los equipos en Datadog LLM Observability? Si bien las cifras específicas varían mucho según la escala y la configuración, se observan algunos patrones.

Aplicación para la producción a pequeña escala

Una startup que gestiona 500.000 solicitudes LLM mensuales con una complejidad media (7 tramos por solicitud) genera aproximadamente 3,5 millones de tramos. Con los precios típicos de APM, esto podría costar entre $300 y 600 mensuales para la ingesta y retención de tramos.

Si se añade la monitorización de la infraestructura para entre 10 y 20 contenedores que ejecutan el servicio LLM, la factura mensual asciende a entre 1.800 y 1.200 T. Esto supone una retención estándar y un uso moderado de métricas personalizadas.

Plataforma de IA empresarial

Una gran organización que procesa 50 millones de solicitudes LLM mensuales con flujos de trabajo agemáticos complejos (con un promedio de 25 segmentos por solicitud) genera 1250 millones de segmentos. Este volumen justifica el precio del nivel empresarial de Datadog.

Con tarifas negociadas y un muestreo optimizado (conservando 20% de trazas), los costos podrían oscilar entre $8.000 y 15.000 mensuales solo para la observabilidad de LLM. El gasto total de Datadog, incluyendo la monitorización de la infraestructura, podría superar los $30.000 mensuales.

Desarrollo y puesta en escena

Los equipos suelen instrumentar en exceso los entornos que no son de producción. Un entorno de desarrollo que genera 5 millones de solicitudes mensuales con plena observabilidad podría costar entre 400 y 800 dólares, dinero que se podría invertir mejor en la visibilidad del entorno de producción.

Enfoque recomendado: utilizar un muestreo agresivo (retención de 5-10%) en entornos de desarrollo/preproducción, centrándose en la captura de errores en lugar del rastreo exhaustivo. Esto reduce los costos entre 80 y 90%, manteniendo la capacidad de depuración.

| Tipo de entorno | Solicitudes mensuales | Estrategia de muestreo | Costo mensual estimado |

|---|---|---|---|

| Desarrollo/Pruebas | 5M | 10% + errores | $100-200 |

| Puesta en escena | 10M | 20% + errores | $300-500 |

| Producción (pequeña) | 500K-2M | 50-100% | $800-1500 |

| Producción (media) | 10M-25M | 30-50% | $3000-6000 |

| Producción (empresa) | Más de 50 millones | 20-30% optimizado | $8000-15000+ |

Cuando Datadog tiene sentido a pesar de los costos más elevados

El precio elevado de Datadog no siempre es un factor decisivo. Existen varios escenarios que justifican la inversión.

Las organizaciones que ya utilizan Datadog para la monitorización de infraestructura y APM obtienen un valor significativo al incorporar la observabilidad de LLM. La plataforma unificada elimina la necesidad de cambiar de contexto y correlaciona el rendimiento de LLM con las métricas de la infraestructura subyacente. Cuando la respuesta de un modelo se ralentiza, los equipos pueden comprobar de inmediato la utilización de la GPU, la latencia de la red y el rendimiento de la base de datos, todo en una única interfaz.

Las empresas con requisitos de cumplimiento complejos se benefician de las capacidades de auditoría, los controles de acceso y las funciones de retención de datos de Datadog. Las alternativas de código abierto a menudo carecen de las herramientas de gobernanza necesarias en los sectores regulados.

Los equipos que no cuentan con recursos dedicados a la ingeniería de plataformas encuentran valor en el servicio gestionado de Datadog. La alternativa —desplegar y mantener una infraestructura de observabilidad de código abierto— requiere una inversión continua en ingeniería que puede superar el costo de la suscripción a Datadog.

Preguntas frecuentes

¿Cuánto cuesta realmente Datadog LLM Observability al mes?

Datadog no publica precios para LLM Observability de forma independiente. Los costos dependen del volumen de ingesta de spans, que varía según el rendimiento de las solicitudes y la complejidad de la aplicación. Las aplicaciones pequeñas pueden gastar entre 300 y 800 TP4T mensuales, mientras que las implementaciones empresariales suelen superar los 8000-15 000 TP4T. El precio se ajusta según las tasas de ingesta de spans de APM y las necesidades de monitoreo de la infraestructura.

¿Puedo usar Datadog LLM Observability sin pagar por la versión completa de APM?

No. LLM Observability se basa en la infraestructura APM de Datadog y requiere una suscripción activa a APM. El modelo de precios basado en intervalos implica que los rastreos de LLM se contabilizan dentro del consumo total de intervalos de APM. Los equipos necesitan tanto APM como los componentes de monitorización de la infraestructura que dan soporte a la aplicación.

¿Cuál es la forma más económica de controlar los costes de LLM en la producción?

Para el seguimiento básico de costes, las soluciones sencillas como los contadores de tokens en el código de la aplicación o el registro simple de solicitudes en S3 prácticamente no tienen coste. Para una observabilidad integral, las plataformas de código abierto como OpenLIT u OpenObserve ofrecen los costes de infraestructura más bajos, pero requieren tiempo de ingeniería para su implementación y mantenimiento. Las alternativas gestionadas, como Langfuse, ofrecen precios intermedios centrados específicamente en cargas de trabajo LLM.

¿Datadog cobra aparte por los datos de uso de tokens?

El recuento de tokens se almacena como metadatos de span y no genera cargos adicionales más allá de los costos de ingesta de span subyacentes. Sin embargo, la creación de métricas personalizadas basadas en el uso de tokens (como recuentos agregados de tokens por usuario o tipo de consulta) sí genera costos adicionales. Los equipos deben supervisar el uso de métricas personalizadas para evitar cargos inesperados.

¿Cómo puedo estimar los costos de Datadog LLM Observability antes de su implementación?

Calcula el volumen mensual de solicitudes previsto, estima los intervalos por solicitud (3-5 para llamadas sencillas, 20-50 para agentes complejos) y multiplica para obtener el total de intervalos. Compara esto con los niveles de precios de APM de Datadog. Añade los costes de monitorización de la infraestructura para los recursos informáticos que ejecutan la aplicación LLM. Incorpora un margen de 20-30% para el crecimiento y los patrones de uso inesperados.

¿Existen diferencias de costes entre los distintos proveedores de servicios de monitorización de LLM?

El precio de Datadog no varía según el proveedor de LLM que se esté monitorizando (OpenAI, Anthropic, etc.). Los costes dependen exclusivamente del volumen de datos de observabilidad: intervalos, métricas y registros generados por la infraestructura de monitorización. Sin embargo, los distintos proveedores pueden tener características de respuesta diferentes que afectan a la complejidad del rastreo y a las necesidades de almacenamiento.

¿Qué ocurre si supero mi presupuesto de Datadog a mediados de mes?

Datadog normalmente no interrumpe el servicio a mitad de mes, pero sí factura por el consumo excesivo. Los equipos deben configurar alertas de uso mediante las funciones de Gestión de Costos y establecer alertas de cuota de tokens para evitar gastos descontrolados. El sistema de cuotas flexible/rígida recomendado por Datadog proporciona avisos antes de alcanzar los límites y puede bloquear las solicitudes que superen el presupuesto.

Tomar la decisión correcta para su equipo

Datadog LLM Observability ofrece una visibilidad profunda del rendimiento de las aplicaciones de IA, la economía de los tokens y las métricas de calidad. Para los equipos que ya utilizan el ecosistema de Datadog, la incorporación del monitoreo de LLM crea una estrategia de observabilidad unificada.

Sin embargo, el modelo de costos requiere una gestión cuidadosa. El volumen de solicitudes aumenta rápidamente con el rendimiento y la complejidad de la arquitectura. Sin estrategias de muestreo rigurosas, gestión de etiquetas y monitoreo del uso, las facturas pueden crecer más rápido que el valor entregado.

En última instancia, la decisión se reduce a tres factores: la inversión existente en Datadog, los recursos de ingeniería disponibles para alternativas y la importancia crítica de la observabilidad unificada en toda la infraestructura y las cargas de trabajo de IA.

Para equipos empresariales con implementaciones complejas, el precio premium de Datadog suele resultar rentable. Para equipos más pequeños o aquellos con sólidas capacidades de ingeniería de plataformas, las alternativas de código abierto ofrecen una visibilidad comparable a una fracción del costo.

Sea cual sea el camino que resulte más sensato, la clave reside en tratar los costes de observabilidad como una cuestión de primer orden: monitorizarlos, optimizarlos y justificarlos por la información operativa que proporcionan.

¿Listo para comenzar con la monitorización de LLM? Consulta la documentación oficial de Datadog para conocer las funciones disponibles y contacta con su equipo de ventas para obtener precios que se ajusten a la escala y los requisitos específicos de tu implementación.