Resumen rápido: Los servicios de evaluación de másteres en derecho (LLM) privados suelen costar entre 1.249 y más de 1.000 TPM mensuales para plataformas, mientras que los proyectos de evaluación personalizados oscilan entre 125.000 y 820.000 TPM anuales, según la envergadura. Los costes dependen del tamaño del modelo, los requisitos de infraestructura, la experiencia del equipo y la complejidad de la implementación. Existen herramientas de evaluación de código abierto, pero los gastos operativos de alojamiento, personal y mantenimiento suelen superar las cuotas de suscripción de la plataforma.

La prisa por implementar modelos de lenguaje privados de gran tamaño ha generado una dolorosa constatación para muchas organizaciones: construir el modelo es solo el principio. ¿Evaluar si realmente funciona? Ahí es donde las cosas se complican.

A diferencia de los modelos basados en API públicas, donde la evaluación se puede realizar mediante simples pruebas comparativas, los modelos LLM privados requieren pruebas rigurosas y continuas que tengan en cuenta los datos propietarios, los casos de uso personalizados y los requisitos de seguridad empresarial. La infraestructura de evaluación por sí sola puede igualar o incluso superar los costos de alojamiento de los propios modelos.

He aquí la incómoda verdad: las empresas subestiman sistemáticamente los costes de evaluación entre un 40 % y un 60 %. Presupuestan hardware e ingenieros, pero se olvidan de la infraestructura de pruebas continuas, los especialistas en pruebas de penetración y la carga operativa de mantener procesos de evaluación que se ejecutan miles de veces al mes.

Este desglose abarca los precios de la plataforma, los gastos de infraestructura, los costes de personal y el gasto operativo oculto que convierte la evaluación de código abierto "asequible" en un compromiso anual de seis cifras.

Comprender la evaluación de los programas de LLM privados: ¿Qué es lo que realmente está pagando?

La evaluación de un máster privado en Derecho (LLM) no consiste simplemente en aplicar un conjunto de pruebas comparativas a un modelo y darlo por terminado. Es un proceso continuo que abarca múltiples dimensiones.

El proceso de evaluación abarca pruebas de precisión, análisis de vulnerabilidades de seguridad, optimización del rendimiento, detección de sesgos y validación del cumplimiento normativo. Cada dimensión requiere herramientas, conjuntos de datos y conocimientos especializados diferentes. Algunas organizaciones intentan integrar soluciones de código abierto. Otras adquieren plataformas. La mayoría termina optando por una solución híbrida que resulta más costosa que cualquiera de los enfoques por separado.

Los componentes clave que impulsan los costos

La infraestructura de evaluación se divide en varios centros de costos. Las suscripciones a la plataforma o las tarifas de licencia constituyen la base visible. Los costos de infraestructura para ejecutar evaluaciones a gran escala añaden otro nivel. Además, está el gasto en talento: ingenieros de aprendizaje automático, especialistas en evaluación y expertos en el dominio que diseñan las pruebas e interpretan los resultados.

No olvide el costo de los datos. Los conjuntos de datos de evaluación personalizados, ya sean licenciados a proveedores o creados internamente, representan una inversión significativa. Según el Centro de Estándares e Innovación de IA (CAISI) del NIST, la creación de sistemas de IA de máxima calidad requiere una ciencia de medición de IA de máxima calidad, y esta no es barata.

¿La pieza final? Los costos generales de integración y mantenimiento. Los procesos de evaluación deben conectarse con los flujos de trabajo de MLOps, los sistemas de control de versiones y las plataformas de monitoreo existentes. Este trabajo de integración rara vez aparece en las estimaciones de costos iniciales, pero consume sistemáticamente entre 20 y 301 TP3T de los presupuestos de evaluación.

Servicios de evaluación basados en plataformas: Referencias de precios

Las plataformas de evaluación gestionadas ofrecen la vía más rápida para realizar pruebas exhaustivas. Sin embargo, los precios varían enormemente en función de las funciones, la escala y el posicionamiento del proveedor.

Según los datos disponibles de 2025-2026, así es como se ve el mercado:

| Nivel de plataforma | Costo mensual | Características principales | Mejor para |

|---|---|---|---|

| Entrada (por ejemplo, Braintrust Pro) | $249 | Rastreo ilimitado, 5 GB de datos procesados, 50 000 puntuaciones | Equipos pequeños, productos en fase inicial |

| Nivel medio | $1,500-$3,500 | Análisis avanzado, puntos de referencia personalizados, colaboración en equipo | Productos en crecimiento con tráfico moderado |

| Empresa | $5,000-$10,000+ | Implementación local, soporte dedicado, escalabilidad ilimitada. | Grandes organizaciones, industrias reguladas |

| Personalizado/Marca blanca | $15,000+ | Personalización completa, infraestructura dedicada, garantías de nivel de servicio (SLA). | Empresas Fortune 500, agencias gubernamentales |

Los datos de la estructura de precios de Braintrust muestran que, según la propia plataforma, los clientes reportan mejoras en la precisión de 30% o más en tan solo unas semanas tras su adopción. Este nivel de mejora en el rendimiento justifica el coste de la plataforma, si la alternativa es implementar funciones de IA defectuosas en producción.

Giskard ofrece opciones tanto de código abierto como empresariales. La biblioteca de código abierto es gratuita, pero requiere alojamiento propio y conocimientos técnicos. Su plataforma empresarial proporciona pruebas de penetración de IA continuas y evaluación RAG con infraestructura gestionada, aunque los precios específicos no se divulgan públicamente.

Qué cubren realmente las tarifas de la plataforma

Las suscripciones a la plataforma suelen incluir el marco de evaluación en sí, conjuntos de pruebas comparativas preconfigurados, alojamiento para la ejecución de pruebas, paneles de análisis de resultados y cierto nivel de soporte.

¿Qué no cubren? Los costos de computación para ejecutar sus modelos durante la evaluación. La creación de conjuntos de datos personalizados. El tiempo de ingeniería necesario para integrar la plataforma en su flujo de trabajo. La capacitación de su equipo para usarla eficazmente.

Muchas plataformas cobran en función del volumen de datos procesados o de las ejecuciones de evaluación. El plan básico de $249/mes parece razonable hasta que procesas 100 GB de datos de evaluación al mes y de repente necesitas el plan empresarial.

Costos de infraestructura para la evaluación autogestionada

Algunos equipos optan por crear una infraestructura de evaluación utilizando herramientas de código abierto como Lighteval o las bibliotecas de evaluación de Hugging Face. El software es gratuito. Todo lo demás cuesta dinero.

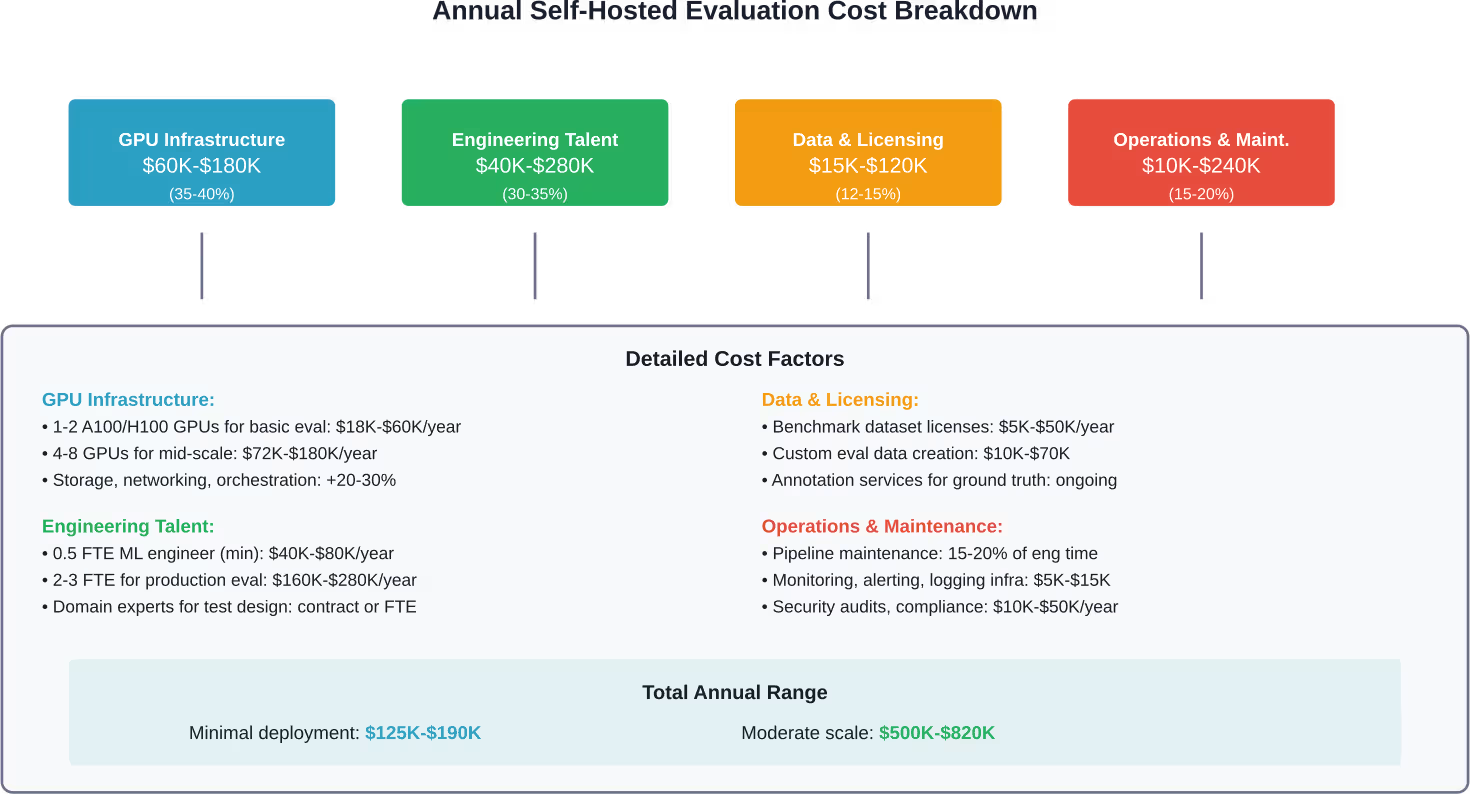

Incluso una implementación interna mínima puede costar entre 125.000 y 190.000 TPG anuales. Esto para una configuración a pequeña escala destinada a usos internos. ¿Funciones de evaluación de tamaño moderado orientadas al cliente? Calcule entre 500.000 y 820.000 TPG anuales, siendo conservadores.

Esto es lo que impulsa esas cifras:

Requisitos de GPU y computación

Realizar evaluaciones implica ejecutar repetidamente modelos con conjuntos de datos de prueba. Para un modelo de 7 a 13 mil millones de parámetros, una sola GPU A100 o H100 gestiona las cargas de trabajo básicas de evaluación. El costo mensual de las GPU en la nube para este nivel oscila entre 1500 y 5000 T.

¿Escalar a modelos de 30B a 70B? Ahora el requisito aumenta a 4-8 GPU, y los costos mensuales activos alcanzan los $6000-$15000. La infraestructura de evaluación puede igualar fácilmente los costos de alojamiento de producción.

Según datos de la competencia de 2025, las implementaciones de nivel básico con modelos de 7B a 13B en una sola GPU cuestan aproximadamente entre 1.500 y 1.500 millones de yuanes mensuales. Las implementaciones de nivel medio con modelos más grandes en 4 a 8 GPU oscilan entre 1.600 y 1.500 millones de yuanes mensuales. Las implementaciones empresariales con los modelos más grandes pueden superar los 30.000 millones de yuanes mensuales solo para computación.

Pero aquí está el problema: la evaluación no se ejecuta de forma continua como la producción. Se ejecuta en ráfagas. Esto genera ineficiencia. Los equipos o bien sobredimensionan los recursos y desperdician dinero en GPU inactivas, o bien los subdimensionan y crean cuellos de botella que ralentizan los ciclos de desarrollo.

El impuesto al talento que nadie menciona

Las herramientas de código abierto no se configuran solas. Requieren ingenieros cualificados que comprendan tanto los marcos de evaluación como el dominio específico que se está probando.

Incluso los modelos preentrenados necesitan expertos. Alguien debe diseñar protocolos de evaluación, seleccionar puntos de referencia adecuados, interpretar los resultados y traducir los hallazgos en mejoras prácticas. Esto requiere experiencia en aprendizaje automático combinada con conocimiento del dominio, una combinación que se traduce en un salario anual de entre 14.000 y 150.000 dólares para profesionales experimentados.

Los equipos pequeños podrían destinar inicialmente 0,5 FTE (equivalente a tiempo completo) al trabajo de evaluación. Esto representa un costo total de entre 1.400 y 1.400.000 dólares (salario, beneficios y gastos generales). Las implementaciones de escala moderada requieren de 2 a 3 ingenieros dedicados, lo que eleva los costos de personal a entre 1.400 y 1.400.000 dólares anuales.

Los debates en la comunidad ponen de manifiesto esta deficiencia repetidamente. Los equipos dan por sentado que simplemente “utilizarán la biblioteca de evaluación de código abierto” sin presupuestar la experiencia necesaria para usarla eficazmente. Seis meses después, o bien contratan especialistas o bien abandonan por completo sus esfuerzos de evaluación.

Impacto del tamaño y la complejidad del modelo en los costos de evaluación

La relación entre el tamaño del modelo y el coste de evaluación no es lineal. En el peor de los casos, es exponencial.

Los modelos pequeños (de 1 a 3 mil millones de parámetros) se ejecutan rápidamente en los conjuntos de evaluación. Una prueba exhaustiva puede tardar de minutos a horas. Los modelos grandes (de 30 a 70 mil millones de parámetros) pueden tardar días para la misma profundidad de evaluación. Las arquitecturas de mezcla de expertos (MoE) añaden otra capa de complejidad.

Según las investigaciones sobre los sistemas MoE, estos modelos poseen un gran número de parámetros —algunos alcanzan los 1.571 mil millones—, pero solo activan entre 1 y 25% durante el procesamiento de tokens. Esta escasa activación plantea dificultades en la evaluación. Es posible que los puntos de referencia estándar no evalúen adecuadamente todas las rutas de los expertos, lo que requiere protocolos de evaluación personalizados.

Recuento de parámetros frente a complejidad de la evaluación

Así es como la escala del modelo se traduce en costos de evaluación:

| Tamaño del modelo | Parámetros típicos | VRAM (4 bits) | Tiempo de evaluación por prueba | Costo de evaluación mensual |

|---|---|---|---|---|

| Pequeño | 1-3B | ~2 GB | Minutos | $200-$800 |

| Medio | 7-13B | 6-8 GB | Horas | $800-$2,500 |

| Grande | 30-70B | 20-40 GB | Horas a días | $3,000-$8,000 |

| Extra grande | 100 mil millones o más | Más de 60 GB | Días | $10,000+ |

Estas estimaciones parten de la base de una cadencia de evaluación regular (pruebas exhaustivas semanales más pruebas de humo diarias). Los equipos que practican la evaluación continua con cada cambio de código verán multiplicarse los costos.

Las arquitecturas especializadas requieren pruebas especializadas.

Los modelos de transformadores estándar cuentan con protocolos de evaluación bien establecidos. Las arquitecturas más recientes, como los modelos MoE, los modelos de espacio de estados o los sistemas híbridos, requieren enfoques de prueba personalizados.

Esta personalización tiene un coste. Los equipos deben construir la infraestructura de pruebas por sí mismos (tiempo de ingeniería) o contratar servicios de evaluación especializados. En cualquier caso, el coste adicional de una arquitectura compleja supone un incremento de entre 30 y 501 TP3T respecto a los costes de evaluación base.

Costes ocultos: Datos, integración y gastos generales operativos

Los gastos no se limitan a las plataformas y la infraestructura. Varias categorías de costos pasan desapercibidas hasta que llegan las facturas.

Costos del conjunto de datos de evaluación

Las pruebas de rendimiento públicas como HumanEval (164 problemas de codificación) o MBPP son útiles para evaluar capacidades generales. Sin embargo, las pruebas de rendimiento privadas suelen estar orientadas a ámbitos específicos: análisis jurídico, diagnóstico médico, modelización financiera y atención al cliente.

Los parámetros de referencia genéricos no son suficientes. Las organizaciones necesitan conjuntos de datos de evaluación personalizados que reflejen sus casos de uso reales, la distribución de sus datos y los casos extremos. La creación de estos conjuntos de datos requiere esfuerzo interno o servicios externos.

Los costos de creación de conjuntos de datos internos incluyen el tiempo de expertos en la materia (a menudo entre 150 y 300 TP/hora para dominios especializados), el trabajo de anotación, el control de calidad y el mantenimiento del conjunto de datos a medida que los productos evolucionan. Un conjunto de datos de evaluación personalizado de tamaño moderado (entre 5000 y 10 000 ejemplos) suele costar entre 20 000 y 50 000 TP para su creación y entre 5000 y 15 000 TP anuales para su mantenimiento.

La obtención de licencias para conjuntos de datos de referencia comerciales supone un gasto adicional. Los conjuntos de datos especializados (legales, médicos, financieros) pueden costar entre 10.000 y 100.000 dólares o más, dependiendo del tamaño, la calidad y las condiciones de la licencia.

Gastos de integración y orquestación

La evaluación no existe de forma aislada. Debe integrarse con sistemas de control de versiones, pipelines de CI/CD, registros de modelos, plataformas de seguimiento de experimentos y monitorización de la producción.

La creación de estas integraciones consume una cantidad considerable de tiempo de ingeniería. Una integración básica entre una plataforma de evaluación y la infraestructura MLOps existente suele requerir entre 80 y 200 horas de desarrollo y pruebas. A un coste de entre 150 y 250 TP/hora para el talento de ingeniería de aprendizaje automático, esto supone entre 12 000 y 50 000 TP/hora por integración.

Multiplique eso por las múltiples herramientas de la pila. Luego, añada el mantenimiento continuo a medida que cambian las API y evolucionan los requisitos. La sobrecarga de integración alcanza fácilmente entre 15 y 251 TP3T del costo total de evaluación.

Auditoría de cumplimiento y seguridad

Los bufetes de abogados privados suelen procesar datos confidenciales. Los proveedores de atención médica manejan información médica protegida. Las instituciones financieras procesan información personal identificable y datos de transacciones. Las agencias gubernamentales gestionan información clasificada.

La infraestructura de evaluación debe cumplir con los mismos estándares de seguridad y cumplimiento que los sistemas de producción. Esto implica auditorías de seguridad, pruebas de penetración, documentación de cumplimiento y, posiblemente, infraestructura dedicada con implementación aislada de la red.

Las auditorías de seguridad para sistemas de IA oscilan entre $25K para evaluaciones básicas y más de $200K para evaluaciones exhaustivas de implementaciones complejas. El monitoreo continuo del cumplimiento añade entre $10K y $50K anuales, según los requisitos regulatorios.

Plataforma frente a alojamiento propio: comparación del coste total de propiedad

La decisión de construir o comprar infraestructura para la evaluación implica más que comparar las tarifas de suscripción de la plataforma con los costos de la infraestructura.

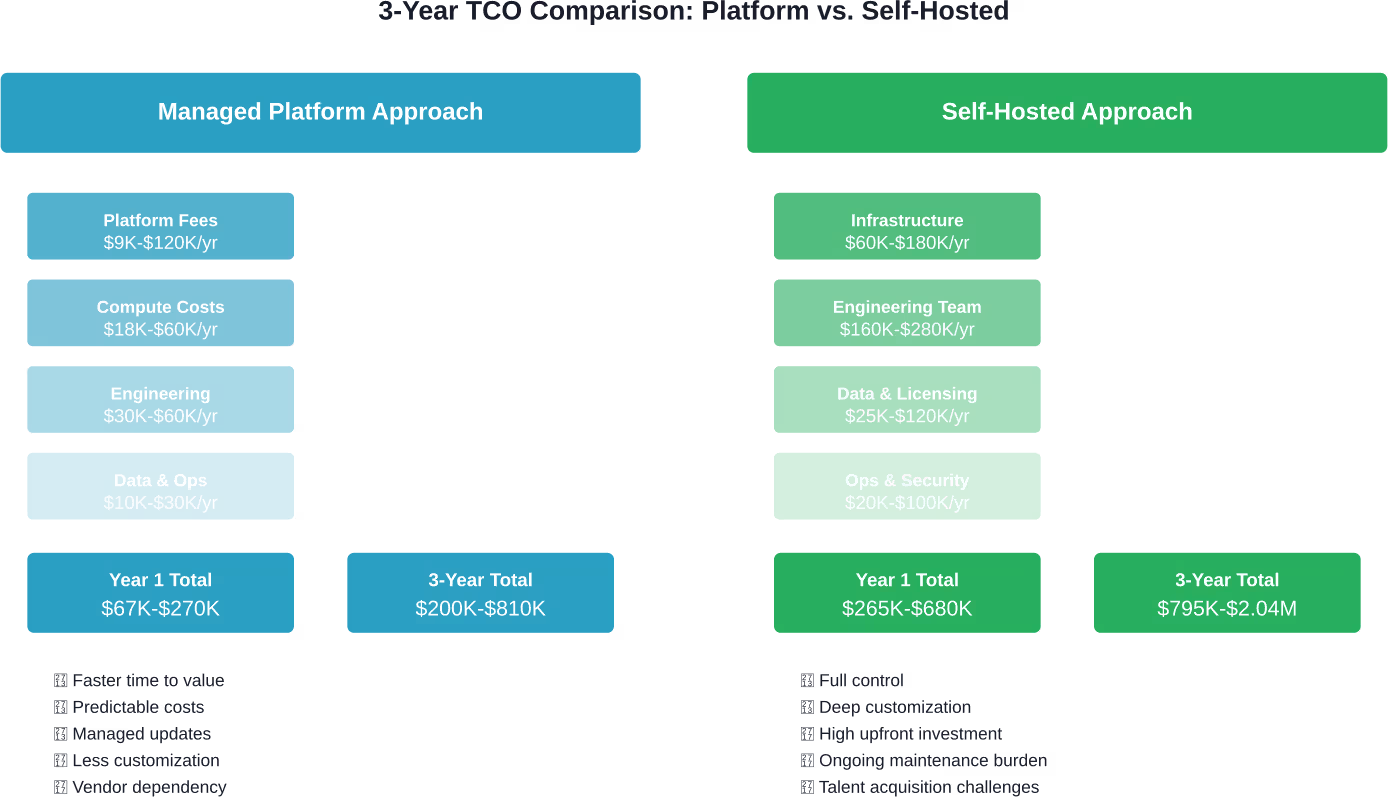

El costo total de propiedad (CTP) incluye los costos directos (plataformas, computación, licencias), los costos de talento (ingeniería, operaciones, experiencia especializada), los costos de oportunidad (tiempo para obtener valor, velocidad de las funciones) y los costos de riesgo (brechas de evaluación que conducen a fallas en la producción).

El enfoque de plataforma gestionada muestra menores costos en el primer año ($67K-$270K frente a $265K-$680K) y un costo total de propiedad (TCO) significativamente menor a tres años ($200K-$810K frente a $795K-$2.04M). El enfoque de autoalojamiento requiere una inversión de 3 a 4 veces mayor para una funcionalidad comparable.

Pero esas cifras solo cuentan una parte de la historia. Las plataformas ofrecen una obtención de valor más rápida, a menudo en semanas en lugar de meses. Las soluciones autogestionadas ofrecen una mayor personalización para organizaciones con requisitos únicos que las plataformas no pueden cubrir.

Cuándo las suscripciones a plataformas tienen sentido

Las plataformas gestionadas son la mejor opción para equipos que necesitan capacidades de evaluación integrales con rapidez, que tienen poca experiencia interna en infraestructura de aprendizaje automático, que desean costes operativos predecibles o que operan a una escala pequeña o moderada donde las limitaciones de la plataforma no son restrictivas.

El marco económico para evaluar los modelos de lenguaje sugiere centrarse en las métricas de coste de aprobación: cuánto cuesta obtener un resultado correcto. Las plataformas destacan en este aspecto para la mayoría de las organizaciones, ya que reducen los costes de ingeniería necesarios para lograr resultados de evaluación fiables.

Cuando el autoalojamiento se vuelve necesario

La infraestructura autogestionada tiene sentido cuando los requisitos de evaluación superan las capacidades de la plataforma, la confidencialidad de los datos impide el uso de servicios externos, el volumen de evaluación haría que las tarifas de la plataforma fueran prohibitivamente caras, o se requiere una personalización profunda para arquitecturas o protocolos de evaluación propietarios.

Las organizaciones de sectores regulados (sanidad, finanzas, gobierno) a menudo no tienen otra opción. Los requisitos de gobernanza de datos exigen la implementación en las instalaciones o en la nube privada, con control total sobre los flujos de datos y los patrones de acceso.

Estrategias de optimización de costos para la evaluación de programas de maestría en derecho (LLM)

Independientemente de si se opta por una plataforma o por un alojamiento propio, existen varias estrategias que reducen los costes de evaluación sin sacrificar la calidad.

Enfoques de evaluación por niveles

No todos los cambios de código requieren una evaluación completa. Implementa una estrategia de pruebas por niveles: pruebas rápidas de humo en cada commit (minutos, coste mínimo), evaluación de profundidad media en las solicitudes de extracción (horas, coste moderado) y evaluación exhaustiva en los candidatos a lanzamiento (días, coste total).

Este enfoque reduce los costos de computación entre 60 y 701 TP3T en comparación con la realización de una evaluación exhaustiva de cada cambio, al tiempo que detecta la mayoría de los problemas en una etapa temprana, cuando es más económico solucionarlos.

Selección eficiente de puntos de referencia

Un estudio sobre los principales conjuntos de datos de referencia para modelos de lenguaje identifica 283 conjuntos de datos representativos, lo que demuestra el enfoque integral del sector para la evaluación de estos modelos. En lugar de ejecutar todos los conjuntos de datos disponibles, se recomienda identificar los 8 o 10 más relevantes para casos de uso específicos. Es importante validar la selección de subconjuntos trimestralmente para garantizar una cobertura adecuada a medida que los modelos evolucionan.

Estrategias de evaluación híbridas

Combine los servicios de la plataforma para pruebas de capacidades estándar con evaluaciones personalizadas autogestionadas para requisitos específicos del dominio. Las plataformas manejan la carga de trabajo de evaluación estándar de manera eficiente. La infraestructura interna aborda las necesidades especializadas de 20% que las plataformas no pueden cubrir.

Este enfoque híbrido suele costar entre 30 y 40 TP3T menos que el autoalojamiento puro, manteniendo al mismo tiempo la personalización necesaria.

Optimización de recursos informáticos

Las cargas de trabajo de evaluación presentan picos y valles. Las instancias spot y las máquinas virtuales preemptivas pueden reducir los costos de GPU en la nube entre un 60 % y un 80 % para cargas de trabajo de evaluación que toleran interrupciones y reinicios.

Para equipos con un volumen de evaluación constante, las instancias reservadas ofrecen descuentos de entre 40 y 501 TP3T en comparación con los precios bajo demanda. El riesgo de compromiso disminuye a medida que la evaluación se integra de forma permanente en los flujos de trabajo de desarrollo, en lugar de ser una actividad ocasional.

Haga que la evaluación del LLM valga la pena, no que sea un gasto más.

La evaluación privada de modelos LLM puede resultar costosa rápidamente, especialmente cuando las pruebas no guardan relación con la forma en que el modelo se construye y se utiliza realmente. IA superior Abordan la evaluación como parte integral del ciclo de vida del modelo, no como una capa de servicio independiente. Su trabajo incluye la creación y el ajuste de modelos, la configuración de pipelines de validación y la alineación de la evaluación con casos de uso reales. Esto ayuda a evitar pruebas excesivas, reduce la redundancia de puntos de referencia y mantiene la evaluación vinculada al rendimiento que realmente importa en producción.

La mayoría de los costos de evaluación aumentan cuando las pruebas se repiten sin mejorar el sistema en sí. Cuando la evaluación se integra en el desarrollo y la implementación, se obtienen menos ciclos y resultados más claros. Si desea convertir la evaluación en algo que realmente mejore su modelo en lugar de solo medirlo, contáctenos. IA superior y examine con más detalle cómo está estructurada su configuración actual.

Ejemplos y estudios de casos reales sobre precios.

Los rangos de costos abstractos se vuelven más claros con escenarios concretos.

Equipo pequeño: Chatbot interno

Una startup de 15 personas desarrolla un chatbot para la base de conocimientos interna utilizando un modelo de parámetros 7B optimizado. Las necesidades de evaluación incluyen pruebas de precisión en consultas específicas de la empresa, comprobaciones de seguridad y monitorización del rendimiento.

Enfoque: Plataforma Braintrust Pro ($249/mes, precio confirmado) más creación de un conjunto de datos de evaluación personalizado ($15K estimación única) más 0,25 FTE de tiempo de ingeniería ($40K/año estimación).

Coste total del primer año: $58K. Coste anual recurrente: $43K.

Empresa mediana: IA de atención al cliente

Una empresa de software como servicio (SaaS) con 200 empleados implementa un modelo de 13 mil millones de parámetros para la automatización del servicio al cliente. Los requisitos de evaluación incluyen precisión, adecuación del tono, detección de alucinaciones y pruebas A/B con respecto a modelos de referencia.

Enfoque: Plataforma de nivel medio ($2,500/mes) más recursos GPU moderados para pruebas especializadas autohospedadas ($4K/mes) más conjunto de datos de dominio personalizado ($35K) más 1.5 especialistas FTE ($180K/año).

Coste total del primer año: $293K. Coste anual recurrente: $258K.

Empresa: Implementación en la industria regulada

Una empresa de servicios financieros con 5000 empleados desarrolla un modelo de parámetros 30B para asistencia en investigación de inversiones. Los requisitos regulatorios exigen la implementación local, registros de auditoría exhaustivos y validación por terceros.

Enfoque: Infraestructura autogestionada en hardware dedicado (costos de GPU de $180K/año) más un equipo de 3 FTE ($450K/año) más conjuntos de datos y licencias comerciales ($80K/año) más auditorías de seguridad ($50K/año) más servicios de validación externa ($40K/año).

Coste total del primer año: $800K. Coste anual recurrente: $800K (más mejoras importantes de infraestructura cada 3 años).

Estos escenarios ilustran cómo los costos aumentan en función del tamaño de la organización, la complejidad del modelo y los requisitos normativos. El ejemplo de la gran empresa cuesta 14 veces más que el del equipo pequeño, pero atiende a 333 veces más usuarios en un entorno altamente regulado.

La economía oculta de la evaluación de código abierto “gratuita”

Las herramientas de evaluación de LLM de código abierto ofrecen una promesa tentadora: cero costes de licencia de software. La realidad resulta ser más costosa.

El problema no reside en las herramientas en sí. Lighteval, las bibliotecas de evaluación de Hugging Face y marcos de trabajo similares funcionan bien. El desafío radica en todo lo que las rodea: la infraestructura para ejecutarlas, la experiencia para utilizarlas eficazmente, el mantenimiento para mantenerlas actualizadas y la integración para que sean útiles.

Los debates en la comunidad ponen de manifiesto esta deficiencia. Los equipos dan por sentado que el código abierto es gratuito. Descubren lo contrario cuando, tras seis meses de proyecto con 150.000 dólares invertidos en tiempo de ingeniería, siguen teniendo dificultades para obtener resultados de evaluación fiables.

Este es el patrón: descargar un marco de evaluación de código abierto (gratuito), dedicar 2 semanas a descifrar la documentación (costo de ingeniería), dedicar 1 mes a construir la infraestructura (costo de ingeniería + nube), dedicar 2 meses a depurar problemas de integración (costo de ingeniería) y dedicar un esfuerzo continuo al mantenimiento a medida que evolucionan los marcos (costo de ingeniería permanente).

Ese marco de trabajo “gratuito” costó entre 1.400.000 y 1.400.000 dólares en el primer año. Para muchas organizaciones, pagar entre 1.400.000 y 1.400.000 dólares por una plataforma gestionada habría proporcionado mejores resultados más rápidamente y a un menor coste total.

Cuando el software de código abierto realmente ahorra dinero

Las herramientas de evaluación de código abierto tienen sentido económico en escenarios específicos: cuando los equipos ya cuentan con experiencia interna en infraestructura de aprendizaje automático, los requisitos de evaluación son altamente especializados y las plataformas no pueden satisfacerlos, el volumen de evaluaciones haría que las tarifas de la plataforma fueran extremadamente costosas, o las organizaciones tienen compromisos ideológicos o estratégicos con pilas de tecnología de código abierto.

Pero incluso en esos casos, la economía operativa es importante. La estructura de costos cambia, pasando de las tarifas de la plataforma al talento y la infraestructura, pero el gasto total rara vez disminuye tanto como sugiere el análisis inicial.

Tendencias de precios y predicciones de costos futuros

El mercado de evaluación de másteres en derecho (LLM) aún es inmaduro y los precios son volátiles. Diversas tendencias configuran la evolución futura de los costes.

La creciente competencia hace bajar los precios de las plataformas.

Cada mes, más proveedores se suman al mercado de plataformas de evaluación. La competencia suele reducir los precios y aumentar las funcionalidades. El plan básico de $249/mes, vigente desde 2025, podría bajar a $149/mes para 2027, incluyendo funcionalidades que antes requerían planes empresariales.

Las investigaciones sobre las métricas de coste de ejecución demuestran que el coste de ejecución en la frontera de la tecnología ha disminuido con el tiempo gracias a los nuevos lanzamientos de modelos, y los análisis económicos revelan que los modelos ligeros son los más rentables para las tareas básicas. Es probable que los servicios de evaluación sigan una dinámica de precios similar.

Los costes de infraestructura siguen siendo difíciles de alcanzar.

Los costes de las GPU no han disminuido significativamente a pesar de las predicciones de años anteriores. Los proveedores de servicios en la nube mantienen altos márgenes en las instancias de GPU. El oligopolio de los hiperescaladores impide una competencia de precios agresiva.

No espere reducciones significativas en los costos de infraestructura para la evaluación autogestionada a corto plazo. Las mejoras en la eficiencia gracias a un mejor software podrían compensar entre 10 y 151 TP3T de costos de computación, pero la economía del hardware sigue siendo un desafío.

La especialización crea niveles de precios premium.

Las plataformas de evaluación genéricas se estandarizarán y ofrecerán precios competitivos. Los servicios especializados para industrias reguladas, la evaluación específica de dominios o las capacidades avanzadas como las pruebas adversarias mantendrán precios premium.

Se prevé una segmentación del mercado: plataformas de productos básicos a $200-$500/mes, plataformas profesionales a $2K-$5K/mes y servicios especializados a $10K+/mes o precios personalizados para proyectos.

Preguntas frecuentes

¿Cuál es el coste medio de los servicios privados de evaluación de másteres en derecho (LLM)?

Los servicios de evaluación basados en plataformas suelen tener precios que oscilan entre 1 TP4T249/mes para planes básicos y más de 1 TP4T10 000/mes para implementaciones empresariales. La infraestructura de evaluación autogestionada cuesta entre 1 TP4T125 000 y 1 TP4T190 000 anuales para implementaciones mínimas y entre 1 TP4T500 000 y 1 TP4T820 000 anuales para sistemas de producción de escala moderada. Los costos totales dependen del tamaño del modelo, la frecuencia de evaluación, la experiencia del equipo y las opciones de infraestructura.

¿Las herramientas de evaluación de LLM de código abierto son realmente gratuitas?

El software en sí es gratuito, pero los costos operativos son considerables. Incluso las implementaciones mínimas autogestionadas con herramientas de código abierto cuestan más de 1.040.000 dólares anuales si se tienen en cuenta la infraestructura, el personal de ingeniería, las licencias de datos y el mantenimiento. Las organizaciones deben presupuestar recursos de GPU, experiencia en ingeniería de aprendizaje automático, creación de conjuntos de datos y gastos operativos continuos. El software "gratuito" suele tener un costo total de propiedad mayor que las plataformas de pago.

¿Cuánto cuesta evaluar un modelo de parámetros 70B?

La evaluación de modelos de 70 mil millones de parámetros suele requerir de 4 a 8 GPU de gama alta y cuesta entre 3000 y 8000 TP4T mensuales solo en recursos de computación. A esto hay que añadir las tarifas de la plataforma (entre 2500 y 5000 TP4T mensuales) o el personal de ingeniería para la infraestructura autogestionada (de 2 a 3 FTE con un coste anual de entre 300 000 y 450 000 TP4T), además de los conjuntos de datos personalizados (entre 35 000 y 70 000 TP4T) y el mantenimiento continuo. El coste total del primer año para una evaluación integral de modelos de 70 mil millones oscila entre 150 000 y 400 000 TP4T, dependiendo de la profundidad y la frecuencia de la evaluación.

¿Qué factores influyen de forma más significativa en los costes de evaluación de los másteres en Derecho (LLM)?

El tamaño y la arquitectura del modelo son los factores que más influyen en las variaciones de costos. Los modelos más grandes requieren más GPU y tiempos de evaluación más prolongados. La frecuencia y la profundidad de la evaluación también son cruciales: la evaluación continua cuesta entre 5 y 10 veces más que las pruebas semanales. La experiencia del equipo afecta los costos, ya que los evaluadores experimentados trabajan de manera más eficiente y eligen mejor las herramientas. Las decisiones sobre la infraestructura (plataforma frente a autoalojamiento) generan diferencias de costo de 3 a 4 veces para capacidades comparables.

¿Resulta más económico utilizar plataformas de evaluación o construir una infraestructura personalizada?

Las plataformas resultan más económicas para la mayoría de las organizaciones. El costo total de propiedad (TCO) de una plataforma a tres años oscila entre 200.000 y 810.000 dólares, en comparación con los 795.000 a 2,04 millones de dólares de una infraestructura autogestionada con capacidades similares. Las plataformas ofrecen una obtención de valor más rápida y requieren menos conocimientos especializados. La infraestructura autogestionada solo resulta económicamente viable cuando el volumen de evaluaciones supera los límites de la plataforma, la gobernanza de datos impide el uso de servicios externos o existen requisitos de evaluación altamente especializados que las plataformas no pueden satisfacer.

¿Cómo pueden las organizaciones reducir los costes de evaluación de los másteres en Derecho (LLM) sin sacrificar la calidad?

Implemente estrategias de evaluación escalonadas con pruebas rápidas de humo en cada cambio y pruebas exhaustivas solo en las versiones, reduciendo los costos de computación en 60-70%. Seleccione subconjuntos de referencia eficientes en lugar de ejecutar conjuntos de pruebas exhaustivos. Utilice enfoques híbridos que combinen servicios de plataforma para pruebas estándar con evaluación autohospedada dirigida para necesidades especializadas. Optimice los recursos de computación mediante instancias spot (ahorro de 60-80%) o instancias reservadas (ahorro de 40-50%) para cargas de trabajo consistentes. Centre el esfuerzo de ingeniería en la evaluación personalizada de alto valor en lugar de reconstruir capacidades estándar.

¿Los costes de evaluación aumentan linealmente con el tamaño del modelo?

No, los costos de evaluación aumentan de forma superlineal. Evaluar un modelo de 70 mil millones de parámetros no cuesta el doble que evaluar uno de 35 mil millones; normalmente cuesta entre 3 y 5 veces más debido a los mayores requisitos de GPU, los tiempos de evaluación más prolongados y la complejidad de la infraestructura. Los modelos muy grandes (más de 100 mil millones de parámetros) requieren infraestructura y técnicas especializadas que incrementan los costos. La relación entre parámetros y costo se acelera en lugar de seguir una progresión lineal.

Tomar decisiones económicas

El coste de los servicios privados de evaluación de másteres en derecho (LLM) varía en dos órdenes de magnitud según el enfoque, la escala y los requisitos. Los equipos pequeños pueden empezar con soluciones de plataforma por menos de 1400 £ a 5000 £ anuales. Las grandes empresas con necesidades especializadas podrían gastar más de 1400 £ a 1 millón de £ anuales en una infraestructura de evaluación integral.

La decisión económica depende de tres factores: la profundidad y frecuencia de evaluación requeridas, la experiencia interna disponible y la importancia estratégica de las capacidades de evaluación.

Para la mayoría de las organizaciones, las plataformas gestionadas ofrecen la mejor relación calidad-precio. Una menor inversión inicial, una obtención de valor más rápida y costes predecibles compensan las ventajas de flexibilidad de la infraestructura autogestionada. ¿La excepción? Organizaciones con requisitos realmente únicos, un volumen de evaluación masivo o restricciones normativas que impiden el uso de servicios externos.

Pero aquí está la clave: los costos de evaluación deben compararse con los costos de los fallos. Implementar una función de IA defectuosa en producción puede destruir la confianza del cliente, generar riesgos regulatorios o dañar la reputación de la marca. Estos costos son mucho mayores que los gastos de evaluación.

La cuestión no es si invertir en evaluación, sino cuánto es suficiente para el perfil de riesgo. Un chatbot de atención al cliente podría justificar una inversión anual de $50K en evaluación. Un asistente de diagnóstico médico podría necesitar $500K. Un sistema de toma de decisiones para vehículos autónomos podría requerir $5M+.

Adapte la inversión en evaluación a la gravedad de las consecuencias. Ahorrar en evaluación hoy suele generar gastos exponencialmente mayores mañana cuando se producen fallos en la producción.

¿Listo para implementar una evaluación rigurosa de LLM? Comience por evaluar el nivel actual de madurez de la evaluación, identificar las brechas entre las capacidades actuales y las requeridas, y calcular el costo real de los fallos de evaluación en casos de uso específicos. Este análisis aclara la decisión entre plataforma y autoalojamiento, y justifica la inversión necesaria ante las partes interesadas.