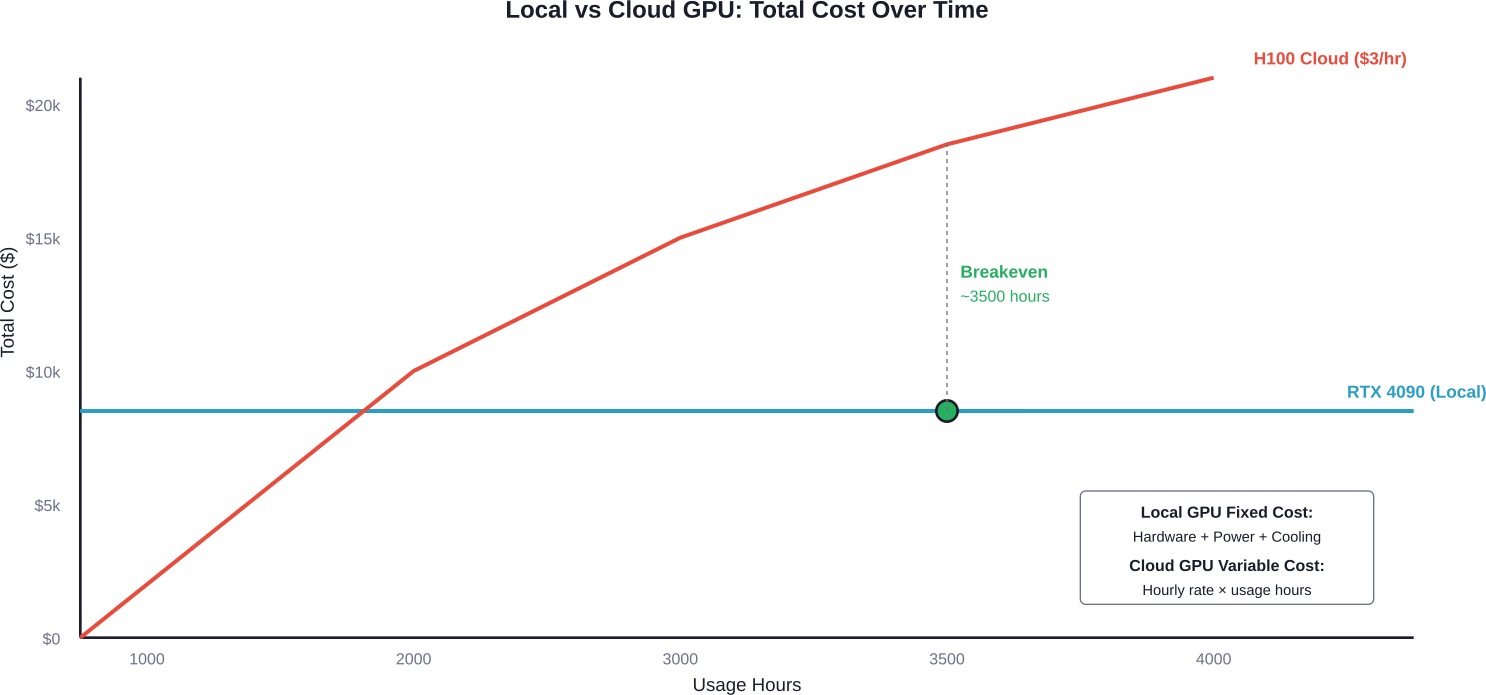

Resumen rápido: En 2026, las GPU rentables para la formación en LLM incluyen NVIDIA RTX 4090 y L4 para configuraciones locales, mientras que las opciones en la nube, como H100 y la asignación fraccionada de GPU, ofrecen precios flexibles. La elección óptima depende del tamaño del programa, el presupuesto y si se opta por la compra o el alquiler; el punto de equilibrio se sitúa en torno a las 3500 horas para la propiedad frente al alquiler en la nube.

La elección del hardware para la formación en LLM ahora determina si los proyectos se terminan a tiempo o si se agotan los presupuestos antes de su implementación. A medida que los modelos superan los 70 mil millones de parámetros, los equipos se enfrentan a un mercado donde una sola elección errónea de GPU puede costar semanas de tiempo de computación desperdiciado o miles de dólares en capacidad sobredimensionada.

Sin embargo, la rentabilidad no se limita al precio de venta. Se trata de adaptar los requisitos de la carga de trabajo a las capacidades del hardware, evitando tanto cuellos de botella por falta de potencia como sobrecostes innecesarios.

Comprender los requisitos de GPU para la formación en LLM

El entrenamiento de modelos de lenguaje complejos requiere características de hardware específicas que van más allá de los videojuegos o las cargas de trabajo de aprendizaje automático tradicionales. La capacidad de memoria establece el límite inferior de lo que los modelos pueden ejecutar.

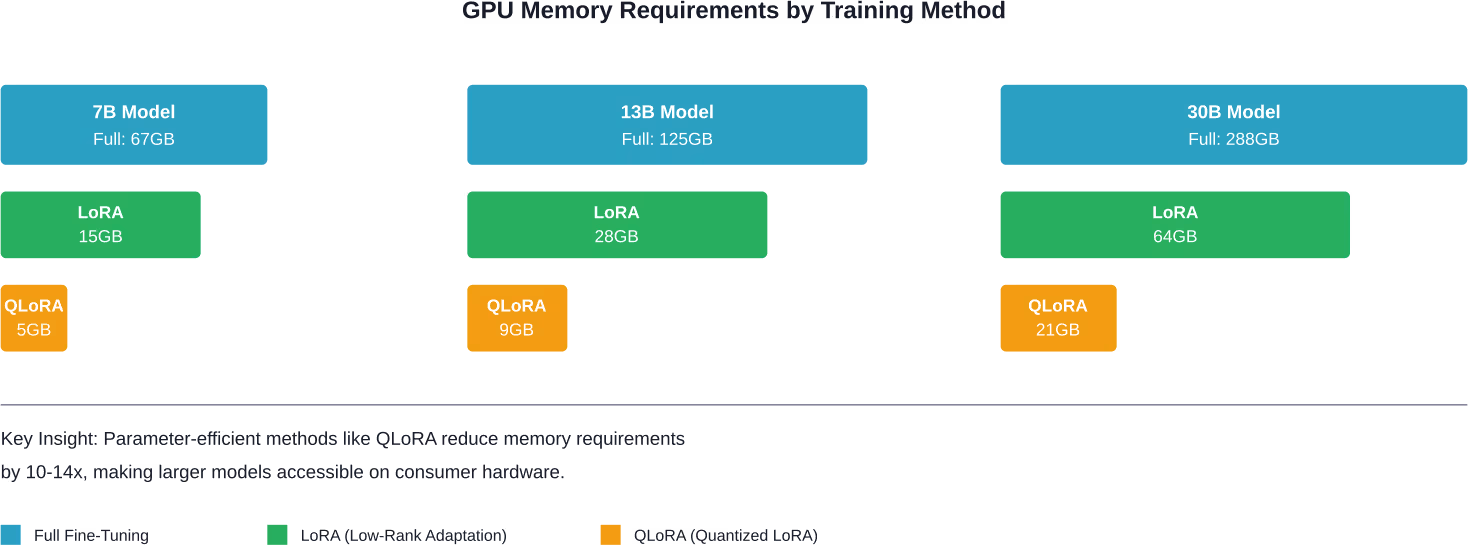

El ajuste fino completo suele requerir alrededor de 16 GB de VRAM por cada mil millones de parámetros. Un modelo de 7 mil millones de parámetros necesita aproximadamente 67 GB para un entrenamiento completo, mientras que un modelo de 13 mil millones aumenta a 125 GB, y los modelos de 30 mil millones requieren 288 GB.

Pero un momento. Esas cifras presuponen un ajuste fino completo. Los métodos que optimizan los parámetros cambian el cálculo por completo.

| Tamaño del modelo | Ajuste fino completo | LoRA | QLoRA (4 bits) | Solo inferencia |

|---|---|---|---|---|

| Parámetros 7B | 67 GB | 15 GB | 5 GB | 14 GB |

| Parámetros 13B | 125 GB | 28 GB | 9 GB | 26 GB |

| Parámetros 30B | 288 GB | 64 GB | 21 GB | 60 GB |

El ancho de banda de la memoria controla la velocidad de entrenamiento. A pesar de consumir toda su potencia, las GPU durante el preentrenamiento estándar de LLM suelen operar con tasas de utilización subóptimas de entre 30% y 50%, según una investigación de Mindbeam AI. El cuello de botella suele residir en la rapidez con la que la GPU puede acceder a los pesos y gradientes del modelo, no en la capacidad de cálculo bruta.

Los núcleos tensoriales proporcionan otro multiplicador de rendimiento fundamental. Las arquitecturas modernas de NVIDIA incluyen hardware especializado para operaciones matriciales, de las que dependen en gran medida los modelos de transformadores.

Opciones de GPU locales: cuando la propiedad tiene sentido.

Comprar hardware tiene sentido desde el punto de vista financiero cuando las cargas de trabajo de entrenamiento se ejecutan de forma continua. Los datos de punto de equilibrio muestran que la compra de una RTX 4090 solo iguala los costos de alquiler de una A100 después de aproximadamente 3500 horas de uso activo.

Eso equivale aproximadamente a 146 días de funcionamiento ininterrumpido. Para los equipos que realizan investigación continua o capacitación regular en producción, la responsabilidad resulta rentable. Para proyectos intermitentes, no.

NVIDIA RTX 4090: La tarjeta gráfica económica ideal para cualquier trabajo.

La RTX 4090 ofrece 24 GB de VRAM a un precio aproximado de $1600-$1800 por tarjeta. Según informes de la comunidad, los tiempos de entrenamiento de YOLOv8 se han reducido de 38 horas a 9 horas al pasar de un hardware inadecuado a la RTX 4090.

Veinticuatro gigabytes son suficientes para la mayoría de los modelos 7B con optimización LoRA. QLoRA puede alcanzar los 13B con una sola tarjeta. Para modelos de 30B o más, se requieren configuraciones multi-GPU.

La 4090 carece de compatibilidad con NVLink, lo que limita la eficiencia de escalado multi-GPU en comparación con las tarjetas para centros de datos. El ancho de banda entre las GPU se basa en PCIe, lo que genera cuellos de botella para los modelos que no caben en la memoria de una sola GPU.

NVIDIA L4: La apuesta por la eficiencia

La GPU L4 está diseñada principalmente para inferencia, pero sus características de eficiencia la hacen relevante para ciertos escenarios de entrenamiento. Con un menor consumo de energía que las GPU de entrenamiento de gama alta, la L4 reduce los costos operativos en implementaciones en la nube.

Los proveedores de servicios en la nube ofrecen instancias L4 a precios considerablemente inferiores a las opciones A100 o H100. Para modelos más pequeños o métodos de entrenamiento con parámetros eficientes, la instancia L4 proporciona un rendimiento adecuado a un precio más económico.

Configuraciones multi-GPU para modelos grandes

El entrenamiento local de modelos con 70 mil millones de parámetros requiere matrices de GPU sustanciales. Según una discusión en los foros de Hugging Face de abril de 2025, un modelo de 70 mil millones requiere aproximadamente 280 GB de VRAM solo para los pesos del modelo, con memoria adicional para gradientes y activaciones.

La RTX 4070 Ti SUPER tiene 16 GB de VRAM, mientras que la RTX 5070 Ti (arquitectura Blackwell) también tiene 16 GB de GDDR7, pero su precio de venta recomendado es de $749 (el precio real en 2026 suele ser más alto, de $900 o más). Además, construir un clúster de 18 GPU de consumo (serie RTX) en un solo sistema es técnicamente inviable debido a las limitaciones de las líneas PCIe, la alimentación, la refrigeración y la placa base. El número máximo realista en un sistema de consumo sin expansores dedicados de grado servidor suele ser de 4 a 8 tarjetas.

En serio: la mayoría de los equipos que trabajan con modelos de más de 70 mil millones de dólares deberían evaluar seriamente las opciones en la nube antes de comprometerse con compilaciones locales masivas.

Alquiler de GPU en la nube: Acceso flexible al hardware del centro de datos

Los proveedores de servicios en la nube ofrecen acceso a la gama de GPU para centros de datos de NVIDIA sin necesidad de inversión inicial. Las GPU H100 y H200 ofrecen 80 GB de memoria HBM3 con un ancho de banda muy superior al de las tarjetas para consumidores.

Los precios varían considerablemente entre los proveedores. Según el documento "Beyond Benchmarks: The Economics of AI Inference", el coste horario base del A800 80G es de aproximadamente $0,79/hora, y generalmente se sitúa en el rango de $0,51 a $0,99/hora, dependiendo del proveedor y el compromiso.

Nubes de hiperescaladores frente a nubes de GPU especializadas

Las principales plataformas en la nube ofrecen instancias con GPU de alta disponibilidad, pero a precios elevados. Los proveedores especializados en GPU en la nube suelen ofrecer precios significativamente más bajos que los grandes proveedores de servicios en la nube, al tiempo que ofrecen el mismo hardware.

La clave está en la integración del ecosistema. Los proveedores de servicios en la nube a gran escala combinan las GPU con una amplia gama de servicios complementarios: bases de datos gestionadas, almacenamiento de objetos, redes y gestión de identidades. Los proveedores especializados se centran exclusivamente en el acceso a la computación.

Para los equipos que ya utilizan los ecosistemas de AWS, Azure o GCP, permanecer en la misma plataforma suele ser conveniente a pesar de los mayores costos de las GPU. Para cargas de trabajo que priorizan las GPU y tienen dependencias mínimas, los proveedores especializados ofrecen una mejor relación costo-beneficio.

| Tipo de proveedor | Control | Disponibilidad bajo demanda | Precio | Mejor para |

|---|---|---|---|---|

| Hiperescalador | Alto | Medio | De primera calidad | Integración empresarial |

| Nube especializada | Medio | Alto | Competitivo | Cargas de trabajo exclusivamente de GPU |

| Spot/Preemptivo | Bajo | Variable | Más bajo | Trabajos tolerantes a fallos |

H100 y H200: Los centros de datos insignia actuales

Las GPU NVIDIA H100 representan el estándar actual para el entrenamiento de modelos lineales a gran escala. Con 80 GB de memoria HBM3 y núcleos tensoriales especializados, estas tarjetas manejan incluso modelos masivos de manera eficiente.

La H200 amplía la memoria a 141 GB HBM3e, lo que permite modelos aún más grandes o lotes de producción de mayor tamaño. Para arquitecturas con una combinación de expertos, como el modelo Mistral Large 3 con un total de 675B parámetros, tal como se detalla en el anuncio de NVIDIA de diciembre de 2025, esta memoria adicional resulta de gran importancia.

Los costos suelen oscilar entre $2 y 4 por hora, dependiendo del proveedor, el compromiso y la región. Con 3500 horas de uso (el punto de equilibrio para la propiedad de la RTX 4090), los costos de alquiler de la H100 ascenderían a entre $7000 y $14000.

Ese precio solo tiene sentido cuando las necesidades de hardware superan lo que es económicamente viable, cuando las cargas de trabajo son intermitentes o cuando el rendimiento de vanguardia justifica el precio superior.

Asignación fraccionada de GPU

Las recientes innovaciones en la planificación de GPU permiten que múltiples cargas de trabajo compartan una única GPU de manera eficiente. NVIDIA Run:ai aborda este problema mediante la asignación fraccionada dinámica, que mejora el rendimiento de tokens a la vez que reduce la capacidad inactiva.

Según las pruebas de rendimiento conjuntas realizadas por NVIDIA y Nebius y publicadas el 18 de febrero de 2026, la fragmentación de la GPU puede mejorar sustancialmente la utilización de recursos para cargas de trabajo LLM, alcanzando un rendimiento total de GPU de 77% con fracciones de GPU de 0,5. Según las pruebas de rendimiento de NVIDIA Run:ai con Nebius (febrero de 2026), modelos pequeños como Phi-4-Mini, con 3.800 millones de parámetros que requieren aproximadamente 8 GB de memoria, pueden compartir eficazmente las GPU con otras cargas de trabajo.

Este enfoque funciona mejor al ejecutar varios modelos pequeños o cargas de trabajo mixtas de inferencia y entrenamiento. Para ejecuciones de entrenamiento grandes e individuales, el acceso dedicado a la GPU sigue proporcionando un rendimiento óptimo.

Hardware emergente: ¿Qué nos depara el futuro?

NVIDIA anunció la plataforma Rubin el 5 de enero de 2026, prometiendo una reducción de hasta 10 veces en el costo de los tokens de inferencia y una reducción de 4 veces en la cantidad de GPU necesarias para el entrenamiento. La plataforma incluye NVLink de sexta generación, que ofrece un ancho de banda de 3,6 TB/s por GPU.

Las GPU Blackwell, situadas entre la actual H200 y la futura Rubin, ofrecen un enorme salto de rendimiento en la capacidad de procesamiento de inferencias. Según el anuncio de NVIDIA del 2 de abril de 2025, Blackwell está optimizada para las crecientes demandas de computación de las cargas de trabajo de razonamiento de IA.

NVIDIA Dynamo 1.0 entró en producción el 16 de marzo de 2026, proporcionando software de código abierto para inferencia generativa y agencial a gran escala. Según el anuncio de NVIDIA, Dynamo aumenta el rendimiento de inferencia de la GPU Blackwell hasta siete veces.

Pero aquí está el problema: todo este hardware de última generación tendrá precios elevados en su lanzamiento. Los primeros usuarios pagarán por un rendimiento de vanguardia. Los equipos que buscan optimizar costos deberían evaluar si las GPU de la generación actual cumplen con los requisitos antes de optar por los chips más recientes.

Estrategias de optimización que reducen los requisitos de la GPU

La selección del hardware es solo una parte de la ecuación. La metodología de entrenamiento determina el consumo real de recursos.

Ajuste fino con parámetros eficientes

Las técnicas LoRA y QLoRA reducen los requisitos de memoria entre 4 y 14 veces en comparación con el ajuste fino completo. En lugar de actualizar todos los pesos del modelo, estos métodos entrenan pequeñas capas adaptadoras mientras mantienen el modelo base sin cambios.

Un modelo 13B que requiere 125 GB para una optimización completa se reduce a tan solo 9 GB con QLoRA de 4 bits. Esa es la diferencia entre necesitar ocho GPU o una sola.

Existen compromisos en el rendimiento: los métodos que optimizan los parámetros no siempre ofrecen la misma calidad que un ajuste fino completo. Sin embargo, para muchas aplicaciones, la diferencia es insignificante en comparación con el ahorro de costes.

Puntos de control de gradiente y precisión mixta

El método de puntos de control de gradiente prioriza la memoria sobre el cálculo, recalculando las activaciones intermedias durante la retropropagación en lugar de almacenarlas. Esto reduce aproximadamente a la mitad los requisitos de memoria, a costa de un tiempo de entrenamiento entre 20 y 301 TP3T mayor.

El entrenamiento de precisión mixta utiliza números de coma flotante de 16 bits para la mayoría de las operaciones, mientras que mantiene los cálculos críticos en 32 bits. Los núcleos tensoriales modernos aceleran las operaciones de 16 bits, lo que a menudo hace que la precisión mixta sea más rápida y más eficiente en cuanto al uso de memoria que el entrenamiento de 32 bits puro.

Descarga de tensores y almacenamiento GPUDirect

Una investigación publicada el 6 de junio de 2025 en arXiv presentó TERAIO, un método de entrenamiento LLM rentable que utiliza la descarga de tensores con conciencia del ciclo de vida a través de GPUDirect Storage. Según la investigación de TERAIO, los tensores activos consumen solo una pequeña fracción (1,7% en promedio) de la memoria GPU asignada en cada iteración de entrenamiento LLM. El sistema permite la migración directa de tensores entre GPU y SSD, lo que reduce los cuellos de botella de la CPU y maximiza la utilización del ancho de banda de la SSD.

Esta arquitectura permite entrenar modelos más grandes con menos GPU mediante el intercambio inteligente de tensores entre la memoria de la GPU y el almacenamiento NVMe de alta velocidad. La penalización de rendimiento derivada del acceso al almacenamiento se minimiza mediante la precarga predictiva.

Marco de cálculo de costos

Para determinar la rentabilidad real, es necesario calcular el coste total de propiedad, no solo los precios de venta.

Componentes locales de TCO de GPU

El precio de compra del hardware representa el costo obvio, pero los gastos operativos se acumulan:

- Consumo de energía: La RTX 4090 tiene una potencia nominal de aproximadamente 450 W a plena carga. Con las tarifas eléctricas típicas de EE. UU., de alrededor de 1 TP4T0,12/kWh, el funcionamiento continuo costaría aproximadamente 1 TP4T0,05 por hora o 1 TP4T438 por año.

- Requisitos de refrigeración: Las GPU de alto rendimiento generan una cantidad considerable de calor, lo que requiere un flujo de aire adecuado o refrigeración líquida.

- Infraestructura de soporte: Placa base, CPU, RAM, almacenamiento, fuente de alimentación, carcasa.

- Mantenimiento y posible reemplazo: Las GPU para consumidores carecen de garantías empresariales y acaban fallando.

Un sistema completo basado en una RTX 4090 suele costar entre 1.000 y 1.000 millones de dólares en total. Amortizado a lo largo de tres años, incluyendo los costes de electricidad, eso supone aproximadamente 1.000 millones de dólares anuales, más la electricidad.

Componentes de TCO de GPU en la nube

La facturación en la nube parece sencilla: tarifa por hora multiplicada por horas de uso. Los costes ocultos surgen en:

- Transferencia de datos: Traslado de conjuntos de datos de entrenamiento y puntos de control del modelo hacia/desde el almacenamiento en la nube.

- Costes de almacenamiento: Discos persistentes para conjuntos de datos y salidas intermedias.

- Tiempo de inactividad: Olvidar cerrar las instancias una vez finalizado el entrenamiento.

- Salida de red: Descarga de modelos entrenados para su implementación en otros entornos.

Presupuesta entre 10 y 20% adicionales, más allá de los costos horarios base de la GPU, para estos gastos auxiliares.

Marco de decisión: Local, en la nube o híbrido

La estrategia óptima depende de los patrones de uso y de los requisitos de escala.

Seleccione GPU locales cuando:

- La formación se imparte de forma continua (más de 3.500 horas anuales).

- Los tamaños de los modelos se ajustan cómodamente a las limitaciones de memoria de las GPU para consumidores.

- Los requisitos de residencia o seguridad de los datos impiden el uso de la nube.

- Existe presupuesto para gastos de capital iniciales.

Elija las GPU en la nube cuando:

- El entrenamiento es intermitente o experimental.

- El tamaño de los modelos excede las configuraciones locales prácticas.

- La demanda máxima varía significativamente con el tiempo.

- El acceso al hardware más reciente importa más que la economía a largo plazo.

Los enfoques híbridos son una buena opción para muchos equipos. Desarrollar y probar en hardware local, y luego escalar a recursos en la nube para realizar entrenamientos completos. Esto maximiza la utilización del hardware propio, accediendo a las GPU del centro de datos solo cuando es necesario.

Compartición de GPU e implementaciones multiusuario

Una investigación publicada el 6 de mayo de 2025 en arXiv presentó Prism, un sistema para compartir GPU en servidores multi-LLM. Según el artículo 2505.04021 de arXiv (mayo de 2025), Prism logra un ahorro de costos de más del doble y un cumplimiento de SLO 3,3 veces superior en comparación con los sistemas de servidores multi-LLM de última generación.

Aunque se centra en la inferencia más que en el entrenamiento, los principios son aplicables. Múltiples tareas de entrenamiento pequeñas pueden compartir los recursos de la GPU de forma más eficiente que si se dedicaran GPU completas a cada carga de trabajo.

La programación de GPU basada en Kubernetes, combinada con herramientas como el complemento de dispositivos de NVIDIA, permite la asignación fraccionada de GPU en entornos autoalojados. Esto maximiza la utilización al ejecutar diversas cargas de trabajo en un grupo de GPU compartido.

Formación regional y descentralizada

Los marcos de entrenamiento descentralizados permiten el preentrenamiento de modelos LLM en GPU distribuidas geográficamente. Según una investigación de SPES presentada en ICLR 2026, los investigadores entrenaron con éxito modelos LLM del Ministerio de Educación utilizando configuraciones de GPU descentralizadas con un menor consumo de memoria por nodo.

Este paradigma extiende la formación LLM accesible a organizaciones con recursos informáticos distribuidos en lugar de clústeres centralizados. La rentabilidad surge de la utilización del hardware existente en múltiples ubicaciones en lugar de la compra de infraestructura de formación específica.

Recomendaciones prácticas según el nivel de presupuesto

Ahora bien, aquí es donde la cosa se pone práctica. ¿Qué deberían comprar o alquilar los equipos?

Presupuesto inicial ($0-$3,000)

Céntrese en instancias spot en la nube o GPU de consumo con 16-24 GB de VRAM. La RTX 4060 Ti (16 GB) ofrece la opción mínima viable para la experimentación con el modelo 7B y QLoRA.

Las instancias spot en la nube para GPU NVIDIA T4 con configuraciones pequeñas tienen un precio de $0.40/hora, según los precios de Hugging Face GPU Spaces. Esto permite 7500 horas de entrenamiento antes de igualar una compilación local de $3000, más que suficiente para la investigación inicial.

Presupuesto medio ($3.000-$10.000)

Los sistemas RTX 4090 ofrecen el mejor equilibrio entre rendimiento y precio. Un sistema dual 4090 configurado correctamente gestiona la mayoría de los escenarios de entrenamiento de 13 mil millones de unidades y los modelos más pequeños de 30 mil millones de unidades con métodos que optimizan los parámetros.

Como alternativa, destine ese presupuesto a créditos en la nube H100. A razón de $3/hora, $10,000 proporciona aproximadamente 3,333 horas, suficientes para proyectos de investigación importantes sin obligaciones de propiedad.

Presupuesto de producción ($10,000+)

Las cargas de trabajo de producción exigentes justifican el uso de hardware para centros de datos. El uso de múltiples GPU A100 o H100 en implementaciones en la nube con precios de instancia reservada ofrece costos y rendimiento predecibles.

Para las organizaciones con necesidades de capacitación continuas, los clústeres A100 o L40S instalados en sus propias instalaciones resultan rentables a pesar de la mayor inversión inicial. El soporte empresarial y la rentabilidad a largo plazo favorecen la adquisición de estos clústeres a gran escala.

Errores comunes que se deben evitar

Varios errores suelen suponer un derroche de presupuesto y tiempo:

- Sobreaprovisionamiento de memoria: Comprar tarjetas gráficas de 80 GB para entrenar un modelo de 7 mil millones de copias es un derroche de dinero. Adapta el hardware a las necesidades reales, no a los máximos teóricos.

- Ignorando el ancho de banda: Las líneas PCIe y la conectividad NVLink son importantes para el entrenamiento con múltiples GPU. Las placas base para consumidores a menudo carecen del ancho de banda suficiente para admitir más de 2 o 3 GPU de gama alta de manera efectiva.

- Olvidarse de la refrigeración: Varias GPU de alto rendimiento en un solo chasis requieren un flujo de aire considerable. La limitación térmica reduce el rendimiento y genera problemas de fiabilidad.

- Mezclar hardware incompatible: No todas las GPU son compatibles con NVLink, las versiones de PCIe son importantes para el ancho de banda y las fuentes de alimentación deben proporcionar energía limpia y adecuada en los rieles apropiados.

- Descuidar la optimización del software: La mejora de rendimiento más económica proviene de un mejor código, no de un mejor hardware. Analiza las cargas de trabajo antes de invertir en tarjetas gráficas.

No pagues de más por las GPU, primero corrige la configuración de entrenamiento.

El coste de las GPU suele reflejar decisiones más profundas: qué se entrena, cómo se entrena y si la carga de trabajo está realmente justificada. IA superior Se trabaja en la creación y el entrenamiento de modelos lineales de aprendizaje (MLA) con un enfoque en la eficiencia en cada etapa. Esto incluye decidir cuándo se necesita un entrenamiento completo y cuándo un ajuste fino, estructurar los conjuntos de datos para que sean utilizables sin un volumen excesivo y configurar ejecuciones de entrenamiento que no desperdicien ciclos. El objetivo es evitar recurrir a cálculos a gran escala cuando una configuración más pequeña y mejor alineada podría ofrecer el mismo resultado.

Gran parte del gasto en GPU proviene de la ejecución de procesos que nunca se planificaron adecuadamente: experimentos repetidos, modelos sobredimensionados o pipelines de entrenamiento que no se ajustan con el tiempo. Reducir esto requiere cambios en la planificación del sistema, no solo en el hardware utilizado. Si desea controlar los costos de la GPU antes de que se acumulen, contáctenos. IA superior y analiza cómo está definido tu flujo de trabajo de capacitación.

Consideraciones para la preparación para el futuro

Las arquitecturas de GPU evolucionan rápidamente. El hardware que se compra hoy será superado en rendimiento por los lanzamientos de la próxima generación en un plazo de 12 a 18 meses.

Pero, ¿realmente importa? Para cargas de trabajo de producción, las plataformas estables con soporte de software probado suelen ofrecer un mejor retorno de la inversión que el hardware de última generación con herramientas aún en desarrollo.

El alquiler de servicios en la nube ofrece una protección natural contra la obsolescencia. Actualice a hardware nuevo cambiando el tipo de instancia en lugar de reemplazar el equipo propio.

Para ensamblajes locales, concéntrese en plataformas con buen valor de reventa. Las GPU de consumo de NVIDIA mantienen la demanda en el mercado secundario. Las tarjetas para centros de datos conservan su valor durante más tiempo, pero tienen mercados menos líquidos.

Preguntas frecuentes

¿Qué GPU necesito para entrenar un modelo LLM de 7 mil millones de parámetros?

Para una optimización completa, se requieren aproximadamente 67 GB de VRAM distribuidos en una o más GPU. Con LoRA, una sola GPU de 24 GB, como la RTX 4090, es suficiente. QLoRA reduce los requisitos a tan solo 5 GB, lo que permite utilizar incluso GPU de gama básica.

¿Es más económico comprar una GPU o alquilarla en la nube?

La propiedad local de GPU resulta más económica tras aproximadamente 3500 horas de uso en comparación con el alquiler en la nube. Para entrenamientos intermitentes o proyectos con menos de 150 días de computación continua, el alquiler en la nube es más barato. Para cargas de trabajo sostenidas, la propiedad resulta más ventajosa.

¿Cuánto cuesta alquilar una GPU en la nube H100?

Los precios varían entre $2 y 4 por hora, dependiendo del proveedor, la región y el nivel de compromiso. Las instancias spot y los precios reservados pueden reducir los costos, mientras que el acceso bajo demanda tiene tarifas premium.

¿Puedo entrenar modelos LLM en GPU de consumo como la RTX 4090?

Por supuesto. La RTX 4090 con 24 GB de VRAM maneja modelos de 7 mil millones sin problemas y modelos de 13 mil millones con técnicas que optimizan los parámetros. Varias 4090 en paralelo pueden entrenar modelos aún más grandes, aunque las GPU para centros de datos ofrecen una mejor escalabilidad multi-GPU.

¿Cuál es la diferencia entre las GPU A100 y H100?

El H100 ofrece 80 GB de memoria HBM3 frente a los 80 GB de HBM2e del A100, lo que proporciona un mayor ancho de banda. El H100 incluye núcleos tensoriales de cuarta generación con un rendimiento mejorado para operaciones con transformadores. Para la formación en LLM, el H100 suele ofrecer un rendimiento superior al del A100.

¿Necesito NVLink para el entrenamiento con múltiples GPU?

NVLink mejora significativamente la eficiencia de las configuraciones multi-GPU para modelos grandes que no caben en la memoria de una sola GPU. Para modelos que caben completamente en una GPU mediante paralelismo de datos, el ancho de banda de PCIe es suficiente. El entrenamiento de modelos de más de 30 mil millones de copias se beneficia sustancialmente de la conectividad NVLink.

¿Cuál es la arquitectura de GPU más rentable para los másteres en Derecho (LLM) en 2026?

Para compilaciones locales, la RTX 4090 ofrece la mejor relación rendimiento-precio. Para cargas de trabajo en la nube, la NVIDIA L4 proporciona eficiencia para modelos pequeños, mientras que la H100 ofrece un rendimiento óptimo para el entrenamiento a gran escala. La opción más rentable depende del tamaño de la carga de trabajo y los patrones de uso, más que de una arquitectura específica.

Conclusión

La selección de GPU rentables para el entrenamiento de LLM equilibra la economía de la compra frente a la del alquiler, los requisitos de memoria frente al tamaño del modelo y las necesidades de rendimiento frente a las limitaciones presupuestarias.

Para los equipos que se inician en el desarrollo de modelos LLM, el alquiler de GPU en la nube ofrece flexibilidad sin necesidad de inversión inicial. Experimente con diferentes tamaños de modelo y enfoques de entrenamiento antes de invertir en hardware.

Las organizaciones con cargas de trabajo de capacitación constantes deberían evaluar seriamente la posibilidad de implementar GPU locales. Tras 3500 horas de uso, la rentabilidad de la propiedad supera con creces los costes de alquiler.

¿La conclusión más importante? La optimización del hardware y las mejoras en la metodología de entrenamiento suelen generar mayores ganancias de rendimiento que simplemente comprar GPU más caras. Empiece con un código eficiente y técnicas apropiadas, y luego ajuste el hardware para solucionar los cuellos de botella reales.

Antes de tomar una decisión final, consulta los precios actuales de los proveedores de servicios en la nube con GPU y de los fabricantes de hardware; este mercado se mueve rápidamente y los precios fluctúan mensualmente.