Resumen rápido: La IA no sustituirá a los profesionales de la ciberseguridad, pero transformará sus funciones al automatizar tareas repetitivas como la detección de amenazas y el análisis de registros. Según investigaciones de CISA y NIST, la experiencia humana sigue siendo esencial para la toma de decisiones estratégicas, el juicio ético, la respuesta a incidentes y la gestión de nuevas amenazas que los sistemas de IA no pueden resolver de forma independiente. El futuro implica una colaboración entre humanos e IA, donde los profesionales guiarán las herramientas de IA en lugar de competir con ellas.

La pregunta sigue surgiendo en círculos profesionales, foros en línea y conferencias sobre ciberseguridad: ¿reemplazará la IA los empleos en ciberseguridad? Es una preocupación legítima. Después de todo, la inteligencia artificial ya analiza los patrones de tráfico de red, detecta anomalías y responde a ciertas amenazas más rápido que cualquier equipo humano.

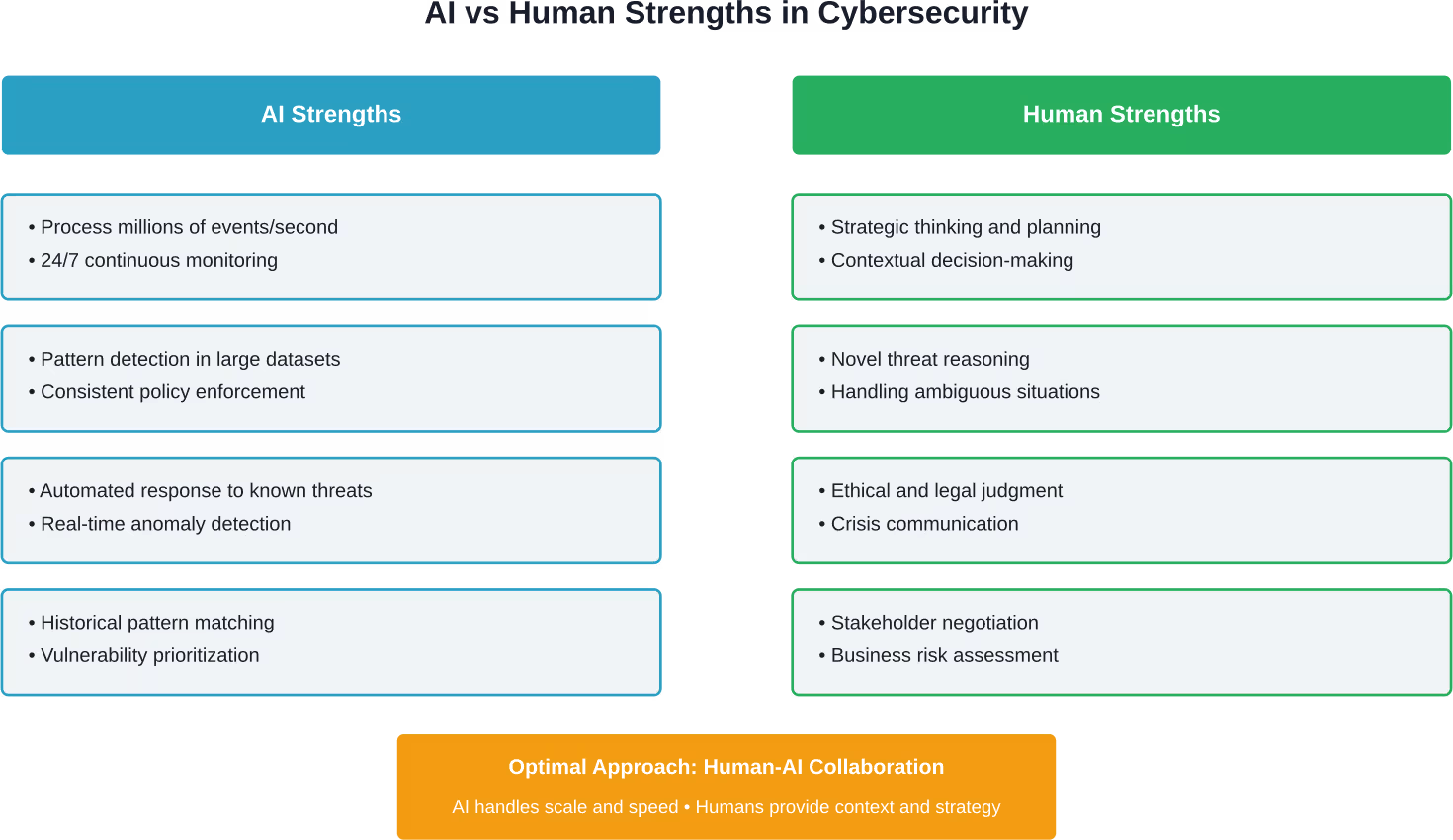

Pero he aquí la clave: la relación entre la IA y los profesionales de la ciberseguridad no es un juego de suma cero. La tecnología no elimina los roles humanos, sino que los transforma de maneras que exigen nuevas habilidades, al tiempo que preserva el valor insustituible del juicio humano.

En serio: la IA destaca en el procesamiento de grandes conjuntos de datos y la identificación de patrones. Sin embargo, tiene dificultades con el contexto, el pensamiento estratégico y los matices éticos que definen los programas de seguridad eficaces. Esta brecha es más importante de lo que la mayoría de la gente cree.

Estado actual de la IA en las operaciones de ciberseguridad

Según los casos de uso publicados por CISA, las herramientas de IA se han convertido en componentes fundamentales de las operaciones de seguridad modernas. Desde la detección de anomalías en los datos de red hasta la mejora de la inteligencia sobre amenazas, estos sistemas complementan las capacidades humanas en lugar de reemplazarlas.

Las iniciativas de automatización impulsadas por IA de CISA se centran en aprovechar el aprendizaje automático para automatizar procesos y mejorar la eficiencia operativa. El programa de Especialista Certificado en Automatización Impulsada por IA (CAIAS), creado en 2024, capacita a profesionales para trabajar junto con estos sistemas, no para competir contra ellos.

Las aplicaciones actuales de la IA en ciberseguridad incluyen:

- Análisis del comportamiento: Los algoritmos de aprendizaje automático establecen patrones de comportamiento de usuario básicos y señalan desviaciones que podrían indicar credenciales comprometidas o amenazas internas.

- Análisis automatizado de vulnerabilidades: Los sistemas de IA evalúan continuamente los entornos en la nube y la infraestructura local para detectar desviaciones de configuración y fallos de seguridad.

- Agregación de inteligencia sobre amenazas: El procesamiento del lenguaje natural analiza boletines de seguridad, foros de la web oscura y fuentes de información sobre amenazas para priorizar los riesgos emergentes.

- Análisis de registros a gran escala: La IA procesa millones de entradas de registro para identificar patrones sospechosos que a los analistas humanos les llevaría días descubrir.

- Automatización de la aplicación de políticas: La IA garantiza configuraciones de seguridad consistentes en todas las cuentas de nube distribuidas y detecta desviaciones de configuración en tiempo real.

Estas aplicaciones comparten una característica común: gestionan tareas repetitivas y de gran volumen de datos que antes consumían enormes cantidades de recursos del equipo de seguridad. Un curso de Coastline College sobre aplicaciones de IA en ciberseguridad, al que se hace referencia en los materiales de NICCS, destaca esta colaboración entre las tecnologías de IA y la supervisión humana.

Diseño e implementación de sistemas de IA con IA superior

IA superior Se dedica al diseño de sistemas de IA que se integran en entornos reales. Esto incluye definir el problema, desarrollar modelos y garantizar que dichos modelos funcionen correctamente una vez conectados a los flujos de trabajo operativos.

¿Necesitas ayuda para diseñar e implementar inteligencia artificial?

AI Superior puede ayudar con:

- Creación de modelos de IA para casos de uso prácticos

- Definición de la arquitectura del sistema y el enfoque técnico.

- Integración de la IA en la infraestructura empresarial

👉 Contacta con IA Superior para analizar su proyecto, datos y enfoque de implementación.

Dónde se queda corta la IA en ciberseguridad

A pesar de sus impresionantes capacidades, los sistemas de IA se enfrentan a limitaciones fundamentales que impiden la automatización completa de las operaciones de seguridad. Comprender estas limitaciones explica por qué la experiencia humana sigue siendo indispensable.

Toma de decisiones dependiente del contexto

La IA destaca en el reconocimiento de patrones, pero tiene dificultades con el contexto. Un aumento repentino en las consultas a la base de datos podría indicar un ataque de inyección SQL, o bien reflejar una actividad comercial legítima durante el lanzamiento de un producto. La IA detecta la anomalía. Los humanos determinan si se trata de una amenaza.

Las decisiones de seguridad a menudo requieren comprender los objetivos comerciales, los requisitos normativos y la tolerancia al riesgo de la organización. Estos no son datos que un algoritmo pueda procesar de forma independiente.

Nuevos vectores de ataque

Los modelos de aprendizaje automático se entrenan con datos históricos. Cuando los atacantes desarrollan técnicas realmente novedosas, los sistemas de IA carecen de puntos de referencia. El modelo podría pasar por alto amenazas que no coincidan con patrones conocidos.

Consideremos el caso del empleado del sector financiero en Hong Kong que transfirió 14.000 millones de chelines tanzanos tras una videoconferencia en febrero de 2024 con quien parecía ser el director financiero y otros ejecutivos. La tecnología deepfake imitó los patrones de habla y la apariencia visual con la suficiente convicción como para no despertar sospechas en el empleado. Los sistemas de detección de IA no habían detectado ese patrón de ataque específico con anterioridad.

Por el contrario, los profesionales de la seguridad humana pueden razonar sobre escenarios desconocidos aplicando principios de seguridad fundamentales y comprendiendo las motivaciones de los atacantes.

Inteligencia artificial adversaria y manipulación de modelos

Las investigaciones del NIST sobre seguridad de la IA destacan que los propios sistemas de IA se convierten en objetivos de ataques. Las técnicas de aprendizaje automático adversarias pueden contaminar los datos de entrenamiento o crear entradas que engañen a los modelos de clasificación.

Un modelo de seguridad entrenado para identificar malware podría clasificar erróneamente el código malicioso si los atacantes modifican sutilmente las características de los archivos. Para defenderse de estos ataques se necesitan investigadores de seguridad que comprendan tanto las vulnerabilidades de la IA como las tácticas de los atacantes.

El curso "Validación de modelos de IA y automatización de pruebas para sistemas críticos: Fundamentos", del NIST, publicado en mayo de 2025, aborda precisamente estas preocupaciones: verificar la fiabilidad de la IA en ámbitos de alta seguridad donde los fallos conllevan graves consecuencias.

Juicio ético y legal

Los incidentes de seguridad suelen implicar consideraciones de privacidad, cumplimiento legal y dilemas éticos. ¿Debería el equipo de seguridad de una empresa acceder a los dispositivos personales de los empleados para investigar una posible filtración de datos? ¿Cómo debe la respuesta ante incidentes equilibrar la transparencia con la protección de la información confidencial?

Estas preguntas no tienen respuestas algorítmicas. Requieren un juicio humano fundamentado en marcos legales, principios éticos y valores organizacionales.

Cómo la IA transforma los roles en ciberseguridad

En lugar de eliminar empleos en ciberseguridad, la IA transforma lo que implican esos trabajos. Esta transformación refleja cambios tecnológicos históricos: la automatización no destruye profesiones, sino que redirige el esfuerzo humano hacia actividades de mayor valor.

Del análisis manual a la supervisión estratégica

Antes, los analistas de seguridad dedicaban horas a revisar manualmente los registros de los cortafuegos y a correlacionar eventos en sistemas dispares. Ahora, la IA se encarga de ese trabajo pesado, procesando datos a una velocidad que ningún equipo humano podría igualar.

Este cambio permite a los analistas centrarse en cuestiones estratégicas: ¿Están las defensas actuales alineadas con los nuevos escenarios de amenazas? ¿Cómo deben priorizarse las inversiones en seguridad en función del riesgo empresarial? ¿Qué deficiencias existen en las capacidades de respuesta a incidentes?

Según una investigación de la Brookings Institution publicada en octubre de 2024, más de 301.000 trabajadores podrían verse expuestos a los efectos de la IA generativa, con los mayores impactos en las ocupaciones de remuneración media y alta, así como en los puestos administrativos. Sin embargo, la investigación subraya que la exposición no equivale a la sustitución, sino que indica una transformación de las tareas.

Nuevos requisitos de habilidades

Un estudio del NIST sobre el impacto de la IA en la fuerza laboral de ciberseguridad (publicado en junio de 2025) destaca cómo el Marco de Recursos Humanos de NICE se adapta a estos cambios. Los profesionales de la ciberseguridad necesitan cada vez más habilidades que combinen la experiencia en seguridad con el conocimiento de la IA.

Según las proyecciones del Foro Económico Mundial citadas en investigaciones académicas, se espera que 39% de las habilidades de la fuerza laboral cambien para 2030, lo que requerirá una adaptación y una recualificación significativas para satisfacer las demandas cambiantes del mercado laboral.

Las habilidades emergentes críticas incluyen:

- Evaluación del modelo de IA: Comprender cómo los modelos de aprendizaje automático toman decisiones e identificar posibles sesgos o vulnerabilidades.

- Ingeniería rápida para la seguridad: Consultar eficazmente los sistemas de IA para extraer información relevante sobre amenazas y seguridad.

- Defensa contra IA adversaria: Protección de los sistemas de IA contra ataques de manipulación y envenenamiento.

- Interpretación del algoritmo: Cómo traducir los resultados de la IA en recomendaciones de seguridad prácticas.

- Diseño del flujo de trabajo humano-IA: Estructurar procesos que optimicen la colaboración entre sistemas automatizados y analistas humanos.

No se trata de profesiones totalmente nuevas. Son evoluciones de funciones de seguridad ya existentes, mejoradas por las capacidades de la IA.

Respuesta mejorada ante incidentes

La IA acelera drásticamente la detección y contención inicial de amenazas. Los sistemas automatizados pueden aislar los puntos finales comprometidos, bloquear direcciones IP maliciosas y activar planes de respuesta predefinidos en cuestión de milisegundos tras detectar un incidente.

Pero las brechas de seguridad complejas aún requieren coordinación humana. Determinar el alcance de la brecha, gestionar la comunicación con las partes interesadas, coordinar con las fuerzas del orden, tomar decisiones sobre la divulgación: estas actividades exigen un criterio que los algoritmos no pueden replicar.

Esta relación simbiótica se traduce en un tiempo medio de resolución (MTTR) más rápido, combinado con una respuesta estratégica más reflexiva. La IA proporciona información en tiempo real. Los humanos toman las decisiones cruciales.

| Tarea de seguridad | Contribución de la IA | Contribución humana | Resultado de la colaboración |

|---|---|---|---|

| Detección de amenazas | Analiza el tráfico de red y los registros para identificar anomalías en tiempo real. | Valida las alertas, determina los falsos positivos y aplica el contexto empresarial. | Detección más rápida con menos falsos positivos. |

| Gestión de vulnerabilidades | Analiza la infraestructura y prioriza en función de la vulnerabilidad y la exposición. | Evalúa el impacto en el negocio, programa las medidas correctivas y gestiona las excepciones. | Priorización basada en riesgos alineada con las necesidades del negocio. |

| Respuesta al incidente | Automatiza la contención, ejecuta planes de respuesta y recopila datos forenses. | Dirige la estrategia de investigación, toma decisiones sobre la divulgación de información y coordina equipos. | Contención más rápida con toma de decisiones estratégicas |

| Vigilancia de seguridad | Vigilancia continua las 24 horas del día, los 7 días de la semana, reconocimiento de patrones en millones de eventos. | Ajusta las reglas de detección, investiga escenarios complejos y gestiona las escaladas. | Cobertura integral sin agotamiento del analista. |

| Caza de amenazas | Sugiere hipótesis de caza basadas en inteligencia sobre amenazas y automatiza las consultas de datos. | Desarrolla escenarios de búsqueda creativos, interpreta los hallazgos y persigue anomalías. | Detección proactiva de amenazas a gran escala |

Integración de la IA y la ciberseguridad en el mundo real

Las organizaciones que ya utilizan IA en sus operaciones de seguridad demuestran cómo se materializa esta colaboración en la práctica. No se trata de escenarios teóricos, sino de implementaciones actuales.

Inteligencia de amenazas automatizada

Los equipos de seguridad utilizan IA para recopilar información sobre amenazas de cientos de fuentes, correlacionar indicadores de compromiso y priorizar las amenazas según la exposición de la organización. La IA procesa el lenguaje natural de los boletines de seguridad, extrae indicadores técnicos relevantes y los relaciona con los activos internos.

Los analistas humanos revisan las amenazas priorizadas, determinan cuáles requieren acción inmediata y ajustan las estrategias defensivas en consecuencia. Sin IA, los equipos se verían abrumados por la cantidad de datos brutos sobre amenazas. Sin la intervención humana, el sistema no podría traducir la información en acciones adecuadas al contexto.

Gestión de la postura de seguridad en la nube

Las herramientas basadas en IA analizan continuamente los entornos en la nube en busca de configuraciones incorrectas, controles de acceso excesivamente permisivos e infracciones de políticas. Corrigen automáticamente ciertos tipos de problemas, como el cierre de depósitos de almacenamiento de acceso público o la revocación de credenciales no utilizadas.

Los arquitectos de seguridad definen las políticas que aplica la IA. Determinan los niveles de riesgo aceptables, diseñan los procesos de excepción y garantizan que la corrección automatizada se ajuste a las operaciones comerciales. La IA se encarga de la aplicación a gran escala. Los humanos se ocupan de la estrategia y la gobernanza.

Análisis del comportamiento del usuario

El aprendizaje automático establece patrones de referencia para usuarios individuales y grupos de pares. Cuando una cuenta de usuario muestra un comportamiento inusual (acceder a sistemas en horarios extraños, descargar grandes conjuntos de datos o conectarse desde ubicaciones desconocidas), la IA detecta dicha actividad.

Los equipos de operaciones de seguridad investigan las cuentas señaladas, entrevistan a los usuarios si es necesario y determinan si el comportamiento anómalo refleja una actividad comercial legítima o una posible vulneración de seguridad. La IA identifica los casos atípicos. Los humanos determinan la intención.

La realidad del mercado laboral para los profesionales de la ciberseguridad

Los datos del IEEE y de la investigación académica ofrecen una perspectiva sobre el impacto real de la IA en el empleo, que difiere sustancialmente de los escenarios distópicos de sustitución.

En un artículo de IEEE Spectrum de febrero de 2024 se analizan argumentos que sugieren que la IA podría generar más empleo que disrupción, lo que podría reactivar los puestos de trabajo de la clase media perdidos durante las anteriores oleadas de automatización. ¿La advertencia? La sociedad debe protegerse contra el mal uso de la IA, en particular la desinformación y las falsificaciones profundas (deepfakes).

El análisis de IEEE Transmitter de abril de 2025 se hace eco de esta evaluación, señalando que la IA reemplaza más tareas que puestos de trabajo. La predicción de los investigadores de IA de 2016, según la cual la automatización transformaría el trabajo en lugar de eliminarlo, se ha cumplido en gran medida casi una década después.

En el ámbito de la ciberseguridad, la demanda sigue superando a la oferta. El sector se enfrenta a una persistente escasez de talento, incluso con la proliferación de herramientas de IA. ¿Por qué? Porque la IA crea nuevos desafíos de seguridad a la vez que resuelve los ya existentes.

La seguridad de la IA crea empleos.

Garantizar la seguridad de los sistemas de IA requiere conocimientos especializados. A medida que las organizaciones implementan modelos de aprendizaje automático para sus operaciones comerciales, necesitan profesionales que comprendan la IA adversaria, la validación de modelos y los marcos de gobernanza de la IA.

La nota conceptual del NIST sobre el perfil RMF de IA para una IA confiable en infraestructura crítica (7 de abril de 2026) aborda los requisitos de seguridad y confiabilidad para la IA implementada en sistemas críticos. La implementación de estos marcos requiere experiencia humana, lo que implica la creación de roles en lugar de suprimirlos.

Según un análisis de la Brookings Institution, la infraestructura, los modelos, la investigación y la gobernanza de la IA representaron una parte significativa del total de la financiación privada para la IA a nivel mundial entre 2014 y 2025. Esta inversión indica la creación de empleo, no su destrucción.

El imperativo de la recualificación

Dicho esto, las habilidades estáticas no bastan. Los profesionales de la ciberseguridad deben adaptarse continuamente a medida que evolucionan las capacidades de la IA. Las organizaciones que invierten en el desarrollo de su personal —capacitando a los equipos existentes en la integración de la IA en lugar de reemplazarlos— suelen obtener mejores resultados en materia de seguridad.

El programa de Especialista Certificado en Automatización Impulsada por IA representa una vía para lograrlo. Iniciativas similares de organizaciones del sector, instituciones académicas y agencias gubernamentales ayudan a cerrar la brecha entre las habilidades de seguridad tradicionales y los roles potenciados por la IA.

Riesgos que la IA introduce en la ciberseguridad

Irónicamente, la integración de la IA en las operaciones de seguridad crea nuevas vulnerabilidades. Comprender estos riesgos explica por qué la supervisión humana sigue siendo fundamental.

Aprendizaje automático adversario

Los atacantes pueden manipular los sistemas de IA mediante datos de entrada cuidadosamente elaborados. Los ejemplos adversarios —datos de entrada diseñados para engañar a los modelos de aprendizaje automático— pueden provocar la clasificación errónea del malware, eludir los sistemas de reconocimiento facial o evadir la detección de intrusiones.

Según un estudio de RAND Corporation sobre los riesgos de la IA para la seguridad, publicado en diciembre de 2017, estas vulnerabilidades existían desde los inicios de la adopción de la IA y se han vuelto cada vez más sofisticadas. Defenderse de la IA maliciosa requiere profesionales de la seguridad que comprendan tanto la mecánica del aprendizaje automático como las metodologías de los atacantes.

Envenenamiento de datos

Los modelos de IA se entrenan con datos históricos. Si los atacantes comprometen los conjuntos de datos de entrenamiento —inyectando ejemplos maliciosos o alterando las distribuciones—, los modelos resultantes heredan esos fallos. Un modelo de detección de amenazas comprometido podría ignorar sistemáticamente ciertas firmas de ataque o generar un exceso de falsos positivos.

Según un análisis de la Brookings Institution de septiembre de 2025, una inversión insuficiente en seguridad de la IA a nivel estatal podría aumentar significativamente los costos del cibercrimen. En 2021, se estimó que el cibercrimen costó a las naciones africanas 101 TP3T de su producto interno bruto, o $4.120 millones, lo que demuestra las consecuencias económicas de las fallas en la seguridad de la IA.

Dependencia excesiva y desocupación

Las organizaciones que dependen demasiado de la IA corren el riesgo de que sus equipos humanos pierdan habilidades. Si los analistas dejan de desarrollar habilidades de investigación manual porque la IA se encarga del análisis rutinario, pierden la capacidad de funcionar cuando los sistemas de IA fallan o se enfrentan a escenarios nuevos.

Mantener la pericia humana junto con la automatización mediante IA requiere un desarrollo intencional del personal. Los equipos necesitan oportunidades para practicar habilidades fundamentales, incluso cuando la IA podría, en teoría, realizar las tareas más rápido.

Explicabilidad y rendición de cuentas

Muchos modelos de IA funcionan como cajas negras, generando resultados sin un razonamiento transparente. Cuando un sistema de IA marca una cuenta como comprometida, los equipos de seguridad necesitan comprender el motivo. Sin explicabilidad, validar las decisiones de la IA se vuelve imposible.

Este desafío se intensifica en las industrias reguladas, donde las decisiones de seguridad deben ser auditables y justificables. La investigación del NIST sobre la IA confiable subraya que la seguridad de los sistemas de IA depende en parte de la explicabilidad y la rendición de cuentas, atributos que requieren supervisión humana.

Buenas prácticas para la colaboración entre humanos e IA en materia de seguridad.

Las organizaciones que integran con éxito la IA en sus operaciones de seguridad siguen ciertos patrones. Estas prácticas maximizan los beneficios de la IA a la vez que preservan la experiencia humana.

Defina límites claros para la automatización.

Establecer reglas explícitas sobre qué tareas gestiona la IA de forma autónoma y cuáles requieren aprobación humana. Las actividades de bajo riesgo y alto volumen, como el análisis rutinario de vulnerabilidades, se prestan a la automatización completa. Las decisiones de alto riesgo, como la divulgación de incidentes, exigen supervisión humana.

Documente estos límites en los manuales de seguridad para que los equipos comprendan cuándo confiar en los resultados de la IA y cuándo validarlos de forma independiente.

Implementar la validación con intervención humana

Para decisiones críticas de seguridad, diseñe flujos de trabajo que requieran confirmación humana antes de que se ejecuten las acciones recomendadas por la IA. Esto podría implicar que los analistas revisen las alertas de alta gravedad antes de que se produzca el bloqueo automático, o que se requiera aprobación antes de que los sistemas de IA modifiquen las políticas de seguridad de producción.

Los enfoques con intervención humana ralentizan ligeramente la respuesta, pero reducen drásticamente el riesgo de que los falsos positivos provoquen interrupciones en la actividad empresarial.

Monitoreo continuo de modelos

Los modelos de IA se degradan con el tiempo a medida que evolucionan los escenarios de amenazas y los datos de entrenamiento se vuelven obsoletos. Los equipos de seguridad deben monitorear continuamente el rendimiento de los modelos, haciendo un seguimiento de métricas como las tasas de falsos positivos, la precisión de detección y la confianza en las predicciones.

Cuando el rendimiento disminuye, los modelos necesitan ser reentrenados con los datos actuales. Este mantenimiento continuo requiere supervisión humana, ya que los sistemas de IA no pueden determinar de forma independiente cuándo dejan de ser eficaces.

Invierta en formación en alfabetización en IA.

Los profesionales de la seguridad no necesitan convertirse en científicos de datos, pero sí necesitan conocimientos básicos de IA. La formación debe abarcar el funcionamiento de los modelos de aprendizaje automático, los fallos más comunes y cómo interpretar de forma crítica los resultados de la IA.

Según la investigación sobre el impacto en la fuerza laboral realizada por el NIST en junio de 2025, las organizaciones que invierten en el desarrollo de habilidades de IA para los equipos existentes obtienen mejores resultados de integración que aquellas que intentan contratar personal completamente nuevo especializado en IA.

Mantener las capacidades manuales

Incluso cuando la IA se encarga de las tareas rutinarias, los equipos deben practicar periódicamente la investigación y el análisis manuales. Estos ejercicios garantizan que las habilidades no se atrofien y preparan a los equipos para situaciones en las que los sistemas de IA fallen o resulten inadecuados.

Los ejercicios de simulación periódicos que recrean fallos en los sistemas de IA ayudan a los equipos a prepararse para operaciones degradadas y a mantener la confianza en sus capacidades fundamentales.

El futuro: Aumento, no reemplazo.

Las pruebas apuntan consistentemente a un futuro en el que la IA complementará a los profesionales de la ciberseguridad en lugar de reemplazarlos. Esto no es una ilusión, sino que refleja las limitaciones fundamentales de la IA y el valor perdurable del juicio humano.

A medida que se expanden las capacidades de la IA, también lo hacen las superficies de ataque. Cada nueva aplicación de IA plantea desafíos de seguridad que requieren la intervención humana. El incidente de deepfake en Hong Kong demuestra cómo la IA empodera tanto a los atacantes como a los defensores.

Miren, la pregunta "¿reemplazará la IA a la ciberseguridad?" plantea el problema de forma incorrecta. La pregunta más pertinente es: ¿cómo se adaptarán los profesionales de la ciberseguridad para aprovechar la IA de manera efectiva y, al mismo tiempo, abordar los nuevos riesgos que genera?

Las organizaciones necesitan profesionales que comprendan tanto los principios de seguridad tradicionales como los desafíos de la era de la IA. Quienes desarrollen habilidades híbridas, combinando los fundamentos de la seguridad con conocimientos de IA, serán cada vez más valiosos.

Esta transformación se asemeja a cambios tecnológicos anteriores. La computación en la nube no eliminó a los administradores de sistemas; simplemente cambió lo que implica la administración de sistemas. La tecnología móvil no eliminó a los desarrolladores de software; simplemente reorientó el tipo de aplicaciones que crean.

La IA sigue el mismo patrón. Elimina tareas específicas a la vez que crea otras nuevas que requieren juicio humano, creatividad y pensamiento estratégico.

Preguntas frecuentes

¿La IA reemplazará por completo a los analistas de ciberseguridad?

No. La IA automatizará tareas repetitivas como el análisis de registros y la monitorización rutinaria, pero los analistas de ciberseguridad seguirán siendo esenciales para la toma de decisiones estratégicas, la coordinación de la respuesta a incidentes y el manejo de nuevas amenazas. Según la investigación de CISA sobre casos de uso de la IA, las herramientas de IA complementan las capacidades humanas en lugar de reemplazarlas. Las investigaciones complejas, el juicio ético y la comunicación con las partes interesadas requieren experiencia humana que la IA no puede replicar.

¿Qué puestos de trabajo en ciberseguridad corren mayor riesgo debido a la automatización mediante IA?

Los puestos de nivel inicial, centrados principalmente en la monitorización rutinaria y la revisión manual de registros, son los que experimentan la mayor transformación. Sin embargo, estos roles evolucionan en lugar de desaparecer: los analistas junior se centran cada vez más en validar los resultados de la IA, ajustar los sistemas de detección e investigar las alertas escaladas. Según una investigación del IEEE de 2025, la IA reemplaza más tareas que puestos de trabajo completos, redirigiendo el esfuerzo humano hacia actividades de mayor valor.

¿Qué nuevos roles en ciberseguridad crea la IA?

La IA crea roles especializados, como especialistas en seguridad de IA que protegen los sistemas de aprendizaje automático de ataques maliciosos, expertos en validación de modelos que verifican la fiabilidad de los sistemas de IA, analistas de gobernanza de IA que garantizan una implementación responsable de la IA e ingenieros de respuesta rápida que optimizan las interacciones de IA centradas en la seguridad. El marco de trabajo de NIST para 2026 sobre IA confiable en infraestructura crítica destaca la creciente demanda de profesionales que comprendan tanto la seguridad como la gestión de riesgos de la IA.

¿Los profesionales de la ciberseguridad necesitan aprender programación y ciencia de datos?

Un conocimiento básico de IA es útil, pero no se requiere una gran experiencia en programación para la mayoría de los puestos de ciberseguridad. Los profesionales deben comprender el funcionamiento conceptual de los modelos de aprendizaje automático, reconocer los fallos más comunes e interpretar críticamente los resultados de la IA. Según un estudio del NIST sobre la fuerza laboral de 2025, la integración exitosa de la IA se centra más en el desarrollo de habilidades híbridas —que combinan los fundamentos de la seguridad con la comprensión práctica de la IA— en lugar de convertir a los profesionales de la seguridad en científicos de datos.

¿Cómo pueden prepararse los profesionales de la ciberseguridad para la integración de la IA?

Los profesionales deben capacitarse en aplicaciones de IA para la seguridad, como el programa de Especialista Certificado en Automatización Impulsada por IA (CAIAS) que ofrece CISA. Es fundamental centrarse en comprender los fundamentos del aprendizaje automático, las técnicas de IA adversaria y los flujos de trabajo de colaboración entre humanos e IA. Es importante mantener sólidos conocimientos básicos en los ámbitos de seguridad tradicionales, al tiempo que se familiarizan con las herramientas de IA utilizadas en la detección de amenazas, la gestión de vulnerabilidades y la respuesta a incidentes.

¿Cuáles son los mayores riesgos del uso de la IA en la ciberseguridad?

Entre los principales riesgos se incluyen los ataques de aprendizaje automático adversario que manipulan los sistemas de IA, la contaminación de datos que corrompe el entrenamiento de los modelos, la dependencia excesiva que provoca la pérdida de habilidades de los equipos humanos y la falta de explicabilidad que dificulta la validación. Según una investigación de RAND sobre los riesgos de seguridad de la IA, las organizaciones deben abordar estas vulnerabilidades mediante una gobernanza rigurosa de la IA, una monitorización continua y el mantenimiento de la supervisión humana de las decisiones críticas de seguridad.

¿La IA hará que los trabajos de ciberseguridad sean más fáciles o más complejos?

Ambas cosas. La IA gestiona tareas tediosas y repetitivas que antes consumían mucho tiempo de los analistas, reduciendo el agotamiento y mejorando la eficiencia. Sin embargo, también introduce una nueva complejidad: proteger los propios sistemas de IA, validar los resultados de los modelos y abordar las amenazas que la IA permite, como los deepfakes. Según una investigación de la Brookings Institution de 2024, más de 301.000 trabajadores se ven expuestos a los efectos de la IA generativa, pero esta exposición transforma el trabajo en lugar de eliminarlo, desplazando el enfoque hacia actividades más estratégicas.

Conclusión: Abrazando el futuro simbiótico

La evidencia es clara. La IA no reemplazará a los profesionales de la ciberseguridad, sino que redefinirá lo que hacen y las habilidades que necesitan.

Las organizaciones que consideran la IA como una herramienta para potenciar las capacidades humanas, en lugar de reemplazarlas, obtienen mejores resultados en materia de seguridad. Invierten en la formación de sus equipos en la integración de la IA, mantienen límites claros entre las actividades automatizadas y las dirigidas por humanos, y supervisan continuamente el rendimiento de los sistemas de IA.

Los profesionales de la ciberseguridad que se adaptan desarrollando conocimientos sobre IA sin perder de vista los fundamentos de la seguridad, se posicionan para el éxito profesional a largo plazo. El sector necesita expertos capaces de guiar los sistemas de IA, validar sus resultados y abordar los nuevos retos que plantea la IA.

¿Reemplazará la IA a la ciberseguridad? La pregunta en sí misma no da en el clavo. La IA transforma la profesión, creando oportunidades para quienes aceptan el cambio sin perder el pensamiento crítico y el criterio que los algoritmos no pueden replicar.

El futuro pertenece a los profesionales que dominan la colaboración entre la experiencia humana y la inteligencia artificial, aportando cada una fortalezas complementarias para defenderse de un panorama de amenazas en constante evolución.

¿Listo para preparar tu carrera en ciberseguridad para el futuro? Empieza explorando programas de capacitación centrados en IA como CAIAS, adquiere experiencia práctica con herramientas de seguridad basadas en IA y desarrolla conocimientos especializados tanto en los ámbitos de seguridad tradicionales como en los desafíos emergentes de la IA. El futuro simbiótico de la ciberseguridad exige profesionales capaces de conectar ambos mundos.