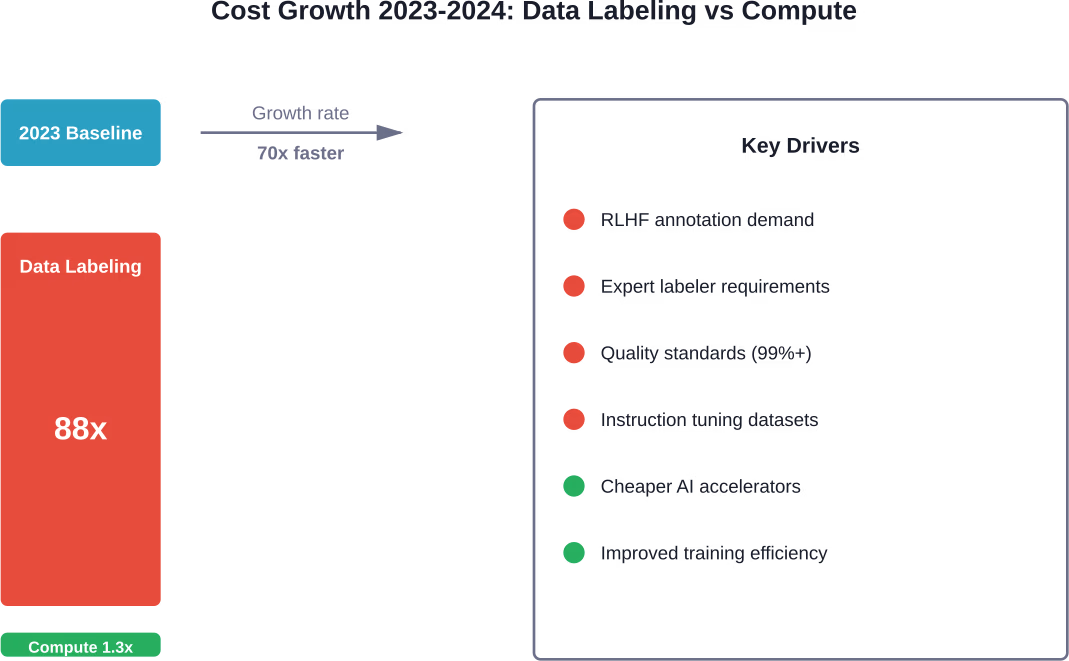

Korte samenvatting: De kosten voor het labelen van LLM-data zijn dramatisch gestegen. De omzet in de sector is tussen 2023 en 2024 maar liefst 88 keer zo hoog geworden, terwijl de rekenkosten slechts met een factor 1,3 zijn gestegen. Handmatige annotatie na de training (RLHF, het afstemmen van instructies) kost nu ongeveer drie keer zoveel als de marginale rekenkosten voor geavanceerde modellen. De kosten voor het labelen door experts voor één project kunnen variëren van 1 tot 14 miljoen euro, waardoor het labelen van data de opkomende bottleneck in de AI-ontwikkeling vormt.

De gangbare opvatting over de kosten van AI is onjuist.

Jarenlang domineerde de rekenkracht de discussie over budgetten voor LLM-opleidingen. GPU's, cloudinfrastructuur, elektriciteit – dit waren de gebruikelijke verdachten als het ging over wat AI duur maakt. Volgens bronnen die in concurrerende content werden aangehaald, kostte de training van GPT-4 naar schatting $78-100+ miljoen, terwijl Gemini Ultra 1.0 zelfs $192 miljoen kostte.

Maar dit is wat er veranderd is: data-labeling heeft de rekenkracht stilletjes ingehaald als de belangrijkste drijvende kracht achter de marginale kosten voor grensmodellen.

Uit recente analyses blijkt dat de omzet van grote datalabelbedrijven tussen 2023 en 2024 maar liefst 88 keer zo hoog is geworden, terwijl de rekenkosten voor het trainen van modellen slechts met een factor 1,3 zijn gestegen. Toen onderzoekers de jaarlijkse omzet van Scale, Surge, Mercor, Labelbox en vergelijkbare bedrijven berekenden en deze vergeleken met de marginale rekenkosten voor modellen zoals GPT-4o, Claude Sonnet-3.5, Mistral-Large, Grok-2 en Llama-3-405B, bleek duidelijk: de labelkosten liggen nu ongeveer drie keer zo hoog als de marginale rekenkosten.

Deze verschuiving weerspiegelt hoe moderne LLM's hun mogelijkheden bereiken. Technieken na de training, zoals supervised fine-tuning (SFT) en reinforcement learning from human feedback (RLHF), zijn essentieel geworden voor het produceren van modellen die daadwerkelijk in de praktijk werken. In tegenstelling tot pre-training op ruwe internetdata, vereisen deze methoden zorgvuldig samengestelde datasets die door mensen – vaak domeinexperts – zijn gecreëerd.

En de tijd van een expert is niet goedkoop.

De werkelijke cijfers achter de kosten van LLM-data-labeling

Casestudies laten zien hoe kostbaar handmatige annotatie is geworden.

Neem bijvoorbeeld MiniMax-M1, dat minder dan $1 miljoen aan rekenkracht nodig had om de kwaliteit van Claude-Opus-4 te bereiken. Of denk aan SkyRL-SQL, dat de prestaties van GPT-40 evenaarde bij tekst-naar-SQL-taken met slechts $360 aan trainingsrekenkracht.

Dit zijn geen uitzonderingen. Ze vertegenwoordigen de nieuwe economie van LLM-ontwikkeling.

Volgens de gezaghebbende handleiding van Scale AI over data-labeling is voor het bereiken van een extreem hoge kwaliteit (99%+) op een grote dataset een groot team nodig (meer dan 1000 data-labelaars per project). Met hoogopgeleide medewerkers en geavanceerde geautomatiseerde workflows leveren gespecialiseerde bedrijven labels van hoge kwaliteit, maar minimale kosten zijn relatief wanneer menselijke expertise de drijvende kracht achter het proces is.

Waardoor worden de kosten voor het labelen van LLM-gegevens bepaald?

Verschillende factoren dragen bij aan hogere annotatiekosten.

Afhankelijkheid na de training

Moderne LLM's werken niet direct na de training. Ze vereisen verfijning door middel van supervised fine-tuning en reinforcement learning-technieken. Deze processen vereisen absoluut door mensen gelabelde data – bij voorkeur van experts die de genuanceerde evaluatiecriteria begrijpen.

Een onderzoekspaper over kostenbewuste LLM-gebaseerde online datasetannotatie (arXiv:2505.15101) laat zien hoe recente ontwikkelingen in grote taalmodellen geautomatiseerde labeling mogelijk hebben gemaakt, maar dat menselijk toezicht cruciaal blijft voor kwaliteitsborging. De spanning tussen de mogelijkheden van automatisering en de kwaliteitseisen houdt de kosten hoog.

Vereisten voor deskundige etiketteerders

Niet iedereen kan trainingsdata voor een LLM-opleiding effectief labelen. Verschillende taken vereisen verschillende expertiseniveaus:

- Eenvoudige classificatietaken kunnen wellicht werken met algemene crowdsourced arbeid.

- Code-evaluatie vereist ervaren softwareontwikkelaars.

- Voor het beantwoorden van medische vragen zijn domeinspecialisten met relevante kwalificaties nodig.

- Juridische redeneertaken vereisen daadwerkelijke juridische professionals.

- Voor de verificatie van wiskundige problemen zijn vakdeskundigen nodig.

De uurtarieven van experts weerspiegelen hun specialistische kennis. Domeinspecialisten die $50-200+ per uur vragen, veranderen de projectkosten aanzienlijk in vergelijking met basislabeling tegen $10-15 per uur.

Kwaliteitsnormen en meerfasenbeoordeling

Het behalen van een annotatienauwkeurigheid van 99%+ vereist gelaagde kwaliteitscontrole. Standaardwerkprocessen in de branche omvatten vaak:

- Initiële labeling door getrainde annotatoren

- Secundaire beoordeling door ervaren etiketteerders

- Steekproefsgewijze controle door domeinexperts

- Consensusmechanismen voor ambigue gevallen

- Continue kwaliteitsbewaking en feedbackloops

Elke extra laag brengt extra kosten met zich mee, maar blijkt noodzakelijk voor datasets van productiekwaliteit.

Vereisten voor de schaal van de dataset

Effectieve nabewerking na de training vereist aanzienlijke hoeveelheden data. RLHF-implementaties hebben mogelijk tienduizenden vergelijkende beoordelingen nodig. Datasets voor het afstemmen van instructies bevatten vaak honderdduizenden voorbeelden uit diverse taakcategorieën.

Schaal is belangrijk voor generalisatie. Grotere en meer diverse datasets helpen modellen om uitzonderlijke gevallen en ongebruikelijke zoekpatronen beter te verwerken, maar ze verhogen de annotatiekosten evenredig.

Hoe toonaangevende bedrijven de prijs bepalen van diensten voor gegevenslabeling.

De data-labelingsindustrie is uitgegroeid tot een miljardensector met gespecialiseerde spelers.

Volgens brancheanalyses hebben grote bedrijven zoals Scale, Surge, Mercor en Labelbox een explosieve omzetgroei doorgemaakt. Toonaangevende AI-bedrijven zoals OpenAI, Google, Meta en Anthropic besteden elk ongeveer 1 tot 4 biljoen dollar per jaar aan door mensen aangeleverde trainingsdata en feedback om concurrerende modelcapaciteiten te bereiken.

De prijsmodellen variëren per aanbieder en projectcomplexiteit:

| Prijsmodel | Het beste voor | Typisch bereik |

|---|---|---|

| Prijs per artikel | Eenvoudige classificatietaken | $0,01 – $2,00 per etiket |

| Uurtarieven | Complexe annotatie die expertise vereist | $15 – $200+ per uur |

| Offertes op projectbasis | Grootschalige initiatieven met een duidelijk omschreven scope | $50.000 – $10M+ |

| Beheerde servicecontracten | Doorlopende labelbehoeften met kwaliteits-SLA's | Aangepaste prijzen voor bedrijven |

Eerlijk gezegd: gepubliceerde tarieven vertellen zelden het hele verhaal. Zakelijke contracten omvatten volumekortingen, kwaliteitsgaranties, levertijdafspraken en toegang tot gespecialiseerd gereedschap – factoren die allemaal van invloed zijn op de uiteindelijke kosten.

Een vergelijking van datalabelingskosten versus rekenkosten in de praktijk.

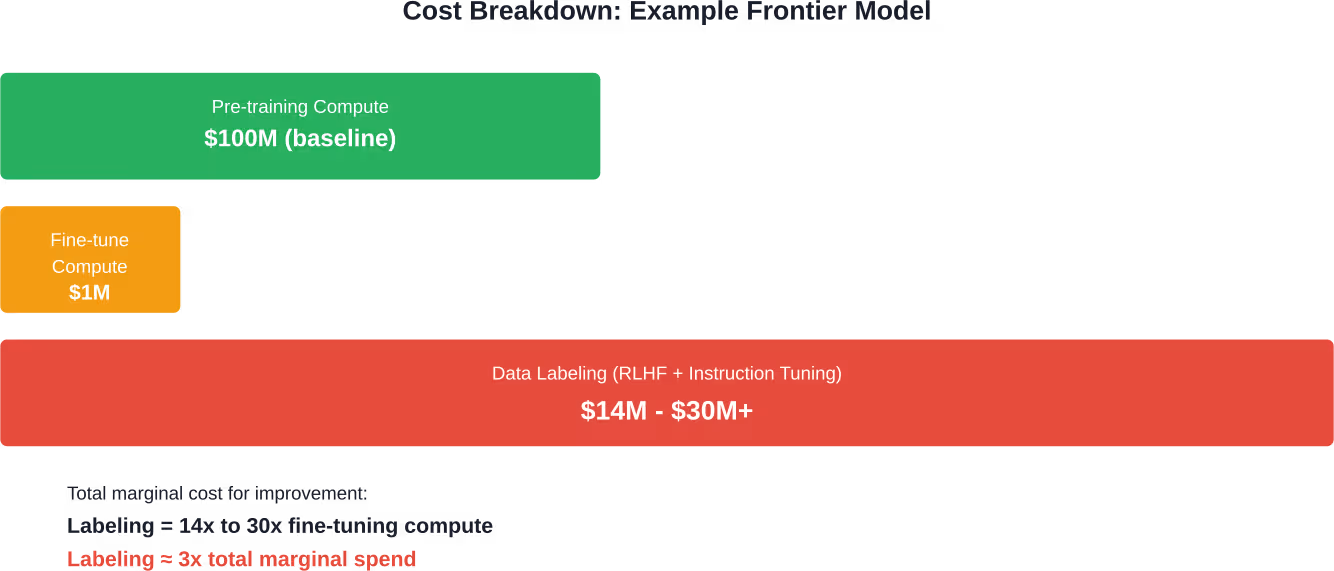

De kostenstructuur van een LLM-opleiding is fundamenteel veranderd.

Pre-training vergt nog steeds aanzienlijke rekenkracht. Het trainen van grensmodellen op triljoenen tokens vereist enorme GPU-clusters die weken of maanden draaien. Maar het punt is: de rekenkosten zijn voorspelbaarder en, relatief gezien, beter beheersbaar geworden.

Cloudproviders bieden gereserveerde capaciteit en langetermijncontracten die de tarieven vastleggen. De efficiëntie van GPU's blijft verbeteren. Trainingstechnieken zoals rekenen met gemengde precisie en gradient checkpointing verminderen de benodigde resources.

Het labelen van data verloopt daarentegen anders. De menselijke capaciteit verdubbelt niet elke 18 maanden. De beschikbaarheid van experts blijft beperkt. Kwaliteitscontrole kan niet oneindig parallel worden uitgevoerd.

De economische aspecten worden duidelijk wanneer we specifieke modelontwikkelingscycli bekijken. Voor modellen die zich richten op gespecialiseerde domeinen (juridisch, medisch, wetenschappelijk) verergert de hoge expertise het probleem. Het vinden van gekwalificeerde annotatoren kost tijd. Het trainen van hen in annotatierichtlijnen kost nog meer tijd. Het waarborgen van consistentie binnen grote teams vereist geavanceerd management.

Kostenvariaties per type annotatietaak

Niet alle etiketteertaken hebben hetzelfde prijskaartje.

RLHF-voorkeurslabeling

Reinforcement learning op basis van menselijke feedback vereist dat annotatoren de modeluitvoer vergelijken en voorkeuren aangeven. Taken omvatten:

- Het lezen van twee of meer voorbeeldantwoorden op dezelfde vraag.

- Kwaliteit beoordelen op meerdere dimensies (nauwkeurigheid, behulpzaamheid, veiligheid, toon)

- Het beste antwoord selecteren of meerdere opties rangschikken

- Soms is het nodig om schriftelijke onderbouwing te geven voor de gemaakte keuzes.

De complexiteit varieert enorm. Eenvoudige voorkeursbeoordelingen op basis van ongecompliceerde vragen kunnen $2-5 per vergelijking kosten. Genuanceerde evaluaties die domeinexpertise vereisen, kunnen $20-100+ per vergelijkingsset kosten.

Bij datasets die 50.000 tot 200.000 vergelijkingen vereisen, lopen de kosten al snel op tot zes of zeven cijfers.

Aanmaken van een dataset voor instructie-tuning

Het opbouwen van datasets die instructies opvolgen, vereist ander werk. Annotatoren creëren:

- Diverse opdrachten die meerdere taakcategorieën omvatten.

- Referentieantwoorden van hoge kwaliteit die het gewenste gedrag demonstreren

- Variaties die betrekking hebben op uitzonderlijke gevallen en verschillende formuleringen.

- Gesprekken die meerdere beurten beslaan en blijk geven van contextueel begrip.

Het creëren van originele, hoogwaardige instructie-antwoordparen kost aanzienlijk meer tijd dan het simpelweg labelen van voorkeuren. Een percentage van $10-50 per instructiepaar is gebruikelijk voor algemene taken. In gespecialiseerde domeinen (programmeren, wiskunde, wetenschappelijk redeneren) kan dit oplopen tot $50-200+ per voorbeeld.

Classificatie en entiteitsherkenning

Traditionele NLP-labeltaken blijven relevant voor gespecialiseerde toepassingen:

- Named entity recognition in domain-specific texts

- Sentimentclassificatie met gedetailleerde categorieën

- Intentieclassificatie voor conversatiesystemen

- Relaties extraheren uit ongestructureerde documenten

Deze taken kosten over het algemeen minder dan RLHF of het afstemmen van instructies – vaak tussen de $0,05 en $2,00 per item, afhankelijk van de complexiteit en de vereiste expertise.

Multimodale annotatie

Visueel-taalmodellen hebben gelabelde beeld-tekstparen, video-annotaties en crossmodale uitlijningsgegevens nodig. De complexiteit neemt toe met:

- Gedetailleerde beeldonderschriften die uitgebreide beschrijvingen vereisen.

- Objectdetectie en -segmentatie in complexe scènes

- Videobegripstaken die een beroep doen op temporeel redeneren.

- 3D-annotatie voor ruimtelijk inzicht

Het labelen met behulp van computervisie kent een eigen kostenstructuur, die vaak hoger ligt dan die van pure tekstannotatie vanwege de vereiste specialistische tools en de hogere cognitieve belasting.

Strategieën om de kosten voor het labelen van LLM-gegevens te verlagen

Slimme teams optimaliseren hun budget voor annotaties zonder in te boeten aan kwaliteit.

Actief leren en selectieve annotatie

Waarom alles labelen als modellen hun eigen zwakke punten kunnen identificeren?

Frameworks voor actief leren raadplegen het model om voorbeelden te vinden waar het het meest onzeker is of waar aanvullende gegevens de meeste waarde zouden opleveren. Dit richt de annotatie-inspanning op de plekken waar het er het meest toe doet, waardoor het labelvolume mogelijk met 50-80% wordt verminderd, terwijl de modelprestaties vergelijkbaar blijven.

Het arXiv-artikel over kostenbewuste LLM-gebaseerde online datasetannotatie onderzoekt hoe geautomatiseerde systemen strategisch kunnen selecteren welke voorbeelden handmatige annotatie vereisen, waarbij kostenbeperkingen worden afgewogen tegen kwaliteitsdoelen.

LLM-ondersteunde annotatie

Grote taalmodellen kunnen het labelproces versnellen. Werkprocessen omvatten:

- GPT-4 of Claude gebruiken om initiële labels te genereren.

- Menselijke beoordelaars valideren en corrigeren de LLM-uitkomsten.

- Deskundige tijd inzetten voor complexe zaken of kwaliteitsborging.

- Het ontwikkelen van consensusmechanismen tussen LLM en menselijke beoordelingen.

Deze aanpak kan de kosten met 40-70% verlagen in vergelijking met volledige handmatige annotatie, terwijl de kwaliteitsnormen behouden blijven. Zorgvuldige validatie blijft echter essentieel om systematische LLM-fouten op te sporen.

Gefaseerde labelworkflows

Stem de expertise van de annotator af op de complexiteit van de taak:

- Junior etiketteerders verwerken eenvoudige gevallen tegen lagere tarieven.

- Ervaren annotatoren buigen zich over ambigue of lastige voorbeelden.

- Domeinexperts richten zich uitsluitend op gespecialiseerde inhoud.

- Geautomatiseerde kwaliteitscontroles leiden artikelen naar de juiste niveaus.

Geavanceerde orkestratie maximaliseert de kostenefficiëntie en waarborgt tegelijkertijd de kwaliteit van onderdelen die echt deskundige aandacht vereisen.

Hergebruik van datasets en synthetische data-augmentatie

Elk nieuw project hoeft niet helemaal vanaf nul te beginnen. Organisaties kunnen:

- Bouw de kerngegevenssets eenmalig op en hergebruik ze in meerdere modeliteraties.

- Licentieer bestaande datasets van hoge kwaliteit indien beschikbaar.

- Genereer synthetische varianten van gelabelde voorbeelden.

- Deel datasets met gerelateerde projecten binnen de organisatie.

Maar pas op: de licentiekosten voor datasets kunnen zelf ook hoog oplopen, omdat aanbieders de strategische waarde van data inzien. Recente deals tussen AI-laboratoria en contentaanbieders voor toegang tot eigen tekstbronnen hebben bedragen van honderden miljoenen dollars opgeleverd.

Bespaar op onnodige kosten voor etikettering voordat je begint met trainen.

De kwaliteit van de data is waar de meeste kosten van LLM ongemerkt oplopen. Het oplossen van labelproblemen na de training is duur, en slecht voorbereide datasets leiden tot meer iteraties in plaats van betere modellen. Dit is waar het probleem begint. AI Superieur Het past doorgaans goed in het plaatje – niet als leverancier van labels, maar als de laag die ervoor zorgt dat de labels daadwerkelijk leiden tot bruikbare modelprestaties.

Ze verzorgen de dataverzameling, -opschoning en -voorverwerking als onderdeel van de modelpipeline, zodat datasets vanaf het begin gestructureerd zijn voor training en niet later worden aangepast. Dit omvat het afstemmen van de data op de use case, het verminderen van ruis en het voorbereiden ervan voor fine-tuning workflows die geen rekenkracht of budget verspillen. Als uw labelkosten blijven stijgen, maar de modelkwaliteit niet, ligt het probleem meestal stroomopwaarts. Repareer de pipeline voordat u deze opschaalt – neem contact op met AI Superieur en krijg duidelijkheid over wat uw kosten nu eigenlijk drijft.

De strategische implicaties voor de ontwikkeling van AI

De kosten voor het labelen van data veranderen de manier waarop organisaties de ontwikkeling van LLM-programma's aanpakken.

Kleinere bedrijven staan voor een uitdagende realiteit. Zonder de middelen om grootschalige annotatieprojecten te financieren, wordt het moeilijk om te concurreren met goed gefinancierde laboratoria. Dit kan leiden tot consolidatiedruk in de AI-industrie: bedrijven met meer financiële middelen kunnen zich betere datasets en daardoor betere modellen veroorloven.

Ook economische overwegingen zijn gunstig voor bepaalde architectuurkeuzes. Kleine taalmodellen (SLM's) met 1 tot 15 miljard parameters vereisen minder trainingsdata en kunnen sterke prestaties leveren op specifieke domeinen. Terwijl geavanceerde taalmodellen meer dan 1 tot 4 biljoen dollar kosten om te trainen, verlagen SLM's de kosten per miljoen zoekopdrachten met meer dan een factor 100 en vereisen ze proportioneel kleinere budgetten voor annotatie en finetuning.

Organisaties evalueren de afweging tussen zelf ontwikkelen en kopen steeds vaker vanuit een data-perspectief. Het verfijnen van bestaande basismodellen is vaak economisch aantrekkelijker dan het trainen van een volledig nieuw model – je betaalt in feite alleen voor annotaties, zonder de enorme rekenkosten die gepaard gaan met de voorbereiding.

Dit heeft de toepassing van fine-tuning versneld. Volgens analyses van modelimplementatiepatronen kan fine-tuning 60-90% besparen ten opzichte van volledige pre-training, terwijl vergelijkbare taakspecifieke prestaties worden behaald.

| Benadering | Bereken de kosten | Kosten voor gegevenslabeling | Het beste voor |

|---|---|---|---|

| Voorbereiding vanaf nul | $50M – $200M+ | Minimaal (zonder toezicht) | Ontwikkeling van grensmodellen |

| Het funderingsmodel verfijnen | $10K – $1M | $50K – $15M | Domeinspecialisatie |

| Alleen snelle technische ondersteuning | Bijna nul | $5K – $50K (enkele-shot voorbeelden) | Snelle prototyping, eenvoudige taken |

| Training met kleine modellen | $5K – $500K | $10K – $500K | Edge-implementatie, kostenbewuste apps |

Trends in de sector en toekomstperspectieven

Wat zijn de volgende stappen in de economie van datalabeling?

De groeicijfers zullen naar verwachting afzwakken na de buitengewone sprong van 88 keer die tussen 2023 en 2024 te zien was. Een groot deel van die piek was te danken aan de snelle schaalvergroting bij specifieke bedrijven zoals Mercor. Maar de absolute bedragen blijven stijgen naarmate meer organisaties LLM-ontwikkeling nastreven en bestaande laboratoria hun modellen blijven verbeteren.

Onderzoeksrichtingen die de economie zouden kunnen veranderen, zijn onder meer:

- Geautomatiseerde verificatiemechanismen: Als modellen zichzelf betrouwbaar kunnen controleren of als er goedkope verificatiemethoden ontstaan, kunnen de kosten voor het genereren van grote gelabelde datasets aanzienlijk dalen. Dit blijft een actief onderzoeksgebied.

- Beloningsmodellen die ruis in de data tolereren: De huidige RLHF-implementaties vereisen voorkeurslabels van hoge kwaliteit. Technieken die werken met labels van lagere kwaliteit of gedeeltelijk geautomatiseerde labels zouden de kosten verlagen.

- Constitutionele AI en zelfverbeteringstechnieken: Methoden waarbij modellen verbeteren door zelfkritiek en herziening zouden de afhankelijkheid van menselijke annotatie kunnen verminderen.

- Betere data-efficiëntie: Er wordt voortdurend onderzoek gedaan naar manieren om meer waarde te halen uit minder gelabelde data door middel van verbeterde algoritmen en trainingstechnieken.

De vraag waar de industrie voor staat is: kan automatisering de groeiende kwaliteitseisen en de toenemende toepassingsmogelijkheden compenseren?

Discussies op professionele fora laten zien hoe data-annotatie een echt knelpunt is geworden in de ontwikkeling van AI. Organisaties melden dat ze maanden kwijt zijn aan het werven en trainen van annotatieteams. Kwaliteitsinconsistenties leiden tot projectvertragingen. De beschikbaarheid van experts beperkt de projecttijdlijnen meer dan de beschikbare rekenkracht.

Praktische kostenplanning voor LLM-projecten

Teams die LLM-initiatieven plannen, moeten een realistisch budget opstellen voor data-annotatie.

Voor een middelgroot project gericht op domeinspecifieke verbetering:

- RLHF-dataset (20.000 vergelijkingen, gemiddelde complexiteit): $100K – $400K

- Dataset voor instructie-tuning (10.000 voorbeelden, algemeen domein): $80K – $300K

- Kwaliteitsborging en validatie (20% aan gegevens): $36K – $140K

- Projectmanagement en hulpmiddelen: $25K – $100K

Totaal budget voor annotaties: $241K – $940K

Het finetunen van de rekenkracht voor hetzelfde project kan $50K tot $200K kosten. De annotatiekosten zijn het grootst, precies zoals de branchegegevens voorspellen.

Voor grotere initiatieven gericht op grensverleggende vaardigheden schalen de budgetten navenant mee. Projecten met meer dan 100.000 gelabelde voorbeelden en de noodzaak van deskundige annotatoren kunnen gemakkelijk oplopen tot 14.000 tot 15 miljoen dollar aan labelkosten alleen al.

Het kiezen van aanbieders van data-etikettering

De keuze voor de juiste annotatiepartner heeft een aanzienlijke invloed op zowel de kosten als de kwaliteit.

De evaluatiecriteria moeten het volgende omvatten:

- Kwaliteitsgeschiedenis: Vraag naar casestudies en referentieklanten die aan vergelijkbare taken werken. Informeer naar de behaalde nauwkeurigheidspercentages en kwaliteitscontrolemechanismen.

- Expertise van de annotator: Controleer of de aanbieder toegang heeft tot domeinexperts die relevant zijn voor het project. Generieke crowdsourcingplatforms hebben moeite met gespecialiseerde content.

- Mogelijkheden van de gereedschappen: Moderne annotatieplatformen bieden efficiëntieverhogende functies die de kosten per item verlagen, zoals intelligente taakroutering, geautomatiseerde kwaliteitscontroles, samenwerkingsfuncties en integratie met machine learning-pipelines.

- Schaalbaarheid: Kan de dienstverlener de capaciteit opschalen om een piek in de vraag aan te kunnen? Beschikken ze over voldoende personeel voor grote of urgente projecten?

- Beveiliging en naleving: Controleer bij gevoelige gegevens of de juiste certificeringen, gegevensverwerkingsprotocollen en contractuele beschermingsmaatregelen aanwezig zijn.

- Prijstransparantie: Pas op voor leveranciers die pas laat in het verkoopproces over de prijs willen praten. Voorspelbaarheid van de kosten is belangrijk voor de projectplanning.

Toonaangevende aanbieders in deze sector hebben gespecialiseerde workflows ontwikkeld die geoptimaliseerd zijn voor LLM-trainingsdata. Volgens informatie van Scale AI beschikken ze over grote, getrainde teams voor data-labeling en eigen tools die specifiek zijn ontworpen voor ML-toepassingen.

De onderzoeksagenda voor data-economie

Academische en industriële onderzoekers beginnen data te beschouwen als een eigen economisch vakgebied.

Een onderzoeksagenda die op arXiv is gepubliceerd (The Economics of AI Training Data) merkt op dat data, ondanks de centrale rol die het speelt in de ontwikkeling van AI, de minst begrepen input blijft. Nu AI-laboratoria publieke data uitputten en zich via deals van honderden miljoenen dollars tot eigen bronnen wenden, is het onderzoek gefragmenteerd geraakt over informatica, economie, recht en beleid.

Belangrijke open vragen zijn onder meer:

- Hoe moet data als een aparte productiefactor worden gewaardeerd?

- Welke marktstructuren zullen er ontstaan voor de uitwisseling van trainingsgegevens?

- Welke invloed hebben intellectuele-eigendomsrechten op de beschikbaarheid en kosten van gegevens?

- Wat zijn de gevolgen van dataconcentratie voor het welzijn?

- Kunnen mechanismen een eerlijke vergoeding garanderen voor de makers van data?

Dit zijn niet zomaar theoretische zorgen. Ze hebben directe gevolgen voor wie het zich kan veroorloven om concurrerende AI-systemen te bouwen en wat die systemen kunnen doen.

De verschuiving van knelpunten in rekenkracht naar knelpunten in data vertegenwoordigt een fundamentele verandering in de economie van AI. Het is moeilijker om menselijke expertise op te schalen dan om meer GPU's toe te voegen. Het is moeilijker om genuanceerde oordelen te automatiseren dan om matrixvermenigvuldigingen te paralleliseren.

Deze realiteit zal de AI-industrie de komende jaren vormgeven.

Veelgestelde vragen

Wat zijn de kosten voor het labelen van data bij een typisch LLM-finetuningproject?

De kosten voor het labelen van data voor het finetunen van LLM-modellen variëren sterk, afhankelijk van de complexiteit van de taak en de omvang van de dataset. Een project van gemiddelde omvang met 20.000-30.000 gelabelde voorbeelden kost doorgaans $200.000-$900.000. Eenvoudige classificatietaken aan de onderkant van de schaal kunnen $0,05-$2 per item kosten, terwijl complexe RLHF-vergelijkingen die domeinexpertise vereisen $20-$100+ per vergelijking kunnen kosten. Expertannotatie voor gespecialiseerde domeinen (medisch, juridisch, wetenschappelijk) brengt hogere tarieven met zich mee van $50-$200+ per uur.

Waarom zijn de kosten voor data-annotatie sneller gestegen dan de rekenkosten?

De kosten voor het labelen van data zijn tussen 2023 en 2024 maar liefst 88 keer zo hoog geworden, terwijl de rekenkosten slechts met een factor 1,3 zijn gestegen. Dit enorme verschil komt doordat post-trainingstechnieken (RLHF, supervised fine-tuning) essentieel zijn geworden voor concurrerende modellen. Deze methoden vereisen uitgebreide handmatige annotatie, vaak door domeinexperts. Tegelijkertijd blijft de efficiëntie van GPU's verbeteren en bieden cloudproviders concurrerendere tarieven, waardoor de rekenkosten relatief stabiel blijven, zelfs nu de labelkosten sterk stijgen.

Kunnen LLM's hun eigen data-labeling automatiseren om kosten te besparen?

LLM's kunnen helpen bij het labelen, maar kunnen dit niet volledig automatiseren zonder kwaliteitsrisico's. Gangbare benaderingen omvatten het gebruik van GPT-4 of Claude om initiële labels te genereren, waarna menselijke beoordelaars de resultaten valideren. Deze hybride aanpak kan de kosten met 40-70% verlagen in vergelijking met volledige handmatige annotatie. Zorgvuldige kwaliteitscontrole blijft echter essentieel, aangezien LLM's systematische fouten of vertekeningen kunnen introduceren. Het arXiv-artikel over kostenbewuste annotatie onderzoekt raamwerken voor het optimaal afwegen van geautomatiseerde LLM-labeling tegen de kosten van handmatige verificatie.

Wat is duurder: een LLM helemaal vanaf nul trainen of een bestaand model verfijnen?

Het trainen van geavanceerde modellen vanaf nul kost 1 TP4T50-200+ miljoen, voornamelijk aan rekenkracht, terwijl het finetunen van bestaande modellen doorgaans 1 TP4T10.000-1 TP4T1 miljoen aan rekenkracht kost. Finetuning vereist echter aanzienlijke budgetten voor data-annotatie – vaak 1 TP4T50.000 tot 1 TP4T15 miljoen, afhankelijk van de grootte van de dataset en de complexiteit van de taak. Ondanks de hogere annotatiekosten levert finetuning nog steeds een totale kostenbesparing op van 60-901 TP3T ten opzichte van pre-training, terwijl tegelijkertijd sterke taakspecifieke prestaties worden behaald. Voor de meeste organisaties is finetuning economisch gezien de meest aantrekkelijke optie.

Hoe verhouden Small Language Models (SLM's) zich tot LLM's qua kosten?

SLM's met 1 tot 15 miljard parameters verlagen de trainings- en inferentiekosten aanzienlijk. Het trainen van SLM's kost 1 TP4T5.000 tot 1 TP4T500.000 aan rekenkracht, vergeleken met 1 TP4T50 tot meer dan 200 miljoen voor geavanceerde LLM's. De vereisten voor data-labeling schalen proportioneel kleiner, doorgaans 1 TP4T10.000 tot 1 TP4T500.000 voor specifieke domeinen. SLM's verlagen de kosten per miljoen query's met meer dan een factor 100 in vergelijking met grote modellen. Voor toepassingen met een specifieke reikwijdte en implementatiescenario's aan de rand van het netwerk bieden SLM's aantrekkelijke kostenvoordelen met behoud van een acceptabele nauwkeurigheid voor de beoogde taken.

Welke strategieën verlagen effectief de kosten voor data-annotatie zonder dat dit ten koste gaat van de kwaliteit?

Verschillende beproefde strategieën verlagen de kosten met behoud van kwaliteit: Actief leren vermindert het labelvolume met 50-80% door voorbeelden te identificeren waar annotatie de maximale waarde oplevert. Workflows met LLM-ondersteuning gebruiken modellen om initiële labels te genereren, waarbij mensen de output valideren – wat de kosten met 40-70% verlaagt. Gelaagde workflows stemmen de expertise van annotatoren af op de moeilijkheidsgraad van de taak, waarbij dure experts worden ingezet voor echt complexe gevallen. Hergebruik van datasets spreidt de investering in annotatie over meerdere projecten. Selectieve steekproeven van hoge kwaliteit leveren vaak betere resultaten op dan grotere datasets van lagere kwaliteit voor fine-tuning.

Zullen de kosten voor data-etikettering in het huidige tempo blijven stijgen?

De buitengewone groei van 88 keer tussen 2023 en 2024 zal waarschijnlijk afzwakken, aangezien een groot deel van die piek het gevolg was van snelle schaalvergroting bij specifieke bedrijven. De absolute kosten voor het labelen van data blijven echter stijgen naarmate meer organisaties LLM-ontwikkeling nastreven en de kwaliteitsnormen toenemen. Experts verwachten dat datalabeling de belangrijkste marginale kostenpost zal blijven voor grensverleggende modellen tot en met 2026 en daarna. Onderzoek naar geautomatiseerde verificatie, ruistolerante training en zelfverbeteringstechnieken zou uiteindelijk de afhankelijkheid van dure menselijke annotatie kunnen verminderen, maar baanbrekende oplossingen op grote schaal zijn nog niet beschikbaar.

Conclusie

De economische aspecten van de ontwikkeling van LLM-programma's zijn fundamenteel veranderd.

Wat ooit een door computers gedomineerd vakgebied was, ziet nu dat menselijke annotatie het grootste deel van de budgetten opslokt. De kosten voor data-annotatie zijn in één jaar tijd 88 keer zo hoog geworden, terwijl de computerkosten slechts met een factor 1,3 zijn gestegen. Voor organisaties die modellen bouwen of verfijnen, vertegenwoordigen annotatiekosten nu ongeveer drie keer de kosten voor computergebruik.

Dit is geen tijdelijke afwijking. Technieken na de training die menselijke feedback vereisen, zijn essentieel gebleken voor het creëren van modellen die betrouwbaar werken in een productieomgeving. RLHF, instructie-tuning en gespecialiseerde fine-tuning zijn allemaal afhankelijk van zorgvuldig samengestelde, deskundig gelabelde datasets. De tijd van experts kost geld – heel veel geld.

De casestudies spreken voor zich. MiniMax-M1 besteedde 28 keer meer aan annotatie dan aan rekenkracht voor de training. Het labelbudget van SkyRL-SQL was 167 keer hoger dan de rekenkosten. Deze verhoudingen weerspiegelen de nieuwe norm in de AI-ontwikkeling.

Slimme teams optimaliseren hun annotatiebudgetten door actief leren, workflows met behulp van leerplatformen en gelaagde labelstrategieën. Maar de fundamentele realiteit is onontkoombaar: het bouwen van concurrerende leerplatformen vereist een forse investering in hoogwaardige, door mensen gelabelde data.

Organisaties die in 2026 LLM-projecten plannen, dienen hier rekening mee te houden in hun budget. Data-annotatie zal naar verwachting 45-601 TP3T van de totale projectkosten uitmaken voor serieuze initiatieven. Werk samen met ervaren annotatieaanbieders, investeer in kwaliteitscontrole en plan langere tijdschema's dan alleen op basis van rekenkracht zou worden geschat.

Het knelpunt is verschoven van silicium naar menselijke expertise. Inzicht in deze verschuiving – en de planning voor de financiële gevolgen ervan – onderscheidt succesvolle LLM-initiatieven van ondergefinancierde mislukkingen.

Heeft u hulp nodig bij het plannen van uw budget voor data-annotatie voor uw LLM-project? Om de werkelijke kosten van annotatie te begrijpen, moet u uw specifieke gebruikssituatie, kwaliteitseisen en schaal analyseren. Neem contact op met ervaren aanbieders voor nauwkeurige projectramingen voordat u middelen investeert.