Korte samenvatting: De kostenoptimalisatie van LLM in 2026 draait om slimme orchestratiestrategieën: prompt caching verlaagt de kosten voor herhaalde taken met maximaal 901 TP3T, hybride SLM+LLM-routering verlaagt de kosten met 70-801 TP3T, en token-efficiënte technieken zoals contextcompressie leveren besparingen op van 44-891 TP3T. De sleutel is om eerst het gebruik te meten en vervolgens gerichte optimalisaties toe te passen, zoals semantische caching, batchverwerking en modelselectie op basis van taakcomplexiteit in plaats van standaard dure grensmodellen te gebruiken.

Productieomgevingen met LLM-implementaties hebben een vies geheim: veel organisaties verbruiken onnodig grote hoeveelheden tokens. De boosdoener is niet alleen de modelselectie, maar ook het ontbreken van systematische optimalisatie in de gehele inferentiepipeline.

Neem dit concrete scenario uit de praktijk: een supportchatbot die maandelijks 500.000 verzoeken afhandelt met 1.500 tokens per verzoek, verbruikt ongeveer 1 TP4T18.000 per maand. Dat is 1 TP4T216.000 per jaar voor één enkele functionaliteit. Maar hier wordt het interessant: dezelfde workload, geoptimaliseerd met caching, routing en contextbeheer, daalt naar 1 TP4T27.000-1 TP4T50.000 per jaar.

Het verschil? Strategisch kostenbeheer waarbij tokenverbruik als een prioriteit binnen de engineering wordt beschouwd, en niet als een bijzaak.

De werkelijke kosten van LLM-activiteiten in 2026

De inferentiekosten van LLM schalen niet op dezelfde manier als traditionele computerberekeningen. Een enkele modelaanroep kost misschien een fractie van een cent, maar vermenigvuldig dat met miljoenen aanvragen en de economische gevolgen veranderen drastisch.

Bij prijsstelling op basis van tokens telt elk woord. Inputtokens (uw prompts) en outputtokens (reacties van het model) hebben elk een eigen prijs. Op Amazon Nova Micro kosten inputtokens $0.000035 per duizend, terwijl outputtokens $0.00014 per duizend kosten – een verschil van ongeveer factor 4. Voor grotere modellen zoals GPT-4 wordt dat verschil nog groter.

Eerlijk gezegd: de meeste kostenoverschrijdingen ontstaan doordat teams hun systemen niet goed monitoren. Zonder inzicht in de verbruikspatronen van tokens wordt optimalisatie een kwestie van gissen. Onderzoek naar energieverbruik bij LLM-inferentie toont aan dat decodering (het genereren van uitvoer) de grootste kostenpost is, waarbij het onderdrukken van brabbelgeluiden een energiebesparing oplevert van 441 TP3T tot 891 TP3T zonder de nauwkeurigheid van de generatie te beïnvloeden.

Waar gaan de kosten van een LLM-opleiding schuil?

Het tellen van tokens geeft slechts een gedeeltelijk beeld. Verborgen kosten stapelen zich op over meerdere dimensies:

- Overbodige verwerking: Identieke of vergelijkbare zoekopdrachten worden opnieuw verwerkt zonder caching.

- Te grote contexten: Het versturen van volledige gespreksgeschiedenissen wanneer samenvattingen volstaan.

- Verkeerde modelkeuze: Grensmodellen gebruiken voor taken die kleinere modellen goed aankunnen.

- Inefficiënt gereedschapsgebruik: Uitgebreide functieschema's en overbodige toolaanroepen

- Slechte batchverwerking: Verzoeken individueel verwerken in plaats van in batches, indien de latentie dit toelaat.

Elke inefficiëntie versterkt de problemen. Een systeem dat de verkeerde modelkeuze maakt, niet cachet én opgeblazen contexten verstuurt, kan gemakkelijk 5 tot 10 keer meer tokens verbruiken dan geoptimaliseerde alternatieven.

Meten voordat je gaat beheren: Instrumentatie eerst

De meest effectieve strategie voor kostenoptimalisatie begint met meten. Teams die hun LLM-activiteiten instrumenteren voordat ze optimaliseren, presteren consequent beter dan teams die blindelings optimalisaties toepassen.

Met de juiste meetinstrumenten kunnen meerdere dimensies per verzoek worden vastgelegd:

| Metrisch | Waarom het belangrijk is | Optimalisatiesignaal |

|---|---|---|

| Aantal invoertokens | Directe kostenfactor | Contextoverload, inefficiënte prompts |

| Aantal uitvoertokens | Doorgaans 2 tot 4 keer duurder | Uitgebreide antwoorden, gebrabbel |

| Gebruikt model | Verschillende prijsniveaus | Mogelijkheden voor overbevoorrading |

| Latentie | Impact op de gebruikerservaring | Cachingkandidaten |

| Cache-hitpercentage | Werkelijke kosten die vermeden zijn | Effectiviteit van caching |

| Attributie-metadata | Kostenallocatie | Gebruikers/functies met hoge kosten |

Toewijzing is belangrijker dan de meeste teams beseffen. Door verzoeken te taggen met project-ID, team-ID, omgeving en feature-vlaggen is een gedetailleerde kostenanalyse mogelijk. Die chatbot van $18.000 per maand? Instrumentatie zou kunnen aantonen dat 70% aan kosten afkomstig zijn van 15% aan gebruikers – wat gerichte optimalisatiemogelijkheden oplevert.

Een kostenbewakingssysteem opzetten

Een infrastructuur voor kostenbeheer hoeft niet complex te zijn. Een minimaal werkend systeem omvat het volgende:

- Tijdstempel en aanvraag-ID voor correlatie

- Modelidentificatie en provider

- Aantal tokens (invoer, uitvoer, in cache)

- Berekende kosten in een gangbare valuta.

- Attributielabels (gebruiker, functie, omgeving)

- Kwaliteitsindicatoren voor de respons, indien beschikbaar.

Sla deze gegevens op in een tijdreeksdatabase of datawarehouse dat aggregatiequery's ondersteunt. Dagelijkse kostenoverzichten moeten trends per model, functie en gebruikerssegment weergeven. Wekelijkse evaluaties identificeren optimalisatiemogelijkheden voordat ze tot budgetcrises leiden.

Promptcaching: de snelste winst met de grootste impact

Promptcaching levert de grootste kostenbesparing op voor de meeste productieworkloads. Het mechanisme is eenvoudig: providers zoals Anthropic en OpenAI cachen de sleutel-waardematrices van aandachtsberekeningen voor promptprefixes. Wanneer volgende verzoeken dezelfde prefix delen, kosten de gecachede gedeeltes 90% minder.

Op Amazon Bedrock verlaagt promptcaching de latentie van inferentiereacties met maximaal 85% en de kosten van invoertokens met maximaal 90%. De berekening is overtuigend: een prompt van 10.000 tokens die $0,30 per aanvraag kost, daalt naar $0,03 wanneer deze in de cache wordt opgeslagen – een besparing van $0,27 per aanvraag.

Maar de effectiviteit van caching hangt volledig af van de aanvraagpatronen. Een hoge cachehitrate vereist stabiele promptstructuren met variabele inhoud die op voorspelbare posities wordt ingevoegd.

Cachevriendelijke prompts ontwerpen

Cacheoptimalisatie begint met een goede promptarchitectuur. Plaats statische content – systeeminstructies, korte voorbeelden, documentatieverwijzingen – vooraan. Variabele content, zoals gebruikersvragen en sessiespecifieke gegevens, komt aan het einde.

Slechte structuur:

Gebruikersquery: [VARIABELE]

Systeeminstructies: [STATISCH 5000 tokens]

Voorbeelden: [STATISCH 3000 tokens]

Geoptimaliseerde structuur:

Systeeminstructies: [STATISCH 5000 tokens]

Voorbeelden: [STATISCH 3000 tokens]

Gebruikersquery: [VARIABELE]

De tweede aanpak cachet 8.000 tokens per verzoek. Bij een gebruikelijke prijsstelling verlaagt een workload met een cache-hitrate van 801 TP3T de kosten met 721 TP3T in vergelijking met geen caching.

Het beleid voor het verwijderen van cachegeheugen verschilt per provider. De cache van Anthropic verloopt na 5 minuten inactiviteit. Bij aanhoudende workloads kan het zinvol zijn om "warme" caches met periodieke verzoeken te onderhouden, mits het aanvraagvolume dit rechtvaardigt.

Wanneer caching loont

Niet elke workload profiteert evenveel van caching. Bereken de verwachte besparingen:

Break-even cache hit rate = Cache schrijfkosten / (Kosten niet-gecacheerd – Kosten gecacheerd)

Bij prompts met minder dan 1000 tokens overtreffen de cachekosten vaak de besparingen, tenzij de hitfrequentie hoger is dan 85-90%. Optimale resultaten worden bereikt bij:

- Grote statische contexten (documentatie, kennisbanken)

- Herhaalde systeeminstructies bij verschillende verzoeken.

- Enkele voorbeelden bij elke prompt

- Gespreksgeschiedenis met toegevoegde nieuwe berichten

Een documentatiechatbot met context van 15.000 tokens en zoekopdrachten van 500 woorden heeft daar enorm veel baat bij. Een creatieve schrijfassistent die elke keer unieke verhalen genereert? Waarschijnlijk niet.

Semantische caching: verder dan exacte overeenkomsten

Traditionele caching vereist identieke invoer. Semantische caching erkent dat vragen als "Hoe reset ik mijn wachtwoord?" en "Wat is de procedure voor wachtwoordherstel?" dezelfde gecachede respons verdienen.

De implementatie maakt gebruik van vector-embeddings om de gelijkenis tussen zoekopdrachten te meten. Elk verzoek genereert een embedding (doorgaans 100-300 dimensies), die wordt vergeleken met in de cache opgeslagen embeddings met behulp van cosinusgelijkenis of andere afstandsmetrieken. Wanneer de gelijkenis een drempelwaarde overschrijdt (meestal 0,85-0,95), wordt het antwoord uit de cache geretourneerd in plaats van de LLM aan te roepen.

Semantische caching werkt op een ander niveau dan promptcaching van de provider. Promptcaching verlaagt de kosten van invoertokens voor cachehits, maar roept nog steeds het model aan. Semantische caching vermijdt de modelaanroep volledig, waardoor zowel invoer- als uitvoerkosten plus latentie worden geëlimineerd.

Het bouwen van een semantische cachelaag

Effectieve semantische caching vereist verschillende componenten:

- Inbeddingsmodel: Lichtgewicht en snel (Sentence-BERT, MiniLM)

- Vectordatabase: Redis, Pinecone, Qdrant of vergelijkbare tools voor een zoekopdracht naar overeenkomsten.

- Cache-sleutelgeneratie: Combinatie van embedding-gelijkenis en metadatafilters

- Afstemming van de gelijkenisdrempel: Balans tussen cache-hitrate en relevantie van de respons

- TTL-beleid: Vervaldatum voor tijdsgebonden inhoud

De drempelwaarde voor gelijkenis is van groot belang. Een te hoge waarde (0,98 of hoger) zorgt voor een onnodige daling van het aantal cachehits. Een te lage waarde (0,80 of lager) leidt tot irrelevante cache-reacties en vermindert de kwaliteit. Begin bij 0,90 en pas de waarde aan op basis van handmatige beoordeling van grensgevallen.

Metadatafiltering voorkomt ongepaste cachehits. Een vraag over de prijs van product A mag geen cache-antwoorden over de prijs van product B opleveren, zelfs niet bij een hoge semantische gelijkenis. Voorzie cache-items van relevante attributen (product, gebruikerssegment, datumbereik) en vereis naast semantische gelijkenis ook overeenkomsten in metadata.

Hybride SLM + LLM-routering: modellen afstemmen op taken

De denkfout van het grensmodel gaat ervan uit dat grotere modellen altijd beter presteren. De realiteit is echter genuanceerder. Kleine taalmodellen (SLM's) met 7-9 miljard parameters kunnen veel productietaken uitvoeren tegen 10-50 keer lagere kosten dan alternatieven met 70 miljard of meer parameters.

Onderzoek naar LLM-begeleiding laat zien dat zelfs hints van 10 tot 301 TP3T van de volledige LLM-respons de nauwkeurigheid van SLM aanzienlijk verbeteren, met afnemende meerwaarde boven de 601 TP3T. Deze aanpak kan worden gebruikt in hybride architecturen waar SLM's het meeste werk afhandelen en LLM's gerichte ondersteuning bieden wanneer nodig.

Hybride orchestratie kan verzoeken routeren op basis van complexiteit, waarbij eenvoudige taken mogelijk naar SLM's worden doorgestuurd en complexe redeneringen worden doorverwezen naar grotere modellen.

Intelligente routering implementeren

Effectieve routering vereist een classificatielaag die de complexiteit van de taak voorspelt voordat modellen worden aangeroepen. Verschillende benaderingen werken:

| Routeringsstrategie | Complexiteit | Nauwkeurigheid | kostenimpact |

|---|---|---|---|

| Op regels gebaseerd | Laag | Gematigd | 60-70%-reductie |

| Trefwoordovereenkomst | Laag | Gematigd | 50-65%-reductie |

| Classificatiemodel | Medium | Hoog | 70-80%-reductie |

| Vertrouwensscore | Hoog | Zeer hoog | 75-85%-reductie |

| Cascade met terugvaloptie | Medium | Zeer hoog | 65-80%-reductie |

Regelgebaseerde routering blijkt het eenvoudigst: "Vragen met minder dan 20 tokens gaan naar SLM, vragen met meer dan 100 tokens naar LLM." Dit werkt voor duidelijke onderscheidingen, maar mist nuance.

Classificatiemodellen worden getraind op historische gegevens die zijn gelabeld met de werkelijke complexiteit. Kenmerken zijn onder andere de lengte van de zoekopdracht, de diversiteit van de woordenschat, de aanwezigheid van specifieke trefwoorden en de prestaties van het model in het verleden op vergelijkbare zoekopdrachten. Lichtgewicht classificatiemodellen (100-300 miljoen parameters) zorgen voor minimale vertraging en verbeteren tegelijkertijd de nauwkeurigheid van de routering.

Bij het beoordelen van de betrouwbaarheid wordt een andere aanpak gehanteerd: probeer altijd eerst de SLM, controleer de betrouwbaarheidsscores in het antwoord en schakel pas over naar de LLM wanneer de betrouwbaarheid onder de drempelwaarde daalt. Deze "optimistische routering" minimaliseert onnodige LLM-aanroepen met behoud van kwaliteit.

Het cascadepatroon

Cascading combineert routering met validatie. Elk verzoek begint bij het kleinste geschikte model. Als het antwoord van dat model aan de kwaliteitsdrempels voldoet, wordt het teruggestuurd. Zo niet, dan wordt het verzoek doorgegeven aan het eerstvolgende grotere model.

Kwaliteitsdrempels kunnen onder meer zijn:

- Betrouwbaarheidsscores van het model zelf

- Formaatvalidatie (correct gestructureerde JSON, volledige zinnen)

- Lengtevereisten (minimaal aantal woorden)

- Semantische coherentiecontroles

Onderzoek naar Pyramid MoA-frameworks toont aan dat cascadesystemen de Oracle-basisnauwkeurigheid van 68,11 TP3T evenaren, terwijl ze tot 18,41 TP3T aan rekenkracht besparen. De router stuurt nul-shot-tests door naar onbekende benchmarks en behoudt robuustheid voor verschillende taaktypen.

Het nadeel? Latentie. Cascading voegt de tijdskosten van mislukte pogingen toe. Voor latencygevoelige applicaties presteert directe routing met een classificatiemodel beter dan cascading met validatie.

Contextbeheer en compressie

Contextvensters worden steeds groter – 128.000, 200.000, zelfs 1 miljoen tokens – maar groter is niet altijd beter. Elk token in je context kost geld aan input en beïnvloedt de kosten voor het genereren van output. Overvolle contexten verbruiken budgetten zonder betere resultaten.

Effectief contextmanagement balanceert de volledigheid van informatie met het gebruik van tokens. Het doel: voldoende context bieden voor accurate antwoorden, terwijl overbodige of irrelevante informatie wordt weggelaten.

Contextcompressietechnieken

Onderzoek naar zinsgebonden compressie van de essentie laat zien dat vooraf getrainde LLM's kunnen worden verfijnd om contexten met een factor 2 tot 8 te comprimeren zonder significante prestatievermindering.

Praktische compressiestrategieën omvatten:

- Samenvatting: Vat lange documenten of gespreksgeschiedenissen samen in een overzicht.

- Extractie: Selecteer relevante fragmenten in plaats van volledige documenten te uploaden.

- Snoeien: Verwijder overbodige informatie uit herhaalde contexten.

- Hiërarchische context: Geef een beknopte samenvatting; details zijn op aanvraag beschikbaar.

De gespreksgeschiedenis is een veelgebruikt doelwit voor compressie. In plaats van 50 berichtenparen (100 berichten in totaal) te versturen, kunnen oudere uitwisselingen worden samengevat en alleen recente berichten letterlijk worden opgenomen. Dit reduceert de context doorgaans met 60-80% met minimaal informatieverlies.

Workflows voor het ophalen van documenten profiteren van extractie in plaats van inclusie. In plaats van 10 volledige documentatiepagina's in de context te proppen (15.000 tokens), kunnen relevante secties met in totaal 2.000-3.000 tokens worden geëxtraheerd. Retrieval Augmented Generation (RAG)-architecturen blinken hierin uit, omdat ze vectorgelijkenis gebruiken om relevante passages te identificeren.

Contexten met schuifvensters

Voor lopende gesprekken of monitoringstaken zorgen schuifvensters ervoor dat contexten van vaste grootte behouden blijven door oude informatie te verwijderen zodra nieuwe informatie binnenkomt. De venstergrootte biedt een balans tussen het behoud van context en de kosten.

De implementatie houdt het aantal tokens bij over de verschillende contextelementen heen:

- Systeeminstructies: Vaste toewijzing (bijv. 1.000 tokens)

- Recente berichten: Variabele toewijzing (bijv. laatste 10 transacties, ~3.000 tokens)

- Samenvatting van de oudere context: Vaste toewijzing (bijv. 500 tokens)

- Huidige zoekopdracht: Variabele (gebruikersinvoer)

Wanneer de totale context de limieten overschrijdt, genereer dan een nieuwe samenvatting om oudere, recente berichten op te nemen en verwijder die berichten vervolgens. Dit zorgt voor contextcontinuïteit en beperkt tegelijkertijd het tokenverbruik.

Token-efficiënt gebruik van tools en functieaanroepen

Het aanroepen van LLM-functies maakt gestructureerde interacties met externe systemen mogelijk, maar tooldefinities verbruiken aanzienlijke context. Een complexe API met 20 beschikbare functies kan 5.000 tot 8.000 tokens vereisen, alleen al om die functies te beschrijven – nog voordat er daadwerkelijk werk wordt verricht.

Token-efficiënt toolgebruik optimaliseert zowel tooldefinities als aanroeppatronen om de overhead te minimaliseren en tegelijkertijd de functionaliteit te behouden.

Optimalisatie van gereedschapsschema's

Functiedefinities volgen het JSON Schema-formaat, wat nogal uitgebreid kan zijn. Neem bijvoorbeeld dit omvangrijke voorbeeld:

{

“naam”: “gebruikersinformatie ophalen”,

“beschrijving”: “Deze functie haalt uitgebreide gebruikersinformatie uit de database op, waaronder persoonlijke gegevens, accountstatus, voorkeuren en geschiedenis.”,

“parameters”: {

“type”: “object”,

“"eigenschappen": {

“gebruikersidentificatie”: {

“type”: “string”,

“beschrijving”: “De unieke identificatiecode voor de gebruiker, dit kan de gebruikersnaam of het e-mailadres zijn”

}

}

}

}

Gecomprimeerde versie:

{

“naam”: “get_user”,

“beschrijving”: “Gebruikersgegevens opvragen via gebruikersnaam of e-mailadres”,

“parameters”: {

“type”: “object”,

“"eigenschappen": {

“id”: {“type”: “string”, “description”: “Gebruikersnaam/e-mail”}

}

}

}

De gecomprimeerde versie verkort het aantal tokens met 60%, terwijl de functionaliteit behouden blijft. Pas de volgende principes toe:

- Kortere functienamen indien ondubbelzinnig

- Beknopte beschrijvingen (maximaal 10-15 woorden)

- Afgekort parameternamen

- Minimale parameterbeschrijvingen

- Verwijder optionele parameters die zelden worden gebruikt.

Dynamische toolprovisionering

In plaats van bij elk verzoek alle beschikbare tools aan te bieden, kunt u tools toewijzen op basis van een analyse van de zoekopdracht. Een vraag over 'gebruikersaccounts' laadt tools voor gebruikersbeheer; een vraag over 'productvoorraad' laadt voorraadbeheertools.

Dit vereist een selectielaag voor gereedschappen vóór de hoofd-LLM-aanroep:

- Analyseer de query met een lichtgewicht classifier.

- Koppel zoekopdrachtcategorieën aan relevante toolsets.

- Neem alleen relevante tools op in de context.

- Proces met hoofd-LLM

Voor applicaties met meer dan 50 beschikbare tools verlaagt dynamische provisioning de overhead van tooldefinities van 15.000 tokens naar 2.000-4.000 tokens – een reductie van 80% in het contextverbruik gerelateerd aan tools.

Batchverwerking voor niet-urgente taken

De Batch API van OpenAI en vergelijkbare aanbiedingen van andere aanbieders bieden 50%-kostenbesparingen voor asynchrone verwerking. De keerzijde is de latentie: batchverzoeken worden binnen 24 uur voltooid in plaats van binnen enkele seconden.

Batchverwerking is zinvol voor:

- Offline analyse en rapportage

- Massale contentgeneratie

- Gegevenslabeling en annotatie

- Dagelijkse samenvattingstaken

- Evaluatie en testen van het model

Het werkt niet voor:

- Chatinterfaces voor gebruikers

- Realtime beslissingssystemen

- Tijdsgebonden waarschuwingen

- Interactieve applicaties

De classificatie van de werkbelasting bepaalt de geschiktheid van batchverwerking. Een aanbevelingssysteem voor content kan 's nachts aanbevelingen in batches genereren en deze vervolgens overdag vanuit de cache weergeven. Deze hybride aanpak profiteert van batchkortingen zonder de gebruikerservaring te beïnvloeden.

Batchworkflows implementeren

Effectieve batchverwerking vereist workflow-orkestratie:

- Verzamelingsfase: Verzamel aanvragen die een vertraagde verwerking kunnen verdragen.

- Batchinzending: Bundel verzoeken en dien ze in bij de batch-API.

- Statusbewaking: Volg de voortgang van batches en handel fouten af.

- Resultaatverwerking: Voltooide resultaten ophalen en systemen bijwerken

- Cachepopulatie: Bewaar resultaten voor snelle toegang.

Optimalisatie van de batchgrootte is belangrijk. Grotere batches zorgen voor een lagere spreiding van de vaste overheadkosten, maar verhogen het risico op fouten en de kosten voor herhaalpogingen. Kleinere batches worden sneller verwerkt, maar leiden tot meerdere API-aanroepen. De optimale batchgrootte ligt doorgaans tussen de 100 en 1000 aanvragen, afhankelijk van de complexiteit van de individuele aanvragen.

Modelselectiestrategie: Intelligentie op maat

De modelkeuze is een van de meest bepalende factoren voor de kosten. De prijzen variëren sterk tussen de verschillende modelcategorieën, maar veel applicaties gebruiken standaard de premium modellen voor alle taken.

| Modelklasse | Parameters | Gemiddelde kosten per 1 miljoen tokens | Het beste voor |

|---|---|---|---|

| Micromodellen | 1-3B | $50-100 | Classificatie, extractie, routering |

| Kleine modellen | 7-9B | $100-300 | Eenvoudige vraag-en-antwoordfunctie, sjabloongeneratie |

| Middelgrote modellen | 30-40B | $500-1,000 | Complexe redeneringen, technische taken |

| Grote modellen | 70 miljard+ | $2,000-5,000 | Geavanceerd redeneren, creatief werk |

| Grensmodellen | 400 miljard+ | $10,000-30,000 | Onderzoek, de moeilijkste taken |

Amazon Nova Micro illustreert dit prijsspectrum: $0,035 per miljoen inputtokens, ongeveer 100 keer goedkoper dan concurrerende alternatieven. Voor taken binnen zijn mogelijkheden biedt Nova Micro enorme kostenvoordelen.

De strategie: stem de mogelijkheden van het model af op de moeilijkheidsgraad van de taak. Classificatietaken vereisen geen extreem krachtige redeneermodellen. Simpele vraag-en-antwoord-sessies met gestructureerde data werken prima met kleinere modellen. Reserveer dure modellen voor echt moeilijke problemen.

Progressieve modeltesten

Bij het implementeren van nieuwe functionaliteiten is het raadzaam om stapsgewijs te testen, van de kleinste naar de grootste modellen:

- Begin met het kleinste model dat mogelijk geschikt is.

- Meet kwaliteitsindicatoren aan de hand van de vereisten.

- Als de kwaliteit onvoldoende is, ga dan een niveau hoger.

- Herhaal dit totdat aan de kwaliteitseisen is voldaan.

- Gebruik die modellaag in productie.

Dit voorkomt overcapaciteit. Teams gaan er vaak vanuit dat complexe taken grensmodellen vereisen, om er vervolgens achter te komen dat modellen met 30 miljard parameters voldoende presteren. Die aanname kost 10 tot 20 keer meer dan uit testen zou blijken.

Monitoring, waarschuwingen en kostenbeheer

Kostenoptimalisatie is geen eenmalig project; het vereist continue monitoring en beheer. Productiesystemen veranderen in de loop der tijd naarmate gebruikspatronen evolueren en nieuwe functies worden geïntroduceerd.

Essentiële kostenindicatoren

Houd deze statistieken dagelijks of wekelijks bij:

- Totale kosten: Totale uitgaven voor alle LLM-activiteiten

- Kosten per aanvraag: Gemiddelde kosten voor individuele operaties

- Kosten per model: Uitsplitsing van de uitgaven per modelcategorie

- Kosten per functie: Toeschrijving aan productfunctionaliteiten

- Token-efficiëntieverhouding: Uitvoertokens / invoertokens

- Cache-hitpercentage: Percentage van verzoeken die vanuit de cache worden afgehandeld

- Modelrouteringsdistributie: Percentage van aanvragen per modelcategorie

Stel waarschuwingen in voor afwijkingen:

- De dagelijkse uitgaven overschrijden 150% van het voortschrijdend gemiddelde over 7 dagen.

- De kosten per aanvraag stijgen met meer dan 50% per week.

- Het aantal cache-hits daalt onder het historische basisniveau.

- Een enkele gebruiker/functie verbruikt meer dan 201 TP3T aan dagelijks budget.

Waarschuwingen maken een snelle reactie op kostenstijgingen mogelijk voordat deze uitgroeien tot budgettaire crises.

Kostenverdeling en terugboekingen

Voor organisaties met meerdere teams of producten die de LLM-infrastructuur delen, zorgt kostenallocatie voor meer verantwoording. Voorzie elk verzoek van attributiemetadata:

- Team of bedrijfseenheid

- Product of kenmerk

- Omgeving (productie, enscenering, ontwikkeling)

- Gebruikerssegment (gratis, premium, zakelijk)

Genereer wekelijkse kostenrapporten met een overzicht van de uitgaven per dimensie. Teams die inzicht hebben in hun verbruikspatronen nemen beter onderbouwde optimalisatiebeslissingen dan teams die zonder dit inzicht werken.

Chargebacks – het daadwerkelijk factureren van interne teams voor hun LLM-gebruik – creëren sterkere prikkels voor efficiëntie. Wanneer kosten als een aparte post in teambudgetten verschijnen in plaats van als gedeelde overhead, wordt optimalisatie een prioriteit.

Geavanceerde optimalisatie: kwantisering en fijnafstemming

Naast operationele optimalisaties bieden technieken op modelniveau extra kostenbesparingen voor zelfgehoste implementaties.

Kwantisatie

Kwantisatie verlaagt de precisie van het model van 16-bits of 32-bits drijvende-kommagetallen naar 8-bits of 4-bits gehele getallen. Dit vermindert de geheugenvereisten en versnelt de inferentie, terwijl de kwaliteitsvermindering minimaal is wanneer het zorgvuldig wordt uitgevoerd.

Volgens bronnen van Hugging Face kan snoeien de modelgrootte aanzienlijk verkleinen (vaak met 80-901 TP3T) met minimale prestatievermindering, mits zorgvuldig uitgevoerd. Bij een spaarzaamheid van 501 TP3T behoudt WiSparse de prestaties van het dichte Llama3.1-model met een spaarzaamheid van 971 TP3T.

Bij zelfgehoste implementaties kan kwantisering de geheugenvereisten aanzienlijk verlagen. Modelspecifieke geheugenvereisten zijn afhankelijk van het aantal parameters en het precisieniveau, waardoor implementatie op goedkopere hardware mogelijk wordt of meer aanvragen per GPU kunnen worden verwerkt.

Afwegingen zijn belangrijk. Agressieve kwantisering (2-bit, 1-bit) vermindert de kwaliteit merkbaar. Conservatieve kwantisering (8-bit) behoudt de kwaliteit, maar vermindert de besparingen. De meeste productieomgevingen streven naar 4-bit als de optimale instelling.

Fijn afstellen voor efficiëntie

Gedetailleerd afgestemde modellen kunnen kleiner en goedkoper zijn, terwijl ze hun prestaties voor specifieke domeinen behouden. Een algemeen model met 70 miljard parameters kan bijvoorbeeld worden vervangen door een verfijnd model met 7 miljard parameters voor specifieke toepassingen.

Fijn afstellen vereist:

- Hoogwaardige trainingsdata (honderden tot duizenden voorbeelden)

- Rekenresources voor training (GPU's, uren tot dagen)

- Evaluatie-infrastructuur voor het valideren van de kwaliteit

- Doorlopend onderhoud naarmate de eisen veranderen

Economisch gezien is fijnafstelling wenselijk wanneer:

- Het aanvraagvolume is zeer hoog (miljoenen per maand).

- De taakvereisten zijn stabiel.

- De prestatiekwaliteit kan nauwkeurig worden gemeten.

- Er bestaat infrastructuur voor het hosten van modellen.

Bij API-gebaseerde workflows overstijgen de kosten voor het finetunen de besparingen totdat het maandelijkse aanvraagvolume honderdduizenden of miljoenen aanroepen bereikt.

De kostenoptimalisatiestack voor 2026

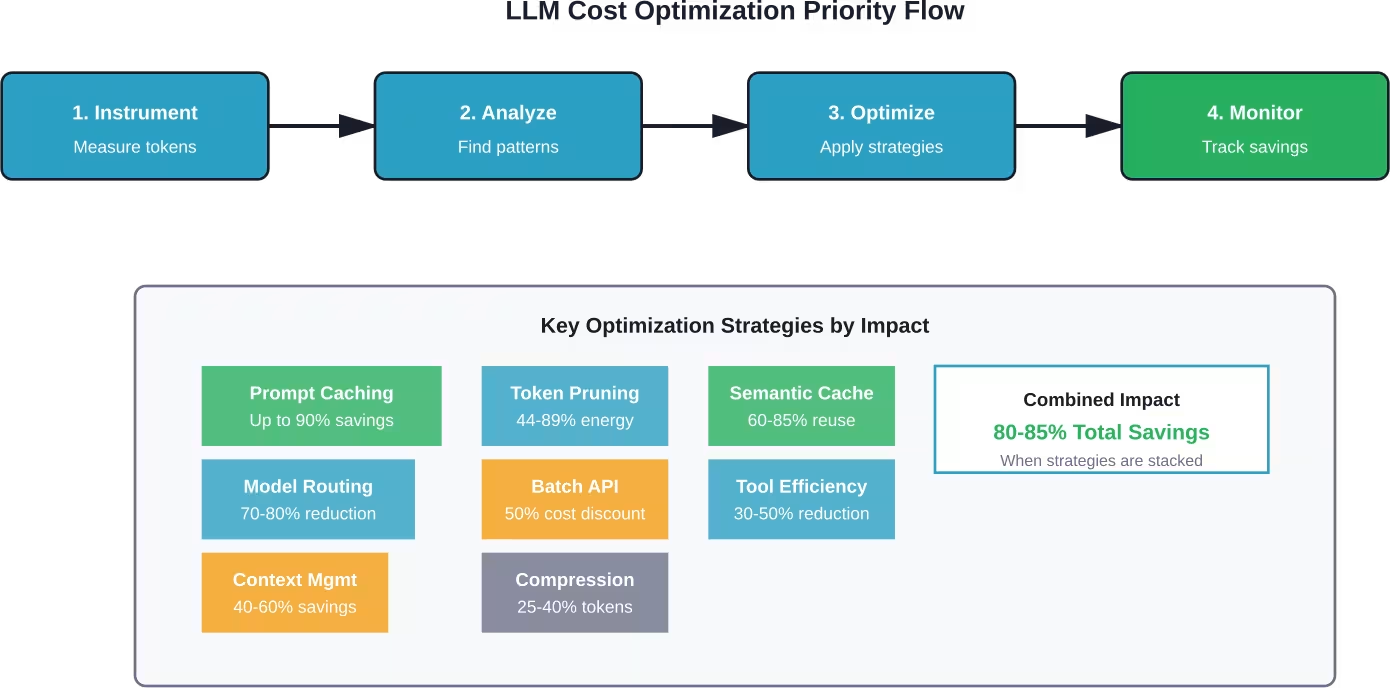

Effectief kostenbeheer voor LLM in 2026 combineert meerdere strategieën tot een samenhangend geheel. Geen enkele techniek lost alle problemen op; de beste resultaten worden behaald door complementaire benaderingen te combineren.

Een optimalisatiestack van productieniveau omvat:

- Fundamentlaag: De modelselectiestrategie zorgt ervoor dat taken standaard gebruikmaken van modellen met de juiste afmetingen.

- Cachinglaag: Zowel prompt caching als semantische caching onderscheppen overbodig werk voordat het de modellen bereikt.

- Routeringslaag: Intelligente orkestratie stuurt verzoeken door naar het meest kostenefficiënte model dat ze kan verwerken.

- Optimalisatielaag: Contextcompressie, tokenefficiëntie en outputbeheer minimaliseren verspilling in verzoeken die modellen bereiken.

- Werkbelastinglaag: Batchverwerking en asynchrone patronen zorgen voor kortingen op niet-urgente werkzaamheden.

- Bestuurslaag: Monitoring, toewijzing en waarschuwingen zorgen ervoor dat optimalisaties in de loop van de tijd behouden blijven en voorkomen dat kosten onnodig stijgen.

Elke laag draagt onafhankelijk bij, maar de gecombineerde effecten versterken elkaar. Een systeem dat alle zes lagen gebruikt, realiseert een kostenbesparing van 80-851 TP3T ten opzichte van naïeve implementaties – waardoor een jaarlijkse uitgave van 1 TP4T216.000 wordt teruggebracht tot 1 TP4T30.000-1 TP4T40.000, terwijl de kwaliteit behouden blijft of zelfs verbetert.

Verlaag de LLM-kosten vroegtijdig – los de problemen op voordat u opschaalt.

De meeste kostenproblemen in LLM-projecten komen voort uit de manier waarop systemen zijn opgezet, niet alleen uit hoe ze worden gebruikt. Inefficiënte datapijplijnen, te grote modellen en niet-geoptimaliseerde prompts kunnen de kosten ongemerkt opdrijven, lang voordat er sprake is van opschaling. AI Superieur Het systeem ondersteunt de volledige levenscyclus – van datavoorbereiding en modelontwerp tot training, finetuning en implementatie – en helpt teams om deze inefficiënties vroegtijdig te elimineren in plaats van er later op te reageren.

De focus ligt op het bruikbaar maken van modellen in productie zonder onnodige overhead, of dat nu betekent het aanpassen van de modelgrootte, het verfijnen van workflows of het heroverwegen van de keuze tussen externe API's en eigen configuraties. Dit wordt cruciaal naarmate het gebruik toeneemt, waar kleine inefficiënties zich ontwikkelen tot aanzienlijke kosten. Als u de kosten van LLM op een praktische manier wilt verlagen, is het de moeite waard om uw huidige configuratie te herzien voordat u verder opschaalt. Neem contact op met AI Superieur om te bepalen waar daadwerkelijk kosten kunnen worden verlaagd.

Veelvoorkomende valkuilen die je moet vermijden

Pogingen tot kostenoptimalisatie mislukken vaak door voorspelbare fouten. Het vermijden hiervan versnelt het succes.

Optimaliseren zonder te meten

De meest voorkomende oorzaak van de fout: het implementeren van optimalisaties zonder de impact ervan te meten. Teams implementeren caching, gaan ervan uit dat het werkt, en missen het feit dat de cache-hitrate rond de 20% ligt in plaats van de verwachte 80%.

Meten moet voorafgaan aan optimaliseren. Anders richten de inspanningen zich op gebieden met minimale impact, terwijl de belangrijkste kostenfactoren onbehandeld blijven.

Overoptimalisatie van de latentie

Afweging tussen latentie en kosten. Agressieve caching verlaagt de kosten, maar verhoogt de latentie bij het opzoeken in de cache. Cascaderende routing bespaart geld, maar verhoogt de vertraging bij mislukte pogingen. Batchverwerking levert enorme kortingen op, maar elimineert realtime respons.

Niet elke milliseconde is even belangrijk. Een chatinterface voor klanten vereist reactietijden van minder dan een seconde. Een rapportgenerator die 's nachts werkt, kan minuten aan. Stem optimalisatiestrategieën af op de werkelijke latentievereisten in plaats van alles te optimaliseren voor snelheid.

Het verwaarlozen van kwaliteitscontrole

Kostenoptimalisatie mag de kwaliteit van de output niet verslechteren, maar agressieve technieken doen dat soms wel. Te agressieve compressie zorgt ervoor dat cruciale context verloren gaat. Semantische caching met te ruime drempelwaarden voor gelijkenis kan leiden tot reacties die niet nauw aansluiten bij de zoekopdracht. Het routeren naar kleinere modellen vermindert de mogelijkheden.

Kwaliteitsbewaking moet hand in hand gaan met kostenbewaking. Houd meetgegevens bij zoals:

- Gebruikerstevredenheidsscores

- Voltooiingspercentages van taken

- Foutpercentages en herhaalpogingen

- Handmatige controle van de voorbeeldresultaten

Als kostenoptimalisatie ten koste gaat van de kwaliteit, mislukt de optimalisatie ongeacht de behaalde besparingen.

Verborgen kosten negeren

De kosten voor tokens zijn de meest voor de hand liggende uitgave, maar er zijn ook verborgen kosten:

- De tijd die ingenieurs besteden aan het bouwen en onderhouden van optimalisatie-infrastructuur

- Infrastructuurkosten voor cachinglagen en monitoringsystemen

- Toegenomen complexiteit en moeilijkere foutopsporing

- De opportuniteitskosten van teamaandacht voor kosten in plaats van functionaliteiten.

Bereken de werkelijke ROI inclusief deze factoren. Een caching-systeem dat maandelijks $500 bespaart, maar $300 aan infrastructuur en 20 uur aan engineering vereist voor onderhoud, levert een twijfelachtige waarde op.

Veelgestelde vragen

Wat is de meest impactvolle kostenoptimalisatie voor LLM in de meeste toepassingen?

Het cachen van prompts heeft doorgaans de grootste directe impact op applicaties met stabiele promptstructuren. Indien van toepassing kan caching de kosten van invoertokens met 901 TP3T en de latentie met 851 TP3T verlagen. De implementatie is eenvoudig: prompts worden herstructureerd zodat statische content vooraan staat, en vereist geen complexe infrastructuur. De meeste productieapplicaties met documentatie, voorbeelden of herhaalde instructies in prompts profiteren hier aanzienlijk van.

Hoe weet ik of mijn cache-hitrate goed genoeg is?

Cache-hitpercentages boven de 60% kunnen aanzienlijke kostenbesparingen opleveren met prompt-caching. Semantische caching vereist hogere percentages – doorgaans 70-80% – omdat de implementatiekosten hoger liggen. Bereken de verwachte besparing: (hitpercentage × cachebesparing) – cachekosten. Als dit getal een netto reductie van meer dan 40-50% oplevert, is caching rendabel. Monitor de hitpercentages wekelijks; dalingen duiden op wijzigingen in de promptstructuur of verschuivingen in het querypatroon die moeten worden aangepakt.

Moet ik SLM's of LLM's gebruiken voor classificatietaken?

Classificatietaken profiteren vrijwel altijd van kleinere modellen. Onderzoek toont aan dat modellen met 7-9 miljard parameters een nauwkeurigheid van 85-951 TP3T behalen bij classificatie, terwijl ze 10-50 keer minder kosten. Test uw specifieke classificatietaak: verzamel 100-200 gelabelde voorbeelden, evalueer zowel kleine als grote modellen en vergelijk de nauwkeurigheid. Kies voor het kleinere model, tenzij het verschil in nauwkeurigheid meer dan 5-10 procentpunten bedraagt.

Wanneer loont het om een model te verfijnen in plaats van grotere modellen te gebruiken?

Finetuning wordt economisch haalbaar wanneer het maandelijkse aanvraagvolume enkele honderdduizenden aanroepen overschrijdt en de taakvereisten stabiel blijven. De trainingskosten variëren van 1 tot 4.500 tot 5.000, afhankelijk van de modelgrootte en het datavolume. Als een gefinetuned model van 7 miljard een API van 70 miljard vervangt met 30 keer lagere inferentiekosten, wordt het break-evenpunt bereikt bij ongeveer 300.000 tot 500.000 aanvragen. Bij lagere volumes leveren optimalisatietechnieken zoals caching en routing een beter rendement op.

Hoeveel contextcompressie is veilig zonder kwaliteitsverlies?

Veilige compressieverhoudingen zijn sterk afhankelijk van het type inhoud. Gespreksgeschiedenis comprimeert 60-801 TP3T met samenvatting, terwijl de samenhang van de dialoog behouden blijft. Technische documentatie comprimeert doorgaans 40-601 TP3T door extractie zonder informatieverlies. Creatieve of genuanceerde inhoud comprimeert minder – mogelijk 30-401 TP3T. Voer altijd A/B-tests uit: verwerk identieke zoekopdrachten met volledige en gecomprimeerde context, vergelijk de resultaten en meet de kwaliteitsverschillen voordat u compressie toepast.

Wat is de minimaal vereiste instrumentatie voor het bijhouden van de kosten van LLM?

Registreer minimaal deze zes velden per verzoek: tijdstempel, modelnaam, invoertokens, uitvoertokens, berekende kosten en één attributieveld (gebruikers-ID of functienaam). Sla de gegevens op in een database die aggregatiequery's ondersteunt – zelfs een eenvoudige PostgreSQL-tabel is voldoende. Dit maakt dagelijkse kostenbewaking mogelijk en identificeert gebieden met hoge uitgaven. Voeg meer velden toe (latency, cache_hit, quality_score) naarmate de behoeften zich voordoen, maar begin met deze basis.

Hoe overtuig ik het management om te investeren in kostenoptimalisatie voor LLM-programma's?

Presenteer kostenramingen met en zonder optimalisatie. Toon de huidige maandelijkse uitgaven, vermenigvuldig deze met 12 voor de jaarlijkse kosten en bereken vervolgens de geoptimaliseerde jaarlijkse kosten met behulp van conservatieve besparingsschattingen (50-60% in plaats van 80%). Het verschil – vaak $ of meer voor productietoepassingen – rechtvaardigt de investering in engineering. Voeg een ROI-berekening toe: (Jaarlijkse_besparingen – Implementatiekosten) / Implementatiekosten. Een ROI van meer dan 300% maakt de investering overtuigend.

Conclusie: Van kostenpost naar concurrentievoordeel

De kosten van LLM hoeven niet uit de hand te lopen. De hier beschreven strategieën – snelle caching, intelligente routing, contextoptimalisatie en systematische instrumentatie – verlagen de productiekosten consequent met 70-85%, terwijl de kwaliteit behouden blijft of zelfs verbetert.

Maar het gaat niet alleen om geld besparen. Organisaties die kostenefficiënte LLM-activiteiten beheersen, behalen strategische voordelen. Lagere eenheidskosten stellen hen in staat meer gebruikers te bedienen, te experimenteren met nieuwe functies en AI-mogelijkheden te bieden die concurrenten economisch niet haalbaar vinden.

De belangrijkste les: beschouw tokenverbruik vanaf dag één als een prioriteit voor de engineering. Implementeer vroegtijdig meetinstrumenten, optimaliseer systematisch en monitor continu. De technieken die in 2026 werken – caching, routing, compressie – zullen evolueren, maar de discipline van kostenbewuste LLM-engineering blijft essentieel.

Begin met meten. Kies één veelgebruikte functie, meet het tokenverbruik ervan en analyseer de patronen. Deze inzichten bieden optimalisatiemogelijkheden die 10 tot 100 keer zoveel waard zijn als de meetinspanning. Pas vervolgens gerichte strategieën toe waar de data aantonen dat ze de grootste impact zullen hebben.

De organisaties die in 2026 succesvol zullen zijn met LLM-technologie, zijn niet alleen de organisaties met de beste modellen, maar ook de organisaties die de economische aspecten van het efficiënt in productie nemen van modellen onder de knie hebben.