Korte samenvatting: De prijsstelling van LLM-modellen varieert sterk tussen aanbieders, met inputtokens variërend van $0.10 tot $5 per miljoen en outputtokens van $0.40 tot $25 per miljoen (vanaf maart 2026). De GPT-modellen van OpenAI, Claude van Anthropic en Gemini van Google domineren de markt met verschillende prijs-prestatieverhoudingen. Inzicht in tokengebaseerde prijsstelling, contextvensters en gebruikspatronen is essentieel voor het optimaliseren van de kosten met behoud van kwaliteit.

De explosieve groei van API's voor grote taalmodellen heeft een complex prijslandschap gecreëerd. Organisaties staan voor cruciale beslissingen over welke modellen de beste prijs-kwaliteitverhouding bieden voor hun specifieke toepassingen.

Maar er is iets belangrijks om te weten: de keuze voor een model draait niet alleen om het vinden van de goedkoopste optie. De economische aspecten van LLM-inferentie zijn afhankelijk van meerdere factoren: tokenprijzen, beperkingen van het contextvenster, latentievereisten en verborgen kosten die uw rekening met een factor 2 tot 3 kunnen verhogen.

Deze vergelijking analyseert de prijzen van grote aanbieders, waaronder OpenAI, Anthropic, Google en opkomende alternatieven. De gegevens weerspiegelen de huidige prijzen per maart 2026, hoewel aanbieders hun tarieven regelmatig aanpassen.

Inzicht in op tokens gebaseerde prijsmodellen

LLM-aanbieders berekenen hun kosten op basis van het aantal verwerkte tokens. Een token vertegenwoordigt ongeveer 4 tekens tekst of circa 0,75 woorden in het Engels. De string "ChatGPT is geweldig!" wordt bijvoorbeeld gecodeerd in zes tokens: ["Chat", "G", "PT", "is", "geweldig", "!"].

De meeste aanbieders splitsen de prijs op in twee componenten: inputtokens (wat ontwikkelaars naar het model sturen) en outputtokens (wat het model genereert). Outputtokens kosten doorgaans 3 tot 5 keer meer dan inputtokens, omdat de generatie ervan meer rekenkracht vereist.

Het totale aantal tokens in een API-aanroep beïnvloedt drie cruciale factoren: de kosten van de aanroep, de verwerkingstijd en of de aanroep binnen de contextlimieten van het model past.

Contextvensters en caching

Contextvensters bepalen het maximale aantal tokens dat een model in één verzoek kan verwerken. Begin 2026 zijn contextvensters aanzienlijk uitgebreid. Anthropic's Claude Opus 4.6 heeft in bèta een contextvenster van 1 miljoen tokens, terwijl de meeste productiemodellen vensters van 128.000 tot 200.000 tokens bieden.

Grotere contextvensters maken complexere toepassingen mogelijk, maar verhogen de kosten evenredig. Een invoer van 100.000 tokens tegen 1 TP4T3 per miljoen tokens kost 1 TP4T0,30 per aanvraag. Vermenigvuldig dat met duizenden dagelijkse zoekopdrachten en de kosten lopen snel op.

Het direct cachen van gegevens levert aanzienlijke besparingen op. OpenAI biedt gecachede invoerprijzen aan van 50% aan standaard invoerkosten. Volgens de prijsdocumentatie van OpenAI rekent GPT-4.1 $2,00 per miljoen invoertokens, maar slechts $0,50 per miljoen gecachede invoertokens.

Prijsopgave van de belangrijkste aanbieders

Het concurrentielandschap omvat drie dominante spelers en diverse opkomende alternatieven. Elke aanbieder biedt meerdere modelniveaus aan, geoptimaliseerd voor verschillende gebruiksscenario's.

Prijsstructuur van OpenAI

De GPT-modellen van OpenAI omvatten verschillende intelligentie- en prijsniveaus. Zoals uiteengezet in communitydiscussies van januari 2026, blijft de prijsstelling evolueren naarmate er nieuwe modellen worden gelanceerd.

| Model | Invoer (per 1 miljoen tokens) | Invoer in cache (per 1M) | Uitvoer (per 1 miljoen tokens) | Contextvenster |

|---|---|---|---|---|

| GPT-4.1 | $2.00 | $0.50 | $8.00 | 128K |

| GPT-4o | $2.50 | $1.25 | $10.00 | 128K |

| GPT-4-32k (verouderd) | $60.00 | Niet van toepassing | $120.00 | 32K |

OpenAI heeft de GPT-4-32k-modellen uitgefaseerd, met een geplande stopzetting op 6 juni 2025. Volgens de documentatie van OpenAI over de uitfasering hadden bestaande gebruikers slechts beperkte tijd om over te stappen naar nieuwere modellen zoals GPT-4o.

De GPT-5.4-modelfamilie vertegenwoordigt de nieuwste ontwikkeling van OpenAI. GPT-5.4 mini werd in maart 2026 uitgebracht en is beschikbaar gekomen voor Free- en Go-gebruikers via de "Thinking"-functie van ChatGPT. Voor betaalde gebruikers fungeert GPT-5.4 mini als een fallback voor GPT-5.4 Thinking wanneer de limiet voor het aantal aanvragen is bereikt.

Antropische Claude-prijzen

De Claude-modellen van Anthropic zijn uitgegroeid tot sterke concurrenten van OpenAI, met name voor codeer- en agentische taken. Het bedrijf bracht Claude Opus 4.6 uit in februari 2026 en Claude Sonnet 4.6 kort daarna.

Claude Opus 4.6 behoudt de prijs van $5 per miljoen inputtokens en $25 per miljoen outputtokens, ondanks aanzienlijke verbeteringen in de functionaliteit. Volgens de aankondiging van Anthropic is deze prijs ongewijzigd gebleven ten opzichte van de vorige versie, Opus 4.5.

Claude Sonnet 4.6 biedt een toegankelijker prijskaartje van $3 per miljoen inputtokens en $15 per miljoen outputtokens – hetzelfde tarief als Sonnet 4.5. Anthropic beschrijft Sonnet 4.6 als een systeem dat de intelligentie van Opus benadert, maar dan tegen een meer praktische prijs voor alledaagse taken.

| Model | Invoer (per 1 miljoen tokens) | Uitvoer (per 1 miljoen tokens) | Contextvenster | Het beste voor |

|---|---|---|---|---|

| Claude Opus 4.6 | $5.00 | $25.00 | 1M (beta) | Complexe redenering, codering, agenten |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 1M (beta) | Evenwichtige prestaties en kosten |

| Claude Opus 4.5 | $5.00 | $25.00 | 200K | Verouderde applicaties |

Het contextvenster van 1 miljoen tokens in Claude Opus 4.6 is een primeur voor de Opus-klasse modellen van Anthropic. Deze uitbreiding maakt het mogelijk om complete codebases of omvangrijke documenten in één enkele aanvraag te verwerken.

Google Gemini-prijzen

De Gemini-modellen van Google concurreren fel op prijs, met name voor toepassingen met een hoog volume. De Gemini-familie omvat verschillende niveaus die geoptimaliseerd zijn voor verschillende prestatie-eisen.

De prijsstructuren voor Gemini-modellen variëren aanzienlijk, afhankelijk van het abonnement en het gebruiksvolume. Google positioneert Gemini als een kosteneffectief alternatief voor applicaties die hoge prestaties vereisen zonder de hoge prijs.

Verborgen kosten en prijsmechanismen

De geadverteerde prijs per token vertelt slechts een deel van het verhaal. Verschillende verborgen factoren kunnen de werkelijke kosten aanzienlijk verhogen.

Uitvoertokenvermenigvuldigers

Uitvoertokens kosten consequent 3 tot 5 keer meer dan invoertokens bij alle aanbieders. Een applicatie die lange reacties genereert, zal onevenredig hogere kosten hebben dan een applicatie die grote invoer verwerkt maar beknopte uitvoer genereert.

Het instellen van het maximale aantal uitvoertokens (parameter max_tokens) helpt de kosten te beheersen. Als deze te laag is ingesteld, worden reacties afgebroken voordat ze voltooid zijn. Als deze te hoog is ingesteld, kan het model onnodige inhoud genereren, vooral bij hogere temperaturen die creativiteit stimuleren.

Tarieflimieten en terugvalkosten

De meeste providers hanteren snelheidslimieten op basis van het aantal verzoeken per minuut, het aantal tokens per minuut, of beide. Wanneer applicaties deze limieten bereiken, falen ze of schakelen ze over op alternatieve modellen.

De GPT-5.4-implementatie van OpenAI illustreert dit patroon. Volgens de release notes van het OpenAI-model uit maart 2026 ervaren betalende gebruikers GPT-5.4 mini als terugvaloptie wanneer de snelheidslimieten van GPT-5.4 Thinking zijn bereikt. Dit zorgt voor continuïteit van de dienstverlening, maar mogelijk tegen andere kosten.

Contextvenster Economie

Grotere contextvensters maken complexere toepassingen mogelijk, maar verhogen de kosten lineair. Met een contextlengte van 128.000 tokens bereikt de KV-cache van LLama2-7B met halfprecisie 64 GB, berekend als: aantal_lagen × aantal_kv_koppen × kop_afmetingen × sequentielengte × grootte van (fp16) × 2.

Onderzoek naar de efficiëntie van LLM-decodering wijst uit dat de grootte van de KV-cache lineair toeneemt met de sequentielengte, waardoor er geheugenknelpunten ontstaan tijdens het decoderen die zich vertalen in hogere operationele kosten.

Prijsbepalingsaspecten voor bedrijven

Implementaties binnen grote bedrijven hebben te maken met andere economische aspecten dan implementaties door individuele ontwikkelaars of kleine teams. Volumekortingen, prijsstelling op maat en implementatieopties hebben een aanzienlijke invloed op de totale eigendomskosten.

Cloud-API versus zelfgehoste implementatie

Organisaties kunnen zich abonneren op commerciële LLM-diensten of modellen implementeren op hun eigen infrastructuur. Onderzoek gepubliceerd op arXiv, waarin de implementatie van LLM op locatie werd geanalyseerd, toonde aan dat het behalen van een break-evenpunt met commerciële diensten een zorgvuldige analyse van gebruikspatronen en infrastructuurkosten vereist.

De studie definieerde vier criteria voor modelselectie: prestatiegelijkheid binnen 20% van de beste commerciële modellen, operationele compatibiliteit, beveiligingsvereisten en kostenefficiëntie op grote schaal. Voor grootschalige applicaties kan zelfhosting de kosten verlagen, maar de initiële investering in infrastructuur blijft aanzienlijk.

Kostenoptimalisatie van hiërarchische architectuur

Recent benchmarkonderzoek naar multi-agent LLM-architecturen voor de verwerking van financiële documenten heeft aangetoond dat hiërarchische architecturen de beste afweging tussen kosten en nauwkeurigheid bieden. Deze systemen behaalden een nauwkeurigheid van 97,71 TP3T voor reflexieve architecturen tegen een kostprijs van 60,91 TP3T.

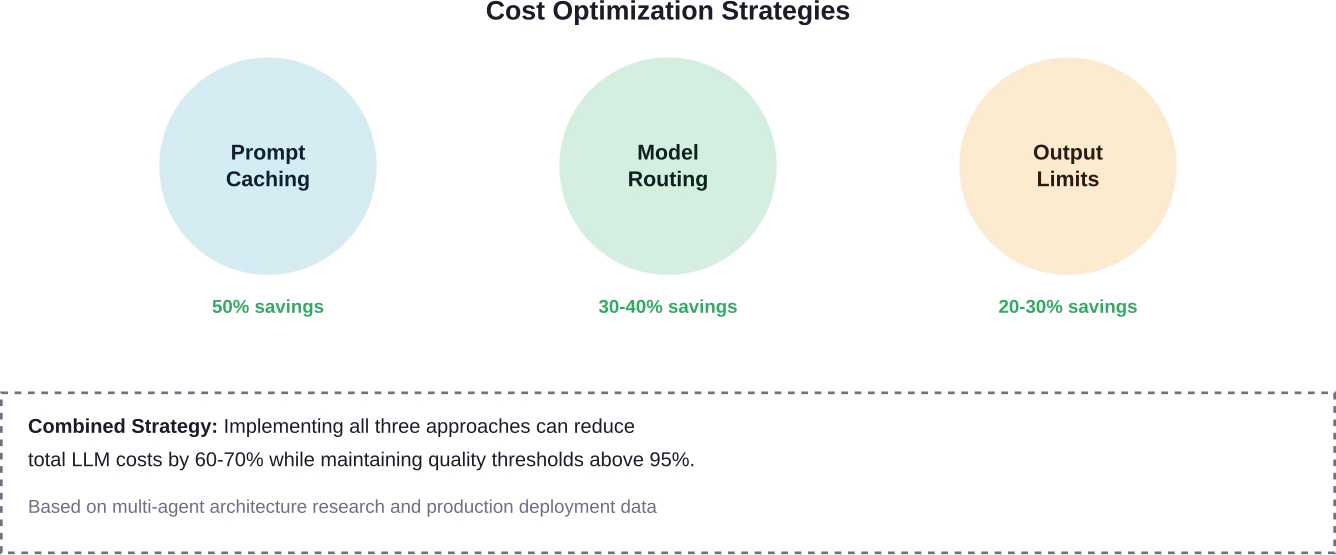

Het onderzoek toonde aan dat semantische caching, modelroutering en adaptieve verwerking de operationele kosten aanzienlijk kunnen verlagen zonder dat dit ten koste gaat van de kwaliteit. Deze technieken worden steeds belangrijker naarmate applicaties opschalen naar miljoenen dagelijkse verzoeken.

Opkomende alternatieven en regionale prijsstelling

Naast de drie grootste aanbieders zijn er diverse alternatieven die concurrerende prijzen bieden voor specifieke toepassingen.

DeepSeek en open source-modellen

DeepSeek heeft de aandacht getrokken met zijn scherpe prijzen voor krachtige modellen. Het bedrijf positioneert zich als een kosteneffectief alternatief voor toepassingen die geen absolute topprestaties vereisen.

Open-sourcemodellen die via cloud-GPU-providers zoals RunPod worden ingezet, bieden een andere mogelijkheid. Deze services rekenen per GPU-uur in plaats van per token, waardoor de kosten voorspelbaarder zijn voor toepassingen met een hoog volume.

Gespecialiseerde modelaanbieders

Mistral, Meta's Llama-familie en de modellen van NVIDIA bedienen elk een specifieke niche. Volgens een modelvergelijkingsanalyse die in augustus 2025 werd gepubliceerd, moet bij de modelkeuze rekening worden gehouden met het ontwerpdoel, de technische specificaties en de optimale gebruiksscenario's, en niet alleen met de prijs.

De analyse benadrukt dat verschillende modellen uitblinken in verschillende taken. Een keuze die uitsluitend gebaseerd is op de laagste kosten leidt vaak tot slechte resultaten en dure herverwerking.

Praktisch kostenberekeningskader

Om de werkelijke kosten te schatten, is inzicht in de specifieke gebruikspatronen van de applicatie essentieel. De vier belangrijkste parameters zijn: gemiddeld aantal inkomende tokens per verzoek, gemiddeld aantal uitgaande tokens per verzoek, verwachte verzoeken per dag en het gekozen modelniveau.

Een eenvoudige berekening: (Invoertokens × Invoerprijs + Uitvoertokens × Uitvoerprijs) × Dagelijkse verzoeken × 30 dagen = Maandelijkse kosten.

Een applicatie die bijvoorbeeld 10.000 invoertokens verwerkt en 2.000 uitvoertokens per verzoek genereert, en dagelijks 1.000 verzoeken uitvoert op Claude Sonnet 4.6: (10.000 × $0.000003 + 2.000 × $0.000015) × 1.000 × 30 = $1.800 per maand.

Eerlijk gezegd: de meeste applicaties onderschatten het werkelijke tokengebruik met een factor 2 tot 3 tijdens de planningsfase. Houd hier rekening mee bij het inschatten van het werkelijke gebruik.

Afweging tussen prestatie en prijs

Het goedkoopste model levert zelden de beste prijs-kwaliteitverhouding. Volgens onderzoek naar de economie van AI-inferentie variëren de "marginale kosten" van LLM-inferentie aanzienlijk, afhankelijk van de rekenkracht en de modelarchitectuur.

Studies die query-approximatie met behulp van lichtgewicht proxy-modellen analyseerden, toonden aan dat strategische modelselectie een kosten- en latentiereductie van factor 100 kan opleveren. Het onderzoek liet zien dat proxy-modellen een nauwkeurigheid van meer dan 90% behaalden, terwijl de kosten voor specifieke querytypen drastisch werden verlaagd.

Lokale implementatie op consumentenhardware biedt een andere optie. Onderzoek naar de efficiëntie van lokale taalmodellen heeft aangetoond dat lokale taalmodellen 88,71 TP3T aan chat- en redeneervragen in één beurt nauwkeurig kunnen verwerken, zij het met aanzienlijke vertragingsnadelen in vergelijking met implementaties in datacenters.

Afweging tussen latentie en kosten

Snellere modellen kosten doorgaans meer of vereisen premium abonnementen. Applicaties met strenge latency-eisen moeten mogelijk hogere kosten per token accepteren om aan de prestatie-SLA's te voldoen.

De verwachte latentie varieert per model en implementatie: topmodellen leveren doorgaans 20-40 tokens per seconde, middenklasse modellen halen 40-80 tokens per seconde en geoptimaliseerde modellen kunnen op dedicated infrastructuur meer dan 100 tokens per seconde halen.

Vergelijk de modellen zorgvuldig en kies het juiste model als basis.

Het vergelijken van meer dan 15 LLM's op basis van alleen de prijs geeft zelden een volledig beeld. De werkelijke kosten worden bepaald door de implementatie van de modellen – datakwaliteit, finetuningstrategie en infrastructuurkeuzes bepalen allemaal wat je uiteindelijk betaalt. AI Superieur Het bedrijf ondersteunt de volledige levenscyclus, van datavoorbereiding en modelselectie tot training, optimalisatie en implementatie, en helpt teams bij het kiezen en configureren van modellen op basis van concrete gebruiksscenario's in plaats van oppervlakkige prijsinformatie.

In de praktijk betekent dit vaak dat je overgedimensioneerde modellen vermijdt waar ze niet nodig zijn, of dat je benaderingen zoals fine-tuning en hybride setups combineert in plaats van te vertrouwen op één enkel model of API. De focus ligt op het bouwen van systemen die efficiënt draaien in productie, niet alleen op het vergelijken van benchmarks. Als je meerdere LLM's evalueert en probeert te begrijpen wat ze daadwerkelijk in gebruik zullen kosten, is het verstandig om je setup vroegtijdig te herzien. Neem contact op met AI Superieur Om de modelkeuze af te stemmen op de werkelijke kosten, en niet alleen op de catalogusprijs.

Toekomstige prijsontwikkelingen

De prijsontwikkeling van LLM blijft zich snel ontwikkelen. Er zijn verschillende duidelijke trends zichtbaar in 2025 en in 2026.

Het aantal contextvensters is aanzienlijk uitgebreid, terwijl de prijs per token is gedaald. Zowel Claude Opus 4.6 als Sonnet 4.6 bieden contextvensters van 1 miljoen tokens aan voor dezelfde prijs als de eerdere modellen met 200.000 vensters. Dit betekent een aanzienlijke toename van de mogelijkheden van contextvensters zonder evenredige prijsstijgingen.

De cycli voor het uitfaseren van modellen zijn versneld. Het feit dat OpenAI de GPT-4-32k-varianten al binnen 12-18 maanden na release uitfaseert, wijst op snellere iteratiecycli. Organisaties moeten rekening houden met regelmatige modelmigraties en de bijbehorende ontwikkelingskosten.

Het verschil tussen topmodellen en modellen uit het middensegment is kleiner geworden. Volgens aankondigingen van Anthropic benadert Claude Sonnet 4.6 het intelligentieniveau van Opus voor 601 TP3T (Total Power) minder. Deze compactere functionaliteit over de verschillende prijsklassen heen is gunstig voor budgetbewuste implementaties.

Veelgestelde vragen

Wat is het goedkoopste LLM-model voor productiegebruik in 2026?

DeepSeek en Google Gemini bieden de laagste kosten per token van alle grote aanbieders, maar "goedkoopst" betekent niet altijd de beste prijs-kwaliteitverhouding. De totale kosten zijn afhankelijk van de nauwkeurigheidseisen, de behoefte aan herverwerking en de vereisten voor het contextvenster. Voor veel toepassingen bieden modellen uit het middensegment, zoals Claude Sonnet 4.6 met $3/$15 per miljoen tokens, een betere algehele economische uitkomst dan de allerlaagste prijzen met een lagere kwaliteit.

Hoeveel tijd bespaart promptcaching nu eigenlijk?

De prijsstelling van OpenAI voor gecachede invoer levert een besparing op van 501 TP3T op herhaalde promptsegmenten. Voor applicaties met consistente systeemprompts of referentiedocumenten vertaalt dit zich in een totale kostenbesparing van 30-501 TP3T. De besparingen zijn het meest significant bij applicaties die duizenden vergelijkbare verzoeken met gedeelde context uitvoeren.

Moeten bedrijven hun LLM-systemen zelf hosten of API's gebruiken?

Onderzoek naar de economische aspecten van on-premise implementaties wijst uit dat break-even alleen mogelijk is bij consistent hoog volumegebruik en een geschikte technische infrastructuur. Applicaties die minder dan 100 miljoen tokens per maand verwerken, vinden API-prijzen doorgaans voordeliger. Boven die drempel wordt zelfhosting een haalbare optie, maar houd dan rekening met DevOps-overhead, modelupdates en infrastructuurbeheerkosten, naast de pure rekenkrachtkosten.

Waarom kosten uitvoertokens meer dan invoertokens?

Generatie vereist aanzienlijk meer rekenkracht dan verwerking. Inputtokens doorlopen het model eenmaal voor codering, terwijl elk outputtoken een volledige forward pass vereist om het volgende token te voorspellen. Dit zorgt voor een 3-5 keer groter verschil in rekenkracht, wat terug te zien is in de prijsstructuren van alle aanbieders.

Hoe schat ik het tokengebruik voor mijn applicatie in?

Gebruik de tokenizer-tools van elke modelleverancier om typische verzoeken te meten. OpenAI, Anthropic en Google bieden allemaal tokenizer-API's of webtools aan. Test met representatieve voorbeeldgegevens, vermenigvuldig met het verwachte aantal verzoeken en voeg een buffer van 50% toe voor variaties. De meeste planningsschattingen onderschatten het werkelijke gebruik met een factor 2 tot 3.

Wat gebeurt er als ik de limieten voor het aantal aanvragen bereik?

De respons is afhankelijk van de provider en het abonnement. Sommige implementaties plaatsen verzoeken in een wachtrij, andere retourneren fouten bij het overschrijden van de snelheidslimiet, waardoor een herhalingslogica nodig is. Premium-abonnementen kunnen terugvallen op alternatieve modellen. OpenAI's GPT-5.4 schakelt voor betaalde gebruikers over op GPT-5.4 mini wanneer de snelheidslimieten zijn bereikt. Raadpleeg de documentatie van de betreffende provider voor informatie over de snelheidslimieten die per abonnement gelden.

Zijn er volumekortingen voor LLM API's?

De meeste aanbieders bieden zakelijke prijzen met volumekortingen, hoewel de voorwaarden niet openbaar worden gemaakt. Organisaties die maandelijks meer dan 1 miljard tokens verwerken, dienen rechtstreeks contact op te nemen met de verkoopafdelingen. Kortingen variëren doorgaans van 10 tot 301 tokens, afhankelijk van de afnameverplichting en het gebruiksvolume. Anthropic, OpenAI en Google hebben allemaal zakelijke verkoopprogramma's met aangepaste prijzen.

Conclusie

De prijsontwikkeling van LLM blijft complex en snel in ontwikkeling. Vanaf maart 2026 variëren de kosten per token van minder dan $1 per miljoen tot $25 per miljoen, afhankelijk van het modelniveau en het tokentype.

Economisch gezien pleit de strategische selectie van modellen boven het simpelweg kiezen van de goedkoopste optie. Claude Sonnet 4.6, met een prijs van $3/$15 per miljoen tokens, levert bijna topprestaties voor alledaagse taken. OpenAI's GPT-4.1, met een prijs van $2/$8, biedt sterke algemene redeneermogelijkheden tegen concurrerende tarieven. Claude Opus 4.6 heeft een hogere prijs van $5/$25, maar is toonaangevend voor complexe programmeer- en agenttaken.

Verborgen kosten zijn net zo belangrijk als de geadverteerde prijs. Het cachen van prompts bespaart 50% op herhaalde invoer. Beheer van uitvoertokens voorkomt kostenstijgingen door uitgebreide antwoorden. Hiërarchische architecturen verlagen de totale kosten met 60% met behoud van kwaliteit.

Organisaties moeten de totale eigendomskosten berekenen, inclusief de afhandeling van snelheidslimieten, de afschrijvingscycli van modellen en de herverwerkingsbehoeften met betrekking tot kwaliteit. De laagste prijs per token leidt vaak tot de hoogste totale kosten.

Begin met het benchmarken van representatieve workloads voor verschillende kandidaatmodellen. Meet niet alleen de nauwkeurigheid, maar ook het totale aantal verbruikte tokens per succesvol voltooide taak. Houd rekening met specifieke gebruikspatronen, latentievereisten en de benodigde context. Neem vervolgens een weloverwogen beslissing op basis van de werkelijke waarde in plaats van alleen de aanschafprijs.