Kurzzusammenfassung: Das LangChain-Framework selbst ist kostenlos und Open Source. Die Entwicklung von LLM-Anwendungen verursacht jedoch Kosten für LLM-API-Aufrufe (typischerweise 0,25–75 Tsd. pro Million Token), die LangSmith-Observability-Plattform (0–39 Tsd. pro Nutzer und Monat), das Hosting der Infrastruktur und den Entwicklungsaufwand. Die gesamten Entwicklungskosten variieren je nach Umfang, Modellwahl und Funktionskomplexität von nahezu null für Prototypen bis zu über 10.000 Tsd. pro Monat für Produktionsumgebungen.

Die Entwicklung von Anwendungen mit großen Sprachmodellen ist 2026 zum Standard geworden, und LangChain zählt weiterhin zu den meistgenutzten Frameworks für die Orchestrierung von LLM-Workflows. Doch Folgendes überrascht viele Teams: Obwohl das Framework kostenlos ist, setzen sich die Gesamtkosten für Entwicklung und Bereitstellung aus mehreren Ebenen zusammen, die nicht immer sofort ersichtlich sind.

Die Preisstruktur ist nicht ganz einfach. LangChain ist Open Source, daher fallen keine Lizenzgebühren an. Teams stoßen jedoch schnell auf Kosten für Modell-API-Aufrufe, Observability-Tools, Vektordatenbanken, Hosting-Infrastruktur und den Entwicklungsaufwand für die Erstellung produktionsreifer Anwendungen.

Dieser Leitfaden schlüsselt alle Kostenkomponenten für die Entwicklung von LangChain-basierten LLM-Anwendungen im Jahr 2026 auf, vom ersten Prototyping bis zur Produktionsskalierung.

LangChain Framework Preisgestaltung: Die Kernkomponenten

LangChain selbst ist komplett kostenlos. Das Framework ist Open Source und ohne Lizenzkosten verfügbar. Dies gilt sowohl für die Python- als auch für die JavaScript-Implementierung, die Entwickler via pip oder npm installieren und sofort verwenden können.

Das Framework bietet modulare Komponenten für die Entwicklung von LLM-Anwendungen: Ketten zur Sequenzierung von Operationen, Agenten für autonome Entscheidungsfindung, Abrufer für die Dokumentensuche und Speichersysteme für den Gesprächskontext. Für keine dieser Kernfunktionen ist eine Zahlung an LangChain erforderlich.

Das LangChain-Ökosystem geht jedoch über das Kernframework hinaus. LangGraph, eine Bibliothek zum Erstellen zustandsbehafteter Multiagenten-Workflows, ist ebenfalls Open Source und kostenlos. LangServe, das Ketten in bereitstellbare APIs umwandelt, folgt demselben Modell: Die Nutzung ist kostenlos, allerdings erfordert die Bereitstellung dieser APIs eine Cloud-Infrastruktur mit entsprechenden Hostingkosten.

LangSmith Observability Platform: Wo die Abonnementkosten beginnen

LangSmith ist der Ort, an dem Teams die ersten direkten Kosten des LangChain-Ökosystems bemerken. Diese Plattform bietet Funktionen zum Tracing, Debugging, zur Evaluierung und zum Monitoring, die beim Übergang vom Prototyp zur Produktion unerlässlich sind.

Laut der offiziellen Preisseite von LangChain bietet LangSmith ab 2026 drei Preisstufen an:

| Planen | Preis pro Sitzplatz | Basisspuren enthalten | Spurenretention | Am besten geeignet für |

|---|---|---|---|---|

| Entwickler | $0/Monat | 5.000/Monat | 14 Tage (Basis) | Einzelentwickler, Prototyping |

| Plus | $39/Monat | 10.000/Monat | 14 Tage (Basis), 400 Tage (verlängert) | Kleine Teams, Produktions-Apps |

| Unternehmen | Individuelle Preise | Benutzerdefinierte Zuweisung | Kundenbindung | Große Organisationen, Compliance-Anforderungen |

Der Entwicklerplan bietet einen kostenlosen Arbeitsplatz und ist daher ideal für Einzelentwickler, die mit der Softwareentwicklung beginnen. Er beinhaltet bis zu 5.000 Basistraces pro Monat; darüber hinaus wird der Verbrauch nutzungsabhängig abgerechnet. Basistraces kosten $2,50 pro 1.000 Traces und werden 14 Tage lang aufbewahrt.

Erweiterte Protokollierungsfunktionen, die Daten 400 Tage lang speichern, kosten $5,00 pro 1.000 Protokollierungen (das Doppelte des Basispreises). Bei Anwendungen, die langfristige Überwachung und Compliance-Prüfprotokolle erfordern, können sich diese Kosten erheblich summieren.

Der Plus-Plan für $39 pro Arbeitsplatz und Monat ist die bevorzugte Option der meisten Produktionsteams. Er umfasst 10.000 Basistraces pro Monat, eine unbegrenzte Anzahl an Fleet-Agenten für autonome Operationen und E-Mail-Support. Teams können beliebig viele weitere Arbeitsplätze zum gleichen Preis pro Arbeitsplatz hinzufügen.

Zu den weiteren Funktionen von LangSmith gehören Anmerkungswarteschlangen für menschliches Feedback, die Verwaltung von Eingabeaufforderungen über den Prompt Hub und Playground sowie die Überwachung mit Benachrichtigungsfunktionen. Diese Tools sind in den Tarifpaketen enthalten und verursachen keine separaten Kosten.

LLM-API-Kosten: Die größte Variable in Produktionsbudgets

Der größte laufende Kostenfaktor bei LangChain-Anwendungen sind die Kosten für den Aufruf der LLM-APIs. Diese übersteigen die Kosten für Framework und Tools bei Weitem, insbesondere bei Anwendungen, die in großem Umfang betrieben werden.

LangChain unterstützt die Integration mit Dutzenden von Modellanbietern über seine standardisierte Schnittstelle. Jeder Anbieter hat unterschiedliche Preisstrukturen, die auf dem Tokenverbrauch, der Modellleistung und zusätzlichen Funktionen wie Caching oder Stapelverarbeitung basieren.

Preislandschaft des Modells 2026

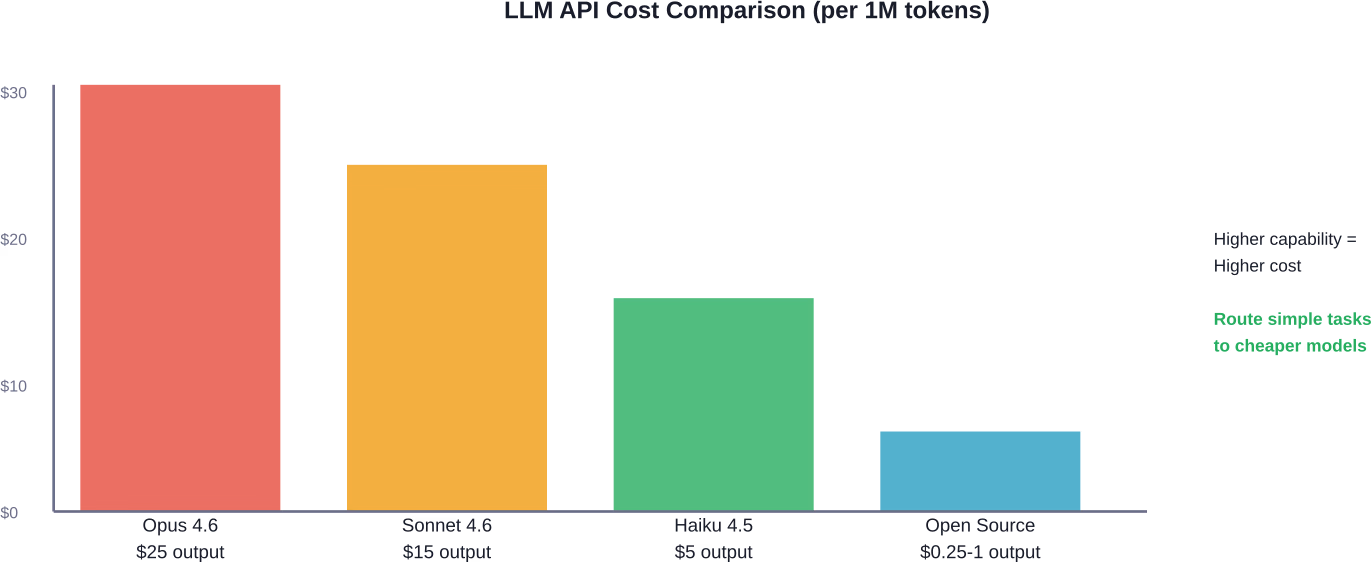

Die Claude-Modelle von Anthropic sind eine gängige Wahl für LangChain-Anwendungen. Laut aktueller Preisdokumentation bieten die Claude-Modelle folgende repräsentative Preise pro Million Token (Preisänderungen vorbehalten):

- Claude Opus 4.6: $5 Eingang / $25 Ausgang

- Claude Sonett 4.6: $3 Eingang / $15 Ausgang

- Claude Haiku 4.5: Eingang $0.25-$1 / Ausgang $1.25-$5

Ältere Modelle der Claude 4.1-Serie weisen höhere Preise auf, wobei Opus 4.1 bei $15 Input / $75 Output pro Million Token liegt. Die Preisentwicklung verdeutlicht, dass neuere Generationen oft eine bessere Performance zu geringeren Kosten bieten.

OpenAI-Modelle verwenden ein ähnliches tokenbasiertes Preismodell, wobei die konkreten Preise für 2026 je nach Modellgeneration variieren. Modelle der GPT-4-Klasse liegen typischerweise zwischen $2,50 und $30 pro Million Eingabe-Token, abhängig von der Fähigkeitsstufe und der Größe des Kontextfensters.

Kleinere Open-Source-Modelle, auf die über Anbieter wie Groq zugegriffen oder die auf Infrastrukturen wie AWS Bedrock gehostet werden, können die Kosten pro Token erheblich senken – manchmal um 80-95% im Vergleich zu Frontier-Modellen – allerdings mit entsprechenden Leistungseinbußen.

Strategien zur Kostenoptimierung

Durch das Zwischenspeichern von Eingabeaufforderungen lassen sich die Kosten für wiederholte Kontextinformationen um bis zu 90% senken. Wenn Anwendungen ähnliche Dokumente verarbeiten oder konsistente Systemeingabeaufforderungen über verschiedene Anfragen hinweg beibehalten, eliminiert das Zwischenspeichern der kodierten Darstellungen redundante Verarbeitungskosten.

Die Batch-API-Verarbeitung bietet, sofern verfügbar, in der Regel Preisnachlässe von 50% gegenüber Echtzeitverarbeitung. Anwendungen, die verzögerte Antworten tolerieren können – wie Dokumentenverarbeitungspipelines oder nächtliche Analyseprozesse – profitieren erheblich von der Batch-Preisgestaltung.

Die Kombination dieser Strategien führt zu erheblichen Einsparungen. Laut Kostenoptimierungsstudien können Teams, die sowohl Prompt-Caching als auch Batch-APIs nutzen, die gesamten Inferenzkosten im Vergleich zur standardmäßigen Echtzeitverarbeitung ohne Caching potenziell deutlich senken.

Modellrouting stellt einen weiteren Optimierungsansatz dar. Hierarchische Architekturen in der Finanzdokumentenverarbeitung erreichten eine reflexive Architekturgenauigkeit von 97,71 TP3T bei Kosten von 60,91 TP3T, basierend auf Benchmark-Daten für spezialisierte Workflows. LangChain-Anwendungen können eine ähnliche Logik implementieren, um einfache Anfragen an kostengünstigere Modelle weiterzuleiten und gleichzeitig teure Spitzenmodelle für komplexe Schlussfolgerungsaufgaben zu reservieren.

Infrastruktur- und Unterstützungsdienstkosten

Über die LLM-APIs und die LangSmith-Observability hinaus benötigen LangChain-Anwendungen eine unterstützende Infrastruktur, die das Gesamtbudget erhöht.

Kosten der Vektordatenbank

Anwendungen, die auf Retrieval-gestützter Generierung basieren, benötigen Vektordatenbanken zum Speichern und Durchsuchen von Dokumenteneinbettungen. Gängige Optionen sind Pinecone, Weaviate, Qdrant und Chroma, die jeweils unterschiedliche Preismodelle anbieten.

Die Abrechnung von Managed Vector Database-Diensten basiert in der Regel auf Datenvolumen, Abfragevolumen und Leistungsstufe. Kleinere Anwendungen nutzen oft kostenlose Tarife mit 1 GB Speicherplatz und begrenzter Abfrageanzahl. Produktionsumgebungen mit Millionen von Vektoren können je nach Umfang und Replikationsanforderungen monatlich zwischen 1.400 und über 1.400 US-Dollar kosten.

Selbstgehostete Vektordatenbanken eliminieren zwar Abonnementkosten, erfordern aber Infrastrukturmanagement. Der Betrieb von Qdrant oder Chroma auf Cloud-Computing-Instanzen verlagert die Kosten auf Servermiete und Betriebsaufwand.

Einbettungsmodellkosten

Die Generierung von Einbettungen für die Vektorspeicherung verursacht eigene API-Kosten, die jedoch typischerweise deutlich niedriger sind als die LLM-Inferenz. OpenAIs text-embedding-3-large kostet etwa $0,13 pro Million Token, während kleinere Einbettungsmodelle noch weniger kosten.

Bei Anwendungen, die große Dokumentensammlungen verarbeiten, können die Einbettungskosten schnell ansteigen. Die Verarbeitung von 10 Millionen Dokumenten-Tokens würde mit Standard-Einbettungs-APIs etwa $1,30 kosten – vernachlässigbar im Vergleich zu den LLM-Kosten, aber dennoch wichtig für eine genaue Budgetplanung.

Anwendungshosting

Für die Bereitstellung von LangChain-Anwendungen werden Rechenressourcen benötigt. Einfache Chatbots können auf serverlosen Plattformen wie Vercel oder AWS Lambda mit minimalen Kosten von unter 100.000 US-Dollar pro Monat betrieben werden. Komplexere Agentensysteme mit kontinuierlichem Betrieb und Zustandsverwaltung benötigen hingegen persistente Server.

Die Kosten für Cloud-Computing variieren stark je nach Anforderungen. Eine einfache containerisierte Bereitstellung auf Diensten wie Render oder Railway beginnt bei etwa 1,4 Tsd. bis 1,4 Tsd. pro Monat für kleine Instanzgrößen. Produktionssysteme mit automatischer Skalierung, Lastverteilung und Hochverfügbarkeit können je nach Datenverkehr und Komplexität 1,4 Tsd. bis über 1,4 Tsd. pro Monat erreichen.

Investitionen des Entwicklungsteams: Die versteckten Kosten

Die Entwicklerzeit stellt einen erheblichen Teil der gesamten Projektkosten dar, wird aber oft übersehen, wenn der Fokus auf Infrastruktur- und API-Ausgaben liegt.

Die Entwicklung einer einfachen LangChain-Anwendung – beispielsweise eines simplen RAG-Chatbots oder eines Dokumenten-Frage-Antwort-Systems – erfordert in der Regel 40 bis 80 Stunden von einem Entwickler mit Kenntnissen in Python und LLM. Bei üblichen Stundensätzen von $75 bis $150 entspricht dies einem Entwicklungsaufwand von $3.000 bis $12.000.

Komplexe Multiagentensysteme mit kundenspezifischen Tools, ausgefeiltem Speichermanagement und produktionsreifer Fehlerbehandlung können 200 bis über 500 Entwicklungsstunden erfordern. Für Teams, die eigene agentenbasierte Workflows entwickeln, können die Entwicklungsinvestitionen leicht 20.000 bis 75.000 TTP erreichen, bevor die Anwendung auch nur eine einzige Produktionsanfrage verarbeitet.

Die laufende Wartung trägt ebenfalls zu diesen Kosten bei. LLM-APIs entwickeln sich rasant weiter, Modelle werden häufig als veraltet markiert und neue Versionen veröffentlicht. Die Aktualisierung von Anwendungen, die Überwachung von Leistungseinbußen und die Optimierung von Eingabeaufforderungen bei sich änderndem Modellverhalten erfordern kontinuierliche Aufmerksamkeit der Entwickler.

Praxisbeispiele für Budgets: Vom Prototyp zur Produktion

Das Verständnis abstrakter Kostenkomponenten ist hilfreich, aber reale Budgetszenarien bieten eine klarere Planungsgrundlage.

Szenario 1: Prototyp für Einzelentwickler

Ein einzelner Entwickler erstellt ein Proof-of-Concept-Dokumentenanalysetool:

- LangChain-Framework: $0

- LangSmith-Entwicklerplan: $0 (5.000 Spuren/Monat)

- Nutzung der Claude Haiku API (50.000 Anfragen, durchschnittlich 2.000 Tokens pro Ausgabe): ~$500/Monat

- Vektordatenbank (Chroma selbst gehostet): $0

- Hosting (Eisenbahn-Hobbystufe): $0-$5/Monat

- Entwicklungszeit (60 Stunden selbstfinanziert): Nicht in Rechnung gestellt

Monatlich wiederkehrende Gesamtkosten: ~$505. Anfangsinvestition in die Entwicklung: 60 Stunden Entwicklerzeit.

Szenario 2: Kundensupport-Bot für ein kleines Team

Ein Startup, das mit 3 Teammitgliedern einen internen Kundensupport-Assistenten aufbaut:

- LangChain-Framework: $0

- LangSmith Plus-Plan (3 Sitze): $117/Monat

- Nutzung der Claude Sonnet API (200.000 Anfragen, durchschnittlich 1.500 ausgegebene Tokens): ~$4.500/Monat

- Vektordatenbank für Kiefernzapfen (Starterpaket): $70/Monat

- AWS-Hosting (containerisierte Bereitstellung): $150/Monat

- Entwicklungszeit (anfängliche 200 Stunden im gesamten Team zu $75-$150/Stunde): $15.000-$30.000 einmalig

- Laufende Optimierung (10 Stunden/Monat): $750-$1.500/Monat

Monatliche Gesamtkosten: ca. 1.400.5587–1.400.6337. Anfangsinvestition für die Entwicklung: 1.400.150.000–1.400.300.000.

Szenario 3: Dokumentenverarbeitungspipeline im Unternehmen

Eine große Organisation, die täglich Tausende von Finanzdokumenten verarbeitet:

- LangChain-Framework: $0

- LangSmith Enterprise-Plan (25 Plätze): ~$3.000+/Monat (individuelle Preisgestaltung)

- Multi-Modell-Routing (Opus für komplexe, Haiku für einfache Stapelverarbeitung): ~$15.000/Monat

- Vektordatenbank (verwaltet, hohe Verfügbarkeit): $800/Monat

- Cloud-Infrastruktur (automatische Skalierung, Redundanz): $2.500/Monat

- Entwicklungsteam (erste Version, 500 Stunden): $50.000-$100.000 einmalig

- Kontinuierliche Weiterentwicklung und Optimierung (40 Stunden/Monat): $3.000-$6.000/Monat

Monatliche Gesamtkosten: ca. 1.400.243.000–1.400.273.000. Anfangsinvestition für die Entwicklung: 1.400.500.000–1.400.000.

Kostenverfolgung und Budgetverwaltung

Die Verwaltung der Anwendungskosten von LLM erfordert Einblick in die Token-Verbrauchsmuster. LangSmith bietet integrierte Funktionen zur Kostenverfolgung, die sich in LangChain-Anwendungen integrieren lassen.

Laut der offiziellen Dokumentation zur Kostenverfolgung berechnet LangSmith die Kosten anhand von Metadaten zur Token-Nutzung und konfigurierbaren Preismodellen. Teams können für jedes Modell Input- und Outputpreise pro Million Token festlegen, wobei detaillierte Aufschlüsselungen nach Token-Typen unterstützt werden.

Bei Anwendungen, die OpenAI, Anthropic oder Modelle in OpenAI-kompatiblen Formaten aufrufen, erfolgt die Kostenverfolgung automatisch bei Verwendung von LangChain-Integrationen oder LangSmith-Wrappern. Die Plattform liest die Token-Anzahlen aus den API-Antworten und wendet Preisregeln an, um die Laufzeitkosten zu berechnen.

Individuelle Kostenstrukturen – wie nichtlineare Preisgestaltung oder anbieterspezifische Rabatte – erfordern eine manuelle Kostenannotation. Teams können Kostenmetadaten programmatisch an Ablaufverfolgungen anhängen, wenn die automatische Berechnung nicht der tatsächlichen Abrechnung entspricht.

Die Kostenberechnung erfolgt nach dem Prinzip „vom häufigsten zum seltensten Token-Typ“. Wenn die Preisgestaltung beispielsweise $2 pro Million eingegebener Token und $1 pro Million aus dem Cache gelesener Token vorsieht und ein Durchlauf 20 eingegebene Token verwendet, davon 5 aus dem Cache, berechnet das System $1 pro Million für die 5 zwischengespeicherten Token und $2 pro Million für die verbleibenden 15 Standardeingaben.

Vergleich von LangChain mit alternativen Frameworks

Die Kostenüberlegungen erstrecken sich auch auf die Framework-Auswahl. LangChain konkurriert mit Alternativen wie dem Vercel AI SDK und der direkten Nutzung des OpenAI SDK, die jeweils unterschiedliche Kostenfolgen haben.

Das Vercel AI SDK konzentriert sich auf Streaming und Edge-Bereitstellung und ist für Next.js-Anwendungen optimiert. Das Framework selbst ist kostenlos, ähnlich wie LangChain. Im Gegensatz zu LangSmith bietet es jedoch keine integrierte Observability, sodass separate Monitoring-Lösungen erforderlich sind, die zusätzliche Kosten verursachen können.

Das OpenAI SDK ermöglicht den direkten Zugriff auf OpenAI-Modelle mit minimaler Abstraktion. Dadurch entfällt der Framework-Overhead, allerdings ist eine individuelle Implementierung von Funktionen erforderlich, die LangChain standardmäßig bietet – Kettenkomposition, Speicherverwaltung und Tool-Integration. Die Zeitersparnis bei der Entwicklung durch die Verwendung von LangChain überwiegt oft die geringfügigen Leistungssteigerungen durch die direkte SDK-Nutzung.

Der Semantic Kernel von Microsoft bietet ähnliche Orchestrierungsfunktionen mit enger Azure-Integration. Teams, die bereits im Azure-Ökosystem tätig sind, können die gebündelten Dienste über die Azure-Integration des Semantic Kernels nutzen, obwohl das Framework selbst wie LangChain ebenfalls Open Source und kostenlos ist.

| Rahmen | Kernlizenz | Beobachtbarkeit | Am besten geeignet für | Kostenprofil |

|---|---|---|---|---|

| LangChain | Kostenlos/Offen | LangSmith ($0-$39+/Sitz) | Komplexe Wirkstoffe, RAG | LLM-APIs + optionale Tools |

| Vercel AI SDK | Kostenlos/Offen | Drittanbieter erforderlich | Edge-Streaming, Next.js | LLM-APIs + Monitoring-SaaS |

| OpenAI SDK | Kostenlos/Offen | Kundenspezifische Implementierung | Einfache Apps, die ausschließlich OpenAI nutzen | LLM APIs + Entwicklungszeit |

| Semantischer Kernel | Kostenlos/Offen | Azure Application Insights | Azure-native Bereitstellungen | LLM-APIs + Azure-Dienste |

Technische Schulden und langfristige Kostenüberlegungen

Die Wahl eines weit verbreiteten Frameworks wie LangChain kann bestimmte Risiken reduzieren, die mit verlassenen Frameworks verbunden sind.

Die rasante Weiterentwicklung von Frameworks bringt jedoch Herausforderungen für das Versionsmanagement mit sich. LangChain veröffentlicht regelmäßig grundlegende Änderungen, da sich die LLM-Landschaft ständig verändert. Teams sollten daher regelmäßige Aktualisierungen einplanen, da LangChain sowohl grundlegende Änderungen als auch neue Funktionen veröffentlicht.

Untersuchungen zeigen, dass selbst eingeräumte technische Schulden in 2,41 TP3T bis 311 TP3T Quellcode von Open-Source-Projekten auftreten, oft verursacht durch erfahrene Entwickler. Insbesondere bei LLM-Anwendungen häufen sich diese Schulden im Zusammenhang mit der Verwaltung von Prompt-Updates, Evaluierungsmethoden und der Festlegung von Modellversionen – alles Bereiche, in denen Tools wie LangSmith zwar einen Mehrwert bieten, aber kostenpflichtig sind.

Die ROI-Berechnung durchführen

Ob sich die Entwicklungskosten von LangChain wirtschaftlich lohnen, hängt vom generierten Geschäftswert ab. Ein Kundensupport-Bot, der täglich 1.000 Anfragen bearbeitet und das Support-Ticket-Volumen um 301.300 reduziert, könnte monatliche Betriebskosten von 1.450.000 rechtfertigen, wenn er 1.420.000 an Gehältern für Supportmitarbeiter einspart.

Dokumentenverarbeitungsprozesse erfordern eine ähnliche Analyse. Verarbeitet ein Unternehmen monatlich 10.000 Finanzdokumente und reduziert die LLM-Automatisierung die Prüfzeit pro Dokument von 15 auf 3 Minuten, so ergibt sich eine Arbeitsersparnis von 2.000 Stunden monatlich bei einem Stundensatz von $50 – insgesamt 100.000 TP4T. Selbst bei einem teuren Modell mit einem monatlichen ROI von 20.000 TP4T zeigt sich ein deutlicher Return on Investment.

Prototypen und MVPs erfordern unterschiedliche Kalkulationen. Es ist sinnvoll, 1.400.000 TP in die Entwicklung zu investieren, um die Produkt-Markt-Passung vor der vollständigen Markteinführung zu validieren. 1.400.000 TP in einen Prototyp ohne Nutzervalidierung zu investieren, ist hingegen nicht sinnvoll.

Die zentrale Erkenntnis: Die Kosten von LangChain und LangSmith sind Optimierungsprobleme, keine Fixkosten. Teams haben die Kontrolle über Modellauswahl, Caching-Strategien, Batch-Verarbeitung und Infrastruktur. Das Framework bietet die Flexibilität, kostengünstig zu starten und strategisch zu skalieren, sobald sich der Geschäftswert bestätigt.

Halten Sie LangChain-Projekte vom ersten Tag an effizient

LangChain sieht anfangs oft einfach aus, aber die Kosten steigen tendenziell an, sobald Ketten, Eingabeaufforderungen und Modellaufrufe im realen Einsatz skalieren. AI Superior Wir arbeiten an der gesamten LLM-Anwendungsschicht hinter Frameworks wie LangChain – von der Modellauswahl über die Feinabstimmung und die Einrichtung der Datenabfrage bis hin zum Deployment. Der Fokus liegt nicht auf dem Framework selbst, sondern auf der Entwicklung von Systemen, in denen Modellaufrufe, Datenflüsse und Infrastruktur optimal auf den jeweiligen Anwendungsfall abgestimmt sind. Dadurch bleibt der Tokenverbrauch kontrolliert und unnötige Lasten werden vermieden.

Die meisten Kostenprobleme in LangChain-Setups entstehen durch die Systemarchitektur, nicht durch das gewählte Tool. Um überdimensionierte Ketten und steigende Inferenzkosten zu vermeiden, wenden Sie sich bitte an [Kontaktinformationen einfügen]. AI Superior Überprüfen Sie die Einrichtung Ihrer LLM-Anwendung, bevor Sie sie skalieren.

Häufig gestellte Fragen

Ist LangChain komplett kostenlos nutzbar?

Ja, das LangChain-Framework selbst ist Open Source und kostenlos. Für das Kern-Framework, LangGraph und LangServe fallen keine Lizenzkosten, Nutzungsgebühren oder Abonnements an. Die Entwicklung von Anwendungen verursacht jedoch Kosten für LLM-API-Aufrufe, die optionale LangSmith-Observability-Plattform und das Hosting der Infrastruktur.

Wie hoch sind die Kosten für LangSmith-Produktionsanwendungen?

LangSmith bietet einen kostenlosen Entwicklerplan mit 5.000 Traces pro Monat, ideal für Einzelentwickler und Prototypen. Der Plus-Plan kostet $39 pro Benutzer und Monat und umfasst 10.000 Traces monatlich. Er eignet sich daher für kleine Teams und Produktionsumgebungen. Die Preise für Enterprise-Lösungen werden individuell nach Umfang und Anforderungen berechnet. Zusätzliche Traces über die Plangrenzen hinaus kosten je nach Aufbewahrungsdauer $2,50 bis $5,00 pro 1.000 Traces.

Welche typischen LLM-API-Kosten fallen für eine LangChain-Anwendung an?

Die Kosten der LLM-API variieren stark je nach Modell und Nutzungsvolumen. Claude Haiku kostet 0,25–5 TTP pro Million Token, Sonnet 3–15 TTP pro Million und Opus 5–25 TTP pro Million. Ein kleiner Chatbot, der monatlich 50.000 Anfragen mit durchschnittlich 2.000 Ausgabetoken verarbeitet, kann je nach Modellstufe 500–2.500 TTP pro Monat kosten. Unternehmensanwendungen können bei hohem Umfang 10.000–50.000+ TTP pro Monat erreichen.

Kann ich die Kosten für den LLM-Studiengang senken, ohne die Qualität zu beeinträchtigen?

Ja, durch verschiedene Optimierungsstrategien. Prompt-Caching kann die Kosten für wiederholte Kontexte um bis zu 90% senken. Die Batch-API-Verarbeitung bietet Kosteneinsparungen von 50% für nicht-Echtzeit-Workloads. Modellrouting – die Verwendung kostengünstigerer Modelle für einfache Aufgaben und teurer Modelle nur für komplexe Schlussfolgerungen – kann die Kosten um 40–60% senken und gleichzeitig eine Genauigkeit von über 95% beibehalten. Die Kombination dieser Techniken ermöglicht eine signifikante Kostenreduzierung im Vergleich zu nicht optimierten Implementierungen.

Benötige ich LangSmith, um LangChain in der Produktion zu verwenden?

Nein, LangSmith ist optional. LangChain-Anwendungen laufen auch ohne LangSmith-Abonnements einwandfrei. LangSmith bietet jedoch wichtige Funktionen für Observability, Debugging und Evaluierung, die insbesondere für Produktionsumgebungen wertvoll sind. Teams können ohne LangSmith beginnen und es erst dann hinzufügen, wenn die Komplexität oder der Umfang der Anwendung das Debugging und Monitoring erschwert. Der kostenlose Developer-Plan bietet eingeschränktes Tracing zum Testen dieser Funktionen.

Wie hoch sollte mein Budget für die LangChain-Entwicklung sein?

Die Entwicklungskosten hängen von der Komplexität der Anwendung ab. Einfache Chatbots oder Dokumenten-Frage-Antwort-Systeme benötigen typischerweise 40–80 Entwicklungsstunden (1.400–12.000 Tsd. zu Standardtarifen). Komplexe Multiagentensysteme mit kundenspezifischen Tools und anspruchsvollen Workflows können 200–500+ Stunden in Anspruch nehmen (15.000–75.000+ Tsd.). Die laufende Wartung verursacht je nach Umfang monatlich zusätzliche 5–40 Stunden. Die monatlichen Betriebskosten reichen von 500 Tsd. für Prototypen bis zu über 25.000 Tsd. für Unternehmensimplementierungen, wobei die Nutzung der LLM-API wiederkehrende Kosten von 55–991 Tsd. verursacht.

Gibt es versteckte Kosten, auf die ich achten sollte?

Zu den am häufigsten übersehenen Kosten gehören Abonnements für Vektordatenbanken für RAG-Anwendungen ($0–$500+ monatlich), Kosten für die Einbettungs-API zur Dokumentenverarbeitung ($0,10–$0,30 pro Million Token), Infrastruktur-Hosting über die kostenlosen Serverless-Konditionen hinaus ($20–$2.000+ monatlich) sowie der Entwickleraufwand für die laufende Optimierung und Aktualisierung der Modelle (10–40 Stunden monatlich). Teams unterschätzen zudem mitunter den Token-Verbrauch während der Entwicklung und des Testens, was die ursprünglichen Budgetschätzungen um 20–50% erhöhen kann.

Planung Ihres LangChain-Entwicklungsbudgets

Die Entwicklung von LLM-Anwendungen mit LangChain im Jahr 2026 erfordert das Verständnis verschiedener Kostenebenen. Das Framework selbst eliminiert zwar Lizenzkosten, die Gesamtbetriebskosten umfassen jedoch die Nutzung der LLM-API, optionale Observability-Tools, die unterstützende Infrastruktur und die Investitionen der Entwickler.

Beginnen Sie mit dem kostenlosen Tarif. Das Open-Source-Framework von LangChain und der Developer-Plan von LangSmith ermöglichen es Teams, Konzepte ohne Vorabkosten zu prototypisieren und zu validieren. Diese risikofreie Testphase hilft festzustellen, ob die Anwendung genügend Mehrwert generiert, um Investitionen in die Produktion zu rechtfertigen.

Skalieren Sie Ihr System schrittweise. Beginnen Sie mit günstigeren Modellen wie Claude Haiku oder kleineren Alternativen. Implementieren Sie von Anfang an Prompt-Caching und Batch-Verarbeitung. Rüsten Sie erst dann auf leistungsfähigere Modelle auf, wenn die Qualitätsverbesserung den Mehraufwand rechtfertigt.

Behalten Sie den Überblick. Aktivieren Sie die Kostenverfolgung von LangSmith frühzeitig, um Verbrauchsmuster zu erkennen, bevor teure Überraschungen entstehen. Überprüfen Sie die Token-Nutzung wöchentlich während der Entwicklung und täglich im Produktivbetrieb. Richten Sie Budgetwarnungen ein, bevor die Kosten akzeptable Schwellenwerte überschreiten.

Am wichtigsten ist es, den Geschäftswert den technischen Kosten gegenüberzustellen. LLM-Anwendungen sollten Probleme lösen, deren Wert die Betriebskosten übersteigt. Wenn die Rechnung nicht aufgeht – wenn die API-Kosten den generierten Nutzen übersteigen –, kann auch die beste Optimierung das Projekt nicht nachhaltig gestalten. Übersteigt der Nutzen jedoch die Kosten, bietet LangChain die Werkzeuge für effiziente Entwicklung, Bereitstellung und Skalierung.

Bereit für den Start? Das LangChain-Framework ist ab sofort kostenlos verfügbar. Testen Sie es mit dem LangSmith Developer-Plan, wählen Sie ein kostengünstiges Modell für erste Experimente und skalieren Sie Ihre Investition, sobald Ihre Anwendung ihren Wert unter Beweis stellt. Mit dem Framework können Sie noch heute nahezu kostenlos beginnen und in Ihrem eigenen Tempo zur Produktion übergehen.