Kurzzusammenfassung: Predictive-Analytics-Software nutzt historische Daten, statistische Modelle, maschinelles Lernen und KI, um zukünftige Ergebnisse vorherzusagen und Trends frühzeitig zu erkennen. Moderne Plattformen reichen von codefreien Business-Tools bis hin zu umfassenden Data-Science-Ökosystemen für Unternehmen und bieten Funktionen für Umsatzprognosen, Kundenabwanderungsprognosen, Bedarfsplanung und Risikobewertung. Die Wahl der passenden Lösung hängt von Ihrem Datenbestand, den Kompetenzen Ihres Teams, der minimalen Größe des benötigten Datensatzes und Ihren Anforderungen an branchenspezifische Modelle oder allgemeine Prognosen ab.

Marketinganalysten verbringen rund 401 TP3 T ihrer Zeit mit der Datenaufbereitung für die Analyse. Dadurch bleibt kaum Zeit für Prognosen, die den Umsatz steigern. Das richtige Tool für prädiktive Analysen kann dies ändern – aber nur, wenn es zu Ihrer Dateninfrastruktur, den Fähigkeiten Ihres Teams und Ihren spezifischen Anwendungsfällen passt.

Dieser Leitfaden bewertet Plattformen für prädiktive Analysen anhand wichtiger Kriterien: minimale Datenanforderungen, Komplexität der Implementierung, Transparenz des Modells und der Unterschied zwischen marketingspezifischen und allgemeinen Business-Intelligence-Tools.

Was ist Predictive-Analytics-Software?

Software für prädiktive Analysen analysiert aktuelle und historische Geschäftsdaten, um zukünftige Ereignisse, Trends und Verhaltensweisen vorherzusagen. Diese Plattformen nutzen statistische Modellierung, Data-Mining-Techniken, künstliche Intelligenz und maschinelles Lernen, um die Wahrscheinlichkeit zukünftiger Ergebnisse zu bestimmen.

Vereinfacht ausgedrückt: Predictive Analytics interpretiert die historischen Daten einer Organisation, um Vorhersagen über zukünftige Entwicklungen zu treffen.

Moderne prädiktive Analyseverfahren können Muster in Daten erkennen und so zukünftige Risiken und Chancen identifizieren. Bei effektiver Implementierung liefern diese Tools messbare Geschäftsergebnisse, die sich direkt auf das Unternehmensergebnis auswirken.

Die Umsatzprognose wird zuverlässiger, wenn Plattformen historische Verkaufsmuster zusammen mit Marktsignalen, saisonalen Trends und Kundendaten analysieren. Finanzteams können mithilfe von Prognosemodellen den Liquiditätsbedarf Wochen oder Monate im Voraus antizipieren, anstatt erst bei Engpässen reagieren zu müssen.

Wie prädiktive Analysen funktionieren

Der Prozess beginnt mit der Datenerfassung. Plattformen beziehen Informationen aus Datenbanken, Tabellenkalkulationen, Cloud-Diensten, CRM-Systemen, Marketing-Automatisierungstools und anderen Quellen.

Im nächsten Schritt erfolgt die Datenaufbereitung – das Bereinigen von Inkonsistenzen, der Umgang mit fehlenden Werten und die Umwandlung der Rohdaten in modellfähige Formate. Diese Phase beansprucht in der Regel den größten Teil der Arbeitszeit der Analysten.

Statistische Modellierung und Algorithmen des maschinellen Lernens identifizieren anschließend Muster in historischen Daten. Die Software wird anhand vergangener Beispiele trainiert, um zu lernen, welche Variablen mit bestimmten Ergebnissen korrelieren.

Schließlich generieren die trainierten Modelle Vorhersagen auf Basis neuer Daten, bewerten Leads, prognostizieren die Nachfrage, schätzen die Abwanderungswahrscheinlichkeit oder was auch immer die Zielvariable ist.

Aber hier liegt der springende Punkt: Die Genauigkeit hängt vollständig von der Datenqualität und -menge ab. Wenn das Modell nur 50 Konversionen erfasst, kann es nicht gut generalisieren. Wenn sich die Leadquellen ändern, die Trainingsdaten diese Änderung aber nicht widerspiegeln, driften die Vorhersagen ab.

Gängige Techniken der prädiktiven Analytik

Verschiedene Techniken eignen sich für unterschiedliche Vorhersageaufgaben. Die meisten Plattformen unterstützen mehrere Methoden und wählen entweder automatisch die am besten geeignete aus oder überlassen die Auswahl den Datenwissenschaftlern manuell.

Regressionsanalyse

Regressionsmodelle prognostizieren kontinuierliche numerische Ergebnisse – Umsatz, Auftragsvolumen, Kundenwert, Lagerbestände. Die lineare Regression ermittelt geradlinige Zusammenhänge zwischen Variablen. Komplexere Regressionsverfahren berücksichtigen nichtlineare Muster und Wechselwirkungen zwischen Merkmalen.

Klassifikationsmodelle

Die Klassifizierung sagt kategoriale Ergebnisse voraus: Wird dieser Lead konvertieren (ja/nein), zu welchem Kundensegment gehört dieser Interessent (A/B/C/D), ist diese Transaktion betrügerisch (wahr/falsch)? Logistische Regression, Entscheidungsbäume und Random Forests sind gängige Klassifizierungsverfahren.

Zeitreihenprognose

Zeitreihenanalysen untersuchen Datenpunkte, die in regelmäßigen Abständen erfasst werden – beispielsweise tägliche Umsätze, monatliche Kundenabwanderung oder Quartalserlöse. Diese Modelle berücksichtigen Saisonalität, Trends und zyklische Muster, um zukünftige Werte zu prognostizieren. ARIMA, exponentielle Glättung und Prophet sind gängige Algorithmen für Zeitreihenanalysen.

Maschinelles Lernen und neuronale Netze

Maschinelle Lernalgorithmen erkennen Muster ohne explizite Programmierung. Neuronale Netze, insbesondere Deep-Learning-Modelle, eignen sich hervorragend zum Aufspüren komplexer, nichtlinearer Zusammenhänge in großen Datensätzen. Diese Techniken ermöglichen fortgeschrittene Anwendungsfälle wie die Bilderkennung zur Qualitätskontrolle oder die Verarbeitung natürlicher Sprache zur Stimmungsanalyse.

Clustering und Segmentierung

Clustering gruppiert ähnliche Datensätze ohne vordefinierte Kategorien. Marketingteams nutzen Clustering, um Kundensegmente anhand von Verhaltensmustern zu identifizieren. Betriebsteams wenden es an, um Geräteausfälle oder Engpässe in der Lieferkette aufzudecken.

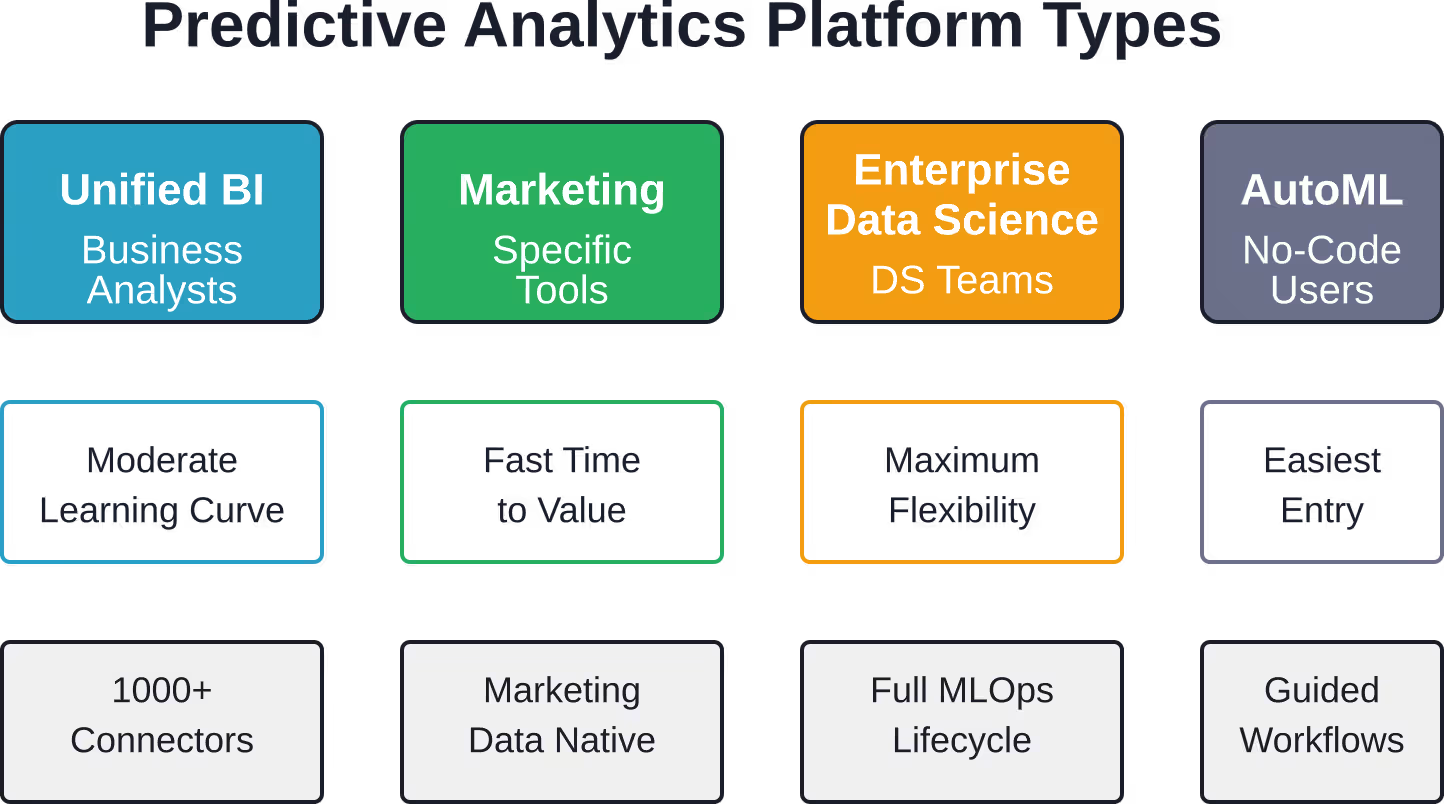

Arten von Plattformen für prädiktive Analysen

Nicht alle Predictive-Analytics-Softwarelösungen richten sich an dieselbe Zielgruppe oder lösen dieselben Probleme. Die Plattformen lassen sich in verschiedene Kategorien einteilen, jede mit ihren spezifischen Stärken.

Vereinheitlichte BI-Plattformen mit prädiktiven Funktionen

Tools wie Domo vereinen Business-Intelligence-Dashboards, Datenintegration und Prognosefunktionen in einer einzigen Umgebung. Diese Plattformen eignen sich für Business-Analysten, die Prognosen erstellen möchten, ohne programmieren zu müssen. Dank moderater Einarbeitungszeit, über 1.000 Datenkonnektoren und der Einhaltung von SOC 2 und HIPAA sind sie auch für regulierte Branchen geeignet.

Stärken: All-in-One-Funktionalität, schnellere Bereitstellung, auch für technisch nicht versierte Anwender zugänglich.

Einschränkungen: Weniger Anpassungsmöglichkeiten als bei Data-Science-Plattformen, bei hochspezialisierten Modellen können Grenzen erreicht werden.

Marketingspezifische Prognoseinstrumente

Speziell für Marketing-Anwendungsfälle entwickelt – Lead-Scoring, Abwanderungsprognose, Konversionswahrscheinlichkeit, Kampagnen-ROI-Prognose. Diese Tools verstehen Marketing-Datenstrukturen und sind für gängige Marketingprognosen vorkonfiguriert.

Stärken: schnelle Wertschöpfung, domänenspezifische Funktionen, optimiert für Marketing-Workflows.

Einschränkungen: Begrenzte Anwendbarkeit außerhalb des Marketings, möglicherweise sind separate Tools für Finanz- oder Betriebsprognosen erforderlich.

Enterprise-Data-Science-Plattformen

Leistungsstarke Ökosysteme für Data-Science-Teams: Modellentwicklungsumgebungen, Experimentverfolgung, MLOps-Pipelines, Bereitstellungsinfrastruktur. Beispiele hierfür sind Databricks, SageMaker und Azure Machine Learning.

Stärken: maximale Flexibilität, Unterstützung kundenspezifischer Algorithmen, Skalierung auf massive Datensätze, vollständiges Lebenszyklusmanagement.

Einschränkungen: steile Lernkurve, erfordert datenwissenschaftliche Expertise, längere Implementierungszeiten.

AutoML- und No-Code-Plattformen

Automatisierte Machine-Learning-Tools ermöglichen es Anwendern, mithilfe intuitiver Benutzeroberflächen Vorhersagemodelle zu erstellen. Die Software übernimmt automatisch Feature Engineering, Algorithmenauswahl, Hyperparameter-Optimierung und Modellevaluierung.

Stärken: Demokratisierung der prädiktiven Analytik, schnelles Prototyping, minimale technische Kenntnisse erforderlich.

Einschränkungen: weniger Kontrolle über Modellierungsentscheidungen, möglicherweise nicht gut mit Randfällen umgehen, schwierigere Fehlersuche, wenn Vorhersagen nicht stimmen.

Wichtige Merkmale, auf die Sie bei Software für prädiktive Analysen achten sollten

Die Bewertung von Predictive-Analytics-Plattformen erfordert einen Blick über Marketingversprechen hinaus auf Fähigkeiten, die sich auf reale Ergebnisse auswirken.

Datenintegration und -aufbereitung

Die Plattform benötigt Konnektoren zu Ihren bestehenden Datenquellen. Verfügt sie über mehr als 100 Datenquellenkonnektoren zu Datenbanken, Tabellenkalkulationen und Cloud-Diensten? Kann sie sowohl in der Cloud als auch lokal bereitgestellt werden?

Achten Sie auf integrierte Funktionen zur Datenbereinigung, -transformation und zum Feature Engineering. Wenn jedes Vorhersageprojekt benutzerdefinierte ETL-Arbeiten erfordert, wird das Tool eher zum Flaschenhals als zum Beschleuniger.

Modelltransparenz und Erklärbarkeit

Prognosen in Blackbox-Form untergraben das Vertrauen. Wenn ein Modell einen Lead als niedrig priorisiert einstuft, müssen Vertriebsteams die Gründe dafür verstehen. Erklärbare KI-Funktionen zeigen, welche Variablen die jeweilige Prognose beeinflusst haben.

Dies ist auch für die Einhaltung regulatorischer Vorgaben relevant. Finanzdienstleistungen, das Gesundheitswesen und andere regulierte Branchen müssen Modellentscheidungen dokumentieren. Standards zur Validierung von maschinellem Lernen, darunter auch die des IEEE, betonen Verifizierungsrahmen für produktive KI-Systeme.

Bereitstellung und Integration

Prognosen, die lediglich in einem Data-Science-Notebook existieren, generieren keinen geschäftlichen Mehrwert. Die Plattform muss Prognosen in operative Systeme – CRM, Marketing-Automatisierung, ERP – überall dort einfließen lassen, wo Entscheidungen getroffen werden.

Daten, Visualisierungen und Dashboards sollten in Drittanbieter-Tools einbettbar sein. Echtzeit-Scoring-APIs ermöglichen es Anwendungen, Vorhersagen bedarfsgesteuert anzufordern.

Skalierbarkeit und Leistung

Kann die Plattform Ihr Datenvolumen heute und in drei Jahren bewältigen? Manche Tools funktionieren gut mit 100.000 Datensätzen, stoßen aber bei 10 Millionen an ihre Grenzen.

Die Trainingszeit spielt ebenfalls eine Rolle. Dauert das erneute Training eines Modells acht Stunden, wird die Einbeziehung neuer Daten für schnelllebige Anwendungsfälle unpraktisch.

Zusammenarbeit und Steuerung

Mehrere Teammitglieder müssen auf Modelle zugreifen, Vorhersagen überprüfen und die Methodik verstehen. Versionskontrolle, Prüfprotokolle und rollenbasierte Berechtigungen verhindern Chaos bei wachsendem Team.

Die Modellüberwachung alarmiert die Teams, wenn die Vorhersagegenauigkeit nachlässt, und signalisiert so die Notwendigkeit eines erneuten Trainings oder einer Untersuchung.

Wenn prädiktive Analysen versagen: Minimale Anforderungen an die Datenqualität

Was die meisten Anbieter Ihnen nicht von vornherein sagen: Prognosemodelle benötigen umfangreiche historische Daten, um verlässliche Vorhersagen zu erstellen. Werden sie mit unzureichenden Daten eingesetzt, sinkt die Genauigkeit rapide.

Soll die Konversionswahrscheinlichkeit vorhergesagt werden, benötigt das Modell Hunderte – idealerweise Tausende – vergangener Konversionen aus verschiedenen Kontexten. Die Mindestschwellenwerte variieren je nach Vorhersagetyp.

Für die Leadbewertung sind in der Regel mindestens sechs Monate Leadhistorie und über 500 Conversions erforderlich. Bei weniger Conversions kann das Modell relevante Informationen nicht von irrelevanten Daten unterscheiden.

Die Prognose von Kundenabwanderung erfordert typischerweise mindestens zwölf Monate an Kundenlebenszyklusdaten und mindestens 200 Abwanderungsereignisse sowie die kontinuierliche Erfassung von Engagement-Kennzahlen. Wenn sich die Definitionen von Kundenabwanderung im Laufe der Zeit ändern (z. B. Kündigungen vs. Nichtverlängerungen), lernt das Modell inkonsistente Muster.

Für eine präzise Nachfrageprognose sind Verkaufsdaten der letzten 24 Monate erforderlich, um saisonale Schwankungen zu erfassen. Ein Jahr reicht nicht aus – das Modell kann nicht feststellen, ob der Anstieg im Dezember ein jährliches Muster oder eine einmalige Ausnahme darstellt.

Mal ehrlich: Liegt Ihre Datenmenge unter diesen Schwellenwerten, neigen Vorhersagemodelle zu Überanpassung. Sie liefern zwar hervorragende Ergebnisse bei historischen Daten, versagen aber bei neuen Vorhersagen. Es ist besser, abzuwarten und weitere Daten zu sammeln, als ein Modell einzusetzen, das Entscheidungsträger in die Irre führt.

Die besten Tools für prädiktive Analysen im Jahr 2026

Die Wahl der richtigen Plattform hängt von den Fähigkeiten des Teams, dem Budget, der Dateninfrastruktur und den konkreten Anwendungsfällen ab. Dieser Vergleich hebt die Stärken und idealen Szenarien der führenden Tools hervor.

| Werkzeug | Am besten geeignet für | Hauptstärke | Lernkurve | Typische Benutzer |

|---|---|---|---|---|

| Domo | Vereinheitlichte BI + prädiktive | All-in-One-Plattform mit über 1000 Anschlüssen | Mäßig | Business-Analysten, BI-Teams |

| Improvisiert | Marketinganalysen | Zusammenführung von Marketingdaten + KI-Agent für natürlichsprachliche Vorhersagen | Niedrig | Marketinganalysten, CMOs |

| Tableau | Visuelle Analytik | Exploration + eingebettete Prognose | Mäßig | Analysten, Datenvisualisierungsspezialisten |

| Datenbausteine | Enterprise ML | Einheitliche Daten- und KI-Plattform für massive Skalierung | Hoch | Dateningenieure, ML-Ingenieure |

| AWS SageMaker | Cloud-natives ML | Vollständiger Modelllebenszyklus auf der AWS-Infrastruktur | Hoch | Datenwissenschaftler, Entwickler |

| H2O.ai | AutoML | Automatisierte Modellerstellung für Nicht-Experten | Niedrig bis mittel | Analysten, Bürgerdatenwissenschaftler |

Einheitliche BI-Plattformen

Domo vereint Datenintegration, Dashboards und Prognosefunktionen in einem einzigen Abonnement. Teams können über 1.000 Datenquellen verbinden, Visualisierungen erstellen und statistische Prognose- oder Machine-Learning-Modelle integrieren, ohne das Tool wechseln zu müssen.

Die Plattform unterstützt komplexe Berechnungen und umfassende Zeitreihenanalysen zur Untersuchung von Saisonalität und Trends. Geschäftsanwender trainieren Modelle mithilfe geführter Arbeitsabläufe anstatt durch Programmierung.

Gut konzipierte Modelle mit sauberen, relevanten Daten erreichen in vielen Geschäftsanwendungen eine Genauigkeit von 80 bis 95 Prozent. Dank der SOC-2- und HIPAA-Konformität eignet sich Domo für das Gesundheitswesen, Finanzdienstleistungen und andere regulierte Branchen.

Marketingspezifische Tools

Improvado konzentriert sich ausschließlich auf Marketingdaten und vereint Kennzahlen von Werbeplattformen, CRM-Systemen, Webanalyse und Marketingautomatisierung. Der KI-Agent der Plattform ermöglicht es Marketern, Fragen in natürlicher Sprache zu stellen und prädiktive Erkenntnisse ohne SQL oder Python zu erhalten.

Die Einrichtung dauert etwa zwei Wochen und ist damit deutlich schneller als bei allgemeinen Data-Science-Plattformen. Vorkonfigurierte Konnektoren verstehen Marketingdatenstrukturen, wodurch der Großteil der Datenaufbereitung entfällt.

Ideal für Marketingteams, die Lead-Scoring, Kampagnen-ROI-Prognosen und Vorhersagen zum Kundenlebenszeitwert benötigen, aber über keine dedizierten Data-Science-Ressourcen verfügen.

Enterprise Data Science Ökosysteme

Databricks bietet eine einheitliche Umgebung für Data Engineering, Data Science und Machine Learning. Teams erstellen Pipelines, die Rohdaten aufnehmen, transformieren, Modelle trainieren und Vorhersagen in der Produktion bereitstellen – alles innerhalb einer einzigen Plattform.

Die Lakehouse-Architektur verarbeitet strukturierte und unstrukturierte Daten im Petabyte-Bereich. Kollaborative Notebooks ermöglichen es Datenwissenschaftlern und Ingenieuren, zusammenzuarbeiten, Modelle zu versionieren und Experimente zu verfolgen.

Am besten geeignet für Organisationen mit ausgereiften Datenteams, die komplexe Anwendungsfälle bearbeiten: Empfehlungssysteme, Betrugserkennung, Optimierung der Lieferkette, vorausschauende Wartung.

Cloud-native ML-Dienste

AWS SageMaker bietet den gesamten Lebenszyklus des maschinellen Lernens als verwaltete Dienste an. Data Scientists bereiten Daten mit integrierten Notebooks auf, trainieren Modelle mithilfe vorkonfigurierter Algorithmen oder benutzerdefiniertem Code und stellen sie auf automatisch skalierenden Endpunkten bereit.

Die Integration mit dem breiteren AWS-Ökosystem – S3, Redshift, Lambda, Step Functions – macht SageMaker zur idealen Wahl für AWS-lastige Technologie-Stacks.

Die Preisgestaltung folgt dem verbrauchsorientierten Modell von AWS: Sie zahlen für Rechenleistung während des Trainings und der Inferenz sowie für Speicherplatz für Modelle und Daten. Die Kosten skalieren mit der Nutzung, sind aber schwer vorherzusagen.

AutoML-Plattformen

H2O.ai automatisiert Feature Engineering, Algorithmenauswahl, Hyperparameter-Optimierung und Modellevaluierung. Business-Analysten laden Daten hoch, geben die Zielvariable an und lassen die Plattform Dutzende von Modellierungsansätzen testen, um den besten zu finden.

Die Software erläutert Vorhersagen anhand von SHAP-Werten und partiellen Abhängigkeitsdiagrammen und zeigt so, welche Merkmale die Ergebnisse beeinflussen. Modelle können als Java-, Python- oder REST-API-Endpunkte für die Produktion exportiert werden.

Eignet sich gut für Teams, die Vorhersagefunktionen benötigen, ohne Data Scientists einzustellen, allerdings sind die Anpassungsmöglichkeiten im Vergleich zu Code-First-Plattformen eingeschränkter.

Anwendungsfälle für prädiktive Analysen nach Branchen

Verschiedene Branchen setzen prädiktive Analysen zur Bewältigung unterschiedlicher Herausforderungen ein, wobei sich die Techniken jedoch häufig überschneiden.

Einzelhandel und E-Commerce

Bedarfsprognosen verhindern Fehlbestände und Überbestände. Modelle analysieren Kaufhistorie, Saisonalität, Werbeaktionen und externe Faktoren wie Wetter oder Konjunkturindikatoren, um die zukünftige Nachfrage nach Artikelnummer und Standort vorherzusagen.

Prognosen zum Kundenlebenszeitwert (Customer Lifetime Value, CLV) helfen Marketingteams bei der Budgetplanung für die Kundengewinnung. Wenn ein Segment einen hohen prognostizierten CLV aufweist, ist es finanziell sinnvoll, mehr Geld für die Kundengewinnung auszugeben.

Mithilfe der Abwanderungsprognose werden gefährdete Kunden identifiziert, bevor sie abwandern, wodurch Kundenbindungsmaßnahmen zum richtigen Zeitpunkt gezielt eingesetzt werden können.

Finanzdienstleistungen

Kreditrisikomodelle bewerten die Wahrscheinlichkeit eines Zahlungsausfalls. Diese Prognosen fließen in Kreditentscheidungen, Zinssätze und Kreditlimits ein.

Betrugserkennungssysteme bewerten Transaktionen in Echtzeit und kennzeichnen verdächtige Muster zur Überprüfung. Modelle des maschinellen Lernens passen sich an die sich wandelnden Betrugsmethoden an.

Der algorithmische Handel nutzt Vorhersagemodelle, um Marktchancen zu erkennen und Transaktionen schneller auszuführen, als es menschliches Ermessen zulässt.

Gesundheitswesen

Risikomodelle für Wiedereinweisungen identifizieren Patienten, die nach ihrer Entlassung wahrscheinlich erneut ins Krankenhaus eingeliefert werden müssen. Pflegekoordinatoren können durch zusätzliche Unterstützung kostspielige Wiedereinweisungen verhindern.

Die Prognose des Krankheitsverlaufs hilft Ärzten, den Krankheitsverlauf ihrer Patienten vorherzusehen und die Behandlungspläne proaktiv anzupassen.

ISO/TS 9491-1:2023 und verwandte ISO-Normen über prädiktive Computermodelle in der personalisierten Medizinforschung bieten Richtlinien für die Konstruktion, Überprüfung und Validierung von Computermodellen, die in klinischen Entscheidungsunterstützungssystemen verwendet werden.

Herstellung

Vorausschauende Instandhaltung prognostiziert Geräteausfälle, bevor sie auftreten. Sensoren erfassen Betriebsdaten – Temperatur, Vibration, Druck – und Modelle erkennen Muster, die Ausfällen vorausgehen.

Geplante Wartungsarbeiten während planmäßiger Stillstandszeiten sind wesentlich kostengünstiger als Notfallreparaturen an einer ausgefallenen Produktionslinie.

Qualitätsvorhersagemodelle analysieren Prozessparameter, um Fehlerraten vorherzusagen, sodass die Bediener die Einstellungen anpassen können, bevor Ausschuss entsteht.

Lieferkette und Logistik

Unternehmen wie Estée Lauder und Kellogg's setzen spezialisierte KI-Plattformen für ihre Lieferketten ein. Diese Systeme prognostizieren die Nachfrage für Tausende von Artikeln, optimieren die Lagerbestände und steuern die Lieferrouten effizient.

Die COVID-19-Pandemie setzte viele Organisationen unter Druck, ihre Lieferkettenstrategien zu überdenken, und beschleunigte die Einführung von Predictive Analytics für Szenarioplanung und Risikobewertung.

Wie man das richtige Tool für prädiktive Analysen auswählt

Die Auswahl einer Plattform erfordert die Abstimmung der technischen Möglichkeiten mit den Bedürfnissen des Unternehmens. Beginnen Sie mit der Beantwortung dieser Fragen.

Wie hoch ist das technische Kompetenzniveau Ihres Teams?

Schreiben die Teammitglieder täglich Python- oder R-Code, oder sind sie auf Excel spezialisierte Business-Analysten? Data-Science-Plattformen setzen Programmierkenntnisse voraus. AutoML- und BI-Tools sind hingegen auch für weniger technisch versierte Nutzer geeignet.

Fehlende Übereinstimmung zwischen der Komplexität der Tools und den Fähigkeiten des Teams führt zu gescheiterten Implementierungen. Eine zu technische Plattform bleibt ungenutzt, weil Analysten sie nicht bedienen können. Ein zu simples Tool frustriert Data Scientists, die Anpassungsmöglichkeiten benötigen.

Wie hoch ist Ihr Datenreifegrad?

Sind die Daten in einem Data Warehouse zentralisiert oder über verschiedene Systeme verteilt? Sind die Definitionen einheitlich – hat “Kunde” in CRM-, Abrechnungs- und Supportdatenbanken dieselbe Bedeutung?

Geringe Datenreife bedeutet, dass die Integration Monate dauern kann, bevor überhaupt mit der Prognosearbeit begonnen werden kann. Achten Sie auf Plattformen mit umfassenden Konnektoren und Funktionen zur Datenaufbereitung, um diese Phase zu beschleunigen.

Welche Vorhersagen brauchen Sie tatsächlich?

Allgemeine Ziele wie “Wir wollen KI einsetzen” sind selten erfolgreich. Definieren Sie stattdessen konkrete Prognosen: Umsatzprognose nach Produktlinie, Lead-Konversionswahrscheinlichkeit, Abwanderungsrisiko nach Kundensegment, Bedarf des Folgemonats nach Lager.

Manche Plattformen eignen sich hervorragend für bestimmte Anwendungsfälle. Wenn Ihre Bedürfnisse beispielsweise auf Marketingprognosen ausgerichtet sind, liefert ein spezialisiertes Marketing-Tool wahrscheinlich schnellere Ergebnisse als eine allgemeine Data-Science-Plattform.

Was ist Ihr minimaler, funktionsfähiger Datensatz?

Überprüfen Sie die zuvor beschriebenen Datenanforderungen. Verfügen Sie über genügend historische Daten und Beispiele des angestrebten Ergebnisses, um zuverlässige Modelle zu trainieren?

Falls nicht, sollten Sie zunächst mit deskriptiver Analytik beginnen – Dashboards, die zeigen, was passiert ist – und gleichzeitig weitere Daten für zukünftige Vorhersagearbeiten sammeln.

Cloud, On-Premises oder Hybrid?

Regulatorische, sicherheitsrelevante oder architektonische Vorgaben können die Bereitstellungsoptionen bestimmen. Einige Branchen erfordern eine lokale Bereitstellung. Andere setzen auf die Cloud, um Skalierbarkeit zu gewährleisten und den Betriebsaufwand zu reduzieren.

Prüfen Sie, ob die Plattform Ihr gewünschtes Bereitstellungsmodell unterstützt, bevor Sie in eine Evaluierung investieren.

Wie hoch sind die Gesamtbetriebskosten?

Abonnementgebühren stellen einen Kostenfaktor dar. Berücksichtigen Sie außerdem Implementierungsleistungen, Schulungen, laufende Wartung und Infrastruktur (Rechenleistung, Speicher).

Manche Plattformen berechnen die Kosten pro Nutzer, andere pro Datenvolumen, wieder andere basierend auf dem Rechenverbrauch. Um Überraschungen zu vermeiden, sollten Sie die Preisstruktur an Ihren erwarteten Nutzungsbedarf anpassen.

Erste Schritte mit Predictive Analytics

Selbst die beste Plattform bringt ohne einen soliden Implementierungsansatz keinen Nutzen.

Fangen Sie klein an und beweisen Sie Ihren Wert.

Beginnen Sie nicht mit einer unternehmensweiten Transformation. Wählen Sie stattdessen einen wirkungsvollen, klar definierten Anwendungsfall – beispielsweise Lead-Scoring für das Vertriebsteam, Bedarfsplanung für eine Produktkategorie oder Abwanderungsprognose für ein einzelnes Kundensegment.

Zunächst kleine Transformationsprozesse realisieren, den ROI nachweisen und dann expandieren. Frühe Erfolge schaffen Dynamik im Unternehmen und sichern Budgets für umfassendere Initiativen.

Etablierung einer Daten-Governance

Vorhersagen sind nur so gut wie die Eingangsdaten. Definieren Sie Datenqualitätsstandards, Verantwortlichkeiten und Prozesse zur Problembehebung.

Wer korrigiert fehlerhafte Kundendatensätze? Wie schnell werden CRM-Aktualisierungen in der Datenquelle des Vorhersagemodells abgebildet? Unklare Antworten führen mit der Zeit zu einer Verschlechterung der Modellleistung.

Funktionsübergreifende Teams bilden

Predictive-Analytics-Projekte erfordern Branchenexpertise, Datenkompetenz und operative Integration. Ein Data Scientist allein kann dies nicht leisten – er benötigt die Partnerschaft mit Geschäftsinhabern, die den Kontext verstehen, und mit Endnutzern, die auf Basis der Vorhersagen handeln.

Regelmäßige Zusammenarbeit stellt sicher, dass Modelle reale Probleme lösen und nicht nur interessante, aber irrelevante technische Herausforderungen.

Modelle überwachen und neu trainieren

Die Genauigkeit der Modelle nimmt mit veränderten Bedingungen ab. Das Kundenverhalten ändert sich, die Marktdynamik entwickelt sich weiter, Wettbewerber treten auf oder scheiden aus, Pandemien brechen aus.

Die automatisierte Überwachung verfolgt die Vorhersagegenauigkeit und alarmiert Teams, wenn die Leistung unter bestimmte Schwellenwerte fällt. Ein erneutes Training mit aktuellen Daten stellt die Leistung wieder her – jedoch nur, wenn das Team über Prozesse verfügt, um auf Warnmeldungen zu reagieren.

Investieren Sie in Change Management

Prognosen sind nur dann wertvoll, wenn Menschen ihre Entscheidungen darauf basieren. Ignorieren Vertriebsmitarbeiter Lead-Scores oder Planer Bedarfsprognosen, bleibt das Modell wirkungslos.

Erläutern Sie, wie Vorhersagen die Ergebnisse verbessern, beziehen Sie die Endnutzer frühzeitig ein und zeigen Sie schnelle Erfolge auf, um Vertrauen in das System aufzubauen.

Entwickeln Sie prädiktive Analysen, die in Ihrem realen Betrieb funktionieren.

Die Wahl einer Software für prädiktive Analysen löst nicht das Hauptproblem – die meisten Tools hängen immer noch davon ab, wie gut sie zu Ihren Daten und Prozessen passen. AI Superior Der Fokus liegt auf dem, was die meisten Plattformen vernachlässigen: der Entwicklung maßgeschneiderter KI-Software, einschließlich prädiktiver Modelle, basierend auf spezifischen Geschäftsproblemen und verfügbaren Daten. Anstatt Ihre Abläufe in ein vorgegebenes Tool zu pressen, wird die Lösung an die tatsächlichen Geschäftsprozesse angepasst.

Verwandeln Sie Vorhersagemodelle in Entscheidungen, die Sie umsetzen können.

AI Superior arbeitet daran, prädiktive Analysen in realen Umgebungen nutzbar zu machen:

- Modelle auf der Grundlage spezifischer betrieblicher oder geschäftlicher Anforderungen definieren und entwickeln

- Daten vor dem Anwenden von maschinellem Lernen vorbereiten und strukturieren.

- Entwickeln Sie Lösungen, die sich in bestehende Systeme einfügen, anstatt sie zu ersetzen.

- Verknüpfen Sie Vorhersagen mit den Punkten, an denen Entscheidungen getroffen werden.

- Überwachen Sie die Ergebnisse und passen Sie die Modelle an, wenn sich Daten und Bedingungen ändern.

Bevor Sie sich für eine andere Plattform entscheiden, Sprechen Sie mit AI Superior und zu verstehen, was nötig ist, damit prädiktive Analysen über das Tool selbst hinaus funktionieren.

Prädiktive vs. deskriptive vs. präskriptive Analytik

Diese drei Analysetypen ergänzen einander und dienen unterschiedlichen Entscheidungsbedürfnissen.

Deskriptive Analysen beantworten die Frage “Was ist passiert?”. Dashboards, Berichte und Visualisierungen fassen die bisherige Performance zusammen. Umsatz des letzten Quartals, Konversionsraten nach Kanal, durchschnittlicher Bestellwert – all das sind deskriptive Daten.

Predictive Analytics beantwortet die Frage “Was wird passieren?”. Modelle prognostizieren zukünftige Ergebnisse auf Basis von Mustern in historischen Daten: Umsatz im nächsten Quartal, welche Leads zu Kunden werden und wann Geräte ausfallen.

Präskriptive Analysen beantworten die Frage “Was sollen wir tun?” Diese Systeme empfehlen konkrete Maßnahmen zur Ergebnisoptimierung. Welcher Preis maximiert den Gewinn? Wie sollten wir Lieferungen routen, um die Kosten zu minimieren? Welche Kunden sollten welches Angebot erhalten?.

Die meisten Organisationen beginnen mit beschreibenden Fähigkeiten, gehen dann zu prädiktiven über und ergänzen diese schließlich mit zunehmender Reife um präskriptive Fähigkeiten.

Häufige Fehler und wie man sie vermeidet

Selbst gut finanzierte Initiativen scheitern, wenn Teams entscheidende Erfolgsfaktoren übersehen.

Einsatz ohne ausreichende Daten

Der häufigste Fehler: Modelle auf zu kleinen Datensätzen erstellen, die keine Generalisierung zulassen. Überprüfen Sie die Mindestdatenanforderungen vor Beginn des Projekts, nicht erst nach monatelanger Investition in ein zum Scheitern verurteiltes Vorhaben.

Modellabweichung ignorieren

Ein im Jahr 2024 trainiertes Modell wird im Jahr 2026 nicht mehr so gut funktionieren, wenn sich die Bedingungen geändert haben. Kundenpräferenzen ändern sich, wirtschaftliche Faktoren schwanken, Wettbewerber passen ihre Strategien an.

Die kontinuierliche Überwachung erkennt Abweichungen frühzeitig. Automatisiertes Nachtrainieren hält die Modelle auf dem neuesten Stand.

Genauigkeit hat Vorrang vor Erklärbarkeit.

Ein neuronales Netzwerk könnte eine um 2% höhere Genauigkeit als die logistische Regression erreichen, aber wenn niemand versteht, warum es bestimmte Vorhersagen trifft, leidet die Akzeptanz.

In regulierten Branchen ist Erklärbarkeit nicht optional, sondern Pflicht. Auch dort, wo sie nicht vorgeschrieben ist, schaffen interpretierbare Modelle schneller Vertrauen.

Die letzte Meile vergessen

Prognosen, die lediglich in einer Datenbank gespeichert sind, bringen keinen Nutzen. Die Integration mit operativen Systemen – CRM, ERP, Marketing-Automatisierung – stellt sicher, dass die richtigen Personen die Prognosen zum Zeitpunkt der Entscheidung einsehen können.

Unterschätzung des Veränderungsmanagements

Die technische Umsetzung stellt die halbe Miete dar. Um Menschen davon zu überzeugen, den Prognosen zu vertrauen und entsprechend zu handeln, bedarf es Kommunikation, Schulung und Geduld.

Binden Sie die Endnutzer frühzeitig ein, zeigen Sie schnell Erfolge auf und begegnen Sie Skepsis mit Beweisen statt mit Ablehnung.

Häufig gestellte Fragen

Worin besteht der Unterschied zwischen Software für prädiktive Analysen und Business-Intelligence-Tools?

Business-Intelligence-Tools konzentrieren sich auf deskriptive Analysen – Dashboards und Berichte, die vergangene Ereignisse darstellen. Predictive-Analytics-Software geht einen Schritt weiter und nutzt statistische Modelle und maschinelles Lernen, um zukünftige Entwicklungen vorherzusagen. Einige moderne BI-Plattformen beinhalten mittlerweile auch prädiktive Funktionen, wodurch die Grenzen zwischen den Kategorien verschwimmen.

Wie viele Daten benötige ich, damit prädiktive Analysen sinnvoll werden?

Die Mindestanforderungen hängen von der Art der Prognose ab. Für Lead-Scoring sind mindestens sechs Monate Datenhistorie und über 500 Konversionen erforderlich. Die Abwanderungsprognose benötigt mindestens zwölf Monate Kundendaten und über 200 Abwanderungsereignisse. Die Bedarfsprognose profitiert von mindestens 24 Monaten, um saisonale Muster zu erfassen. Unterhalb dieser Schwellenwerte neigen die Modelle zu Überanpassung und liefern unzuverlässige Prognosen.

Können auch kleine Unternehmen von prädiktiver Analytik profitieren, oder ist diese nur für Großunternehmen geeignet?

Kleine Unternehmen können profitieren, wenn sie über ausreichend Daten und klare Anwendungsfälle verfügen. AutoML-Plattformen und marketingspezifische Tools senken die Einstiegshürden im Vergleich zu Data-Science-Ökosystemen für Großunternehmen. Konzentrieren Sie sich zunächst auf eine einzelne Prognose – beispielsweise Lead-Scoring, Bestandsplanung oder Kundensegmentierung – anstatt eine umfassende Transformation anzustreben.

Benötige ich ein Data-Science-Team, um Predictive-Analytics-Software zu nutzen?

Nicht unbedingt. AutoML-Plattformen und integrierte BI-Tools mit prädiktiven Funktionen ermöglichen es Business-Analysten, Modelle mithilfe geführter Workflows zu erstellen. Data-Science-Expertise ist jedoch bei komplexen Anwendungsfällen, benutzerdefinierten Algorithmen und der Fehlerbehebung hilfreich, wenn Modelle nicht die erwartete Leistung erbringen. Der erforderliche Kenntnisstand hängt von der Plattformwahl und der Komplexität des Anwendungsfalls ab.

Wie lange dauert die Implementierung von Predictive Analytics?

Die Implementierungszeiten variieren je nach Plattformkomplexität, Dateninfrastruktur und organisatorischer Bereitschaft zwischen zwei Wochen und sechs Monaten. Marketingspezifische Tools mit vorkonfigurierten Konnektoren lassen sich innerhalb von zwei Wochen implementieren. Data-Science-Plattformen für Unternehmen, die mit fragmentierten Daten arbeiten, benötigen unter Umständen drei bis sechs Monate für das erste Produktionsmodell. Der größte Zeitaufwand entfällt auf die Datenaufbereitung, nicht auf das Modelltraining.

Welche Branchen nutzen prädiktive Analysen am häufigsten?

Einzelhandel, Finanzdienstleistungen, Gesundheitswesen, Fertigung und Logistik sind führend bei der Einführung von Predictive Analytics. Der Einzelhandel nutzt diese Technologien zur Bedarfsplanung und zur Ermittlung des Kundenwerts. Finanzdienstleister wenden sie zur Kreditrisikobewertung und Betrugserkennung an. Im Gesundheitswesen werden Patientenwiederaufnahmen und Krankheitsverläufe prognostiziert. Die Fertigung prognostiziert Geräteausfälle. Die Logistik optimiert Routenplanung und Lagerbestände.

Wie messe ich den ROI von Investitionen in prädiktive Analysen?

Definieren Sie Kennzahlen vor der Implementierung. Messen Sie für die Bedarfsplanung die Reduzierung der Lagerhaltungskosten und die Vermeidung von Fehlbeständen. Verfolgen Sie für das Lead-Scoring die Verbesserung der Konversionsrate und die Beschleunigung des Vertriebszyklus. Berechnen Sie für die Abwanderungsprognose die Steigerung der Kundenbindungsrate und die Auswirkungen auf den Kundenwert. Vergleichen Sie die Ergebnisse vor und nach der Implementierung und berücksichtigen Sie dabei nach Möglichkeit weitere Einflussfaktoren.

Schlussfolgerung

Software für prädiktive Analysen wandelt historische Daten in zukunftsweisende Erkenntnisse um und ermöglicht es Unternehmen, Ergebnisse vorherzusehen, anstatt nur darauf zu reagieren. Der Markt bietet Plattformen von codefreien AutoML-Tools bis hin zu umfassenden Machine-Learning-Ökosystemen für Unternehmen – jede Plattform ist auf unterschiedliche Teamkompetenzen und Anwendungsfälle zugeschnitten.

Erfolgreiche Implementierungen beginnen klein, konzentrieren sich auf klar definierte Vorhersagen mit ausreichend historischen Daten und priorisieren die Integration in operative Systeme, in denen Entscheidungen getroffen werden. Modellüberwachung und -nachschulung gewährleisten die Genauigkeit bei sich ändernden Bedingungen.

Die richtige Plattform hängt von der Reife Ihrer Daten, den Fähigkeiten Ihres Teams, den spezifischen Anwendungsfällen und den Bereitstellungsanforderungen ab. Marketingspezifische Tools liefern schnellere Ergebnisse für Marketingprognosen. Einheitliche BI-Plattformen eignen sich für Business-Analysten-Teams. Enterprise-Data-Science-Plattformen bieten maximale Flexibilität für komplexe, umfangreiche Anwendungen.

Beginnen Sie damit, eine besonders wirkungsvolle Prognose zu identifizieren, sicherzustellen, dass Sie über ausreichend Daten verfügen, und eine Plattform auszuwählen, die zu den Kompetenzen Ihres Teams passt. Weisen Sie den Nutzen anhand eines konkreten Anwendungsfalls nach, bevor Sie den Umfang erweitern.

Sind Sie bereit, von reaktivem Reporting zu proaktiver Prognose überzugehen? Ermitteln Sie Ihren minimalen Datensatz, bewerten Sie Plattformen anhand Ihrer spezifischen Anforderungen und beginnen Sie mit einem Pilotprojekt, das messbare Geschäftsauswirkungen aufzeigt.