Kurzzusammenfassung: Die Trends im Bereich Predictive Analytics konzentrieren sich 2026 auf Echtzeitprognosen, KI-gestützte Automatisierung, kausales maschinelles Lernen für Lieferketten und personalisierte Kundenerlebnisse. Der Markt wächst jährlich um 22 bis 281 Tsd. Billionen US-Dollar. Unternehmen nutzen ereignisgesteuerte Architekturen und fortschrittliches maschinelles Lernen, um historische Daten in handlungsrelevante Zukunftserkenntnisse umzuwandeln – insbesondere in den Bereichen Gesundheitswesen, Einzelhandel, Finanzen und Fertigung.

Der Markt für prädiktive Analysen setzt seinen rasanten Wachstumskurs fort. Erwartet wird ein Volumen zwischen 1,4 Billionen und 1,4 Billionen US-Dollar im Jahr 2025, was einer jährlichen Wachstumsrate von 22,1 Billionen bis 28,1 Billionen US-Dollar in den nächsten fünf Jahren entspricht. Dies ist nicht nur ein schrittweiser Fortschritt, sondern ein grundlegender Wandel in der Art und Weise, wie Unternehmen Entscheidungen treffen.

Aber eines ist klar: Predictive Analytics ist nicht mehr das, was es vor zwei Jahren war. Die Techniken, Werkzeuge und Anwendungen haben sich rasant weiterentwickelt. Echtzeit-Datenverarbeitung, kausales maschinelles Lernen und KI-gestützte Automatisierung verändern die Spielregeln grundlegend.

Welche Trends prägen das Feld also im Jahr 2026? Schauen wir uns die wichtigsten Entwicklungen genauer an.

Was prädiktive Analysen im Jahr 2026 tatsächlich sind

Prädiktive Analysen nutzen historische Daten, statistische Methoden und Modelle des maschinellen Lernens, um zukünftige Ergebnisse oder Trends vorherzusagen. Laut Stanford HAI analysieren diese Techniken Muster in historischen Daten, um die Wahrscheinlichkeit von Ereignissen wie Kundenverhalten, Geräteausfällen oder Marktveränderungen abzuschätzen.

Diese Disziplin bewegt sich an der Schnittstelle von Mathematik, Statistik und Informatik. Sie unterscheidet sich grundlegend von deskriptiver Analytik (Was ist passiert?) oder diagnostischer Analytik (Warum ist es passiert?). Prädiktive Analytik beantwortet die Frage: Was wird passieren?

| Analysetyp | Frage beantwortet | Primäre Verwendung |

|---|---|---|

| Beschreibend | Was ist passiert? | Historische Berichterstattung |

| Diagnostik | Warum ist das passiert? | Ursachenanalyse |

| Vorhersage | Was wird geschehen? | Prognose und Wahrscheinlichkeit |

| Vorschreibend | Was sollen wir tun? | Entscheidungsoptimierung |

Der Hauptunterschied zwischen prädiktiver Analytik und maschinellem Lernen liegt in ihrem Umfang und ihrer Anwendung. Prädiktive Analytik konzentriert sich auf die Prognose konkreter Ergebnisse für Geschäftsentscheidungen. Maschinelles Lernen ermöglicht es Systemen, aus Daten zu lernen und ihre Leistung ohne explizite Programmierung zu verbessern.

Allerdings verschwimmt die Grenze. Moderne prädiktive Analyseverfahren nutzen in hohem Maße Techniken des maschinellen Lernens – insbesondere Deep Learning und neuronale Netze.

Kausales maschinelles Lernen transformiert das Lieferkettenmanagement

Einer der bedeutendsten Trends ist der Wandel von korrelationsbasierten Modellen hin zu kausalen Ansätzen. Laut einer im Januar 2026 veröffentlichten Studie des NIST stellt kausales maschinelles Lernen einen empirischen Durchbruch im Supply-Chain-Management dar.

Traditionelle Vorhersagemodelle identifizieren Muster: “Wenn X eintritt, folgt in der Regel Y.” Kausalmodelle gehen tiefer: “X verursacht Y durch Mechanismus Z.” Diese Unterscheidung ist bei Interventionsentscheidungen von enormer Bedeutung.

Insbesondere für Lieferketten hilft kausales maschinelles Lernen bei der Beantwortung von Fragen wie:

- Wird ein Wechsel des Lieferanten A die Verzögerungen tatsächlich verringern, oder ist die Korrelation ein Trugschluss?

- Welchen tatsächlichen Einfluss haben Änderungen der Lagerhaltungspolitik auf die Kundenzufriedenheit?

- Welche Störungen breiten sich tatsächlich kaskadenartig im Netzwerk aus und welche sind isolierte Ereignisse?

Das NIST-Framework zeigt, wie Techniken der Kausalanalyse auf reale Lieferkettendaten angewendet werden können, um über einfache Vorhersagen hinauszugehen und die zugrunde liegenden Mechanismen zu verstehen, die die Ergebnisse beeinflussen.

Und das ist nicht nur Theorie. Hersteller setzen bereits Ursachenmodelle ein, um die Beschaffung zu optimieren, Abfall zu reduzieren und die Widerstandsfähigkeit gegenüber Störungen zu stärken.

Echtzeit-Datenarchitekturen ermöglichen sofortige Prognosen

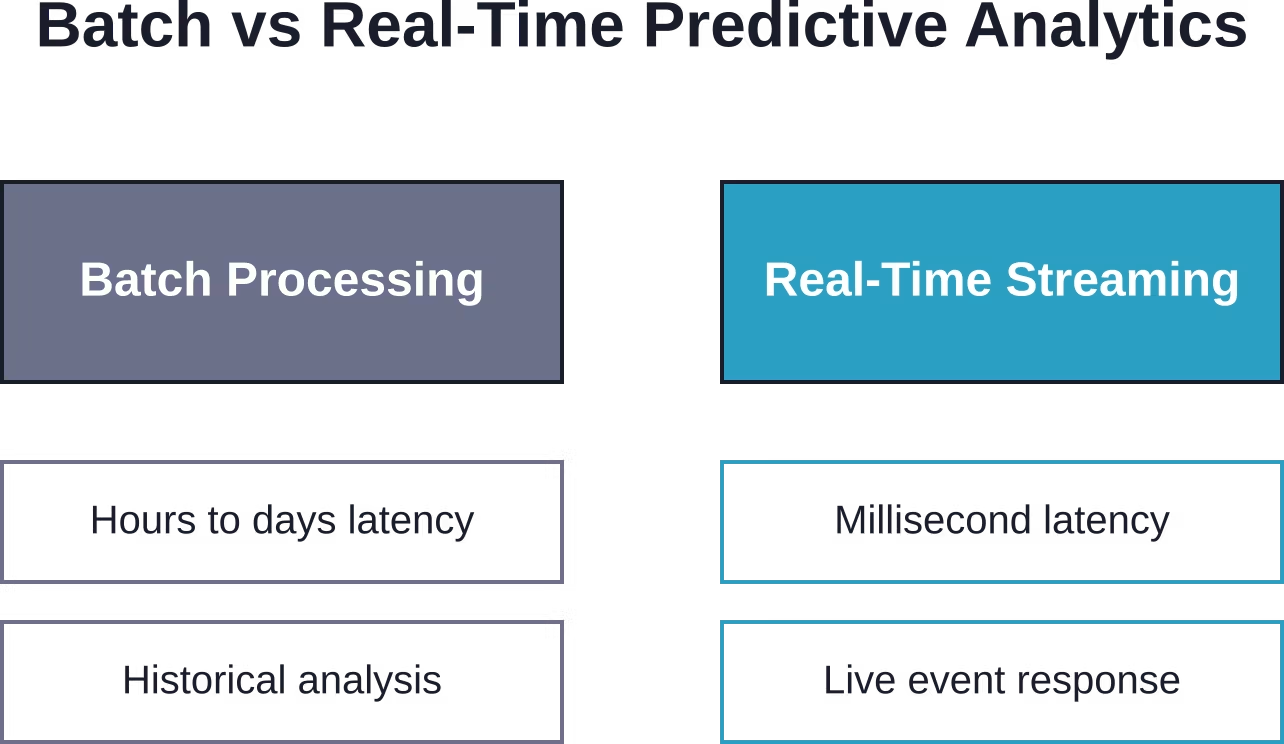

Die Stapelverarbeitung verliert gegenüber Echtzeitanalysen an Bedeutung. Ereignisgesteuerte Architekturen (EDAs) und Daten-in-Motion-Plattformen bilden die Grundlage für prädiktive Systeme, die sofort reagieren müssen.

Das ist aus folgendem Grund wichtig: Traditionelle Vorhersagemodelle arbeiten oft mit Daten, die Stunden oder Tage alt sind. Für Anwendungsfälle wie Betrugserkennung, Geräteüberwachung oder dynamische Preisgestaltung ist diese Verzögerung inakzeptabel.

Echtzeit-Datentechnologien ermöglichen:

- Sofortige Anomalieerkennung in Transaktionsströmen

- Vorhersage von Geräteausfällen im laufenden Betrieb auf Basis von Sensordaten

- Dynamische Personalisierung des Kundenerlebnisses während aktiver Sitzungen

- Sofortige Warnmeldungen zu Lieferkettenrisiken während der Ereignisse

Der Wandel erfordert eine andere technische Infrastruktur – Stream-Processing-Frameworks, Event-Broker und Modelle, die für latenzarmes Scoring optimiert sind. Der Nutzen ist jedoch beträchtlich: Vorhersagen, die im entscheidenden Moment tatsächlich umsetzbar sind.

KI-gestützte Personalisierung erreicht neue Raffinesse

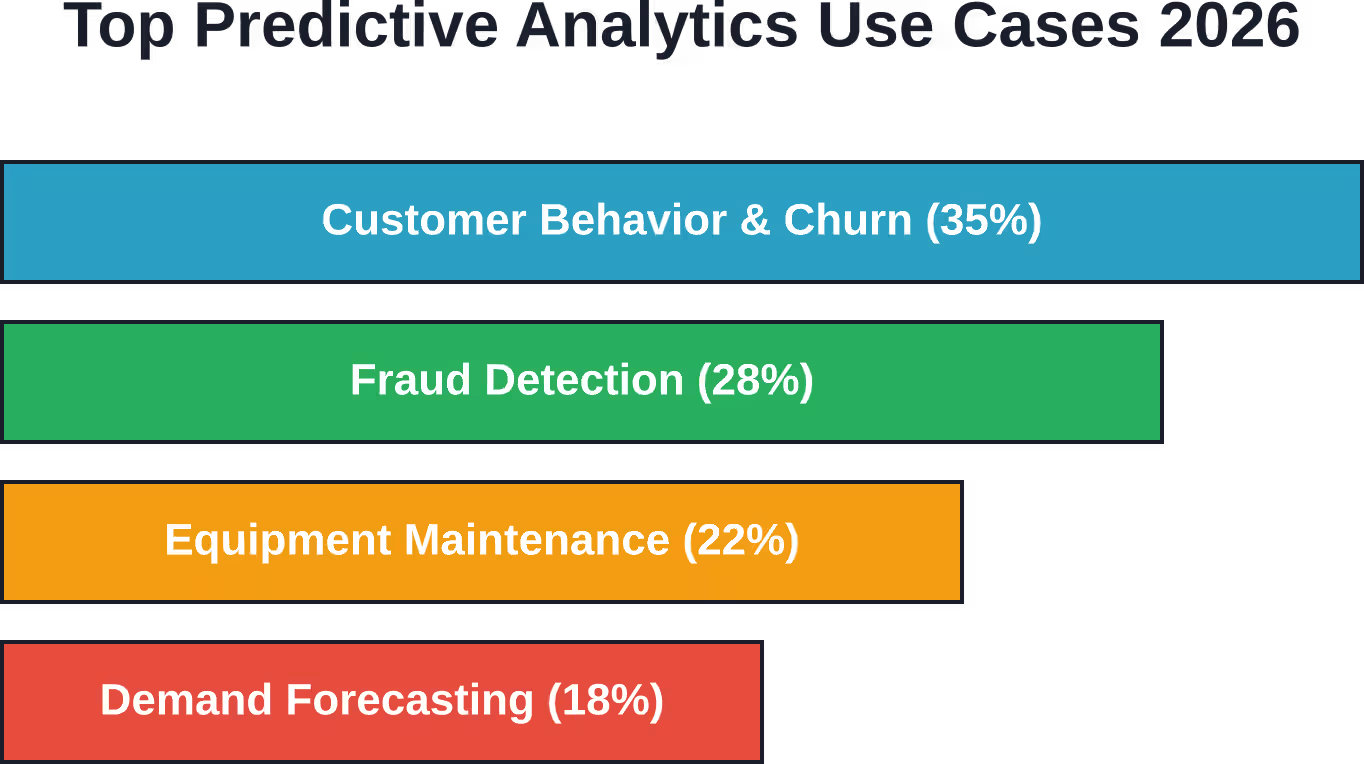

Kundenanalysen waren schon immer ein zentraler Anwendungsfall für prädiktive Analysen. Doch das im Jahr 2026 mögliche Maß an Personalisierung ist bemerkenswert.

Unternehmen, die fortschrittliche prädiktive Kundenanalysen und Personalisierungstechniken einsetzen, berichten von Umsatzsteigerungen. Dies wird durch zahlreiche Branchenanalysen bestätigt und spiegelt die Reife von Empfehlungssystemen, dynamischen Inhaltssystemen und Verhaltensvorhersagemodellen wider.

Große E-Commerce-Unternehmen berichten von deutlichen Verbesserungen bei der Kundenbindung durch prädiktive Analysen. Amazons Größenordnung ist zwar einzigartig, doch die zugrundeliegenden Techniken – kollaboratives Filtern, sequentielles Mustererkennen und Wahrscheinlichkeitsmodellierung – sind zunehmend auch für kleinere Unternehmen zugänglich.

Moderne Kundenanalyseplattformen kombinieren:

- Verhaltenssequenzanalyse zur Vorhersage des nächsten Vorgehens

- Stimmungsanalyse aus Text- und Sprachinteraktionen

- Lebenszeitwertmodellierung zur Priorisierung der Kundenbindung

- Kundenabwanderungsprognose mit Interventionsempfehlungen

Der Übergang von segmentbasierten zu individuellen Prognosen ist nahezu abgeschlossen. Modelle des maschinellen Lernens können nun personalisierte Prognosen für Millionen von Kunden gleichzeitig erstellen – etwas, das vor fünf Jahren noch rechnerisch nicht möglich war.

Kleinere Hersteller erhalten Zugang zu KI durch praktische Tools

Predictive Analytics ist nicht länger ausschließlich Großunternehmen vorbehalten. Laut einer Studie des NIST zu kleineren Herstellern ist künstliche Intelligenz selbst für mittelständische und kleine Produktionsbetriebe zu einem entscheidenden Aspekt der Industrie-4.0-Einführung geworden.

Was hat sich geändert? Vor allem die Verfügbarkeit und die Kosten der Tools. Cloudbasierte Analyseplattformen, vortrainierte Modelle und Low-Code-/No-Code-Schnittstellen haben die Einstiegshürde deutlich gesenkt.

Kleinere Hersteller nutzen prädiktive Analysen für:

- Anlagenwartungsplanung auf Basis von Sensordaten

- Qualitätsvorhersage zur Reduzierung von Fehlern und Abfall

- Bedarfsprognose zur Bestandsoptimierung

- Energieverbrauchsprognose für das Kostenmanagement

Die MEP-Zentren (Manufacturing Extension Partnership) haben eine wichtige Rolle bei der Verbreitung dieser Fähigkeiten gespielt und Herstellern geholfen, Anwendungsfälle zu identifizieren und Lösungen ohne massive Kapitalinvestitionen umzusetzen.

Mal ehrlich: Für prädiktive Analysen in der Fertigung braucht man heutzutage kein Data-Science-Team mehr. Viele Plattformen bieten branchenspezifische Vorlagen und automatisiertes Modelltraining, das Produktionsleiter selbst konfigurieren können.

Erweiterte Möglichkeiten für Gesundheitsdiagnostik und Ressourcenprognose

Das Gesundheitswesen zählt weiterhin zu den wirkungsvollsten Anwendungsbereichen für prädiktive Analysen. Die Einsatzmöglichkeiten reichen von der patientenbezogenen Diagnoseunterstützung bis hin zur systemweiten Ressourcenplanung.

Zu den wichtigsten Anwendungsfällen im Gesundheitswesen im Jahr 2026 gehören:

- Geräteausfallprognose für kritische medizinische Geräte

- Modellierung des Risikos einer Patientenwiederaufnahme

- Prognose des Krankheitsverlaufs bei chronischen Erkrankungen

- Prognose der Krankenhauskapazität und des Personalbedarfs

- Behandlungserfolgswahrscheinlichkeit bei personalisierter Therapie

Die Genauigkeit dieser Modelle verbessert sich kontinuierlich mit der Weiterentwicklung elektronischer Patientenaktensysteme (EHR) und der steigenden Datenqualität. Maschinelle Lernverfahren wie Long Short-Term Memory (LSTM)-Netzwerke eignen sich hervorragend für die Verarbeitung zeitlicher Gesundheitsdaten – sie erfassen, wie sich der Zustand von Patienten im Laufe der Zeit verändert.

Doch es gibt eine Herausforderung: Vorhersagemodelle im Gesundheitswesen müssen nachvollziehbar sein. Neuronale Netze, die ihre Vorhersagen nicht begründen können, stoßen auf regulatorische und ethische Hürden. Dies hat zu bedeutenden Innovationen im Bereich interpretierbarer maschineller Lernverfahren und kausaler Schlussfolgerungen geführt.

Finanzprognosen werden detaillierter

Die Finanzdienstleistungsbranche nutzt prädiktive Analysen schon seit Jahrzehnten – die Kreditwürdigkeitsprüfung ist im Grunde ein Vorhersagemodell. Neu sind die Detailtiefe und die Bandbreite der Anwendungsmöglichkeiten.

Moderne Finanzprognosen nutzen prädiktive Analysen für:

- Betrugserkennung in Echtzeit über alle Transaktionsströme hinweg

- Marktbewegungsprognose für den algorithmischen Handel

- Kreditrisikobewertung mit alternativen Datenquellen

- Cashflow-Prognose für das Treasury-Management

- Kundenlebenszeitwertmodellierung zur Optimierung der Kundengewinnung

Ein bemerkenswerter Trend: die Einbeziehung unstrukturierter Daten wie Nachrichtenstimmung, Social-Media-Signale und Satellitenbilder in Finanzmodelle. Diese alternativen Datenquellen liefern prädiktive Signale, die bei herkömmlichen strukturierten Daten unberücksichtigt bleiben.

WHOOP beispielsweise verbesserte mithilfe von KI und maschinellem Lernen die Finanzprognosen und optimierte gleichzeitig das Kundenerlebnis durch die zentrale Datenzugriffsverwaltung mit modernen Datenplattformen. Diese Kombination – bessere Prognosen und ein besseres Kundenerlebnis – verdeutlicht, wie prädiktive Analysen mittlerweile in alle Geschäftsbereiche integriert sind und nicht mehr nur im Finanzbereich Anwendung finden.

Wichtige prädiktive Analysemodelle und -techniken

Die technischen Grundlagen der prädiktiven Analytik entwickeln sich stetig weiter. Klassische statistische Methoden bleiben zwar relevant, doch maschinelles Lernen dominiert moderne Implementierungen.

Regressionsmodelle

Lineare, logistische und polynomische Regression eignen sich für Vorhersagen sowohl kontinuierlicher als auch kategorialer Daten. Sie sind interpretierbar, schnell zu trainieren und effektiv bei relativ linearen Zusammenhängen. Finanzprognosen und einfache Risikobewertungen basieren häufig auf Regressionsverfahren.

Entscheidungsbäume und Ensemble-Methoden

Random Forests, Gradient Boosting Machines (wie XGBoost und LightGBM) und Ensemble-Verfahren kombinieren mehrere Modelle, um eine höhere Genauigkeit zu erzielen. Sie bewältigen nichtlineare Zusammenhänge, Merkmalsinteraktionen und fehlende Daten problemlos. Ensemble-Methoden werden häufig zur Kundenabwanderungsprognose und zur Kreditwürdigkeitsprüfung eingesetzt.

Neuronale Netze und Deep Learning

Deep Learning eignet sich hervorragend zur Erkennung komplexer Muster, insbesondere bei unstrukturierten Daten wie Bildern, Texten und Zeitreihen. LSTM-Netzwerke, Convolutional Neural Networks (CNNs) und Transformer-Architekturen bilden die Grundlage für fortschrittliche Prognoseanwendungen. Auch in der medizinischen Diagnostik und der Verarbeitung natürlicher Sprache spielt Deep Learning eine wichtige Rolle.

Zeitreihenprognose

ARIMA, Prophet und spezialisierte neuronale Architekturen verarbeiten zeitliche Daten mit Saisonalität und Trends. Bedarfsplanung, Absatzprognosen und Ressourcenplanung basieren auf robusten Zeitreihenverfahren.

Clustering und Klassifizierung

K-Means-Verfahren, hierarchisches Clustering, Support-Vektor-Maschinen und Bayes'sche Klassifikatoren segmentieren Daten und ordnen ihnen Kategorien zu. Diese Verfahren werden zur Kundensegmentierung und Betrugserkennung eingesetzt.

Die Wahl der Methode hängt von den Dateneigenschaften, den Anforderungen an die Interpretierbarkeit, den verfügbaren Rechenressourcen und der jeweiligen Vorhersageaufgabe ab. Viele Produktionssysteme nutzen Ensemble-Ansätze – sie kombinieren mehrere Modelltypen, um deren sich ergänzende Stärken auszunutzen.

Optimierung der Lebensmittelproduktion durch LSTM-Netzwerke

Lebensmittelverschwendung bleibt eine der beständigsten Herausforderungen für die Branche. Fehlprognosen zum Bedarf führen zu Überproduktion, Verderb und Ressourcenfehlverteilung.

Aktuelle Forschungsergebnisse zur prädiktiven Analytik in der Lebensmittelproduktion demonstrierten einen maschinellen Lernansatz unter Verwendung von Long Short-Term Memory-Netzwerken. Das System prognostiziert Lebensmittelmengen und Transaktionen anhand historischer Verkaufsdaten in Kombination mit Merkmalen wie Tag, Monat und artikelspezifischen Attributen.

Das Ergebnis? Eine Genauigkeit von 89,68% bei der Bedarfsprognose. Diese Präzision ermöglicht eine signifikante Abfallreduzierung, ein optimiertes Bestandsmanagement und eine bessere Ressourcenzuweisung – und bringt somit sowohl wirtschaftliche als auch ökologische Vorteile für eine nachhaltige Lebensmittelproduktion.

LSTM-Netzwerke eignen sich besonders gut für diese Anwendung, da sie langfristige Abhängigkeiten in sequenziellen Daten erfassen. Die Nachfrage nach Lebensmitteln weist komplexe Muster auf – wöchentliche Zyklen, monatliche Trends, saisonale Schwankungen, Feiertagseffekte –, die einfachere Modelle nur schwer abbilden können.

Der Ansatz demonstriert, wie spezialisierte neuronale Architekturen branchenspezifische Prognoseherausforderungen lösen können, die zuvor unlösbar waren.

Werkzeuge und Plattformen zur Ermöglichung prädiktiver Analysen

Das Ökosystem der prädiktiven Analytik umfasst eine Reihe von Werkzeugen für verschiedene Anwendungsfälle und technische Kompetenzniveaus.

Cloud-Plattformen wie Snowflake bieten integrierte Data-Warehousing- und Analysefunktionen. Sie zentralisieren den Datenzugriff, reduzieren die Komplexität der Infrastruktur und ermöglichen es Teams, Vorhersagemodelle zu erstellen, ohne Server verwalten zu müssen.

Spezialisierte Plattformen für maschinelles Lernen bieten automatisierte Modelltrainings-, Hyperparameter-Optimierungs- und Bereitstellungspipelines. Dadurch verkürzt sich die Zeit von den Daten bis zum produktionsreifen Modell von Monaten auf Tage.

Open-Source-Frameworks wie scikit-learn, TensorFlow, PyTorch und XGBoost bieten Data Scientists detaillierte Kontrolle und Anpassungsmöglichkeiten. Sie bilden die Grundlage für die Entwicklung kundenspezifischer Modelle, wenn Standardlösungen nicht ausreichen.

Business-Intelligence-Tools integrieren zunehmend direkt Prognosefunktionen. Auch Anwender ohne technische Vorkenntnisse können Prognosen über geführte Schnittstellen erstellen, ohne Code schreiben zu müssen.

Der Trend geht hin zur Demokratisierung: Predictive Analytics soll für mehr Berufsgruppen zugänglich gemacht werden, nicht nur für spezialisierte Data Scientists. Das bedeutet aber nicht, die Inhalte zu vereinfachen, sondern vielmehr, ausgefeilte Techniken durch bessere Abstraktionen und Schnittstellen zu ergänzen.

Herausforderungen und Überlegungen

Prädiktive Analysen sind kein Allheilmittel. Es bestehen weiterhin mehrere Herausforderungen:

Datenqualität und Verfügbarkeit

Modelle sind nur so gut wie ihre Trainingsdaten. Unvollständige, verzerrte oder veraltete Daten führen zu unzuverlässigen Vorhersagen. Datenmanagement und die Qualität der Datenpipeline sind genauso wichtig wie die Wahl des Algorithmus.

Interpretierbarkeit des Modells

Komplexe Modelle wie tiefe neuronale Netze funktionieren oft wie Blackboxes. In regulierten Branchen oder bei weitreichenden Entscheidungen ist Erklärbarkeit unerlässlich. Dies treibt die Forschung im Bereich des interpretierbaren maschinellen Lernens voran.

Überanpassung und Generalisierung

Modelle können Trainingsdaten auswendig lernen, anstatt verallgemeinerbare Muster zu erlernen. Sorgfältige Validierung, Regularisierung und Tests mit separaten Daten sind unerlässlich, um sicherzustellen, dass Modelle auch bei neuen Eingaben gut funktionieren.

Ethische Bedenken und Voreingenommenheit

Vorhersagemodelle können in historischen Daten vorhandene Verzerrungen fortführen oder verstärken. Anwendungen für faire Kreditvergabe, Personalbeschaffung und Gesundheitswesen erfordern sorgfältige Prüfungen auf Verzerrungen und Strategien zur deren Minderung.

Integration und Operationalisierung

Ein Modell zu erstellen ist das eine; es in Produktionssystemen einzusetzen, wo es einen geschäftlichen Mehrwert bietet, ist etwas ganz anderes. MLOps-Praktiken – Versionierung, Überwachung und Retraining – sind entscheidend für nachhaltige prädiktive Analysen.

Organisationen, die mit prädiktiver Analytik erfolgreich sind, nehmen diese Herausforderungen ernst und betrachten sie nicht als Nebensache.

Erste Schritte mit Predictive Analytics

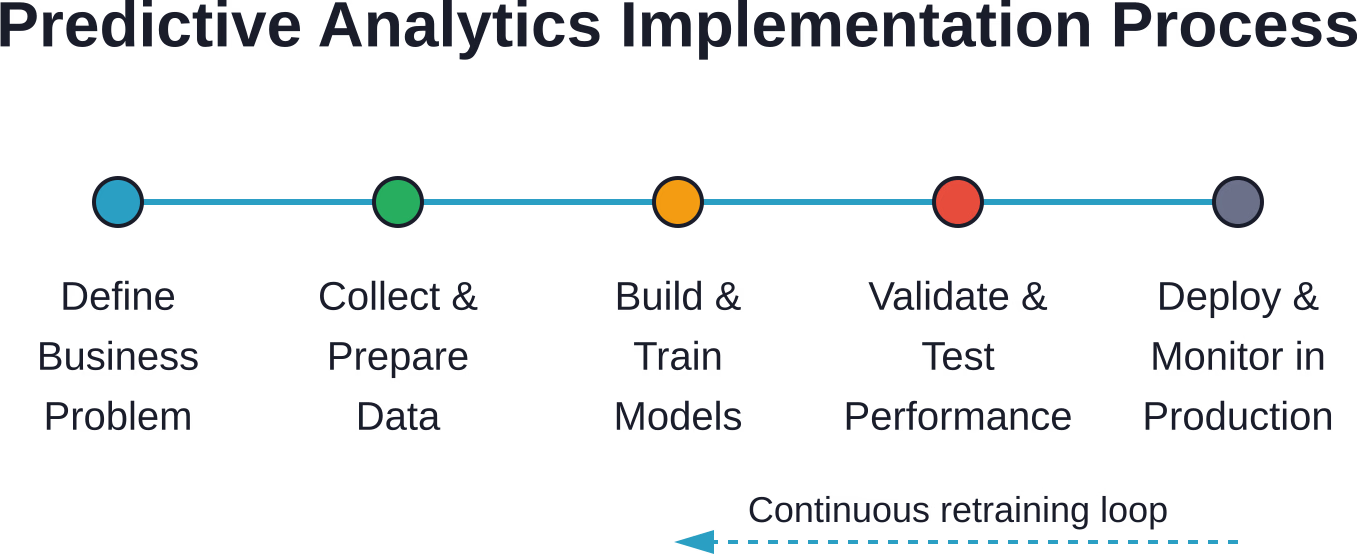

Organisationen, die neu im Bereich der prädiktiven Analytik sind, sollten einen pragmatischen Ansatz verfolgen:

- Beginnen Sie mit einem klar definierten Geschäftsproblem: Entwickeln Sie keine Modelle auf der Suche nach Anwendungsbereichen. Identifizieren Sie eine konkrete Entscheidung, die durch bessere Prognosen optimiert werden könnte – Kundenabwanderung, Lagerbestände, Geräteausfälle.

- Datenbereitschaft beurteilen: Sind ausreichend historische Daten vorhanden? Sind diese sauber und zugänglich? Die Datenaufbereitung beansprucht typischerweise 60 bis 801 Tsd. 30 Projektstunden. Dies zu unterschätzen, ist ein häufiger Fehler.

- Beginnen Sie mit einfachen Ausgangswerten: Lineare Regression oder Entscheidungsbäume bieten oft überraschende Vorteile, bevor man zu komplexen Deep-Learning-Modellen übergeht. Einfache Modelle lassen sich schneller implementieren, sind leichter zu interpretieren und dienen als Leistungsbenchmarks.

- Investieren Sie in Infrastruktur: Für prädiktive Analysen werden Datenpipelines, Modelltrainingsumgebungen und Bereitstellungsplattformen benötigt. Cloudbasierte Lösungen reduzieren die anfänglichen Investitionskosten.

- Bilden Sie funktionsübergreifende Teams: Effektive prädiktive Analysen vereinen Fachwissen, Datenaufbereitung und statistische Modellierung. Niemand verfügt über all diese Fähigkeiten.

- Messen Sie die Auswirkungen auf das Geschäft, nicht nur die Modellgenauigkeit: Ein Modell mit einer Genauigkeit von 95%, das keine Entscheidungsänderungen bewirkt, ist wertlos. Verfolgen Sie, wie sich Vorhersagen auf Handlungen und Ergebnisse auswirken.

Die Eintrittsbarrieren waren noch nie so niedrig. Doch Erfolg erfordert nach wie vor disziplinierte Umsetzung und realistische Erwartungen.

Erstellen Sie Vorhersagemodelle, die tatsächlich mit Ihren Daten funktionieren.

Die meisten Projekte im Bereich der prädiktiven Analytik scheitern, weil die Modelle nicht zu den realen Daten oder Entscheidungsprozessen passen. AI Superior entwickelt maßgeschneiderte Modelle für maschinelles Lernen, die historische und aktuelle Daten nutzen, um Prognosen, Mustererkennung und genauere Entscheidungen zu unterstützen.

Prädiktive Analysen in funktionierende Modelle umwandeln

AI Superior konzentriert sich auf die praktische Umsetzung, nicht auf die Theorie:

- Entwicklung von Modellen auf Basis Ihrer Daten

- Identifizierung von Mustern und Signalen in großen Datensätzen

- Unterstützung datengestützter Entscheidungsprozesse

- Integration in bestehende Systeme

- Validierung durch kleine, testbare Implementierungen

Sprechen Sie mit AI Superior und sehen Sie, wie Ihre Daten in funktionierende Vorhersagemodelle umgewandelt werden können.

Häufig gestellte Fragen

Was ist Predictive Analytics und wie funktioniert es?

Prädiktive Analysen nutzen historische Daten, statistische Algorithmen und maschinelles Lernen, um zukünftige Ergebnisse vorherzusagen. Sie funktionieren, indem sie Muster in vergangenen Daten – wie Kundenkäufen, Messwerten von Gerätesensoren oder Markttrends – identifizieren und diese Muster anwenden, um auf Wahrscheinlichkeiten basierende Vorhersagen über zukünftige Ereignisse zu treffen. Der Prozess umfasst die Datenerfassung, das Training des Modells anhand historischer Beispiele, die Validierung zur Sicherstellung der Genauigkeit und die Anwendung zur Generierung von Prognosen auf Basis neuer Daten.

Welche Branchen profitieren am meisten von prädiktiver Analytik?

Das Gesundheitswesen, der Finanzsektor, der Einzelhandel, die Fertigungsindustrie und die Telekommunikation profitieren erheblich von prädiktiver Analytik. Im Gesundheitswesen wird sie für die Patientendiagnose und Ressourcenplanung eingesetzt. Finanzdienstleister nutzen sie zur Betrugserkennung und Kreditrisikobewertung. Einzelhändler setzen auf die Vorhersage des Kundenverhaltens und die Bedarfsplanung. Hersteller prognostizieren Geräteausfälle und optimieren die Produktion. Jede Branche mit umfangreichen historischen Daten und Entscheidungen, die von zukünftigen Unsicherheiten beeinflusst werden, kann davon profitieren.

Worin unterscheidet sich Predictive Analytics von maschinellem Lernen?

Predictive Analytics ist eine Anwendung, die sich auf die Prognose spezifischer Geschäftsergebnisse mithilfe von Daten konzentriert. Maschinelles Lernen umfasst Techniken, die es Systemen ermöglichen, Muster aus Daten ohne explizite Programmierung zu erkennen. Predictive Analytics nutzt häufig Methoden des maschinellen Lernens, aber nicht jedes maschinelle Lernen ist prädiktiv (manche sind deskriptiv oder präskriptiv). Der entscheidende Unterschied: Predictive Analytics beschreibt, was erreicht werden soll (die Zukunft vorhersagen), während maschinelles Lernen beschreibt, wie dies erreicht wird (algorithmisches Musterlernen).

Ab welcher Unternehmensgröße sind prädiktive Analysefähigkeiten erforderlich?

Organisationen jeder Größe können davon profitieren, auch wenn die Anwendungsbereiche variieren. Große Unternehmen nutzen Predictive Analytics für komplexe, multivariate Prognosen ihrer globalen Geschäftstätigkeit. Mittelständische Unternehmen wenden sie auf spezifische Anwendungsfälle wie Kundenabwanderung oder Bestandsoptimierung an. Selbst kleine Hersteller haben heute über kostengünstige Cloud-Plattformen und branchenspezifische Tools Zugriff auf vorausschauende Wartung. Die Frage ist nicht die Unternehmensgröße, sondern ob bessere Prognosen konkrete Entscheidungen so weit verbessern, dass sich die Investition lohnt.

Was sind die größten Herausforderungen bei der Implementierung von Predictive Analytics?

Datenqualität und -verfügbarkeit stehen an erster Stelle – Modelle benötigen umfangreiche, saubere historische Daten. Die Integration in bestehende Geschäftsprozesse ist anspruchsvoll; Prognosen müssen in Entscheidungsprozesse einfließen, um Mehrwert zu schaffen. Es bestehen weiterhin Qualifikationslücken; vielen Organisationen fehlt es an Data-Science-Expertise. Die Interpretierbarkeit der Modelle ist für regulierte Branchen, die Prognosen erläutern müssen, von Bedeutung. Schließlich ist ein realistisches Erwartungsmanagement entscheidend – prädiktive Analysen verbessern die Entscheidungsfindung probabilistisch, beseitigen aber nicht die Unsicherheit.

Wie genau sind prädiktive Analysemodelle?

Die Genauigkeit variiert stark je nach Anwendungsbereich, Datenqualität und Prognosehorizont. Kurzfristige Prognosen mit stabilen Mustern (wie die Nachfrage nach etablierten Produkten in der nächsten Woche) können eine Genauigkeit von über 90% erreichen. Langfristige Prognosen in volatilen Bereichen (wie Aktienmarktbewegungen) sind deutlich unzuverlässiger. Die Prognose der Lebensmittelproduktion hat mithilfe von LSTM-Netzwerken eine Genauigkeit von nahezu 90% erzielt. Modelle zur Kundenabwanderung erreichen typischerweise eine Genauigkeit zwischen 70 und 85%. Entscheidend ist, die Modellleistung mit Basismethoden (wie naiver Prognose oder menschlicher Einschätzung) zu vergleichen, anstatt Perfektion zu erwarten.

Worin besteht der Unterschied zwischen prädiktiver und präskriptiver Analytik?

Prädiktive Analysen prognostizieren zukünftige Ereignisse – sie schätzen Wahrscheinlichkeiten und wahrscheinliche Ergebnisse. Präskriptive Analysen gehen noch einen Schritt weiter und geben Handlungsempfehlungen, welche Maßnahmen als Reaktion auf diese Prognosen ergriffen werden sollten. Eine prädiktive Analyse könnte beispielsweise sagen: “Dieser Kunde hat eine Abwanderungswahrscheinlichkeit von 751 TP3T.” Eine präskriptive Analyse würde hinzufügen: “Bieten Sie einen Rabatt von 151 TP3T an, um den Kundenbindungswert zu maximieren.” Präskriptive Analysen kombinieren typischerweise prädiktive Modelle mit Optimierungsalgorithmen und Geschäftsregeln, um konkrete Handlungsempfehlungen und nicht nur Prognosen zu generieren.

Die Zukunft der prädiktiven Analytik

Mit Blick auf die Zukunft werden mehrere Trends die prädiktive Analytik über das Jahr 2026 hinaus prägen.

Automatisiertes maschinelles Lernen (AutoML) wird die technischen Hürden weiter senken und es Business-Analysten ermöglichen, komplexe Modelle ohne Programmierung zu erstellen. Menschliches Fachwissen bleibt jedoch entscheidend für die Problemdefinition, die Dateninterpretation und die Erkennung von Verzerrungen.

Techniken zur Kausalanalyse werden zunehmend korrelationsbasierte Vorhersagen ergänzen und Organisationen dabei helfen, nicht nur zu verstehen, was passieren wird, sondern auch warum – und welche Maßnahmen die Ergebnisse tatsächlich verändern werden.

Edge Computing wird prädiktive Modelle näher an die Datenquellen bringen. Fertigungssensoren, IoT-Geräte und mobile Anwendungen werden lokale Vorhersagemodelle ausführen, anstatt alle Daten an zentrale Cloud-Systeme zu senden.

Ethische KI und verantwortungsvolle Prognosen werden an Bedeutung gewinnen. Da Vorhersagemodelle immer mehr weitreichende Entscheidungen beeinflussen, werden Rahmenbedingungen für Fairness, Transparenz und Verantwortlichkeit zum Standard gehören und nicht länger nur eine nachträgliche Überlegung darstellen.

Die Integration unstrukturierter Daten – Text, Bilder, Videos, Audio – in Prognosemodelle wird sich intensivieren. Multimodale Modelle, die traditionelle strukturierte Daten mit natürlichsprachlichen und visuellen Eingaben kombinieren, werden neue Vorhersagemöglichkeiten eröffnen.

Echtzeitprognosen werden zur Grundvoraussetzung. Batch-Prognosen werden zwar nicht verschwinden, aber Anwendungen, die sofortige Reaktionen erfordern, werden architektonische Innovationen in den Bereichen Streaming-Analytics und latenzarmes Modell-Serving vorantreiben.

Die Organisationen, die mit Predictive Analytics erfolgreich sein werden, sind diejenigen, die es nicht als Technologieprojekt, sondern als Entscheidungsfindungskompetenz betrachten – eine Kompetenz, die kontinuierliche Investitionen in Dateninfrastruktur, Talente und Prozessintegration erfordert.

Sind Sie bereit, Predictive Analytics in Ihrem Unternehmen einzuführen? Beginnen Sie mit der Identifizierung einer wichtigen Entscheidung, die durch bessere Prognosen optimiert werden kann. Prüfen Sie Ihre Datenverfügbarkeit. Stellen Sie ein interdisziplinäres Team zusammen. Und wählen Sie Tools, die Ihren technischen Möglichkeiten und Geschäftsanforderungen entsprechen. Die Technologie war noch nie so zugänglich – der entscheidende Faktor ist die konsequente Umsetzung.