Kurzzusammenfassung: Prädiktive Analysen in klinischen Studien nutzen statistische Modellierung, maschinelles Lernen und historische Daten, um Patientenergebnisse vorherzusagen, das Studiendesign zu optimieren und die Rekrutierungseffizienz zu steigern. Die FDA-Leitlinien unterstützen nun KI-gestützte prädiktive Modelle für regulatorische Entscheidungen. Validierungsrahmen gewährleisten die Modellgenauigkeit anhand von Kennzahlen wie Kalibrierungssteigung und Brier-Score. Organisationen, die diese Tools einsetzen, berichten von kürzeren Studienzeiten, besserer Patientenstratifizierung und reduzierten Entwicklungskosten.

Klinische Studien gelten seit Langem als die teuerste und zeitaufwändigste Phase der Arzneimittelentwicklung. Traditionelle Ansätze stützen sich stark auf retrospektive Analysen und fundierte Annahmen über Patientenreaktionen, die Durchführbarkeit des Studienprotokolls und die Rekrutierungszeiträume.

Aber das ändert sich schnell.

Prädiktive Analysen nutzen heute statistische Verfahren und Algorithmen des maschinellen Lernens für aktuelle und historische Studiendaten und ermöglichen es Forschern, Ergebnisse vorherzusagen, bevor sie eintreten. Die FDA hat diesen Wandel erkannt und offizielle Leitlinien für den Einsatz künstlicher Intelligenz im gesamten Arzneimittelentwicklungsprozess und im Design klinischer Studien herausgegeben.

Die Pharmaindustrie setzt zunehmend auf datenbasierte Ansätze – von der Identifizierung neuer Wirkstoffziele bis hin zur Prognose von Zeitplänen für klinische Studien. Fakt ist: Unternehmen, die prädiktive Analysen beherrschen, verzeichnen messbare Verbesserungen bei den Erfolgsraten klinischer Studien, der Rekrutierungsgeschwindigkeit und der Gesamteffizienz.

Was prädiktive Analysen tatsächlich für klinische Studien bedeuten

Prädiktive Analysen wenden statistische und Modellierungstechniken auf aktuelle und historische Daten an und ermöglichen so die Vorhersage zukünftiger Ereignisse mit quantifizierbaren Konfidenzniveaus. Im Kontext klinischer Studien bedeutet dies die Prognose von Patientenrekrutierungsraten, die Vorhersage von Abbruchrisiken, die Identifizierung wahrscheinlicher Therapieansprecher und die Abschätzung der Durchführbarkeit von Studienprotokollen, bevor Millionenbeträge in die Durchführung investiert werden.

Laut FDA-Richtlinien bezeichnet künstliche Intelligenz maschinenbasierte Systeme, die Vorhersagen treffen, Empfehlungen aussprechen oder Entscheidungen fällen können, die reale oder virtuelle Umgebungen beeinflussen. Diese Systeme erfassen Umgebungen anhand verschiedener Eingaben, abstrahieren diese Erfassungen durch automatisierte Analysen zu Modellen und nutzen Modellinferenz, um handlungsrelevante Optionen zu formulieren.

Der Technologie-Stack wird heute von Large Medical Models (LMMs) und multimodalen Basismodellen dominiert, die mit traditionellem ML zur Generierung klinischer Evidenz integriert sind.

Die Komponenten, die es zum Funktionieren bringen

Klinische Vorhersagemodelle folgen einem strukturierten Entwicklungsprozess. Die in medizinischen Fachzeitschriften veröffentlichte Forschung beschreibt sieben entscheidende Schritte: Bestimmung des Vorhersageproblems und Definition von Prädiktoren und Ergebnissen, angemessene Kodierung der Prädiktoren, Spezifizierung einer Modellarchitektur, Schätzung der Modellparameter, Bewertung der Modellleistung, Validierung anhand externer Datensätze und Präsentation des Modells in einem klinisch nutzbaren Format.

Die aktuellen Validierungsrahmen für 2026, einschließlich der aktualisierten TRIPOD+AI-Erklärung, priorisieren den Kalibrierungs-Achsenabschnitt/die Kalibrierungs-Steigung und die Entscheidungskurvenanalyse (DCA) gegenüber starren R²-Unterschieden und erfordern Schrumpfungsfaktoren, die auf die spezifischen klinischen Auswirkungen zugeschnitten sind.

Nutzen Sie prädiktive Analysen in klinischen Studien mit überlegener KI.

AI Superior Arbeitet mit strukturierten und unstrukturierten Daten, um Vorhersagemodelle zu erstellen, die die Planung, Überwachung und Analyse von Studien unterstützen.

Der Fokus liegt auf Modellen, die sich in regulierte Arbeitsabläufe einfügen und komplexe Datensätze verarbeiten können, wie sie in klinischen Umgebungen verwendet werden.

Sie möchten prädiktive Analysen in klinischen Studien anwenden?

AI Superior kann Ihnen helfen bei:

- Auswertung klinischer und Forschungsdaten

- Erstellung von Vorhersagemodellen

- Integration von Modellen in bestehende Systeme

- Verfeinerung der Ergebnisse basierend auf der Nutzung

👉 Kontaktieren Sie AI Superior um Ihr Projekt, Ihre Daten und Ihren Implementierungsansatz zu besprechen

Wo prädiktive Analysen die größte Wirkung erzielen

Die Anwendungsbereiche umfassen den gesamten Lebenszyklus klinischer Studien. Hier erzielen Organisationen die deutlichsten Erfolge.

Patientenrekrutierung und Standortauswahl

Die Suche nach geeigneten Patienten stellt nach wie vor eine der größten Herausforderungen in der klinischen Forschung dar. Prädiktive Modelle analysieren elektronische Patientenakten, Abrechnungsdaten und Registerinformationen, um Patientengruppen zu identifizieren, die den Einschlusskriterien entsprechen. Noch wichtiger ist, dass diese Modelle auf Grundlage bisheriger Ergebnisse, Patientendemografie und der lokalen Krankheitsprävalenz prognostizieren, welche Studienzentren am schnellsten Patienten rekrutieren werden.

Der Unterschied zwischen einer gut zielgerichteten und einer schlecht geplanten Rekrutierungsstrategie kann monatelange Verzögerungen im Zeitplan und Hunderttausende an verschwendeten Screening-Kosten bedeuten.

Protokolloptimierung und Machbarkeitsbewertung

Bevor ein Studienprotokoll endgültig festgelegt wird, können prädiktive Analysen Tausende von Studienszenarien simulieren und dabei verschiedene Einschlusskriterien, Besuchspläne, Endpunktauswahlen und erforderliche Stichprobengrößen testen. Dieser rechnergestützte Ansatz deckt Designfehler auf, die sonst erst Monate nach Studienbeginn zutage treten würden.

Die Forschung zu Prognosemodellen für Multiple Sklerose hat gezeigt, dass viele veröffentlichte Modelle Prädiktoren enthalten, die in der Primärversorgung kaum messbar sind, was ihren praktischen Nutzen stark einschränkt. Eine Machbarkeitsstudie deckt diese Implementierungslücken frühzeitig auf.

Vorläufige Entscheidungsfindung und adaptive Designs

Validierungsanalysen auf Basis abgeschlossener Studien und realer Daten unterstützen nun die Auswahl von Vorhersagemodellen und Regeln für Zwischenanalysen in zukünftigen Studien. Die FDA hat diesen Antrag zur Kenntnis genommen und festgestellt, dass KI und maschinelles Lernen in der klinischen Forschung zunehmend an Bedeutung gewinnen und die Studienlandschaft verändern.

Adaptive Studiendesigns nutzen die gesammelten Daten, um Aspekte wie Stichprobengröße, Behandlungsgruppen oder Patientenpopulationen während der laufenden Studie anzupassen. Prädiktive Analysen unterstützen diese Entscheidungen und gewährleisten, dass die Anpassungen die Effizienz steigern, ohne die statistische Aussagekraft zu beeinträchtigen.

Sicherheitsüberwachung und Vorhersage unerwünschter Ereignisse

Maschinelle Lernmodelle, die anhand historischer Sicherheitsdatenbanken trainiert wurden, können Patienten mit erhöhtem Risiko für bestimmte unerwünschte Ereignisse identifizieren, bevor diese auftreten. Dies ermöglicht proaktive Überwachungsprotokolle, eine umfassendere Aufklärung der Patienten und ein frühzeitiges Eingreifen bei ersten Warnzeichen.

Die Kalibrierung dieser Sicherheitsmodelle ist von enormer Bedeutung. Schlecht kalibrierte Vorhersagen führen entweder zu einer Überforderung durch Fehlalarme oder zu übersehenden Signalen durch Fehlalarme.

Validierungsstandards und regulatorische Überlegungen

Die FDA-Leitlinie von 2024 zur Nutzung künstlicher Intelligenz zur Unterstützung regulatorischer Entscheidungen für Arzneimittel und Biologika formuliert klare Erwartungen. Sponsoren müssen nachweisen, dass die Vorhersagemodelle für ihren vorgesehenen Zweck geeignet, ordnungsgemäß validiert und transparent dokumentiert sind.

Die Leistungsfähigkeit eines Modells hängt nicht nur von der Genauigkeit ab. Die Kalibrierung spielt im klinischen Kontext eine entscheidende Rolle. Die Vorhersagen eines gut kalibrierten Modells stimmen über das gesamte Wahrscheinlichkeitsspektrum mit den beobachteten Ergebnissen überein. Schlecht kalibrierte Modelle weisen zwar möglicherweise eine hohe Diskriminierungsfähigkeit auf (sie können Ereignisse von Nicht-Ereignissen unterscheiden), überschätzen oder unterschätzen aber systematisch das absolute Risiko.

Die Kalibrierungsbewertung beinhaltet typischerweise das Anpassen einer Kalibrierungsgeraden an Beobachtungen im Vergleich zu Vorhersagen und die Zusammenfassung der Leistungsfähigkeit mit zwei Kennzahlen: Achsenabschnitt und Steigung. Alternativ können glatte Kalibrierungskurven die lokale Kalibrierung über verschiedene Risikogruppen hinweg bewerten.

Anforderungen an die externe Validierung

Eine interne Validierung anhand des Entwicklungsdatensatzes reicht nicht aus. Vorhersagemodelle müssen ihre Übertragbarkeit auf neue Populationen, andere Gesundheitseinrichtungen oder zukünftige Zeiträume nachweisen. Die externe Validierung zeigt, ob ein mit Daten eines akademischen medizinischen Zentrums trainiertes Modell auch in regionalen Krankenhäusern präzise Ergebnisse liefert oder ob geografische Unterschiede im Krankheitsbild die Leistungsfähigkeit beeinflussen.

Veröffentlichte Modelle zur Vorhersage des kardiovaskulären Risikos weisen eine hohe Diskriminierungsfähigkeit auf; gut validierte Modelle erreichen über verschiedene Modellierungsstrategien hinweg C-Index-Werte im Bereich von 0,84–0,87. Die Konsistenz der Ansätze schafft Vertrauen, doch die geringe Variabilität zwischen den Subgruppen unterstreicht die Bedeutung einer umfassenden Validierung.

Auch der Kontext ist wichtig. Ein Lungenkrebs-Vorhersagemodell, das in einer thoraxchirurgischen Klinik mit hoher Krebsprävalenz validiert wurde, liefert möglicherweise in einer allgemeinen ambulanten Einrichtung mit geringerer Krankheitsprävalenz nicht die gleichen Ergebnisse. Die Krankheitsprävalenz beeinflusst die positiven und negativen Vorhersagewerte, selbst wenn Sensitivität und Spezifität konstant bleiben.

| Validierungsmetrik | Zielschwelle | Klinische Bedeutung |

|---|---|---|

| Globaler Schrumpfungsfaktor | ≥0,9 | Minimaler Optimismus hinsichtlich der Vorhersageeffekte |

| R²-Differenz (kontinuierlich) | ≤0,05 | Stabile erklärte Varianz |

| R²-Differenz (Binär) | ≤0,05 | Konstante Klassifizierungsleistung |

| Brier-Score (Binär) | 0–0,25 | 0 = perfekt, 0,25 = nicht aussagekräftig |

| Restliche Standardabweichungsmarge | ≤10% | Präzise Schätzung der Variabilität |

Implementierungsherausforderungen, die wirklich zählen

Theorie ist das eine. Umsetzung das andere.

Datenqualität und Integrationsbarrieren

Vorhersagemodelle sind nur so gut wie ihre Trainingsdaten. Datenbanken klinischer Studien weisen häufig fehlende Werte, inkonsistente Kodierung, Selektionsverzerrungen und eine geringe Diversität auf. Elektronische Patientenakten bringen eigene Probleme mit sich: Dokumentationsvariabilität, Ungenauigkeiten bei den Abrechnungscodes und strukturelle Unterschiede zwischen den Systemen.

Die Integration von Daten aus verschiedenen Quellen erfordert umfangreiche Bereinigung, Standardisierung und Validierung. Das ist zwar keine glamouröse Arbeit, aber sie entscheidet darüber, ob sich Vorhersagen verallgemeinern lassen oder ob sie in der komplexen Realität kläglich scheitern.

Abwägung zwischen Modellinterpretierbarkeit und Leistung

Komplexe Architekturen des maschinellen Lernens übertreffen einfachere statistische Modelle oft hinsichtlich der Vorhersagegenauigkeit. Dieser Leistungsvorteil geht jedoch auf Kosten der Interpretierbarkeit. Aufsichtsbehörden und Ethikkommissionen möchten verstehen, warum ein Modell bestimmte Vorhersagen trifft, insbesondere wenn diese Vorhersagen Entscheidungen zur Patientensicherheit beeinflussen.

Lineare Modelle und Entscheidungsbäume bieten Transparenz. Tiefe neuronale Netze hingegen sind intransparent. Die optimale Wahl hängt von der jeweiligen Anwendung, den regulatorischen Anforderungen und den verfügbaren Validierungsressourcen ab.

Überlegungen zu Gerechtigkeit und Voreingenommenheit

Prädiktive Modelle können bestehende Ungleichheiten im Gesundheitswesen verfestigen oder verstärken, wenn bestimmte Bevölkerungsgruppen in den Trainingsdaten unterrepräsentiert sind oder wenn Prädiktorvariablen mit geschützten Merkmalen korrelieren. Bei der Implementierung müssen daher von Beginn an bis zum Einsatz Aspekte der Chancengleichheit berücksichtigt und die Modellleistung regelmäßig in verschiedenen demografischen Untergruppen überprüft werden.

Die FDA-Leitlinien gehen explizit auf diese Bedenken ein und empfehlen Sponsoren zu prüfen, ob KI-Systeme in relevanten Patientensubpopulationen und klinischen Kontexten konsistent funktionieren.

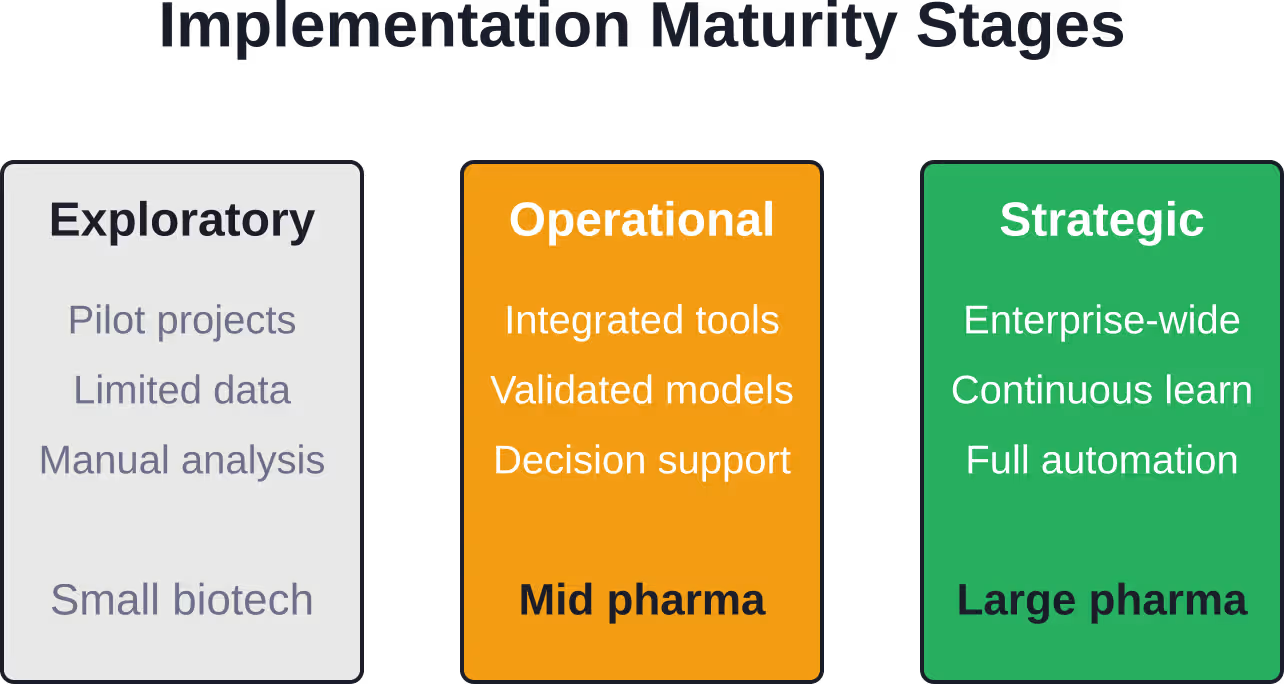

Der aktuelle Stand der Adoption

Pharmaunternehmen und Auftragsforschungsinstitute haben die Pilotprojekte hinter sich gelassen. Predictive Analytics beeinflusst nun tatsächliche klinische Entscheidungen, wobei Unternehmen eigene Data-Science-Teams aufbauen und in die Analyseinfrastruktur investieren.

Die Akzeptanz ist jedoch weiterhin uneinheitlich. Große Pharmaunternehmen mit umfangreichen historischen Studiendatenbanken und Kompetenzen im Bereich Data Science sind führend. Kleinere Biotech-Unternehmen und akademische Forschungszentren stehen vor deutlich höheren Ressourcenbarrieren.

Der Technologie-Stack entwickelt sich weiterhin rasant. Cloudbasierte Analyseplattformen, föderierte Lernverfahren, die den Datenschutz gewährleisten, und vortrainierte Basismodelle, die für klinische Anwendungen angepasst sind, gewinnen zunehmend an Bedeutung.

Praktische Schritte für den Einstieg

Organisationen, die neu im Bereich Predictive Analytics sind, müssen nicht alles von Grund auf neu entwickeln. Beginnen Sie mit klar definierten, wirkungsvollen Anwendungsfällen, bei denen eine hohe Datenverfügbarkeit und eine eindeutige Validierungsmöglichkeit bestehen.

- Die Optimierung der Patientenrekrutierung stellt einen leicht zugänglichen Ansatzpunkt dar. Historische Einschreibungsdaten, Kennzahlen zur Standortleistung und Screening-Fehlerraten liefern reichhaltige Trainingsdatensätze für relativ einfache Vorhersagemodelle.

- Im nächsten Schritt erfolgt die Bewertung der Machbarkeit des Protokolls. Die Analyse vergangener Protokolle im Vergleich zu den tatsächlichen Rekrutierungszeitplänen deckt Muster auf, die zukünftige Designentscheidungen beeinflussen. Hierfür sind keine komplexen Algorithmen erforderlich – selbst einfache Regressionsmodelle liefern bei systematischer Anwendung wertvolle Ergebnisse.

- Der Aufbau interner Kompetenzen ist wichtiger als der Kauf von Software. Schulen Sie Ihre Teams im klinischen Bereich darin, Modellergebnisse zu interpretieren, Annahmen zu hinterfragen und Vorhersagen in Ihre Entscheidungsprozesse zu integrieren. Selbst das beste Vorhersagemodell ist nutzlos, wenn die Beteiligten ihm nicht vertrauen oder nicht verstehen, wie sie auf Basis seiner Erkenntnisse handeln sollen.

- Partnerschaften mit akademischen medizinischen Zentren, Auftragsforschungsinstituten mit Analysekapazitäten oder Technologieanbietern können den Lernprozess beschleunigen. Die Kontrolle über die Kernkompetenzen muss jedoch unbedingt erhalten bleiben. Prädiktive Analysen werden zunehmend den Unterschied zwischen erfolgreichen und weniger erfolgreichen Arzneimittelentwicklungsunternehmen ausmachen.

Ich freue mich auf

Die Entwicklung ist eindeutig. Die regulatorische Akzeptanz KI-gestützter Entscheidungsunterstützung wächst stetig. Die Datenverfügbarkeit nimmt kontinuierlich zu. Die Rechenleistung verbessert sich stetig. Unternehmen, die jetzt robuste Fähigkeiten zur prädiktiven Analytik aufbauen, werden gegenüber Wettbewerbern, die weiterhin auf Intuition und Tabellenkalkulationen setzen, einen deutlichen Wettbewerbsvorteil erlangen.

Aber Moment mal.

Technologie allein wird die Ineffizienzen klinischer Studien nicht beheben. Vorhersagemodelle erfordern eine sorgfältige Implementierung, kontinuierliche Validierung und die Integration menschlicher Expertise. Ziel ist es nicht, das klinische Urteil zu ersetzen, sondern es durch quantitative Daten zu ergänzen, die zuvor nicht verfügbar waren.

Wie die FDA in ihren Leitlinien feststellte, verändern KI und maschinelles Lernen die Landschaft klinischer Studien. Dieser Wandel eröffnet Organisationen, die bereit sind, in die notwendige Infrastruktur, die Fachkräfte und die erforderlichen kulturellen Veränderungen zu investieren, um datengestützte Entscheidungen zur Routine statt zur Ausnahme zu machen, neue Chancen.

Die Frage ist nicht, ob prädiktive Analysen klinische Studien verändern werden. Vielmehr geht es darum, ob bestimmte Organisationen diese Transformation anführen oder später, wenn der Wettbewerbsdruck keine andere Wahl lässt, hektisch versuchen werden, den Rückstand aufzuholen.

Häufig gestellte Fragen

Welche Datentypen verwenden prädiktive Analysemodelle in klinischen Studien?

Die Modelle integrieren typischerweise historische Datenbanken klinischer Studien, elektronische Patientenakten, Abrechnungsdaten, Krankheitsregister, Genominformationen und Daten aus der realen Versorgungspraxis. Die spezifischen Datenquellen hängen von der jeweiligen Vorhersageaufgabe ab: Rekrutierungsmodelle legen Wert auf Patientendemografie und die Leistung der Studienzentren, während Sicherheitsmodelle Datenbanken zu unerwünschten Ereignissen und Laborwerte priorisieren.

Wie genau sind Vorhersagemodelle für die Ergebnisse klinischer Studien?

Die Genauigkeit variiert erheblich je nach Anwendung und Modellqualität. Gut validierte kardiovaskuläre Risikomodelle erreichen C-Index-Werte im Bereich von 0,84–0,87, was auf eine hohe Unterscheidungsfähigkeit zwischen Patienten mit hohem und niedrigem Risiko hinweist. Schlecht entwickelte Modelle hingegen schneiden unter Umständen nicht besser ab als der Zufall. Eine externe Validierung anhand unabhängiger Datensätze ist daher unerlässlich, bevor man den Vorhersagen eines Modells vertraut.

Verlangt die FDA spezifische Validierungsstandards für KI in klinischen Studien?

Die FDA-Leitlinie von 2024 zur künstlichen Intelligenz in der Arzneimittelentwicklung empfiehlt Sponsoren, nachzuweisen, dass die Modelle zweckmäßig, ordnungsgemäß validiert und transparent dokumentiert sind. Obwohl keine spezifischen numerischen Schwellenwerte vorgeschrieben sind, legen veröffentlichte Validierungsrahmen Kennzahlen wie Schrumpfungsfaktoren ≥ 0,9 und R²-Differenzen ≤ 0,05 für kontinuierliche Zielgrößen nahe.

Können prädiktive Analysen die Kosten klinischer Studien senken?

Branchenberichte deuten auf erhebliche Einsparmöglichkeiten durch optimierte Standortauswahl, geringere Fehlerraten bei Screenings, bessere Patientenstratifizierung und frühzeitigere Identifizierung aussichtsloser Studien hin. Um diese Vorteile zu realisieren, sind jedoch Vorabinvestitionen in Dateninfrastruktur, Modellentwicklung und -validierung erforderlich – und nicht alle Anwendungen erzielen positive Ergebnisse.

Worin besteht der Unterschied zwischen prädiktiver Analytik und maschinellem Lernen in klinischen Studien?

Prädiktive Analytik ist die umfassendere Disziplin, die Daten nutzt, um zukünftige Ergebnisse vorherzusagen. Maschinelles Lernen umfasst spezifische algorithmische Ansätze innerhalb der prädiktiven Analytik, die automatisch Muster aus Daten erkennen. Maschinelles Lernen ist immer auch prädiktive Analytik, aber nicht jede prädiktive Analytik verwendet maschinelles Lernen – die traditionelle statistische Regression zählt ebenfalls dazu.

Wie gehen Organisationen mit Verzerrungen in Vorhersagemodellen um?

Zu den bewährten Verfahren gehören die Bewertung der Modellleistung in verschiedenen demografischen Untergruppen, die Sicherstellung, dass die Trainingsdaten diverse Bevölkerungsgruppen repräsentieren, die Überprüfung von Prädiktorvariablen auf Korrelationen mit geschützten Merkmalen sowie die Etablierung von Governance-Prozessen, die Gleichstellungsaspekte von der Modellentwicklung bis zur Implementierung berücksichtigen. Die FDA-Leitlinie empfiehlt ausdrücklich die Bewertung der Leistung in relevanten Patientensubpopulationen.

Welche Fähigkeiten benötigen Teams für die Implementierung von Predictive Analytics?

Für eine erfolgreiche Implementierung werden Data Scientists mit Expertise in Statistik und maschinellem Lernen, Experten aus dem klinischen Bereich, die Studienabläufe und den medizinischen Kontext verstehen, Data Engineers, die heterogene Datenquellen integrieren und bereinigen können, sowie Change-Management-Spezialisten benötigt, die die Akzeptanz bei skeptischen Stakeholdern fördern. Keine einzelne Person benötigt all diese Kompetenzen, aber das Team muss sie gemeinsam abdecken.

Schlussfolgerung

Die prädiktive Analytik hat sich von einer experimentellen Kuriosität zu einer operativen Notwendigkeit in klinischen Studien entwickelt. Die offiziellen Leitlinien der FDA, veröffentlichte Validierungsrahmen und die wachsende Zahl realer Anwendungen deuten allesamt auf einen grundlegenden Wandel in der Konzeption und Durchführung von Studien hin.

Organisationen, die eine Dateninfrastruktur aufbauen, Validierungskompetenz entwickeln und prädiktive Erkenntnisse in Entscheidungsprozesse integrieren, verzeichnen bereits messbare Verbesserungen bei der Rekrutierungseffizienz, der Durchführbarkeit von Studienprotokollen und den Patientenergebnissen. Wer zögert, sieht sich zunehmenden Wettbewerbsnachteilen ausgesetzt, da Mitbewerber durch datengestützte Ansätze immer stärkere Vorteile erzielen.

Die Technologie wird sich stetig verbessern. Die entscheidende Frage ist, ob Unternehmen die notwendigen Kompetenzen entwickeln, um sie effektiv zu nutzen. Beginnen Sie mit klar definierten Anwendungsfällen, investieren Sie in eine gründliche Validierung und konzentrieren Sie sich auf die Integration in bestehende Arbeitsabläufe anstatt auf den kompletten Austausch aktueller Prozesse.

Die Zukunft klinischer Studien lässt sich quantitativ vorhersagen. Organisationen, die diese Realität systematisch anerkennen, werden die nächste Generation der Arzneimittelentwicklung prägen.