Kurzzusammenfassung: Prädiktive Analysen im Data-Mining kombinieren statistische Algorithmen, maschinelles Lernen und historische Datenmuster, um zukünftige Ergebnisse und Trends vorherzusagen. Der Prozess extrahiert mithilfe von Data-Mining-Techniken verborgene Muster aus großen Datensätzen und wendet anschließend prädiktive Modelle an, um fundierte Geschäftsentscheidungen zu treffen, Risiken zu minimieren und Abläufe in Branchen wie dem Gesundheitswesen, dem Finanzwesen und dem Marketing zu optimieren.

Unternehmen ertrinken in Daten, aber hungern nach Erkenntnissen. Das ist das Paradoxon, mit dem Unternehmen heute konfrontiert sind.

Prädiktive Analysen im Data-Mining lösen dieses Problem, indem sie historische Rohdaten in handlungsrelevante Prognosen umwandeln. Der Ansatz nutzt statistische Algorithmen und Verfahren des maschinellen Lernens, um Muster zu identifizieren, die Aufschluss über zukünftige Entwicklungen geben.

Laut IBM nutzt prädiktive KI statistische Analysen und maschinelles Lernen, um Muster zu erkennen, Verhaltensweisen vorherzusagen und zukünftige Ereignisse zu prognostizieren. Unternehmen setzen prädiktive KI ein, um potenzielle zukünftige Ergebnisse, Ursachen und Risiken vorherzusagen.

Der Unterschied zwischen Raten und Wissen prägt den Wettbewerbsvorteil. Lassen Sie uns untersuchen, wie prädiktive Analysen aus Data Mining Mehrwert generieren.

Grundlagen verstehen: Data Mining vs. Predictive Analytics

Data Mining und Predictive Analytics sind nicht dasselbe, obwohl sie eng miteinander verbunden sind.

Data-Mining konzentriert sich auf die Entdeckung verborgener Muster in historischen Daten. Dabei werden große Datensätze untersucht, um Zusammenhänge, Anomalien und Trends aufzudecken, die zuvor nicht erkennbar waren. Man kann es sich als die Erkundungsphase vorstellen.

Die prädiktive Analytik nutzt diese erkannten Muster, um zukünftige Ergebnisse vorherzusagen. Erst in der Anwendungsphase werden die Muster in Vorhersagen umgewandelt.

Aber eines ist klar: Effektive prädiktive Analysen sind ohne solides Data-Mining nicht möglich. Der Data-Mining-Prozess liefert das Rohmaterial, das prädiktive Modelle benötigen.

| Aspekt | Datengewinnung | Prädiktive Analytik |

|---|---|---|

| Hauptfokus | Aufdeckung verborgener Muster in historischen Daten | Muster nutzen, um zukünftige Ergebnisse vorherzusagen |

| Zeitorientierung | Vergangenheitsorientiert | Zukunftsorientiert |

| Hauptausgang | Muster, Korrelationen, Anomalien | Prognosen, Wahrscheinlichkeiten, Vorhersagen |

| Gängige Techniken | Clustering, Assoziationsregeln, Klassifizierung | Regression, Entscheidungsbäume, neuronale Netze |

| Geschäftsfrage | Was ist passiert und warum? | Was wird als Nächstes geschehen? |

Die Forschung zur prädiktiven Analytik als Kern des Data Mining hat in diesem Bereich große akademische Aufmerksamkeit erfahren.

Nutzen Sie prädiktive Analysen im Data Mining mit überlegener KI.

AI Superior arbeitet mit großen Datensätzen, um Vorhersagemodelle zu erstellen, die Muster erkennen und die Entscheidungsfindung unterstützen.

Der Fokus liegt auf der Auswahl des richtigen Modellierungsansatzes und der Integration der Ergebnisse in bestehende Arbeitsabläufe.

Sie möchten prädiktive Analysen im Data Mining anwenden?

AI Superior kann Ihnen helfen bei:

- Bewertung von Datenquellen

- Erstellung von Vorhersagemodellen

- Test- und Verfeinerungsansätze

- Ergebnisse in Arbeitsabläufe integrieren

👉 Kontaktieren Sie AI Superior um Ihr Projekt, Ihre Daten und Ihren Implementierungsansatz zu besprechen

Wie der Prozess tatsächlich funktioniert

Die prädiktive Analytik im Data-Mining folgt einem systematischen Arbeitsablauf. Jede Phase baut auf der vorherigen auf.

Zunächst erfolgt die Datenerfassung. Organisationen sammeln relevante historische Daten aus verschiedenen Quellen – Transaktionsdatenbanken, Kundeninteraktionen, Sensormesswerten, sozialen Medien, alles, was das für die Vorhersage benötigte Signal enthält.

Im nächsten Schritt erfolgt die Datenaufbereitung. Rohdaten sind oft unstrukturiert. In dieser Phase werden Fehler bereinigt, fehlende Werte behandelt, Duplikate entfernt und Variablen in verwendbare Formate transformiert. Studien mit prädiktiven Modellen berichten von einer umfassenden Datenbereinigung und -aufbereitung sowie der Anwendung von Validierungs-Split-Ratios für das Modelltraining.

Anschließend extrahieren Data-Mining-Techniken Muster. Algorithmen analysieren die aufbereiteten Daten, um Beziehungen zwischen Variablen zu identifizieren, Populationen zu segmentieren oder Anomalien zu erkennen.

Anschließend werden Vorhersagemodelle erstellt. Statistische Algorithmen und Verfahren des maschinellen Lernens nutzen die erkannten Muster, um Modelle zu entwickeln, die Ergebnisse prognostizieren können. Gängige Ansätze sind Regressionsanalysen, Entscheidungsbäume, neuronale Netze und Support-Vektor-Maschinen.

Anschließend erfolgt die Validierung des Modells. Das Vorhersagemodell wird anhand neuer, ihm unbekannter Daten getestet, um seine Genauigkeit zu messen. Studien haben gezeigt, dass Naive-Bayes-Modelle bei Klassifizierungsaufgaben hohe Genauigkeitsraten erzielen.

Schließlich erfolgt die Implementierung. Nach der Validierung wird das Vorhersagemodell in Produktionsumgebungen eingesetzt, wo es auf Basis eingehender Daten Echtzeitvorhersagen trifft.

Kerntechniken und Algorithmen

Verschiedene statistische Verfahren und Techniken des maschinellen Lernens bilden die Grundlage für prädiktive Analysen im Data-Mining.

Regressionsanalyse

Regressionsmodelle sagen kontinuierliche numerische Ergebnisse voraus. Die lineare Regression prognostiziert Werte auf der Grundlage von Beziehungen zwischen Variablen, während die logistische Regression Wahrscheinlichkeiten für binäre Ergebnisse (ja/nein, wahr/falsch) vorhersagt.

Entscheidungsbäume

Diese Modelle unterteilen Daten anhand von Entscheidungsregeln in Zweige und erzeugen so eine baumartige Struktur. Random Forests kombinieren mehrere Entscheidungsbäume, um die Vorhersagegenauigkeit zu verbessern und Überanpassung zu reduzieren.

Neuronale Netze

Inspiriert von biologischen Neuronen, erkennen diese Algorithmen komplexe, nichtlineare Muster. Varianten des Deep Learning eignen sich hervorragend für Bilderkennung, Verarbeitung natürlicher Sprache und andere anspruchsvolle Vorhersageaufgaben.

Naive Bayes-Klassifikatoren

Basierend auf der Wahrscheinlichkeitstheorie berechnen Naive-Bayes-Algorithmen die Wahrscheinlichkeit von Ergebnissen unter bestimmten Bedingungen. Studien haben gezeigt, dass diese Modelle bei Klassifizierungsaufgaben hohe Genauigkeitsraten erzielen.

Support Vector Machines

SVMs finden optimale Grenzen zwischen verschiedenen Klassen in Daten und eignen sich daher sowohl für Klassifizierungs- als auch für Regressionsprobleme.

Zeitreihenanalyse

Spezielle Verfahren wie ARIMA-Modelle prognostizieren zukünftige Werte auf der Grundlage von zeitlichen Mustern in sequenziellen Daten – unerlässlich für Aktienkurse, Wettervorhersagen und Bedarfsplanung.

| Technik | Am besten geeignet für | Ausgabetyp | Komplexität |

|---|---|---|---|

| Lineare Regression | Kontinuierliche numerische Vorhersagen | Numerische Werte | Niedrig |

| Entscheidungsbäume | Klassifizierung und Interpretierbarkeit | Kategorien oder Werte | Medium |

| Neuronale Netze | Komplexe nichtlineare Muster | Kategorien oder Werte | Hoch |

| Naive Bayes | Textklassifizierung, Spam-Erkennung | Wahrscheinlichkeiten | Niedrig |

| Zeitreihenmodelle | Sequenzielle zeitliche Prognose | Zukünftige Werte | Medium |

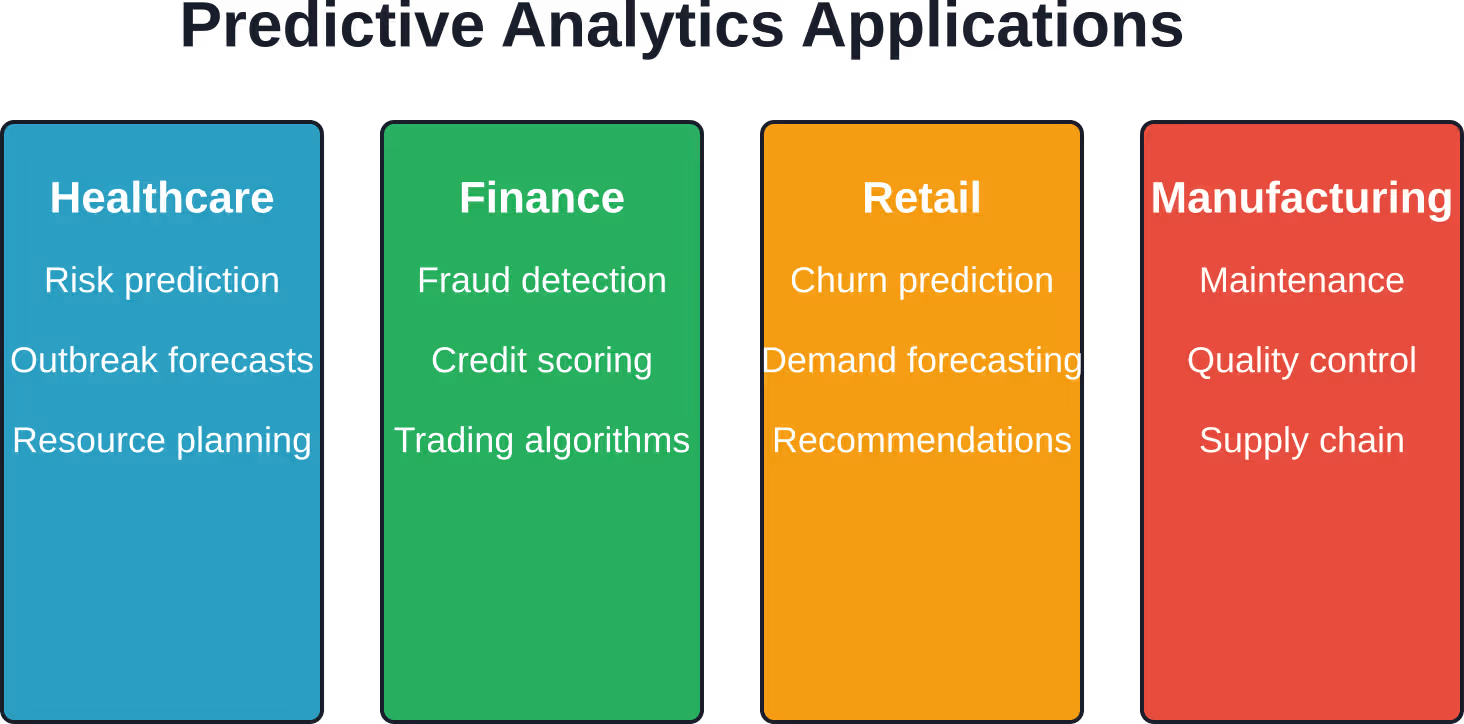

Anwendungsbeispiele aus der Praxis in verschiedenen Branchenies

Predictive Analytics im Data Mining treibt die Entscheidungsfindung in nahezu allen Sektoren voran.

- Gesundheitspflege: Krankenhäuser nutzen prädiktive Modelle, um Patienten mit hohem Risiko für eine Wiedereinweisung zu identifizieren, Krankheitsausbrüche vorherzusagen und die Ressourcenverteilung zu optimieren. Im Bereich der Cybersicherheit werden durch Data-Mining ungewöhnliche Muster in Systemen aufgedeckt, die auf Sicherheitslücken hindeuten können – beispielsweise lassen sich durch prädiktive Analysen erkennbare Muster bei Phishing-Angriffen nachweisen.

- Finanzen: Banken setzen prädiktive Analysen für Kreditwürdigkeitsprüfungen, Betrugserkennung und algorithmischen Handel ein. Die Forschung zur Aktienmarktanalyse mittels prädiktiver Analysen umfasste Anwendungen des k-NN-Algorithmus und der Markov-Kettenanalyse zur Prognose von Aktienindextrends.

- Einzelhandel: E-Commerce-Plattformen prognostizieren Kundenabwanderung, geben Produktempfehlungen und erstellen Nachfrageprognosen. Marketingteams nutzen Vorhersagemodelle, um diejenigen Kunden zu identifizieren, die am ehesten auf Kampagnen reagieren.

- Herstellung: Laut NIST unterstützt die Datenanalyse für intelligente Fertigungssysteme kleine und mittlere Unternehmen dabei, Datenanalysedienste zur Verbesserung von Entscheidungsfindung und Leistung einzusetzen. Vorausschauende Wartung prognostiziert Geräteausfälle, bevor sie auftreten.

- Marketing: Die akademische Forschung zur Wissensgenerierung im Marketing betont, dass Predictive Analytics bestätigte Beziehungen zwischen Variablen nutzt, um zukünftige Ergebnisse vorherzusagen, meist Werte, die die Wahrscheinlichkeit des Eintretens eines bestimmten Verhaltens oder Ereignisses angeben.

Vorteile, die die Akzeptanz fördern

Warum investieren Unternehmen in prädiktive Analysen? Die Vorteile sind überzeugend.

- Risikominderung: Die Vorhersage potenzieller Probleme ermöglicht eine proaktive Risikominderung. Finanzinstitute reduzieren Kreditausfälle, indem sie die Kreditwürdigkeit genauer prognostizieren.

- Betriebliche Effizienz: Vorausschauende Wartung beugt kostspieligen Geräteausfällen vor. Hersteller planen Reparaturen während vorgesehener Stillstandszeiten, anstatt sich mit unerwarteten Ausfällen auseinandersetzen zu müssen.

- Umsatzwachstum: Gezielte Marketingkampagnen auf Basis von prädiktiven Kundenbewertungen erzielen höhere Konversionsraten. Einzelhändler optimieren ihren Lagerbestand, um die prognostizierte Nachfrage zu decken und so Fehlbestände und Überbestände zu reduzieren.

- Bessere Entscheidungsfindung: Datengestützte Prognosen ersetzen Bauchgefühl und Spekulationen. Führungskräfte treffen strategische Entscheidungen auf Basis statistischer Erkenntnisse.

- Wettbewerbsvorteil: Organisationen, die Marktveränderungen vorhersagen, reagieren schneller als Wettbewerber, die noch analysieren, was bereits geschehen ist.

Herausforderungen und Beschränkungen

Prädiktive Analysen sind keine Zauberei. Es gibt reale Einschränkungen.

Probleme mit der Datenqualität beeinträchtigen Prognosen. Der Grundsatz „Müll rein, Müll raus“ gilt weiterhin. Modelle, die mit verzerrten oder unvollständigen historischen Daten trainiert wurden, liefern unzuverlässige Vorhersagen.

Der Anwendungsbereich muss viele Einzelfälle umfassen. Prädiktive Analysen funktionieren, wenn genügend historische Beispiele vorliegen, um Muster zu erkennen. Die Vorhersage einzigartiger, einmaliger Ereignisse erweist sich als schwierig.

Die Komplexität von Modellen führt zu Interpretationsproblemen. Neuronale Netze können zwar präzise Vorhersagen treffen, liefern aber kaum Erklärungen dafür. Regulierte Branchen wie das Gesundheitswesen und der Finanzsektor erfordern häufig transparente Begründungen.

Überanpassung tritt auf, wenn Modelle Trainingsdaten auswendig lernen, anstatt verallgemeinerbare Muster zu erlernen. Das Modell erzielt hervorragende Ergebnisse mit historischen Daten, versagt aber bei neuen Fällen.

Prognosen sind Wahrscheinlichkeitsrechnungen, keine Gewissheiten. Eine Genauigkeit von 951 TP3T bedeutet immer noch einen Fehler von 51 TP3T. Unternehmen müssen diese verbleibende Unsicherheit in ihre Planung einbeziehen.

Kontinuierliche Wartung ist erforderlich. Muster verändern sich im Laufe der Zeit – das Kundenverhalten ändert sich, die Marktbedingungen entwickeln sich weiter, neue Variablen treten auf. Modelle müssen regelmäßig neu trainiert werden, um präzise zu bleiben.

Die wachsende Rolle des maschinellen Lernens

Maschinelles Lernen hat die prädiktive Analytik im Data-Mining revolutioniert. Traditionelle statistische Methoden erforderten von Analysten die manuelle Angabe von Beziehungen zwischen Variablen.

Maschinelle Lernalgorithmen erkennen Muster automatisch. Bei ausreichend Daten identifizieren diese Systeme komplexe, nichtlineare Zusammenhänge, die Menschen möglicherweise übersehen.

Dieser Unterschied ist wichtig. Die traditionelle Regressionsanalyse erfordert, dass jemand Hypothesen darüber aufstellt, welche Variablen das Ergebnis vorhersagen. Maschinelles Lernen hingegen untersucht Tausende potenzieller Muster gleichzeitig.

Neuronale Netze des Deep Learning erzielen bemerkenswerte Genauigkeiten bei Aufgaben wie der Bildklassifizierung und der Verarbeitung natürlicher Sprache. Die Forschung auf diesem Gebiet hat einen erheblichen akademischen Einfluss.

Doch hier liegt der Haken: Modelle des maschinellen Lernens opfern oft die Interpretierbarkeit zugunsten der Genauigkeit. Random Forests mit Hunderten von Bäumen sagen zwar gut voraus, erklären die Daten aber schlecht.

Erste Schritte mit Predictive Analytics

Organisationen, die neu im Bereich der prädiktiven Analytik sind, sollten einen praxisorientierten Ansatz verfolgen.

Beginnen Sie mit einem konkreten Geschäftsproblem. Setzen Sie prädiktive Analysen nicht ein, nur weil sie im Trend liegen. Identifizieren Sie eine konkrete Herausforderung – Kundenabwanderung, Bestandsoptimierung, Betrugserkennung –, bei der Prognosen einen Mehrwert bieten.

Prüfen Sie die Datenverfügbarkeit. Sind genügend historische Beispiele vorhanden? Sind die Daten zugänglich, sauber und relevant?

Beginnen Sie mit einfachen Modellen. Lineare Regression und Entscheidungsbäume sind leichter zu interpretieren und anzuwenden als neuronale Netze. Erhöhen Sie die Komplexität schrittweise, wenn dies erforderlich ist.

Investieren Sie in Dateninfrastruktur. Predictive Analytics erfordert Systeme, die Daten effizient erfassen, speichern und verarbeiten.

Analytische Fähigkeiten fördern. Unternehmen benötigen Mitarbeiter, die sowohl die Geschäftsprozesse als auch statistische Methoden verstehen. Die Weiterbildung des vorhandenen Personals ist oft effektiver als die ausschließliche Einstellung externer Experten.

Vor dem Einsatz gründlich validieren. Modelle anhand von Testdaten prüfen, die sie noch nie gesehen haben. Die Genauigkeit unter realistischen Produktionsbedingungen messen, nicht nur in kontrollierten Experimenten.

Häufig gestellte Fragen

Was versteht man unter prädiktiver Analytik im Data-Mining?

Prädiktive Analysen im Data-Mining sind der Prozess, bei dem statistische Algorithmen und Verfahren des maschinellen Lernens eingesetzt werden, um historische Datenmuster zu analysieren und zukünftige Ergebnisse vorherzusagen. Data-Mining deckt verborgene Muster in großen Datensätzen auf, während prädiktive Analysen diese Muster nutzen, um Verhaltensweisen, Trends und Ereignisse vorherzusagen, die noch nicht eingetreten sind.

Wie genau sind prädiktive Analysemodelle?

Die Genauigkeit variiert je nach Anwendung, Datenqualität und verwendetem Verfahren. Studien haben gezeigt, dass Modelle bei Klassifizierungsaufgaben hohe Genauigkeitsraten erreichen. Einfachere Probleme mit sauberen Daten schneiden jedoch in der Regel besser ab als komplexe Szenarien mit verrauschten Daten. Kontinuierliche Überwachung und Nachschulung tragen dazu bei, die Genauigkeit langfristig zu erhalten.

Worin besteht der Unterschied zwischen Data Mining und Predictive Analytics?

Data Mining konzentriert sich auf das Aufspüren von Mustern, Korrelationen und Anomalien in historischen Daten – und beantwortet damit die Frage “Was ist passiert?”. Predictive Analytics nutzt diese Muster, um zukünftige Ereignisse vorherzusagen. Data Mining ist Exploration, Predictive Analytics ist Anwendung. Beide arbeiten in einem komplementären Workflow zusammen.

Welche Branchen profitieren am meisten von prädiktiver Analytik?

Gesundheitswesen, Finanzwesen, Einzelhandel, Fertigung und Marketing profitieren erheblich. Im Gesundheitswesen lassen sich Patientenrisiken und Ressourcenbedarf prognostizieren. Im Finanzwesen werden Betrug aufgedeckt und Kreditwürdigkeit bewertet. Der Einzelhandel prognostiziert Nachfrage und Kundenverhalten. Die Fertigung antizipiert Geräteausfälle. Jede Branche mit ausreichend historischen Daten kann prädiktive Analysen effektiv einsetzen.

Welche Fähigkeiten sind für prädiktive Analysen erforderlich?

Für eine erfolgreiche prädiktive Analytik sind Kenntnisse in Statistik und Wahrscheinlichkeitsrechnung, Programmierkenntnisse in Sprachen wie Python oder R, ein Verständnis von Algorithmen des maschinellen Lernens, Fähigkeiten zur Datenaufbereitung und -bereinigung, Fachkenntnisse im jeweiligen Geschäftsbereich sowie kritisches Denken zur Interpretation der Ergebnisse und Validierung der Modelle erforderlich.

Wie viele Daten werden für prädiktive Analysen benötigt?

Die benötigte Menge hängt von der Komplexität und Variabilität des Problems ab. Einfache Probleme erfordern möglicherweise Hunderte von Beispielen; komplexe Szenarien hingegen Tausende oder Millionen. Generell verbessert eine größere Datenmenge die Vorhersagegenauigkeit, doch die Qualität ist wichtiger als die Quantität.

Können kleine Unternehmen prädiktive Analysen nutzen?

Absolut. Cloudbasierte Tools und Open-Source-Software haben prädiktive Analysen für Unternehmen jeder Größe zugänglich gemacht. Die Forschung des NIST konzentriert sich darauf, kleine und mittlere Unternehmen bei der Anwendung von Datenanalysediensten zu unterstützen, um ihre Entscheidungsfindung und Leistung zu verbessern. Beginnen Sie mit klar definierten Problemen, bei denen selbst bescheidene Verbesserungen einen Mehrwert bieten.

Ich freue mich auf

Die prädiktive Analytik im Data-Mining entwickelt sich weiterhin rasant. Mehrere Trends prägen die Zukunft.

Echtzeitprognosen werden zum Standard. Unternehmen wünschen sich, dass Prognosen kontinuierlich aktualisiert werden, sobald neue Daten eintreffen, und nicht durch Batch-Prozesse, die nächtlich ausgeführt werden.

Mixed-Data-Modelle, die strukturierte Zahlen mit unstrukturiertem Text und Bildern kombinieren, erweitern die Vorhersagemöglichkeiten. Die Verarbeitung natürlicher Sprache extrahiert Signale aus Kundenrezensionen, Support-Tickets und sozialen Medien.

Automatisierte Plattformen für maschinelles Lernen senken die Hürde der erforderlichen Fachkenntnisse. AutoML-Tools übernehmen die Algorithmenauswahl, das Feature Engineering und die Hyperparameter-Optimierung und machen so prädiktive Analysen auch für Nicht-Spezialisten zugänglich.

Erklärbare KI begegnet der Herausforderung der Interpretierbarkeit. Neue Techniken helfen neuronalen Netzen und Ensemble-Modellen, ihre Schlussfolgerungen zu erläutern – ein entscheidender Faktor für regulierte Branchen.

Edge Computing ermöglicht Vorhersagen direkt auf den Endgeräten anstatt auf zentralen Servern. Intelligente Fertigungssysteme und IoT-Sensoren erstellen Prognosen lokal mit minimaler Latenz.

Die Nachfrage nach Datenanalysten wächst stetig. Akademische Programme legen zunehmend Wert auf quantitative Fähigkeiten, damit große Informationsmengen in Wissen umgewandelt werden und nicht zu einer Informationsüberflutung führen.

Unternehmen, die prädiktive Analysen im Data Mining beherrschen, werden nicht nur auf Veränderungen reagieren, sondern sie antizipieren. Die Muster sind bereits in den historischen Daten vorhanden. Die entscheidende Frage im Wettbewerb ist, wer sie als Erster erkennt.