Kurzzusammenfassung: Predictive Analytics im Bereich Business Intelligence wandelt Rohdaten in zukunftsweisende Erkenntnisse um, indem historische Daten mit maschinellem Lernen, statistischer Modellierung und Data-Mining-Verfahren kombiniert werden. Unternehmen nutzen diese Möglichkeiten, um das Kundenverhalten vorherzusagen, Abläufe zu optimieren, Risiken zu minimieren und proaktive Entscheidungen zu treffen, die die Wettbewerbsposition und den ROI verbessern.

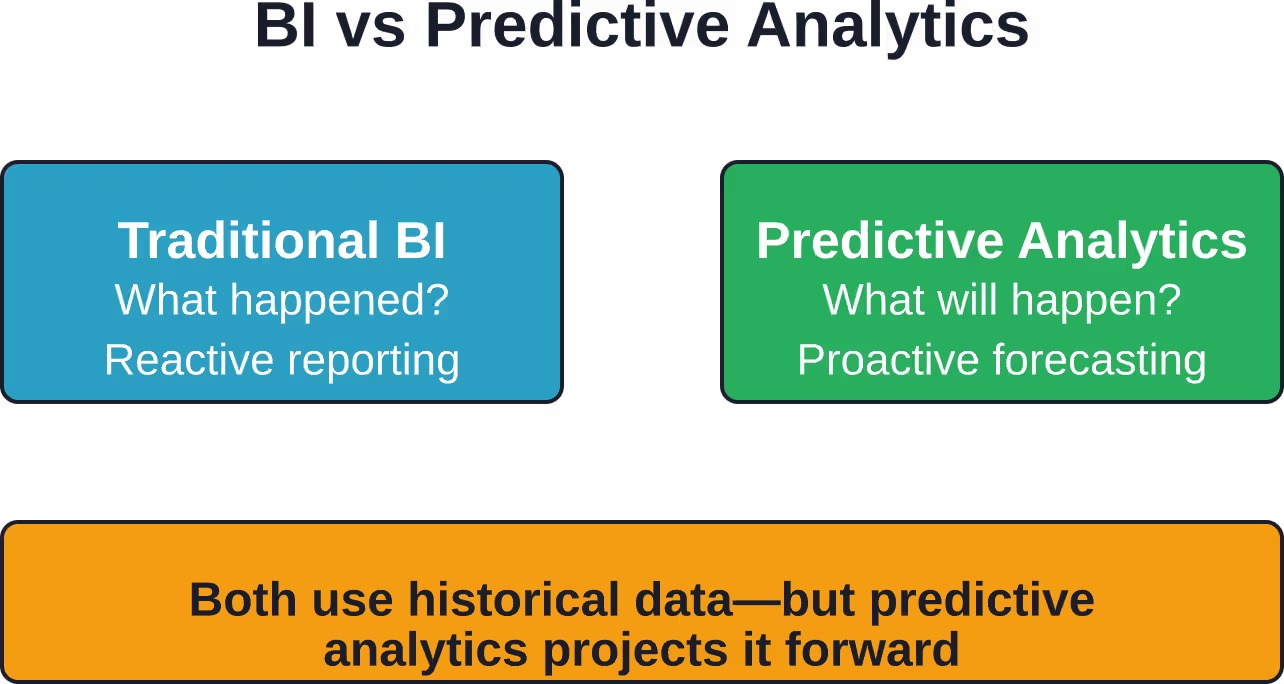

Früher beantwortete Business Intelligence nur eine Frage: Was ist passiert? Berichte zeigten Umsatzzahlen des letzten Quartals, Kundenzahlen des Vormonats oder Lagerbestände von gestern. Nützlich, gewiss. Aber reaktiv.

Prädiktive Analysen verändern alles. Sie verlagern den Fokus von Rückspiegeln auf Windschutzscheiben und nutzen historische Daten in Kombination mit statistischer Modellierung, Data-Mining-Techniken und maschinellem Lernen, um vorherzusagen, was als Nächstes kommt.

Hier ist, was Predictive Analytics für Business Intelligence tatsächlich leistet: Es nimmt in historischen Daten verborgene Muster und projiziert sie in die Zukunft, wodurch Unternehmen die Möglichkeit erhalten, Kundenabwanderung vorherzusehen, Nachfragespitzen vorherzusagen, Betrug zu erkennen, bevor er sich ausbreitet, und die Ressourcenzuweisung Wochen oder Monate im Voraus zu optimieren.

Was unterscheidet Predictive Analytics von traditioneller Business Intelligence?

Die traditionelle Business Intelligence beantwortet beschreibende Fragen. Wie hoch waren unsere Umsätze im letzten Quartal? Welche Produkte verkauften sich am schnellsten? Wie viele Kunden haben wir verloren?

Die prädiktive Analytik befasst sich mit einer grundlegend anderen Frage: Was wird als Nächstes wahrscheinlich passieren, und was sollten wir dagegen tun?

Diese Unterscheidung ist wichtig, weil sie den Zeitpunkt des Handelns von Organisationen beeinflusst. Deskriptive Analysen ermöglichen es Teams, auf Probleme zu reagieren, nachdem diese bereits aufgetreten sind. Prädiktive Analysen schaffen die Möglichkeit, einzugreifen, bevor sich die Folgen verfestigen.

Berücksichtigen Sie die Kundenbindung. Deskriptive Business Intelligence (BI) zeigt Teams, dass die Abwanderungsrate im letzten Monat von 101 TP3T auf 121 TP3T gestiegen ist. Das ist zwar eine wertvolle Information, aber diese Kunden sind bereits abgewandert.

Mithilfe von Predictive Analytics lassen sich frühzeitig Warnzeichen für eine mögliche Abwanderung erkennen – etwa ein nachlassendes Engagement, eine geringere Kaufhäufigkeit oder veränderte Support-Ticket-Muster –, solange noch Zeit für gezielte Kundenbindungsangebote bleibt.

Der technische Unterschied liegt in der Methodik. Business Intelligence stützt sich stark auf Abfragen, Reporting-Tools und Dashboards, die historische Daten auf vielfältige Weise analysieren. Predictive Analytics hingegen nutzt statistische Algorithmen, Modelle des maschinellen Lernens und Data-Mining-Techniken, um Muster zu erkennen und daraus Wahrscheinlichkeitsprognosen abzuleiten.

Nutzen Sie Predictive Analytics in Business Intelligence mit überlegener KI.

AI Superior arbeitet mit Geschäftsdaten, um prädiktive Modelle zu erstellen, die über die reine Berichterstattung hinausgehen und zukunftsorientierte Analysen unterstützen.

Der Fokus liegt auf der Integration von Vorhersageergebnissen in BI-Workflows, damit Erkenntnisse direkt in die Entscheidungsfindung einfließen können.

Möchten Sie Predictive Analytics im Bereich Business Intelligence anwenden?

AI Superior kann Ihnen helfen bei:

- Auswertung von Geschäftsdaten

- Erstellung von Vorhersagemodellen

- Integration von Modellen in BI-Systeme

- Verfeinerung der Ergebnisse basierend auf der Nutzung

👉 Kontaktieren Sie AI Superior um Ihr Projekt, Ihre Daten und Ihren Implementierungsansatz zu besprechen

Wie prädiktive Analysen in der Praxis funktionieren

Der Prozess ist nicht geheimnisvoll. Predictive Analytics folgt einem strukturierten Arbeitsablauf, der von Rohdaten zu umsetzbaren Prognosen führt.

Es beginnt mit der Datenerfassung. Organisationen beziehen historische Daten aus verschiedenen Quellen: Transaktionsdatenbanken, Kundenbeziehungsmanagementsystemen, Webanalyseplattformen, Betriebsprotokollen, externen Marktdaten und allen anderen relevanten Informationsspeichern.

Im nächsten Schritt erfolgt die Datenaufbereitung. Rohdaten sind selten direkt analysereif. Sie enthalten Duplikate, fehlende Werte, Formatierungsinkonsistenzen und Ausreißer. Datenwissenschaftler bereinigen, normalisieren und strukturieren diese Informationen in Formate, die für die Modellierung geeignet sind.

In der Modellierungsphase werden statistische Algorithmen und Verfahren des maschinellen Lernens eingesetzt, um Muster in den aufbereiteten Daten zu erkennen. Regressionsmodelle können beispielsweise das Verkaufsvolumen auf Basis saisonaler Muster und Werbeaktionen prognostizieren. Klassifizierungsalgorithmen können potenziell betrügerische Transaktionen kennzeichnen. Zeitreihenmodelle prognostizieren den Lagerbedarf anhand historischer Nachfrageschwankungen.

Die Validierung von Modellen gewährleistet die Zuverlässigkeit von Vorhersagen. Datenwissenschaftler testen Modelle anhand zurückgehaltener historischer Daten, um die Genauigkeit zu messen. Ein Modell, das die Vergangenheit präzise vorhergesagt hat, hat eine höhere Wahrscheinlichkeit, auch die Zukunft zuverlässig vorherzusagen.

Die Implementierung integriert Modelle in Produktionssysteme, wo sie Echtzeit- oder Batch-Vorhersagen generieren. Ein Betrugserkennungsmodell bewertet jede Transaktion unmittelbar nach ihrem Auftreten. Ein Bedarfsprognosemodell aktualisiert die Lagerempfehlungen täglich.

Die Überwachung schließt den Zyklus. Die Modellleistung verschlechtert sich im Laufe der Zeit mit sich ändernden Geschäftsbedingungen. Die kontinuierliche Überwachung erkennt Genauigkeitsabweichungen und veranlasst bei Bedarf ein erneutes Training.

Kerntechniken, die Vorhersagen ermöglichen

Verschiedene statistische und maschinelle Lernverfahren treiben die Fähigkeiten zur prädiktiven Analytik voran:

- Die Regressionsanalyse modelliert Zusammenhänge zwischen Variablen, um kontinuierliche Ergebnisse vorherzusagen. Die lineare Regression kann beispielsweise den monatlichen Umsatz auf Basis von Marketingausgaben, Saisonalität und Konjunkturindikatoren prognostizieren. Die logistische Regression prognostiziert binäre Ergebnisse, etwa ob ein Kunde kauft oder abwandert.

- Entscheidungsbäume unterteilen Daten anhand von Merkmalswerten in Zweige und erstellen so regelbasierte Vorhersagestrukturen. Random Forests kombinieren mehrere Entscheidungsbäume, um die Genauigkeit zu verbessern und Überanpassung zu reduzieren.

- Neuronale Netze verarbeiten Daten mithilfe von Schichten miteinander verbundener Knoten und lernen dabei komplexe, nichtlineare Muster. Deep-Learning-Architekturen verarbeiten unstrukturierte Daten wie Texte, Bilder und Sensormesswerte.

- Zeitreihenmodelle sind auf sequentielle Daten spezialisiert und erfassen Trends, Saisonalität und zyklische Muster, um zukünftige Werte auf der Grundlage zeitlicher Abhängigkeiten vorherzusagen.

- Clustering-Algorithmen gruppieren ähnliche Datensätze und decken so Kundensegmente, Produktaffinitäten oder operative Muster auf, die als Grundlage für gezielte Strategien dienen können.

Geschäftsanwendungen, bei denen Prognosen den Wert steigern

Unternehmen verschiedenster Branchen setzen prädiktive Analysen ein, um spezifische geschäftliche Herausforderungen zu bewältigen. Die Anwendungsfälle weisen gemeinsame Merkmale auf: Sie dienen der Entscheidungsfindung in wichtigen Bereichen, nutzen verfügbare historische Daten und führen zu messbaren Ergebnisverbesserungen.

Kundenbindung und Abwanderungsprävention

Die Neukundengewinnung ist deutlich teurer als die Kundenbindung. Prognosemodelle identifizieren Kunden mit hohem Abwanderungsrisiko anhand von Verhaltenssignalen: nachlassendes Engagement, geringere Kaufhäufigkeit, weniger Support-Interaktionen und Rechercheaktivitäten bei Wettbewerbern.

Diese Prognosen lösen gezielte Kundenbindungsmaßnahmen aus – personalisierte Angebote, proaktive Kontaktaufnahme, Serviceverbesserungen –, wobei ein Eingreifen das Ergebnis noch verändern kann.

Bedarfsplanung und Bestandsoptimierung

Einzelhändler und Hersteller nutzen Prognosemodelle, um die Produktnachfrage standort-, kanal- und zeitraumübergreifend vorherzusagen. Genaue Prognosen reduzieren Fehlbestände, die zu Umsatzeinbußen führen, und überschüssige Lagerbestände, die Kapital binden.

Zeitreihenmodelle berücksichtigen Saisonalität, Werbeaktionen, Wettermuster, Wirtschaftsindikatoren und historische Trends, um Prognosen zu erstellen, die Kauf-, Produktions- und Vertriebsentscheidungen steuern.

Betrugserkennung und Risikomanagement

Finanzinstitute setzen prädiktive Modelle ein, die Transaktionen in Echtzeit bewerten und Anomalien, die auf betrügerische Aktivitäten hindeuten, kennzeichnen. Modelle des maschinellen Lernens identifizieren subtile Muster, die regelbasierten Systemen entgehen – ungewöhnliche Transaktionssequenzen, geografische Unstimmigkeiten und Verhaltensabweichungen.

Der gleiche Ansatz wird auch für die Kreditrisikobewertung, die Versicherungszeichnung und die Überwachung der Einhaltung von Vorschriften angewendet.

Gezieltes Marketing und Personalisierung

Marketingteams nutzen prädiktive Analysen, um vorherzusagen, welche Kunden am ehesten auf bestimmte Angebote reagieren, welche Produkte zu empfehlen sind, welche Kanäle die höchste Konversionsrate erzielen und welche Botschaften bei verschiedenen Kundensegmenten Anklang finden.

Diese Prognosen ermöglichen eine Ressourcenallokation, die den Return on Investment im Marketing maximiert, indem die Anstrengungen dort konzentriert werden, wo sie messbare Ergebnisse erzielen.

Betriebseffizienz und Instandhaltung

Vorausschauende Wartungsmodelle analysieren Sensordaten, Nutzungsmuster und historische Ausfalldaten, um vorherzusagen, wann Anlagen gewartet werden müssen. Dadurch verlagert sich die Wartung von reaktiv (Behebung von Störungen) oder kalenderbasiert (geplant unabhängig vom Bedarf) hin zu zustandsorientiert (Eingreifen, wenn Vorhersagen einen bevorstehenden Ausfall anzeigen).

Dieser Ansatz reduziert Ausfallzeiten, verlängert die Lebensdauer von Anlagen und optimiert die Zuteilung von Wartungsressourcen.

| Anwendungsgebiet | Wichtigste Vorhersagen | Hauptvorteil |

|---|---|---|

| Kundenbindung | Abwanderungswahrscheinlichkeit, Kundenwert | Reduzierte Kundenakquisitionskosten |

| Nachfragevorhersage | Produktnachfrage nach Standort und Zeit | Optimierte Lagerbestände |

| Aufdeckung von Betrug | Transaktionsrisikobewertungen | Reduzierte Betrugsverluste |

| Marketing-Optimierung | Antwortwahrscheinlichkeit, Konversionswahrscheinlichkeit | Verbesserter Marketing-ROI |

| Vorausschauende Wartung | Zeitpunkt des Geräteausfalls | Reduzierte Ausfallzeiten und Wartungskosten |

| Absatzprognose | Umsatzprognosen nach Segment | Bessere Ressourcenplanung |

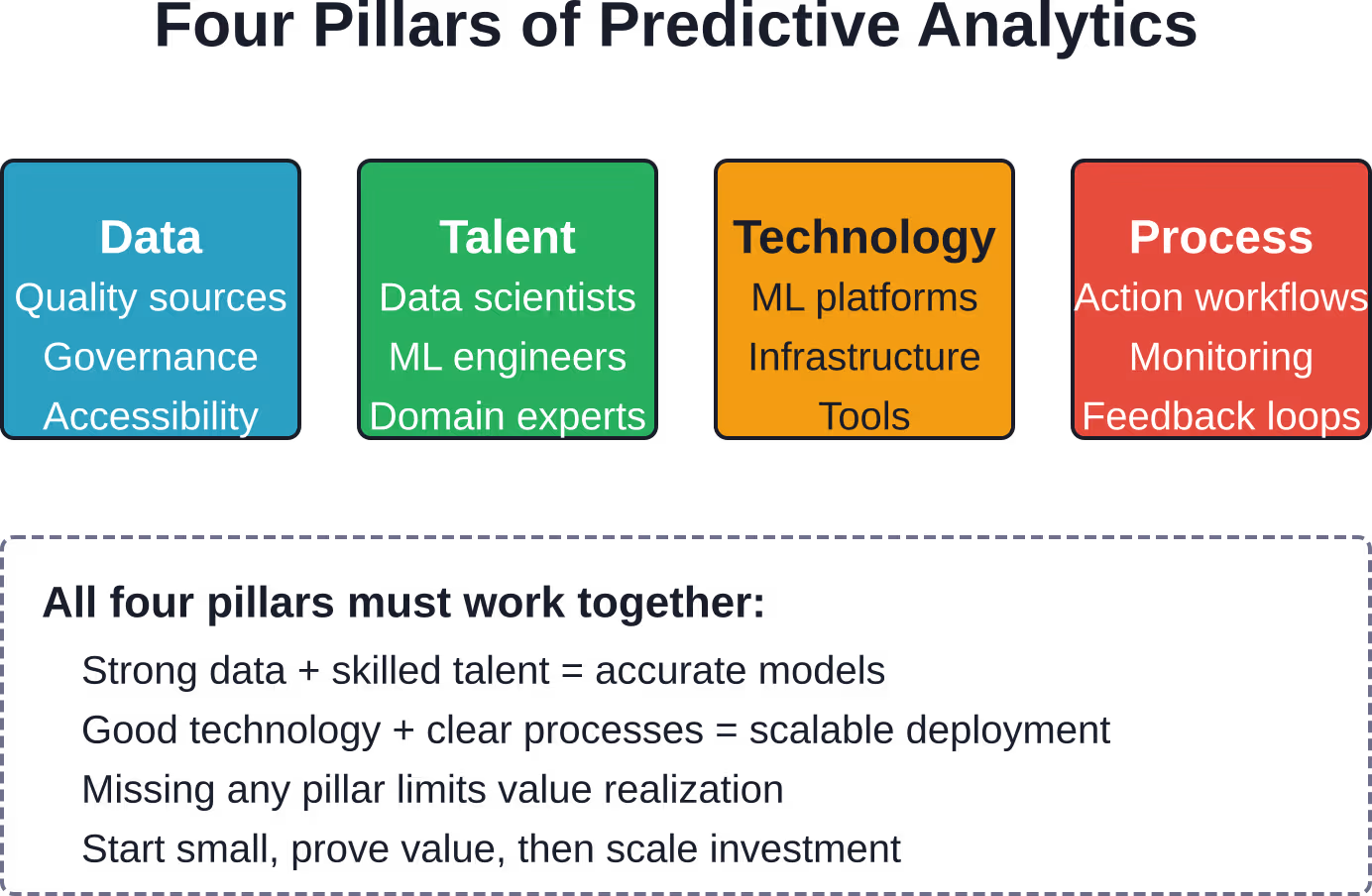

Aufbau von Vorhersagefähigkeiten: Was Organisationen benötigen

Die Implementierung von Predictive Analytics erfordert mehr als Softwarelizenzen. Erfolgreiche Implementierungen kombinieren technologische Infrastruktur, qualifizierte Fachkräfte, qualitativ hochwertige Daten und organisatorische Prozesse, die Vorhersagen in konkrete Maßnahmen umsetzen.

Dateninfrastruktur und -qualität

Vorhersagemodelle sind nur so gut wie die Daten, mit denen sie trainiert werden. Organisationen benötigen Systeme, die relevante historische Daten in der erforderlichen Granularität und Vollständigkeit erfassen, speichern und zugänglich machen.

Probleme mit der Datenqualität – fehlende Werte, Duplikate, inkonsistente Formatierung, Messfehler – beeinträchtigen die Modellgenauigkeit unmittelbar. Investitionen in Daten-Governance, Qualitätsüberwachung und Bereinigungsprozesse zahlen sich in Form einer höheren Vorhersagezuverlässigkeit aus.

Analytisches Talent und Expertise

Für die Entwicklung und den Einsatz von Vorhersagemodellen sind spezielle Fähigkeiten erforderlich: statistische Kenntnisse zur Auswahl geeigneter Verfahren, Programmierkenntnisse zur Implementierung und zum Testen der Modelle, Fachkenntnisse zur Identifizierung relevanter Merkmale und zur Interpretation der Ergebnisse sowie technisches Know-how zur Operationalisierung der Vorhersagen in Produktionssystemen.

Organisationen begegnen diesem Problem durch die Einstellung von Datenwissenschaftlern und Machine-Learning-Ingenieuren, die Weiterbildung bestehender Analyseteams oder durch Partnerschaften mit externen Spezialisten.

Technologieplattformen und -werkzeuge

Moderne Plattformen für prädiktive Analysen bieten integrierte Umgebungen für Datenaufbereitung, Modellentwicklung, Validierung, Bereitstellung und Überwachung. Diese Tools reichen von Open-Source-Bibliotheken wie scikit-learn und TensorFlow für Python bis hin zu kommerziellen Plattformen mit durchgängigen Workflows und grafischen Benutzeroberflächen.

Die richtige Wahl hängt von der technischen Raffinesse, der Komplexität des Anwendungsfalls, den Skalierungsanforderungen und den bestehenden Technologieinvestitionen ab.

Organisationsprozesse für Maßnahmen

Prognosen schaffen nur dann Wert, wenn Organisationen darauf reagieren. Dies erfordert Prozesse, die Prognosen an Entscheidungsträger weiterleiten, Arbeitsabläufe, die Interventionen auslösen, und Feedbackschleifen, die messen, ob die auf Prognosen basierenden Maßnahmen die gewünschten Ergebnisse erzielt haben.

Ein Abwanderungsprognosemodell erstellt Listen gefährdeter Kunden. Ohne Prozesse, die diese Listen an die Kundenbindungsteams weiterleiten, personalisierte Maßnahmen auslösen und nachverfolgen, ob Interventionen die Abwanderung reduziert haben, bleiben die Prognosen jedoch interessante Datenpunkte und liefern keinen echten Mehrwert für das Unternehmen.

Häufige Herausforderungen und wie man sie bewältigt

Organisationen, die prädiktive Analysen einsetzen, stoßen auf vorhersehbare Hindernisse. Die Antizipation dieser Herausforderungen und die Planung von Gegenmaßnahmen verbessern die Erfolgsquoten.

Datenverfügbarkeits- und Qualitätslücken

Historische Daten erweisen sich oft als unvollständig, inkonsistent oder nicht in der erforderlichen Detailtiefe verfügbar. Kundendatensätze enthalten keine Kaufhistorie vor einem bestimmten Datum. Systemmigrationen haben alte Transaktionsdaten verloren. Verschiedene Abteilungen speichern Informationen in inkompatiblen Formaten.

Zu den Lösungsansätzen gehören Investitionen in Datenintegrationsplattformen, die Festlegung von Datenqualitätsstandards, die Implementierung von Governance-Prozessen und der Ausgangspunkt sind Anwendungsfälle, in denen bereits ausreichend qualitativ hochwertige Daten vorhanden sind, anstatt auf perfekte Daten in allen Bereichen zu warten.

Modellgenauigkeit und Vertrauen

Prognosemodelle liefern Wahrscheinlichkeitsprognosen, keine Gewissheiten. Ein Abwanderungsmodell mit einer Genauigkeit von 80% identifiziert immer noch jeden fünften Kunden falsch. Entscheidungsträger, die an deterministische Berichte gewöhnt sind, könnten mit Wahrscheinlichkeitsprognosen Schwierigkeiten haben.

Um Vertrauen aufzubauen, bedarf es Transparenz hinsichtlich der Modellgrenzen, einer klaren Kommunikation der Konfidenzintervalle, einer Validierung anhand historischer Ergebnisse und des Beginns mit Anwendungsfällen mit geringerem Risiko, bei denen Vorhersagefehler überschaubare Folgen haben.

Überanpassung und Modellverschlechterung

Modelle können sich zu stark auf die Trainingsdaten spezialisieren und dabei eher Rauschen als echte Muster erfassen. Diese Überanpassung führt zwar zu hervorragenden Ergebnissen bei historischen Daten, aber zu schlechten Vorhersagen bei neuen Daten.

Geeignete Validierungsmethoden – wie Trainings- und Testdatensätze, Kreuzvalidierung und Holdout-Datensätze – erkennen Überanpassung bereits während der Entwicklung. Die Überwachung der Leistung des Produktionsmodells deckt Leistungseinbußen bei sich ändernden Geschäftsbedingungen auf und löst erneute Trainingszyklen aus.

Operationalisierung von Vorhersagen

Die Kluft zwischen Proof-of-Concept-Modellen, die auf Data-Science-Workstations laufen, und Produktionssystemen, die Tausenden von Nutzern Echtzeitvorhersagen liefern, stellt eine große Implementierungshürde dar.

Organisationen benötigen technische Ressourcen, um Bereitstellungspipelines aufzubauen, Vorhersagen in operative Systeme zu integrieren, Skalierbarkeit und Zuverlässigkeit zu gewährleisten und ein Monitoring einzurichten, das Leistungsprobleme erkennt, bevor sie sich auf Geschäftsergebnisse auswirken.

ROI-Überlegungen: Wann zahlt sich Predictive Analytics aus?

Predictive Analytics erfordert Investitionen in Dateninfrastruktur, Technologieplattformen, spezialisierte Fachkräfte und organisatorische Veränderungen. Diese Investitionen müssen messbare Ergebnisse liefern.

Die Forschung zu ROI-orientierter Datenanalyse betont, dass bei Entscheidungen über die Tiefe der Analyse sowohl die Kosten als auch der erzielbare Nutzen berücksichtigt werden sollten, wobei die Gewinnschwellenwerte ermittelt werden müssen, ab denen weitere Analysen im Verhältnis zum investierten Aufwand keinen Mehrwert mehr bieten.

Szenarien mit hohem ROI weisen gemeinsame Merkmale auf: Sie befassen sich mit wichtigen Entscheidungen, bei denen eine verbesserte Genauigkeit erhebliche finanzielle Auswirkungen hat, nutzen vorhandene Qualitätsdaten, die den Vorbereitungsaufwand minimieren, und knüpfen an operative Prozesse an, die bereit sind, auf Vorhersagen zu reagieren.

Ein Einzelhändler, der mithilfe von Bedarfsprognosen seinen Lagerbestand über Tausende von Artikeln und Hunderte von Standorten hinweg optimiert, schafft Mehrwert durch weniger Fehlbestände und Überbestände. Der Nutzen steigt mit der Unternehmensgröße.

Für ein kleines Unternehmen mit begrenzten historischen Daten, einfachen Abläufen und geringer Entscheidungskomplexität reichen möglicherweise grundlegende deskriptive Analysen aus. Die Investition in prädiktive Analysen würde sich nicht lohnen.

Der Einsatz fokussierter Pilotprojekte für wirkungsvolle Anwendungsfälle beweist den Nutzen, bevor unternehmensweite Implementierungen vorgenommen werden. Erste Erfolge stärken das Vertrauen im Unternehmen und finanzieren die Expansion.

Zukunftsrichtungen: KI-gestützte Intelligenz

Die prädiktive Analytik entwickelt sich ständig weiter, da die Techniken des maschinellen Lernens Fortschritte machen, die Rechenleistung zunimmt und die Datenverfügbarkeit zunimmt.

Laut IEEE-Forschungen und -Veröffentlichungen zum Thema KI-gestützte Business Intelligence kombinieren Unternehmen zunehmend traditionelle Vorhersagemodelle mit fortschrittlichen KI-Fähigkeiten, darunter die Verarbeitung natürlicher Sprache für unstrukturierte Daten, Computer Vision für die Bild- und Videoanalyse sowie Deep Learning für die Erkennung komplexer Muster.

AutoML-Plattformen bieten mittlerweile eine vollständige autonome Governance und die Integration von ‘Reasoning AI’ und gehen damit über die einfache Hyperparameter-Optimierung hinaus bis hin zur automatisierten Prüfung der Modellethik und der Generierung synthetischer Daten.

Echtzeit-Vorhersagearchitekturen verarbeiten Streaming-Daten, um Prognosen im Moment der Entscheidungsfindung zu erstellen, anstatt Vorhersagen über Nacht in Batches zu aktualisieren. Dies ermöglicht Anwendungen wie dynamische Preisgestaltung, sofortige Betrugserkennung und adaptive Personalisierung.

Erklärbare KI-Techniken lösen das Black-Box-Problem komplexer Modelle, indem sie nachvollziehbare Erklärungen dafür liefern, warum Modelle bestimmte Vorhersagen generieren. Dies schafft Vertrauen und ermöglicht es Organisationen, Vorhersagen in regulierten Bereichen, die Transparenz erfordern, zu nutzen.

Häufig gestellte Fragen

Worin besteht der Unterschied zwischen prädiktiver Analytik und künstlicher Intelligenz?

Prädiktive Analytik ist eine spezielle Anwendung der Datenanalyse, die sich auf die Vorhersage zukünftiger Ergebnisse mithilfe statistischer Modelle und maschinellen Lernens konzentriert. Künstliche Intelligenz (KI) ist ein umfassenderes Feld, das verschiedene Techniken beinhaltet, die es Computern ermöglichen, Aufgaben mit menschenähnlicher Intelligenz auszuführen. Viele Anwendungen prädiktiver Analytik nutzen KI-Techniken, aber nicht alle KI-Anwendungen beinhalten Vorhersagen.

Wie viele historische Daten benötigen Sie für prädiktive Analysen?

Der Datenbedarf variiert je nach Komplexität des Anwendungsfalls und Art der Vorhersage. Einfache Regressionsmodelle kommen mit Hunderten von Datensätzen aus, während Deep-Learning-Ansätze typischerweise Tausende oder Millionen von Beispielen benötigen. Generell gilt: Je mehr Daten, desto höher die Modellgenauigkeit, doch die Qualität ist wichtiger als die Quantität. Saubere, relevante Daten der letzten ein bis drei Jahre genügen oft für viele Geschäftsanwendungen.

Können auch kleine Unternehmen von prädiktiver Analytik profitieren?

Absolut. Während große Unternehmen komplexe, individuell angepasste Modelle einsetzen, können kleine Unternehmen auf vordefinierte Prognosefunktionen in Marketingplattformen, CRM-Systemen und Buchhaltungssoftware zurückgreifen. Tools zur Optimierung von E-Mail-Kampagnen, zur Kundensegmentierung und zur Cashflow-Prognose nutzen Prognosetechniken, ohne dass Data-Science-Expertise oder riesige Datensätze erforderlich sind.

Wie genau sind prädiktive Analysemodelle?

Die Genauigkeit hängt von der Datenqualität, dem Modellierungsansatz und der inhärenten Vorhersagbarkeit des Prognostizierten ab. Gut konzipierte Modelle für stabile Bereiche wie die Nachfrageprognose erreichen eine Genauigkeit von 85–951 TP³T. Modelle, die weniger deterministische Ergebnisse wie das Kundenverhalten vorhersagen, erreichen eine Genauigkeit von 70–801 TP³T. Die Vorhersagegenauigkeit nimmt mit zunehmender Zukunftsreichweite und bei signifikanten Abweichungen der Bedingungen von historischen Mustern ab.

Was passiert, wenn sich die wirtschaftlichen Rahmenbedingungen ändern und die Modelle nicht mehr funktionieren?

Die Modellleistung verschlechtert sich naturgemäß, wenn sich die Marktdynamik ändert, sich das Kundenverhalten weiterentwickelt oder externe Faktoren variieren. Die kontinuierliche Überwachung gewährleistet die Genauigkeit der Vorhersagen im Produktivbetrieb. Sinkt die Leistung unter akzeptable Schwellenwerte, müssen die Modelle mit aktuellen Daten, die die gegenwärtigen Bedingungen widerspiegeln, neu trainiert werden. Unternehmen legen üblicherweise regelmäßige Trainingspläne fest – monatlich, vierteljährlich oder wenn die Überwachung eine Verschlechterung der Genauigkeit feststellt.

Wie lange dauert die Implementierung von Predictive Analytics?

Die Zeitpläne variieren stark je nach Komplexität des Anwendungsfalls, Datenverfügbarkeit und Reifegrad der Organisation. Ein fokussiertes Pilotprojekt, das auf vorhandenen, sauberen Daten basiert, kann bereits nach 2–3 Monaten erste Ergebnisse liefern. Unternehmensweite Implementierungen, die Aktualisierungen der Dateninfrastruktur, die Integration mehrerer Systeme und ein entsprechendes Change-Management erfordern, können 6–18 Monate dauern. Der Einstieg mit kleineren Projekten beschleunigt den Fortschritt und den Nutzennachweis.

Benötigen Sie ein Data-Science-Team für die Anwendung prädiktiver Analysen?

Nicht unbedingt. Unternehmen haben mehrere Möglichkeiten: Sie können interne Data-Science-Teams für die Entwicklung kundenspezifischer Modelle aufbauen, vorgefertigte Vorhersagefunktionen kommerzieller Softwareplattformen nutzen, mit externen Beratungsunternehmen im Bereich Analytics zusammenarbeiten oder AutoML-Tools einsetzen, die einen Großteil der technischen Komplexität automatisieren. Der richtige Ansatz hängt vom Budget, der Komplexität des Anwendungsfalls, den verfügbaren Fachkräften und der strategischen Bedeutung der Analytics-Funktionen ab.

Den nächsten Schritt nach vorn machen

Prädiktive Analysen wandeln Business Intelligence von einem Rückspiegel in ein zukunftsorientiertes Navigationssystem um. Unternehmen, die diese Fähigkeiten erfolgreich implementieren, erzielen Wettbewerbsvorteile durch frühzeitige Problemerkennung, proaktive Entscheidungsfindung und Ressourcenoptimierung, die reaktive Analysen schlichtweg nicht bieten können.

Der Weg in die Zukunft erfordert nicht, das Unternehmen auf umfassende Analytics-Transformationen zu setzen. Er beginnt damit, hochwertige Anwendungsfälle zu identifizieren, in denen bessere Vorhersagen messbare Ergebnisse liefern, die Datenbereitschaft für diese Anwendungen zu bewerten und gezielte Pilotprojekte durchzuführen, die den Nutzen beweisen, bevor Investitionen skaliert werden.

Der Erfolg hängt von der Ausgewogenheit vierer Elemente ab: einer qualitativ hochwertigen Dateninfrastruktur, analytischen Fähigkeiten und Expertise, geeigneten Technologieplattformen und operativen Prozessen, die Prognosen in konkrete Geschäftsmaßnahmen umsetzen. Organisationen, die eine dieser Säulen vernachlässigen, schränken ihr Potenzial zur Wertschöpfung aus Prognosefähigkeiten ein.

Die Diskrepanz zwischen dem Vergangenen und dem Zukünftigen verdeutlicht den Unterschied zwischen reaktiven und proaktiven Organisationen. Predictive Analytics schließt diese Lücke, indem es historische Daten in zukunftsweisende Erkenntnisse umwandelt, die auf Basis wahrscheinlicher zukünftiger Entwicklungen bessere Entscheidungen ermöglichen.

Sind Sie bereit, sich von rückwärtsgewandten Berichten zu verabschieden? Beginnen Sie damit, eine wichtige Entscheidung zu identifizieren, bei der bessere Prognosen einen messbaren Mehrwert schaffen würden, prüfen Sie, ob ausreichend historische Daten zur Unterstützung der Modellierung vorhanden sind, und entwickeln Sie ein fokussiertes Pilotprojekt, das beweist, dass prädiktive Analysen in Ihrem spezifischen Kontext Ergebnisse liefern können.