Kurzzusammenfassung: Predictive Analytics im Bankwesen nutzt künstliche Intelligenz, maschinelles Lernen und statistische Algorithmen zur Analyse historischer und Echtzeitdaten. Dadurch können Finanzinstitute das Kundenverhalten prognostizieren, Betrug aufdecken, Kreditrisiken bewerten und Dienstleistungen personalisieren. Stand 2024 nutzen bereits 751.000 große Banken und Finanzinstitute KI in irgendeiner Form – im Vergleich zu 531.000 im Jahr 2022. Diese Technologie hilft Banken, Betrug im Wert von Milliardenbeträgen jährlich zu verhindern, Kreditausfälle zu reduzieren und hochgradig personalisierte Kundenerlebnisse zu bieten.

Das Bankwesen ist nicht nur digital geworden. Es ist auch vorausschauend geworden.

Sobald jemand eine Mobile-Banking-App öffnet, um seinen Kontostand zu prüfen, arbeiten Algorithmen im Hintergrund – sie analysieren Ausgabemuster, kennzeichnen ungewöhnliche Transaktionen und prognostizieren sogar, ob der Nutzer zu einem Konkurrenten wechseln könnte. Das ist keine Science-Fiction. Es geschieht bereits jetzt bei allen großen Finanzinstituten.

Laut Daten der Bank of England nutzen bereits 751.030 der im Jahr 2024 befragten Finanzunternehmen KI in irgendeiner Form. Das ist ein deutlicher Anstieg gegenüber 531.030 nur zwei Jahre zuvor im Jahr 2022. Die Nutzung beschränkt sich dabei nicht auf technologieorientierte Startups – alle großen britischen und internationalen Banken, Versicherungen und Vermögensverwalter, die an der Umfrage teilnahmen, berichteten über KI-Implementierungen.

Doch was genau macht prädiktive Analysen so revolutionär für das Bankwesen? Und warum beeilen sich die Institute trotz der Komplexität und der regulatorischen Kontrollen, diese Systeme einzuführen?

Was ist Predictive Analytics im Bankwesen?

Prädiktive Analytik bezeichnet die Anwendung statistischer Algorithmen, Modelle des maschinellen Lernens und künstlicher Intelligenz zur Analyse aktueller und historischer Daten, um zukünftige Entwicklungen vorherzusagen. Im Bankwesen bedeutet dies, riesige Datensätze – Transaktionshistorien, Kundeninteraktionen, Markttrends, Social-Media-Aktivitäten – in handlungsrelevante Erkenntnisse umzuwandeln.

Die Technologie vereint verschiedene Disziplinen. Algorithmen des maschinellen Lernens erkennen Muster, die Menschen entgehen würden. Statistische Modelle quantifizieren Wahrscheinlichkeiten und Risiken. Eine Big-Data-Infrastruktur verarbeitet Informationen in großem Umfang. Gemeinsam ermöglichen diese Komponenten Banken, von reaktiven zu proaktiven Entscheidungen überzugehen.

Aber eines ist klar: Predictive Analytics ist nicht nur ein einzelnes Werkzeug. Es ist ein Ökosystem aus Technologien, die zusammenarbeiten. Ein Betrugserkennungssystem nutzt beispielsweise neuronale Netze, um verdächtige Transaktionen aufzuspüren. Ein Kreditscoring-Modell kombiniert logistische Regression mit Gradient Boosting. Die Vorhersage von Kundenabwanderung basiert häufig auf Ensemble-Methoden, die mehrere Algorithmen miteinander verbinden.

Der Wechsel von traditionellen Analysemethoden zu prädiktiven Systemen stellt einen grundlegenden Wandel in der Arbeitsweise von Banken dar. Traditionelle Business Intelligence zeigt Ihnen, was im letzten Quartal geschah. Prädiktive Analysen zeigen Ihnen, was im nächsten Quartal voraussichtlich passieren wird – und wie Sie darauf reagieren können.

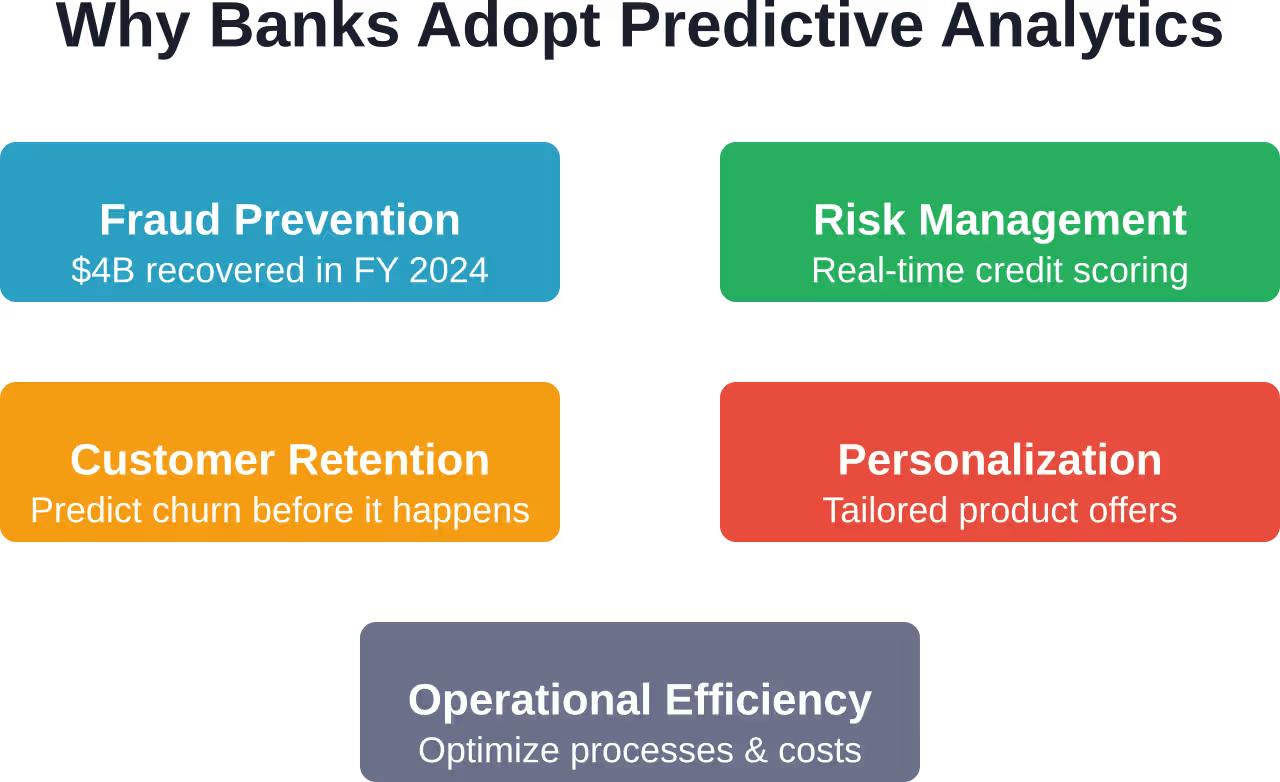

Warum Banken voll auf prädiktive Technologien setzen

Die Finanzdienstleistungsbranche steht unter Druck, der prädiktive Analysen nicht nur nützlich, sondern unerlässlich macht. Betrugsfälle nehmen zu. Die Kundenerwartungen steigen. Die regulatorischen Anforderungen werden strenger. Der Wettbewerb durch Fintech-Startups verschärft sich.

Betrachten wir allein den Betrug. Laut dem Financial Crimes Enforcement Network (FinCEN) gingen zwischen Februar und August 2023 über 15.000 Meldungen zu Scheckbetrug im Zusammenhang mit Postdiebstahl ein, die mit betrügerischen Transaktionen in Höhe von über 1,4 Billionen US-Dollar verbunden waren. Herkömmliche regelbasierte Systeme haben Schwierigkeiten, mit den immer raffinierteren Betrugsmethoden Schritt zu halten.

Prädiktive Modelle bieten einen anderen Ansatz. Anstatt sich auf vorgegebene Regeln zu stützen, lernen Systeme des maschinellen Lernens aus Mustern betrügerischer und legitimer Transaktionen. Sie passen sich an veränderte Betrugstaktiken an. Das US-Finanzministerium berichtete, dass KI-Tools im Fiskaljahr 2024 Betrugsfälle im Wert von 14 Billionen US-Dollar verhindert und zurückerlangt haben, davon 14 Billionen US-Dollar speziell im Zusammenhang mit Scheckbetrug.

Doch die Triebkräfte reichen über die Betrugsprävention hinaus. Banken verfügen über beispiellose Mengen an Kundendaten. Jede Kartenzahlung, jede Interaktion mit der mobilen App, jeder Anruf beim Kundenservice und jeder Filialbesuch generiert Informationen. Die Frage lautet: Wie lassen sich diese Daten in einen Wettbewerbsvorteil verwandeln?

Die Antwort liegt in der prädiktiven Analytik. Sie ermöglicht personalisierte Angebote in großem Umfang, Risikobewertungen in Echtzeit und operative Effizienz, die Kosten senkt und gleichzeitig den Service verbessert.

Kritische Anwendungsfälle zur Transformation des Bankwesens

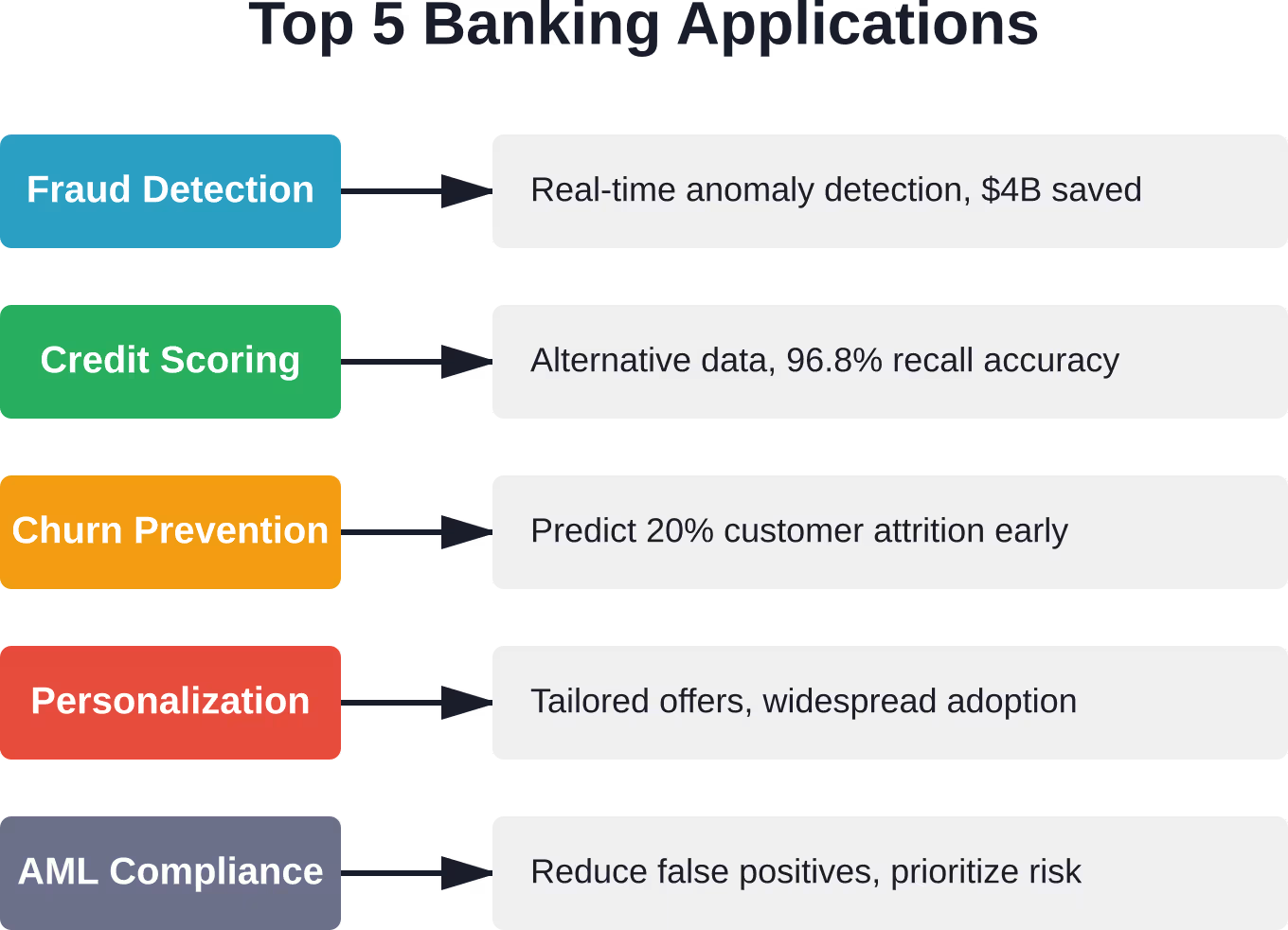

Prädiktive Analysen sind keine Theorie. Banken setzen diese Systeme bereits in ihren Kernfunktionen ein. Schauen wir uns die Anwendungen an, die den größten Mehrwert bieten.

Betrugserkennung, die tatsächlich funktioniert

Herkömmliche Betrugserkennungssysteme basieren auf Regeln. Transaktionen über 14.000 INR, die international erfolgen, werden markiert. Drei Käufe innerhalb von zehn Minuten werden überprüft. Das Problem? Betrüger kennen diese Regeln und entwickeln Angriffe, um sie zu umgehen. Gleichzeitig werden legitime Kunden daran gehindert, Flüge zu buchen oder größere Einkäufe zu tätigen.

Systeme zur prädiktiven Betrugserkennung verfolgen einen anderen Ansatz. Modelle des maschinellen Lernens analysieren Hunderte von Variablen für jede Transaktion – Geräte-Fingerabdrücke, Standortdaten, Transaktionsgeschwindigkeit, Händlerkategorie, historische Muster und sogar das Tipptempo auf Mobilgeräten. Das System sucht nicht nach Regelverstößen, sondern nach Abweichungen vom normalen Verhalten jedes Kunden.

Die Ergebnisse sprechen für sich. Finanzinstitute, die fortschrittliche KI-gestützte Betrugserkennung einsetzen, haben die Anzahl falsch-positiver Ergebnisse drastisch reduziert und gleichzeitig ausgeklügelte Angriffe aufgedeckt, die regelbasierte Systeme völlig übersehen.

Mal ehrlich: Die Technologie ist nicht perfekt. Modelle müssen ständig neu trainiert werden, da sich Betrugsmuster ständig weiterentwickeln. Hinzu kommt die Herausforderung der Erklärbarkeit – Aufsichtsbehörden wollen verstehen, warum eine Transaktion beanstandet wurde, doch komplexe neuronale Netze funktionieren wie Blackboxes. Banken arbeiten an diesem Problem mit hybriden Ansätzen, die Modellgenauigkeit mit regelbasierter Transparenz kombinieren.

Kreditrisikobewertung jenseits der FICO-Scores

Die Kreditwürdigkeitsbewertung stützte sich traditionell auf wenige Faktoren. Die Zahlungshistorie hat mit 35% das größte Gewicht, gefolgt von der Kreditauslastung (30%), der Kreditlaufzeit (15%), den Kreditarten (10%) und den jüngsten Kreditanfragen (10%).

Doch hier liegt die Einschränkung: Diese Faktoren erfassen nur einen Teil des Bildes. Jemand mit einer dünnen Kredithistorie – ein kürzlich eingewanderter Mensch, ein junger Erwachsener, jemand, der sich von einer Insolvenz erholt – kann kreditwürdig sein, schneidet aber nach traditionellen Modellen schlecht ab.

Prädiktive Analysen erweitern den Datensatz. Alternative Datenquellen wie Mietzahlungen, Nebenkostenabrechnungen, Cashflow-Muster, Bildungs- und Beschäftigungsverläufe liefern zusätzliche Hinweise. Modelle des maschinellen Lernens können Zusammenhänge zwischen diesen Variablen und dem Ausfallrisiko identifizieren, die bei herkömmlichen Scoring-Verfahren übersehen werden.

Akademische Forschungen, die neuronale Netze zur Kreditwürdigkeitsprognose einsetzen, haben vielversprechende Ergebnisse erzielt. Eine Studie mit einem Datensatz von 10.000 Einträgen und 14 Merkmalen erreichte eine Trefferquote von 96,81 % (TP3T) und einen AUC-Wert von 0,91. Die Architektur des mehrschichtigen Perzeptrons nutzte 128 bzw. 64 Neuronen in den verborgenen Schichten, um komplexe nichtlineare Zusammenhänge abzubilden.

Die Auswirkungen sind erheblich. Verbesserte Kreditmodelle ermöglichen eine präzisere Risikobewertung. Kreditnehmer, die nach herkömmlichen Bewertungsmethoden abgelehnt oder mit überhöhten Zinsen belegt würden, könnten nun für Standardzinssätze in Frage kommen. Gleichzeitig werden Antragsteller, deren Bonität auf dem Papier gut aussieht, die aber versteckte Risiken bergen, angemessen bewertet.

Kundenabwanderungsprognose und -prävention

Die Gewinnung neuer Bankkunden ist deutlich teurer als die Bindung bestehender. Dennoch bleibt die Kundenabwanderung ein anhaltendes Problem. Branchenzahlen zufolge liegt die Kundenabwanderungsrate im Finanzdienstleistungssektor bei etwa 201 % – jeder fünfte Kunde verlässt das Unternehmen innerhalb eines bestimmten Zeitraums.

Mithilfe von Prognosemodellen können gefährdete Kunden identifiziert werden, bevor sie abwandern. Dieser Ansatz kombiniert verschiedene Datenquellen: Transaktionshäufigkeit, Produktnutzung, Interaktionen mit dem Kundenservice, Nutzung der mobilen App, Wettbewerbsanalysen und sogar die Stimmung in sozialen Medien.

Maschinelle Lernalgorithmen erkennen Muster, die Kundenabwanderung ankündigen. Das kann beispielsweise ein sinkendes Transaktionsvolumen sein. Vielleicht nehmen die Anmeldungen in der mobilen App ab. Oder es könnten vermehrte Kontostandsabfragen darauf hindeuten, dass jemand plant, Geld zu einem anderen Anbieter zu transferieren.

Sobald das Modell gefährdete Kunden identifiziert hat, können Banken eingreifen. Gezielte Kundenbindungsangebote, proaktive Kontaktaufnahme mit dem Kundenservice, personalisierte Produktempfehlungen – was auch immer die Daten als am effektivsten für den jeweiligen Kunden erachten.

Entscheidend ist das Timing. Greift man zu früh ein, werden Ressourcen für Kunden verschwendet, die gar nicht abwandern wollten. Wartet man zu lange, hat der Kunde seine Entscheidung bereits getroffen. Prognosemodelle helfen Banken, den optimalen Zeitpunkt für ein Eingreifen zu finden.

Hochgradig personalisierte Produktempfehlungen

Generisches Marketing hat ausgedient. Kunden erwarten von Banken, dass sie ihre Bedürfnisse verstehen und ihnen zum richtigen Zeitpunkt relevante Angebote unterbreiten.

Prädiktive Analysen ermöglichen diese Personalisierung in großem Umfang. Das System analysiert Transaktionsmuster, um die finanzielle Situation jedes Kunden zu verstehen. Ein Kunde mit regelmäßigen Kinderbetreuungszahlungen könnte sich für Bildungssparkonten interessieren. Jemand, der häufig international reist, könnte von einer Premium-Kreditkarte ohne Gebühren für Auslandstransaktionen profitieren. Ein kürzlich erworbener Hauskäufer benötigt wahrscheinlich Versicherungsprodukte und einen Immobilienkredit.

Große Finanzunternehmen nutzen KI, um den Kundenservice zu verbessern und interne Prozesse zu optimieren – viele dieser Anwendungen beinhalten personalisierte Serviceleistungen und intelligentes Produkt-Matching.

Die ausgefeilte Technologie geht weit über einfache Mustererkennung hinaus. Moderne Systeme nutzen kollaboratives Filtern – sie identifizieren Kunden mit ähnlichen Profilen und empfehlen Produkte, die sich für vergleichbare Nutzer bewährt haben. Sie integrieren Timing-Modelle, die vorhersagen, wann jemand am empfänglichsten für ein Angebot ist. Sie optimieren sogar die Kanalauswahl und ermitteln, ob ein bestimmter Kunde besser auf E-Mails, Benachrichtigungen in mobilen Apps oder Direktmailings reagiert.

Compliance und Geldwäschebekämpfung

Die Einhaltung regulatorischer Vorgaben stellt für Banken einen enormen Kostenfaktor dar. Systeme zur Bekämpfung von Geldwäsche (AML) generieren Tausende von Warnmeldungen, die von den Compliance-Teams manuell geprüft werden müssen. Die meisten erweisen sich als Fehlalarme, doch jede einzelne erfordert Arbeitszeit für die Überprüfung.

Prädiktive Analysen verbessern diesen Prozess auf zweierlei Weise. Erstens reduzieren Modelle des maschinellen Lernens Fehlalarme, indem sie erkennen, wie legitime ungewöhnliche Aktivitäten für jeden Kunden aussehen. Zweitens priorisieren sie Warnmeldungen nach Risikostufe und stellen so sicher, dass sich Compliance-Teams zunächst auf die verdächtigsten Fälle konzentrieren.

Auch die Regulierungsbehörden reagieren. Im Juli 2023 schlug die US-Börsenaufsichtsbehörde (Securities and Exchange Commission) neue Regeln vor, die Broker und Anlageberater verpflichten, Interessenkonflikte im Zusammenhang mit prädiktiver Datenanalyse zu thematisieren.

Diese regulatorische Kontrolle spiegelt sowohl die Macht als auch die Risiken von Prognosesystemen wider. Wenn Algorithmen Entscheidungen treffen, die Kunden betreffen, wollen die Regulierungsbehörden die Gewissheit, dass diese Entscheidungen fair und transparent sind und keine versteckten Interessenkonflikte hervorrufen.

Der Technologie-Stack hinter Predictive Banking

Die Implementierung prädiktiver Analysen erfordert mehr als nur Datenwissenschaftler. Banken benötigen eine vollständige Technologieinfrastruktur, die Daten in großem Umfang erfassen, verarbeiten, analysieren und darauf reagieren kann.

Dateninfrastruktur und Big-Data-Plattformen

Vorhersagemodelle sind nur so gut wie die Daten, mit denen sie trainiert werden. Banken generieren täglich Terabytes an Informationen, doch diese Daten liegen oft in Datensilos – Kernbankensysteme, Kartenverarbeitungsplattformen, mobile Apps, CRM-Systeme, Betrugserkennungstools und mehr.

Moderne Datenplattformen lösen dieses Problem durch zentrale Data Lakes oder Data Warehouses. Diese Systeme aggregieren Informationen aus unterschiedlichen Quellen, bereinigen und normalisieren sie und stellen sie für Analysen bereit. Cloud-Infrastrukturen haben dies deutlich vereinfacht – anstatt riesige eigene Rechenzentren zu errichten, können Banken flexible Rechen- und Speicherkapazitäten von Anbietern nutzen.

Diese Infrastrukturinvestition spiegelt die Rechenleistung wider, die für fortgeschrittene Analysen benötigt wird, wenn Finanzinstitute und andere Branchen ihre KI-Fähigkeiten ausbauen.

Frameworks für maschinelles Lernen und KI

Die eigentlichen Vorhersagemodelle basieren auf Frameworks und Algorithmen des maschinellen Lernens. Gängige Ansätze sind:

- Logistische Regression: Es wird nach wie vor häufig für binäre Klassifizierungsprobleme wie Betrugserkennung oder Ausfallprognose eingesetzt. Es ist einfach, interpretierbar und effektiv für viele Bankanwendungen.

- Random Forests und Gradient Boosting: Ensemble-Methoden, die mehrere Entscheidungsbäume kombinieren. Hervorragend geeignet für strukturierte Daten mit komplexen nichtlinearen Zusammenhängen.

- Neuronale Netze: Deep-Learning-Verfahren, die extrem komplexe Muster erkennen können. Sie werden für Bilderkennung (Scheckbearbeitung), Verarbeitung natürlicher Sprache (Kundenservice) und ausgefeilte Betrugserkennung eingesetzt.

- Support-Vektor-Maschinen: Effektiv geeignet für Klassifizierungsaufgaben mit klaren Abgrenzungen zwischen den Klassen.

Die Wahl des Algorithmus hängt vom Anwendungsfall ab. Betrugserkennung nutzt häufig neuronale Netze aufgrund ihrer Fähigkeit zur Mustererkennung. Bei der Kreditwürdigkeitsbewertung wird oft Gradient Boosting bevorzugt, da es ein ausgewogenes Verhältnis zwischen Genauigkeit und Interpretierbarkeit bietet. Für die Kundensegmentierung können Clustering-Algorithmen wie k-Means zum Einsatz kommen.

Echtzeit-Verarbeitungsfähigkeiten

Viele Banking-Anwendungen benötigen Vorhersagen in Echtzeit oder nahezu Echtzeit. Wenn jemand seine Karte durchzieht, hat das Betrugserkennungssystem nur Millisekunden Zeit, die Transaktion zu prüfen und sie zu genehmigen oder abzulehnen. Eine Stapelverarbeitung über Nacht reicht dafür nicht aus.

Dies erfordert eine Infrastruktur für die Streamverarbeitung – Systeme, die Transaktionen in Echtzeit erfassen, verarbeiten und bewerten können. Technologien wie Apache Kafka für Datenstreaming in Kombination mit Frameworks, die Machine-Learning-Modelle mit geringer Latenz bereitstellen können, machen dies möglich.

Die architektonische Herausforderung ist beträchtlich. Die Modelle müssen ressourcenschonend genug sein, um schnelle Inferenz zu ermöglichen, und gleichzeitig präzise bleiben. Sie müssen Tausende oder Millionen von Vorhersagen pro Sekunde verarbeiten können. Und all dies muss zuverlässig funktionieren, denn Ausfallzeiten verhindern die Verarbeitung von Transaktionen.

Modellsteuerung und -überwachung

Die Implementierung eines Modells in der Produktion ist erst der Anfang. Banken benötigen Systeme, um die Modellperformance zu überwachen, Abweichungen zu erkennen, die Versionsverwaltung zu gewährleisten und die Einhaltung regulatorischer Vorgaben sicherzustellen.

Modelldrift tritt auf, wenn sich die statistischen Eigenschaften der Daten im Laufe der Zeit verändern. Ein Kreditbewertungsmodell, das mit Daten aus der Zeit vor der Pandemie trainiert wurde, kann nach einer Veränderung der wirtschaftlichen Lage schlechtere Ergebnisse liefern. Überwachungssysteme erfassen Leistungskennzahlen und alarmieren die Teams, wenn die Genauigkeit nachlässt.

Die Governance umfasst die Dokumentation der Modellentwicklung, Validierungstests, Bias-Audits und die Berichterstattung an die Aufsichtsbehörden. Fragt eine Aufsichtsbehörde nach den Gründen für die Ablehnung eines bestimmten Kreditantrags, muss die Bank den Entscheidungsprozess des Modells erläutern.

Implementierungsherausforderungen, denen Banken tatsächlich gegenüberstehen

Prädiktive Analysen klingen in der Theorie großartig. Die Umsetzung offenbart jedoch Komplikationen, die in Anbieterpräsentationen oder Konferenzvorträgen nicht zur Sprache kommen.

Datenqualität: Das anhaltende Problem

Maschinelle Lernmodelle benötigen saubere, konsistente und vollständige Daten. Banken verfügen selten darüber. Kundendatensätze können Duplikate enthalten. Transaktionscodes können systemübergreifend inkonsistent sein. Historische Daten können Lücken oder Fehler aufweisen.

Die Datenbereinigung beansprucht in vielen Organisationen 60 bis 801 Tsd. Billionen Pfund an Projektzeit im Bereich Data Science. Bevor mit der Modellierung begonnen werden kann, müssen die Teams Datenqualitätsprobleme identifizieren, diese auf die Quellsysteme zurückführen, Korrekturen implementieren und Prozesse entwickeln, um zukünftige Probleme zu vermeiden.

Hinzu kommt die Herausforderung der Integration. Kundendaten befinden sich im Kernbankensystem. Transaktionsdaten stammen von Kartenprozessoren. Interaktionen mit mobilen Apps werden auf separaten Analyseplattformen erfasst. Webaktivitäten werden über verschiedene Tools verfolgt. All dies zusammenzuführen, erfordert einen erheblichen Entwicklungsaufwand.

Abwägungen zwischen Modellinterpretierbarkeit und Genauigkeit

Die präzisesten Modelle – tiefe neuronale Netze mit Dutzenden von Schichten – funktionieren wie Blackboxes. Sie liefern hervorragende Vorhersagen, können aber nicht erklären, warum.

Aufsichtsbehörden sehen intransparente Systeme nicht gern. Wenn eine Bank einen Kredit ablehnt, verlangen die Gesetze zur fairen Kreditvergabe eine Begründung. “Das neuronale Netzwerk hat Nein gesagt” ist keine akzeptable Antwort.

Das erzeugt einen Konflikt. Optimiert man die Genauigkeit bei komplexen Modellen? Oder priorisiert man die Interpretierbarkeit mit einfacheren Ansätzen, die möglicherweise etwas schlechter abschneiden?

Viele Banken wählen einen Mittelweg. Sie nutzen komplexe Modelle, wenn die Erklärbarkeit nicht entscheidend ist (z. B. für interne Prognosen), und einfachere Modelle für kundenorientierte Entscheidungen (z. B. für Kreditgenehmigungen). Andere Banken setzen auf Hybridansätze: Komplexe Modelle liefern die erste Prognose, anschließend erklären interpretierbare Ebenen die Entscheidung mithilfe einfacherer Logik.

Fachkräftemangel im Bereich Finanz-KI

Der Aufbau und die Wartung von Systemen für prädiktive Analysen erfordern spezielle Kenntnisse. Datenwissenschaftler, die sowohl maschinelles Lernen als auch Finanzdienstleistungen verstehen, sind rar.

Laut Daten der US-Notenbank Federal Reserve (Fed) werden in rund 101.030 Stellenanzeigen im Finanzsektor KI-Kenntnisse erwähnt. Das ist zwar mehr als der branchenübergreifende Durchschnitt von 51.030 Stellenanzeigen, deutet aber dennoch auf einen angespannten Arbeitsmarkt hin. Zum Vergleich: Im Informationssektor werden KI-Kenntnisse in etwa 201.030 Stellenanzeigen genannt.

Banken konkurrieren um diese Talente mit Technologieunternehmen, die oft bessere Vergütungen, interessantere Aufgaben und weniger regulatorische Auflagen bieten. Die Folge? Schwierigkeiten bei der Personalbeschaffung und -bindung.

Manche Institutionen begegnen diesem Problem durch Partnerschaften mit Fintech-Unternehmen oder Cloud-Anbietern, die Managed AI Services anbieten. Andere investieren massiv in die Weiterbildung ihrer Mitarbeiter. Keiner dieser Ansätze löst das Problem jedoch vollständig.

Komplexität der Einhaltung regulatorischer Bestimmungen

Der Finanzdienstleistungssektor zählt zu den am stärksten regulierten Branchen. Jedes Prognosemodell muss den Gesetzen für faire Kreditvergabe, den Verbraucherschutzbestimmungen, den Datenschutzanforderungen und den Risikomanagementstandards entsprechen.

Die 2023 von der SEC vorgeschlagenen Regeln zu Interessenkonflikten bei prädiktiven Datenanalysen deuten auf eine verstärkte Kontrolle hin. Die Aufsichtsbehörden befürchten, dass Algorithmen die Rentabilität von Banken auf Kosten der Kunden optimieren könnten – und somit Produkte empfehlen, die hohe Gebühren verursachen, anstatt Produkte, die den Kundenbedürfnissen optimal entsprechen.

Die Bank für Internationalen Zahlungsausgleich (BIZ) hat auf Bedenken hinsichtlich der Finanzstabilität im Zusammenhang mit der Einführung von KI hingewiesen. Wenn viele Institutionen ähnliche Modelle verwenden, die mit ähnlichen Daten trainiert wurden, besteht die Gefahr von Herdenverhalten – alle treffen gleichzeitig dieselben Entscheidungen, was die Marktvolatilität potenziell verstärkt.

Die Navigation durch dieses regulatorische Umfeld erfordert einen kontinuierlichen Dialog mit den Regulierungsbehörden, solide Governance-Prozesse und manchmal die Akzeptanz, dass das profitabelste Modell nicht unbedingt das konformste ist.

Integration von Altsystemen

Die meisten Banken nutzen eine über Jahrzehnte aufgebaute Technologieinfrastruktur. Kernbankensysteme laufen oft auf Großrechnern. Verschiedene Geschäftsbereiche verwenden inkompatible Plattformen. Moderne prädiktive Analysen müssen sich daher in all diese Systeme integrieren lassen.

API-Entwicklung, Middleware, Datentransformationsschichten – diese Integrationsprojekte können länger dauern als die Entwicklung der Modelle selbst. Die Herausforderung liegt nicht im maschinellen Lernen, sondern darin, die Vorhersagen des Modells in die Systeme zu integrieren, in denen sie benötigt werden, und sicherzustellen, dass diese Systeme die Empfehlungen umsetzen können.

Manche Banken begegnen diesem Problem mit einer schrittweisen Modernisierung, indem sie neue Funktionen parallel zu den bestehenden Systemen aufbauen. Andere setzen auf einen kompletten Plattformwechsel, der mit enormen Risiken und Kosten verbunden ist. Eine einfache Lösung gibt es nicht.

| Herausforderung | Auswirkungsniveau | Primäre Minderungsstrategie |

|---|---|---|

| Datenqualitätsprobleme | Hoch | Spezielle Daten-Governance-Programme und automatisierte Validierung |

| Interpretierbarkeit des Modells | Hoch | Hybride Ansätze, die Genauigkeit mit Erklärbarkeitsebenen kombinieren |

| Talentmangel | Medium | Partnerschaften mit Anbietern, interne Schulungsprogramme |

| Einhaltung gesetzlicher Vorschriften | Hoch | Solide Unternehmensführung, regelmäßige Prüfungen, Einbindung der Aufsichtsbehörden |

| Legacy-Integration | Medium | API-First-Architektur, schrittweise Modernisierung |

| Modelldrift | Medium | Kontinuierliche Überwachung, automatisierte Umschulungsprozesse |

Der Evolutionspfad: Wohin führt Predictive Banking?

Der aktuelle Stand der prädiktiven Analytik im Bankwesen ist beeindruckend. Die Entwicklung lässt auf noch bedeutendere Veränderungen in der Zukunft schließen.

Grundlagenmodelle und generative KI

Foundation-Modelle und generative KI-Systeme sind aufstrebende Anwendungen im Bankwesen. Dabei handelt es sich um große Sprachmodelle, die die öffentliche Aufmerksamkeit auf sich gezogen haben.

Foundation-Modelle könnten den Kundenservice durch natürlichere Dialogschnittstellen revolutionieren. Sie könnten die Betrugserkennung verbessern, indem sie unstrukturierte Daten wie Kunden-E-Mails oder Social-Media-Beiträge analysieren. Sie könnten Compliance-Teams unterstützen, indem sie Verträge und behördliche Dokumente automatisch prüfen.

Doch sie bergen auch neue Risiken. Große Sprachmodelle können Halluzinationen erzeugen – plausibel klingende, aber falsche Informationen generieren. Sie benötigen enorme Rechenressourcen. Und ihre Entscheidungsprozesse sind noch weniger transparent als die traditioneller neuronaler Netze.

Die Banken gehen vorsichtig vor. Pilotprojekte testen die Leistungsfähigkeit, während Risikomanagementteams mögliche Nachteile bewerten. Die Einführung dürfte angesichts der damit verbundenen betrieblichen und regulatorischen Komplexität schrittweise erfolgen.

Föderiertes Lernen für datenschutzfreundliche Analysen

Datenschutzbestimmungen wie die DSGVO schränken ein, wie Banken Kundendaten weitergeben dürfen. Gemeinsame Analysen könnten die Betrugserkennung jedoch verbessern – wenn zehn Banken ihre Betrugsdaten bündeln würden, wären die Modelle deutlich robuster.

Föderiertes Lernen bietet eine mögliche Lösung. Anstatt Daten auszutauschen, teilen Institutionen Modellaktualisierungen. Jede Bank trainiert ein Modell mit ihren lokalen Daten und teilt anschließend nur die gelernten Parameter. Ein zentrales System aggregiert diese Aktualisierungen, um ein globales Modell zu verbessern, ohne jemals die zugrunde liegenden Kundendaten einzusehen.

Diese Technologie befindet sich noch in der Entwicklung, aber Pilotprojekte im Finanzdienstleistungssektor laufen bereits. Bei Erfolg könnte sie die Zusammenarbeit ermöglichen und gleichzeitig Datenschutz und die Einhaltung gesetzlicher Bestimmungen gewährleisten.

Integrierte Analytik in jedem Bankprozess

Aktuell wird prädiktive Analytik oft als separate Funktion betrieben – das Data-Science-Team erstellt Modelle und übergibt diese dann an die Geschäftsbereiche. Zukünftig wird Analytik direkt in jeden Prozess integriert.

Kreditsachbearbeiter würden Risikobewertungen in Echtzeit direkt in ihren Antragsbearbeitungssystemen einsehen können. Filialmitarbeiter würden während des Kundengesprächs Handlungsempfehlungen erhalten. Treasury-Teams würden kontinuierlich aktualisierte, automatisierte Cashflow-Prognosen erhalten.

Dies erfordert eine engere Verzahnung von Analyse- und Betriebssystemen. Es bedarf Benutzeroberflächen, die Vorhersagen kontextbezogen darstellen, anstatt separate Analyse-Dashboards zu benötigen. Und es bedarf eines effektiven Veränderungsmanagements, damit die Mitarbeiter den algorithmischen Empfehlungen vertrauen und entsprechend handeln.

Vorausschauende Regulierung und Compliance

Auch die Aufsichtsbehörden selbst beginnen, prädiktive Analysen für die Aufsicht einzusetzen. Anstelle planmäßiger Prüfungen könnten Aufsichtssysteme Institute, die frühzeitig Warnsignale für Probleme aufweisen, kennzeichnen.

Dies führt zu einer interessanten Dynamik. Banken nutzen Prognosemodelle, um regulatorische Vorgaben zu erfüllen. Aufsichtsbehörden nutzen Prognosemodelle, um Banken zu überwachen. Das Zusammenspiel dieser Systeme wird die zukünftige Regulierungslandschaft prägen.

Einige Szenarien, die man im Auge behalten sollte: automatisierte Compliance-Berichterstattung, bei der die Systeme der Banken direkt mit den Überwachungsplattformen der Aufsichtsbehörden synchronisiert werden; Modellregister, die jeden Algorithmus dokumentieren, der bei kundenorientierten Entscheidungen zum Einsatz kommt; und Stresstests, die die Leistungsfähigkeit von KI-Systemen unter widrigen Bedingungen umfassen.

Erste Schritte: Praktische Schritte für Banken

Für Institutionen, die prädiktive Analysefähigkeiten implementieren oder erweitern möchten, erfordert der Weg nach vorn eine sorgfältige Planung.

Beginnen Sie mit hochwertigen, unkomplizierten Anwendungsfällen.

Beginnen Sie nicht mit den schwierigsten Problemen. Identifizieren Sie Anwendungsfälle, in denen prädiktive Analysen einen klaren Mehrwert bieten können, ohne dass vollständige Systemüberarbeitungen erforderlich sind.

Betrugserkennung eignet sich oft gut als Einstiegsprojekt. Die Daten sind vorhanden, der Business Case ist klar, und Verbesserungen zeigen sofort messbare Wirkung. Kundensegmentierung für Marketingzwecke ist ein weiterer guter Ausgangspunkt – wertvolle Erkenntnisse, ohne die zentralen Transaktionssysteme anzutasten.

Schaffen Sie Erfolgsgeschichten. Frühe Erfolge sichern die Unterstützung der Führungsebene und schaffen organisatorische Dynamik für spätere, ambitioniertere Projekte.

Investieren Sie zuerst in die Dateninfrastruktur.

Wenn man vorschnell Modelle entwickelt, bevor die Dateninfrastruktur bereit ist, führt das zu Frustration. Teams verbringen Monate damit, sich mit der Datenintegration herumzuschlagen, anstatt Analysen zu entwickeln.

Priorisieren Sie Programme zur Datenqualitätssicherung, etablieren Sie Governance-Prozesse und entwickeln Sie die Infrastruktur, die den Zugriff auf saubere Daten ermöglicht. Diese grundlegende Arbeit ist zwar nicht glamourös, aber unerlässlich.

Ziehen Sie Cloud-Plattformen in Betracht, die Managed Data Services anbieten. Der Eigenaufbau ist für große Institute mit umfangreichen IT-Ressourcen geeignet. Kleinere Banken profitieren oft von Anbieterlösungen, die die Infrastrukturkomplexität bewältigen.

Stellen Sie Teams mit Fachkompetenz zusammen

Data Scientists müssen nicht nur Algorithmen, sondern auch Bankwesen verstehen. Ein Betrugserkennungsmodell, das von jemandem entwickelt wurde, der keine Ahnung von Zahlungsabwicklung hat, wird entscheidende Nuancen übersehen.

Entweder man stellt Mitarbeiter ein, die über beide Kompetenzbereiche verfügen, oder man bildet Teams, die Expertise im Bereich Data Science mit fundiertem Bankwissen verbinden. Die Zusammenarbeit dieser Rollen führt zu besseren Ergebnissen als die Arbeit in Einzelpositionen.

Auch Weiterbildung ist wichtig. Investieren Sie in Programme, die Datenwissenschaftlern Finanzdienstleistungen und Bankfachleuten Datenanalyse beibringen. Bereichsübergreifendes Verständnis verbessert die Ergebnisse.

Frühzeitige Etablierung von Governance-Strukturen

Modell-Governance ist keine nachträgliche Ergänzung. Sie muss von Anfang an in den Entwicklungsprozess integriert werden.

Dokumentieren Sie alles – Datenquellen, Modellarchitektur, Trainingsverfahren, Validierungstests, Leistungskennzahlen und bekannte Einschränkungen. Eine umfassende Dokumentation erleichtert die Einhaltung der Vorschriften, wenn Aufsichtsbehörden Fragen stellen.

Implementieren Sie Prüfprozesse. Modelle sollten von Teams validiert werden, die unabhängig von den Entwicklern sind. Bias-Audits sollten diskriminierende Ergebnisse aufdecken. Risikobewertungen sollten die Folgen eines Modellversagens evaluieren.

Plan für kontinuierliche Verbesserung

Die Implementierung eines Modells ist nicht das Ende. Sie ist der Beginn eines fortlaufenden Zyklus aus Überwachung, Bewertung und Optimierung.

Entwickeln Sie Systeme, die die Modellleistung im Produktivbetrieb überwachen. Legen Sie Schwellenwerte fest, die Überprüfungen auslösen, sobald die Genauigkeit nachlässt. Erstellen Sie Trainingspläne, die die Modelle bei sich ändernden Datenverteilungen aktuell halten.

Richten Sie Feedbackschleifen ein, damit Anwender aus dem Fachbereich melden können, wenn Modellvorhersagen fehlerhaft erscheinen. Ihr Fachwissen deckt oft Probleme auf, die von der automatisierten Überwachung übersehen werden.

Nutzen Sie prädiktive Analysen zur Erkennung von Bankrisiken und Betrug.

Betrugsmuster verändern sich, das Kundenverhalten ändert sich und Risiken bauen sich auf, bevor sie in Berichten sichtbar werden. AI Superior Das Unternehmen entwickelt maßgeschneiderte KI-Software mit prädiktiver Analytik, die Banken bei der Analyse von Finanz- und Verhaltensdaten, der Prognose möglicher Ergebnisse und der Entscheidungsfindung in den Bereichen Betrugserkennung, Risikobewertung und kundenbezogene Prozesse unterstützt. Der Ansatz kombiniert historische und Echtzeitdaten, um die Entwicklung von Finanzaktivitäten im Zeitverlauf abzubilden.

Anwendung prädiktiver Analysen bei täglichen Bankentscheidungen

AI Superior hilft Ihnen dabei:

- Arbeiten Sie mit Risikomustern, bevor sie sich vollständig entwickeln

- Treffen Sie Entscheidungen auf Grundlage sich ständig ändernder Kunden- und Transaktionsdaten.

- Nutzen Sie prädiktive Modelle innerhalb laufender Bankprozesse

Um zu sehen, wie prädiktive Analysen in Ihren Bankprozessen angewendet werden können, Kontaktieren Sie AI Superior und erläutern Sie Ihren Anwendungsfall.

Häufig gestellte Fragen

Worin besteht der Unterschied zwischen prädiktiver Analytik und traditioneller Business Intelligence im Bankwesen?

Traditionelle Business Intelligence blickt zurück und analysiert historische Daten, um zu verstehen, was passiert ist und warum. Dashboards zeigen beispielsweise das Kreditvolumen des letzten Quartals oder die monatlichen Betrugsverluste. Predictive Analytics hingegen blickt nach vorn und nutzt historische Muster, um zukünftige Entwicklungen vorherzusagen. Anstatt lediglich zu berichten, dass der Betrug im letzten Monat um 101.000 US-Dollar gestiegen ist, identifizieren prädiktive Systeme potenziell betrügerische Transaktionen, bevor diese genehmigt werden. Der Wandel geht von der Beschreibung zur Vorgabe – von der Ergebnisberichterstattung hin zur gezielten Gestaltung der Ergebnisse.

Wie genau sind Vorhersagemodelle für die Kreditwürdigkeitsbewertung im Vergleich zu den traditionellen FICO-Scores?

Die Genauigkeit hängt von der Implementierung ab, doch Studien belegen, dass Modelle des maschinellen Lernens beeindruckende Ergebnisse erzielen können. Untersuchungen, die neuronale Netze zur Kreditwürdigkeitsprognose einsetzen, berichten von Trefferquoten von bis zu 96,81³T bei AUC-Werten von 0,91. Die verwendeten Datensätze umfassten 14 Merkmale und 10.000 Einträge. Diese Modelle übertreffen häufig traditionelle Scoring-Verfahren, insbesondere bei Personen mit wenigen Kreditakten, da sie alternative Datenquellen einbeziehen können. Die Verbesserung variiert jedoch je nach Anwendungsfall und Datenqualität. Traditionelle Scoring-Verfahren bleiben aufgrund ihrer Standardisierung und regulatorischen Akzeptanz weiterhin wertvoll.

Welche regulatorischen Hauptbedenken bestehen im Zusammenhang mit KI im Bankwesen?

Die Regulierungsbehörden konzentrieren sich auf mehrere Kernpunkte. Erstens: Fairness und Voreingenommenheit – Algorithmen dürfen nicht aufgrund geschützter Merkmale diskriminieren. Zweitens: Transparenz und Nachvollziehbarkeit – Banken müssen die Entscheidungen von KI-Systemen, insbesondere bei Kreditablehnungen, erläutern. Drittens: Interessenkonflikte – die von der SEC für 2023 vorgeschlagenen Regeln gehen speziell auf Bedenken ein, dass prädiktive Analysen eher die Rentabilität des Unternehmens als den Kundennutzen optimieren könnten. Viertens: Systemisches Risiko – wenn viele Institute ähnliche Modelle verwenden, könnten korrelierte Verhaltensweisen die Risiken für die Finanzstabilität verstärken. Schließlich: Operative Resilienz – KI-Systeme müssen robust, sicher und im Fehlerfall wiederherstellbar sein.

Wie lange dauert die Implementierung eines Predictive-Analytics-Systems in einer Bank im Durchschnitt?

Die Implementierungszeiten variieren je nach Umfang und Komplexität erheblich. Ein fokussierter Anwendungsfall wie die Betrugserkennung für einen bestimmten Zahlungskanal kann von Projektbeginn bis zur Produktionsbereitstellung 3–6 Monate dauern. Unternehmensweite Implementierungen, die mehrere Systeme und Prozesse betreffen, benötigen oft 12–24 Monate oder länger. Die zeitaufwendigsten Phasen sind in der Regel die Datenintegration und der Infrastrukturaufbau, nicht die Modellentwicklung selbst. Banken mit ausgereiften Datenplattformen und Governance-Prozessen sind schneller als solche, die die Grundlagen von Grund auf neu aufbauen.

Können auch kleine und mittelständische Banken prädiktive Analysen einsetzen, oder ist das nur für große Institute praktikabel?

Auch kleinere Institute können Predictive Analytics einsetzen, allerdings unterscheidet sich der Ansatz von dem großer Banken. Cloudbasierte Plattformen und Lösungen von Drittanbietern haben den Zugang zu fortschrittlichen Analysefunktionen demokratisiert. Anstatt alles selbst zu entwickeln, können kleinere Banken Managed Services nutzen, die vorgefertigte Modelle für gängige Anwendungsfälle wie Betrugserkennung oder Kundenabwanderungsprognosen bereitstellen. Der Schlüssel liegt darin, mit gezielten Anwendungen zu beginnen, die einen klaren ROI liefern, anstatt eine umfassende Transformation anzustreben. Viele Fintech-Partnerschaften und Banking-as-a-Service-Plattformen bieten mittlerweile integrierte Analysen an, wodurch anspruchsvolle Funktionen unabhängig von der Institutsgröße zugänglich werden.

Welche Qualifikationen benötigen Banken bei der Einstellung von Mitarbeitern, um Fähigkeiten im Bereich prädiktiver Analysen aufzubauen?

Erfolgreiche Teams für prädiktive Analysen vereinen vielfältige Kompetenzen. Data Scientists bringen Expertise in Statistik, Algorithmen des maschinellen Lernens und Programmiersprachen wie Python oder R ein. Data Engineers entwickeln die Infrastruktur für die Erfassung, Bereinigung und Verarbeitung von Daten in großem Umfang. ML-Ingenieure sind auf die Implementierung und Wartung von Modellen in Produktionssystemen spezialisiert. Experten aus dem Bankwesen stellen sicher, dass die Modelle reale Geschäftsprobleme lösen und regulatorischen Vorgaben entsprechen. Produktmanager übersetzen Geschäftsanforderungen in analytische Anforderungen. Laut Daten der Federal Reserve erwähnen mittlerweile rund 101.300 Stellenanzeigen im Finanzsektor KI-bezogene Kompetenzen, was die wachsende Nachfrage nach diesen Fähigkeiten widerspiegelt.

Wie gehen Banken mit dem Black-Box-Problem komplexer KI-Modelle um?

Banken nutzen verschiedene Strategien, um Modellgenauigkeit und Nachvollziehbarkeit in Einklang zu bringen. Einige setzen Hybridarchitekturen ein, bei denen ein komplexes neuronales Netzwerk die erste Vorhersage trifft und ein einfacheres, interpretierbares Modell diese Entscheidung anschließend in verständlicher Form approximiert. Andere verwenden SHAP-Werte oder LIME-Techniken, die einzelne Vorhersagen erklären, indem sie aufzeigen, welche Merkmale am stärksten zum Ergebnis beigetragen haben. Bei kundenorientierten Entscheidungen wie der Kreditvergabe bevorzugen viele Institute inhärent interpretierbare Modelle wie logistische Regression oder Entscheidungsbäume und akzeptieren eine etwas geringere Genauigkeit, um regulatorische Vorgaben zu erfüllen. Modelldokumentation, Validierungstests und Bias-Audits sorgen für zusätzliche Transparenz und helfen, Bedenken der Aufsichtsbehörden auszuräumen, selbst wenn die zugrunde liegenden Algorithmen komplex sind.

Das Wettbewerbsgebot

Prädiktive Analysen haben sich von experimentellen zu unverzichtbaren Technologien entwickelt. Die Kluft zwischen Institutionen, die diese Möglichkeiten effektiv nutzen, und solchen, die dies nicht tun, wird sich weiter vergrößern.

Banken, die sich durch prädiktive Analysen auszeichnen, werden durch Personalisierung ein besseres Kundenerlebnis bieten. Sie werden Risiken durch die frühzeitige Erkennung von Problemen effektiver managen. Sie werden effizienter arbeiten, indem sie Entscheidungen automatisieren, die derzeit noch manuell geprüft werden müssen. Und sie werden Betrug erfolgreicher verhindern, indem sie sich schneller anpassen als Kriminelle.

Die Technologie entwickelt sich stetig weiter. Fundamentale Modelle, föderiertes Lernen, eingebettete Analytik – diese Fortschritte erweitern die Möglichkeiten. Doch die Grundlagen bleiben unverändert: saubere Daten, geeignete Algorithmen, solide Governance und Teams mit Expertise in Bankwesen und Analytik.

Für Finanzinstitute stellt sich nicht die Frage, ob sie in Predictive Analytics investieren sollen. Die hohe Verbreitung von 75% bei großen Unternehmen zeigt deutlich, dass dieses Thema bereits abgeschlossen ist. Die Frage ist vielmehr, wie schnell und effektiv diese Fähigkeiten implementiert werden können, bevor der Wettbewerbsnachteil unüberwindbar wird.

Die Banken, die diesen Weg vor Jahren eingeschlagen haben, verzeichnen bereits Erfolge – Milliardenerträge durch Betrugsprävention, geringere Kreditausfälle, verbesserte Kundenbindung und operative Effizienz. Diejenigen, die erst jetzt damit beginnen, stehen vor großen Herausforderungen, doch der Weg ist vielversprechend.

Beginnen Sie mit klaren Anwendungsfällen. Schaffen Sie eine solide Datengrundlage. Stellen Sie die richtigen Talente ein oder arbeiten Sie mit den passenden Anbietern zusammen. Etablieren Sie eine Governance, die den regulatorischen Anforderungen entspricht. Überwachen, messen und verbessern Sie kontinuierlich.

Die Zukunft des Bankwesens, geprägt von vorausschauender Planung, ist da. Jetzt ist es an der Zeit, die Fähigkeiten aufzubauen, die den Erfolg in dieser Zukunft bestimmen werden.