Kurzzusammenfassung: Private LLM-Evaluierungsdienste kosten in der Regel zwischen 1.249 und über 10.000 PKR monatlich für Plattformen, während individuelle Evaluierungsprojekte je nach Umfang zwischen 125.000 und 820.000 PKR jährlich liegen. Die Kosten hängen von der Modellgröße, den Infrastrukturanforderungen, der Expertise des Teams und der Komplexität der Implementierung ab. Es gibt zwar Open-Source-Evaluierungstools, doch die Betriebskosten für Hosting, Personal und Wartung übersteigen oft die Abonnementgebühren der Plattformen.

Der übereilte Einsatz großer, privater Sprachmodelle hat vielen Organisationen eine schmerzhafte Erkenntnis beschert: Die Entwicklung des Modells ist erst der Anfang. Die Evaluierung seiner Funktionsfähigkeit? Genau da wird es teuer.

Im Gegensatz zu öffentlichen API-basierten Modellen, deren Evaluierung durch einfaches Benchmarking erfolgen kann, erfordern private LLMs rigorose, kontinuierliche Tests, die proprietäre Daten, kundenspezifische Anwendungsfälle und unternehmensweite Sicherheitsanforderungen berücksichtigen. Allein die Evaluierungsinfrastruktur kann die Hostingkosten der Modelle selbst erreichen oder sogar übersteigen.

Die unangenehme Wahrheit ist: Unternehmen unterschätzen die Evaluierungskosten systematisch um 40 bis 60¹³T. Sie budgetieren für Hardware und Ingenieure, vergessen aber die Infrastruktur für kontinuierliches Testen, Red-Teaming-Spezialisten und den operativen Aufwand für die Wartung von Evaluierungspipelines, die tausendfach pro Monat ausgeführt werden.

Diese Aufschlüsselung umfasst die Plattformpreise, Infrastrukturkosten, Personalkosten und die versteckten Betriebskosten, die aus einer “erschwinglichen” Open-Source-Evaluierung eine jährliche Investition im sechsstelligen Bereich machen.

Private LLM-Bewertung verstehen: Wofür Sie tatsächlich bezahlen

Die private Evaluierung von LLM-Modellen beschränkt sich nicht darauf, ein Modell anhand einer Benchmark-Suite zu testen und die Sache damit abzuschließen. Es handelt sich um einen kontinuierlichen Prozess, der mehrere Dimensionen umfasst.

Der Evaluierungsprozess umfasst Genauigkeitstests, Sicherheitslückenanalysen, Leistungsoptimierung, Erkennung von Verzerrungen und die Überprüfung der Einhaltung gesetzlicher Bestimmungen. Jede Dimension erfordert unterschiedliche Werkzeuge, Datensätze und Fachkenntnisse. Einige Organisationen versuchen, Open-Source-Lösungen zu kombinieren. Andere erwerben Plattformen. Die meisten entscheiden sich letztendlich für eine Hybridlösung, die teurer ist als die einzelnen Ansätze.

Die wichtigsten Kostentreiber

Die Evaluierungsinfrastruktur gliedert sich in mehrere Kostenstellen. Plattformabonnements oder Lizenzgebühren bilden die sichtbare Basis. Infrastrukturkosten für die Durchführung von Evaluierungen in großem Umfang stellen eine weitere Kostenstelle dar. Hinzu kommen die Personalkosten – für ML-Ingenieure, Evaluierungsspezialisten und Fachexperten, die Tests entwickeln und Ergebnisse interpretieren.

Vergessen Sie nicht die Datenkosten. Individuelle Evaluierungsdatensätze, ob von Anbietern lizenziert oder intern erstellt, stellen eine erhebliche Investition dar. Laut dem Center for AI Standards and Innovation (CAISI) des NIST erfordert die Entwicklung von KI-Systemen auf höchstem Niveau eine KI-Messtechnik auf höchstem Niveau – und diese ist nicht billig.

Das letzte Puzzleteil? Integrations- und Wartungsaufwand. Evaluierungspipelines müssen mit bestehenden MLOps-Workflows, Versionskontrollsystemen und Monitoring-Plattformen verbunden werden. Diese Integrationsarbeit taucht in den ersten Kostenschätzungen selten auf, verschlingt aber regelmäßig 20 bis 301 TP3T des Evaluierungsbudgets.

Plattformbasierte Evaluierungsdienste: Preisvergleich

Managed-Evaluierungsplattformen bieten den schnellsten Weg zu umfassenden Tests. Die Preise variieren jedoch stark je nach Funktionen, Umfang und Positionierung des Anbieters.

Auf Basis der verfügbaren Daten aus den Jahren 2025-2026 sieht der Markt folgendermaßen aus:

| Plattformebene | Monatliche Kosten | Hauptmerkmale | Am besten geeignet für |

|---|---|---|---|

| Einstiegspunkt (z. B. Braintrust Pro) | $249 | Unbegrenzte Spuren, 5 GB verarbeitete Daten, 50.000 Ergebnisse | Kleine Teams, Produkte in der Frühphase |

| Mittleres Preisniveau | $1,500-$3,500 | Erweiterte Analysen, benutzerdefinierte Benchmarks, Teamzusammenarbeit | Wachsende Produkte mit mäßigem Verkehrsaufkommen |

| Unternehmen | $5,000-$10,000+ | Lokale Bereitstellung, dedizierter Support, unbegrenzte Skalierbarkeit | Große Organisationen, regulierte Branchen |

| Kundenspezifisch/Weißlabel | $15,000+ | Vollständige Anpassungsmöglichkeiten, dedizierte Infrastruktur, SLA-Garantien | Fortune-500-Unternehmen, Regierungsbehörden |

Die Daten zur Preisstruktur von Braintrust zeigen, dass Kunden laut Braintrust innerhalb weniger Wochen nach der Einführung regelmäßig Genauigkeitsverbesserungen von mindestens 301 TP3T berichten. Ein solcher Leistungszuwachs rechtfertigt die Plattformkosten – insbesondere, wenn die Alternative darin bestünde, fehlerhafte KI-Funktionen in der Produktion einzusetzen.

Giskard bietet sowohl Open-Source- als auch Enterprise-Lösungen an. Die Open-Source-Bibliothek ist kostenlos, erfordert jedoch Selbsthosting und technisches Know-how. Die Enterprise-Plattform ermöglicht kontinuierliches KI-Red-Teaming und RAG-Evaluierung mit verwalteter Infrastruktur; konkrete Preisinformationen werden jedoch nicht veröffentlicht.

Was die Plattformgebühren tatsächlich abdecken

Plattformabonnements beinhalten typischerweise das Evaluierungsframework selbst, vorgefertigte Benchmark-Suites, Hosting für die Testausführung, Dashboards zur Ergebnisanalyse und einen gewissen Support.

Was nicht abgedeckt ist? Die Rechenkosten für die Ausführung Ihrer Modelle während der Evaluierung. Die Erstellung benutzerdefinierter Datensätze. Der Entwicklungsaufwand für die Integration der Plattform in Ihren Workflow. Die Schulung Ihres Teams zur effektiven Nutzung.

Viele Plattformen berechnen ihre Gebühren anhand des verarbeiteten Datenvolumens oder der Anzahl der Testläufe. Der Einstiegstarif von $249/Monat klingt zunächst angemessen, bis man monatlich 100 GB Testdaten verarbeitet und plötzlich den Enterprise-Tarif benötigt.

Infrastrukturkosten für selbstgehostete Evaluierung

Manche Teams entscheiden sich dafür, ihre Evaluierungsinfrastruktur mithilfe von Open-Source-Tools wie Lighteval oder den Evaluierungsbibliotheken von Hugging Face aufzubauen. Die Software selbst ist kostenlos. Alles andere ist kostenpflichtig.

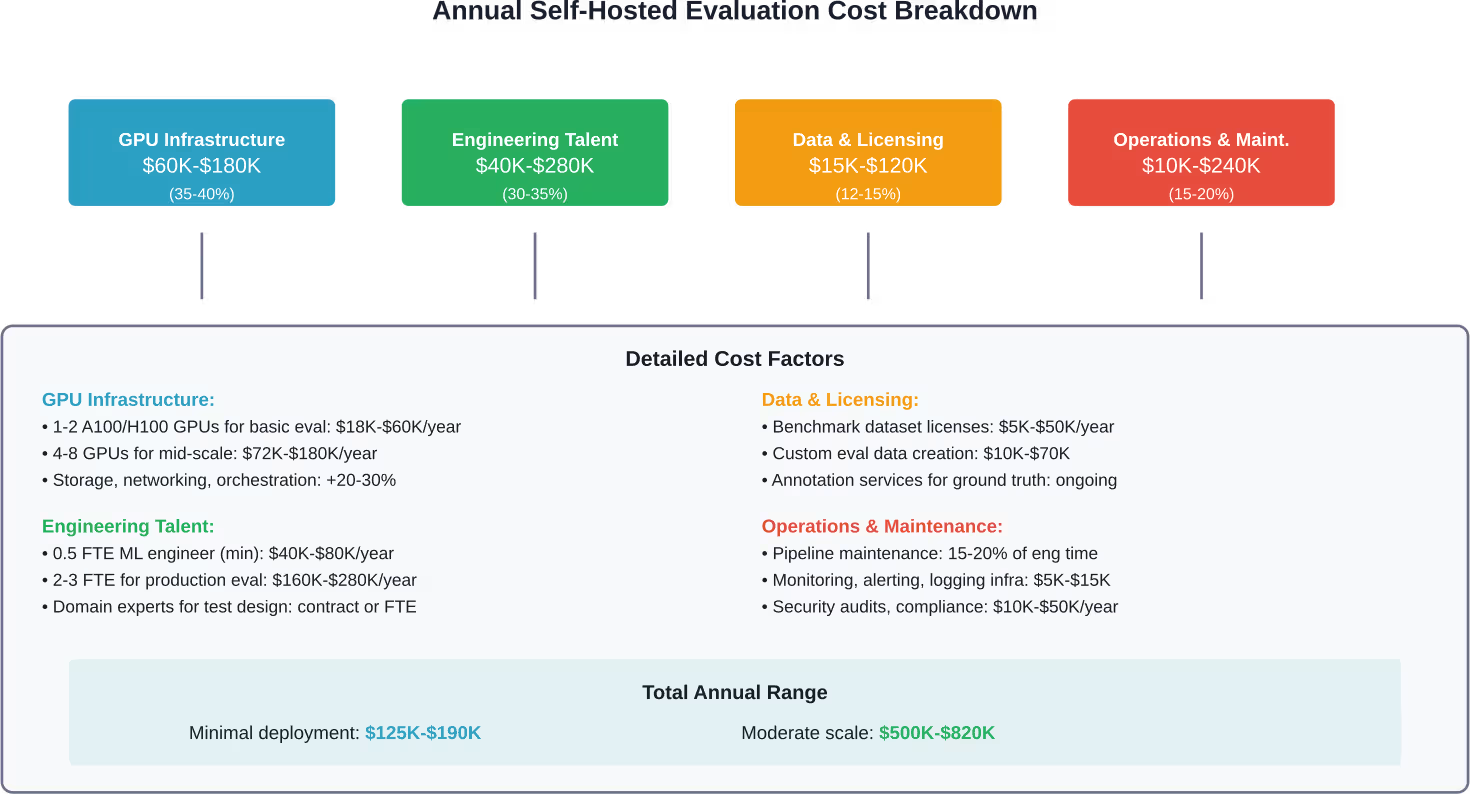

Selbst eine minimale interne Implementierung kann jährlich 125.000 bis 190.000 Tsd. ...

Folgendes beeinflusst diese Zahlen:

GPU- und Rechenanforderungen

Die Durchführung von Evaluierungen bedeutet, Modelle wiederholt anhand von Testdatensätzen auszuführen. Für ein Modell mit 7 bis 13 Milliarden Parametern bewältigt eine einzelne A100- oder H100-GPU die grundlegenden Evaluierungsaufgaben. Die monatlichen Kosten für Cloud-GPUs dieser Stufe liegen bei etwa 1.500 bis 5.000 Tsd.

Skalierung auf 30B- bis 70B-Modelle? Dann steigt der Bedarf auf 4 bis 8 GPUs, und die monatlichen Betriebskosten erreichen 6.000 bis 15.000 TP4T. Die Evaluierungsinfrastruktur kann die Hosting-Kosten für den Produktivbetrieb problemlos erreichen.

Basierend auf Wettbewerbsdaten von 2025 belaufen sich die monatlichen Kosten für Einstiegslösungen mit 7B- bis 13B-Modellen auf einer einzelnen GPU auf ca. 1.500 bis 1.500 Tsd. 4.000 Tsd. ...

Doch hier liegt der Haken: Die Evaluierung läuft nicht kontinuierlich wie der Produktivbetrieb, sondern in Intervallen. Das führt zu Ineffizienz. Teams überdimensionieren entweder die Ressourcen und verschwenden Geld für ungenutzte GPUs, oder sie unterdimensionieren sie und erzeugen Engpässe, die die Entwicklungszyklen verlangsamen.

Die Talentsteuer, über die niemand spricht

Open-Source-Tools konfigurieren sich nicht von selbst. Sie erfordern qualifizierte Ingenieure, die sowohl die Bewertungsrahmen als auch den jeweiligen Testbereich verstehen.

Auch vortrainierte Modelle benötigen Experten für ihre Anwendung. Jemand muss Evaluierungsprotokolle entwickeln, geeignete Benchmarks auswählen, Ergebnisse interpretieren und die Erkenntnisse in konkrete Verbesserungen umsetzen. Dies erfordert Expertise im Bereich maschinelles Lernen in Kombination mit Fachwissen – eine Kombination, die erfahrenen Fachkräften ein Jahresgehalt von 150.000 bis 250.000 Euro einbringt.

Kleine Teams könnten anfänglich 0,5 Vollzeitäquivalente (VZÄ) für die Evaluierungsarbeit einplanen. Das entspricht Gesamtkosten von 1.750.000 bis 1.250.000 INR (Gehalt zuzüglich Sozialleistungen und Gemeinkosten). Für Implementierungen mittleren Umfangs werden 2–3 dedizierte Ingenieure benötigt, wodurch die Personalkosten auf 1.300.000 bis 7.500.000 INR jährlich steigen.

In Diskussionen innerhalb der Community wird diese Lücke immer wieder deutlich. Teams gehen fälschlicherweise davon aus, einfach die Open-Source-Evaluierungsbibliothek nutzen zu können, ohne die dafür notwendigen Fachkräfte einzuplanen. Sechs Monate später stellen sie entweder Spezialisten ein oder geben ihre Evaluierungsbemühungen ganz auf.

Auswirkungen von Modellgröße und -komplexität auf die Evaluierungskosten

Die Beziehung zwischen Modellgröße und Evaluierungskosten ist nicht linear. Im schlimmsten Fall ist sie exponentiell.

Kleine Modelle (1–3 Milliarden Parameter) durchlaufen Evaluierungsreihen schnell. Ein umfassender Test kann Minuten bis Stunden dauern. Große Modelle (30–70 Milliarden Parameter) benötigen für dieselbe Evaluierungstiefe Tage. Mixture-of-Experts-Architekturen (MoE) führen zu einer weiteren Komplexitätsebene.

Untersuchungen zu MoE-Systemen zufolge weisen diese Modelle eine hohe Anzahl an Parametern auf – einige erreichen bis zu 1,571 Milliarden –, aktivieren aber während der Tokenverarbeitung lediglich 1-25%. Diese geringe Aktivierung stellt eine Herausforderung für die Evaluierung dar. Standard-Benchmarks testen möglicherweise nicht alle Expertenpfade ausreichend, sodass benutzerdefinierte Evaluierungsprotokolle erforderlich sind.

Parameteranzahl vs. Auswertungskomplexität

So wirkt sich der Modellumfang auf den Auswertungsaufwand aus:

| Modellgröße | Typische Parameter | VRAM (4-Bit) | Auswertungszeit pro Test | Monatliche Bewertungskosten |

|---|---|---|---|---|

| Klein | 1-3B | ca. 2 GB | Minuten | $200-$800 |

| Medium | 7-13B | 6-8 GB | Std | $800-$2,500 |

| Anwendungsfälle | 30-70B | 20-40 GB | Stunden bis Tage | $3,000-$8,000 |

| Extra groß | 100 Milliarden+ | 60+ GB | Tage | $10,000+ |

Diese Schätzungen basieren auf der Annahme regelmäßiger Evaluierungen (wöchentliche umfassende Tests plus tägliche Funktionstests). Teams, die bei jeder Codeänderung eine kontinuierliche Evaluierung durchführen, werden mit einer Vervielfachung der Kosten konfrontiert sein.

Spezialisierte Architekturen erfordern spezialisierte Tests

Standardisierte Transformatormodelle verfügen über etablierte Evaluierungsprotokolle. Neuere Architekturen wie MoE-Modelle, Zustandsraummodelle oder Hybridsysteme erfordern hingegen kundenspezifische Testansätze.

Diese Anpassung ist mit Kosten verbunden. Entweder entwickeln die Teams die Testinfrastruktur selbst (Entwicklungsaufwand) oder sie erwerben spezialisierte Evaluierungsdienste. In beiden Fällen erhöht der Aufpreis für die spezielle Architektur die Basisevaluierungskosten um 30-50%.

Versteckte Kosten: Daten-, Integrations- und Betriebskosten

Die Ausgaben beschränken sich nicht auf Plattformen und Infrastruktur. Zahlreiche Kostenkategorien bleiben zunächst unbemerkt, bis die Rechnungen eintreffen.

Kosten des Evaluierungsdatensatzes

Öffentliche Benchmarks wie HumanEval (164 Programmieraufgaben) oder MBPP eignen sich für allgemeine Fähigkeitstests. Private LLMs hingegen bedienen typischerweise spezifische Bereiche – Rechtsanalyse, medizinische Diagnostik, Finanzmodellierung, Kundenservice.

Generische Benchmarks reichen nicht aus. Organisationen benötigen maßgeschneiderte Evaluierungsdatensätze, die ihre tatsächlichen Anwendungsfälle, Datenverteilungen und Sonderfälle widerspiegeln. Die Erstellung dieser Datensätze erfordert entweder interne Anstrengungen oder externe Dienstleistungen.

Die Kosten für die Erstellung interner Datensätze umfassen den Zeitaufwand von Fachexperten (oft 150–300 INR/Stunde für spezialisierte Bereiche), die Annotation, die Qualitätssicherung und die Datensatzpflege im Zuge der Produktentwicklung. Ein kleiner, individueller Evaluierungsdatensatz (5.000–10.000 Beispiele) kostet in der Regel 20.000–50.000 INR in der Erstellung und 5.000–15.000 INR jährlich in der Pflege.

Die Lizenzierung kommerzieller Benchmark-Datensätze verursacht zusätzliche Kosten. Spezialisierte Domänendatensätze (Recht, Medizin, Finanzen) können je nach Größe, Qualität und Lizenzbedingungen zwischen 10.000 und über 100.000 PKR kosten.

Integrations- und Orchestrierungskosten

Evaluierung findet nicht isoliert statt. Sie muss in Versionskontrollsysteme, CI/CD-Pipelines, Modellregister, Plattformen zur Versuchsverfolgung und Produktionsüberwachung integriert werden.

Die Entwicklung solcher Integrationen ist sehr zeitaufwendig. Eine grundlegende Integration zwischen einer Evaluierungsplattform und einer bestehenden MLOps-Infrastruktur erfordert typischerweise 80 bis 200 Stunden Entwicklungs- und Testaufwand. Bei einem Stundensatz von 150 bis 250 £ für ML-Ingenieure entspricht dies 12.000 bis 50.000 £ pro Integration.

Multipliziert man dies mit der Anzahl der Tools im Stack, so ergeben sich fortlaufende Wartungsarbeiten aufgrund von API-Änderungen und sich weiterentwickelnden Anforderungen. Der Integrationsaufwand erreicht leicht 15–251 TP3T der gesamten Evaluierungskosten.

Compliance- und Sicherheitsprüfung

Private Lizenzierungsstellen verarbeiten häufig sensible Daten. Gesundheitsdienstleister verwalten Patientendaten. Finanzinstitute verarbeiten personenbezogene Daten und Transaktionsdaten. Regierungsbehörden verwalten Verschlusssachen.

Die Evaluierungsinfrastruktur muss dieselben Sicherheits- und Compliance-Standards erfüllen wie Produktionssysteme. Dies umfasst Sicherheitsaudits, Penetrationstests, Compliance-Dokumentation und gegebenenfalls eine dedizierte Infrastruktur mit abgeschotteter Bereitstellung.

Die Kosten für Sicherheitsaudits von KI-Systemen reichen von $25K für grundlegende Bewertungen bis zu $200K+ für umfassende Evaluierungen komplexer Implementierungen. Die laufende Überwachung der Einhaltung von Vorschriften verursacht je nach regulatorischen Anforderungen zusätzliche Kosten von $10K bis $50K pro Jahr.

Plattform vs. Selbstgehostet: Vergleich der Gesamtbetriebskosten

Die Entscheidung zwischen Eigenentwicklung und Kauf einer Evaluierungsinfrastruktur umfasst mehr als nur den Vergleich von Plattformabonnementgebühren mit Infrastrukturkosten.

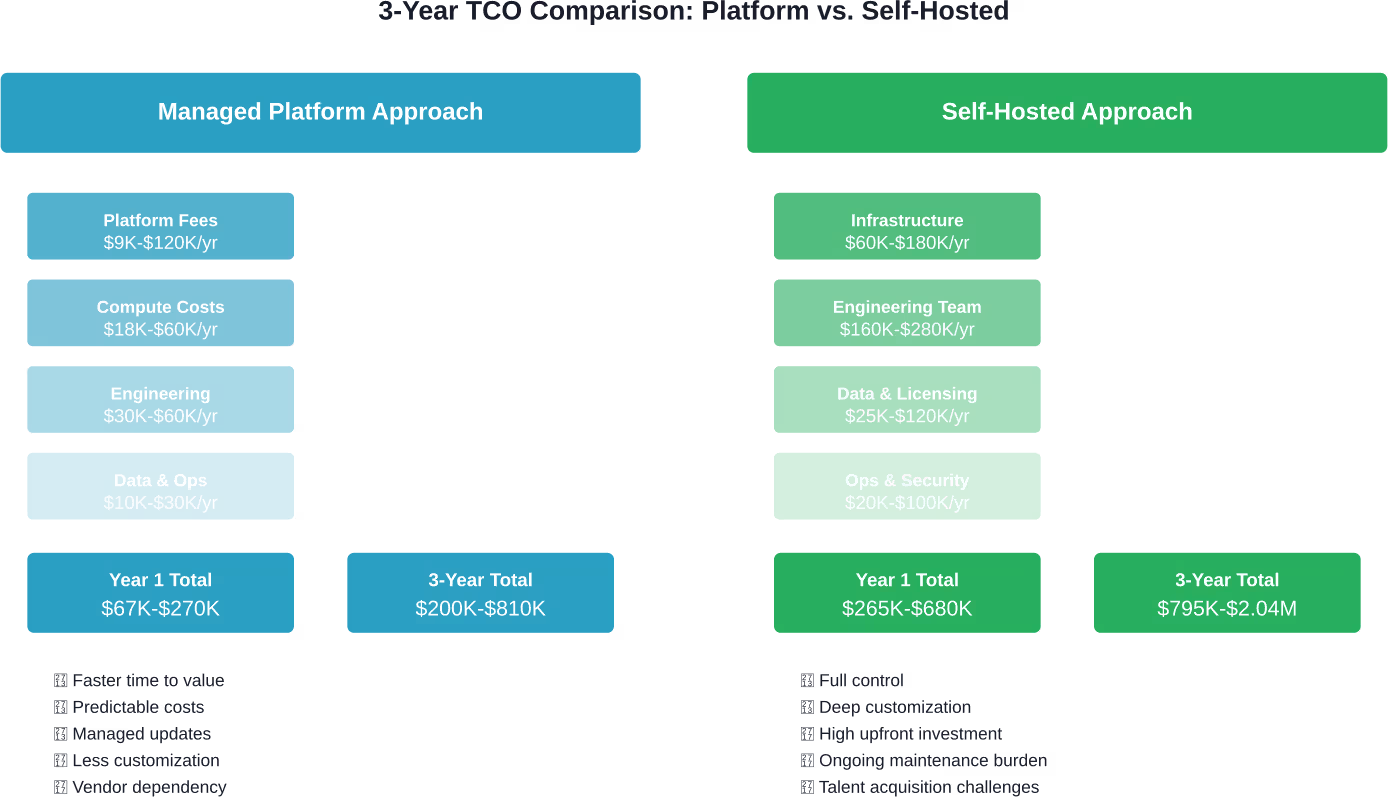

Die Gesamtbetriebskosten (TCO) umfassen direkte Kosten (Plattformen, Rechenleistung, Lizenzen), Personalkosten (Entwicklung, Betrieb, Spezialexpertise), Opportunitätskosten (Zeit bis zur Wertschöpfung, Funktionsgeschwindigkeit) und Risikokosten (Bewertungslücken, die zu Produktionsausfällen führen).

Der Ansatz mit der verwalteten Plattform weist im ersten Jahr geringere Kosten auf ($67K–$270K vs. $265K–$680K) und deutlich niedrigere Gesamtbetriebskosten über drei Jahre ($200K–$810K vs. $795K–$2,04M). Der selbstgehostete Ansatz erfordert für vergleichbare Funktionalität das Drei- bis Vierfache der Investition.

Diese Zahlen erzählen aber nur einen Teil der Geschichte. Plattformbasierte Ansätze ermöglichen eine schnellere Wertschöpfung – oft innerhalb von Wochen statt Monaten. Selbstgehostete Lösungen bieten hingegen mehr Anpassungsmöglichkeiten für Organisationen mit individuellen Anforderungen, die Plattformen nicht erfüllen können.

Wann Plattform-Abonnements sinnvoll sind

Managed Platforms eignen sich am besten für Teams, die schnell umfassende Evaluierungsfunktionen benötigen, nur über begrenzte interne Expertise im Bereich ML-Infrastruktur verfügen, planbare Betriebskosten wünschen oder in kleinem bis mittlerem Umfang arbeiten, wo Plattformbeschränkungen keine Rolle spielen.

Der ökonomische Rahmen zur Bewertung von Sprachmodellen legt nahe, sich auf die Kosten pro erfolgreicher Bewertung zu konzentrieren – also darauf, wie viel es kostet, ein korrektes Ergebnis zu erzielen. Plattformen sind hier für die meisten Organisationen von Vorteil, da sie den Entwicklungsaufwand für zuverlässige Bewertungsergebnisse reduzieren.

Wann Selbsthosting notwendig wird

Eine selbstgehostete Infrastruktur ist sinnvoll, wenn die Anforderungen an die Evaluierung die Leistungsfähigkeit der Plattform übersteigen, die Sensibilität der Daten die Nutzung externer Dienste verhindert, das Evaluierungsvolumen die Plattformgebühren unerschwinglich machen würde oder eine tiefgreifende Anpassung für proprietäre Architekturen oder Evaluierungsprotokolle erforderlich ist.

Organisationen in regulierten Branchen (Gesundheitswesen, Finanzwesen, öffentliche Verwaltung) haben oft keine Wahl. Die Anforderungen an die Daten-Governance erfordern eine Bereitstellung vor Ort oder in einer privaten Cloud mit voller Kontrolle über Datenflüsse und Zugriffsmuster.

Kostenoptimierungsstrategien für die LLM-Bewertung

Unabhängig von der Entscheidung für eine Plattform oder eine selbstgehostete Lösung gibt es mehrere Strategien, die die Evaluierungskosten senken, ohne die Qualität zu beeinträchtigen.

Gestufte Bewertungsansätze

Nicht jede Codeänderung erfordert eine vollständige Evaluierung. Implementieren Sie eine gestaffelte Teststrategie: Schnelle Smoke-Tests bei jedem Commit (Minuten, minimaler Aufwand), Evaluierung mittleren Umfangs bei Pull Requests (Stunden, moderater Aufwand) und umfassende Evaluierung bei Release Candidates (Tage, voller Aufwand).

Dieser Ansatz reduziert die Rechenkosten um 60-70% im Vergleich zur Durchführung einer umfassenden Auswertung bei jeder Änderung und erkennt die meisten Probleme frühzeitig, wenn ihre Behebung noch kostengünstiger ist.

Effiziente Benchmark-Auswahl

Eine Studie zu Benchmarks für große Sprachmodelle identifiziert 283 repräsentative Benchmarks und verdeutlicht damit den umfassenden Ansatz des Forschungsfelds zur Evaluierung großer Sprachmodelle. Anstatt alle verfügbaren Benchmarks auszuführen, sollten die 8–10 wichtigsten für spezifische Anwendungsfälle ausgewählt werden. Die Auswahl der Benchmarks sollte vierteljährlich überprüft werden, um sicherzustellen, dass die Abdeckung auch bei Weiterentwicklung der Modelle ausreichend bleibt.

Hybride Evaluierungsstrategien

Die Plattformdienste für Standardfunktionstests werden mit kundenspezifischen, selbstgehosteten Evaluierungen für domänenspezifische Anforderungen kombiniert. Plattformen bewältigen die Evaluierungslast für Standardfunktionen effizient. Die interne Infrastruktur deckt die spezialisierten Anforderungen gemäß 20% ab, die Plattformen nicht erfüllen können.

Dieser hybride Ansatz ist in der Regel 30-40% günstiger als reines Self-Hosting und ermöglicht gleichzeitig die notwendige Anpassung.

Optimierung der Rechenressourcen

Die Auslastung von Evaluierungs-Workloads weist Spitzen und Tiefpunkte auf. Spot-Instanzen und präemptive VMs können die Cloud-GPU-Kosten für Evaluierungs-Workloads, die Unterbrechungen und Neustarts tolerieren, um 60–801 Tsd. 30 Tsd. reduzieren.

Für Teams mit einem regelmäßigen Evaluierungsvolumen bieten reservierte Instanzen Rabatte von 40–501 TP3T im Vergleich zur On-Demand-Preisgestaltung. Das Abhängigkeitsrisiko sinkt, da die Evaluierung zu einem festen Bestandteil der Entwicklungsabläufe und nicht nur zu einer gelegentlichen Aktivität wird.

Die LLM-Evaluation sollte ihren Preis wert sein und nicht nur eine weitere Position darstellen.

Private LLM-Evaluierungen können schnell teuer werden, insbesondere wenn die Tests nicht mit der tatsächlichen Erstellung und Verwendung des Modells zusammenhängen. AI Superior Evaluierung wird als integraler Bestandteil des gesamten Modelllebenszyklus betrachtet – nicht als separate Serviceebene. Zu ihren Aufgaben gehören die Entwicklung und Feinabstimmung von Modellen, die Einrichtung von Validierungspipelines und die Ausrichtung der Evaluierung an realen Anwendungsfällen. Dies hilft, übermäßiges Testen zu vermeiden, redundante Benchmarks zu reduzieren und die Evaluierung auf die im Produktivbetrieb tatsächlich relevante Leistung zu fokussieren.

Die meisten Evaluierungskosten steigen, wenn Tests wiederholt werden, ohne das System selbst zu verbessern. Wenn die Evaluierung in die Entwicklung und den Einsatz integriert wird, erhalten Sie weniger Zyklen und klarere Ergebnisse. Wenn Sie die Evaluierung so gestalten möchten, dass sie Ihr Modell tatsächlich verbessert, anstatt es nur zu messen, kontaktieren Sie uns. AI Superior und schauen Sie sich genauer an, wie Ihre aktuelle Konfiguration aufgebaut ist.

Preisbeispiele und Fallstudien aus der Praxis

Abstrakte Kostenspannen werden durch konkrete Szenarien verständlicher.

Kleines Team: Interner Chatbot

Ein 15-köpfiges Startup entwickelt einen internen Wissensdatenbank-Chatbot mithilfe eines feinabgestimmten Modells mit 7 Milliarden Parametern. Zu den Evaluierungsanforderungen gehören Genauigkeitstests bei unternehmensspezifischen Anfragen, Sicherheitsprüfungen und Leistungsüberwachung.

Vorgehensweise: Braintrust Pro Plattform ($249/Monat, bestätigter Preis) plus Erstellung eines kundenspezifischen Evaluierungsdatensatzes ($15K einmalige Schätzung) plus 0,25 FTE Entwicklungszeit ($40K/Jahr Schätzung).

Gesamtkosten im ersten Jahr: $58K. Laufende jährliche Kosten: $43K.

Mittelständisches Unternehmen: KI im Kundenservice

Ein SaaS-Unternehmen mit 200 Mitarbeitern implementiert ein 13-Milliarden-Parameter-Modell zur Automatisierung des Kundenservice. Zu den Evaluierungsanforderungen gehören Genauigkeit, Angemessenheit des Tonfalls, Erkennung von Fehlkommunikation und A/B-Tests im Vergleich zu Basismodellen.

Ansatz: Plattform der mittleren Leistungsklasse ($2.500/Monat) plus moderate GPU-Ressourcen für selbstgehostete spezialisierte Tests ($4K/Monat) plus benutzerdefinierter Domänendatensatz ($35K) plus 1,5 FTE Spezialisten ($180K/Jahr).

Gesamtkosten im ersten Jahr: $293K. Laufende jährliche Kosten: $258K.

Unternehmen: Einsatz in regulierten Branchen

Ein Finanzdienstleistungsunternehmen mit 5.000 Mitarbeitern entwickelt ein 30-Milliarden-Parameter-Modell zur Unterstützung der Investmentanalyse. Regulatorische Vorgaben erfordern die Implementierung vor Ort, umfassende Prüfprotokolle und die Validierung durch Dritte.

Ansatz: Selbstgehostete Infrastruktur auf dedizierter Hardware ($180K/Jahr GPU-Kosten) plus 3 FTE-Team ($450K/Jahr) plus kommerzielle Datensätze und Lizenzen ($80K/Jahr) plus Sicherheitsaudits ($50K/Jahr) plus externe Validierungsdienste ($40K/Jahr).

Gesamtkosten im ersten Jahr: $800K. Laufende jährliche Kosten: $800K (zuzüglich größerer Infrastruktur-Upgrades alle 3 Jahre).

Diese Szenarien veranschaulichen, wie die Kosten mit der Unternehmensgröße, der Modellkomplexität und den regulatorischen Anforderungen skalieren. Das Beispiel eines Großunternehmens kostet 14-mal so viel wie das eines kleinen Teams – bedient aber 333-mal so viele Nutzer in einem stark regulierten Umfeld.

Die verborgene Ökonomie der “kostenlosen” Open-Source-Evaluierung

Open-Source-Tools zur Evaluierung von LLM-Studiengängen wecken ein verlockendes Versprechen: keine Softwarelizenzkosten. Die Realität erweist sich jedoch als teurer.

Die Herausforderung liegt nicht in den Werkzeugen selbst. Lighteval, die Evaluierungsbibliotheken von Hugging Face und ähnliche Frameworks funktionieren gut. Die Herausforderung besteht vielmehr im gesamten Umfeld: der Infrastruktur für ihren Betrieb, dem Fachwissen für ihre effektive Nutzung, der Wartung, um sie aktuell zu halten, und der Integration, um sie nutzbar zu machen.

In Diskussionen innerhalb der Community wird diese Diskrepanz immer wieder deutlich. Teams gehen fälschlicherweise davon aus, dass Open Source kostenlos bedeutet. Sie lernen das Gegenteil, wenn sie sechs Monate in ein Projekt investiert haben, 1.400.000 US-Dollar Entwicklungszeit angelegt haben und immer noch Schwierigkeiten haben, verlässliche Auswertungsergebnisse zu erzielen.

Das Muster sieht folgendermaßen aus: Man lädt ein Open-Source-Evaluierungsframework herunter (kostenlos), verbringt 2 Wochen mit dem Erarbeiten der Dokumentation (Entwicklungskosten), verbringt 1 Monat mit dem Aufbau der Infrastruktur (Entwicklungs- und Cloudkosten), verbringt 2 Monate mit der Behebung von Integrationsproblemen (Entwicklungskosten) und investiert laufende Zeit in die Wartung, da sich die Frameworks ständig weiterentwickeln (dauerhafte Entwicklungskosten).

Dieses “kostenlose” Framework kostete im ersten Jahr 80.000 bis 120.000 Euro. Für viele Unternehmen hätte die Investition in eine Managed-Plattform für 3.000 bis 10.000 Euro bessere Ergebnisse schneller und zu geringeren Gesamtkosten geliefert.

Wenn Open Source tatsächlich Geld spart

Open-Source-Evaluierungstools sind in bestimmten Szenarien wirtschaftlich sinnvoll: wenn Teams bereits über ML-Infrastruktur-Expertise im eigenen Haus verfügen, die Evaluierungsanforderungen hochspezialisiert sind und Plattformen diese nicht erfüllen können, das Evaluierungsvolumen die Plattformgebühren extrem hoch machen würde oder Organisationen ideologische oder strategische Verpflichtungen gegenüber Open-Source-Technologie-Stacks haben.

Doch selbst in diesen Szenarien spielen die betrieblichen Wirtschaftlichkeitsfaktoren eine Rolle. Die Kostenstruktur verlagert sich von Plattformgebühren hin zu Personal und Infrastruktur, aber die Gesamtausgaben sinken selten so stark, wie die anfängliche Analyse vermuten lässt.

Preistrends und zukünftige Kostenprognosen

Der Markt für LLM-Bewertungen ist noch nicht ausgereift und die Preise schwanken stark. Mehrere Trends beeinflussen die zukünftige Kostenentwicklung.

Zunehmender Wettbewerb senkt die Plattformpreise

Monatlich drängen weitere Anbieter auf den Markt für Evaluierungsplattformen. Wettbewerb führt in der Regel zu sinkenden Preisen und erweiterten Funktionen. Das Einstiegsmodell von $249/Monat aus dem Jahr 2025 könnte bis 2027 auf $149/Monat sinken und gleichzeitig Funktionen beinhalten, die zuvor nur in Unternehmenspaketen verfügbar waren.

Untersuchungen zu Kosten-Nutzen-Analysen zeigen, dass die Kosten für die Spitzentechnologie im Laufe der Zeit mit neuen Modellveröffentlichungen gesunken sind. Wirtschaftliche Erkenntnisse belegen, dass schlanke Modelle für grundlegende Aufgaben am kosteneffektivsten sind. Evaluierungsdienstleistungen werden voraussichtlich einer ähnlichen Preisdynamik folgen.

Die Infrastrukturkosten bleiben träge

Die GPU-Kosten sind trotz jahrelanger Prognosen nicht nennenswert gesunken. Cloud-Anbieter erzielen weiterhin hohe Gewinnmargen bei GPU-Instanzen. Das Oligopol der Hyperscaler verhindert einen aggressiven Preiswettbewerb.

Erwarten Sie kurzfristig keine signifikanten Kostensenkungen bei der Infrastruktur für selbstgehostete Evaluierungen. Effizienzgewinne durch bessere Software könnten zwar 10–151 Tbit/s an Rechenkosten ausgleichen, die Wirtschaftlichkeit der Hardware bleibt jedoch eine Herausforderung.

Spezialisierung schafft Premium-Preisstufen

Generische Evaluierungsplattformen werden sich zu Standardprodukten entwickeln und preislich wettbewerbsfähig sein. Spezialisierte Dienstleistungen für regulierte Branchen, domänenspezifische Evaluierungen oder fortgeschrittene Funktionen wie Adversarial Testing werden weiterhin im Premiumsegment angesiedelt sein.

Erwarten Sie eine Marktsegmentierung: Standardplattformen zu $200-$500/Monat, professionelle Plattformen zu $2K-$5K/Monat und spezialisierte Dienstleistungen zu $10K+/Monat oder individuelle Projektpreise.

Häufig gestellte Fragen

Wie hoch sind die durchschnittlichen Kosten für private LLM-Bewertungsdienste?

Plattformbasierte Evaluierungsdienste kosten in der Regel zwischen 1.249 Tsd. pro Monat für Einsteigerpakete und über 10.000 Tsd. pro Monat für Enterprise-Implementierungen. Die Kosten für eine selbstgehostete Evaluierungsinfrastruktur liegen bei 125.000 bis 190.000 Tsd. pro Jahr für minimale Implementierungen und bei 500.000 bis 820.000 Tsd. pro Jahr für Produktionssysteme mittleren Umfangs. Die Gesamtkosten hängen von der Modellgröße, der Evaluierungshäufigkeit, der Expertise des Teams und der gewählten Infrastruktur ab.

Sind Open-Source-Tools zur LLM-Evaluierung wirklich kostenlos?

Die Software selbst ist zwar kostenlos, die Betriebskosten sind jedoch erheblich. Selbst minimale, selbstgehostete Implementierungen mit Open-Source-Tools kosten jährlich über 125.000 Euro, wenn man Infrastruktur, Entwicklerpersonal, Datenlizenzen und Wartung berücksichtigt. Unternehmen müssen Budgets für GPU-Ressourcen, ML-Entwicklungsexpertise, die Erstellung von Datensätzen und den laufenden Betrieb einplanen. Die “kostenlose” Software ist in der Gesamtnutzung oft teurer als kostenpflichtige Plattformen.

Wie viel kostet die Auswertung eines 70B-Parametermodells?

Die Auswertung großer Modelle mit 70 Milliarden Parametern erfordert typischerweise 4–8 High-End-GPUs und verursacht monatliche Kosten von 3.000–8.000 PKR allein für Rechenressourcen. Hinzu kommen Plattformgebühren (2.500–5.000 PKR/Monat) oder die Kosten für Ingenieure für eine eigene Infrastruktur (2–3 Vollzeitäquivalente zu 300.000–450.000 PKR jährlich), sowie Kosten für benutzerdefinierte Datensätze (35.000–70.000 PKR) und die laufende Wartung. Die Gesamtkosten im ersten Jahr für eine umfassende Auswertung eines 70-Milliarden-Modells liegen je nach Auswertungstiefe und -häufigkeit zwischen 150.000 und 400.000 PKR.

Welche Faktoren beeinflussen die Kosten der LLM-Evaluierung am stärksten?

Modellgröße und -architektur verursachen die größten Kostenunterschiede. Größere Modelle benötigen mehr GPUs und längere Auswertungszeiten. Auch Auswertungshäufigkeit und -tiefe spielen eine entscheidende Rolle – kontinuierliche Auswertungen sind 5- bis 10-mal teurer als wöchentliche Tests. Die Expertise des Teams beeinflusst die Kosten, da erfahrene Auswerter effizienter arbeiten und bessere Werkzeugauswahlen treffen. Infrastrukturentscheidungen (Plattform vs. Eigenhosting) führen zu 3- bis 4-fachen Kostenunterschieden bei vergleichbaren Funktionen.

Ist es günstiger, Evaluierungsplattformen zu nutzen oder eine eigene Infrastruktur aufzubauen?

Plattformen sind für die meisten Organisationen kostengünstiger. Die Gesamtbetriebskosten (TCO) einer Plattform über drei Jahre liegen zwischen 200.000 und 810.000 INR, verglichen mit 795.000 bis 2,04 Mio. INR für eine selbstgehostete Infrastruktur mit vergleichbaren Funktionen. Plattformen bieten eine schnellere Wertschöpfung und erfordern weniger spezialisiertes Fachwissen. Selbstgehostete Infrastruktur ist nur dann wirtschaftlich sinnvoll, wenn das Evaluierungsvolumen die Kapazitäten der Plattform übersteigt, die Daten-Governance externe Dienste ausschließt oder hochspezialisierte Evaluierungsanforderungen bestehen, die Plattformen nicht erfüllen können.

Wie können Organisationen die Kosten für die LLM-Evaluierung senken, ohne die Qualität zu beeinträchtigen?

Implementieren Sie gestaffelte Evaluierungsstrategien mit schnellen Smoke-Tests bei jeder Änderung und umfassenden Tests nur bei Releases, wodurch die Rechenkosten um 60–701 TP3T gesenkt werden. Wählen Sie effiziente Benchmark-Teilmengen anstelle von umfassenden Testsuiten. Nutzen Sie hybride Ansätze, die Plattformdienste für Standardtests mit gezielter, selbstgehosteter Evaluierung für spezielle Anforderungen kombinieren. Optimieren Sie Rechenressourcen durch Spot-Instanzen (Einsparungen von 60–801 TP3T) oder reservierte Instanzen (Einsparungen von 40–501 TP3T) für konsistente Workloads. Konzentrieren Sie den Entwicklungsaufwand auf hochwertige, kundenspezifische Evaluierungen anstatt auf die Neuerstellung von Standardfunktionen.

Skalieren die Evaluierungskosten linear mit der Modellgröße?

Nein, die Evaluierungskosten skalieren nicht linear. Die Evaluierung eines 70-Milliarden-Modells kostet nicht doppelt so viel wie die eines 35-Milliarden-Modells – sie ist typischerweise 3- bis 5-mal so teuer, bedingt durch höhere GPU-Anforderungen, längere Evaluierungszeiten und eine komplexere Infrastruktur. Sehr große Modelle (über 100 Milliarden Parameter) erfordern spezialisierte Infrastruktur und Verfahren, die zusätzliche Kosten verursachen. Der Zusammenhang zwischen Parametern und Kosten beschleunigt sich, anstatt linear zu verlaufen.

Die wirtschaftliche Entscheidung treffen

Die Kosten für private LLM-Evaluierungsdienstleistungen variieren je nach Ansatz, Umfang und Anforderungen um zwei Größenordnungen. Kleine Teams können mit Plattformlösungen für unter 14.000 bis 5.000 INR jährlich beginnen. Große Unternehmen mit speziellen Anforderungen geben hingegen unter Umständen mehr als 1 Million INR jährlich für eine umfassende Evaluierungsinfrastruktur aus.

Die wirtschaftliche Entscheidung hängt von drei Faktoren ab: der erforderlichen Tiefe und Häufigkeit der Evaluierung, dem verfügbaren internen Fachwissen und der strategischen Bedeutung der Evaluierungsfähigkeiten.

Für die meisten Organisationen bieten Managed-Plattformen die beste Wirtschaftlichkeit. Geringere Vorabinvestitionen, schnellere Amortisation und planbare Kosten überwiegen die Flexibilitätsvorteile selbstgehosteter Infrastrukturen. Die Ausnahme bilden Organisationen mit wirklich einzigartigen Anforderungen, einem sehr hohen Evaluierungsvolumen oder regulatorischen Beschränkungen, die externe Dienstleistungen ausschließen.

Doch hier liegt die eigentliche Erkenntnis: Die Kosten der Evaluierung müssen den Kosten eines Fehlschlags gegenübergestellt werden. Die Auslieferung einer fehlerhaften KI-Funktion in die Produktion kann das Vertrauen der Kunden zerstören, regulatorische Risiken nach sich ziehen oder den Markenruf schädigen. Diese Kosten übersteigen die Evaluierungskosten bei Weitem.

Die Frage ist nicht, ob in Evaluierung investiert werden soll, sondern wie viel für das jeweilige Risikoprofil angemessen ist. Ein Kundenservice-Chatbot könnte jährliche Evaluierungsinvestitionen von $50K rechtfertigen. Ein medizinischer Diagnoseassistent benötigt möglicherweise $500K. Ein Entscheidungssystem für autonome Fahrzeuge könnte über $5M erfordern.

Die Investitionen in die Evaluierung sollten dem Schweregrad der Folgen entsprechen. Wer heute an der Evaluierung spart, verursacht morgen oft exponentiell höhere Kosten, wenn Produktionsausfälle auftreten.

Sind Sie bereit für eine umfassende Evaluierung Ihres Lernmanagementsystems? Beginnen Sie mit der Bewertung des aktuellen Reifegrads Ihrer Evaluierungsmethoden, identifizieren Sie Lücken zwischen den vorhandenen und den erforderlichen Fähigkeiten und berechnen Sie die tatsächlichen Kosten von Evaluierungsfehlern in konkreten Anwendungsfällen. Diese Analyse macht die Entscheidung zwischen einer Plattform und einer selbst gehosteten Lösung transparent und rechtfertigt die notwendige Investition gegenüber den Stakeholdern.