Kurzzusammenfassung: Die Optimierung der LLM-Kosten bei KI-Implementierungen erfordert einen mehrschichtigen Ansatz, der intelligente Modellauswahl, Infrastrukturoptimierung und Token-Management kombiniert. Unternehmen können die Kosten durch Techniken wie Modellrouting, semantisches Caching und KV-Cache-Optimierung um 60 bis 851 Tsd. Euro senken – ohne Kompromisse bei der Genauigkeit einzugehen. Entscheidend ist, LLM-Kosten wie Kosten pro Produktionseinheit und nicht wie herkömmliche Softwarekosten zu behandeln.

Ein Kundensupport-Chatbot, der monatlich 500.000 Anfragen mit je 1.500 Tokens bearbeitet, verursacht monatlich Kosten von rund 18.000 TP4T – allein für eine einzige Funktion. Bei 10.000 täglichen Konversationen steigen die Kosten allein für Eingabe-Tokens auf über 1.500 TP4T täglich.

Dies ist kein herkömmliches Cloud-Kostenmanagement. LLM-native Produkte vereinen Eigenschaften physischer Güter und Software: Sie skalieren wie Code sofort, verursachen aber gleichzeitig relevante variable Kosten pro Nutzung. Da Unternehmen zunehmend großflächige Modelle einsetzen, ist das Kostenmanagement zu einem entscheidenden Wettbewerbsvorteil geworden und nicht mehr nur eine operative Herausforderung.

Die Preisunterschiede zwischen den Anbietern sind beträchtlich. GPT-5.4 berechnet $2,50 pro Million Input-Token, während Claude 4.5 Sonnet $3 pro Million Input-Token verlangt. Die Anbieterwahl ist jedoch nur der Anfang – die Optimierung der Produktionskosten erfordert ein Umdenken auf Infrastrukturebene.

Warum sich die Kosten für ein LLM-Studium anders verhalten

Traditionelle Software basiert auf einem einfachen Wirtschaftsmodell: hohe Entwicklungskosten im Vorfeld, danach sinken die Grenzkosten für jeden zusätzlichen Nutzer gegen null. Die Anwendung wird einmal gehostet und kann von Millionen Nutzern bedient werden.

KI-native Anwendungen brechen dieses Modell komplett.

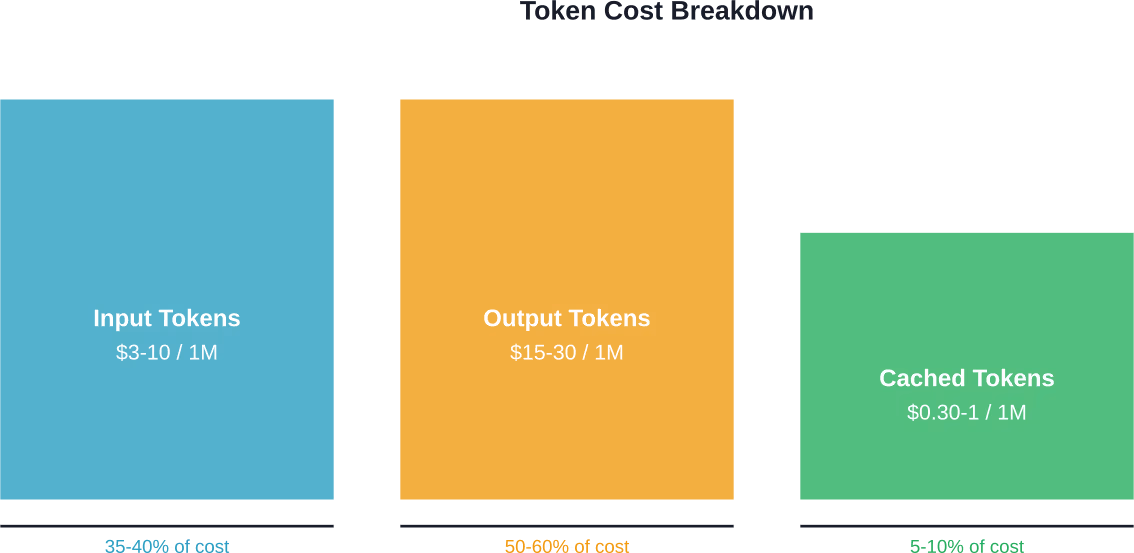

Jede Inferenz verursacht Rechenkosten. Eingabe-Token, Ausgabe-Token und zwischengespeicherte Token haben jeweils unterschiedliche Preisstrukturen. Die Preisgestaltung hängt von mehreren miteinander verbundenen Variablen ab, die sich dynamisch anhand der Workload-Charakteristika ändern.

Die Kontextlänge ist wichtiger als die meisten Teams annehmen. Ein Modell mit einer Kontextlänge von 2.048 Token kann bis zu 2.048 Token gleichzeitig verarbeiten. Die Verarbeitung längerer Kontexte erhöht den Speicherbedarf jedoch exponentiell – nicht linear. Der Key-Value-Cache, der die redundante Neuberechnung vergangener Token-Repräsentationen während der autoregressiven Generierung verhindert, wächst proportional zur Sequenzlänge.

Produktionssysteme stoßen auf Engpässe, die in der Entwicklung nicht auftreten. Die Speicherbandbreite wird während der Dekodierungsphase zum primären limitierenden Faktor. Der Multi-Head-Attention-Mechanismus führt mehrere Aufmerksamkeitsberechnungen parallel durch, der tatsächliche Durchsatz wird jedoch durch Hardwarebeschränkungen bestimmt.

Das Problem der Stückkosten

KI-Startups stehen in drei Bereichen vor besonderen Herausforderungen: Stückkosten (Kosten pro Inferenz), Kapazitätsplanung (GPU-Versorgung) und Ertragsoptimierung (Modellausgabequalität pro Token).

Anders als bei herkömmlicher Software, bei der die Grenzkosten für einen neuen Nutzer praktisch null sind, weisen LLM-native Produkte erhebliche variable Kostenkomponenten auf. Dies zwingt Teams dazu, wie Hersteller zu denken – Produktionseffizienz zu überwachen, den Durchsatz zu optimieren und Lieferengpässe zu managen.

Mal ehrlich: Die meisten Teams können ihre LLM-Kosten nicht präzise begründen. Die Komplexität der KI-Kostenstrukturen, einschließlich Rechenleistung, Speicherbandbreite, Speicherplatz und Netzwerk, führt zu mangelnder Transparenz. Den Entwicklungsteams fehlt der Einblick, welche Anwendungsfälle die Kosten verursachen oder welche Optimierungen den höchsten ROI erzielen würden.

Modellauswahl und Routing-Strategien

Die jüngsten Fortschritte bei Sprachmodellen haben ein stetig wachsendes Ökosystem geschaffen. Unternehmen können nun aus Dutzenden von Open-Source- und kommerziellen Optionen wählen, die jeweils ein unterschiedliches Kosten-Nutzen-Verhältnis aufweisen.

Aber jede Anfrage als gleich komplex zu behandeln, ist Geldverschwendung.

| Strategie | So funktioniert es | Typische Einsparungen |

|---|---|---|

| Statisches Routing | Leiten Sie Anfragen basierend auf dem Anwendungsfall an vordefinierte Modelle weiter. | 30-40% |

| Dynamisches Routing | Analysiere die Abfragekomplexität in Echtzeit und wähle das optimale Modell aus | 45-60% |

| Kaskadierend | Probieren Sie zunächst günstigere Modelle aus und rüsten Sie erst auf, wenn es nötig ist. | 50-70% |

| LLM Shepherding | Teure Modelle dienen als Orientierungshilfe, günstigere Modelle zur Umsetzung. | 60-75% |

Untersuchungen auf arXiv zeigen, dass kleine Sprachmodelle (SLMs) mit gezielten Hinweisen aus großen Sprachmodellen (LLMs) bei minimalem Ressourcenverbrauch der LLMs höhere Genauigkeit erzielen. Die Daten belegen, dass sich die Genauigkeit des SLM (Llama-3.2-3B-Instruct) in Abhängigkeit von der Größe der Hinweise des LLM (Llama-3.3-70B-Versatile) deutlich verbessert, wenn die Hinweise nur 10–30% der vollständigen LLM-Antwort ausmachen. Darüber hinaus nimmt der Nutzen ab 60% ab.

Dies motiviert einen beratenden Ansatz: Man bittet um Hinweise statt um vollständige LLM-Antworten. Die Strategie behandelt das teure Modell eher als Berater denn als Ausführenden – man bezahlt für Anleitung, nicht für fertige Antworten.

Optimierungstechniken auf Infrastrukturebene

Die Modellauswahl ist nur ein Hebel. Die Infrastrukturoptimierung behebt die hardwarebedingten Engpässe, die die Leistung einschränken und die Kosten in die Höhe treiben.

KV-Cache-Verwaltung

Der Key-Value-Cache ist eine grundlegende Optimierung in Transformer-basierten Modellen. Er beansprucht aber auch einen erheblichen Teil des Speichers.

Bei der autoregressiven Generierung berechnet das Modell in jedem Schritt die Aufmerksamkeit über alle vorherigen Token. Ohne Caching erfordert dies die wiederholte Neuberechnung der Repräsentationen für die gesamte Sequenz. Der KV-Cache speichert diese Berechnungen und tauscht so Speicherplatz gegen Geschwindigkeit.

Hier liegt das Problem: Die Cache-Größe wächst linear mit der Sequenzlänge und der Batchgröße. Bei Anwendungen mit langem Kontext kann der Cache-Speicher die Modellgewichte selbst übersteigen. Strategien zur Bewältigung dieses Problems umfassen Folgendes:

- Quantisierung zwischengespeicherter Werte auf niedrigere Genauigkeit (8-Bit oder 4-Bit)

- Umsetzung von Räumungsrichtlinien, die weniger relevante Token aussortieren

- Verwendung von gleitenden Aufmerksamkeitsfenstern für begrenztes Speicherwachstum

- Komprimierung von Cache-Einträgen durch gelernte Komprimierungstoken

Forschungen zur satzbasierten Gist-Komprimierung zeigen, dass vortrainierte LLMs feinabgestimmt werden können, um Kontext mithilfe gelernter Token zu komprimieren und so den Speicher- und Rechenaufwand für lange Sequenzen zu reduzieren. Parametereffiziente Feinabstimmungsmethoden ermöglichen es kompakten Modellen, Schlussfolgerungsaufgaben ohne vollständige KV-Cache-Erweiterung zu bewältigen.

Batchverarbeitung und Durchsatzoptimierung

Inferenzsysteme müssen ein Gleichgewicht zwischen Latenz und Durchsatz finden. Größere Batchgrößen verbessern zwar die Hardwareauslastung, erhöhen aber die Wartezeiten für einzelne Anfragen.

Die Rechenphase während des Vorbefüllens (Verarbeitung der Eingabe-Token) profitiert enorm von der Batch-Verarbeitung – die GPU-Auslastung steigt linear mit der Batch-Größe bis zu den Hardwaregrenzen. Die Dekodierungsphase hingegen ist bandbreitenbegrenzt. Das Hinzufügen weiterer Anfragen zu einem Batch erhöht den Durchsatz nicht proportional, da die Speicherbandbreite zum Flaschenhals wird.

Effektive Strategien trennen Vorbefüllung und Dekodierung in separate Batches, wodurch jede Phase unabhängig optimiert werden kann. Kontinuierliche Batching-Verfahren fügen neue Anfragen dynamisch zu laufenden Batches hinzu, anstatt auf die Fertigstellung des gesamten Batches zu warten.

Modellquantisierung

Die Quantisierung reduziert die Modellgenauigkeit von 32-Bit- oder 16-Bit-Gleitkommazahlen auf 8-Bit- oder 4-Bit-Ganzzahlen. Dadurch werden Speicherbedarf und Bandbreitenverbrauch proportional reduziert.

Die GPTQ-Quantisierung ist laut Forschungsergebnissen des IST Austria mathematisch äquivalent zum Babai-Algorithmus der nächsten Ebene. Diese geometrische Interpretation liefert Fehlergrenzen für die Quantisierung großer Sprachmodelle und ermöglicht eine 4-Bit-Präzision mit sorgfältig kalibrierten Parametern, um Genauigkeitsverluste zu minimieren.

DistilBERT demonstriert die Leistungsfähigkeit der Modelldestillation in Kombination mit Quantisierung. Entwickelt vom Hugging Face-Team, ist es 40% kleiner und schneller als BERT base – etwa 66 Millionen Parameter gegenüber 110 Millionen – und behält dabei 97% der Leistung bei nachgelagerten Aufgaben bei.

| Technik | Gedächtnisreduzierung | Geschwindigkeitsverbesserung | Auswirkungen auf die Genauigkeit |

|---|---|---|---|

| 8-Bit-Quantisierung | 50% | 1,5-2x | <1%-Verlust |

| 4-Bit-Quantisierung | 75% | 2-3x | 1-3% Verlust |

| Modelldestillation | 40-60% | 2-3x | 2-5% Verlust |

| KV-Cache-Quantisierung | 30-50% (nur Cache) | 1,3-1,8x | <1%-Verlust |

Semantisches Caching zur Kostenreduzierung

Caching erscheint naheliegend – Ergebnisse speichern, wiederverwenden. LLM-Anwendungen stellen jedoch besondere Herausforderungen dar.

Die exakte Zeichenkettenübereinstimmung schlägt fehl, weil Nutzer identische Fragen unterschiedlich formulieren. “Was ist die Hauptstadt von Frankreich?” und “Sag mir die Hauptstadt von Frankreich” sollten zum selben Cache-Eintrag führen.

Semantisches Caching löst dieses Problem, indem Anfragen in einen Vektorraum eingebettet und anhand von Ähnlichkeit statt exakter Zeichenketten abgeglichen werden. Bei einer neuen Anfrage berechnet das System deren Einbettung und sucht nach passenden Einträgen im Cache. Liegt eine Übereinstimmung oberhalb eines bestimmten Schwellenwerts, wird die zwischengespeicherte Antwort zurückgegeben. Andernfalls wird das Modell aufgerufen und das Ergebnis zwischengespeichert.

Bei Anwendungen mit hohem Datenaufkommen erreicht semantisches Caching typischerweise nach der ersten Betriebswoche Trefferraten von 40–60%. Bei den Preisen von GPT-5 bedeutet dies erhebliche monatliche Einsparungen für eine einzelne Funktion.

Die Implementierung erfordert eine sorgfältige Abstimmung des Ähnlichkeitsschwellenwerts. Ist er zu hoch angesetzt, sinkt die Anzahl der Cache-Treffer drastisch. Ist er zu niedrig, liefert das System veraltete oder irrelevante Antworten, was die Benutzerfreundlichkeit beeinträchtigt.

Schnelles Engineering und Token-Management

Eingabetoken kosten Geld. Ausgabetoken kosten mehr – oft das 3- bis 5-fache des Eingabepreises.

Die Optimierung nach dem Prompt-Prinzip zielt darauf ab, mit weniger Token die gleichen Ergebnisse zu erzielen. Zu den Techniken gehören:

- Unnötigen Kontext oder Beispiele entfernen

- Verwendung prägnanterer Anweisungen

- Systemmeldungen effizient nutzen

- Implementierung von Few-Shot-Learning mit minimalen Beispielen

- Begrenzung der Ausgabelänge durch Anweisungen

Die Herausforderung besteht darin, Kürze und Klarheit in Einklang zu bringen. Zu knappe Vorgaben führen oft zu Ergebnissen minderer Qualität, was Wiederholungsversuche erfordert, deren Kosten die ursprüngliche Einsparung übersteigen.

Tests zeigen, dass eine systematische Promptkomprimierung – das Entfernen redundanter Tokens unter Beibehaltung der semantischen Bedeutung – die Eingabekosten um 20–40% senken kann, ohne die Genauigkeit zu beeinträchtigen. Dies erfordert jedoch eine Evaluierungsinfrastruktur, um zu validieren, dass die komprimierten Prompts die Ausgabequalität beibehalten.

Aufbau eines Kostenüberwachungssystems

Was nicht gemessen wird, kann nicht optimiert werden.

Produktionsfähige LLM-Systeme benötigen Instrumente, die Kosten auf verschiedenen Granularitätsebenen erfassen: pro Benutzer, pro Funktion, pro Modell, pro Anfragetyp. Diese Transparenz ermöglicht datengestützte Optimierungsentscheidungen.

Die meisten Teams beginnen mit den monatlichen Gesamtrechnungen der Anbieter. Das reicht nicht aus. Die Instrumente sollten Folgendes erfassen:

- Tokenanzahl (Eingabe, Ausgabe, zwischengespeichert) pro Anfrage

- Verwendetes Modell und Routing-Entscheidungen

- Latenz- und Durchsatzmetriken

- Cache-Trefferraten und Effektivität

- Fehlerraten und Wiederholungskosten

- Kostenzuordnung zu Funktionen oder Benutzern

Hierarchische Budgetkontrollen ermöglichen es Teams, Ausgabenlimits auf verschiedenen Ebenen festzulegen – unternehmensweit, pro Team, pro Funktion oder pro Benutzer. Wird ein Budgetschwellenwert erreicht, kann das System automatisch auf kostengünstigere Modelle umleiten oder eine Ratenbegrenzung implementieren.

Laut einer MIT-Studie zu Skalierungsgesetzen von KI ist es entscheidend, das Rechenbudget und die angestrebte Modellgenauigkeit im Vorfeld festzulegen. Die Studie ergab, dass ein durchschnittlicher relativer Fehler (ARE) von etwa 41 TP3T die bestmögliche Genauigkeit aufgrund von zufälligem Startrauschen darstellt, aber ein ARE von bis zu 201 TP3T für die Entscheidungsfindung weiterhin sinnvoll ist.

Das Problem der Anbieterökonomie

Managed LLM-Dienste wie Azure OpenAI bringen Herausforderungen im Kostenmanagement mit sich, die sich grundlegend von traditionellen Cloud-Modellen unterscheiden. Die Preisstruktur hängt von Input-Tokens, Output-Tokens, zwischengespeicherten Tokens, bereitgestellten Durchsatzeinheiten (PTUs) und Bereitstellungskonfigurationen ab.

Azure OpenAI verschleiert durch seine Architektur die wahren Kostentreiber. Unternehmen stellen Kapazität in PTUs bereit, ohne Einblick in den tatsächlichen Tokenverbrauch oder die Modellnutzung zu haben. Dies führt zu Verantwortlichkeitslücken – Entwicklungsteams können nicht feststellen, welche Funktionen die Kosten verursachen oder ob Optimierungen tatsächlich funktionieren.

Cloud-Kostenmanagementplattformen, die für traditionelle Infrastrukturen entwickelt wurden, bewältigen KI-Workloads nicht effektiv. Sie erfassen zwar VM-Stunden und Speicherbytes, bieten aber nicht die für die LLM-Optimierung erforderliche Token-Ebene.

FinOps für KI erfordert eine anwendungsfallbezogene Wirtschaftlichkeitsanalyse. Teams müssen die Stückkosten – Kosten pro Konversation, pro zusammengefasstem Dokument, pro Code-Fertigstellung – erfassen, anstatt nur die Gesamtausgaben zu betrachten. Dies verschiebt den Fokus von der Infrastrukturkostenverwaltung hin zur Produktionseffizienz.

Rahmen für die Umsetzung in der Praxis

Optimierung ist kein einmaliges Projekt. Es ist eine fortlaufende Praxis, die sich mit den Nutzungsmustern und der Verfügbarkeit von Modellen weiterentwickelt.

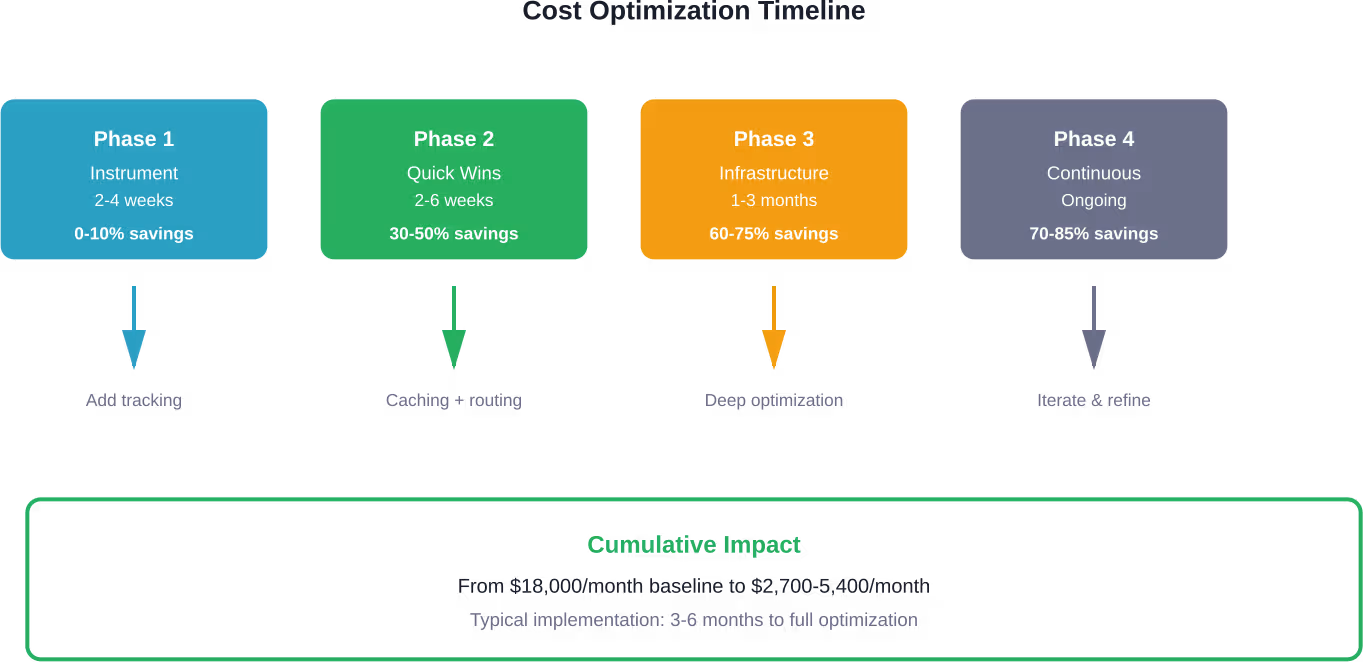

Phase 1: Ausgangslage und Instrument

Beginnen Sie mit einer umfassenden Instrumentierung. Implementieren Sie ein Tracking-System, das Token-Nutzung, Modellauswahl, Latenz und Kosten auf Anfrageebene erfasst. Legen Sie Basismetriken fest: aktuelle Kosten, Verteilung auf verschiedene Anwendungsfälle und Leistungsbenchmarks.

Diese Phase dauert in der Regel 2-4 Wochen und erfordert nur minimale Codeänderungen – hauptsächlich das Hinzufügen von Protokollierung und Metrikenerfassung.

Phase 2: Schnelle Erfolge

Setzen Sie leicht umsetzbare Optimierungen um:

- Semantisches Caching für häufige Abfragen einsetzen

- Leiten Sie einfache Anfragen an günstigere Modelle weiter.

- Komprimieren Sie Eingabeaufforderungen, indem Sie redundanten Kontext entfernen.

- Maximale Ausgabetoken-Grenzwerte festlegen

Diese Änderungen führen oft innerhalb weniger Wochen zu Kostensenkungen von 30-50% ohne Genauigkeitsverlust.

Phase 3: Infrastrukturoptimierung

Nun zu tiefergehenden Optimierungen:

- Dynamisches Routing mit Komplexitätsanalyse implementieren

- Quantisierte Modelle für latenztolerante Workloads einsetzen

- Optimierung des KV-Cache-Managements

- Kontinuierliche Batchverarbeitung zur Durchsatzverbesserung implementieren

Diese Phase erfordert einen höheren Entwicklungsaufwand – typischerweise 1-3 Monate – ermöglicht aber eine zusätzliche Kostenreduzierung des 20-40%.

Phase 4: Kontinuierliche Verbesserung

Richten Sie Feedbackschleifen ein. Überwachen Sie, welche Anfragen wohin weitergeleitet werden, welche Cache-Einträge häufig genutzt werden und wo Latenz- oder Qualitätsprobleme auftreten. Nutzen Sie diese Daten, um die Routing-Logik zu optimieren, Cache-Richtlinien zu aktualisieren und Quantisierungsparameter neu anzupassen.

Das Testen neuer Modelle wird zur Routine. Wenn Anbieter verbesserte Optionen veröffentlichen, ermöglicht die Instrumentierung schnelle A/B-Tests, um Kosten-Nutzen-Abwägungen vor der vollständigen Einführung zu validieren.

Häufige Fallstricke, die es zu vermeiden gilt

Kostenoptimierung kann nach hinten losgehen, wenn Teams die falschen Kennzahlen optimieren oder wichtige Fähigkeiten opfern:

- Latenzverschlechterung: Aggressives Caching oder die Nutzung langsamerer Modelle kann die Antwortzeiten so stark verlängern, dass die Nutzer dies nicht mehr tolerieren. Bei interaktiven Anwendungen ist die Latenz genauso wichtig wie die Kosten. Nutzer brechen Anwendungen bei Verzögerungen von 3–5 Sekunden ab, unabhängig von der Genauigkeit.

- Qualitätsverlust: Zu aggressives Routing zu kleinen Modellen verschlechtert die Ausgabequalität. Tests mögen in Benchmarks eine akzeptable Genauigkeit zeigen, doch in Grenzfällen der Produktion werden Schwächen deutlich. Implementieren Sie daher neben der Kostenverfolgung auch ein Qualitätsmonitoring.

- Übermäßige Komplexität des Caching: Semantisches Caching erhöht die Komplexität der Infrastruktur. Bei Funktionen mit geringem Datenverkehr übersteigen die Kosten für Implementierung und Wartung des Cachings die Einsparungen. Konzentrieren Sie Ihre Caching-Bemühungen daher zunächst auf Endpunkte mit hohem Datenverkehr.

- Kaltstartkosten außer Acht lassen: Das Laden und Initialisieren von Modellen kann die Leistung und Kosteneffizienz beeinträchtigen. Skalierungsstrategien erfordern eine sorgfältige Abwägung der Startzeit gegenüber den Leerlaufkosten. Leerlaufkosten und Startzeit müssen gegeneinander abgewogen werden.

- Anbieterbindung: Eine zu starke Optimierung für die spezifischen APIs oder Preisstrukturen eines einzelnen Anbieters schafft Migrationshürden. Wenn möglich, sollten anbieterspezifische Details durch Schnittstellen abstrahiert werden, die einen einfachen Wechsel ermöglichen.

Senken Sie die Kosten für die LLM-Einführung dort, wo sie tatsächlich entstehen

Die meisten Kosten für die Implementierung von LLM werden nicht allein durch das Modell verursacht – sie ergeben sich aus der Art und Weise, wie das System konzipiert, integriert und skaliert wird. AI Superior Das Unternehmen deckt den gesamten Bereitstellungszyklus ab – von der Modellauswahl und -optimierung bis hin zur Infrastruktureinrichtung und -optimierung. Der Ansatz konzentriert sich auf die Entwicklung von KI-Systemen, die der tatsächlichen Arbeitslast entsprechen. Dies kann durch die Verwendung benutzerdefinierter Modelle, die Optimierung bestehender Modelle oder die Balance zwischen API-Nutzung und interner Bereitstellung erreicht werden. Dadurch werden unnötige Schlussfolgerungen reduziert, eine überdimensionierte Infrastruktur vermieden und die Leistung auch bei steigender Nutzung vorhersehbar gehalten.

Kostenprobleme bei der Implementierung entstehen üblicherweise durch Entscheidungen, die vor dem Start getroffen werden – Modellgröße, Datenpipelines und Systemaufrufhäufigkeit. Anpassungen dieser Faktoren haben einen größeren Einfluss als ein späterer Toolwechsel. Damit Ihre LLM-Implementierung auch bei Skalierung effizient bleibt, kontaktieren Sie uns. AI Superior und richten Sie Ihre Konfiguration daran aus, wie sie tatsächlich in der Produktion eingesetzt wird.

Ausblick: Kostenentwicklung

Manche glauben, die Kosten für LLM würden gegen Null sinken, wodurch eine Optimierung überflüssig werde. Die Geschichte spricht jedoch dagegen.

Die Rechenkosten sinken seit Jahrzehnten kontinuierlich, doch der Bedarf wächst schneller. Leistungsfähigere Modelle ermöglichen neue Anwendungsfälle, die zusätzlichen Rechenaufwand erfordern. Kontextfenster erweitern sich von 2.048 auf über 128.000 Tokens, wodurch der Speicherbedarf exponentiell steigt. Multimodale Modelle verarbeiten neben Text auch Bilder und Videos.

Organisationen, die LLM-Kosten strategisch begreifen und frühzeitig Optimierungsfähigkeiten aufbauen, schaffen Wettbewerbsvorteile, die sich im Laufe der Zeit verstärken. Kosteneffizienz ermöglicht nachhaltiges Wachstum und damit eine breitere Implementierung und Experimentierfreude, ohne dass Budgetbeschränkungen die Produktentwicklung einschränken.

Infrastrukturoptimierung, Modellauswahl und Token-Management sind keine einmaligen Projekte. Sie gehören zu den Kernkompetenzen von KI-Unternehmen. Die Teams, die diese Fähigkeiten jetzt aufbauen, werden mit strukturellen Kostenvorteilen arbeiten, die Wettbewerber nur schwer erreichen können.

Häufig gestellte Fragen

Wie lassen sich die LLM-Kosten am schnellsten um 301 TP3T oder mehr senken?

Implementieren Sie semantisches Caching für häufige Anfragen und leiten Sie einfache Anfragen an kostengünstigere Modelle weiter. Diese beiden Maßnahmen führen typischerweise innerhalb von 4–6 Wochen mit minimalem Entwicklungsaufwand zu einer Kostenreduzierung von 30–501 TP3T. Beginnen Sie mit der Instrumentierung, um Endpunkte mit hohem Anfragevolumen und geringer Anfragediversität zu identifizieren – diese eignen sich ideal für das Caching.

Sollte ich GPT-4 oder Claude zur Kostenoptimierung verwenden?

Keines von beiden ist ausschließlich. GPT-5.4 berechnet $2,50 pro Million Eingabe-Token, während Claude 4.5 Sonnet $3 pro Million Eingabe-Token berechnet. Die Kosten pro Token sind jedoch nicht der einzige Faktor – Ausgabequalität, Latenz und Anforderungen an die Kontextlänge spielen ebenfalls eine Rolle. Implementieren Sie ein Routing, das das jeweilige Modell für Workloads nutzt, bei denen es das beste Kosten-Nutzen-Verhältnis bietet. Nur das Testen verschiedener Modelle mit Produktionsdaten ermöglicht die Bestimmung der optimalen Zuweisung.

Beeinträchtigt die Quantisierung die Modellgenauigkeit signifikant?

Nicht, wenn es korrekt durchgeführt wird. Untersuchungen zeigen, dass die 8-Bit-Quantisierung typischerweise einen Genauigkeitsverlust von weniger als 11 TP³T verursacht und gleichzeitig den Speicherbedarf um 501 TP³T reduziert. Selbst die 4-Bit-Quantisierung mit sorgfältiger Kalibrierung (wie GPTQ) führt nur zu einem Genauigkeitsverlust von 1–31 TP³T bei einer Speicherreduzierung um 751 TP³T. Entscheidend ist, quantisierte Modelle vor dem Produktiveinsatz anhand repräsentativer Evaluierungsdatensätze zu testen, um eine akzeptable Leistung zu gewährleisten.

Wie viel kann Caching im Produktivbetrieb tatsächlich einsparen?

Die Trefferraten des semantischen Caching erreichen bei den meisten Anwendungen nach der ersten Betriebswoche typischerweise 40–601 TP3T. Für einen Support-Chatbot, der monatlich 500.000 Anfragen zu GPT-4-Preisen verarbeitet, entspricht dies einer monatlichen Einsparung von 1 TP4T7.200–10.800. Die Effektivität variiert jedoch je nach Anwendungsfall: Anwendungen im FAQ-Stil weisen höhere Trefferraten auf, während kreative oder stark personalisierte Anwendungen weniger vom Caching profitieren.

Wie hoch ist der ROI beim Aufbau einer kundenspezifischen Optimierungsinfrastruktur?

Bei Anwendungen mit monatlichen LLM-Kosten von über 1.400.000 INR amortisiert sich eine kundenspezifische Optimierungsinfrastruktur in der Regel innerhalb von 3–6 Monaten. Der Entwicklungsaufwand für eine umfassende Implementierung inklusive Instrumentierung, Caching und Routing beträgt 2–4 Entwicklermonate. Organisationen mit geringeren Kosten sollten sich zunächst auf einfachere Optimierungen wie die schnelle Komprimierung und die Auswahl des passenden Anbieters konzentrieren, bevor sie eine kundenspezifische Infrastruktur aufbauen.

Wie kann ich Kostenoptimierung und Reaktionszeit in Einklang bringen?

Messen Sie beide Kennzahlen gemeinsam und definieren Sie akzeptable Kompromisse. Einige Optimierungen, wie z. B. Caching, reduzieren sowohl Kosten als auch Latenz. Andere, wie das Routing zu kleineren Modellen, können die Latenz leicht erhöhen, aber gleichzeitig die Kosten senken. Definieren Sie Latenz-SLAs für jeden Anwendungsfall – interaktiver Chat erfordert möglicherweise Reaktionszeiten im Subsekundenbereich, während die Stapelverarbeitung von Dokumenten Minuten toleriert. Optimieren Sie innerhalb der gegebenen Einschränkungen, anstatt Kosten oder Latenz isoliert zu betrachten.

Kann ich LLMs lokal betreiben, um Kosten zu reduzieren?

Möglicherweise. Die Bereitstellung vor Ort eliminiert zwar die API-Kosten, erfordert aber GPU-Infrastruktur, technisches Know-how für die Optimierung der Bereitstellung und einen gewissen Betriebsaufwand. Dies wird erst bei einer großen Anzahl von Anfragen – etwa 500.000+ pro Tag – kosteneffektiv, da sich die fixen Infrastrukturkosten dann auf das hohe Volumen verteilen. Unterhalb dieser Schwelle sind verwaltete APIs in der Regel günstiger, wenn man die Gesamtbetriebskosten einschließlich des Entwicklungsaufwands berücksichtigt.

Schlussfolgerung

Die Kostenoptimierung im Bereich Lifecycle-Management ist für KI-basierte Produkte unerlässlich. Die Wirtschaftlichkeit unterscheidet sich grundlegend von herkömmlicher Software – die variablen Kosten skalieren mit der Nutzung und führen zu einer produktionsähnlichen Stückkostenrechnung, die kontinuierliche Aufmerksamkeit erfordert.

Doch das Potenzial ist beträchtlich. Organisationen, die eine umfassende Optimierung implementieren – eine Kombination aus intelligenter Modellauswahl, Infrastrukturoptimierung, semantischem Caching und Token-Management – erzielen Kostensenkungen von 60 bis 851 TP3T, ohne dabei Abstriche bei Qualität oder Benutzerfreundlichkeit zu machen.

Beginnen Sie mit der Instrumentierung. Teams können nur optimieren, was sie messen. Schaffen Sie Transparenz hinsichtlich Token-Nutzung, Modellauswahl und Kostenzuordnung auf Anfrageebene.

Setzen Sie anschließend schnell umsetzbare Maßnahmen um: Speichern Sie häufige Abfragen im Cache und leiten Sie einfache Anfragen an effiziente Modelle weiter. Dies führt zu unmittelbaren Erfolgen und stärkt gleichzeitig die organisatorischen Fähigkeiten für eine tiefergehende Optimierung.

Den Wettbewerbsvorteil erlangen Teams, die Kostenoptimierung als kontinuierliche Disziplin und nicht als einmaliges Projekt betrachten. Sie schaffen die Infrastruktur, etablieren die entsprechenden Praktiken und passen diese kontinuierlich an, um sich ändernden Nutzungsmustern und neuen Modellen anzupassen.

Die Zukunft des KI-Einsatzes gehört den Organisationen, die sowohl die technischen als auch die wirtschaftlichen Herausforderungen meistern. Beginnen Sie noch heute mit der Optimierung.