Kurzzusammenfassung: Die Preise für LLM variieren stark zwischen den Anbietern. Die Input-Token lagen im März 2026 zwischen 0,10 und 5 TP4T5 pro Million, die Output-Token zwischen 0,40 und 25 TP4T0 pro Million. Die GPT-Modelle von OpenAI, Claude von Anthropic und Gemini von Google dominieren den Markt mit unterschiedlichen Preis-Leistungs-Verhältnissen. Um die Kosten zu optimieren und gleichzeitig die Qualität zu sichern, ist es unerlässlich, die tokenbasierte Preisgestaltung, die Kontextfenster und die Nutzungsmuster zu verstehen.

Die explosionsartige Zunahme großer Sprachmodell-APIs hat eine komplexe Preislandschaft geschaffen. Unternehmen stehen vor der wichtigen Entscheidung, welche Modelle den besten Nutzen für ihre spezifischen Anwendungsfälle bieten.

Aber der springende Punkt ist: Bei der Modellwahl geht es nicht nur darum, die günstigste Option zu finden. Die Ökonomie der LLM-Inferenz hängt von mehreren Faktoren ab: Token-Preise, Kontextfensterbeschränkungen, Latenzanforderungen und versteckte Kosten, die Ihre Rechnung um das Zwei- bis Dreifache erhöhen können.

Dieser Vergleich analysiert die Preise führender Anbieter wie OpenAI, Anthropic, Google und neuerer Alternativen. Die Daten spiegeln den aktuellen Stand der Preise ab März 2026 wider, wobei die Anbieter ihre Preise regelmäßig anpassen.

Verständnis tokenbasierter Preismodelle

LLM-Anbieter berechnen die Gebühren anhand der verarbeiteten Token. Ein Token entspricht etwa vier Zeichen Text oder ungefähr 0,75 Wörtern im Englischen. Beispielsweise wird die Zeichenkette “ChatGPT is great!” in sechs Token kodiert: [“Chat”, “G”, “PT”, ”is”, ”great”, “!”].

Die meisten Anbieter unterteilen die Preisgestaltung in zwei Komponenten: Input-Tokens (die Entwickler an das Modell senden) und Output-Tokens (die das Modell generiert). Output-Tokens kosten in der Regel 3- bis 5-mal so viel wie Input-Tokens, da ihre Generierung mehr Rechenressourcen erfordert.

Die Gesamtzahl der Token in einem API-Aufruf beeinflusst drei entscheidende Faktoren: die Kosten des Aufrufs, die Dauer der Ausführung und ob er innerhalb der Kontextfenstergrenzen des Modells liegt.

Kontextfenster und Caching

Kontextfenster definieren die maximale Anzahl an Tokens, die ein Modell in einer einzelnen Anfrage verarbeiten kann. Seit Anfang 2026 haben sich Kontextfenster deutlich vergrößert. Anthropics Claude Opus 4.6 bietet in der Beta-Phase ein Kontextfenster für 1 Million Tokens, während die meisten Produktionsmodelle 128.000 bis 200.000 Tokens verarbeiten können.

Größere Kontextfenster ermöglichen komplexere Anwendungen, erhöhen aber die Kosten proportional. Eine Eingabe von 100.000 Token zu $3 pro Million Token kostet $0,30 pro Anfrage – multipliziert man dies mit Tausenden von täglichen Anfragen, steigen die Kosten schnell an.

Schnelles Caching ermöglicht erhebliche Kosteneinsparungen. OpenAI bietet zwischengespeicherte Eingaben zu 50% der Standard-Eingabekosten an. Laut OpenAIs Preisdokumentation berechnet GPT-4.1 $2,00 pro Million Eingabe-Token, aber nur $0,50 pro Million zwischengespeicherter Eingabe-Token.

Aufschlüsselung der Preise der wichtigsten Anbieter

Der Wettbewerbsmarkt umfasst drei dominante Anbieter und mehrere aufstrebende Alternativen. Jeder Anbieter bietet verschiedene Modellstufen an, die für unterschiedliche Anwendungsfälle optimiert sind.

OpenAI-Preisstruktur

Die GPT-Modelle von OpenAI decken verschiedene Intelligenz- und Kostenstufen ab. Wie in Community-Diskussionen vom Januar 2026 dargelegt, entwickeln sich die Preise mit der Einführung neuer Modelle stetig weiter.

| Modell | Eingabe (pro 1 Mio. Token) | Zwischengespeicherte Eingabe (pro 1M) | Ausgabe (pro 1 Million Token) | Kontextfenster |

|---|---|---|---|---|

| GPT-4.1 | $2.00 | $0.50 | $8.00 | 128K |

| GPT-4o | $2.50 | $1.25 | $10.00 | 128K |

| GPT-4-32k (veraltet) | $60.00 | N / A | $120.00 | 32K |

OpenAI hat die GPT-4-32k-Modelle als veraltet eingestuft; die Abschaltung ist für den 6. Juni 2025 geplant. Laut der Dokumentation von OpenAI zur Veraltung hatten bestehende Benutzer nur begrenzt Zeit, auf neuere Modelle wie GPT-4o umzusteigen.

Die GPT-5.4-Modellfamilie stellt die neueste Entwicklung von OpenAI dar. GPT-5.4 mini wurde im März 2026 veröffentlicht und ist für Free- und Go-Nutzer über die “Thinking”-Funktion von ChatGPT verfügbar. Für zahlende Nutzer dient GPT-5.4 mini als Ausweichlösung bei Ratenbegrenzung für GPT-5.4 Thinking.

Anthropic Claude Preisgestaltung

Die Claude-Modelle von Anthropic haben sich als starke Konkurrenten von OpenAI etabliert, insbesondere bei Programmier- und Agentenaufgaben. Das Unternehmen veröffentlichte Claude Opus 4.6 im Februar 2026 und Claude Sonnet 4.6 kurz darauf.

Claude Opus 4.6 behält trotz erheblicher Funktionsverbesserungen die Preise von $5 pro Million Input-Token und $25 pro Million Output-Token bei. Laut Anthropics Ankündigung bleibt diese Preisgestaltung gegenüber der Vorgängerversion Opus 4.5 unverändert.

Claude Sonnet 4.6 bietet mit $3 pro Million Input-Token und $15 pro Million Output-Token erschwinglichere Preise – den gleichen Preis wie Sonnet 4.5. Anthropic beschreibt Sonnet 4.6 als nahezu so intelligent wie Opus, jedoch zu einem praktischeren Preis für alltägliche Aufgaben.

| Modell | Eingabe (pro 1 Mio. Token) | Ausgabe (pro 1 Million Token) | Kontextfenster | Am besten geeignet für |

|---|---|---|---|---|

| Claude Opus 4.6 | $5.00 | $25.00 | 1M (Beta) | Komplexes Denken, Codierung, Agenten |

| Claude Sonett 4.6 | $3.00 | $15.00 | 1M (Beta) | Ausgewogenes Verhältnis von Leistung und Kosten |

| Claude Opus 4.5 | $5.00 | $25.00 | 200.000 | Legacy-Anwendungen |

Das 1-Millionen-Token-Kontextfenster in Claude Opus 4.6 ist eine Premiere für die Opus-Klassenmodelle von Anthropic. Diese Erweiterung ermöglicht die Verarbeitung ganzer Codebasen oder umfangreicher Dokumente in einzelnen Anfragen.

Google Gemini Preise

Googles Gemini-Modelle konkurrieren preislich sehr stark, insbesondere bei Anwendungen mit hohem Datenvolumen. Die Gemini-Familie umfasst mehrere Leistungsstufen, die für unterschiedliche Leistungsanforderungen optimiert sind.

Die Preisstrukturen für Gemini-Modelle variieren je nach Tarif und Nutzungsvolumen erheblich. Google positioniert Gemini als kostengünstige Alternative für Anwendungen, die hohe Leistung erfordern, ohne dafür Premiumpreise zahlen zu müssen.

Versteckte Kosten und Preismechanismen

Der angegebene Preis pro Token erzählt nur einen Teil der Geschichte. Mehrere versteckte Faktoren können die tatsächlichen Kosten drastisch erhöhen.

Ausgabetoken-Multiplikatoren

Ausgabetoken sind bei allen Anbietern durchweg 3- bis 5-mal so teuer wie Eingabetoken. Eine Anwendung, die lange Antworten generiert, hat unverhältnismäßig höhere Kosten als eine, die große Eingaben verarbeitet, aber kurze Ausgaben erzeugt.

Die Festlegung der maximalen Anzahl an Ausgabetokens (Parameter „max_tokens“) hilft, die Kosten zu kontrollieren. Ist der Wert zu niedrig, werden Antworten vor Abschluss abgeschnitten. Ist er zu hoch, kann das Modell unnötige Inhalte generieren, insbesondere bei höheren Temperatureinstellungen, die Kreativität fördern.

Ratenbegrenzungen und Ausweichkosten

Die meisten Anbieter implementieren Ratenbegrenzungen basierend auf Anfragen pro Minute, Token pro Minute oder beidem. Wenn Anwendungen diese Grenzwerte erreichen, schlagen sie entweder fehl oder greifen auf alternative Modelle zurück.

Die GPT-5.4-Implementierung von OpenAI veranschaulicht dieses Muster. Laut den Versionshinweisen von OpenAI vom März 2026 nutzen zahlende Nutzer GPT-5.4 mini als Fallback, sobald die Ratenbegrenzungen von GPT-5.4 Thinking erreicht sind. Dadurch wird die Servicekontinuität gewährleistet, jedoch möglicherweise zu unterschiedlichen Kostenstrukturen.

Kontextfensterökonomie

Größere Kontextfenster ermöglichen komplexere Anwendungen, erhöhen aber die Kosten linear. Bei einer Kontextlänge von 128K Tokens erreicht der KV-Cache von LLama2-7B mit halber Genauigkeit 64 GB, berechnet als: Anzahl_Schichten × Anzahl_KV_Kopf × Kopfdimension × Sequenzlänge × Größe(fp16) × 2.

Untersuchungen zur Effizienz der LLM-Dekodierung zeigen, dass die Größe des KV-Caches linear mit der Sequenzlänge wächst, was während der Dekodierung zu Speicherengpässen führt, die wiederum höhere Betriebskosten nach sich ziehen.

Überlegungen zur Preisgestaltung für Unternehmen

Bei der Implementierung in Unternehmen gelten andere wirtschaftliche Rahmenbedingungen als bei einzelnen Entwicklern oder kleinen Teams. Mengenrabatte, individuelle Preisgestaltung und Bereitstellungsoptionen beeinflussen die Gesamtbetriebskosten erheblich.

Cloud-API vs. selbstgehostete Bereitstellung

Organisationen können kommerzielle LLM-Dienste abonnieren oder Modelle auf ihrer eigenen Infrastruktur implementieren. Eine auf arXiv veröffentlichte Studie zur On-Premise-Implementierung von LLM-Lösungen ergab, dass die Kostendeckung kommerzieller Dienste eine sorgfältige Analyse der Nutzungsmuster und Infrastrukturkosten erfordert.

Die Studie definierte vier Kriterien für die Modellauswahl: Leistungsgleichheit mit führenden kommerziellen Modellen innerhalb des 20%-Zeitraums, Betriebskompatibilität, Sicherheitsanforderungen und Kosteneffizienz im großen Maßstab. Bei Anwendungen mit hohem Datenvolumen kann Self-Hosting die Kosten senken, die anfänglichen Investitionen in die Infrastruktur bleiben jedoch beträchtlich.

Kostenoptimierung hierarchischer Architekturen

Aktuelle Benchmark-Studien zu Multiagenten-LLM-Architekturen für die Finanzdokumentenverarbeitung haben gezeigt, dass hierarchische Architekturen das beste Kosten-Genauigkeits-Verhältnis bieten. Diese Systeme erreichten eine reflexive Architekturgenauigkeit von 97,71 TP3T bei Kosten von 60,91 TP3T.

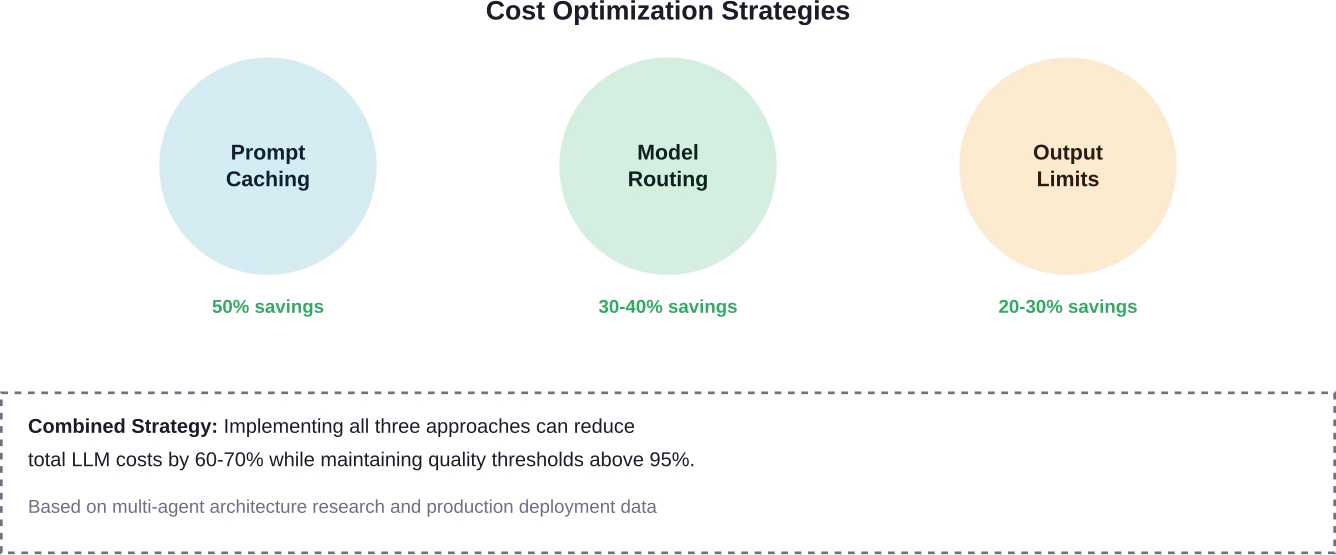

Die Forschung hat gezeigt, dass semantisches Caching, Modellrouting und adaptive Verarbeitung die Betriebskosten deutlich senken können, ohne die Qualität zu beeinträchtigen. Diese Techniken gewinnen zunehmend an Bedeutung, wenn Anwendungen Millionen von Anfragen pro Tag verarbeiten.

Neue Alternativen und regionale Preisgestaltung

Neben den drei großen Anbietern bieten mehrere Alternativen wettbewerbsfähige Preise für bestimmte Anwendungsfälle.

DeepSeek und Open-Source-Modelle

DeepSeek hat durch aggressive Preisgestaltung bei leistungsstarken Modellen Aufmerksamkeit erregt. Das Unternehmen positioniert sich als kostengünstige Alternative für Anwendungen, die keine absolute Spitzenleistung erfordern.

Open-Source-Modelle, die über Cloud-GPU-Anbieter wie RunPod bereitgestellt werden, bieten eine weitere Möglichkeit. Diese Dienste berechnen die Kosten pro GPU-Stunde anstatt pro Token, wodurch die Kosten für Anwendungen mit hohem Datenaufkommen besser planbar werden.

Anbieter spezialisierter Modelle

Mistral, die Llama-Familie von Meta und die Modelle von NVIDIA bedienen jeweils spezifische Nischen. Laut einer im August 2025 veröffentlichten Modellvergleichsanalyse sollten bei der Modellauswahl neben dem Preis auch der Verwendungszweck, die technischen Spezifikationen und die optimalen Anwendungsfälle berücksichtigt werden.

Die Analyse unterstreicht, dass unterschiedliche Modelle für unterschiedliche Aufgaben hervorragend geeignet sind. Die Auswahl allein aufgrund der niedrigsten Kosten führt oft zu schlechten Ergebnissen und teurer Nachbearbeitung.

Praktischer Kostenberechnungsrahmen

Um die tatsächlichen Kosten abzuschätzen, ist es notwendig, die anwendungsspezifischen Nutzungsmuster zu verstehen. Die vier entscheidenden Parameter sind: durchschnittliche Anzahl der Eingabe-Tokens pro Anfrage, durchschnittliche Anzahl der Ausgabe-Tokens pro Anfrage, erwartete Anfragen pro Tag und der gewählte Tarif.

Eine einfache Berechnung: (Eingabe-Token × Eingabepreis + Ausgabe-Token × Ausgabepreis) × Tägliche Anfragen × 30 Tage = Monatliche Kosten.

Eine Anwendung, die beispielsweise 10.000 Eingabe-Token verarbeitet und pro Anfrage 2.000 Ausgabe-Token generiert und täglich 1.000 Anfragen auf Claude Sonnet 4.6 ausführt: (10.000 × $0,000003 + 2.000 × $0,000015) × 1.000 × 30 = 1.800 $ pro Monat.

Mal ehrlich: Die meisten Anwendungen unterschätzen den tatsächlichen Tokenverbrauch in der Planungsphase um das Zwei- bis Dreifache. Pufferberechnungen erfolgen entsprechend.

Leistungs- vs. Preisüberlegungen

Das günstigste Modell bietet selten das beste Preis-Leistungs-Verhältnis. Laut einer Studie zur Ökonomie der KI-Inferenz variieren die Grenzkosten der LLM-Inferenz erheblich in Abhängigkeit von der Recheneffizienz und der Modellarchitektur.

Studien zur Abfrageapproximation mithilfe von ressourcenschonenden Proxy-Modellen zeigten, dass eine strategische Modellauswahl eine Kosten- und Latenzreduzierung um das Hundertfache ermöglicht. Die Forschung ergab, dass Proxy-Modelle eine Genauigkeit von über 90% erreichen und gleichzeitig die Kosten für bestimmte Abfragetypen drastisch senken.

Der lokale Einsatz auf Endgeräten stellt eine weitere Option dar. Untersuchungen zur Effizienz lokaler Sprachmodelle ergaben, dass lokale Sprachmodelle 88,71 TP3T an einstufigen Chat- und Logikanfragen präzise beantworten können, allerdings mit deutlichen Latenzeinbußen im Vergleich zu Rechenzentrumsbereitstellungen.

Abwägung von Latenz und Kosten

Schnellere Modelle sind in der Regel teurer oder erfordern Premium-Tarife. Anwendungen mit strengen Latenzanforderungen müssen unter Umständen höhere Kosten pro Token in Kauf nehmen, um die Leistungs-SLAs zu erfüllen.

Die Latenzerwartungen variieren je nach Modell und Bereitstellung: Flaggschiffmodelle erreichen typischerweise 20-40 Token/Sekunde, Modelle der mittleren Preisklasse 40-80 Token/Sekunde und optimierte Modelle können auf dedizierter Infrastruktur 100 Token/Sekunde überschreiten.

Vergleichen Sie die Modelle sorgfältig und wählen Sie das richtige aus.

Ein Preisvergleich von mehr als 15 LLMs allein liefert selten ein vollständiges Bild. Die tatsächlichen Kosten entstehen durch die Implementierung der Modelle – Datenqualität, Feinabstimmungsstrategie und Infrastrukturwahl beeinflussen die langfristigen Gesamtkosten. AI Superior arbeitet über den gesamten Lebenszyklus hinweg, von der Datenaufbereitung und Modellauswahl bis hin zu Training, Optimierung und Bereitstellung, und hilft Teams dabei, Modelle auf der Grundlage realer Anwendungsfälle und nicht auf der Grundlage oberflächlicher Preisinformationen auszuwählen und zu konfigurieren.

In der Praxis bedeutet dies oft, überdimensionierte Modelle zu vermeiden, wo sie nicht benötigt werden, oder Ansätze wie Feinabstimmung und Hybridkonfigurationen zu kombinieren, anstatt sich auf ein einzelnes Modell oder eine API zu verlassen. Der Fokus liegt auf dem Aufbau von Systemen, die im Produktivbetrieb effizient laufen, nicht nur auf dem Vergleich von Benchmarks. Wenn Sie mehrere LLMs evaluieren und deren tatsächliche Kosten im Einsatz ermitteln möchten, ist es sinnvoll, Ihre Konfiguration frühzeitig zu überprüfen. Wenden Sie sich an AI Superior Die Modellwahl soll sich an den tatsächlichen Kosten orientieren, nicht nur an den Listenpreisen.

Zukünftige Preistrends

Die Preisgestaltung für LLM-Studiengänge entwickelt sich weiterhin rasant. Bis 2025 und ins Jahr 2026 zeichneten sich mehrere klare Trends ab.

Die Anzahl der Kontextfenster wurde deutlich erhöht, während die Preise pro Token sanken. Claude Opus 4.6 und Sonnet 4.6 bieten beide Kontextfenster mit 1 Million Token zum gleichen Preis wie die vorherigen Modelle mit 200.000 Fenstern. Dies bedeutet eine signifikante Steigerung der Kontextfensterkapazität ohne proportionale Kostensteigerungen.

Die Modell-Altstellungszyklen beschleunigen sich. OpenAIs Entscheidung, GPT-4-32k-Varianten innerhalb von 12 bis 18 Monaten nach Veröffentlichung als veraltet zu kennzeichnen, deutet auf schnellere Iterationszyklen hin. Unternehmen müssen regelmäßige Modellmigrationen und die damit verbundenen Entwicklungskosten einplanen.

Die Kluft zwischen Flaggschiff- und Mittelklassemodellen verringerte sich. Laut Anthropics Ankündigungen erreicht Claude Sonnet 4.6 eine Intelligenz auf Opus-Niveau zu einem Bruchteil der Kosten von 60%. Diese Angleichung der Funktionen über alle Preisklassen hinweg ist vorteilhaft für kostenbewusste Anwender.

Häufig gestellte Fragen

Welcher LLM-Studiengang ist 2026 für den Produktionseinsatz am günstigsten?

DeepSeek und Google Gemini bieten die niedrigsten Kosten pro Token unter den großen Anbietern, aber “am günstigsten” bedeutet nicht immer das beste Preis-Leistungs-Verhältnis. Die Gesamtkosten hängen von den Genauigkeitsanforderungen, dem Nachbearbeitungsaufwand und den Anforderungen an das Kontextfenster ab. Für viele Anwendungen bieten Modelle der mittleren Preisklasse wie Claude Sonnet 4.6 mit $3/$15 pro Million Token eine insgesamt bessere Wirtschaftlichkeit als extrem niedrige Preise bei geringerer Ausgabequalität.

Wie viel spart Prompt-Caching tatsächlich ein?

Die Preisgestaltung von OpenAI für zwischengespeicherte Eingaben ermöglicht Einsparungen von 501 TP3T bei wiederholten Eingabeaufforderungen. Für Anwendungen mit konsistenten Systemeingabeaufforderungen oder Referenzdokumenten entspricht dies einer Gesamtkostenreduzierung von 30–501 TP3T. Die Einsparungen sind besonders hoch bei Anwendungen, die Tausende ähnlicher Anfragen mit gemeinsamem Kontext stellen.

Sollten Unternehmen LLMs selbst hosten oder APIs nutzen?

Untersuchungen zur Wirtschaftlichkeit von On-Premise-Bereitstellungen legen nahe, dass ein konstant hoher Nutzungsdurchsatz und eine entsprechende technische Infrastruktur erforderlich sind, um die Gewinnschwelle zu erreichen. Anwendungen, die monatlich weniger als 100 Millionen Token verarbeiten, profitieren in der Regel von der API-Preisgestaltung. Oberhalb dieser Schwelle ist Self-Hosting rentabel, jedoch müssen neben den reinen Rechenkosten auch DevOps-Aufwand, Modellaktualisierungen und Kosten für das Infrastrukturmanagement berücksichtigt werden.

Warum sind Ausgabetoken teurer als Eingabetoken?

Die Generierung erfordert deutlich mehr Rechenressourcen als die Verarbeitung. Eingabe-Token durchlaufen das Modell einmal zur Kodierung, während für jedes Ausgabe-Token ein vollständiger Durchlauf zur Vorhersage des nächsten Tokens notwendig ist. Dies führt zu einem 3- bis 5-fachen Rechenaufwandsunterschied, der sich in den Preisstrukturen aller Anbieter widerspiegelt.

Wie schätze ich den Tokenverbrauch für meine Anwendung ab?

Nutzen Sie die Tokenisierungstools der jeweiligen Modellanbieter, um typische Anfragen zu messen. OpenAI, Anthropic und Google bieten Tokenisierungs-APIs oder Webtools an. Testen Sie mit repräsentativen Beispieldaten, multiplizieren Sie diese mit dem erwarteten Anfragevolumen und fügen Sie einen Puffer von 50% für Schwankungen hinzu. Die meisten Planungsschätzungen unterschätzen die tatsächliche Nutzung um das Zwei- bis Dreifache.

Was passiert, wenn ich die Ratenbegrenzungen erreiche?

Die Antwort hängt vom Anbieter und Tarif ab. Einige Implementierungen stellen Anfragen in eine Warteschlange, andere geben Fehler aufgrund von Ratenlimits zurück, die eine Wiederholungslogik erfordern, und Premium-Tarife greifen möglicherweise auf alternative Modelle zurück. OpenAIs GPT-5.4 verwendet für zahlende Nutzer GPT-5.4 mini, sobald die Ratenlimits erreicht sind. Informationen zur tarifspezifischen Handhabung von Ratenlimits finden Sie in der Dokumentation Ihres Anbieters.

Gibt es Mengenrabatte für LLM-APIs?

Die meisten Anbieter bieten Unternehmenspreise mit Mengenrabatten an, die genauen Konditionen sind jedoch nicht öffentlich einsehbar. Organisationen, die monatlich mehr als 1 Milliarde Token verarbeiten, sollten sich direkt an die Vertriebsteams wenden. Die Rabatte liegen üblicherweise zwischen 10 und 301 Tsd. Token, abhängig von der Vertragslaufzeit und dem Nutzungsvolumen. Anthropic, OpenAI und Google bieten alle spezielle Vertriebsprogramme für Unternehmen mit individuellen Preisen an.

Schlussfolgerung

Die Preislandschaft von LLM ist weiterhin komplex und unterliegt einem schnellen Wandel. Stand März 2026 liegen die Kosten pro Token je nach Modellstufe und Tokentyp zwischen unter 1 TP4T1 pro Million und 1 TP4T25 pro Million.

Ökonomisch betrachtet ist die strategische Modellauswahl der Wahl der einfach günstigsten Option vorzuziehen. Claude Sonnet 4.6 bietet mit $3/$15 pro Million Token eine nahezu Spitzenleistung bei alltäglichen Aufgaben. GPT-4.1 von OpenAI liefert mit $2/$8 starke allgemeine Schlussfolgerungsfähigkeiten zu wettbewerbsfähigen Preisen. Claude Opus 4.6 ist mit $5/$25 zwar teurer, führt aber bei komplexen Programmier- und agentenbasierten Aufgaben.

Versteckte Kosten sind genauso wichtig wie der beworbene Preis. Schnelles Caching spart 501.030 Terabyte an wiederholten Eingaben. Die Verwaltung von Ausgabetoken verhindert Kostenexplosionen durch ausführliche Antworten. Hierarchische Architekturen reduzieren die Gesamtkosten um 601.030 Terabyte bei gleichbleibender Qualität.

Organisationen sollten die Gesamtbetriebskosten inklusive Ratenbegrenzung, Modell-Altstartzyklen und qualitätsbezogener Nachbearbeitung berechnen. Der niedrigste Preis pro Token führt oft zu den höchsten Gesamtkosten.

Beginnen Sie mit einem Benchmarking repräsentativer Workloads für verschiedene Kandidatenmodelle. Messen Sie dabei nicht nur die Genauigkeit, sondern auch die Anzahl der verbrauchten Token pro erfolgreich abgeschlossener Aufgabe. Berücksichtigen Sie spezifische Nutzungsmuster, Latenzanforderungen und den Bedarf an Kontextfenstern. Treffen Sie anschließend eine fundierte Entscheidung, die auf dem tatsächlichen Wert und nicht nur auf dem Preis basiert.